Introduction : Qu'est-ce que Seedance 2.0 ?

Seedance 2.0 est le successeur attendu du modèle de génération vidéo multimodale de ByteDance.

- L'amélioration : Alors que Seedance 1.5 Pro a posé les bases de la génération audiovisuelle native, la version 2.0 devrait introduire des « Champs de physique acoustique » et des « Priors de modèle du monde ».

- L'objectif : Combler le fossé entre la génération par l'IA et la réalité physique. Il vise à agir comme un réalisateur polyvalent, gérant des récits audiovisuels complexes pour des vidéos dépassant les 30 secondes.

Prédictions clés : 3 améliorations majeures dans Seedance 2.0 (Prévues)

1. De la synchronisation audio à la « physique acoustique »

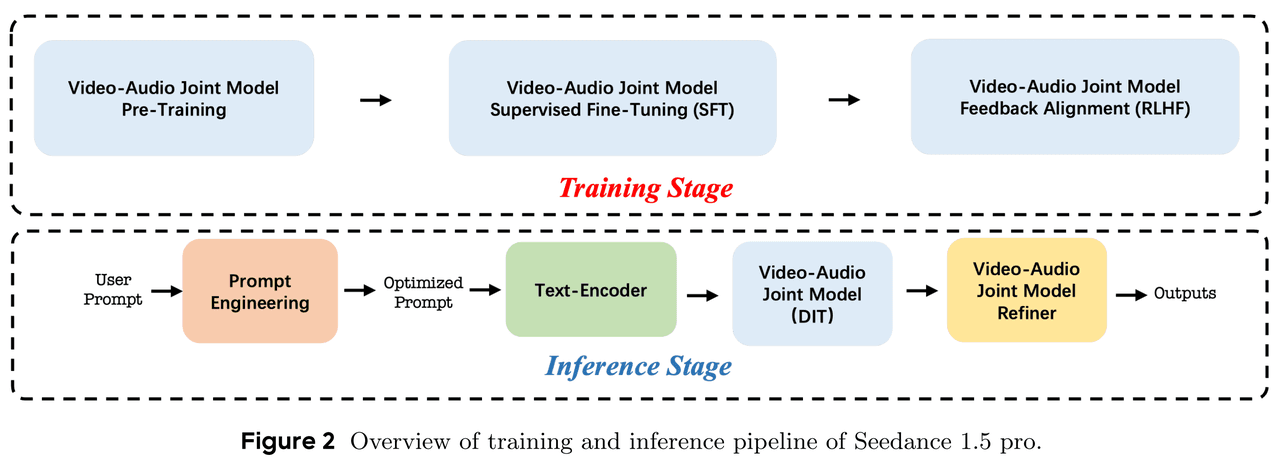

Seedance 1.5 Pro a utilisé un Transformateur de Diffusion à double branche (MMDiT) pour résoudre les problèmes de synchronisation labiale. Cependant, Seedance 2.0 devrait simuler un Champ acoustique complet.

- Physique multimodale réelle : Si un verre se brise dans la vidéo, l'audio généré ne sera pas un simple effet sonore générique. Il calculera la réverbération en fonction du matériau du sol (ex. : moquette vs carrelage) visible dans l'image.

- Priors latents : Cela implique l'ajout de priors de moteur physique à l'architecture MMDiT, donnant au son du « poids » et de l'« impact ».

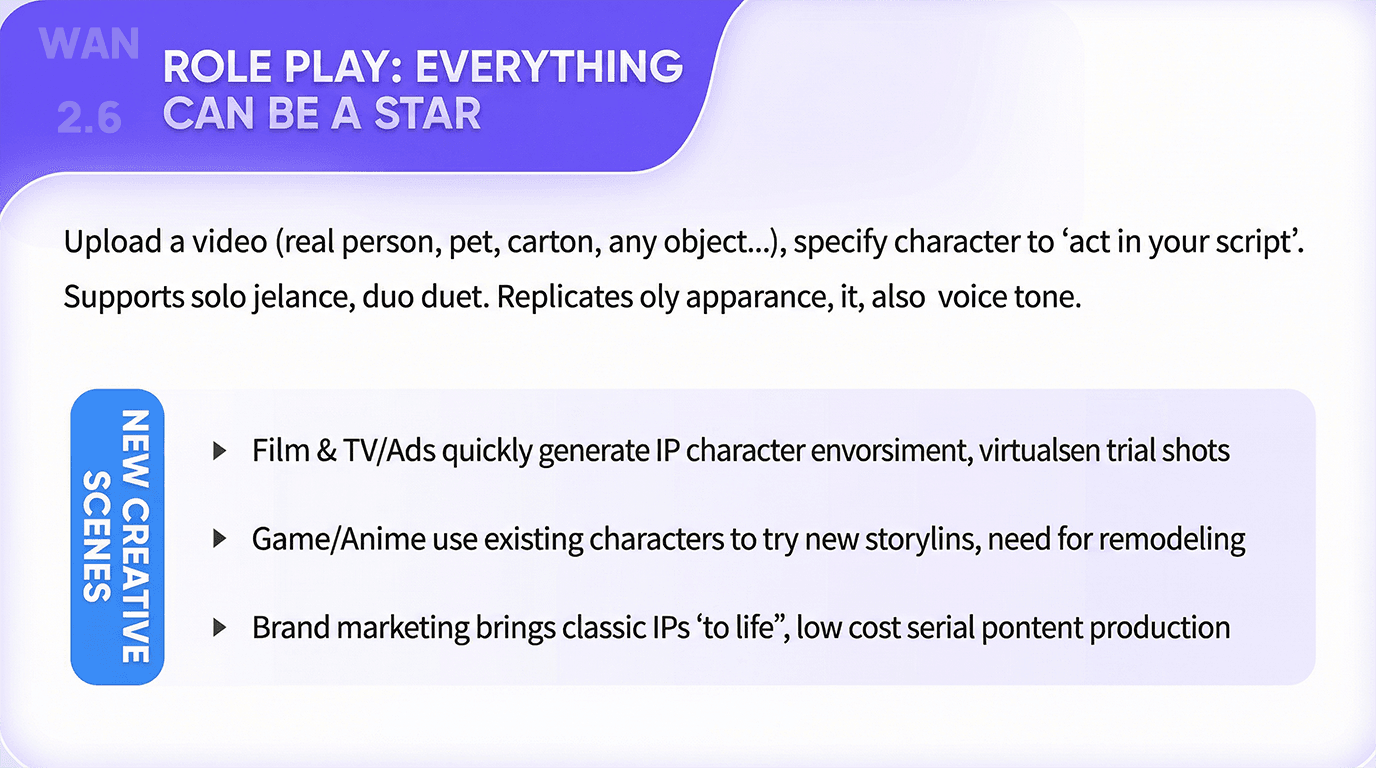

2. Face à Wan 2.6 : Cohérence dans les vidéos longues

- Actuellement, Wan 2.6 domine la cohérence des personnages avec sa fonction Reference-to-Video, qui agit comme un LoRA de personnage zero-shot. Seedance 2.0 devrait contrer cela en se verrouillant sur le « World ID ».

- Génération plus longue : Brisant la « malédiction des 12 secondes », Seedance 2.0 vise une cohérence native pour des vidéos de 30 à 60 secondes.

- Attention temporelle : Une optimisation post-entraînement améliorée permettra probablement au modèle de « se souvenir » des événements de la première seconde et d'y faire référence à la fin du clip.

3. Contrôle de niveau réalisateur

- Seedance 2.0 devrait introduire des capacités de Contrôle basé sur les nœuds et de Prévisualisation en temps réel.

- In-painting partiel et Remixage audio : Les utilisateurs pourraient être en mesure de sélectionner un personnage et de modifier son action ou l'émotion de son dialogue (ex. : de la colère à la supplication) tout en gardant la musique de fond et l'environnement inchangés.

Comparaison : Seedance 2.0 vs La concurrence

| Fonctionnalité | Seedance 1.5 Pro | Seedance 2.0 (Prévu) |

| Architecture | MMDiT (Audio-Visuel) | World-MMDiT (Physique + AV) |

| Audio | Synchro labiale, Alignement des émotions | Simulation physique, Interaction avec l'environnement |

| Durée | Court (~10s) | Long (30s-60s) |

| Charge de calcul | Élevée | Extrêmement élevée |

Comment accéder à Seedance 2.0 : Le défi matériel

La documentation technique de 1.5 Pro souligne que bien que l'optimisation ait multiplié la vitesse par 10, le passage aux capacités de « Modèle du monde » de Seedance 2.0 augmentera de manière exponentielle les besoins en VRAM et en calcul.

Exécuter Seedance 2.0 localement — même sur une NVIDIA RTX 4090 — sera probablement impossible pour la plupart des utilisateurs en raison de la charge massive de traitement multimodale.

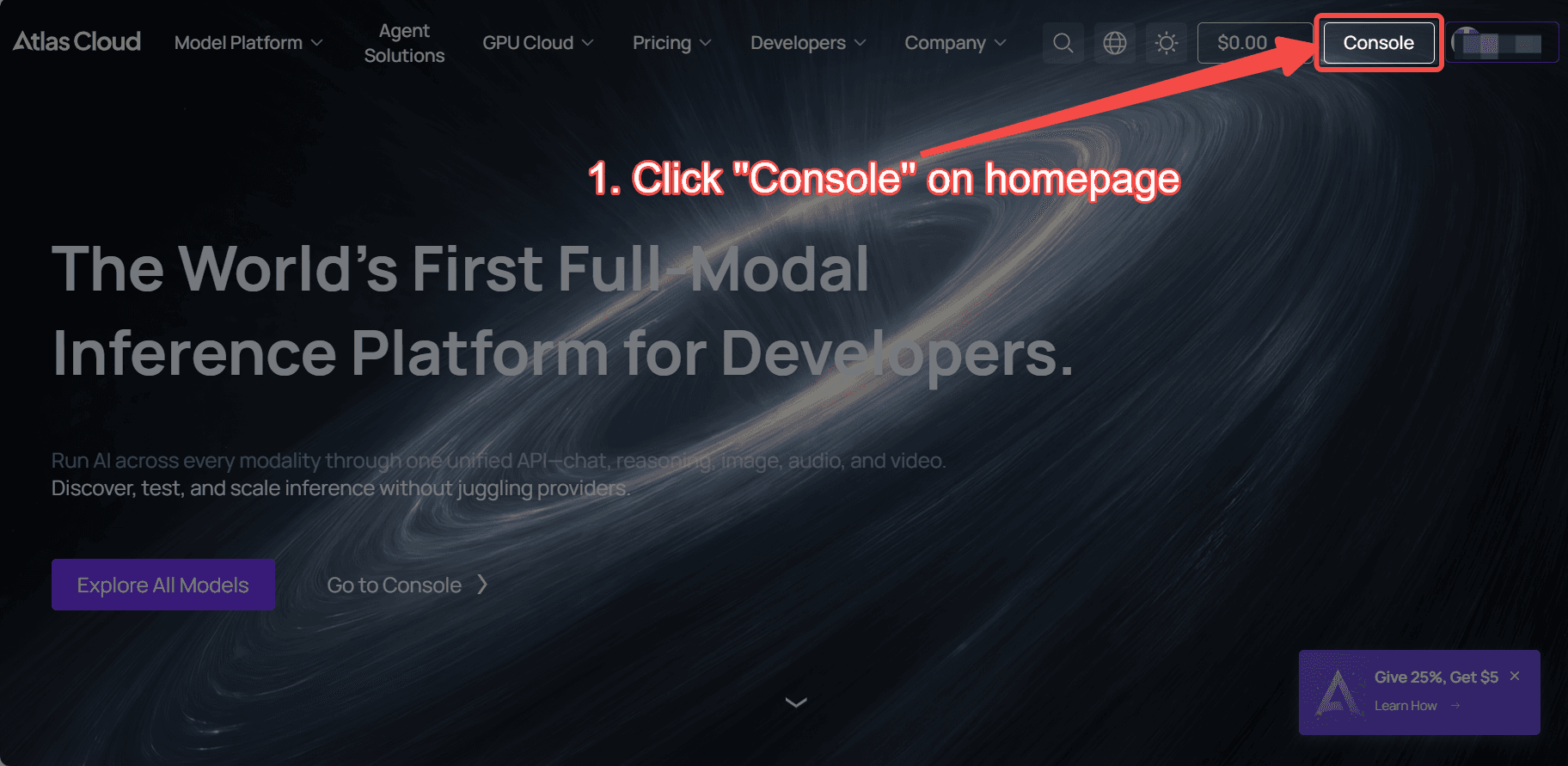

La solution : Atlas Cloud

Atlas Cloud est prêt pour le lancement. Nous avons intégré toute la famille de modèles Seedance et nous prendrons en charge Seedance 2.0 dès le Jour 0 de sa sortie.

- Déploiement sans configuration : Accédez à Seedance, Kling et des modèles de type Sora sans configuration complexe de Python ou CUDA.

- Calcul élastique : Augmentez votre puissance GPU instantanément. Payez à la seconde pour le rendu de vidéos longues et complexes sans épuiser votre matériel local.

- Accès API : Les développeurs peuvent intégrer les capacités de Seedance 2.0 directement dans leurs applications via l'API Atlas Cloud immédiatement après le lancement.

Ne laissez pas le matériel limiter votre créativité. [Inscrivez-vous sur Atlas Cloud] pour garantir votre accès prioritaire au lancement de Seedance 2.0 à la mi-février.

Comment utiliser sur Atlas Cloud

Atlas Cloud vous permet d'utiliser les modèles côte à côte — d'abord dans un playground, puis via une API unique.

Méthode 1 : Utiliser directement dans le playground Atlas Cloud

Méthode 2 : Accès via API

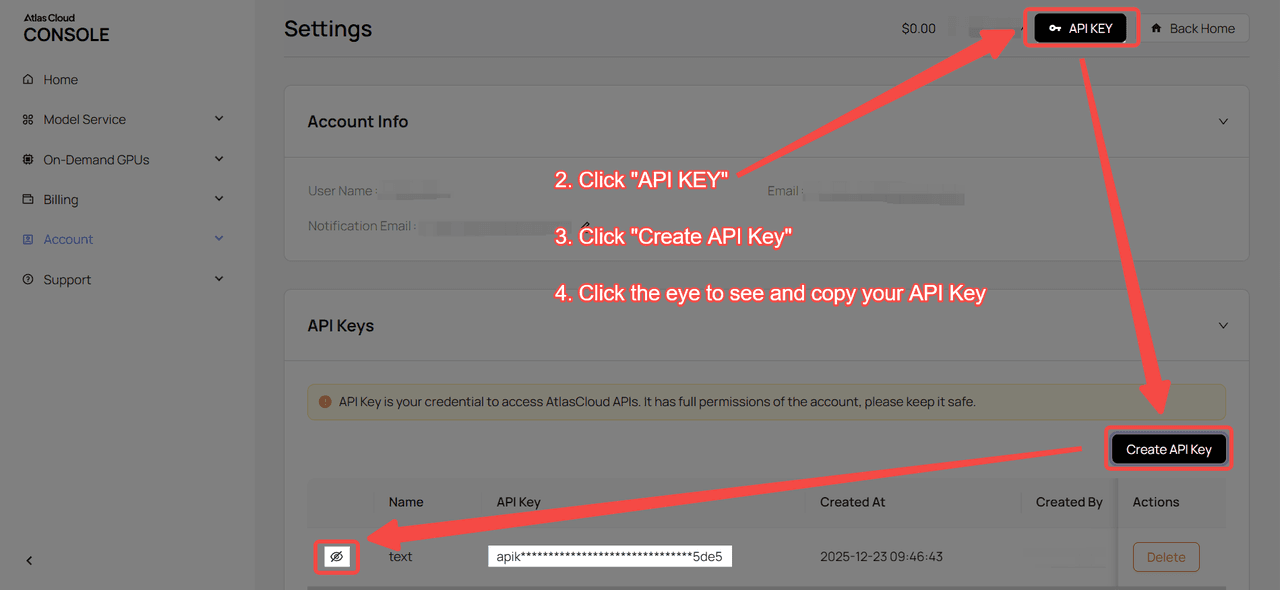

Étape 1 : Obtenez votre clé API

Créez une clé API dans votre console et copiez-la pour une utilisation ultérieure.

Étape 2 : Consultez la documentation de l'API

Consultez le point de terminaison, les paramètres de requête et la méthode d'authentification dans notre documentation API.

Étape 3 : Effectuez votre première requête (exemple Python)

Exemple : générer une vidéo avec Seedance 1.5 Pro :

plaintext1import requests 2import time 3 4# Step 1: Start video generation 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-v1.5-pro/image-to-video-fast", 12 "aspect_ratio": "16:9", 13 "camera_fixed": False, 14 "duration": 5, 15 "generate_audio": True, 16 "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png", 17 "last_image": "example_value", 18 "prompt": "Use the provided image as the first frame.\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.", 19 "resolution": "720p", 20 "seed": -1 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24generate_result = generate_response.json() 25prediction_id = generate_result["data"]["id"] 26 27# Step 2: Poll for result 28poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 29 30def check_status(): 31 while True: 32 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 33 result = response.json() 34 35 if result["data"]["status"] in ["completed", "succeeded"]: 36 print("Generated video:", result["data"]["outputs"][0]) 37 return result["data"]["outputs"][0] 38 elif result["data"]["status"] == "failed": 39 raise Exception(result["data"]["error"] or "Generation failed") 40 else: 41 # Still processing, wait 2 seconds 42 time.sleep(2) 43 44video_url = check_status()