DeepSeek v4:全貌解明 — 功能特性、发布日期及如何在 Atlas Cloud 上使用

前言:什么是 DeepSeek v4?

AtlasCloud 正通过即将推出的 DeepSeek v4 进一步扩充其生成式 AI 工具库。

- 定义: DeepSeek 团队的最新旗舰模型。如果说 DeepSeek v3.2 为高性价比开源编码模型树立了标杆,那么 v4 则通过专有的 流形约束超连接 (mHC) 和 印迹记忆 (Engram Memory) 技术,突破了逻辑与内存的边界。

- 核心优势: 不仅仅是生成代码片段,v4 更像是一位资深架构师,能够理解整个代码库结构,进行跨文件推理和复杂的 Bug 修复。

- 状态: 即将发布(预计 2026 年 2 月中旬)。

为什么我们如此确信 DeepSeek v4 是下一个改变游戏规则的产品?因为它解决了行业最大的痛点:AI 需要记忆并理解项目的逻辑。

📣 更新 — 2026 年 4 月 24 日: DeepSeek-V4 已正式发布。阅读我们关于实际发布内容的全面报道,包括全新的稀疏注意力架构、1M token 上下文及 Agent 基准测试结果 — 请参阅 DeepSeek-V4 预览版发布。

技术深入解析:核心特性

为了挑战 Claude Opus 4.5,DeepSeek 对模型进行了彻底的重构。泄露的论文表明,该模型在处理内存和逻辑稳定性方面发生了根本性转变。让我们剖析此次更新的四大支柱。

架构:卓越的逻辑推理

-

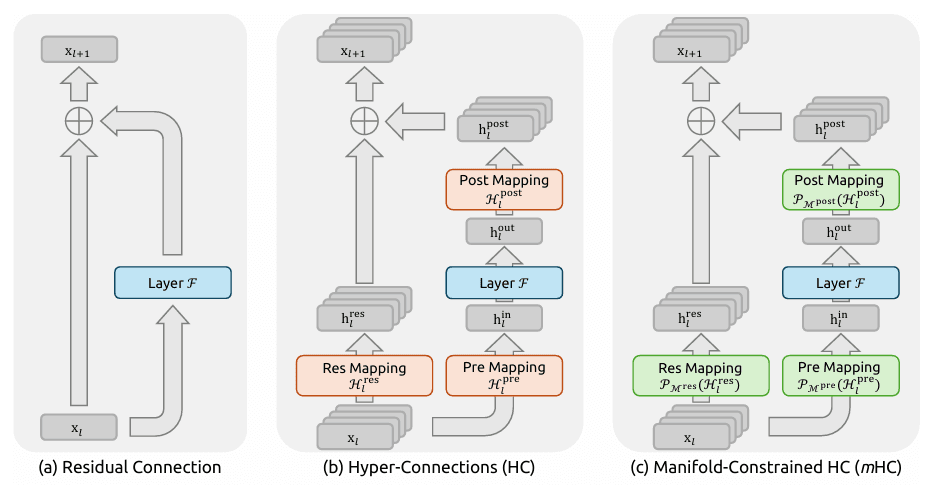

流形约束超连接 (Manifold-Constrained Hyper-Connections, mHC)

- 概念: DeepSeek v4 创造了一种全新的“神经连线”方法。传统的连接方式在深度网络中容易丢失信息,而 mHC 充当了 AI 大脑的“逻辑高速公路”。

- 成果: 在处理海量且复杂的逻辑(如重构数千行代码)时,模型学习速度更快,逻辑保留能力更强。这消除了长上下文生成中常见的“逻辑幻觉”和不一致性。

效率:降低推理成本

-

混合专家模型 (MoE) 2.0

- 概念: 虽然 v4 是一个参数巨兽(数千亿参数),但它采用了优化的 MoE 架构,仅为每个 token 激活最相关的“专家”。

- 成果: 在高性能(庞大的知识库)与高效扩展(运行起来像较小模型一样轻量)之间实现了完美平衡。

-

稀疏注意力 (Sparse Attention)

- 概念: 放弃了扫描所有文本的暴力方法,模型现在能够智能地仅关注关键信息。这大幅降低了计算成本,并加速了长上下文处理。

内存:智能上下文管理

-

印迹记忆 (Engram Memory - 选择性存储与回溯)

- 概念: AI 不再死记硬背,而是开始“理解”。它能识别项目结构、遵循命名规范(如 snake_case 与 camelCase),并识别编码模式(模仿你们团队特定的工程模式)。

- 成果: 它的编程表现如同资深员工。

-

多头潜在注意力 (Multi-Head Latent Attention, MLA)

- 概念: 可以将其视为“超级速记”。其他模型需要 100 个 token 来存储信息时,MLA 将其压缩为 10 个关键符号。

- 成果: 当需要回溯时,模型通过数学方式无损地重构出原始含义。这在显著降低显存占用的同时,保持了惊人的细节保留能力。

应用:工程实战

- 仓库级理解与 Bug 修复

- 目标不仅仅是编写函数,而是掌控代码库。在 SWE-bench 测试中,DeepSeek v4 通过理解跨文件依赖关系,旨在解决超过 80.9% 的真实复杂问题。

用例:削减成本与提升效率

DeepSeek v4 是为高强度工程设计的。以下是它与竞争对手的对比:

重构遗留代码

对于文档缺失、混乱的遗留系统,mHC 架构是救命稻草。它能追踪远距离逻辑依赖,从而实现安全重构。

- 对比 GPT-4o: 当上下文超过 10k token 时,GPT-4o 经常出现“逻辑幻觉”(编造不存在的函数调用)。DeepSeek v4 在长上下文中保持了 100% 的逻辑一致性。

- 对比 Claude 3.5 Sonnet: 虽然 Sonnet 质量很高,但对于大规模重构任务来说,其速度较慢且成本高昂。DeepSeek v4 的 MoE 架构在 Atlas Cloud 上提供了约 40% 更快的推理速度,且成本更低。

仓库级功能开发

在成熟项目中添加新 API 时,v4 使用“印迹记忆”瞬间掌握上下文。

- 对比传统自动补全: 标准工具往往忽略项目特定的规范,导致风格不统一。DeepSeek v4 模仿现有代码库的效果极佳,写出来的代码感觉就像是你最优秀的开发者写的。

全链路 Bug 追踪

瞄准 SWE-bench 上 80.9% 的成功率,意味着需要处理跨越前端、后端和数据库的 Bug。

- 对比 Claude Opus 4.5 (预计): Opus 4.5 功能强大,但定价昂贵。DeepSeek v4 以接近 SOTA(当前最高水平)的性能,提供了能够进行迭代式“反思与纠正”的性价比,且不会超支。

📉 总结:团队的投资回报率 (ROI)

对于初创公司和开发团队,DeepSeek v4 + AtlasCloud 的组合带来了切实可见的 ROI:

- 生产力: 将资深开发者的编码时间缩短 30-50%。

- 成本: 与租赁双 RTX 4090 服务器或支付昂贵的闭源 API 费用相比,AtlasCloud 的集成 API 可为团队节省超过 60% 的综合计算成本。

硬件红线:本地部署?三思而后行。

此时,你可能想在本地机器上运行这个“编程之神”。但我们必须提醒你:性能是有代价的。

- 最低门槛:双 RTX 4090

- 换算: 你需要购买两块市面上最昂贵的消费级 GPU 并组装在一起。仅 GPU 的成本就大约相当于 3 部 iPhone 17 Pro Max(或一辆体面的二手车)。

- 推荐配置:单 RTX 5090 (2026 旗舰)

- 换算: 这是 GPU 中的“法拉利”。不仅会因黄牛炒作导致价格极高,且供货极其稀缺。

在 GPU 价格居高不下的情况下,问问自己:仅仅为了运行一个模型,花费数千美元并忍受风扇噪音、散热压力和复杂的环境配置,真的值得吗?

智能方案:Atlas Cloud 零日访问

使用 DeepSeek v4 不需要你财力雄厚,只需要你足够聪明。不要购买会贬值的“电子砖块”,选择云端。

Atlas Cloud 已为发布做好准备:

-

我们的承诺: 享受假期,将繁琐的部署工作交给我们。我们全天候 24/7 监控官方发布渠道。

-

核心优势:

- 即刻访问: 开源权重一经发布,我们的 API 集成即刻上线。

- 零门槛: 无需昂贵硬件,无需面对 CUDA 依赖地狱。只需带上你的 Prompt。

- 极致体验: 我们提供完整的上下文支持,确保“印迹”记忆机制在 100% 容量下运行,且无量化损失。

如何在 Atlas Cloud 上使用

Atlas Cloud 允许你并排使用模型 — 先在 Playground 中测试,再通过单一 API 调用。

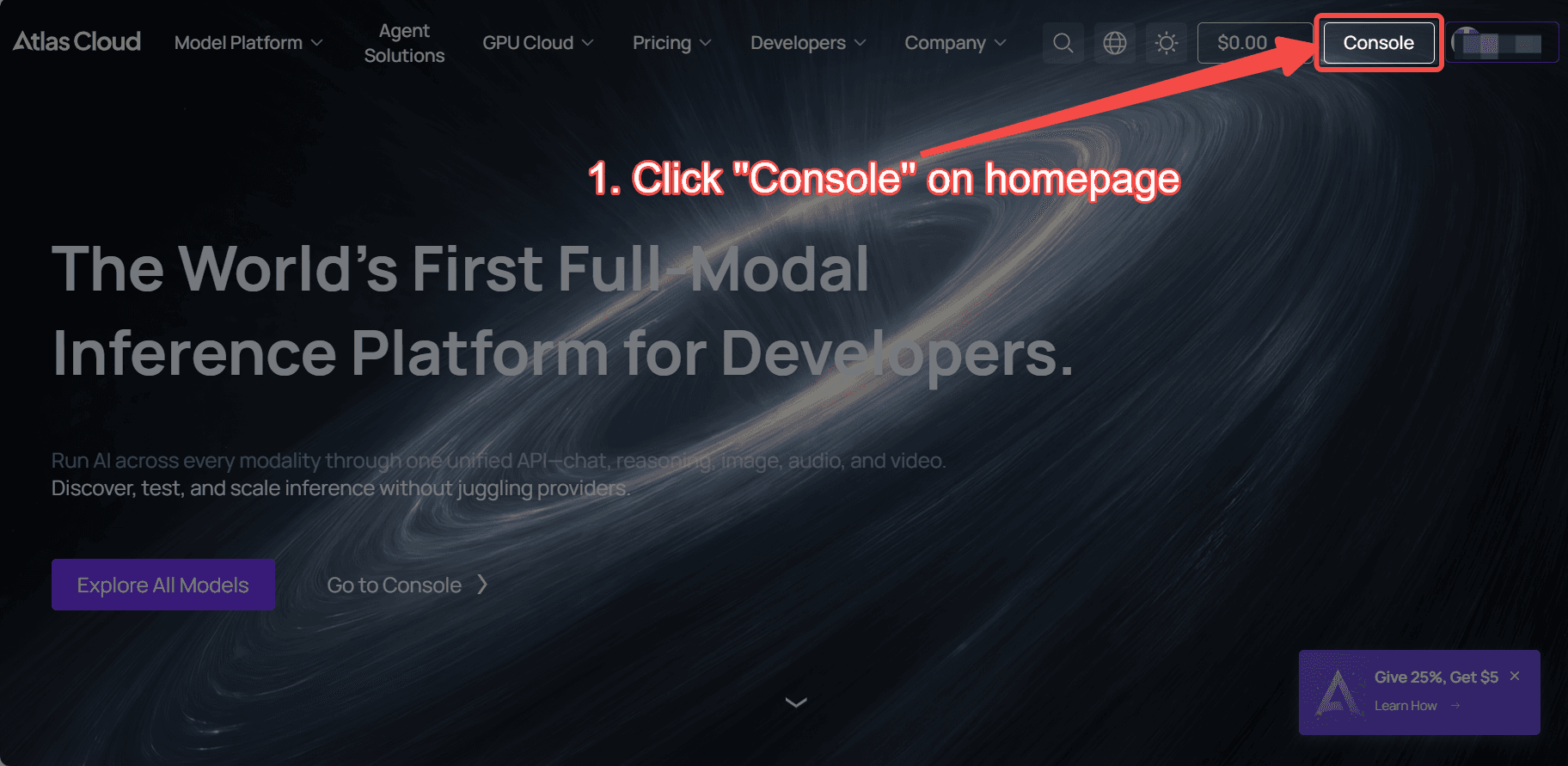

方法 1:直接在 Atlas Cloud Playground 中使用

方法 2:通过 API 访问

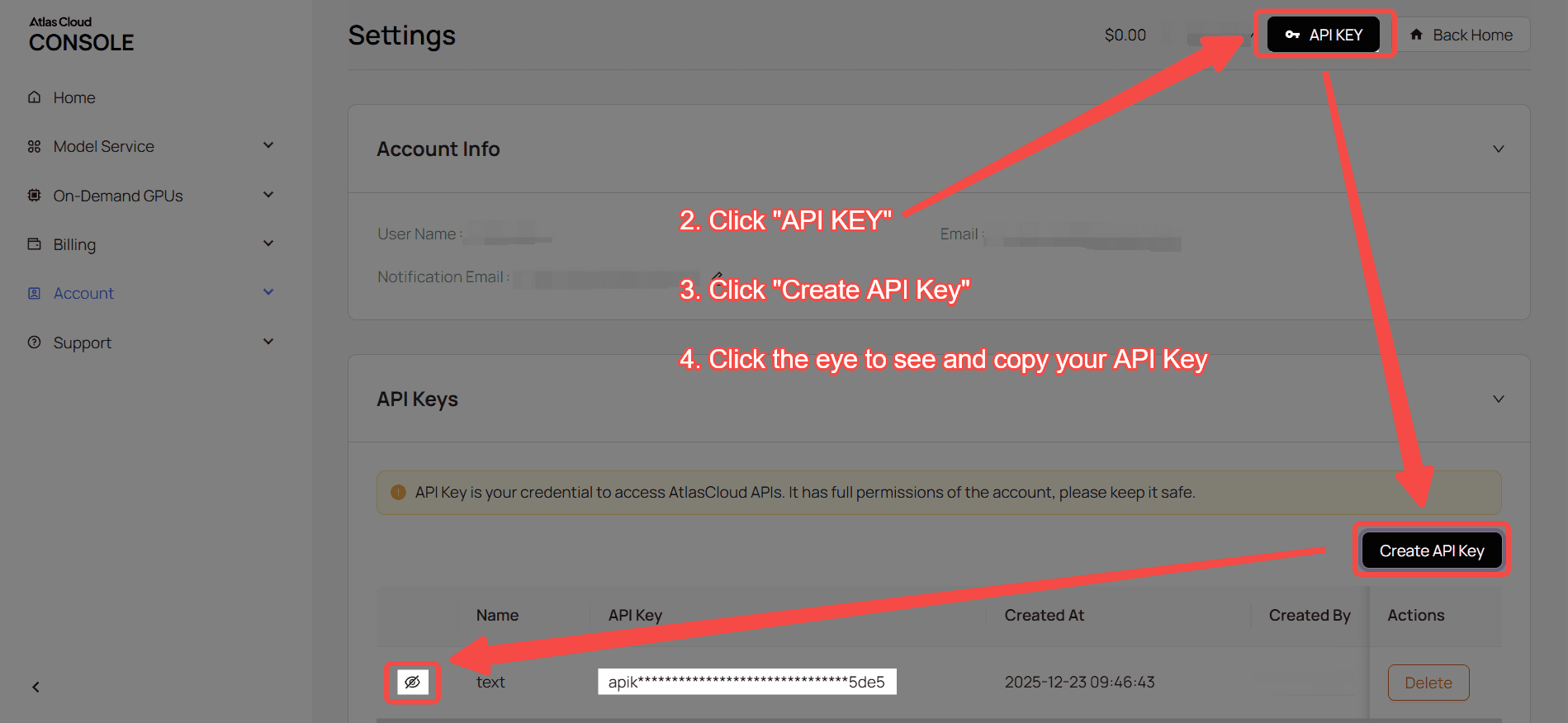

步骤 1:获取 API Key

在你的控制台中创建 API Key 并复制以备后用。

步骤 2:查看 API 文档

在我们的 API 文档 中查阅端点、请求参数和认证方法。

步骤 3:发起你的第一个请求(Python 示例)

示例:使用 DeepSeek v3.2 生成内容:

plaintext1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "deepseek-ai/deepseek-v3.2", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "what is difference between http and https" 14 } 15 ], 16 "max_tokens": 32768, 17 "temperature": 1, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())