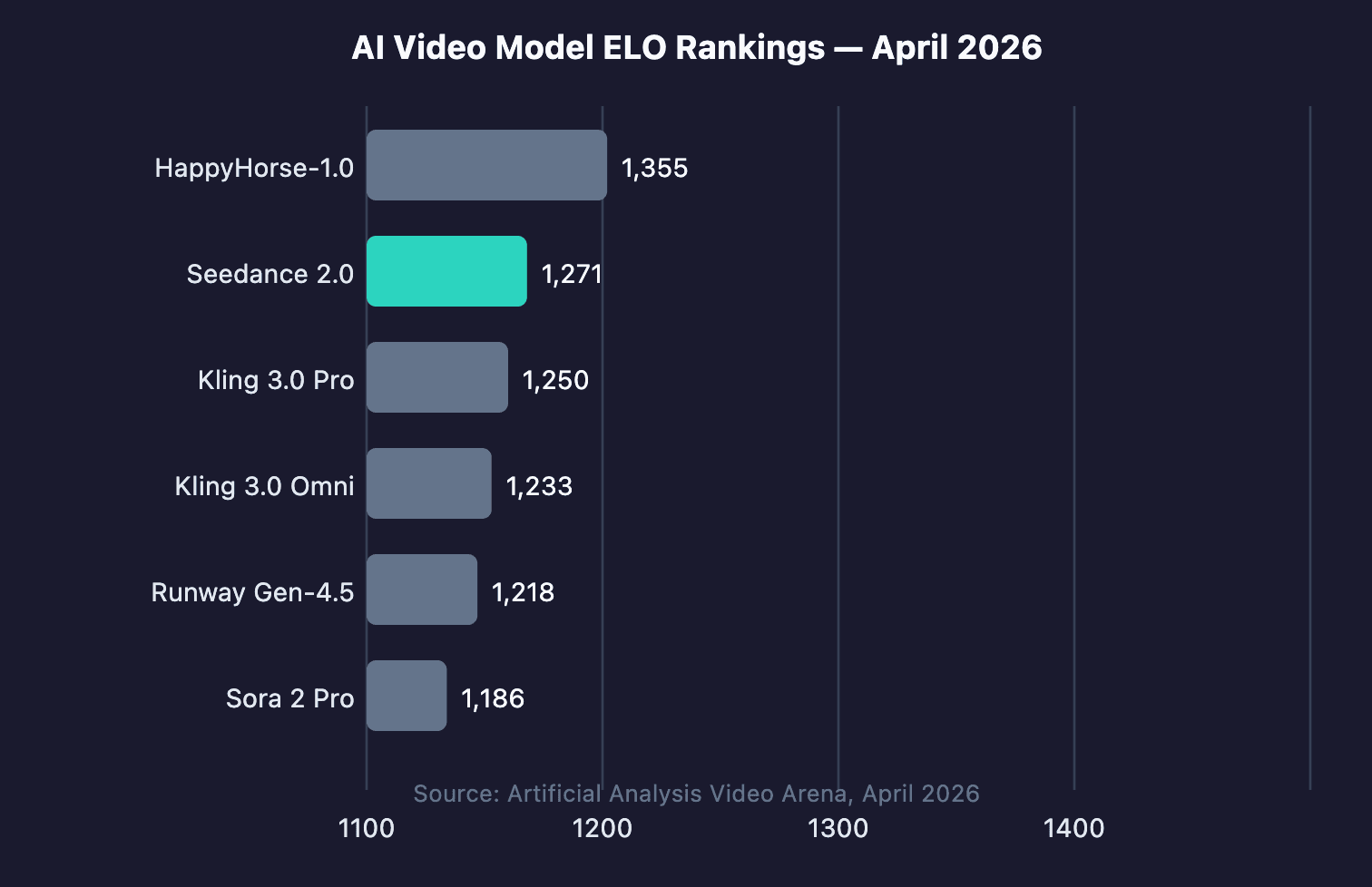

Seedance 2.0の利用方法に関する、明確で実践的なガイドをお探しなら、ここが最適な場所です。かつて60秒のマーケティング動画を制作するには13日かかっていましたが、Seedance 2.0のようなAI動画ツールを使えば、同じ作業がわずか27分で完了します。これは制作時間を99.7%削減したことになります(Zebracat via AutoFaceless, 2026)。ByteDanceは2026年2月12日にSeedance 2.0をリリースし、現在Artificial Analysis Video ArenaにおいてELOスコア1,271で世界第2位にランクインしています。

本ガイドでは、米国、インド、その他の中国以外の国々でSeedance 2.0を利用するための主なアクセス方法を網羅しています。

要点

- Seedance 2.0はDreaminaおよびCapCutを通じて世界中で利用可能です。VPNや中国の電話番号は不要です。

- Dreaminaの無料プランでは、毎日225トークン(ウォーターマーク付き)が付与されます。有料プランは月額18ドルからです。

- 米国や国際的な開発者にとって、Atlas Cloudは1秒あたりUSD0.081という最も手頃なAPIアクセスを提供します。

- このモデルは、@AssetName構文を使用して、テキスト、画像、音声、動画を一度のマルチモーダル処理で受け入れます。

- 2026年には企業の91%が動画マーケティングを活用しており(Wyzowl via Ngram, 2026)、AI制作は従来の動画制作と比較してコストを最大91%削減します。

Seedance 2.0を無料で使う方法 - ステップバイステップチュートリアル

Seedance 2.0を無料で使う方法は、多くのユーザーが最初に抱く疑問です。Dreaminaでは毎日225の共有トークンを無料で提供しており、これを使って1日あたり約10〜15本の短い動画クリップを生成できます。

無料オプション1:Dreamina(推奨)

ステップ1:ブラウザから dreamina.capcut.com にアクセスします。ダウンロードは不要です。プラットフォームはグローバルに展開されており、Googleアカウント、Apple ID、またはメールアドレスで無料でサインアップできます。クレジットカードは不要です。

ステップ2:左側のサイドバーにある「Create」をクリックして、動画生成パネルを開きます。パネル上部のモデルドロップダウンから「Seedance 2.0」を選択します。標準(Standard)と高速(Fast)のバリエーションが表示されます。

ステップ3:「被写体 + アクション + シチュエーション + ムード + カメラワーク」という5つの要素でプロンプトを作成します。例:「木製のテーブルに置かれたセラミックのコーヒーカップ、立ち上る湯気、温かいキッチンの光、ゆっくりと前方に寄るドリーショット」。持続時間(無料プランでは4〜8秒を推奨)とアスペクト比(ワイドスクリーンは16:9、縦型SNSは9:16)を設定します。

ステップ4:「Generate」をクリックします。各クリップで約15〜20トークンを消費します。毎日の225トークンは24時間ごとに更新されます。動画をダウンロードしてください。無料版にはウォーターマークが入ります。これを取り除くには、月額18ドルのスタンダードプランへアップグレードしてください。

無料オプション2:CapCutアプリ

CapCutは、同一のByteDanceアカウントを使用してDreaminaとトークンプールを共有しています。App StoreまたはPlay StoreからCapCutをダウンロードし、同じアカウントでログインして「AI Video」をタップするとSeedance 2.0にアクセスできます。トークンは共有されており、CapCutで消費すればDreaminaの残高も減少し、その逆も同様です。

開発者向けSeedance 2.0 API

開発者や企業にとって、Atlas Cloudを経由するAPIルートは、最も費用対効果が高く、迅速な統合パスです。

Atlas Cloudは、開発者や企業が300以上のAIモデルに統合的にアクセスできるAI APIアグリゲーションプラットフォームで、Seedance 2.0の全6バリエーションにも対応しています。単一のAPIキー、一元化された請求ダッシュボード、単一のベースURLで動作するため、ByteDanceとの直接の企業契約を交わすことなく、あらゆるアプリケーションやパイプラインにSeedance 2.0を組み込む最短の方法です。

Atlas Cloudの主な特徴

- 1つのAPIキーで300以上のAIモデル(動画、画像、LLM、音声)にアクセス可能

- Seedance 2.0の全6バリエーションに対応:text-to-video, image-to-video, reference-to-video(標準および高速)

- Seedance 2.0 Fastは1秒あたりUSD 0.081。主要プラットフォーム中で最低コスト

- OpenAI SDK互換のエンドポイント(ドロップイン置換が可能)

- 従量課金制、月額サブスクリプション不要

- 国際的なデータコンプライアンスに準拠した99.9%の稼働率SLA

- 100以上のIDEクライアントに対応したMCPサーバー統合

- クレジットカード、PayPal、暗号資産、WeChat Pay、Alipayに対応

方法1:Atlas Cloud Playgroundでの直接利用

コードは不要です。atlascloud.aiにサインアップし、「Models」ページからSeedance 2.0を検索して「Try in Playground」をクリックします。ブラウザ上で直接プロンプトを入力し、設定を選んで生成してください。APIを構築する前にアイデアを検証する最も早い方法です。

方法2:API経由でのアクセス

ステップ1:APIキーを取得する

atlascloud.ai/console/api-keysにアクセスします。「Create API Key」をクリックし、名前を付けて保存してください。一度しか表示されないため、すぐにコピーして

1ATLASCLOUD_API_KEY

ステップ2:APIドキュメントを確認する

詳細なリファレンスはatlascloud.ai/docsにあります。全パラメータ、モデルID、リファレンスファイルのアップロードエンドポイント、ポーリングのライフサイクルが記載されています。実装前に5分ほど読むことをお勧めします。

ステップ3:最初のリクエストを実行する

流れは常に同じです:生成ジョブの送信 → 予測IDの取得 → 完了までのポーリング → 動画URLの取得。以下はPythonを使用した開始用のサンプルコードです:

plaintext1import requests 2import time 3 4# ステップ1: 動画生成を開始 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/text-to-video", # 必須: モデル名 12 "prompt": "A cinematic view of the endless ocean at sunrise, golden sunlight spreading " 13 "across the deep blue sea, powerful waves rising and crashing with white foam. " 14 "The camera flies low above the water surface, water droplets and mist glowing " 15 "in the light. Epic cinematic atmosphere, 4K.", 16 "duration": 5, # 動画の長さ (4–15秒)、または自動設定の場合は-1 17 "resolution": "720p", # オプション: 480p | 720p 18 "ratio": "adaptive", # 9:16 | 16:9 | 1:1 | 4:3 | adaptive 19 "generate_audio": True, # 同期された音声、SFX、BGMを生成 20 "watermark": False, 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24prediction_id = generate_response.json()["data"]["id"] 25 26# ステップ2: 結果をポーリング 27poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 28 29def check_status(): 30 while True: 31 response = requests.get( 32 poll_url, 33 headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"} 34 ) 35 result = response.json() 36 status = result["data"]["status"] 37 38 if status in ["completed", "succeeded"]: 39 video_url = result["data"]["outputs"][0] 40 print("生成された動画:", video_url) 41 return video_url 42 elif status == "failed": 43 raise Exception(result["data"].get("error", "生成失敗")) 44 else: 45 time.sleep(2) # 処理中 — 2秒後に再チェック 46 47video_url = check_status()

Atlas CloudのSeedance 2.0 Fastティアは1秒あたりUSD 0.081で、Kling 3.0のUSD 0.153/秒と比較して低コストです。リファレンスファイルのアップロードは課金対象外であり、生成された動画の長さに対してのみ課金されます。新規アカウントにはクレジットカード不要で1ドルの無料クレジットが付与されます(Atlas Cloudドキュメント, 2026)。

Seedance 2.0とは何か、なぜ重要なのか?

2026年4月、Seedance 2.0はArtificial Analysis Video ArenaでELOスコア1,271を獲得し、世界第2位にランクインしました。音声対応モデルとしては1,221で第1位です。このランキングが示す事実は、複数のツールを組み合わせるのではなく、テキスト、画像、動画クリップ、音声を単一の統合プロセスで処理できる数少ないモデルの一つであるということです。

ByteDanceはSEEDラボ内でSeedance 2.0を構築し、2026年2月12日に公開しました。このアーキテクチャは「統一マルチモーダル音声・動画共同生成」と呼ばれます。具体的には、プロンプトにオプションのリファレンス画像、動画クリップ、音声ファイルを加えるだけで、モデルがこれらすべてを一度に処理します。個別の音声同期ステップや手動のリップシンク作業は不要です。

出力解像度はDreamina UI経由で最大1080p、API経由で720pです。4秒から15秒のクリップを21:9、16:9、4:3、1:1、3:4、9:16の6つのアスペクト比で生成できます。最後のアスペクト比はSNSコンテンツにおいて非常に重要です。すべての出力には、ファイルメタデータにC2PAの来歴ウォーターマークが焼き込まれています。

なぜELOの差が重要なのでしょうか?Kling 3.0 Proのスコアは1,250、Runway Gen-4.5は1,218です。この21〜53ポイントの差は、複雑なシーンにおける動きの滑らかさとプロンプトへの忠実度に目に見える違いをもたらします。独自のユースケースでA/Bテストを行う価値はありますが、Seedance 2.0は映画的なカメラワークと多言語音声において優位に立つ傾向があります。

Seedance 2.0は2026年4月のArtificial Analysis Video ArenaにおいてELOスコア1,271を記録し、すべてのtext-to-videoモデルの中で世界2位、並行して行われた音声サブリーダーボードで1,221を記録した音声対応モデルの中では1位を獲得しました(Artificial Analysis Video Arena, 2026年4月)。

AI動画市場自体も急成長しています。Fortune Business Insightsによると、世界のAI動画生成市場は2025年に7億1,680万ドル規模となり、2026年には8億4,700万ドルへ18.8%の年間成長を遂げると予測されています。Grand View Researchも2026年のデータとして、2033年までの年平均成長率(CAGR)20.3%で9億4,640万ドルに達すると評価しています。これらの数字は、これがニッチな実験ではなく、今のツール選択が数年先に影響を与える成長市場であることを裏付けています。

Seedance 2.0の高度なプロンプトとマルチモーダル入力

2026年には、動画マーケターの63%がマーケティング動画の作成や編集にAIツールを使用しています(Wyzowl via Ngram)。平凡な出力とプロレベルの仕上がりの差は、プロンプトの精度にあります。Seedance 2.0のマルチモーダル入力は強力なプロンプトをより効果的にしますが、多くのガイドでは触れられていない失敗の可能性も生じます。

@AssetNameリファレンスタグの使用

@AssetName構文は、アップロードしたファイルをシーン内の特定の役割にリンクさせる方法です。製品ショット、背景動画、BGMファイルをアップロードし、「@product_front on a minimalist desk, slow orbit, jazz @ambient_track playing softly.」と入力できます。モデルは画像を視覚的なアンカーとして、動画クリップをモーションのリファレンスとして、音声をサウンドレイヤーとして使用します。これがテキストのみの生成に対する核心的なアドバンテージです。

カメラコントロールオプション

Seedance 2.0は、dolly(前後移動)、pan(左右回転)、push(モーション付きズーム)という3つの指定カメラワークをサポートしています。これらは映画監督レベルの用語であり、プロンプト内でリテラルとして扱ってください。「Slow dolly push forward」は「zoom in」とは異なる結果を生みます。1クリップにつき1つのカメラワークを使用してください。8秒のクリップ内で2つの動きを重ねると、通常は視覚的なアーティファクトが発生します。

プロンプトの失敗と修正

一貫して見られるパターンとして、曖昧なプロンプトは曖昧な結果を生みます。同じ製品ショットに対する2つのプロンプトの違いを考えてみてください:

修正前(弱い): "Show a water bottle in a nice setting with good lighting." 修正後(強い): "@bottle Translucent blue water bottle on a wet stone surface, water droplets catching morning light, forest background blurred, slow dolly push, cool cinematic tone."

弱いバージョンでは一般的なスタジオモックアップが作成されますが、強いバージョンでは実際の広告に使用できるレベルの映像が生成されます。何が変わったのでしょうか?表面の質感、光源、背景の奥行き、カメラワークの具体性です。「nice」や「good」といった形容詞ではなく、具体的な名詞と精密な記述にモデルが反応するのです。

Seedance 2.0は、dolly、pan、pushなどの映画監督レベルのカメラ制御をサポートしています。プロンプト内ではカメラワークを文字通りの指示として扱ってください。出典: Unsplash / Harrison Kugler.

Seedance 2.0は1リクエストにつき最大12個のリファレンスファイル(画像9枚、動画クリップ3本、音声ファイル3本)を受け入れ、@AssetName構文を使用して、すべてを一度のマルチモーダルパスで処理します。ELOランキング上位6位以内で、このレベルの複合入力制御を提供している競合他社はありません(ByteDance SEEDラボドキュメント, 2026)。

Seedance 2.0に関するよくある質問

- Seedance 2.0は無料で使えますか?

はい、一定の範囲内であれば可能です。Dreaminaの無料ティアには毎日225の共有トークンが含まれており、すべての出力にウォーターマークが追加されます。有料プランは月額18ドルからで、ウォーターマークが削除され、トークン制限が増加します。AI動画プラットフォームの月間アクティブユーザー数は2026年1月に1億2400万人に達しており(Ngram, 2026)、ピーク時には無料枠が混雑する可能性があります。

- Seedance 2.0で生成可能な動画の最大長は?

Dreamina UIおよびAPIの両方で、単一クリップの最大長は15秒、最小は4秒です。それ以上の動画が必要な場合は、@AssetNameタグを使用して、一貫したリファレンスアセットを使いながら複数のクリップを繋げてください。これは2026年の主要AI動画モデルにおけるプロフェッショナルなワークフローの構造と一致しています。

- コスト面でSora 2と比較するとどうですか?

APIレベルで見ると、Atlas Cloud経由のSeedance 2.0 Fastは1秒あたりUSD 0.022で、10秒のクリップでUSD 0.22です。Sora 2は約1秒あたりUSD 0.15であり、同じクリップでUSD 1.50かかります。Seedance 2.0は約7倍のコスト優位性があります。ELOスコアが1,271対1,186であることを踏まえると、コストパフォーマンスは明らかにSeedanceに軍配が上がります(Atlas Cloud, 2026年3月)。

- Seedance 2.0の出力を商用利用できますか?

有料のDreaminaプランおよびAPI経由での商用利用は、ByteDanceの利用規約に従うことを条件に許可されています。すべての出力にはC2PAの来歴メタデータが埋め込まれており、一部の広告プラットフォームやブランドセーフティツールで検出可能です。有料キャンペーンを実施する前に、各プラットフォームのAIコンテンツ開示ポリシーを確認してください。従来の制作費が1分あたり4,500ドルであるのに対し、AIは1分あたり400ドルであるため(vidBoard.ai, 2026)、コンプライアンスの遵守は重要です。

- APIでの生成にはどれくらい時間がかかりますか?

AtlasCloud API経由の生成時間は、1クリップあたり30〜120秒です。ブロックリクエストではなく、非同期の「送信→ポーリング→ダウンロード」パターンを使用してください。バッチワークフローの場合は、すべてのジョブを先に送信してから、結果をポーリングします。

- VPNを使わずに中国外でSeedance 2.0を使うには?

VPNは不要です。中国外でSeedance 2.0を使う方法:どの国からでも dreamina.capcut.com に直接アクセスしてください。DreaminaはJimeng(中国国内専用)とは完全に分離された国際プラットフォームです。米国、英国、インド、日本、およびヨーロッパの大部分を含む130カ国以上で利用可能です。APIアクセスの場合は、Atlas Cloudやfal.aiが地理的制限なしで利用可能です。

- CapCutでSeedance 2.0を使うには?

アプリストアからCapCutをダウンロードし、ログインして「AI Video」をタップします。モデルピッカーからSeedance 2.0を選択し、プロンプトを入力してアスペクト比と長さを設定し、「Generate」をタップします。CapCutは、同じByteDanceアカウントのDreaminaと同一のトークンプールを共有しています。ByteDanceは2026年4月に、CapCutのグローバルアクセスを150カ国以上に拡大しました。

- 開発者がSeedance 2.0 APIを使う方法は?

atlascloud.aiにサインアップし、APIキーを作成し、アカウントにチャージ(最低10ドル)します。status:"completed"になるまで5秒ごとにステータスをポーリングしてください。Seedance 2.0 Fastは1秒あたりUSD 0.022で、約USD 0.15のSora 2より7倍安価です(Atlas Cloud, 2026年3月)。