あなたのプロンプトが拒否されたのは、それが有害だったからではなく、特定のキーワードがフィルターに触れたためです。

Ollamaコミュニティの開発者は、これを「拒否ベクトル(refusal vectors)」と呼んでいます。これは、実際の有害性とは無関係にキーワードでブロックされる仕組みです。セキュリティ研究のためのマルウェアのリバースエンジニアリング、医療症例の記録、アダルトコンテンツの作成、ダークフィクションの執筆など、主流のAIはこれらをすべて一律にブロックします。本稿では、マーケティングコピーではなく、実際のコミュニティデータに基づいた2026年版の最高性能なアンセンサード(検閲なし)AIモデルをランキング形式で紹介します。内容は「テキストおよびコード向けアンセンサードLLM」「プライベートなハードウェア環境に最適なアンセンサードローカルAIモデル」「API経由で利用可能なアンセンサード画像・動画生成AI」の3つのカテゴリに分かれており、すべての数値は2026年5月時点のソースに基づいています。

より広いツール環境を知りたい初心者の方向けには、まず「アンセンサードAI画像生成ガイド」を読んでからモデルを選択することをお勧めします。

2026年版 アンセンサードAIモデルのランキング手法

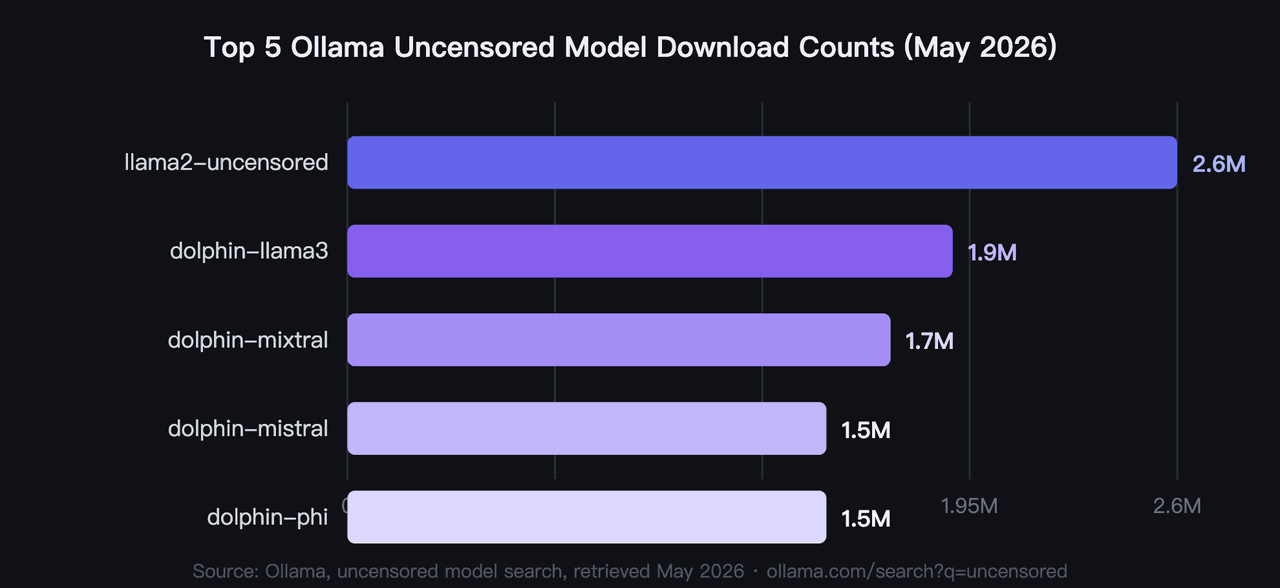

2026年現在、ベンチマークスコアはプレスリリース用に最適化されることがあるため、実際のパフォーマンスを測る指標としてはOllamaのコミュニティダウンロード数の方が信頼性が高くなっています(Ollama, uncensored model search, 2026)。数百万回というダウンロード数は、何千ものハードウェア構成や多様なプロンプトタイプを反映しており、操作された評価セットよりもはるかに信頼できます。

本記事では3つの指標を使用しています。Ollamaのアンセンサードモデルについては、2026年5月時点のollama.comでのプル数を主な指標としました。OpenRouterのモデルについては、プル数が公開されていないため、パラメータ数とコンテキストウィンドウのサイズでランク付けしています。画像および動画モデルについては、出力単価に基づき、各グループ内で低価格なものを上位としています。

2026年のアンセンサードAIモデルは、技術的に「ファインチューニング(微調整)済み」と「アブリテレーション(拒否重みの除去)」の2つに大別されます。Dolphinシリーズのようなファインチューニング済みモデルは、拒否行動を強化しないデータセットで訓練されています。一方、アブリテレーションは拒否のための重みを外科的に取り除く手法です。コミュニティでは、ファインチューニング済みモデルの方が、多様なプロンプトタイプに対して安定しているという評価が定着しています。

実際、ダウンロード数はモデルの安定性と相関しています。100万回以上ダウンロードされたモデルは、多様なハードウェア構成でテストされており、小規模なテストグループでは見過ごされるようなバグや不安定さが排除されています。

Ollamaで最もダウンロードされているアンセンサードモデル TOP 5

2026年現在、Ollamaで最もダウンロードされているアンセンサードモデル上位5つは合計で920万プルを超えており、

1llama2-uncensored1. llama2-uncensored: Ollamaで最もダウンロードされたアンセンサードAI

アンセンサードローカルAIのコミュニティにおけるオリジナルベンチマークです。George Sung氏とJarrad Hope氏が、Llama 2の汎用的な能力を損なうことなく拒否行動のみを取り除くためにファインチューニングを公開しました。開発者が最初に試すモデルであり、260万というプル数は2年以上にわたる実用実績を反映しています。これほどのダウンロード数を達成したアンセンサードLLMは他にありません。

- パラメータ: 7B または 70B

- VRAM: 約6GB (7B); 約40GB (70B)

- 用途: 汎用的な無制限チャットおよびコンテンツ生成

- プラットフォーム: Ollama

2. dolphin-llama3: エージェントワークフローに最適なアンセンサードLlama 3

Eric Hartford氏によるLlama 3ベースのDolphinは、現代的なアーキテクチャで構築されたモデルの中で最多の190万プルを誇ります(Ollama, dolphin-llama3 model page, 2026)。関数呼び出し(Function calling)をサポートし、設定に応じて8Kから256Kトークンまでのコンテキストウィンドウに対応します。8Bモデルはサイズが4.7GBで、多くのミッドレンジGPUに収まります。

- パラメータ: 8B または 70B

- VRAM: 約5GB (8B); 約40GB (70B)

- 用途: コーディング、エージェントワークフロー、関数呼び出し

- プラットフォーム: Ollama

3. dolphin-mixtral 8x7B: 複雑な推論に適したアンセンサードMoE AI

Mixture-of-Experts(MoE)アーキテクチャを採用し、各トークンを8つの専門レイヤーの一部にルーティングします。これにより、同規模の密なモデルよりも低い推論コストで、70Bクラスに近い推論品質を実現しています。Eric Hartford氏によるアンセンサード版は、コーディングへの高い適性を維持しています。

- パラメータ: 8x7B(推論時のアクティブなパラメータは合計よりはるかに少ない)

- VRAM: 量子化状態で約12-16GB

- 用途: 複雑なコーディングタスク、技術的な推論、長い指示の連鎖

- プラットフォーム: Ollama

4. dolphin-mistral: 高速応答を実現するアンセンサード7BローカルAI

CPU負荷の高いハードウェアでも動作する、軽量かつ高速なモデルです。コーディング支援のために応答性の高いローカルモデルを求める開発者から150万プルを獲得しました。Mistralベースのアーキテクチャにより、7Bモデルとしては非常に高い性能対サイズ比を実現しています。

- パラメータ: 7B

- VRAM: 約5-6GB

- 用途: 軽量なコーディング支援、高速なチャット応答

- プラットフォーム: Ollama

5. dolphin-phi 2.7B: 最も軽量なアンセンサードローカルAI

MicrosoftのPhiベースのアーキテクチャを採用し、2.7Bというサイズで高い推論能力を実現しています。Eric Hartford氏のアンセンサード版はこの効率性を維持しています。VRAM消費が4GB未満であるため、独立したGPUを搭載したほとんどのコンシューマー向けノートPCで動作し、2026年の最高のアンセンサードAIへの入り口として最適です。

- パラメータ: 2.7B

- VRAM: 4GB未満

- 用途: ノートPCでの展開、クイックテスト、ハードウェア制約環境

- プラットフォーム: Ollama

アンセンサードLLM 6-10位: コーディング、ロールプレイ、長文コンテキスト

2026年現在、Ollamaのアンセンサードカテゴリのトップ10のうち5つをDolphinシリーズが占めています。これは、Eric Hartford氏の首尾一貫したファインチューニング手法が、異なるベースアーキテクチャにおいても有効であることを証明しています(Ollama, hermes3 model page, 2026)。6位から10位は、ロールプレイ、汎用会話、開発ツール、指示追従、拡張コンテキストなど、主流のAIの拒否機能が最も障壁となる用途をカバーしています。

6. hermes3: ロールプレイとエージェントタスク向けアンセンサードAI

Nous Research社が開発したhermes3は、ロールプレイの深みと構造化されたツール利用を重視しています。3Bから405Bまで4つのサイズがあり、このリストの中で最も幅広い選択肢を提供しています。130万プルを記録した8Bモデルは、クリエイティブな執筆やエージェント計画ワークフローにおいて非常に実用的です(Ollama, hermes3 model page, 2026)。

- パラメータ: 3B, 8B, 70B, または 405B

- VRAM: 約2GB (3B); 約5GB (8B); 約40GB (70B)

- 用途: ロールプレイ、創作フィクション、エージェントタスク計画

- プラットフォーム: Ollama

7. wizard-vicuna-uncensored: 汎用向けのマルチサイズ・アンセンサードAI

Llama 2ベースの古くからある信頼性の高いモデルで、最大30Bまでの3サイズが利用可能です。120万プルを記録し、より幅広いパラメータ範囲を求めるユーザーに選ばれています。dolphin-llama3のような広大なコンテキストウィンドウ機能はありませんが、汎用会話や創作コンテンツを安定してこなします。

- パラメータ: 7B, 13B, または 30B

- VRAM: 約5GB (7B); 約9GB (13B); 約20GB (30B)

- 用途: 汎用会話、創作コンテンツ

- プラットフォーム: Ollama

8. dolphincoder: StarCoder2ベースのアンセンサード・コーディングAI

StarCoder2をベースにしているため、専門性が非常に高いモデルです。他のDolphinモデルがアンセンサード調整された汎用機であるのに対し、本モデルはソフトウェア開発に特化しています。94万3千プルは、ほぼ開発者からのみ獲得したものです。15Bモデルは7Bよりも大規模なコードベースを扱えます。

- パラメータ: 7B または 15B

- VRAM: 約5GB (7B); 約10GB (15B)

- 用途: コード生成、デバッグ、技術文書作成

- プラットフォーム: Ollama

9. wizardlm-uncensored: 研究向け指示追従LLM

61万プルを記録した13Bの指示追従モデルです。複雑な多段階の指示を、言い逃れや拒否をすることなく実行できる点が強みです。拒否されることが長いプロセスの失敗につながる研究ワークフローにおいて、高い信頼性は生産性に直結します。現代的なベースアーキテクチャではありませんが、指示追従という任務を確実に遂行します。

- パラメータ: 13B

- VRAM: 約9GB

- 用途: 複雑な多段階の指示実行、研究ワークフロー

- プラットフォーム: Ollama

10. everythinglm: 16Kコンテキストウィンドウを備えたアンセンサードLLM

このモデルの最大の特徴は、Llama 2ベースでありながら16Kのコンテキストウィンドウを備えている点です。多くの7Bモデルが4K〜8Kトークンに制限される中、この広大なコンテキストにより、完全なコードベースや長い文書、長時間の会話履歴を切り捨てずに処理できます。53万6千プルはリスト内では控えめですが、このサイズで他にはない利便性を提供しています。

- パラメータ: 13B

- VRAM: 約9GB

- 用途: 長文分析、拡張コンテキストチャット、コードベース全体レビュー

- プラットフォーム: Ollama

Dolphinシリーズがダウンロード数で支配的なのは、コミュニティが実証したパターンを示しています。つまり、一過性のアブリテレーションではなく、一人の作者が一貫した手法でファインチューニングを行ったモデルの方が、高いパフォーマンスを発揮するということです。アブリテレーションは拒否の重みを単一モデルから取り除く手法ですが、ファインチューニングは多様なプロンプトタイプに対して安定したアンセンサード行動を構築します。この一貫性こそが、トップ10のうち半分がEric Hartford氏のモデルで占められている理由です。

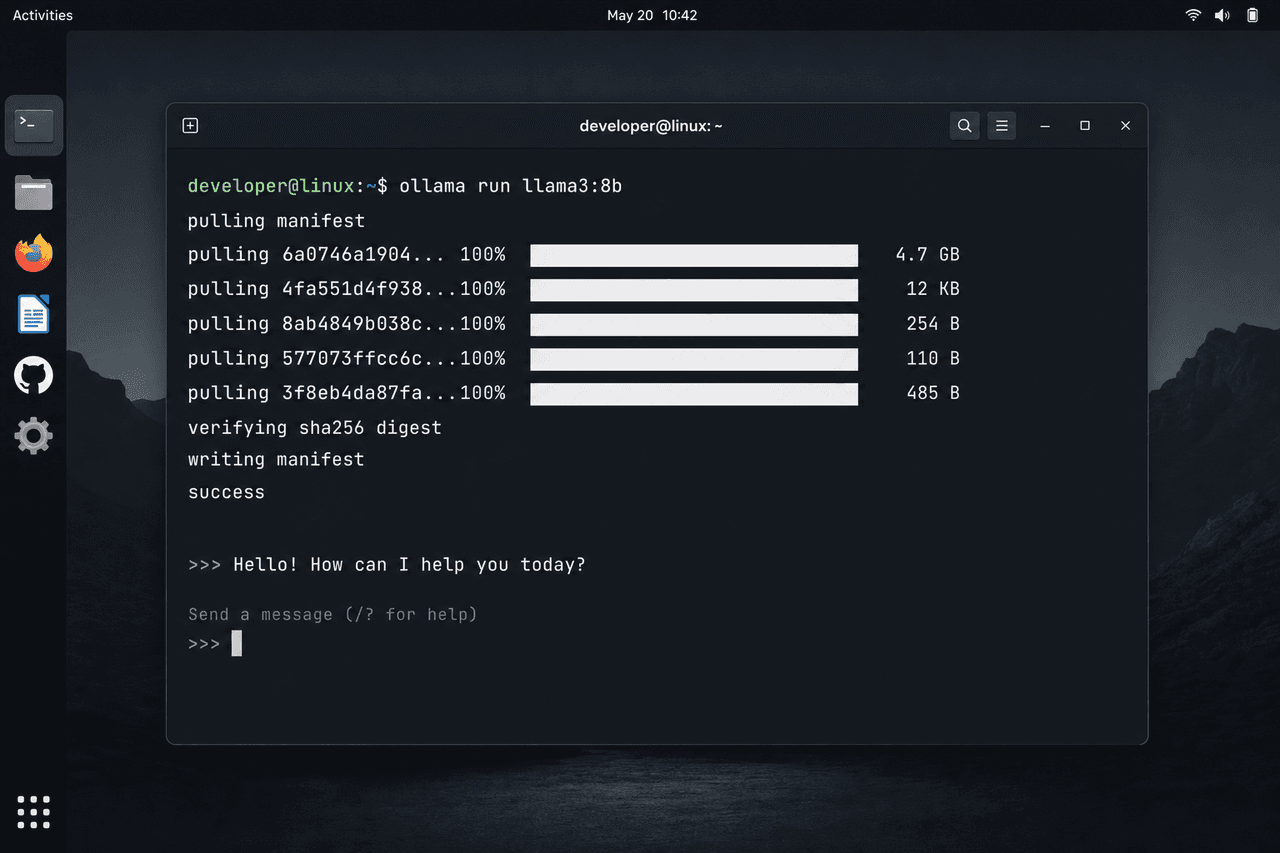

Ollamaアンセンサードモデルをローカルでセットアップする方法

2026年現在、Mac、Linux、Windows上のOllamaモデルは3つのコマンドで導入可能です。ollama.comからOllamaをインストールし、

1ollama pull [モデル名]1ollama run [モデル名]例として

1dolphin-llama31ollama pull dolphin-llama31ollama run dolphin-llama3ターミナル操作を好まないユーザー向けには「LM Studio」というデスクトップGUIがあります。これはOllamaと同じGGUFモデルファイルを使用し、モデル選択やパラメータ調整のための視覚的なインターフェースを提供します。両ツールとも基盤となっている推論エンジンは

1llama.cppコンシューマー向けGPUで2026年最高のアンセンサードモデルを動かすためのハードウェア要件や量子化設定については、「完全なローカルセットアップガイド」で最小VRAM構成や設定エラーの詳細を網羅しています。

ローカルGPUがない場合に使えるOpenRouterのアンセンサードモデル

2026年現在、OpenRouterではAPI経由でアンセンサードLLMをホストしており、GPUの準備を完全に不要にしています。

1venice/uncensoredトレードオフは明確です。OpenRouterはインフラを経由してプロンプトを処理するため、ローカルモデルのようなプライバシーは確保されません。ローカルのOllamaモデルはすべてデバイス内で完結します。どちらが優れているかは個人の脅威モデルやハードウェア環境次第です。

11. venice/uncensored: OpenRouterの無料アンセンサードモデル

OpenRouterの無料枠で利用可能なVenice Uncensoredモデルです。24BのMistral-Smallをベースに、Venice.aiとCognitive Computationsが協力してアンセンサード出力用にファインチューニングしています。32Kコンテキストウィンドウ、100万トークンあたり0ドル。無料枠にはプラットフォーム全体で1日200リクエストの制限があります。

- パラメータ: 24B

- VRAM: 不要(クラウドホスト)

- 用途: ローカル環境なしでのアンセンサードLLMテスト、無料枠内での利用

- プラットフォーム: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B: OpenRouterの大規模アンセンサードモデル

Sao10kによる、70Bクラスのクリエイティブ・ロールプレイおよび指示追従モデルです。Llama 3.3 70Bベースで131Kコンテキストをサポート。OpenRouterで活発に利用されており、プラットフォームのグローバル検索からモデル名で探すことができます。

- パラメータ: 70B

- VRAM: 不要(クラウドホスト)

- 用途: ローカル環境なしでの複雑な創作、ロールプレイ、長文の指示連鎖

- プラットフォーム: OpenRouter

13. Sao10K: Llama 3 8B Lunaris: OpenRouterの軽量アンセンサードモデル

Llama 3 8Bベースの汎用かつロールプレイモデルです。複数のモデルを戦略的にマージし、創造性と論理的推論、一般知識のバランスを取っています。Stheno v3.2よりも創造性と推論能力が強化されています。OpenRouter内で最も低コストな選択肢であり、100万トークンあたりUSD0.04/USD0.05で利用可能です。

- パラメータ: 8B

- VRAM: 不要(クラウドホスト)

- 用途: 低コストかつ軽量なアンセンサード会話と創作

- プラットフォーム: OpenRouter

14. TheDrummer: Cydonia 24B V4.1: OpenRouterのクリエイティブ執筆モデル

TheDrummer氏によるアンセンサード執筆モデルです。Mistral Small 3.2 24Bをベースに、記憶保持力、プロンプト遵守能力、知性に優れています。131Kコンテキストウィンドウに対応しており、OpenRouterで直接検索可能です。

- パラメータ: 24B

- VRAM: 不要(クラウドホスト)

- 用途: ローカル環境なしでのアンセンサード創作・ロールプレイ

- プラットフォーム: OpenRouter

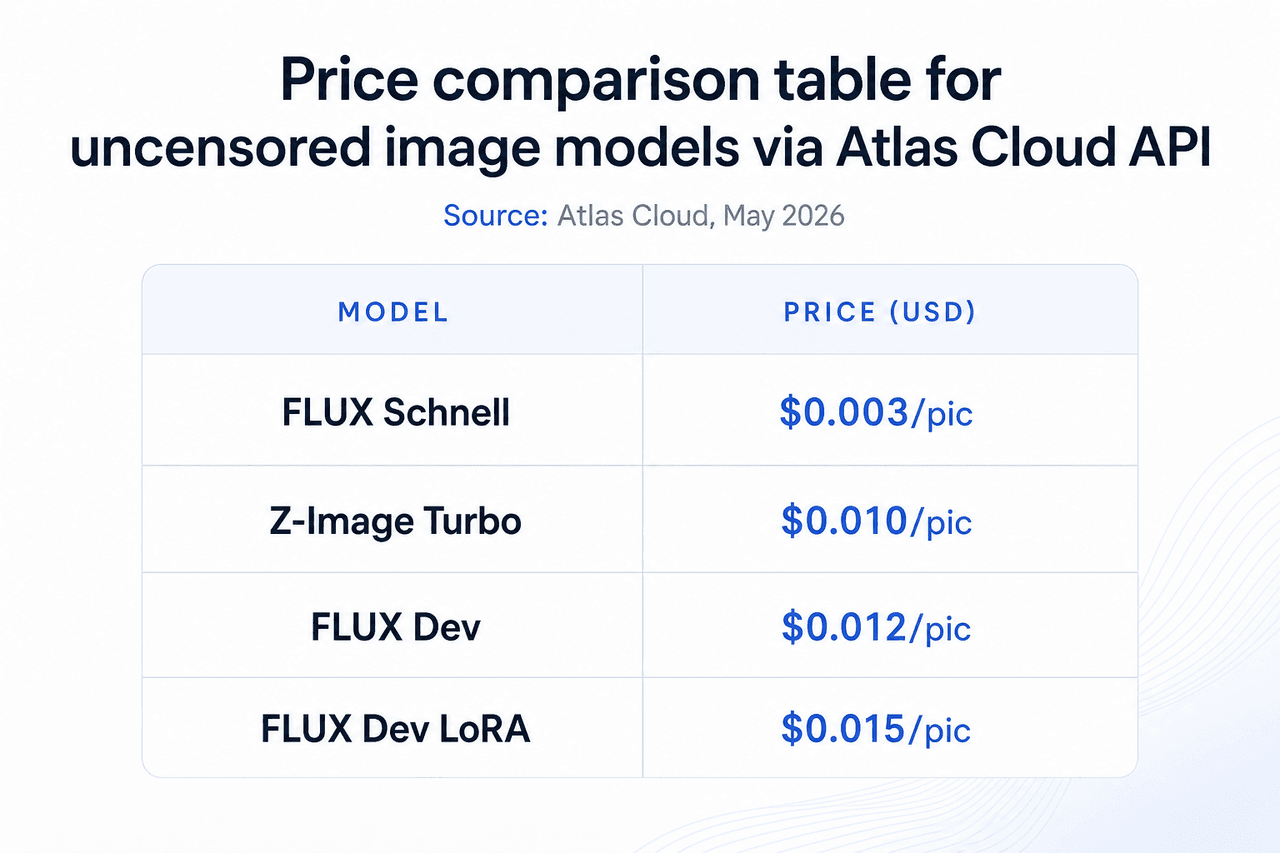

Atlas Cloud経由でアンセンサード画像・動画モデルにアクセスする方法

2026年現在、多くのアンセンサード画像・動画モデルは、主流のクラウド事業者がNSFWコンテンツをブロックしているため、ローカルGPUか専用のAPIプラットフォームが必要です。Atlas Cloudは、そのような制限を取り払うために設計されたAPIプラットフォームであり、テキスト、画像、動画、音声を含む300以上の厳選されたモデルを提供しています。

利用開始までの3ステップ:

- atlascloud.aiでアカウント作成

- ダッシュボードからAPIキーを生成

- キーを使ってモデルエンドポイントを呼び出す(画像・動画は独自のREST形式、LLMはOpenAI Chat Completions形式に対応)

Atlas Cloudがアンセンサード用途に優れている理由:

- プライバシーポリシーに「生成されたコンテンツは学習に使用されず、第三者が閲覧することもない」と明記されている。

- カタログ内のいかなるモデルにも1日の生成上限がない。

- 画像カタログには33のモデルがあり、1画像あたりUSD0.003から利用可能。

- 動画カタログには10以上のNSFWモデルがあり、1秒あたりUSD0.01から利用可能。

完全なカタログはatlascloud.ai/models/explore/uncensoredから閲覧可能です。以下15位から20位のモデルは、すべて単一のAtlas Cloud APIキーでアクセスできます。

2026年最高のアンセンサード画像生成AI

2026年現在、高品質なアンセンサード画像生成の大部分はFLUXアーキテクチャが担っており、Atlas Cloud API経由で価格と品質の階層を選択できます(Atlas Cloud, text-to-image model list, 2026)。用途はファインアート、キャラクターデザイン、アンセンサードなファッションモデルやポートレート、ゲーム用アセット作成、バッチ出力など多岐にわたります。

Atlas Cloudのホームページには、コンテンツは「一切訓練に使用されず、誰にもレビューされない」と明記されています。

ブラウザベースおよびAPI経由の画像ツールについての詳細は、「アンセンサードAI画像生成ガイド」をご参照ください。特にFLUXアーキテクチャに特化したい場合は、「FLUXアンセンサード画像生成ガイド」でファインチューニングやワークフローの詳細を確認できます。

15. FLUX Schnell: バッチ生成に最適な最速アンセンサードモデル

Atlas Cloud画像カタログで最も低コストなオプションです。1画像あたりUSD0.003で、細部よりもスピードと量を重視するバッチ生成ワークフローに最適です。1日の上限はなく、学習用にコンテンツが保存されることもありません。

- 価格: USD0.003/画像

- VRAM: 不要(APIアクセス)

- 用途: バッチ生成、ラピッドプロトタイピング、大量出力

- プラットフォーム: Atlas Cloud API

USD3.00で1,000枚の画像が生成可能であり、多くのプロバイダーで必要となるクラウドストレージ料金よりも安価なコストで出力を得られます。これにより、これまで高価なローカルGPUを夜通し稼働させていたスタジオの経済状況が大きく変わります。APIアプローチの方が現在では低価格かつ高速です。

16. FLUX Dev: 最終制作に最適な高品質アンセンサードモデル

FLUX Schnellの4倍のコストですが、解剖学的構造、ライティング、テクスチャの細部において明らかに優れています。1枚1枚の品質が重要となるポートフォリオ作品や商用のアダルトコンテンツ、完成品アセット制作において、USD0.012という価格設定は現実的なアップグレードと言えます。

- 価格: USD0.012/画像

- VRAM: 不要(APIアクセス)

- 用途: 高品質な単体画像、ポートフォリオ、完成品制作

- プラットフォーム: Atlas Cloud API

17. FLUX Dev LoRA: カスタムスタイル学習モデル

LoRAファインチューニングにより、特定のスタイル、キャラクターの外見、テーマをFLUX Devベースに適用できます。バッチ全体でキャラクターの容姿を統一したい場合や、シリーズ全体に特定のハウススタイルを適用したい場合に最適です。Atlas Cloudがサーバー側でLoRAの読み込みを処理します。

- 価格: USD0.015/画像

- VRAM: 不要(APIアクセス)

- 用途: キャラクターの統一性、カスタムスタイル訓練、シリーズ制作

- プラットフォーム: Atlas Cloud API

18. Z-Image Turbo: 品質とコストのバランスモデル

FLUX SchnellとFLUX Devの中間に位置する価格設定です。1画像あたりUSD0.01で、Schnellよりも高品質でありながら、Devほどコストがかかりません。Schnellの品質では足りず、かつDevではコストが高すぎるという場合の現実的な選択肢です。

- 価格: USD0.01/画像

- VRAM: 不要(APIアクセス)

- 用途: 品質とコストのバランスが求められる中規模の生成

- プラットフォーム: Atlas Cloud API

2026年最高のNSFWアニメーション動画生成AI

2026年現在、動画生成は画像生成とは別個のパイプラインが必要です。 mainstreamな動画プラットフォームは画像生成時よりも厳しいフィルターをかけており、元画像がアンセンサードであってもNSFW動画の生成を拒否します(Atlas Cloud, uncensored model catalog, 2026)。Atlas Cloudのアンセンサード動画ページでは「無制限の創造的自由。フィルターなし。制限なし。」を掲げており、Wan 2.6、Wan 2.5、Vanシリーズの変種を含む10以上のモデルを提供しています。

19. Wan 2.2 Turbo Spicy Infinite I2V: 最も安価なアンセンサード動画モデル

静止画からのNSFWアニメーション生成のエントリーモデルです。1秒あたりUSD0.01と最も費用対効果が高く、静止画をNSFW動画へ変換するのに最適です。解像度は1080pに対応し、クリップ時間は可変であるため、予算を重視する制作ワークフローの出発点となります。

- 価格: USD0.01/秒

- 解像度: 1080p

- 期間: 可変

- 用途: コスト効率の高いアニメーション、モーションコンセプトのプレビュー

- プラットフォーム: Atlas Cloud API

20. Seedance v1.5 Spicy: 最高品質の最終出力用アンセンサード動画モデル

カタログ内で映画品質を提供するモデルです。1秒あたりUSD0.049とWan 2.2 Turbo Spicy Infiniteの約2.5倍のコストがかかりますが、より滑らかな動き、フレーム間での被写体の一貫性、自然なトランジションを実現します。視覚的な忠実度が最優先される最終段階のNSFW動画制作においては、Atlas Cloudラインナップで最高のオプションです。

- 価格: USD0.049/秒

- 解像度: 720p

- 期間: 5秒

- 用途: 最終品質のNSFW動画、プロ向けアダルトコンテンツ

- プラットフォーム: Atlas Cloud API

詳細なカタログやWan 2.7および2.2 Spicyシリーズの詳細は「アンセンサードAI動画生成ガイド」をご参照ください。

アンセンサードAIモデル クイック選定ガイド

| 用途 | 推奨モデル |

|---|---|

| 最も汎用的なLLM | llama2-uncensored または dolphin-llama3 |

| コーディングタスク | dolphin-mixtral 8x7B または dolphincoder |

| ロールプレイ・執筆 | hermes3 |

| 4GB VRAM未満 | dolphin-phi 2.7B |

| アンセンサード画像生成 | FLUX Schnell via Atlas Cloud (USD0.003/枚) |

| 静止画からのNSFW動画 | Wan 2.2 Turbo Spicy Infinite via Atlas Cloud (USD0.01/秒) |

アンセンサードAIモデルに関するFAQ

2026年に最も使用されているアンセンサードAIモデルは?

Ollamaのダウンロード数では

1llama2-uncensored1dolphin-llama3Ollamaで動作するモデルは?

本リストに含まれるllama2-uncensored、dolphin-llama3、dolphin-mixtral、dolphin-mistral、dolphin-phi、hermes3、wizard-vicuna-uncensored、dolphincoder、wizardlm-uncensored、everythinglmの10モデルはOllamaで動作します。すべて

1ollama pull [モデル名]OpenRouterで利用可能なモデルは?

2026年現在、OpenRouterではGPU不要でアンセンサードLLMをAPI利用可能です。無料枠の

1venice/uncensoredアブリテレーションとファインチューニングの違いは?

アブリテレーションはモデルから拒否用の重みを外科的に削除する手法です。ファインチューニングは拒否行動を強めないデータセットでモデルを学習させる手法です。コミュニティではファインチューニング済みモデルの方が安定性が高いとされています。アブリテレーションは多様なプロンプトで矛盾を生じさせることがありますが、ファインチューニングは結果の信頼性が高く、それがDolphinシリーズの人気に繋がっています。

ノートPCでローカル実行は可能ですか?

はい。

1dolphin-phi 2.7B結論

2026年における最高のアンセンサードAIモデルは、用途によって異なります。汎用LLMなら

1dolphin-llama31dolphin-phi1venice/uncensored1FLUX Schnell1Wan