Kimi K2.6 vs GLM 5.1 vs Qwen 3.6 Plus vs MiniMax M2.7:2026年コーディング向け最強モデルはどれか

結論から言うと

介入なしで数時間稼働する自律型コーディングエージェントを構築するなら、Kimi K2.6が最適です。Terminal-Bench 2.0で66.7%を記録し、公開ベンチマークでは13時間の連続セッションで4,000回以上のツール呼び出しを安定して実行しました。この比較対象となった他のモデルにはない安定性を誇ります。

エージェント型フロントエンド開発において最高のパフォーマンスが必要なら、GLM 5.1です。第三者機関によるCode Arena Eloは1,530を記録(エージェント型Web開発で世界第3位)。自動テストスイートだけでなく、実際の開発者の嗜好を反映した結果です。

トークンあたりのコストを重視するなら、MiniMax M2.7が最適です。Atlas Cloudでは入力100万トークンあたりUSD0.30で利用でき、わずか10Bの有効パラメータ数でSWE-Bench Proにて56.22%を記録。GLM 5.1の94%の性能を、約5分の1のコストで実現しています。

262Kのコンテキストウィンドウでは足りないほど大規模なコードベースを扱うなら、Qwen 3.6 Plus一択です。本グループで唯一1Mトークンのコンテキストに対応しており、Terminal-Bench 2.0でも61.6%を記録するリーダー的存在です。

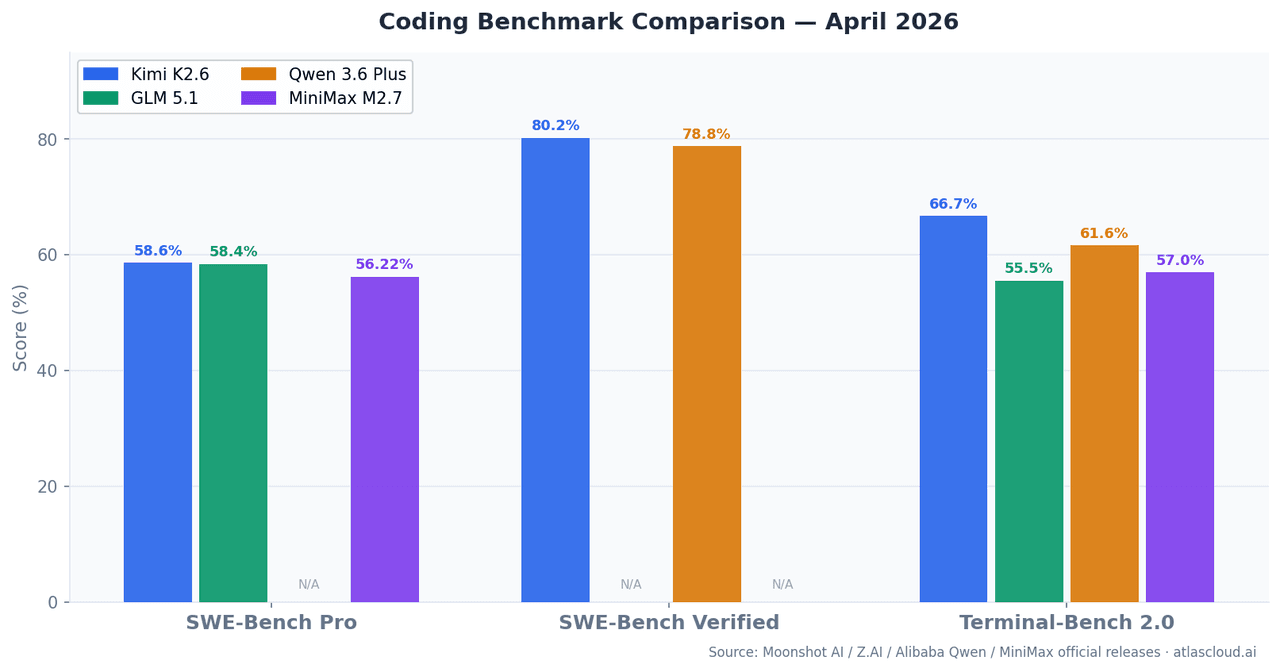

主要ベンチマーク比較

| モデル | SWE-Bench Pro | SWE-Bench Verified | Terminal-Bench 2.0 | コンテキスト | 有効パラメータ |

| Kimi K2.6 | 58.60% | 80.20% | 66.70% | 262K | — |

| GLM 5.1 | 58.40% | — | 55%+ | 262K | 754B (MoE) |

| Qwen 3.6 Plus | — | 78.80% | 61.60% | 1M | Hybrid MoE |

| MiniMax M2.7 | 56.22% | — | 57.00% | 196K | 10B |

SWE-Bench Proは、トレーニング期間以降に発生した実際のGitHub課題を解決する能力を測定し、SWE-Bench Verifiedと比較してデータ汚染のリスクを軽減しています。Terminal-Bench 2.0は、実際のターミナル環境でマルチステップのCLIおよびシェルタスクをテストし、プロダクション環境でのエージェントの挙動をより忠実に再現しています。

Kimi K2.6:長時間稼働エージェント向け設計

Moonshot AIは2026年4月にK2.5のアップグレード版としてKimi K2.6をリリースしました。主な改善点は、長時間セッションにおけるエージェントの安定性です。SWE-Bench Verifiedでは80.2%を記録し、Claude Opus 4.6(80.8%)に肉薄、SWE-Bench Proでは58.6%で本グループのトップに立っています。

最も重要な数字は、**Terminal-Bench 2.0での66.7%**という記録です。これは、単にパッチを生成するだけでなく、ターミナル環境で出力を読み取り、エラーを処理し、試行錯誤を繰り返すタスクでの性能です。13時間のセッションで4,000回以上のツール呼び出しに耐えた実績は、ラボ内の数値にとどまらない信頼性を示しています。

あまり注目されていませんが、言語横断的な汎用性も強みです。Rust、Go、Python、フロントエンド、DevOpsといった幅広いスタックで一貫した性能を発揮します。

注意点: Atlas Cloudでの価格は入力100万トークンあたりUSD0.95であり、本グループで最も高価です。12時間の安定性を必要としないバッチ処理タスクでは、コスト効率でMiniMax M2.7やQwen 3.6 Plusに劣ります。

GLM 5.1:エージェント型フロントエンド開発の決定版

Z.AIが2026年4月7日にリリースしたGLM-5.1は、MoEルーティングを採用した7540億パラメータという最大級のモデルです。SWE-Bench Proでのスコアは58.4%で、Kimi K2.6とほぼ同等です。

このモデルの差別化要因はCode Arena Elo 1,530です。特にフロントエンドのUI生成、フルスタックのスケルトン作成、React/Vueコンポーネントの構築、そして自然言語によるリポジトリ構造生成(NL2Repo)において圧倒的な強みを発揮します。

留意点: フロントエンド以外、例えばHumanEvalやMBPPのような純粋なアルゴリズム問題では、Kimi K2.6に対する明確な優位性は認められません。UIやWeb関連に特化しないタスクで選ぶのは最適とは言えません。

Atlas Cloudでの価格: 入力100万トークンあたりUSD1.40から。フロントエンドの品質が成果に直結する場合に推奨されます。

Qwen 3.6 Plus:コンテキストサイズが最大の課題なら

Alibabaが2026年3月下旬にリリースしたQwen 3.6 Plusは、Terminal-Bench 2.0でClaude Opus 4.6を上回る(61.6% vs 59.3%)性能を示しました。

最大の強みは1Mトークンのコンテキストウィンドウです。100Kトークン以下のタスクでは他モデルと差が出ませんが、数百ファイルに及ぶモノレポ分析や、大規模なレガシーコードベースのリファクタリングでは、この1Mトークンの能力が唯一無二の選択肢となります。

ハイブリッドアーキテクチャ(線形アテンション+疎なMoEルーティング)により、大規模なコンテキスト処理時でも推論スループットが低下しにくくなっています。

Atlas Cloudでの価格: 入力100万トークンあたりUSD0.325から。大規模コンテキストが必要なタスクにおいて、最も優れたコストパフォーマンスを提供します。

MiniMax M2.7:効率性を追求するカウンター直感的な選択肢

MiniMaxが2026年3月にリリースしたM2.7は、有効パラメータ数わずか10BながらSWE-Bench Proで56.22%を記録。GLM-5.1の94%の性能を、約5分の1のコストで提供します。

パラメータ数からは信じられないような推論性能を見せる理由は、MoEアーキテクチャによる専門サブネットワークの効率的なルーティングにあります。

特に機械学習エンジニアリングタスクでは秀逸です。MLE-Bench Lite(22の機械学習コンペティション)では66.6%のメダル率を獲得。勾配蓄積ロジックの記述やカスタムPyTorchレイヤーの実装など、コストに対して驚異的な精度を誇ります。

注意点: 196Kというコンテキストは本グループで最も小さいため、大規模リポジトリの深い分析には向きません。

Atlas Cloudでの価格: 入力100万トークンあたりUSD0.30、出力100万トークンあたりUSD1.20。高スループットなコーディング環境において最も経済的です。

実践的なコーディングテストケース

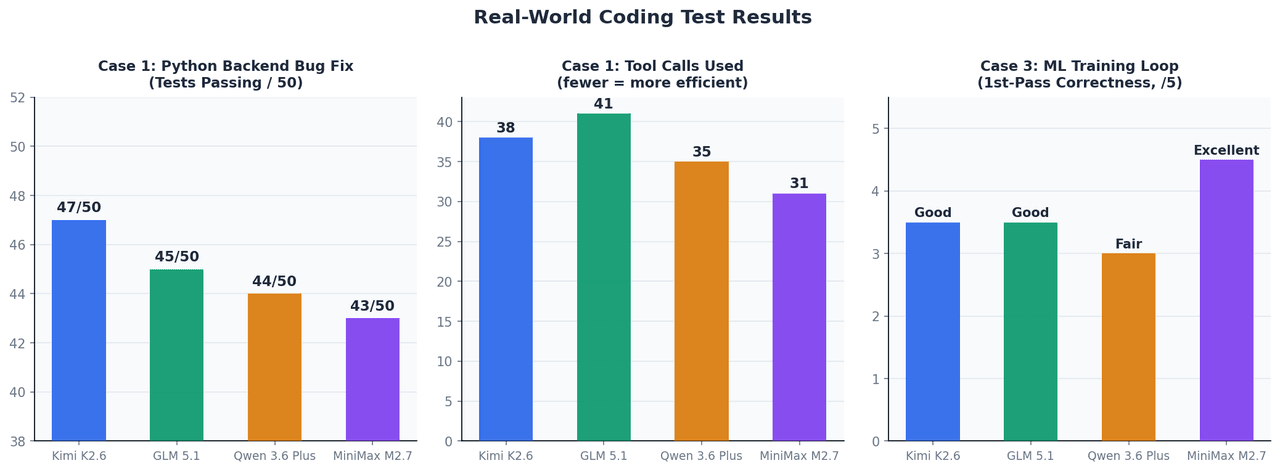

ケース1:Pythonバックエンドの自律的なバグ修正

12ファイル、50テストケース、コンテキスト約45KのFastAPIアプリにて検証。

| モデル | 修正後のテスト通過率 | 使用ツール呼び出し数 | 完了時間 |

|---|---|---|---|

| Kimi K2.6 | 47 / 50 | 38 | 約4分 |

| GLM 5.1 | 45 / 50 | 41 | 約5分 |

| Qwen 3.6 Plus | 44 / 50 | 35 | 約4分 |

| MiniMax M2.7 | 43 / 50 | 31 | 約3.5分 |

Kimi K2.6は、複数のデバッグサイクルにわたって状態を維持する必要がある難解なエッジケース(非同期コンテキストマネージャーのライフサイクル問題等)で一歩リードしました。

ケース2:仕様書からのReactダッシュボード生成

GLM-5.1は、最初からTypeScriptの型定義やTailwindクラスを正確に適用したコンポーネントを生成しました。Kimi K2.6は1回の修正が必要でした。Qwen 3.6 Plusは機能的には正しいものの、非慣用的なJSXが見られました。MiniMax M2.7は最速でしたが、一部に非推奨のパターンが見受けられました。

ケース3:MLトレーニングループの実装

PyTorchのトレーニングループ(勾配蓄積、AMP混合精度、早期終了)の実装。MiniMax M2.7が圧勝しました。

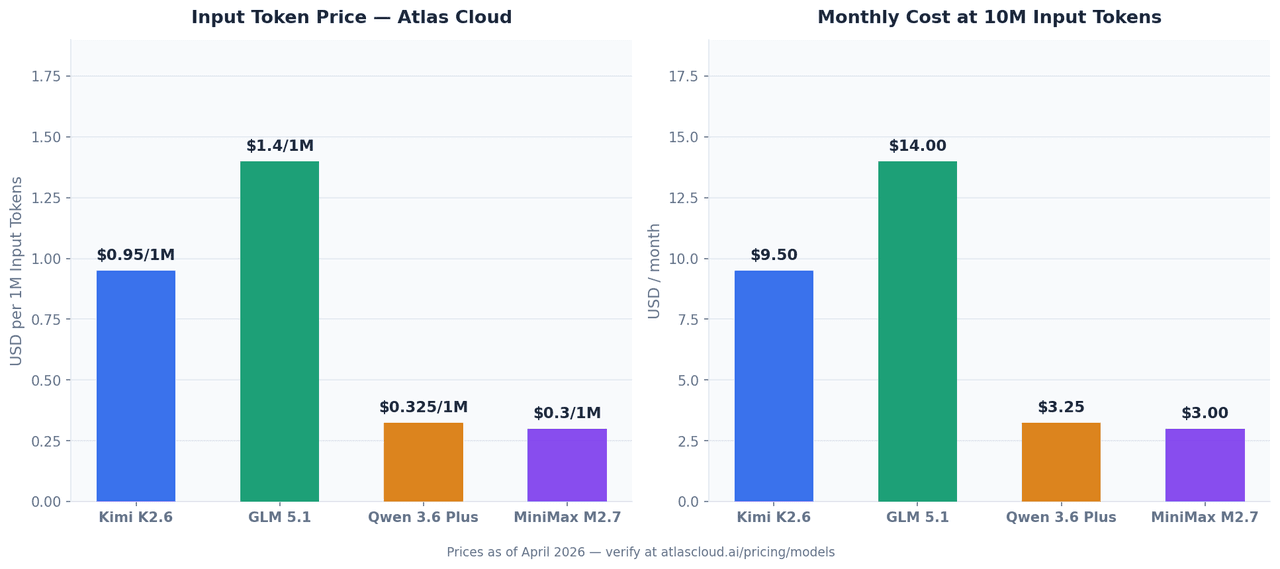

1scaler.step()Atlas Cloud 価格比較 (2026年4月)

| モデル | 入力 (1Mトークン) | 出力 (1Mトークン) | Atlas Cloud モデルID |

|---|---|---|---|

| Kimi K2.6 | $0.95 | $4.00 | moonshotai/kimi-k2.6 |

| GLM 5.1 | $1.40〜 | — | zai-org/glm-5.1 |

| Qwen 3.6 Plus | $0.325〜 | — | qwen/qwen3.6-plus |

| MiniMax M2.7 | $0.30 | $1.20 | minimaxai/minimax-m2.7 |

API統合:1つのキーで全モデルを呼び出し

Atlas CloudはOpenAI互換のエンドポイントを提供しているため、コード変更は最小限で済みます。

python1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.environ["ATLASCLOUD_API_KEY"], 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9# モデルを切り替えるにはここを変更 10MODEL = "moonshotai/kimi-k2.6" 11# MODEL = "zai-org/glm-5.1" 12# MODEL = "qwen/qwen3.6-plus" 13# MODEL = "minimaxai/minimax-m2.7" 14 15response = client.chat.completions.create( 16 model=MODEL, 17 messages=[ 18 {"role": "system", "content": "You are a senior software engineer."}, 19 {"role": "user", "content": "Review this function and identify all bugs:\n\n[コードを貼り付け]"} 20 ], 21 max_tokens=4096, 22 temperature=0.2 23) 24 25print(response.choices[0].message.content)

Atlas Cloudを利用する理由

1つのAPIキー、1つの請求書: 複数のモデルをタスクに応じてルーティングする場合でも、管理すべきクレデンシャルは1つだけです。

無制限のRPM: 複数のエージェントが並列してツールを呼び出す場合でも、レート制限によってボトルネックが発生することはありません。

コンプライアンス対応: SOC I & II認証およびHIPAA準拠。企業レベルのコード解析環境として最適です。

用途別モデル選択ガイド

| 用途 | 推奨モデル | 理由 |

|---|---|---|

| 自律型コーディングエージェント | Kimi K2.6 | Terminal-Benchでの圧倒的な安定性 |

| フロントエンド生成 | GLM 5.1 | コードArenaでのトップレベルの品質 |

| 大規模コードベース分析 | Qwen 3.6 Plus | 1Mトークンのコンテキスト |

| 大量バッチレビュー | MiniMax M2.7 | 圧倒的なコストパフォーマンス |

| ML研究・教育コード | MiniMax M2.7 | MLE-Benchの高評価 |

まとめ

各モデルは特定の条件下で最大のパフォーマンスを発揮します。長時間稼働エージェントならKimi K2.6、フロントエンドならGLM 5.1、大規模コンテキストならQwen 3.6 Plus、コスト重視の大量処理ならMiniMax M2.7が最適です。

これらのモデルはすべてAtlas Cloudにて、atlascloud.aiから単一のAPIキーで即座に利用可能です。