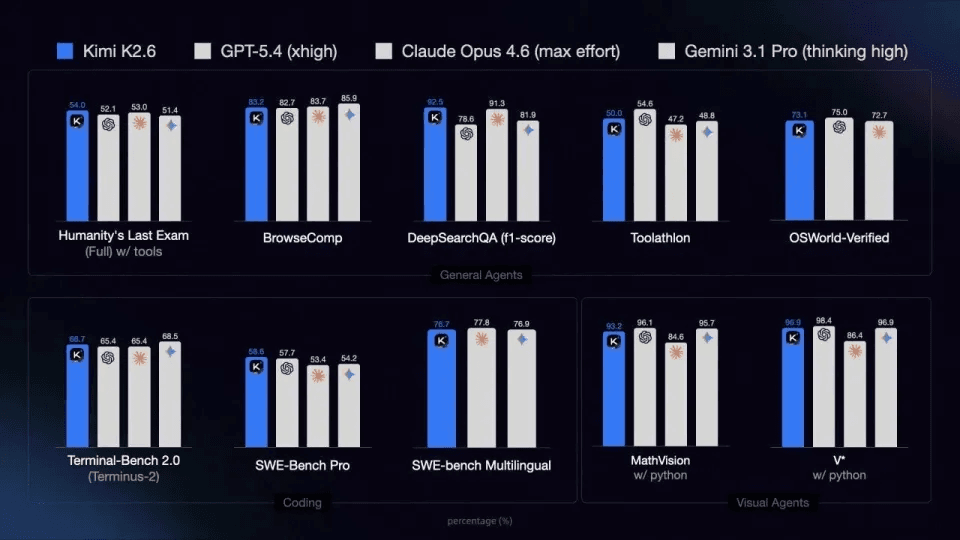

KimiがK2.6をリリースしました。HuggingFaceでオープンソース化されており、GPT-5.4、Claude Opus 4.6、Gemini 3.1 Proと比較検証されています。Humanity's Last Exam、DeepSearchQA、SWE-Bench Proのすべてにおいてこれら3モデルを上回る性能を記録。コーディング能力はK2.5から約20%向上し、エージェントワークロードにおける平均タスクステップ数は35%削減、価格はClaude Opus 4.6の1/8に抑えられています。

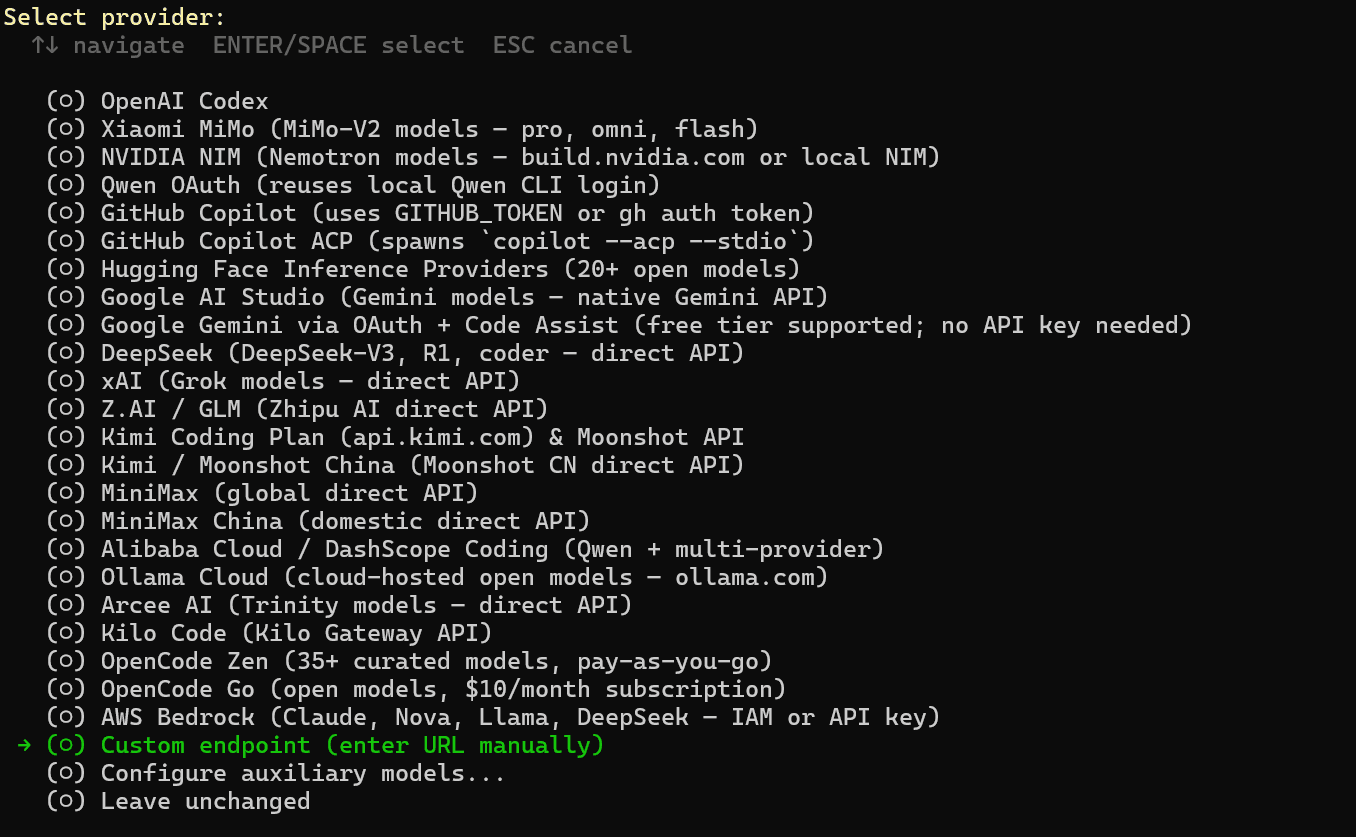

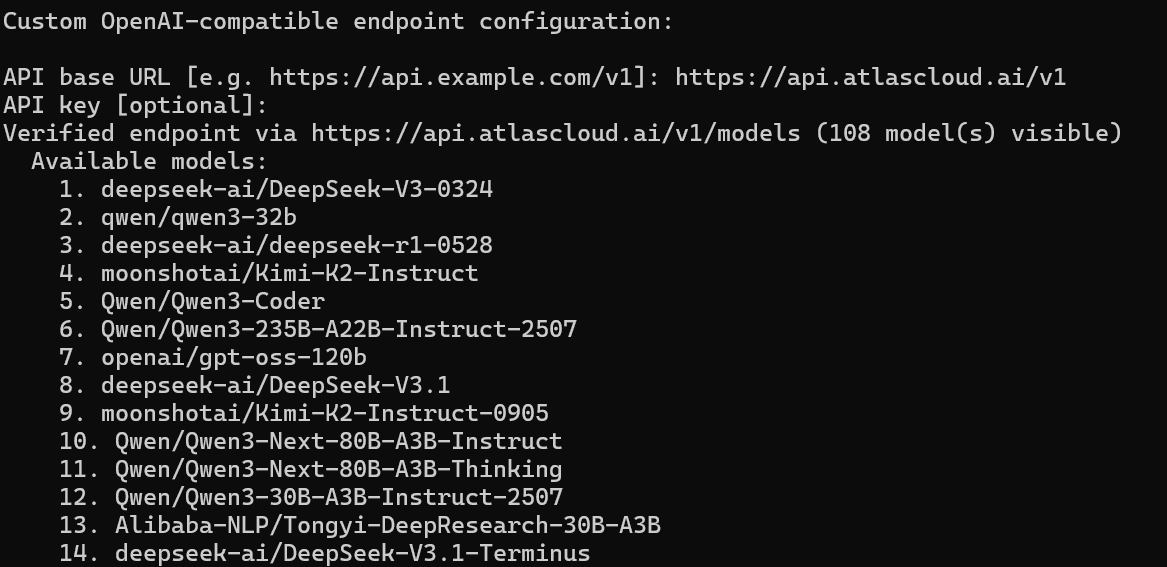

AIエージェントを運用中で、既存のツールチェーンにK2.6を導入したい場合、本ガイドではClaude Code、OpenCode、OpenClaw、Hermes Agentの4つの主要フレームワークへの組み込み方法を解説します。すべて atlascloud.ai 経由の共有APIエンドポイントで利用可能です。後半では、実際に動作させた際のK2.6のパフォーマンスについて紹介します。

クイックリファレンス

| ツール | 設定場所 | モデル切り替え | 注意点 |

| Claude Code | 環境変数 ANTHROPIC_* | 環境変数または /model | なし |

| OpenCode | ~/.config/opencode/config.json | modelフィールドを編集 | @ai-sdk/openai-compatibleが必須 |

| OpenClaw | ~/.openclaw/openclaw.json | primaryを編集 | 事前にゲートウェイの起動が必要 |

| Hermes Agent | 対話型セットアップ | セットアップを再実行 | モデルID形式を厳密に守る必要あり |

本記事のチュートリアルは、すべてWindowsのWSL2環境で実施しています。

パート1 — セットアップ

-

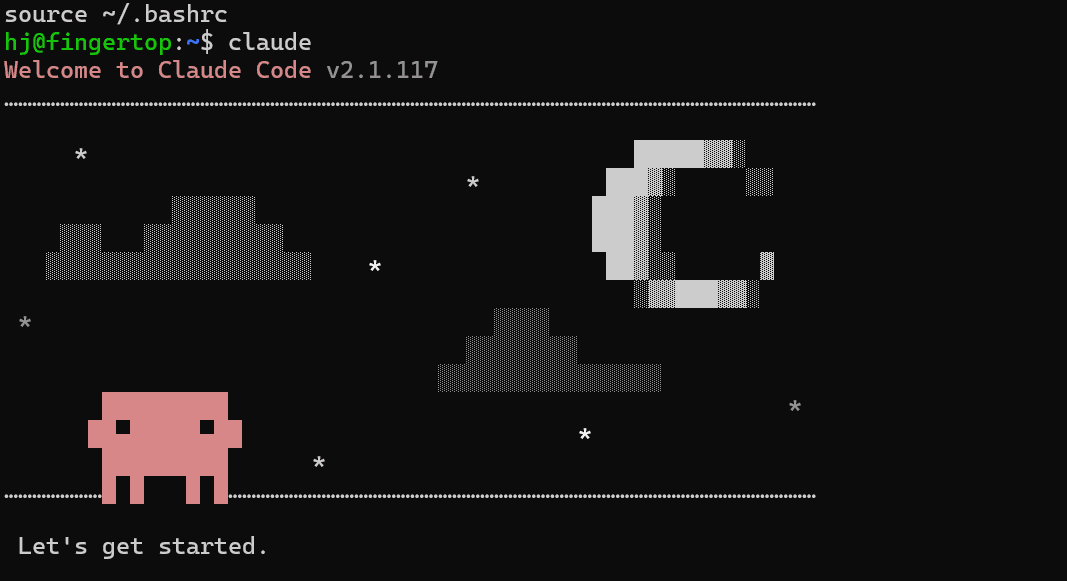

Claude Code (最も簡単)

Claude Code公式ダウンロードドキュメント:https://github.com/anthropics/claude-code

Claude CodeはAnthropic形式をネイティブでサポートしています。以下の環境変数を3つ設定するだけです:

plaintext1# ~/.bashrc または ~/.zshrc に追加 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

1source ~/.bashrc1/model2.OpenCode (設定ファイル)

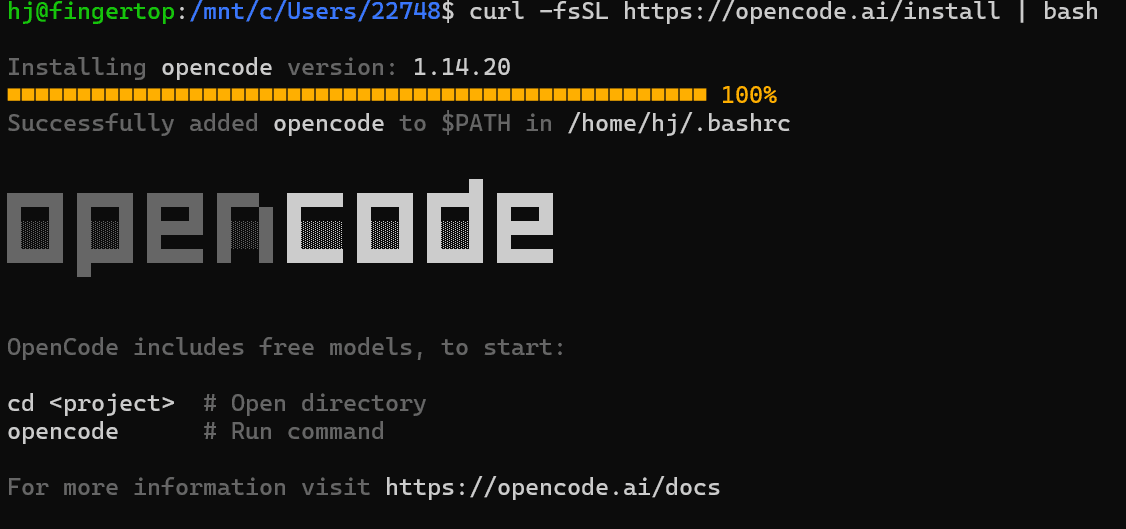

OpenCode公式ダウンロードドキュメント:https://github.com/anomalyco/opencode

OpenCodeには組み込みの

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonjson

plaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

1model1providerName/modelKey

3.OpenClaw (設定ファイル + 2つのターミナル)

OpenClawはゲートウェイとTUIの2つのプロセスで動作します。使用前に両方を起動しておく必要があります。

1~/.openclaw/openclaw.jsonjson

plaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

起動手順:

bash

plaintext1# ターミナル 1 2openclaw gateway 3 4# ターミナル 2 5openclaw tui

対話的な再設定を行う場合は

1openclaw configure1primary4.Hermes Agent (対話型セットアップ)

Hermesは設定ファイルの代わりにウィザードを使用します:

bash

plaintext1hermes setup

プロンプトに従って入力します:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

重要: モデルIDには必ず

プレフィックスを含める必要があります。text1moonshot/だけを入力すると404エラーになります。text1kimi-k2.6

後からモデルを切り替えるには、

1hermes setup

パート2 — K2.6の実力

Claude Code × K2.6 — 23エージェント同時稼働時の挙動

AIシステムを極限まで押し上げたとき、最初に破綻するのはどこでしょうか?

ある開発者が、Claude Codeを通じて23個のエージェントを丸一日同時稼働させるという実験を行いました。合計26のセッションで、高頻度のツール呼び出し、マルチステップパイプライン、PRD(製品要求仕様書)作成やSEOプランニングといった長期チェーンタスクを実行しました。つまり、システムが破綻しやすい「本番環境に近い」負荷状況です。

しかし、今回は予期せぬ結果となりました。

429 レート制限エラーが一度も発生しなかったのです。

エージェントワークフローをスケールさせた経験がある方なら、この重要性がお分かりいただけるでしょう。同様の条件下では、GLM 5.1のようなモデルでも頻繁にレート制限に達し、再試行やパイプラインの停止、システム不安定化を招きがちです。対照的にK2.6は、最速ではないものの、高負荷下でも驚異的な安定性を維持しました。

この「安定性」は、言葉以上の価値を持っています。

単一プロンプトからマルチエージェントシステムへと進む際、真の課題は「モデルが正しく答えられるか」ではなく、以下の点に集約されるからです。

数十の並列タスクを実行しながら、システムを止めることなく精度の高い回答を維持できるか?

生成ではなく「計画」を感じさせる品質

違いは安定性だけではありません。複雑なタスクの処理プロセスにも現れました。

PRDの作成を依頼した際、モデルはただ回答するだけでなく、自律的に問題領域を構造化しました。競合分析、ユーザーシナジー、機能の優先順位付けなど、明示的に指示しなかった要素まで、まるで「完全なPRD」とはどうあるべきかを理解しているかのように提示されました。

SEOタスクでも同様の挙動が見られました。K2.6はキーワードの提案に飛びつく前に、まず検索意図を推論し、それに合わせてコンテンツの方向性を調整しました。出力は単なる生成ではなく、初期段階の戦略的プランニングのように感じられました。

これは微細ですが、重要な変化です。

回答を受け取るのではなく、整理された思考を得ているのです。

マルチエージェント環境では、この効果が積み重なります。各エージェントが構造化された高品質な出力を生成することで、調整レイヤー(コーディネーター)の手間が大幅に削減されるからです。

代償:安定性ゆえのコスト

ただし、この性能は無償ではありません。

K2.6は、特に**初回トークンレイテンシ(反応速度)**において、GLM 5.1よりも明らかに遅くなります。この遅延は無視できるレベルではなく、一桁分ほど遅く感じられます。単発のやり取りなら許容範囲かもしれませんが、23エージェントが並列稼働するシステムでは、ステップごとの小さな停止が積み重なり、影響を及ぼします。

これはアーキテクチャによるものです。K2.6はMixture-of-Experts (MoE) 設計を採用しており、総パラメータ数は約1兆、推論時には320億がアクティブになります。その規模が能力をもたらす一方で、スケジューリングのオーバーヘッドも生じさせます。現在はプレビュー版であるため、推論最適化は今後さらに進むと予想されます。

つまり、トレードオフは明確です。

- スループットと速度を最優先するなら、考慮が必要

- 大規模な安定性と構造化された出力を重視するなら、価値ある選択肢

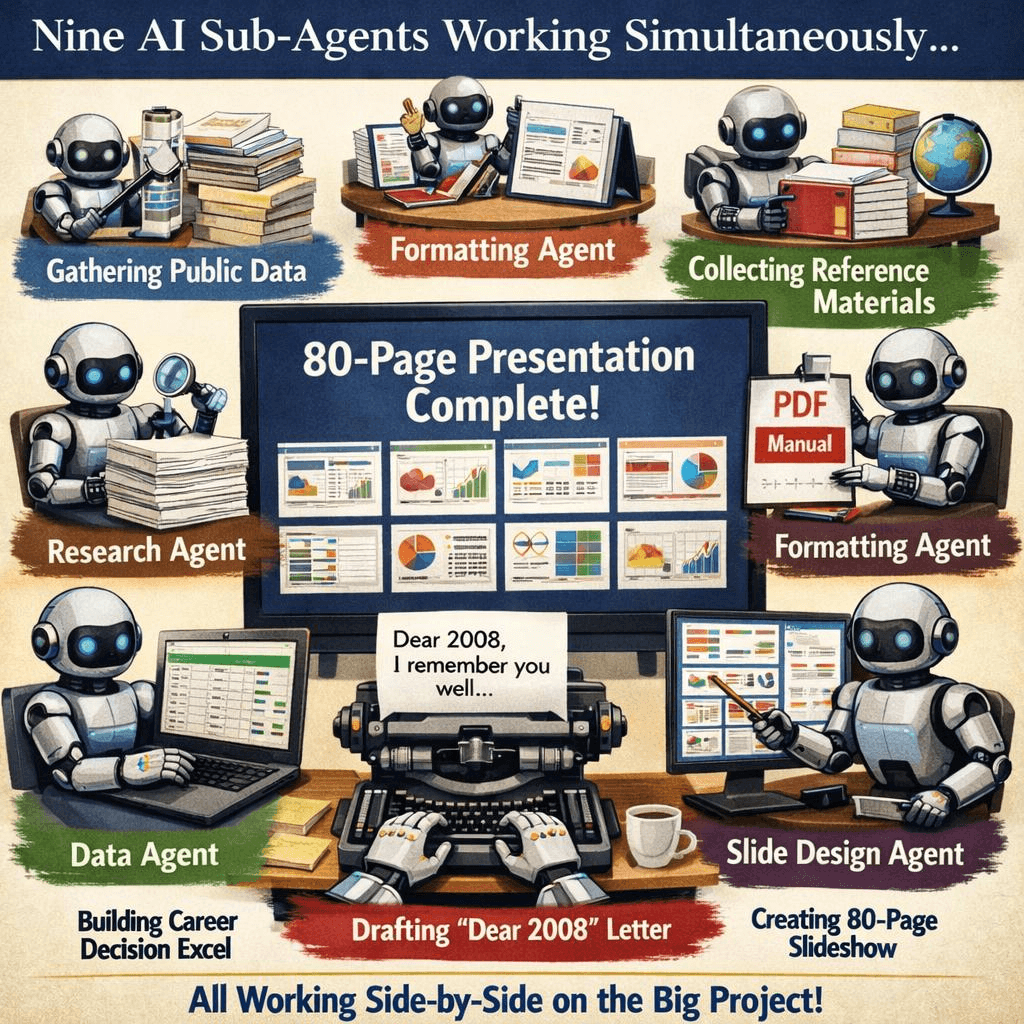

OpenCode × K2.6 — 1つのプロンプトから9つの並列ワークストリームへ

Claude Codeの実験がK2.6の高負荷耐性を示したなら、OpenCodeは、それがどのように作業を組織化するかを明らかにします。

K2.6には AgentSwarm と呼ばれる調整レイヤーが導入されており、単一の「コーディネーター」エージェントが、特定の役割を持つ数十のサブエージェントを生成できます。単一スレッドでタスクをステップバイステップで処理するのではなく、タスクを分解して複数のプロセスを並列実行します。

実際の実例を見てみましょう。

ある研究者がK2.6に対し、ダリオ・アモデイ(Anthropic創業者)の深いプロファイル作成を依頼しました。プリンストン大学の物理学博士号取得からAnthropic創業までの軌跡を辿るというものです。K2.6はこれを単一の長文生成タスクとして扱うのではなく、9つの並列トラックに分解しました。

各トラックには明確な責務がありました。あるエージェントは純粋なリサーチに集中し、公開情報を収集。別のエージェントはレイアウトを担当し、資料を構造化されたPDFに整形しました。また別のエージェントはキャリアの重要な決定ポイントに関するデータセットを構築。同時に、ライティング担当エージェントが「2008年の自分へ」というタイトルの一人称の物語を執筆しました。

これらすべてが同時に実行されました。

その結果は単なる出力ではなく、調整されたパッケージでした。80ページのスライドデッキに、構造化データと整形されたドキュメントが添えられていたのです。通常であれば複数のツールやセッションを使い、手動で統合する必要がある作業が、統一された成果物として生成されました。

なぜこれがAIの活用方法を変えるのか

その鍵となるのが Skillシステム です。

各タスクを新しいプロンプトとして扱うのではなく、K2.6ではゴールドマン・サックスのレポート、競合分析、優れた製品スペックといった構造化された知識を読み込ませ、再利用可能な「スキル」に変えることができます。サブエージェントが実行される際、そのフレームワーク(分析スタイル、トーン、構造)が継承されます。

時間が経つにつれ、システムはプロンプトベースのワークフローとは全く異なるものへと進化します。

それは、再現可能な生産パイプラインになるのです。

そして、AI利用に対する考え方もシフトします。

モデルにプロンプトを与えるのではなく、チームをマネジメントするようになるのです。

エージェントベースのワークフローを構築しているなら、この違いは無視できません。

すべてのツールは

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6FAQ

-

Hermes Agentを使うことと、Kimi K2.6 APIを直接叩くことの違いは何ですか?

最大の違いは、「実行」か「応答」かという点です。

Kimi K2.6 APIを直接叩く場合、本質的にはリクエストごとに単一の応答を得ることになります。複雑なタスクであっても、自分でタスクを分解し、複数のプロンプトで繰り返し、出力を手動で結合しなければなりません。これは単純な用途や対話型用途には適していますが、構造化されたワークフローでは効率が悪くなります。

Hermesはそこにワークフローのオーケストレーションを導入します。単一のプロンプトではなく、調査・計画・実行などの複数のステップで構成されるパイプラインを定義し、各ステップをHermesが適切なエージェントに割り当てます。エージェント間で結果を受け渡し、中間出力を検証し、エラー時にステップを自動リトライすることも可能です。

つまり、「プロンプトエンジニアリング」からタスクオーケストレーションへと移行できるということです。APIはシステムの一部(コンポーネント)となり、API自体がシステムそのものではなくなります。

-

Kimi K2.6はマルチエージェントワークフローや自動化に向いていますか?

はい、非常に高い適性を持っています。

マルチエージェント環境では、通常以下の3点が課題となります。

- ステップ間の一貫性

- 長期稼働時の安定性

- 構造化されたタスクへの追従性

Kimi K2.6は、これらすべてにおいて高いパフォーマンスを示します。Hermes内で使用すると、複数ステージにわたって構造化された出力を維持し、フォーマットを崩したり目的を見失ったりすることなく複雑なタスクチェーンを処理できます。

もう一つ重要なのが自己修正能力です。中間結果が目標から逸脱した場合、システムは不完全なデータのまま進行せず、そのステップを再生成できます。これにより、各ステップを人間が逐一監視したくない自動化シナリオにおいて非常に有用です。

全体として、単なるテキスト生成モデルというよりも、信頼性の高い実行レイヤーに近い存在です。

-

エージェントワークフローにおいて、Kimi K2.6が他モデルより遅いのはなぜですか?

遅延の主な原因は、モデルそのものというよりも、その使用方法にあります。

標準的なチャットシナリオでは、一つの応答を待つだけです。しかし、エージェントワークフローでは、1つのタスクに複数のステップが含まれ、それぞれが別々のモデル呼び出しとエージェント間の調整オーバーヘッドを必要とします。これが各ステージでレイテンシを発生させます。

加えて、Kimi K2.6はMoEスタイルのルーティングのような複雑なアーキテクチャを採用しており、小規模で最適化されたモデルと比較して推論オーバーヘッドが大きくなる傾向があります。マルチエージェントオーケストレーションと組み合わせると、その遅延はより顕著になります。

しかし、その代償として各ステップで高品質かつ構造化された出力が得られるため、リトライや手動修正の必要性が減ります。つまり、応答速度という点では遅くとも、ワークフローレベルではより効率的と言えます。