少し前まで、見栄えの良いソーシャル動画を作成するには、脚本、撮影、編集、サウンドデザインといったチームが必要でした。2026年までに、その全工程はテキストプロンプトとAPIコールに集約されています。製品説明や脚本の一節、コンテンツの概要を、そのまま公開可能な動画クリップへと変換するインフラが、今や存在しているのです。

本稿では、このインフラがどのような仕組みなのか、それを活用して何を作るか、そして大規模な運用において信頼性を保つために何が必要かを解説します。

なぜ今、ソーシャル動画の自動化が重要なのか

ショート動画は、もはや単なる娯楽ではありません。TikTok、Instagram Reels、YouTube Shortsは、文化、マーケティング、eコマースを牽引する中心的な流通エンジンとなりました。しかし、ここには「コンテンツ制作は需要に合わせてスケールしない」という単純な制約があります。

経験豊富なクリエイターであっても、高品質な動画を作るには、脚本、絵コンテ、撮影(または素材探し)、編集、カラーグレーディング、音響調整、字幕など、多大な時間を要します。ボトルネックとなるのは、アイデア不足ではありません。実行スピードです。トレンドが数時間しか続かない状況では、最初に投稿した者が勝者となります。AI動画生成は、バッチ生産を資本集約型のプロジェクトから日常的な運用コストへと変えることで、ゲームのルールを一変させました。

なぜUIよりもAPIが重要なのか

多くのAI動画ツールは便利なWebインターフェースを提供しています。プロンプトを入力し、ボタンをクリックすれば結果が得られます。これは個人クリエイターには便利ですが、自動化されたコンテンツシステムを構築する場合、UIは役に立ちません。真のスケールを実現するのは、APIです。

APIはプログラムによる制御を可能にします。ジョブをバッチで送信し、プラットフォームに合わせてアスペクト比を自動調整することも可能です。SaaSプラットフォームに動画生成機能をネイティブ機能として組み込むこともできます。プログラムによるA/Bテストを実行し、同じ製品説明から10種類のスタイルのバリエーションを生成して異なるオーディエンスセグメントに配信し、エンゲージメントデータを使用して次のプロンプトを改善することも可能です。

毎日200点の新製品が登録されるeコマースプラットフォームを想像してください。手作業ですべての紹介動画を作成するには、何十人もの動画プロフェッショナルが必要です。APIを使えば、製品データベースを読み取り、プロンプトテンプレートを自動生成し、APIを呼び出し、ソーシャルメディアの予約投稿ツールへ結果を送るスクリプトを書くだけで済みます。人間が編集ソフトを開く必要は一切ありません。UIは人のためのものですが、APIはシステムのためのものです。真のブレイクスルーは後者から生まれます。

APIコールの一生

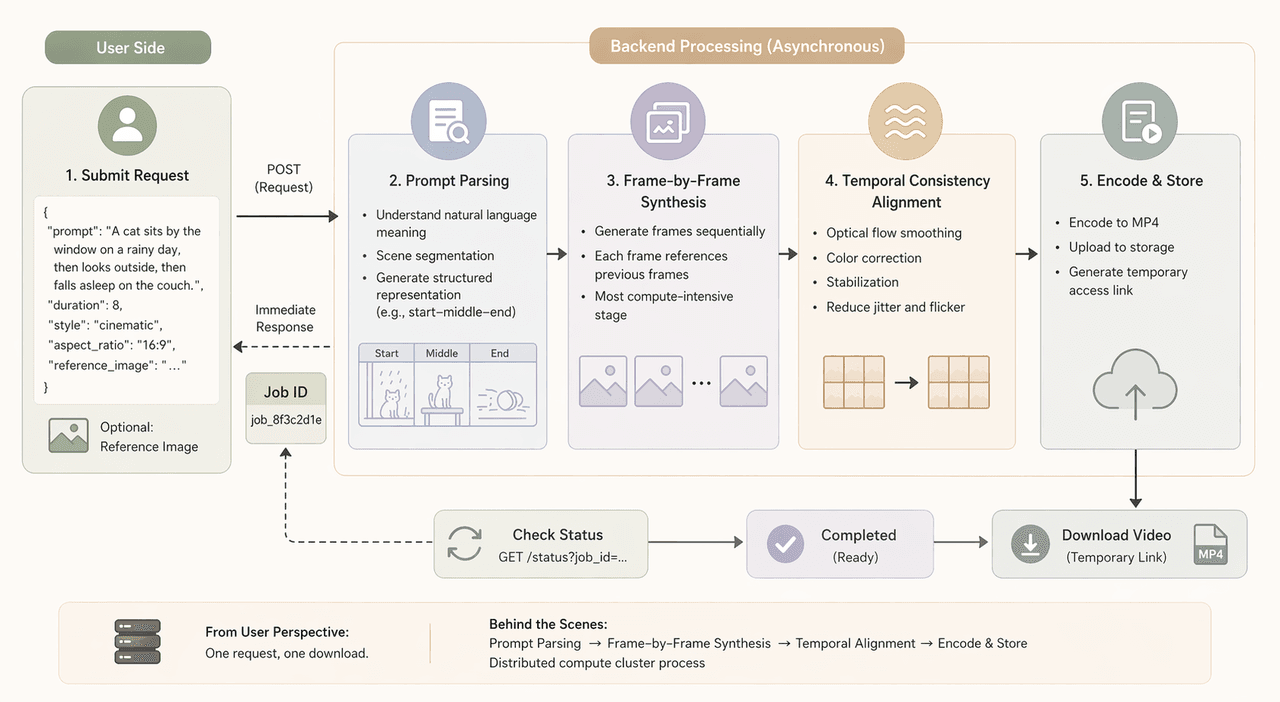

APIコールが送信からダウンロードに至るまでの流れを見てみましょう。

まず、プロンプトとパラメータをJSON形式でパッケージ化します。リクエストには通常、プロンプト、動画の長さ(例:8秒)、スタイルプリセット、アスペクト比、そしてキャラクターやシーンを固定するための参照画像などが含まれます。これをエンドポイントに送信すると、システムは即座に固有のジョブIDを返します。生成には数秒から数分かかるため、このプロセスは非同期で行われます。

送信後、バックエンドが処理を開始します。

ステップ1はプロンプトの解析です。自然言語を構造化された表現に変換します。これにはシーンのセグメンテーション(切り分け)が含まれます。説明文に3つの連続したアクションが含まれている場合、モデルが開始・中間・終了を判断します。

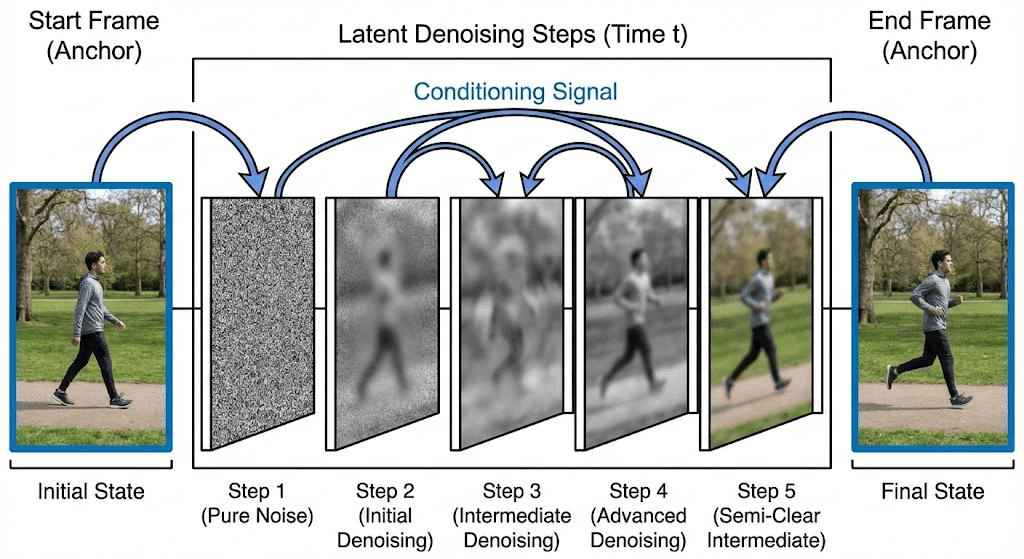

ステップ2はフレーム単位の合成です。モデルは先行するフレームを参照しながら、一貫性を保つために順番にフレームを生成します。これが最も計算リソースを消費する段階です。

ステップ3は時間的一貫性の調整です。モデルが最善を尽くしても、生のフレームにはわずかな揺れが生じることがあります。ポストプロセスの段階で、オプティカルフローのスムージング、色補正、スタビライゼーション(手ブレ補正)が適用されます。

最後に、システムは動画をMP4にエンコードし、ストレージにアップロードして一時的なアクセスリンクを生成します。ユーザーから見れば、1回のリクエストでダウンロードが完了します。裏側では、分散コンピューティングクラスターが膨大な計算を行っているのです。

活用事例

個人クリエイターはAPIを使ってアウトプットを倍増させています。1つの核となるアイデアから、色調を変えたり、ナレーションスタイルを切り替えたり、カメラの動きを調整したりして、何十ものバリエーションを生成できます。週に3本ではなく、1日に10本の動画を作成可能です。ボトルネックは「制作速度」から「何を公開するかという判断」へとシフトします。

クイックデモ:1つのアイデア、多数のバリエーション

plaintext1import requests 2 3API_KEY = "YOUR_API_KEY" 4url = "https://api.atlascloud.ai/api/v1" 5 6styles = ["cinematic", "anime", "documentary", "vlog"] 7 8for style in styles: 9 payload = { 10 "prompt": "A cat sitting by the window, wind blowing curtain", 11 "duration": 6, 12 "style": style, 13 "aspect_ratio": "1:1" 14 } 15 16 res = requests.post(url, json=payload, headers={ 17 "Authorization": f"Bearer {API_KEY}" 18 }).json() 19 20 print(f"{style} → job_id:", res["job_id"])

マーケティングチームはより体系的なアプローチをとります。一般的なのはマルチリージョン向けローカライズです。世界展開するブランドが20カ国でローンチする場合、マスター動画を作成し、スクリプトを実行して画面上のテキストやナレーション、視覚情報を各言語向けに自動置換します。1ヶ月かかっていた作業が数日で完了します。

eコマースも急成長している分野です。静的な製品画像と簡単な説明文を、動的な紹介動画へ変換します。スマートウォッチなら、照明やカメラワークを指定したクローズアップの説明を入力すれば、システムが6秒のループ動画を生成します。商品ページに配置された動画クリップは、多くの場合、静止画よりも高い成果を上げます。カタログ全体をバッチ処理することも可能です。

デベロッパーやSaaSプラットフォームは、動画生成をサービスとしてパッケージ化しています。例えば、ソーシャルメディア予約投稿ツールにAPIを統合すれば、ユーザーがツイートを入力するだけで、ツールが自動的に短い動画脚本に展開し、動画を生成して投稿を予約するといったことが可能です。こうしたプラットフォームは、動画生成を基本的な機能として取り入れ始めています。

AIの出力をプロダクション品質にするには

厳しい現実ですが、APIから出力されたそのままの動画が、すぐに公開できるクオリティであることは稀です。成功している制作システムは、APIをいくつかの層でラップ(包み込む)しています。

第一に、プロンプトエンジニアリングです。成熟したチームは、カテゴリー、スタイル、プラットフォームごとにプロンプトテンプレートのライブラリを維持しています。Instagram Reels用なら彩度を上げ、カットを早くするプロンプト、YouTube Shorts用ならストーリー展開を重視するプロンプトなどです。テンプレートには変数が含まれ、スクリプトが動的に値を挿入します。

第二に、生成品質の管理です。同じプロンプトを5回実行しても、3つは使えても2つは指が変形していたり、背景に不自然な物体があったりすることがあります。一般的な失敗パターンを検出し、再生成を促す自動チェックを組み込みます。

第三に、ポストプロセスのパイプラインです。生成後、ロゴやイントロ/アウトロの追加、字幕の焼き込みが必要になる場合があります。これらは編集ソフトへの再インポートではなく、スクリプトで自動処理します。

第四に、キャッシュと再利用です。ライブラリで同じ製品やキャラクターを繰り返し使用する場合は、結果をキャッシュします。これによりコストを削減し、視覚的な一貫性を保てます。

これらの層が重なり合って、初めて本物のコンテンツエンジンとなります。APIはあくまで一つのコンポーネントです。価値は、それらをどのようにシステムとして組み立てるかにあります。

まだ実現できないこと

AI動画生成は、まだ完璧には程遠い状態です。15秒以上の動画を生成しようとすると、物体の変形やシーンの論理破綻、キャラクターの一貫性の欠如などの問題が発生しやすくなります。現在のモデルが効果的なストーリーテリングを行える時間は短いです。

計算コストも制約の一つです。高品質な動画を1秒生成するのには、画像を1枚生成するよりもはるかに多くのGPU時間が必要です。価格は下がっていますが、1日に数百本の動画が必要なチームにとっては、コスト計算が重要になります。現実的なアプローチとしては、高コストな生成は重要なコンテンツに限定し、テスト用には安価なオプションを使用することが推奨されます。

プロンプトの予測不能性も依然として悩みの種です。昨日と同じプロンプトが、今日同じ結果を返すとは限りません。提供元によって結果も大きく異なります。自動化システムには追加の堅牢性が必要です。すべての生成が期待通りになるとは限らないという前提で、リトライ処理を組み込んでください。

複数シーンにわたる物語の一貫性も、まだ非常に弱いです。「カフェでコーヒーを飲む人」を生成し、「同じ人物が通りに出てくる」シーンを生成しても、モデルはそれらの切り替わりを自動的には理解しません。複数シーンの動画を作るには、現時点では各カットを詳細に記述する必要があります。

今後の展望

こうした制限はあっても、向かっている方向は明らかです。動画生成はスタンドアロンのツールにとどまりません。今後数年のうちに、トレンドを毎朝スキャンし、動画コンセプトを自動生成し、小規模なテストを実行し、最もパフォーマンスの高かったものを自動選定して拡散する、完全自動化されたコンテンツパイプラインが普及するでしょう。人間はクリエイティブな決定を下すのではなく、最終的なブランドセーフティの確認を行うだけになります。

また、エージェント型のクリエイティブシステムも期待されます。「今週の新製品の認知度を上げる」という目標をAIエージェントに与えれば、脚本の方向性を提案し、候補を生成し、テストオーディエンスに配信し、フィードバックを分析し、戦略を調整し、次のバッチを生成するようになるでしょう。

リアルタイムのパーソナライズされた動画ストリームも登場するはずです。フィットネスアプリが、ユーザー自身のデータ、進捗状況のビジュアル、励ましのナレーションを盛り込んだ、週次パーソナライズレポートを自動生成するような形です。

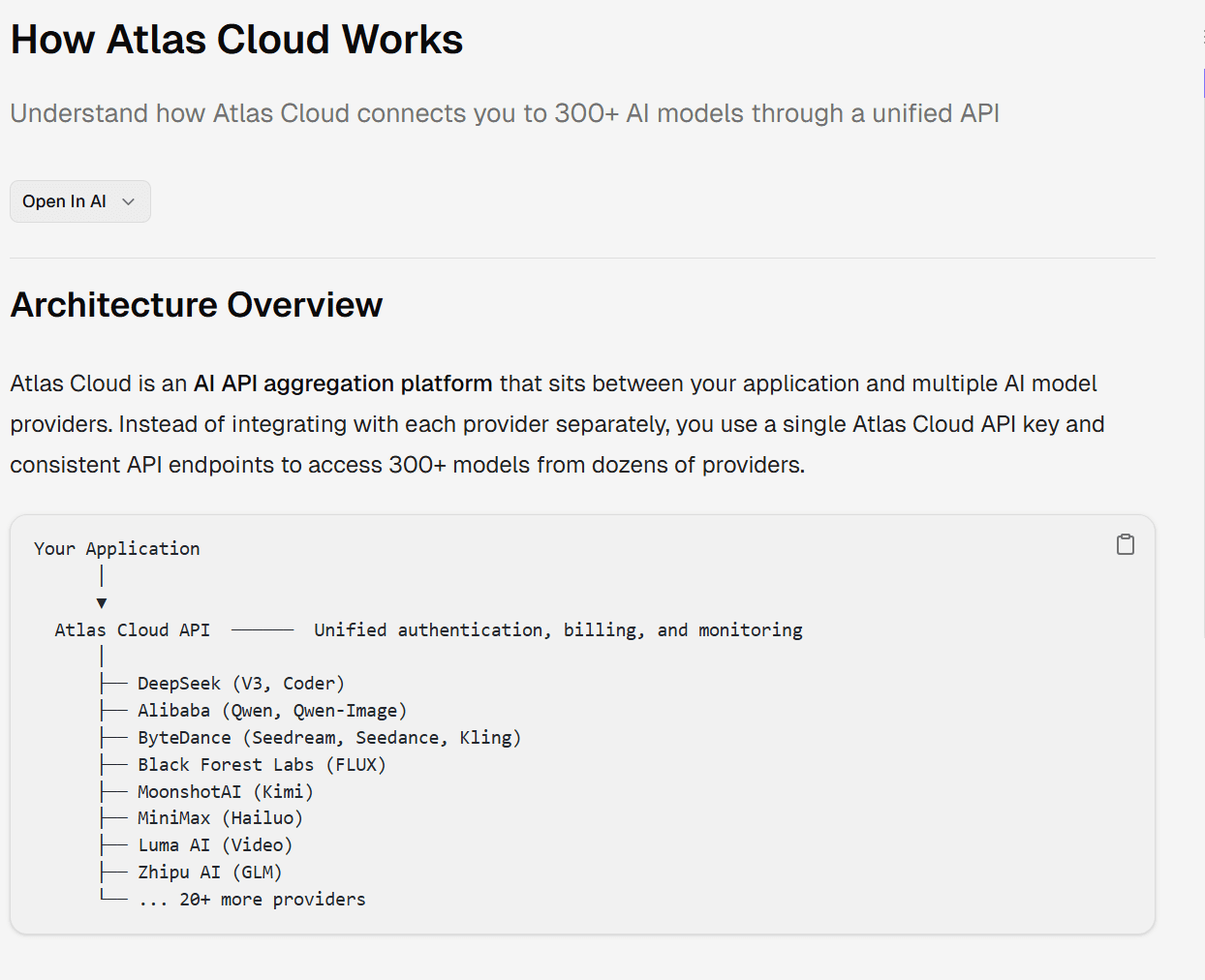

最後に、マーケティングオートメーションスタックとの深い統合も期待されます。AtlasCloudのようなプラットフォームは、画像および動画生成のための複数のモデルを集約し、ユーザーが自身のクリエイティブやビジネスプロジェクトに組み込みやすくするサポートを行っています。

最後に

手作業の編集からAPIベースの生成への移行は、単なるツールのアップグレードではありません。コンテンツがどのように作られ、消費されるかという構造的な変化です。動画生成APIは、現代のデジタルストーリーテリングのインフラ層になりつつあります。クリエイターにとっては「スケール」を、デベロッパーにとっては「チャンス」を、プラットフォームにとっては「自動化」を意味します。そしてインターネットにとっては、静的なバッチ生産から継続的な生成メディアシステムへの移行を意味します。その転換は、すでに始まっているのです。APIキーとアイデアさえあれば、誰でも独自の動画パイプラインを構築できます。数百万ドルの予算はもう必要ありません。