Flux.2 Image Models

Developed by Black Forest Labs, FLUX.2 is a powerhouse 32-billion parameter rectified flow Transformer model that redefines creative workflows by unifying AI image generation, editing, and composition. It transforms complex text prompts into high-fidelity visuals while offering integrated tools for professional-grade editing at resolutions up to 2K, providing a streamlined, all-in-one solution for digital artists and designers seeking unmatched precision and scalability in their visual content creation.

Verken Toonaangevende Modellen

Atlas Cloud biedt u de nieuwste toonaangevende creatieve modellen in de industrie.

Wat Flux.2 Image Models Onderscheidt

Atlas Cloud biedt u de nieuwste toonaangevende creatieve modellen uit de industrie.

Photorealistic Quality

Generates crisp, high-resolution images with accurate lighting, textures, and detail for production use.

Fast, Lightweight Inference

Optimized architecture delivers rapid image generation on modest GPUs and edge hardware.

Fine-Grained Control

Supports styles, presets, and prompt controls so designers can quickly dial in the exact look they want.

Seamless Workflow Integration

Simple APIs and plugins connect Nano Banana to design tools, apps, and pipelines with minimal setup.

Cost-Efficient Creativity

Efficient diffusion kernels and smart caching keep generation costs low, so teams can experiment freely at scale.

Flexible Deployment Options

Flexible Deployment Options Run in the cloud, on-prem, or in VPC environments.

Pieksnelheid

Laagste kosten

| Modaliteit | Beschrijving |

|---|---|

| Flux.2 Dev API(Text To Image, Image To Image) | De Flux.2 Dev API biedt toegang tot 's werelds krachtigste open-weights model met 32 miljard parameters, ontworpen voor geavanceerde tekst-naar-beeld generatie en multi-input beeldbewerking. Door gebruik te maken van een uniform checkpoint voor zowel creatie als modificatie, stroomlijnt het professionele creatieve workflows en biedt het een ongeëvenaarde basis voor het bouwen van geavanceerde, aanpasbare visuele AI-toepassingen onder commerciële licenties. |

| Flux.2 Pro API(Text To Image, Image To Image) | De Flux.2 Pro API levert toonaangevende beeldkwaliteit en prompt-naleving die wedijvert met topklasse closed-source modellen, terwijl latentie en operationele kosten aanzienlijk worden verlaagd. Het biedt een hoogwaardige oplossing voor zakelijke toepassingen die visuele getrouwheid van topniveau vereisen zonder het hoge prijskaartje. |

| Flux.2 Flex API(Text To Image, Image To Image) | De Flux.2 Flex API biedt ontwikkelaars granulaire controle over generatieparameters, inclusief guidance scales en inferentiestappen, om de afweging tussen snelheid en promptgetrouwheid perfect te kalibreren. Specifiek geoptimaliseerd voor ingewikkelde details en nauwkeurige typografische rendering, dient het als een veelzijdige toolkit voor makers die hoge precisiecontrole eisen over complexe visuele composities en tekstuele elementen. |

| Flux.2 Klein API(Text To Image, Image To Image) | De Flux.2 Klein API biedt een lichtgewicht maar robuuste oplossing via geavanceerde size-distillation technieken, uitgebracht onder de ontwikkelaarsvriendelijke Apache 2.0-licentie. Het presteert beter dan modellen van vergelijkbare schaal die from scratch zijn getraind, en biedt een efficiënt en toegankelijk pad voor het genereren van afbeeldingen van hoge kwaliteit in omgevingen met beperkte middelen. |

Nieuwe functies van Flux.2 Image Models + Showcase

De combinatie van geavanceerde modellen met het GPU-versnelde platform van Atlas Cloud biedt ongeëvenaarde snelheid, schaalbaarheid en creatieve controle voor beeld- en videogeneratie.

Verbeterde textuurgetrouwheid en realistische belichting met de FLUX.2 API

Het FLUX.2-model benut zijn architectuur met 32 miljard parameters om scherpere texturen en gestabiliseerde belichting te leveren in alle visuele outputs. Door de interactie tussen licht en materie in de latente ruimte te optimaliseren, kunnen gebruikers fotorealistische resultaten bereiken voor high-end productvisualisatie en professionele fotografie. Het is de ultieme oplossing voor hyperrealistische rendering, materiaalconsistentie en digitale assets van studiokwaliteit.

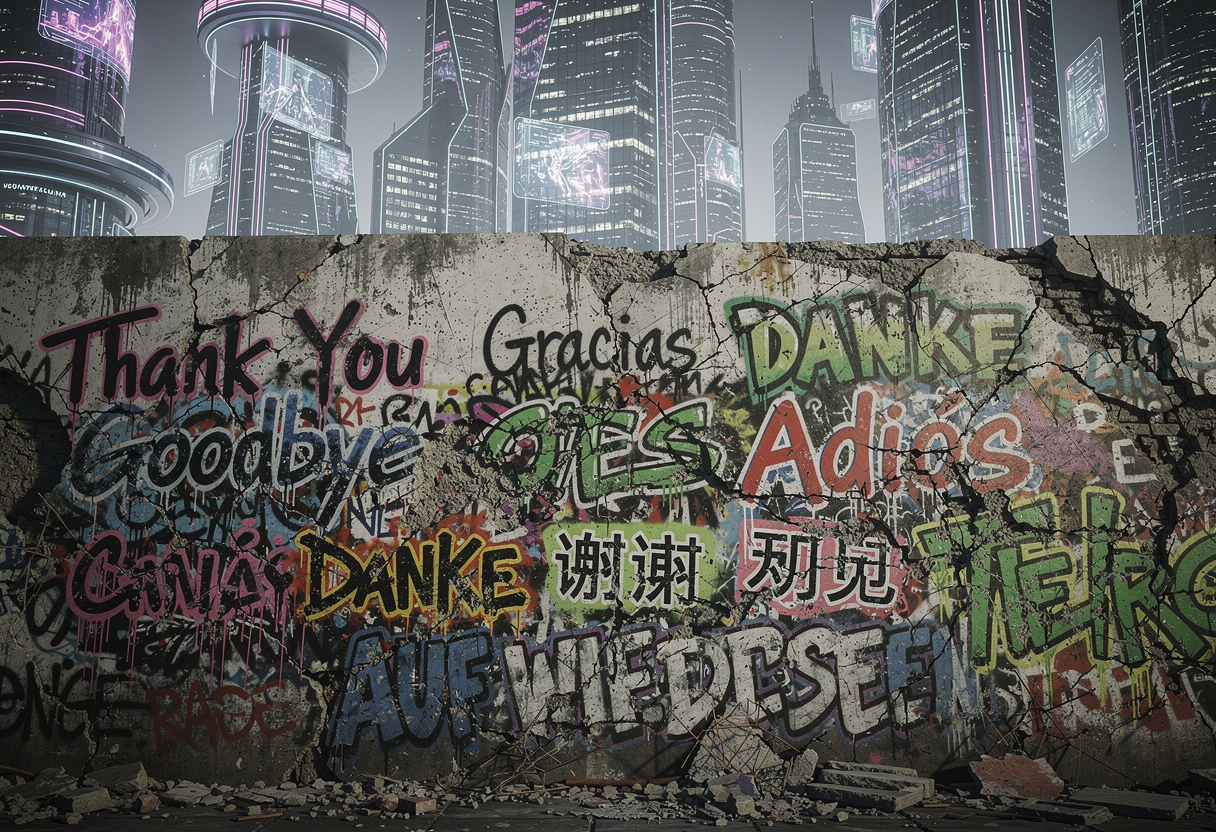

Geavanceerde typografie en grafische rendering met de FLUX.2 API

FLUX.2 ondersteunt complexe typografische lay-outs en ingewikkelde UI-simulaties, waardoor zelfs microtekst leesbaar en scherp blijft. Door geavanceerde codering op tekenniveau te integreren, kunnen gebruikers infographics, memes en merkcontent nauwkeurig renderen zonder tekenvervorming. Het is de ultieme oplossing voor professioneel grafisch ontwerp, interface-prototyping en tekstzware creatieve composities.

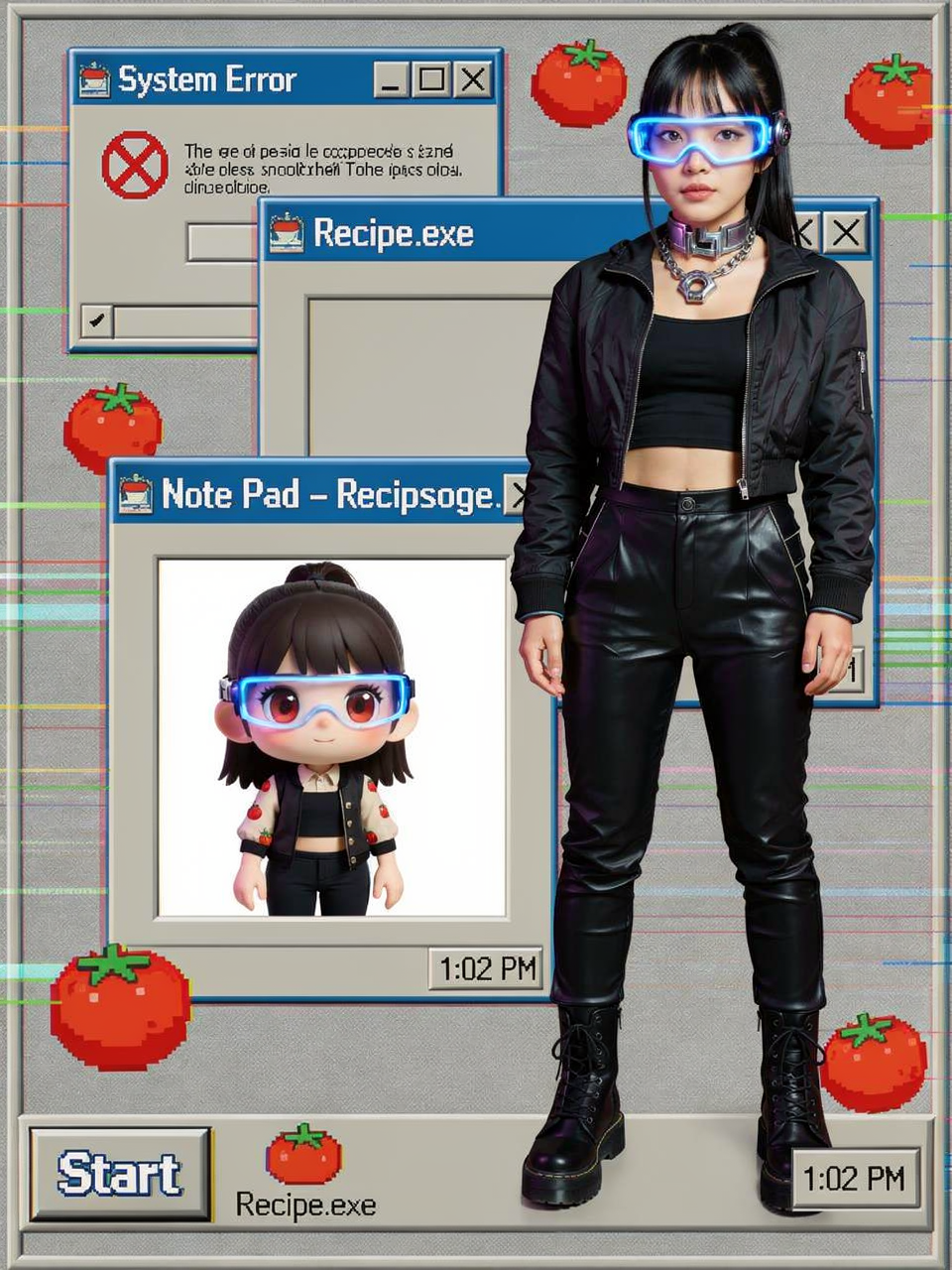

Begrip van gestructureerde prompts en compositorische controle met de FLUX.2 API

De FLUX.2-engine biedt superieure logica voor het interpreteren van prompts van meerdere paragrafen en complexe ruimtelijke beperkingen met hoge getrouwheid. Door genuanceerde relationele richtlijnen te decoderen, kunnen gebruikers nauwkeurig scènes met meerdere onderwerpen orkestreren en strikt vasthouden aan de compositorische intentie. Het is de ultieme oplossing voor geavanceerde verhalenvertelling, gelaagde digitale kunst en precisie-gestuurde visuele verhalen.

Verbetering van wereldlogica en ruimtelijk inzicht met de FLUX.2 API

FLUX.2 integreert enorme wereldkennis om de fysieke relaties tussen licht, ruimte en objectgedrag diepgaand te begrijpen. Door elke generatie te baseren op realistische omgevingslogica, kunnen gebruikers ervoor zorgen dat complexe scènes zich precies gedragen zoals verwacht in de fysieke wereld. Het is de ultieme oplossing voor architecturale visualisatie, immersieve wereldbouw en logisch consistente scènesynthese.

Wat U Kunt Doen met Flux.2 Image Models

Ontdek praktische use cases en workflows die u kunt bouwen met deze modelfamilie — van contentcreatie en automatisering tot productie-grade applicaties.

Fotorealistische high-fidelity rendering met de FLUX.2 API

Het FLUX.2-model stelt makers en ontwikkelaars in staat om ultra-realistische visuele content te bouwen die levensechte texturen, gestabiliseerde belichting en fysieke nauwkeurigheid behoudt. Ideaal voor professionele productfotografie en architecturale visualisatie, zorgt de 32B-parameterarchitectuur voor consistente oppervlaktereflecties en materiaaldiepte—ter ondersteuning van high-end marketingmateriaal, mockups voor luxe merken en digitale fotografie van studiokwaliteit.

Nauwkeurig typografisch ontwerp en lay-out met de FLUX.2 API

For information-dense graphics, FLUX.2 renders complex typography, UI simulations, and intricate layouts with absolute clarity and zero character distortion. This use case fits graphic designers, branding experts, and social media creators requiring precise text integration in posters, infographics, and interface prototypes—ensuring even micro-fonts remain legible and perfectly aligned, powered by advanced Transformer-based semantic understanding.

Logische scènecompositie en 4MP-bewerking in hoge resolutie

FLUX.2 biedt een ongeëvenaarde interpretatie van gestructureerde, meerdelige prompts, wat geavanceerde scènes met meerdere onderwerpen en complexe ruimtelijke arrangementen mogelijk maakt. Met ondersteuning voor bewerking in hoge resolutie tot 4 miljoen pixels, vergemakkelijkt de API naadloze beeld-naar-beeld transformaties en nauwkeurige lokale aanpassingen. Hiermee wordt een efficiënte alles-in-één oplossing geboden voor professionele digitale kunstenaars en visionairs die logische consistentie eisen in grootschalige creatieve projecten.

Modelvergelijking

Bekijk hoe modellen van verschillende aanbieders zich verhouden — vergelijk prestaties, prijzen en unieke sterke punten voor een weloverwogen beslissing.

| Model | Limiet referentieafbeeldingen | Aantal outputs | Resolutie | Model |

|---|---|---|---|---|

| Flux.2 | 10 | 1 | 2K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Flux.1 | 1 | 1 | 256P~4K | Width[256, 4096]px; Height[256, 4096]px |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

How to Use Flux.2 Image Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

Waarom Flux.2 Image Models Gebruiken Op Atlas Cloud

De combinatie van Flux.2 Image Models's geavanceerde modellen met het GPU-versnelde platform van Atlas Cloud biedt ongeëvenaarde prestaties, schaalbaarheid en ontwikkelaarservaring.

Prestatie & Flexibiliteit

Lage Latentie:

GPU-geoptimaliseerde inferentie voor realtime reasoning.

Uniforme API:

Voer Flux.2 Image Models, GPT, Gemini en DeepSeek uit met één integratie.

Transparante Prijzen:

Voorspelbare op tokens gebaseerde facturering met serverloze opties.

Onderneming & Schaling

Ontwikkelaarservaring:

SDK's, analytics, fine-tuning tools en sjablonen.

Betrouwbaarheid:

99,99% beschikbaarheid, RBAC en compliance-ready logging.

Beveiliging & Compliance:

SOC 2 Type II, HIPAA-afstemming, gegevenssoevereiniteit in VS.

Veelgestelde Vragen over Flux.2 Image Models

Het verenigt beeldgeneratie, lokale bewerking en compositie van meerdere beelden. FLUX.2 is 30%-50% sneller dan zijn voorganger en ondersteunt van nature 4MP hoge resolutie output, waarmee fotorealistische excellentie wordt bereikt in fysieke logica, belichting en texturen.

FLUX.2 rendert scherpe, nauwkeurige tekst, zelfs in complexe scènes, en ondersteunt lange paragrafen en micro-lettertypen. Door de integratie van het Mistral-3 24B visie-taalmodel blinkt het uit in infographics, UI-mockups en tekstrijke merkassets.

FLUX.2 is ontwikkeld door Black Forest Labs (BFL), opgericht door de oorspronkelijke makers van Stable Diffusion (SDXL). Het team pionierde met Latent Diffusion-technologie en herdefinieert nu visuele intelligentie via een Rectified Flow-architectuur met 32B parameters.

Verken Meer Families

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.