Introdução: O que é o Seedance 2.0?

Seedance 2.0 é o antecipado sucessor do modelo multimodal de geração de vídeo da ByteDance.

- O Upgrade: Enquanto o Seedance 1.5 Pro estabeleceu as bases para a geração audiovisual nativa, a versão 2.0 deve introduzir "Campos de Física Acústica" e "Priors de Modelo de Mundo".

- O Objetivo: Preencher a lacuna entre a geração por IA e a realidade física. Ele visa atuar como um diretor completo, gerenciando narrativas audiovisuais complexas para vídeos com mais de 30 segundos.

Principais Previsões: 3 Grandes Upgrades no Seedance 2.0 (Previstos)

1. Da Sincronia de Áudio à "Física Acústica"

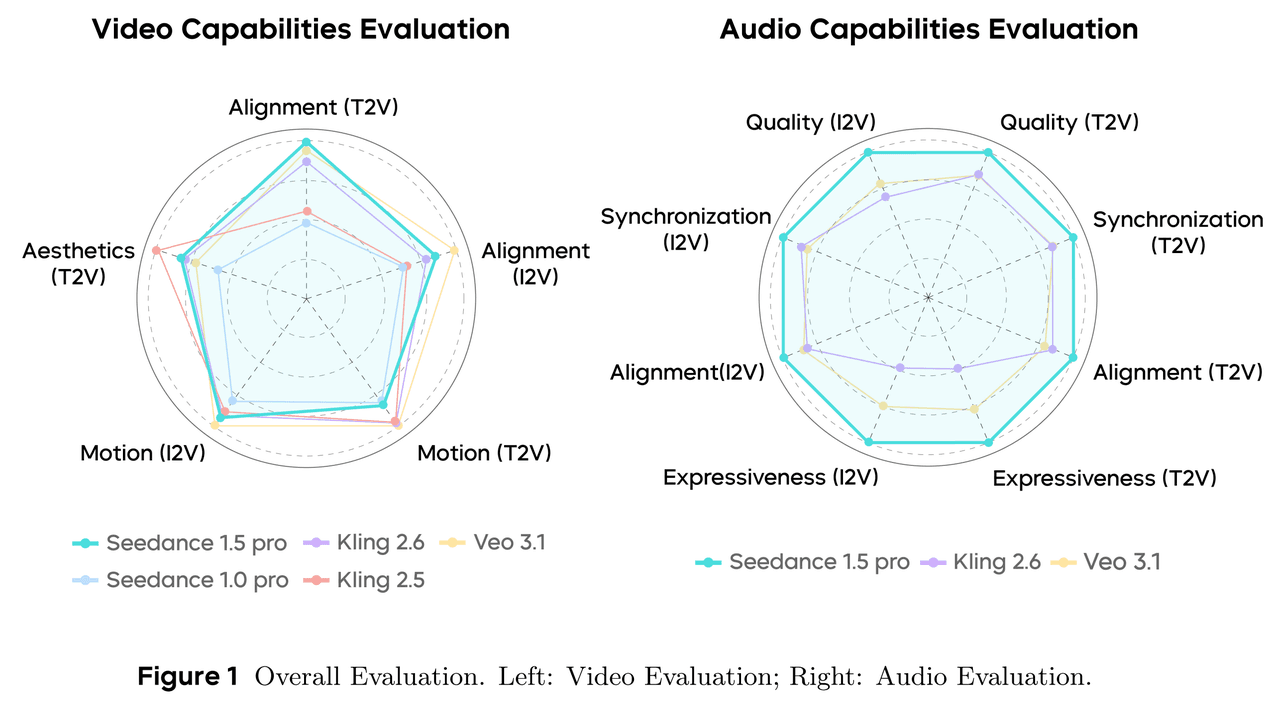

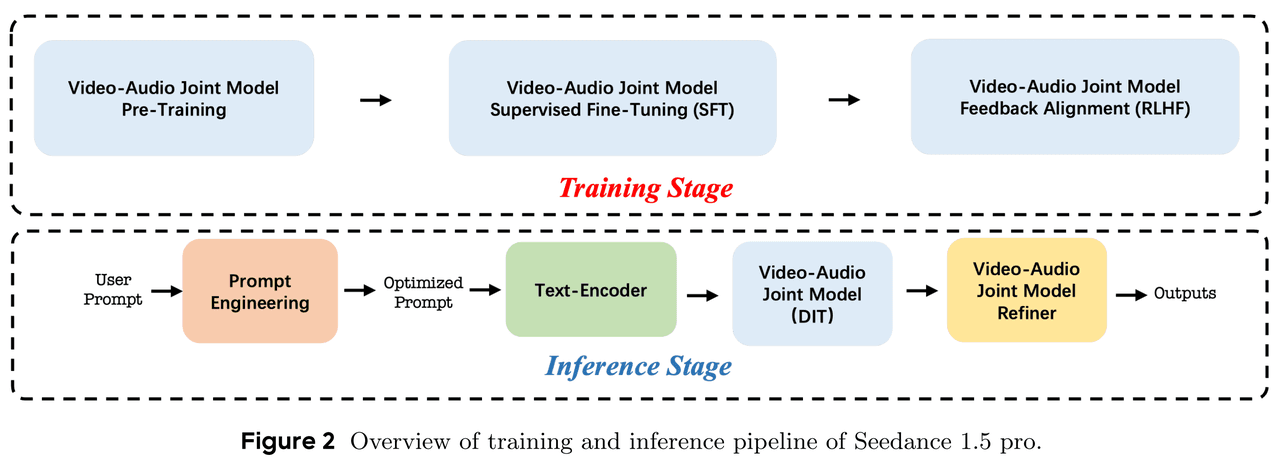

O Seedance 1.5 Pro utilizou um Dual-branch Diffusion Transformer (MMDiT) para resolver problemas de sincronia labial. No entanto, espera-se que o Seedance 2.0 simule um Campo Acústico completo.

- Física Multimodal Real: Se um vidro quebrar no vídeo, o áudio gerado não será apenas um efeito sonoro genérico. Ele calculará a reverberação com base no material do piso (ex: tapete vs. azulejo) visível no quadro.

- Priors Latentes: Isso envolve a adição de priors de motor físico à arquitetura MMDiT, dando ao som "peso" e "impacto".

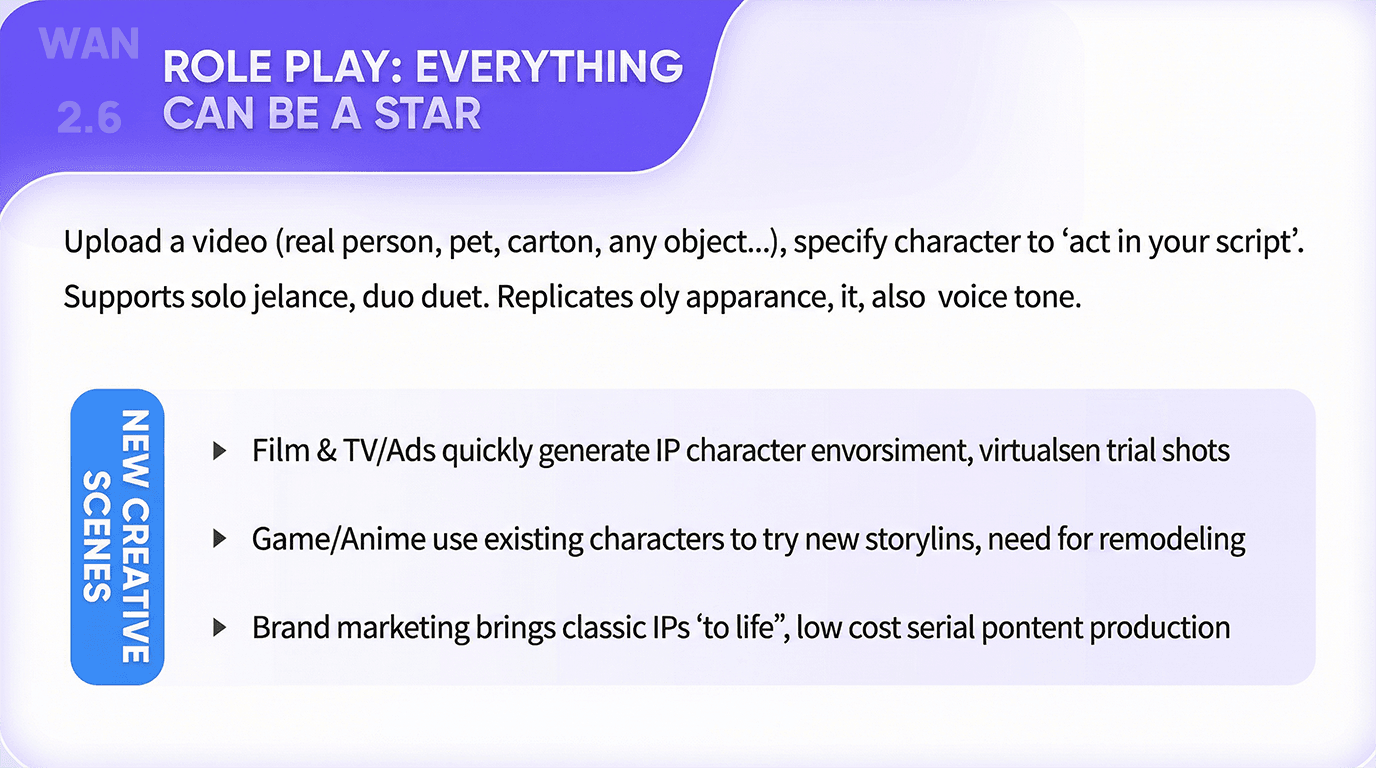

2. Lutando contra o Wan 2.6: Consistência em Vídeos Longos

- Atualmente, o Wan 2.6 domina a consistência de personagens com seu recurso Reference-to-Video, que funciona como um LoRA de personagem zero-shot. Espera-se que o Seedance 2.0 responda a isso travando no "World ID".

- Geração Mais Longa: Quebrando a "maldição dos 12 segundos", o Seedance 2.0 visa coerência nativa para vídeos de 30 a 60 segundos.

- Atenção Temporal: Otimizações aprimoradas pós-treinamento provavelmente permitirão que o modelo "lembre" de eventos do primeiro segundo e faça referência a eles no final do clipe.

3. Controle de Nível de Diretor

- Prevê-se que o Seedance 2.0 introduza Controle Baseado em Nós (Node-based Control) e capacidades de Visualização em Tempo Real.

- In-painting Parcial & Remixagem de Áudio: Usuários podem ser capazes de selecionar um personagem e modificar sua ação ou a emoção do diálogo (ex: de irritado para suplicante), mantendo a música de fundo e o ambiente inalterados.

Comparação: Seedance 2.0 vs. A Concorrência

| Recurso | Seedance 1.5 Pro | Seedance 2.0 (Previsto) |

| Arquitetura | MMDiT (Audiovisual) | World-MMDiT (Física + AV) |

| Áudio | Sincronia Labial, Alinhamento de Emoção | Simulação de Física, Interação com o Ambiente |

| Duração | Curto (~10s) | Longo (30s-60s) |

| Carga de Processamento | Alta | Extremamente Alta |

Como Acessar o Seedance 2.0: O Desafio do Hardware

A documentação técnica do 1.5 Pro destaca que, embora a otimização tenha aumentado a velocidade em 10x, o salto para as capacidades de "Modelo de Mundo" do Seedance 2.0 aumentará exponencialmente os requisitos de VRAM e processamento.

Rodar o Seedance 2.0 localmente — mesmo em uma NVIDIA RTX 4090 — provavelmente será impossível para a maioria dos usuários devido à enorme carga de processamento multimodal.

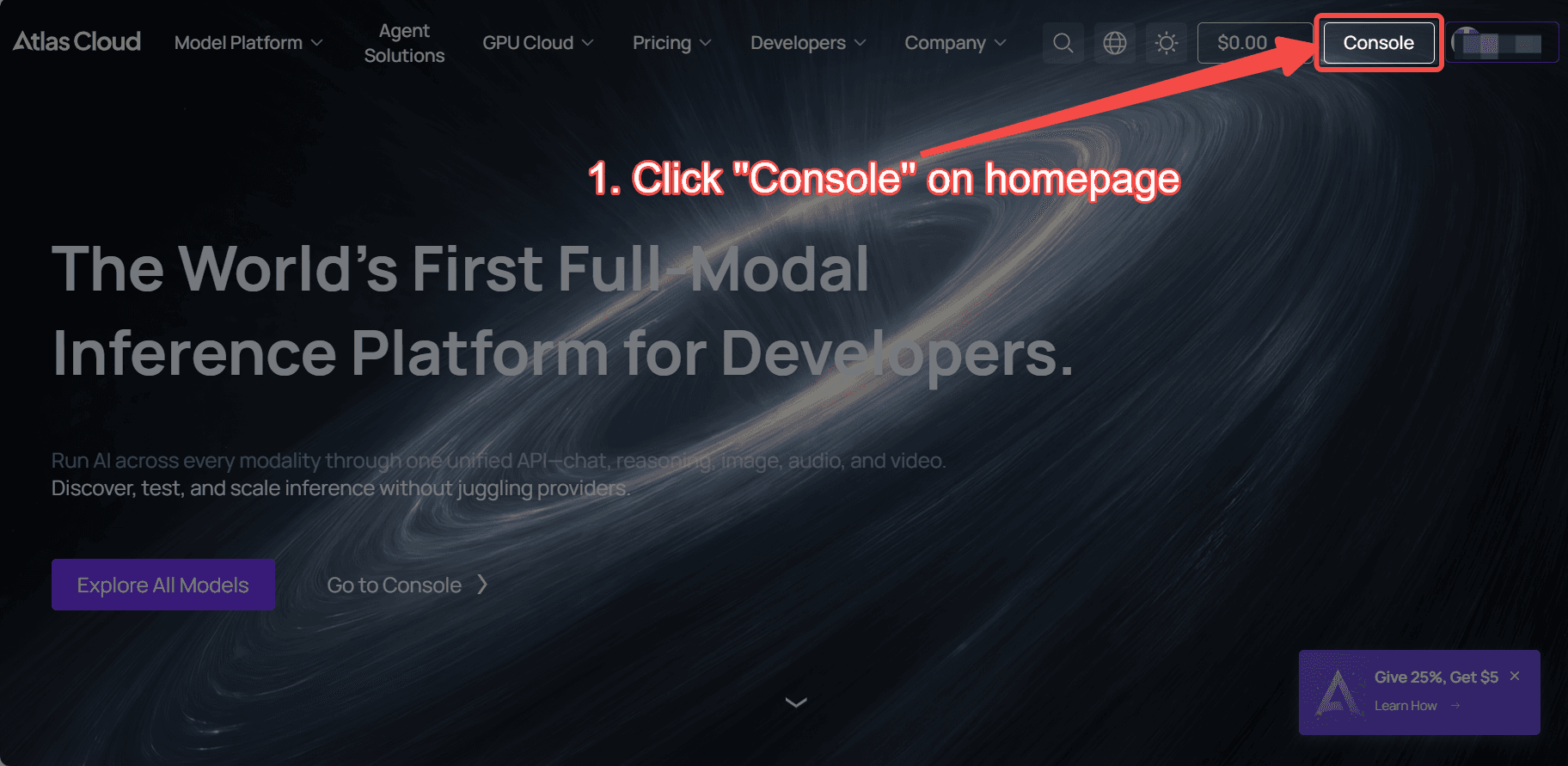

A Solução: Atlas Cloud

A Atlas Cloud está preparada para o lançamento. Integramos toda a família de modelos Seedance e daremos suporte ao Seedance 2.0 no Dia 0 do seu lançamento.

- Implantação Zero Configuração: Acesse modelos como Seedance, Kling e similares ao Sora sem configurações complexas de Python ou CUDA.

- Computação Elástica: Dimensione seu poder de GPU instantaneamente. Pague por segundo para renderizar vídeos longos e complexos sem sobrecarregar seu hardware local.

- Acesso via API: Desenvolvedores podem integrar as capacidades do Seedance 2.0 diretamente em seus aplicativos via API da Atlas Cloud imediatamente após o lançamento.

Não deixe o hardware limitar sua criatividade. [Inscreva-se na Atlas Cloud] para garantir seu acesso prioritário para o lançamento do Seedance 2.0 em meados de fevereiro.

Como usar na Atlas Cloud

A Atlas Cloud permite que você use modelos lado a lado — primeiro em um playground, depois via uma única API.

Método 1: Use diretamente no playground da Atlas Cloud

Método 2: Acesso via API

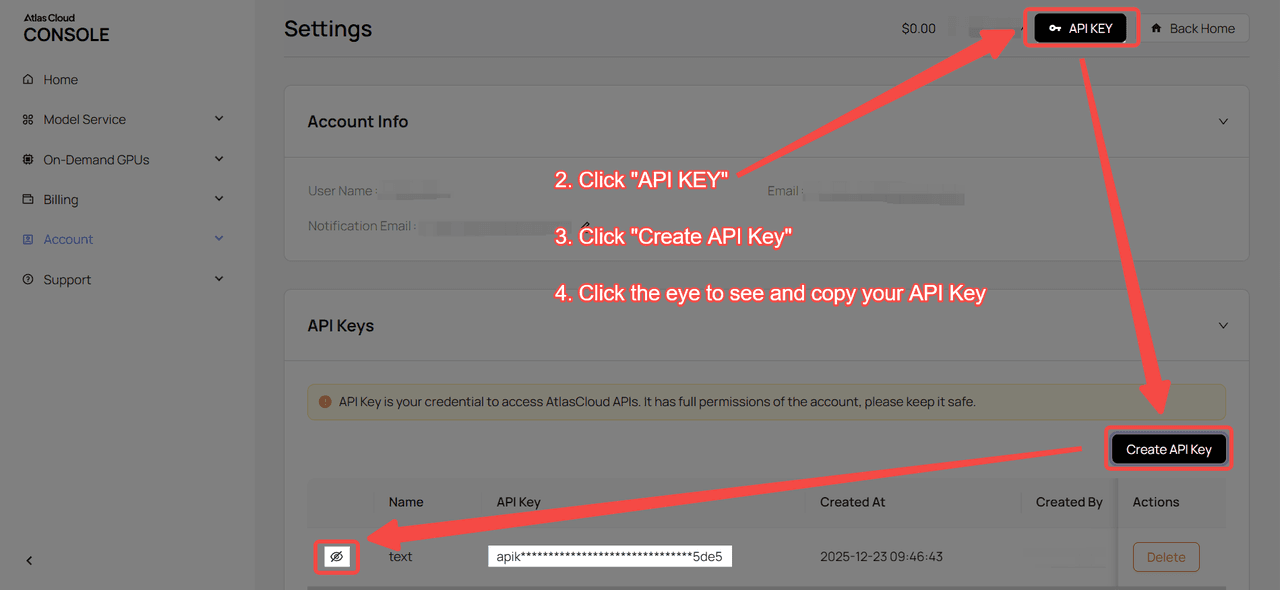

Passo 1: Obtenha sua chave de API

Crie uma chave de API no seu console e copie-a para uso posterior.

Passo 2: Verifique a documentação da API

Revise o endpoint, os parâmetros de requisição e o método de autenticação em nossos documentos de API.

Passo 3: Faça sua primeira requisição (exemplo em Python)

Exemplo: gerar um vídeo com o Seedance 1.5 Pro:

plaintext1import requests 2import time 3 4# Step 1: Start video generation 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-v1.5-pro/image-to-video-fast", 12 "aspect_ratio": "16:9", 13 "camera_fixed": False, 14 "duration": 5, 15 "generate_audio": True, 16 "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png", 17 "last_image": "example_value", 18 "prompt": "Use the provided image as the first frame.\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.", 19 "resolution": "720p", 20 "seed": -1 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24generate_result = generate_response.json() 25prediction_id = generate_result["data"]["id"] 26 27# Step 2: Poll for result 28poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 29 30def check_status(): 31 while True: 32 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 33 result = response.json() 34 35 if result["data"]["status"] in ["completed", "succeeded"]: 36 print("Generated video:", result["data"]["outputs"][0]) 37 return result["data"]["outputs"][0] 38 elif result["data"]["status"] == "failed": 39 raise Exception(result["data"]["error"] or "Generation failed") 40 else: 41 # Still processing, wait 2 seconds 42 time.sleep(2) 43 44video_url = check_status()