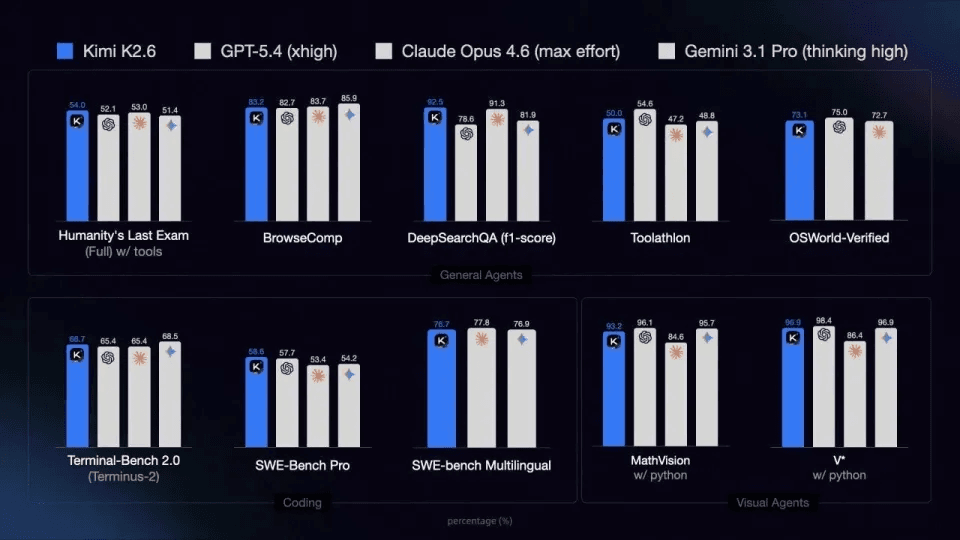

O Kimi acaba de lançar o K2.6 — disponibilizado em open-source no HuggingFace e comparado com o GPT-5.4, Claude Opus 4.6 e Gemini 3.1 Pro. Ele supera os três no Humanity's Last Exam, DeepSearchQA e SWE-Bench Pro, com uma capacidade de código quase 20% superior à do K2.5, redução de 35% nos passos médios de tarefa e um preço de 1/8 do Claude Opus 4.6 para cargas de trabalho de Agentes.

Se você está executando Agentes de IA e deseja integrar o K2.6 à sua cadeia de ferramentas atual, este guia cobre as quatro principais estruturas — Claude Code, OpenCode, OpenClaw e Hermes Agent — com um endpoint de API compartilhado via atlascloud.ai. A segunda parte mostra o que o K2.6 realmente faz quando está em execução.

Referência Rápida

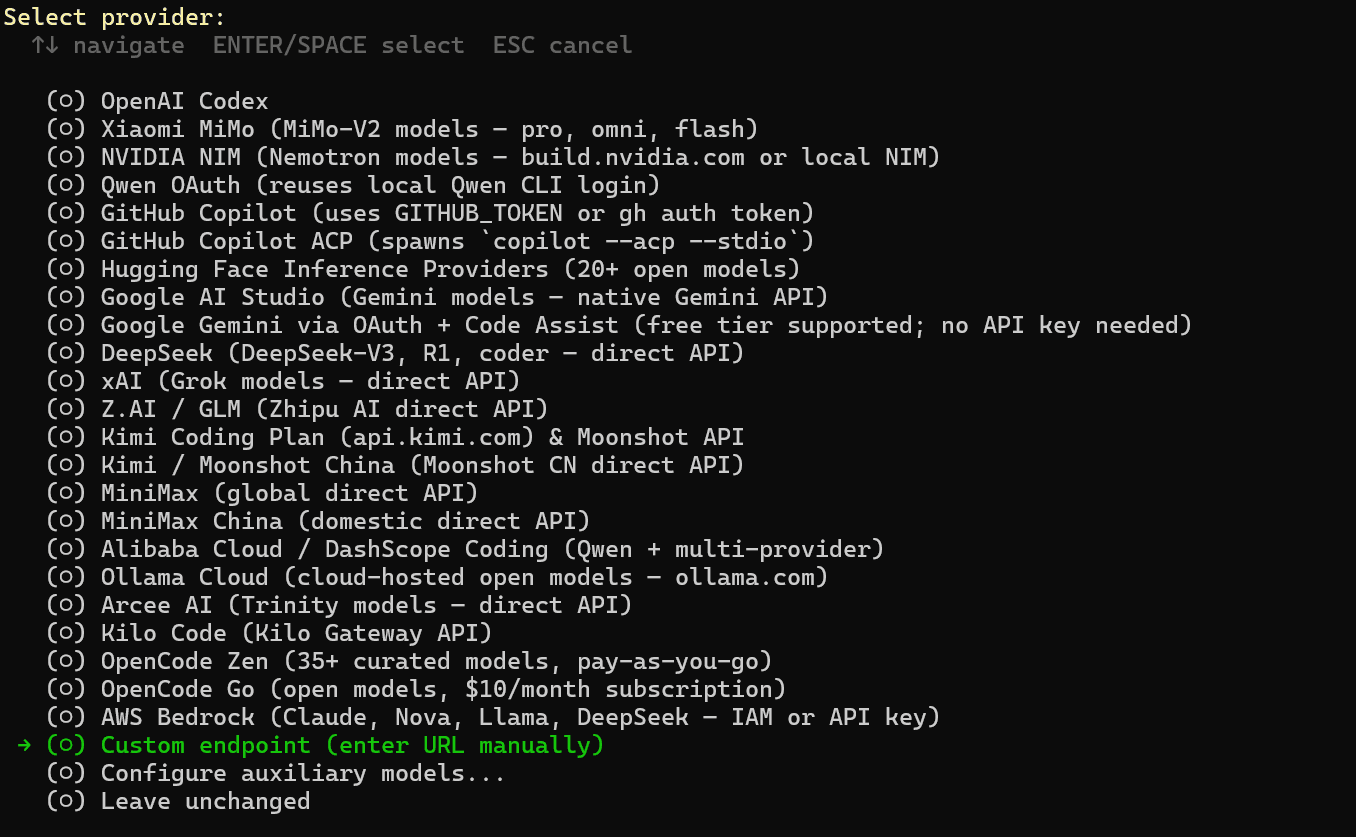

| Ferramenta | Local da Configuração | Trocar Modelo | Observação |

| Claude Code | variáveis de ambiente ANTHROPIC_* | mudar via env ou /model | nenhuma |

| OpenCode | ~/.config/opencode/config.json | editar campo model | deve usar @ai-sdk/openai-compatible |

| OpenClaw | ~/.openclaw/openclaw.json | editar primary | precisa iniciar o gateway primeiro |

| Hermes Agent | setup interativo do hermes | rodar setup novamente | formato do ID do modelo deve ser exato |

Todos os tutoriais neste artigo foram realizados no Windows usando WSL2.

Parte 1 — Configuração

-

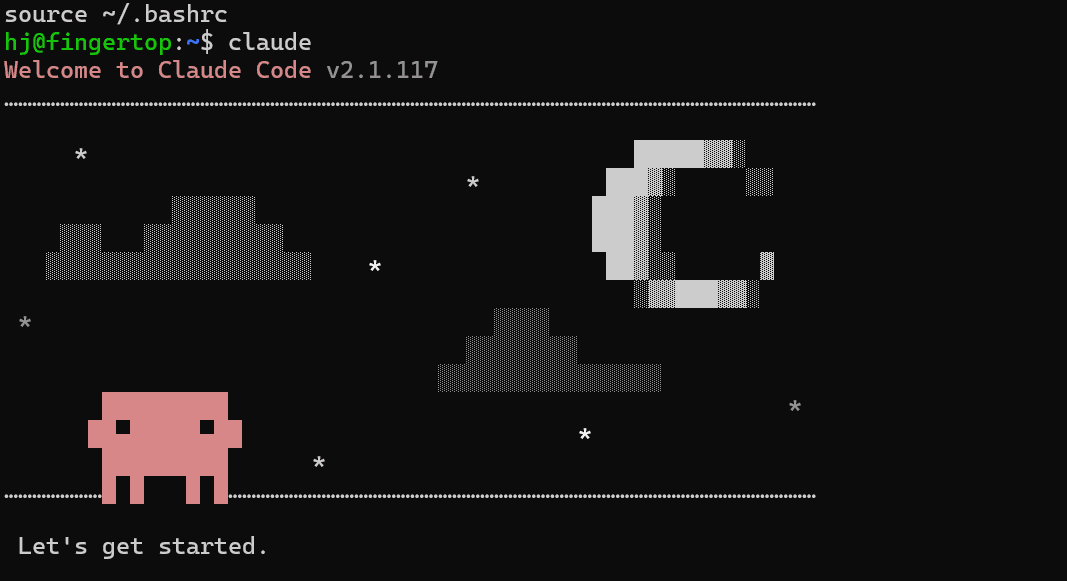

Claude Code (Mais simples)

Documentação oficial de download do Claude Code: https://github.com/anthropics/claude-code

O Claude Code utiliza nativamente o formato da Anthropic. Defina três variáveis de ambiente e pronto:

plaintext1# Adicione ao ~/.bashrc ou ~/.zshrc 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

Após executar

1source ~/.bashrc1/model2. OpenCode (Arquivo de Configuração)

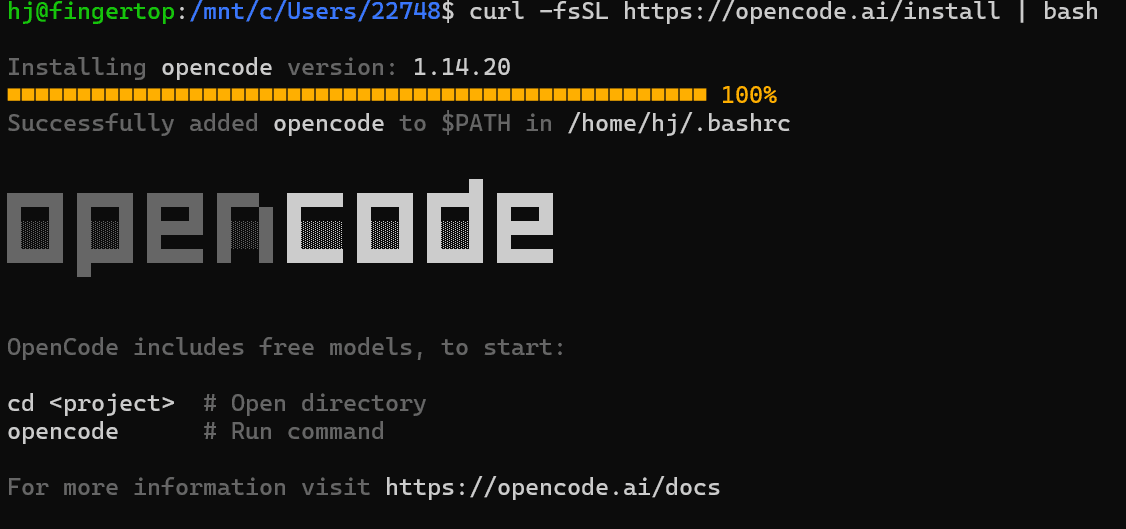

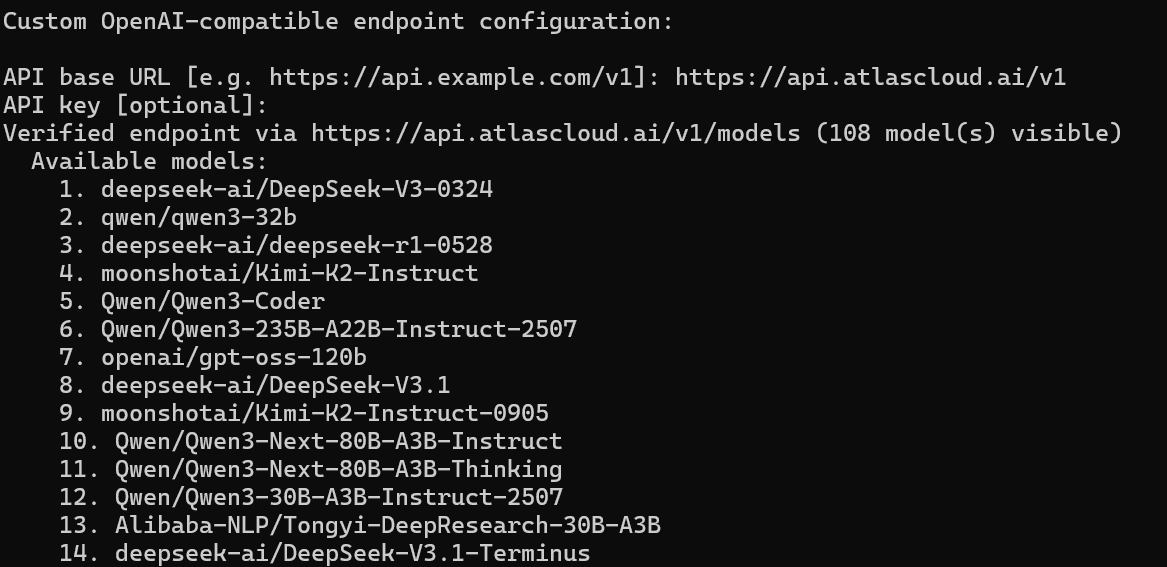

Documentação oficial de download do OpenCode: https://github.com/anomalyco/opencode

O OpenCode possui um provedor

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonjson

plaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

O campo

1model1providerName/modelKey

3. OpenClaw (Arquivo de Configuração + Dois Terminais)

O OpenClaw roda como dois processos separados: um gateway e um TUI. Ambos precisam estar ativos antes de você usá-lo.

1~/.openclaw/openclaw.jsonjson

plaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

Ordem de inicialização:

bash

plaintext1# Terminal 1 2openclaw gateway 3 4# Terminal 2 5openclaw tui

Para reconfiguração interativa:

1openclaw configurePara trocar de modelo, edite o campo

1primary4. Hermes Agent (Configuração Interativa)

O Hermes usa um assistente (wizard) em vez de um arquivo de configuração:

bash

plaintext1hermes setup

Preencha os prompts:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

Importante: O ID do modelo deve incluir o prefixo

. Inserir apenastext1moonshot/retornará um erro 404.text1kimi-k2.6

Para trocar de modelo posteriormente, execute

1hermes setup

Parte 2 — O que o K2.6 realmente faz

Claude Code × K2.6 — O que acontece quando 23 agentes rodam ao mesmo tempo?

O que realmente falha primeiro quando você leva um sistema de IA ao limite?

Um desenvolvedor decidiu testar exatamente isso — executando 23 agentes simultaneamente via Claude Code durante um dia inteiro. Em 26 sessões, o sistema lidou com chamadas de ferramentas de alta frequência, pipelines de várias etapas e tarefas de cadeia longa, como redação de PRDs e planejamento de SEO. Em outras palavras, uma carga de trabalho "pronta para produção" onde as coisas geralmente começam a desmoronar.

Mas, desta vez, algo incomum aconteceu.

Houve zero erros de limite de taxa (429 rate-limit errors).

Para qualquer pessoa que tenha tentado escalar fluxos de trabalho de agentes, esta é a parte que se destaca. Em condições semelhantes, modelos como o GLM 5.1 tendem a atingir limites de taxa com frequência, forçando novas tentativas, quebrando pipelines e introduzindo instabilidade no sistema. O K2.6, por outro lado, manteve a estabilidade — não por ser o mais rápido, mas por ser consistentemente confiável sob pressão.

E essa distinção importa mais do que parece.

Porque, uma vez que você vai além de prompts únicos para sistemas multiagentes, o verdadeiro desafio não é mais "o modelo consegue responder bem?", mas:

Ele consegue continuar respondendo bem — através de dezenas de tarefas paralelas — sem quebrar o sistema?

Uma qualidade que parece planejamento, não apenas geração

A diferença não foi apenas sobre estabilidade. Ela também apareceu na forma como o K2.6 lidou com tarefas complexas.

Ao ser solicitado a escrever um PRD, o modelo não apenas respondeu — ele estruturou o espaço do problema por conta própria. Análise competitiva, histórias de usuários, priorização de funcionalidades — estes elementos não foram solicitados explicitamente, mas apareceram como se o sistema entendesse como um PRD "completo" deveria parecer.

Em tarefas de SEO, o comportamento foi semelhante. Em vez de pular direto para sugestões de palavras-chave, o K2.6 primeiro inferiu a intenção de busca e, em seguida, alinhou a direção do conteúdo de acordo. O resultado pareceu menos uma geração bruta e mais um planejamento estratégico de estágio inicial.

Esta é uma mudança sutil, mas importante:

Você não está mais apenas recebendo respostas — você está recebendo pensamento organizado.

E em ambientes multiagentes, isso se multiplica. Quando cada agente produz resultados estruturados e de alta qualidade, a camada de coordenação tem muito menos trabalho de limpeza a fazer.

O trade-off: a estabilidade tem um custo

Dito isso, esse desempenho não é gratuito.

O K2.6 é visivelmente mais lento que o GLM 5.1, especialmente em termos de latência do primeiro token. O atraso não é marginal — é aproximadamente uma ordem de grandeza maior. Em uma única interação, isso pode ser tolerável. Mas em um sistema onde 23 agentes estão rodando em paralelo, cada etapa introduz uma pequena pausa, e essas pausas se somam.

Parte disso vem de sua arquitetura. O K2.6 utiliza um design de Mistura de Especialistas (MoE), com cerca de 1 trilhão de parâmetros totais e 32 bilhões ativados por inferência. Essa escala traz capacidade, mas também sobrecarga de escalonamento. E como esta ainda é uma versão de visualização, é provável que a otimização de inferência ainda não tenha sido totalmente implementada.

Portanto, o trade-off torna-se claro:

- Se você se preocupa com vazão e velocidade, isso importa

- Se você se preocupa com estabilidade e resultados estruturados em escala, pode valer a pena

OpenCode × K2.6 — De um prompt para nove fluxos de trabalho paralelos

Se o experimento com o Claude Code mostra como o K2.6 se comporta sob pressão, o OpenCode revela outra coisa: como ele organiza o trabalho.

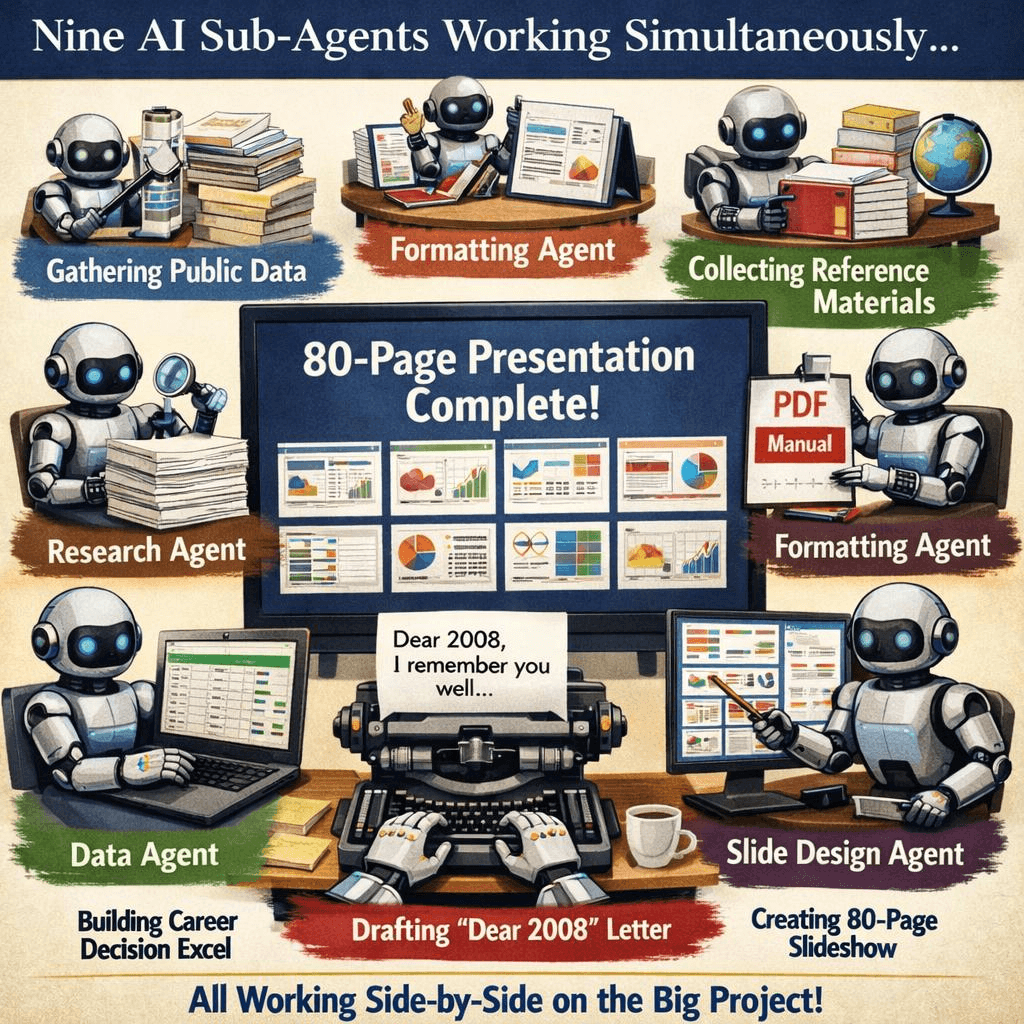

O K2.6 introduz uma camada de coordenação chamada AgentSwarm, onde um único agente "Coordenador" pode gerar dezenas de subagentes especializados, cada um designado com uma função específica. Em vez de lidar com uma tarefa passo a passo em um único thread, o sistema a divide e executa vários processos em paralelo.

Para ver como isso funciona na prática, considere este exemplo.

Um pesquisador pediu ao K2.6 para produzir um perfil detalhado de Dario Amodei, traçando sua trajetória desde o doutorado em física em Princeton até a fundação da Anthropic. Em vez de abordar isso como uma única tarefa de geração longa, o K2.6 a decompôs em nove trilhas paralelas.

Cada trilha tinha uma responsabilidade distinta. Um agente focou puramente em pesquisa, coletando informações públicas. Outro cuidou do layout, formatando o material em um PDF estruturado. Um agente separado construiu um conjunto de dados dos principais pontos de decisão de carreira. Enquanto isso, um agente de redação produziu uma narrativa em primeira pessoa intitulada “Dear 2008”.

Tudo isso rodou ao mesmo tempo.

O resultado não foi apenas uma única saída, mas um pacote coordenado: uma apresentação de slides de 80 páginas, apoiada por dados estruturados e documentos formatados. O que normalmente exigiria várias ferramentas, sessões e montagem manual foi produzido como uma entrega unificada.

Por que isso muda a maneira como você usa IA

O principal habilitador aqui é o sistema de Habilidades (Skill system).

Em vez de tratar cada tarefa como um novo prompt, o K2.6 permite carregar conhecimento estruturado — como um relatório do Goldman Sachs, uma análise de concorrente ou uma especificação de produto bem escrita — e transformá-lo em uma "Habilidade" reutilizável. Quando um subagente é executado, ele herda essa estrutura: o estilo analítico, o tom, até mesmo a organização.

Com o tempo, isso transforma seu sistema em algo muito diferente de um fluxo de trabalho baseado apenas em prompts.

Ele se torna um pipeline de produção repetível.

E isso leva a uma mudança na maneira como você pensa sobre o uso de IA:

Você não está mais dando prompts a um modelo — você está gerenciando uma equipe.

Se você está construindo fluxos de trabalho baseados em agentes, essa diferença é difícil de ignorar.

Todas as quatro ferramentas conectam-se via

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6FAQ

-

Qual é a diferença entre usar o Hermes Agent e chamar a API do Kimi K2.6 diretamente?

A diferença central está entre execução vs. resposta.

Quando você chama a API do Kimi K2.6 diretamente, você está essencialmente obtendo uma única resposta por solicitação. Mesmo para tarefas complexas, você ainda precisa quebrá-las manualmente, iterar sobre vários prompts e combinar os resultados por conta própria. Isso funciona bem para casos de uso simples ou interativos, mas rapidamente se torna ineficiente para fluxos de trabalho estruturados.

O Hermes muda isso ao introduzir a orquestração de fluxo de trabalho. Em vez de um único prompt, você define um pipeline com várias etapas — pesquisa, planejamento, execução, etc. — e o Hermes atribui cada etapa a um agente. Esses agentes podem passar resultados uns para os outros, validar resultados intermediários e até mesmo repetir etapas quando algo dá errado.

Na prática, isso significa que você passa de "engenharia de prompt" para orquestração de tarefas. A API torna-se um componente dentro de um sistema, em vez do sistema em si.

-

O Kimi K2.6 é bom para fluxos de trabalho multiagentes e automação?

Sim — é aqui que ele apresenta um desempenho notavelmente bom.

Em configurações multiagentes, os maiores desafios geralmente são:

- consistência entre etapas

- estabilidade durante execuções longas

- capacidade de seguir tarefas estruturadas

O Kimi K2.6 apresenta um desempenho sólido em todas as três áreas. Quando usado dentro do Hermes, ele pode manter saídas estruturadas em várias fases e lidar com cadeias de tarefas complexas sem quebrar o formato ou perder a direção.

Outro aspecto importante é a autocorreção. Se um resultado intermediário se desviar do objetivo, o sistema pode regenerar essa etapa em vez de continuar com dados falhos. Isso o torna muito mais adequado para cenários de automação onde você não quer supervisionar manualmente cada passo.

No geral, ele parece mais uma camada de execução confiável do que um simples gerador de texto.

-

Por que o Kimi K2.6 é mais lento em fluxos de trabalho de agentes em comparação com outros modelos?

A velocidade mais lenta deve-se principalmente à forma como ele está sendo usado, não apenas ao modelo em si.

Em um cenário de chat padrão, você só espera por uma resposta. Em um fluxo de trabalho de agente, uma única tarefa pode envolver várias etapas — cada uma exigindo uma chamada de modelo separada, além da sobrecarga de coordenação entre os agentes. Isso introduz latência naturalmente em cada estágio.

Além disso, o Kimi K2.6 foi projetado com uma arquitetura mais complexa (por exemplo, roteamento estilo MoE), o que pode aumentar a sobrecarga de inferência em comparação com modelos menores ou mais otimizados. Quando combinado com a orquestração multiagente, o atraso torna-se mais perceptível.

No entanto, o trade-off é que cada etapa produz saídas de maior qualidade e mais estruturadas, reduzindo a necessidade de novas tentativas ou correções manuais. Portanto, embora seja mais lento no tempo de resposta bruto, ele pode ser mais eficiente no nível do fluxo de trabalho.