OpenAI LLM Models

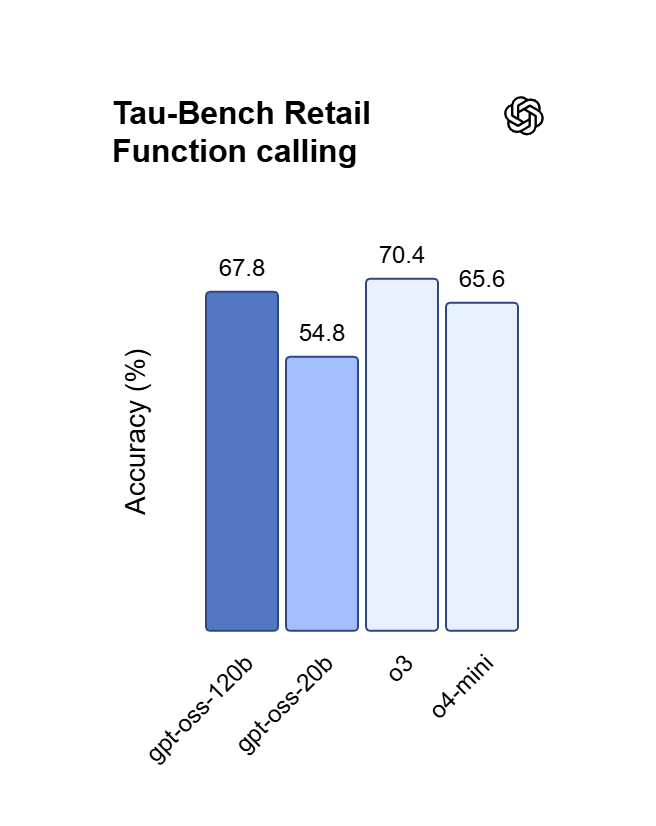

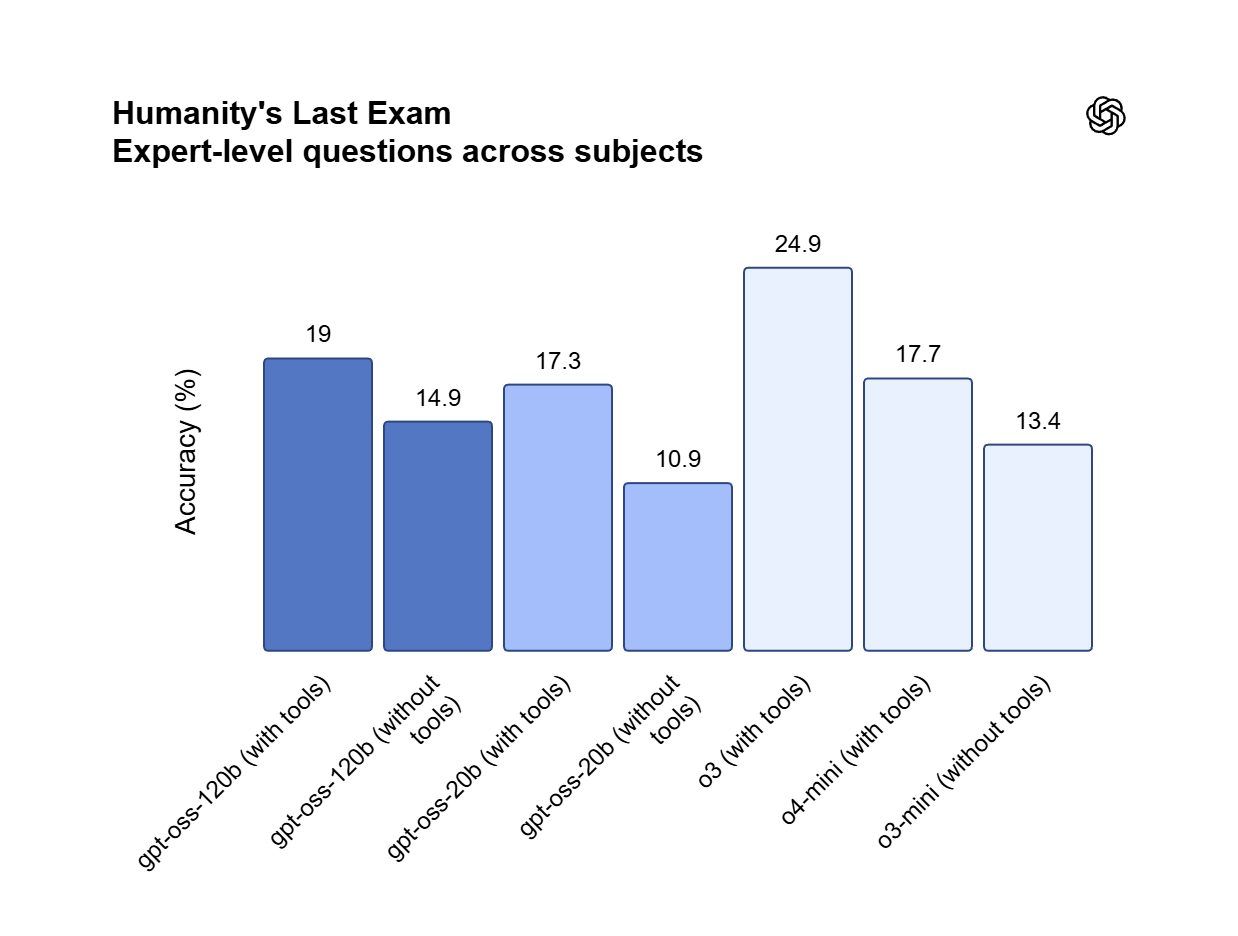

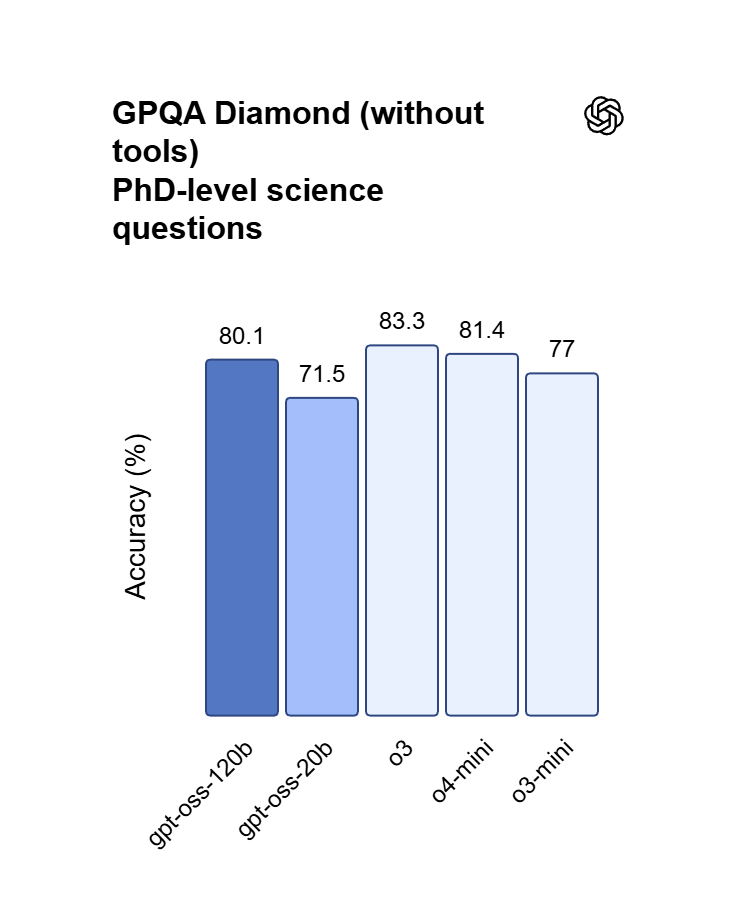

OpenAI’s premier GPT model family leads the industry, highlighted by the GPT OSS 120B which achieves near-parity with OpenAI o4-mini on core reasoning benchmarks while running efficiently on a single 80GB GPU. Perfectly optimized for vibecoding and complex logic operations, this model balances top-tier intelligence with hardware accessibility for modern developers and AI-driven web development.

Modeller Yakında Geliyor

Bu koleksiyona son rötuşları yapıyoruz — bu arada aşağıdaki benzer koleksiyonları keşfedin.

Daha Fazla Aile Keşfedin

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.

OpenAI LLM Models'i Öne Çıkaran Nedir

Atlas Cloud size sektörün en yeni öncü yaratıcı modellerini sunar.

Frontier Research

Cutting-edge models that set global benchmarks in reasoning, multimodality, and AI safety.

Cost-Efficient Performance

Optimized families like GPT-4.1 mini and GPT-5 nano balance accuracy, speed, and cost.

Developer Ecosystem

APIs powering millions of daily requests across diverse platforms and industries.

Flexible Model Sizes

Choice of flagship, mini, and nano models for every workload and budget.

Enterprise Reliability

SLAs, monitoring, and compliance-ready logging trusted by Fortune 500 companies.

Open Model Options

Access to open-source models (gpt-oss-20b, gpt-oss-120b) for transparency and customization.

Tepe hızı

En düşük maliyet

| Model | Açıklama |

|---|---|

| GPT OSS 120B | GPT OSS 120B, optimize edilmiş mimariyi güçlü 131.07K bağlam işleme yetenekleriyle birleştiren, yüksek performanslı ve muhakeme odaklı bir LLM'dir; tek bir 80 GB GPU üzerinde OpenAI o4-mini ile neredeyse eşit seviyeye ulaşarak, vibecoding ve karmaşık mantık güdümlü iş akışlarının yürütülmesi de dahil olmak üzere hızlı yinelemeli geliştirme için bir motor görevi görür. |

OpenAI LLM Models Yeni Özellikleri + Vitrin

Gelişmiş modelleri Atlas Cloud'un GPU hızlandırmalı platformuyla birleştirmek, görüntü ve video üretimi için benzersiz hız, ölçeklenebilirlik ve yaratıcı kontrol sunar.

GPT OSS 120B ile Hassas Talimat Uyumu

GPT OSS 120B, mutlak çıktı güvenilirliğini sağlamak için karmaşık sistem istemlerine (prompts) sıkı sıkıya bağlı kalarak olağanüstü yönlendirilebilirlik sergiler. İnce ayarlı hizalama mimarisinden yararlanarak, kullanıcılar belirli formatları, kısıtlamaları ve üslup nüanslarını sıfır karakter kaymasıyla (zero character drift) uygulayabilirler. Otonom ajanlar, yapılandırılmış veri çıkarımı ve görev açısından kritik üretim ortamları için kesin tercihtir.

Apache 2.0 Lisansı Altında Ticari Egemenlik

GPT OSS 120B, token başına ücret olmaksızın sınırsız ticari kullanıma ve özel ince ayarlara (fine-tuning) izin veren Apache 2.0 lisansı altında dağıtılmaktadır. Kapalı kaynak API'lerin aksine, hassas tescilli verileri tamamen şirket içinde (on-premises) tutmak için tek bir 80 GB GPU üzerinde yerel barındırmaya olanak tanır. Bu çerçeve, yapay zeka destekli yazılım yığınları oluşturmak, değiştirmek ve ölçeklendirmek için yasal ve teknik özgürlük sağlar.

GPT OSS 120B ile Yüksek Verimli Mantık ve Vibecoding

OpenAI o4-mini ile neredeyse eşit seviyeye ulaşan bu 120B parametreli model, karmaşık kod sentezi ve matematiksel ispatları işleme konusunda üstün başarı gösterir. Geliştiriciler, yinelemeli istemleme (prompting) yoluyla doğal dil fikirlerini doğrudan işlevsel web uygulamalarına dönüştüren "vibe coding" için bu modelin akıl yürütme motorundan yararlanabilirler. Bu, iç içe geçmiş mantığı hata ayıklamak ve gelişmiş görev zamanlama iş akışlarını düzenlemek için yüksek hızlı bir çözümdür.

OpenAI LLM Models ile Neler Yapabilirsiniz

Bu model ailesiyle oluşturabileceğiniz pratik kullanım senaryolarını ve iş akışlarını keşfedin — içerik oluşturma ve otomasyondan üretim düzeyinde uygulamalara kadar.

GPT OSS 120B ile Derin Mantık Hata Ayıklama ve Prototipleme

GPT OSS 120B, üst düzey mimari fikirleri üretime hazır Python veya React bileşenlerine dönüştürerek mühendislerin "vibecoding" zorluklarını çözmelerini sağlar. Muhakeme motoru, genellikle mini modelleri yanıltan iç içe geçmiş bağımlılıkları ve uç durumları ele alarak çok adımlı kod sentezinin işlevsel kalmasını sağlar. Algoritmik kanıtları ve karmaşık görev zamanlamasını destekleyen bu araç; teknik MVP'ler, otomatik QA komut dosyaları ve veri yoğunluklu web uygulamaları oluşturmak için mükemmeldir.

GPT OSS 120B Kullanan Çevrimdışı Tescilli Araçlar

Apache 2.0 lisansı altında ekipler, hassas dahili verileri bulut sızıntısı riski olmadan işlemek için GPT OSS 120B'yi tek bir 80 GB GPU üzerinde barındırabilirler. Bu kurulum, token başına yinelenen API maliyetleri olmaksızın, niş dahili kod tabanları veya tıbbi kayıtlar üzerinde kalıcı yerel ince ayar (fine-tuning) yapılmasına olanak tanır. Yüksek güvenlikli dahili araçlar ve çevrimdışı yapay zeka desteği için ideal olan model, özel RAG sistemlerini ve özelleştirilmiş tescilli yazılım yığınlarını destekleyerek tam ağırlık egemenliği sağlar.

GPT OSS 120B ile Şema Uyumlu Mükemmel Veri Çıkarma

GPT OSS 120B, geliştiricilerin dağınık, yapılandırılmamış belgeleri "talimat kayması" olmadan kesin biçimlendirilmiş JSON veya Markdown'a dönüştürmesini sağlar. 131.07K bağlam penceresini katı sistem kurallarıyla sabitleyerek model, uzun süreli işleme sırasında alanların asla halüsinasyon görmemesini veya atlanmamasını sağlar. CRM otomasyonu ve otomatik içerik etiketleme için ideal olan bu model, devasa veri kümelerinde mantıksal korkulukları koruyarak güvenilir API entegrasyonlarını ve veritabanı doldurma işlemlerini destekler.

Model Karşılaştırma

Farklı sağlayıcıların modellerinin nasıl karşılaştırıldığını görün — performans, fiyatlandırma ve benzersiz güçlü yönleri karşılaştırarak bilinçli bir karar verin.

| Model | Bağlam | Maksimum Çıktı | Girdi | Konumlandırma |

|---|---|---|---|---|

| GPT OSS 120B | 131.07K | 131.07K | Metin | Yüksek Verimli Muhakeme LLM |

| GLM-5 | 202.75K | 202.75K | Metin | Amiral gemisi temel model |

| DeepSeek V3.2 | 163.84K | 163.84K | Metin | Genel Amiral Gemisi |

| MiniMax-M2.5 | 204.8K | 196.6K | Metin | SOTA Ajan Tabanlı Kodlama |

How to Use OpenAI LLM Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

Atlas Cloud'da OpenAI LLM Models'i Neden Kullanmalı

OpenAI LLM Models'in gelişmiş modellerinin Atlas Cloud'un GPU hızlandırmalı platformuyla birleşimi, benzersiz performans, ölçeklenebilirlik ve geliştirici deneyimi sunar.

Performans ve Esneklik

Düşük Gecikme:

Gerçek zamanlı akıl yürütme için GPU optimize çıkarım.

Birleşik API:

OpenAI LLM Models, GPT, Gemini ve DeepSeek'i tek entegrasyonla çalıştırın.

Şeffaf Fiyatlandırma:

Sunucusuz seçeneklerle öngörülebilir token tabanlı faturalandırma.

Kurumsal ve Ölçekleme

Geliştirici Deneyimi:

SDK'lar, analitik, ince ayar araçları ve şablonlar.

Güvenilirlik:

%99,99 kullanılabilirlik, RBAC ve uyumluluk için hazır günlükleme.

Güvenlik ve Uyumluluk:

SOC 2 Type II, HIPAA uyumluluğu, ABD'de veri egemenliği.

Sıkça Sorulan Sorular - OpenAI LLM Models

Temel akıl yürütme ve matematik kıyaslamalarında OpenAI o4-mini ile neredeyse eşitlik sağlar. o4-mini kapalı bir API iken, OSS 120B tam model ağırlığı erişimi avantajıyla karşılaştırılabilir mantık derinliği sunar.

Model, tek bir 80 GB GPU için optimize edilmiştir ve çoklu düğüm karmaşıklığını ortadan kaldırır. Ancak, anında ölçeklenebilirlik ve sıfır bakım için Atlas Cloud üzerindeki API aracılığıyla erişmenizi öneririz.

Evet. Token başına lisans ücreti veya satıcı kilidi (vendor lock-in) olmaksızın sınırsız ticari kullanım, değişiklik ve dağıtıma izin veren Apache 2.0 lisansı altında yayınlanmıştır.

131.07K bağlam penceresi, "samanlıkta iğne arama" hassasiyetinde geri getirme doğruluğu için tasarlanmıştır. Tüm proje dizinlerini veya 100'den fazla sayfalık teknik kılavuzları işleyebilir ve tüm girdi boyunca mantıksal tutarlılığı koruyabilir.

Kesinlikle. Muhakeme motoru, yinelemeli kod sentezi için ince ayarlanmıştır. İç içe geçmiş React bileşenlerini ve karmaşık Python arka uçlarını standart 70B sınıfı modellerden daha güvenilir bir şekilde işler, bu da onu doğal dilden uygulamaya iş akışları için ideal kılar.