DeepSeek LLM Models

DeepSeek, developed by the deepseek-ai team, is a cutting-edge series of open-source generative AI models engineered to democratize access to high-performance computing through a cost-effective and efficiency-first strategy. Its flagship reasoning model, DeepSeek-R1, made waves by rivaling top-tier proprietary models in mathematics, programming, and complex logical deduction, while the DeepSeek-V3.2, is designed for seamless daily interaction and autonomous Agent workflows. By significantly lowering the barrier to entry for advanced AI, DeepSeek has become a cornerstone for the "vibe coding" movement and a transformative tool in specialized fields like academic research and high-level technical problem-solving.

Khám phá Mô hình Hàng đầu

Atlas Cloud cung cấp cho bạn các mô hình sáng tạo tiên tiến nhất trong ngành.

Điều Gì Làm Nên DeepSeek LLM Models

Atlas Cloud cung cấp cho bạn các mô hình sáng tạo hàng đầu trong ngành công nghiệp mới nhất.

Sức mạnh Mở

Các mô hình hàng đầu hoàn toàn mã nguồn mở, đảm bảo tính minh bạch và quyền kiểm soát.

Hiệu quả kiến trúc

Tận dụng công nghệ Mixture-of-Experts (MoE) tiên tiến để mang lại hiệu suất hàng đầu với chi phí chỉ bằng một phần nhỏ.

Tính đa năng được thiết kế chuyên biệt

Từ V3.1 đa năng đến khả năng suy luận chuyên sâu của R1, DeepSeek cung cấp các mô hình cho mọi tác vụ.

Sự tự do ưu tiên nhà phát triển

Được cấp phép mở cho mục đích thương mại không hạn chế, thúc đẩy đổi mới không rào cản.

Hiệu suất đã được kiểm chứng

Liên tục đạt được kết quả tiên tiến nhất trên các tiêu chuẩn ngành về lập trình và tư duy logic.

Giải pháp thay thế thiết thực

Mang lại sức mạnh của các mô hình độc quyền hàng đầu với chi phí phải chăng và tính linh hoạt của mã nguồn mở.

Peak speed

Lowest cost

| Phương thức | Mô tả |

|---|---|

| DeepSeek V3.2 | DeepSeek V3.2 là một LLM đa năng hàng đầu, tích hợp cơ chế sự chú ý thưa thớt (sparse attention) với khả năng xử lý ngữ cảnh 163.8K mạnh mẽ; với mức giá cơ bản cạnh tranh cao, nó đóng vai trò là nền tảng cho quy trình làm việc hàng ngày, bao gồm suy luận tổng quát phức tạp và xây dựng các Agents lập lịch tác vụ đa bước. |

| DeepSeek V3.2 Speciale | DeepSeek V3.2 Speciale được định vị là một LLM tùy chỉnh hiệu suất cao, có cửa sổ ngữ cảnh khổng lồ 163,8K và cấu trúc giá theo cấp cao cấp ($0,4 đầu vào / $1,2 đầu ra), được thiết kế đặc biệt cho các nút kinh doanh cốt lõi nhạy cảm với độ trễ đòi hỏi chất lượng đầu ra tối ưu, chẳng hạn như dịch vụ khách hàng thông minh cho khách hàng có giá trị ròng cao hoặc phân tích định lượng cấp độ mili giây. |

| DeepSeek V3.2 Exp | DeepSeek V3.2 Exp là phiên bản thử nghiệm tiên tiến dựa trên kiến trúc V3.2, tích hợp các tính năng thuật toán mới nhất trong khi vẫn duy trì ngữ cảnh 163.8K và chi phí tương đương, khiến nó trở nên lý tưởng cho các đội ngũ R&D tiến hành nghiên cứu kỹ thuật tiền khả thi và thử nghiệm canary để xác thực trước sức mạnh khác biệt của các khả năng AI thế hệ tiếp theo cho các sản phẩm trong tương lai. |

| DeepSeek-V3.1 | DeepSeek-V3.1 là thế hệ mới nhất của các mô hình hệ sinh thái mã nguồn mở hiệu suất cao, đạt được sự cân bằng mới giữa hiệu suất và chi phí trong ngữ cảnh 131.1K; là lựa chọn hàng đầu cho các dự án triển khai thương mại, nó đóng vai trò là xương sống cho các kịch bản đòi hỏi cả khả năng tạo nội dung chất lượng cao và chi phí có thể kiểm soát. |

| DeepSeek V3.1 Terminus | DeepSeek V3.1 Terminus đóng vai trò là hình thái tối thượng, ổn định lâu dài của dòng V3.1. DeepSeek V3.1 Terminus duy trì các tham số và mức giá giống hệt phiên bản tiêu chuẩn, nhằm mục đích cung cấp phong cách đầu ra và logic ổn định vĩnh viễn cho các dịch vụ điểm cuối (endpoint) trong môi trường sản xuất hướng tới người tiêu dùng một cách liền mạch. |

| DeepSeek-V3-0324 | DeepSeek-V3-0324 là một phiên bản chụp nhanh lịch sử cụ thể với ngữ cảnh 131,1K và chi phí nhập văn bản thấp nhất hiện có, chủ yếu được áp dụng trong bảo trì hệ thống cũ đòi hỏi sự nhất quán tuyệt đối về hành vi, hoặc các tác vụ xử lý hàng loạt với lưu lượng đầu vào lớn nhưng yêu cầu logic đầu ra ở mức trung bình. |

| DeepSeek-R1-0528 | DeepSeek-R1-0528 được định vị là mô hình suy luận sâu hàng đầu, sử dụng ngữ cảnh 131.1K và có chi phí tính toán cao nhất ($0.55/$2.15), đại diện cho đỉnh cao của khả năng biện chứng logic, được sử dụng riêng cho các tác vụ "động não" quan trọng như mô hình hóa toán học phức tạp và tạo kiến trúc mã nâng cao. |

| DeepSeek OCR | DeepSeek OCR là một LLM đa phương thức trực quan chuyên dụng hỗ trợ đầu vào hình ảnh-văn bản theo dõi kép với ngữ cảnh ngắn 8.2K và chi phí sử dụng cực thấp, thích ứng hoàn hảo cho các kịch bản quy trình nhập dữ liệu tự động như số hóa các tài liệu quét khổng lồ và trích xuất có cấu trúc các biên lai tài chính. |

Tính năng mới của DeepSeek LLM Models + Showcase

Kết hợp các mô hình tiên tiến với nền tảng tăng tốc GPU của Atlas Cloud mang lại tốc độ, khả năng mở rộng và kiểm soát sáng tạo vượt trội cho việc tạo hình ảnh và video.

Suy luận và Xác minh Đẳng cấp Thế giới thông qua DeepSeek-V3.2-Speciale API

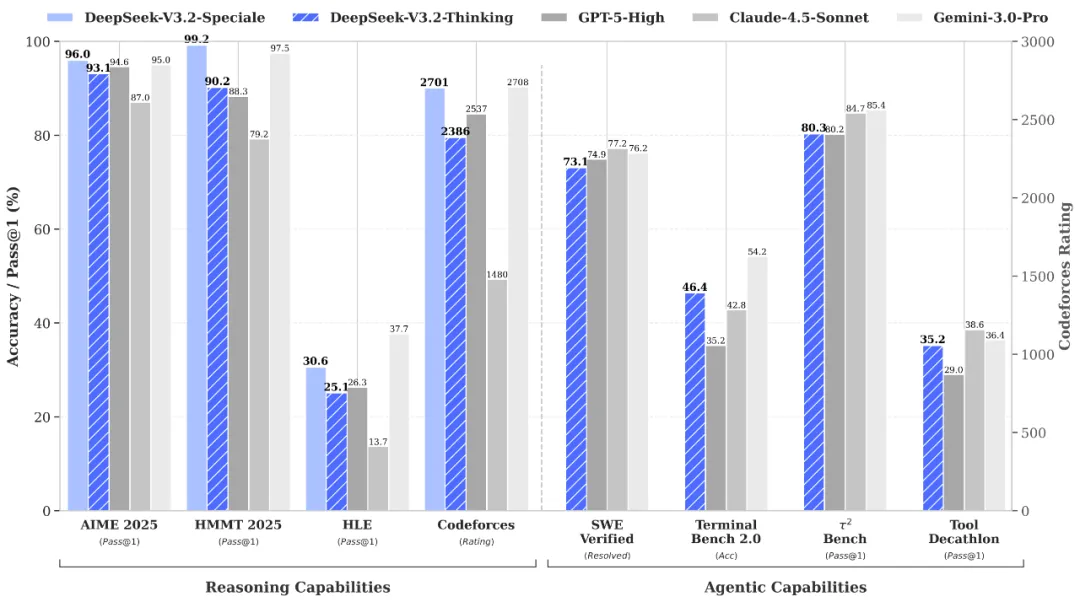

DeepSeek-V3.2-Speciale is the "long-thought" enhanced variant of the V3.2 architecture, integrating advanced theorem-proving capabilities from DeepSeek-Math-V2. Engineered for extreme precision, this model excels in rigorous mathematical proofing, complex logical verification, and superior instruction following, rivaling the performance of Gemini-3.0-Pro in mainstream reasoning benchmarks. It is the premier choice for academic research, automated formal verification, and high-stakes technical problem-solving where logical integrity is non-negotiable.

Chiều sâu nhận thức vô song thông qua DeepSeek-R1 API

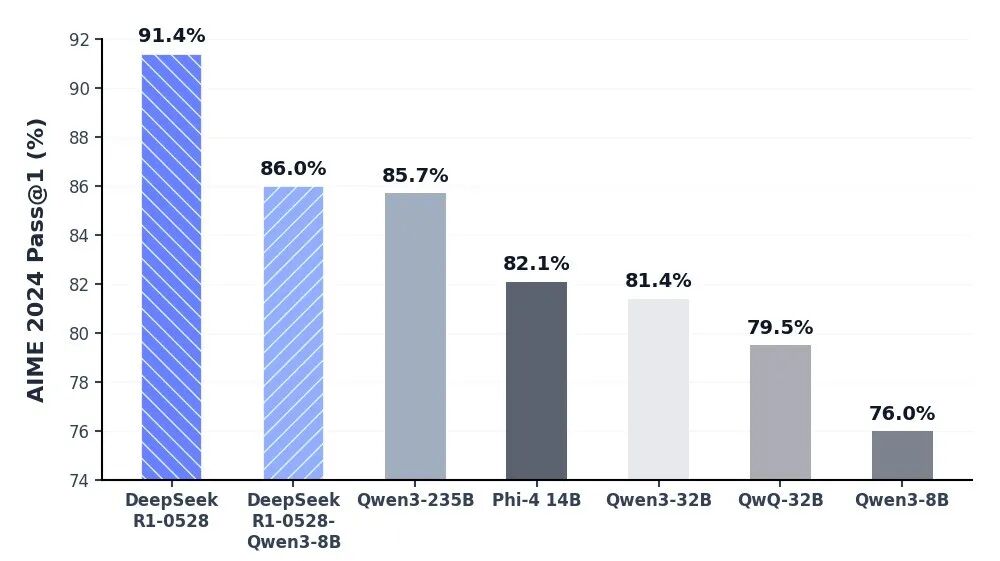

Mô hình DeepSeek-R1 đứng đầu trong lĩnh vực AI lập luận, mang lại hiệu suất dẫn đầu ngành trong toán học, lập trình và logic tổng quát. Bằng cách đạt được sự ngang bằng với các mô hình ưu tú toàn cầu như o3 của OpenAI và Gemini-2.5-Pro, R1 đã định nghĩa lại khả năng của trí tuệ mã nguồn mở. Nó được tối ưu hóa đặc biệt cho các tác vụ tư duy sâu, bao gồm phát triển thuật toán phức tạp, tổng hợp dữ liệu tinh vi và các quy trình nhận thức nâng cao đòi hỏi suy luận diễn dịch đa giai đoạn.

Tương tác hàng ngày liền mạch với quy trình làm việc của tác nhân tự động sử dụng DeepSeek V3.2 API

DeepSeek-V3.2 đạt được sự cân bằng hoàn hảo giữa chiều sâu suy luận và tốc độ thực thi, được thiết kế để hỗ trợ các tương tác hàng ngày liền mạch và hệ sinh thái tác nhân (Agent) tự chủ. Với độ trễ giảm đáng kể và khả năng kiểm soát đầu ra được tối ưu hóa, nó đóng vai trò là một động cơ mạnh mẽ cho việc điều phối tác vụ nhiều bước và các trợ lý AI đa năng. Dù triển khai tự động hóa quy mô doanh nghiệp hay các công cụ tương tác tần suất cao, V3.2 đều đảm bảo trải nghiệm người dùng mượt mà, hiệu quả và tối ưu chi phí.

Khám phá khoa học chặt chẽ và Kiểm chứng hình thức với DeepSeek-V3.2-Speciale API

The DeepSeek-V3.2-Speciale API is engineered for tasks that demand absolute logical precision and multi-step reasoning. By integrating advanced theorem-proving capabilities, it enables researchers and engineers to execute complex mathematical inductions, verify formal logic, and solve high-tier competitive programming challenges. Perfect for academic R&D, automated code auditing, and cryptographic analysis, this API transforms abstract complexity into verifiable results with the performance of top-tier global models.

Advanced Algorithmic Synthesis & Strategic Reasoning using the DeepSeek-R1 API

DeepSeek-R1 empowers developers to build applications centered on deep cognitive workflows and strategic decision-making. Ranking at the forefront of global reasoning benchmarks, the R1 API excels in synthesizing sophisticated code architectures, processing dense technical documentation, and generating innovative solutions for open-ended logical puzzles. It is the ideal engine for AI-driven software engineering, long-form data synthesis, and any scenario where "thinking fast and slow" requires a powerful, reasoning-first foundation.

Điều phối tác nhân tự chủ liền mạch với DeepSeek-V3.2 API

For high-velocity, sensory-driven AI applications, the DeepSeek-V3.2 API provides the perfect equilibrium between reasoning depth and ultra-low latency. It is optimized for building autonomous Agents that can navigate multi-step workflows, manage real-time user interactions, and execute general-purpose tasks with GPT-5 level intelligence. This use case is tailor-made for enterprise-scale automation, intelligent customer ecosystems, and developers looking to deploy responsive, cost-effective AI assistants at scale.

So Sánh Mô Hình

Xem các mô hình từ các nhà cung cấp khác nhau so sánh như thế nào — so sánh hiệu suất, giá cả và điểm mạnh độc đáo để đưa ra quyết định sáng suốt.

| Mô hình | Ngữ cảnh | Đầu ra tối đa | Đầu vào | Định vị |

|---|---|---|---|---|

| DeepSeek V3.2 | 163.84K | 163.84K | Text | Tổng quát Hàng đầu |

| DeepSeek V3.2 Speciale | 163.84K | 163.84K | Text | Tùy chỉnh hiệu suất cao |

| DeepSeek V3.2 Exp | 163.84K | 163.84K | Text | Bản dựng thử nghiệm |

| DeepSeek-V3.1 | 131.07K | 65.54K | Text | Backbone mã nguồn mở |

| DeepSeek V3.1 Terminus | 131.07K | 65.54K | Text | Ổn định dài hạn (LTS) |

| DeepSeek-V3-0324 | 131.07K | 32.77K | Text | Bản chụp lịch sử |

| DeepSeek-R1-0528 | 131.07K | 131.07K | Text | Khả năng suy luận hàng đầu |

| DeepSeek OCR | 8.19K | 8.19K | Text | Đa phương thức chuyên dụng |

| GLM-5 | 200K | 128K | Text | Mô hình nền tảng chủ lực |

| MiniMax-M2.5 | 204.8K | 196.6K | Text | Lập trình tác nhân SOTA |

How to Use DeepSeek LLM Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

Tại sao Sử dụng DeepSeek LLM Models trên Atlas Cloud

Sự kết hợp của các mô hình tiên tiến của DeepSeek LLM Models với nền tảng được tăng tốc GPU của Atlas Cloud mang lại hiệu suất, khả năng mở rộng và trải nghiệm nhà phát triển độc đáo.

Hiệu suất và Tính linh hoạt

Độ Trễ Thấp:

Suy luận được tối ưu hóa GPU cho suy luận thời gian thực.

API Thống nhất:

Chạy DeepSeek LLM Models, GPT, Gemini và DeepSeek với một tích hợp duy nhất.

Giá cả Minh bạch:

Thanh toán dựa trên token có thể dự đoán với tùy chọn serverless.

Doanh nghiệp và Mở rộng

Trải nghiệm Nhà phát triển:

SDK, phân tích, công cụ tinh chỉnh và mẫu.

Độ tin cậy:

99,99% khả dụng, RBAC và ghi nhật ký sẵn sàng cho tuân thủ.

Bảo mật và Tuân thủ:

SOC 2 Type II, tuân thủ HIPAA, chủ quyền dữ liệu tại Hoa Kỳ.

Câu Hỏi Thường Gặp về DeepSeek LLM Models

DeepSeek mang lại sự minh bạch của mã nguồn mở và hiệu quả chi phí vượt trội. Với khả năng suy luận (R1 & V3.2) sánh ngang với GPT-5, nó cung cấp một giải pháp thay thế hiệu suất cao, chi phí thấp hơn cùng sự linh hoạt của việc triển khai riêng tư.

Điều này phản ánh tổng "dung lượng não bộ" của mô hình. Thiết kế MoE của DeepSeek kết hợp tổng số lượng tham số khổng lồ (ví dụ: 671B) cho trí thông minh sâu rộng với số lượng tham số "hoạt động" được tinh giản để đạt hiệu quả vận hành tối đa.

Khám phá Thêm Dòng

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.