Flux.2 Image Models

Developed by Black Forest Labs, FLUX.2 is a powerhouse 32-billion parameter rectified flow Transformer model that redefines creative workflows by unifying AI image generation, editing, and composition. It transforms complex text prompts into high-fidelity visuals while offering integrated tools for professional-grade editing at resolutions up to 2K, providing a streamlined, all-in-one solution for digital artists and designers seeking unmatched precision and scalability in their visual content creation.

استكشف النماذج الرائدة

يوفر لك Atlas Cloud أحدث النماذج الإبداعية الرائدة في الصناعة.

ما الذي يميز Flux.2 Image Models

توفر لك Atlas Cloud أحدث النماذج الإبداعية الرائدة في الصناعة.

Photorealistic Quality

Generates crisp, high-resolution images with accurate lighting, textures, and detail for production use.

Fast, Lightweight Inference

Optimized architecture delivers rapid image generation on modest GPUs and edge hardware.

Fine-Grained Control

Supports styles, presets, and prompt controls so designers can quickly dial in the exact look they want.

Seamless Workflow Integration

Simple APIs and plugins connect Nano Banana to design tools, apps, and pipelines with minimal setup.

Cost-Efficient Creativity

Efficient diffusion kernels and smart caching keep generation costs low, so teams can experiment freely at scale.

Flexible Deployment Options

Flexible Deployment Options Run in the cloud, on-prem, or in VPC environments.

السرعة القصوى

التكلفة الأقل

| الوسيط | الوصف |

|---|---|

| Flux.2 Dev API(Text To Image, Image To Image) | تمنح واجهة برمجة تطبيقات Flux.2 Dev API الوصول إلى أقوى نموذج مفتوح الأوزان (open-weights) في العالم بمعايير تبلغ 32 مليار، والمصمم لتوليد صور معقدة من النصوص وتحرير الصور بمدخلات متعددة. من خلال استخدام نقطة تفتيش (checkpoint) موحدة لكل من الإنشاء والتعديل، فإنها تعمل على تبسيط سير العمل الإبداعي الاحترافي وتوفر أساسًا لا مثيل له لبناء تطبيقات ذكاء اصطناعي بصري متقدمة وقابلة للتخصيص بموجب ترخيص تجاري. |

| Flux.2 Pro API(Text To Image, Image To Image) | توفر واجهة برمجة تطبيقات Flux.2 Pro (API) جودة صور رائدة في الصناعة والتزاماً دقيقاً بالتعليمات النصية (prompts) يضاهي أفضل النماذج مغلقة المصدر، مع تقليل زمن الانتقال والتكاليف التشغيلية بشكل كبير. إنها تقدم حلاً عالي الأداء للتطبيقات على مستوى المؤسسات التي تتطلب دقة بصرية فائقة دون تكلفة باهظة. |

| Flux.2 Flex API(Text To Image, Image To Image) | تمنح Flux.2 Flex API المطورين تحكمًا دقيقًا في معلمات التوليد، بما في ذلك مقاييس التوجيه وخطوات الاستدلال، لضبط التوازن بدقة بين السرعة والامتثال للمطالبة النصية (prompt fidelity). تم تحسينها خصيصًا للتفاصيل المعقدة والعرض الدقيق للطباعة، وهي بمثابة مجموعة أدوات متعددة الاستخدامات للمبدعين الذين يطلبون تحكمًا عالي الدقة في التراكيب المرئية المعقدة والعناصر النصية. |

| Flux.2 Klein API(Text To Image, Image To Image) | تقدم واجهة برمجة التطبيقات Flux.2 Klein API حلاً خفيف الوزن ولكنه قوي من خلال تقنيات تقطير الحجم المتقدمة، وتم إصدارها بموجب ترخيص Apache 2.0 الصديق للمطورين. وهي تتفوق في الأداء على النماذج ذات الحجم المماثل التي تم تدريبها من الصفر، مما يوفر مساراً فعالاً وميسراً لتوليد صور عالية الجودة في البيئات محدودة الموارد. |

ميزات جديدة لـ Flux.2 Image Models + عرض

يوفر الجمع بين النماذج المتقدمة ومنصة Atlas Cloud المسرّعة بوحدات GPU سرعة وقابلية توسع وتحكمًا إبداعيًا لا مثيل لهما في إنشاء الصور والفيديو.

دقة نسيج محسنة وإضاءة واقعية باستخدام واجهة برمجة تطبيقات FLUX.2

يستفيد نموذج FLUX.2 من بنيته التي تضم 32 مليار معلمة لتقديم أنسجة أكثر دقة وإضاءة مستقرة عبر جميع المخرجات المرئية. من خلال تحسين تفاعل الضوء والمادة في الفضاء الكامن (latent space)، يمكن للمستخدمين تحقيق نتائج واقعية للغاية لتصور المنتجات الراقية والتصوير الفوتوغرافي الاحترافي. إنه الحل الأمثل للتقديم فائق الواقعية، واتساق المواد، والأصول الرقمية بجودة الاستوديو.

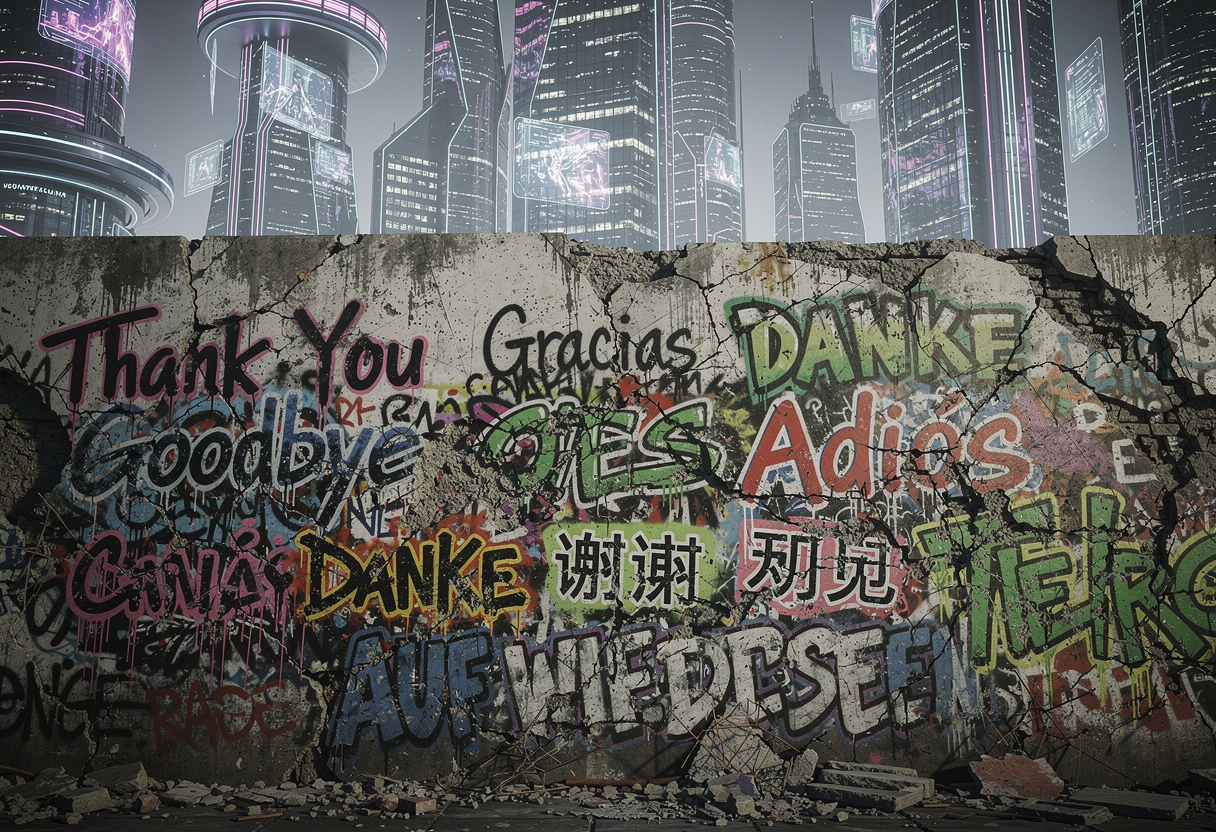

طباعة متقدمة وتصيير رسومي باستخدام FLUX.2 API

يدعم FLUX.2 التخطيطات الطباعية المعقدة ومحاكاة واجهة المستخدم الدقيقة، مما يضمن بقاء حتى النصوص الدقيقة مقروءة وواضحة. من خلال دمج ترميز متطور على مستوى الأحرف، يمكن للمستخدمين تقديم الرسوم البيانية (Infographics) والميمات والمحتوى ذي العلامة التجارية بدقة دون أي تشويه للأحرف. إنه الحل الأمثل للتصميم الجرافيكي الاحترافي، والنماذج الأولية للواجهات، والتركيبات الإبداعية كثيفة النصوص.

فهم الأوامر الهيكلية والتحكم التركيبي باستخدام FLUX.2 API

يوفر محرك FLUX.2 منطقاً فائقاً لتفسير المطالبات (prompts) متعددة الفقرات والقيود المكانية المعقدة بدقة عالية. من خلال فك تشفير التوجيهات العلائقية الدقيقة، يمكن للمستخدمين تنسيق المشاهد متعددة العناصر بدقة والحفاظ على الالتزام الصارم بقصد التكوين. إنه الحل الأمثل لسرد القصص المتطور، والفن الرقمي الطبقي، والسرديات البصرية القائمة على الدقة.

تحسين منطق العالم والوعي المكاني باستخدام FLUX.2 API

يدمج FLUX.2 معرفة واسعة بالعالم لفهم العلاقات الفيزيائية بين الضوء والمكان وسلوك الأشياء بعمق. من خلال تأسيس كل عملية توليد على منطق بيئي واقعي، يمكن للمستخدمين ضمان أن تتصرف المشاهد المعقدة تمامًا كما هو متوقع في العالم المادي. إنه الحل الأمثل للتصور المعماري، وبناء عوالم غامرة، وتوليف المشاهد المتسق منطقيًا.

ما يمكنك فعله مع Flux.2 Image Models

اكتشف حالات الاستخدام العملية وسير العمل التي يمكنك بناؤها مع عائلة النماذج هذه — من إنشاء المحتوى والأتمتة إلى التطبيقات على مستوى الإنتاج.

تصيير واقعي عالي الدقة باستخدام واجهة برمجة تطبيقات FLUX.2

يمكّن نموذج FLUX.2 المبدعين والمطورين من بناء محتوى مرئي فائق الواقعية يحافظ على القوام النابض بالحياة، والإضاءة المستقرة، والدقة الفيزيائية. تُعد بنية المعلمات البالغ عددها 32 مليارًا مثالية لتصوير المنتجات الاحترافي والتصور المعماري، حيث تضمن انعكاسات سطحية متسقة وعمقًا في المواد—مما يدعم أصول التسويق الراقية، ونماذج العلامات التجارية الفاخرة، والتصوير الرقمي بمستوى الاستوديو.

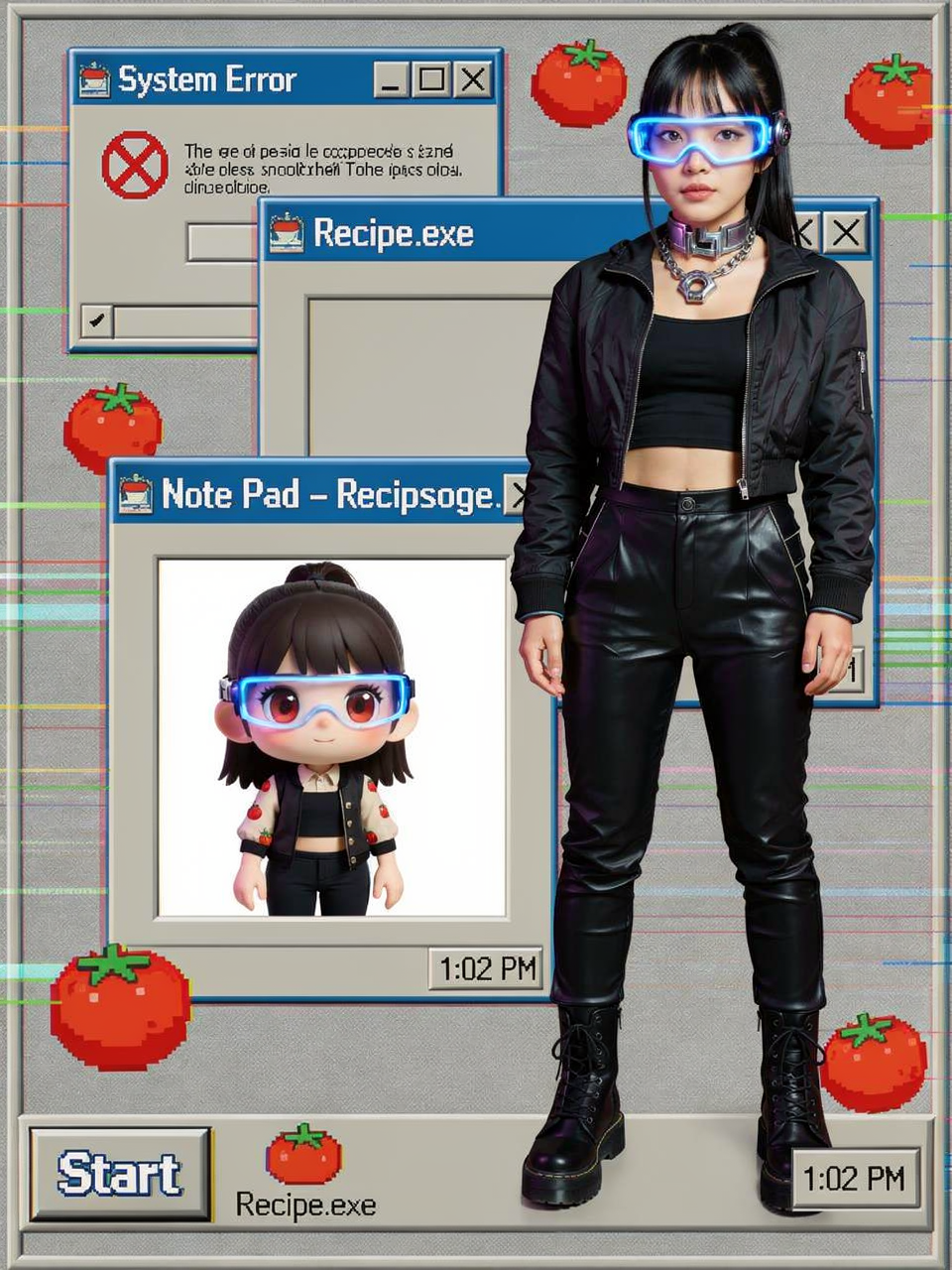

تصميم طباعي وتخطيط دقيق باستخدام FLUX.2 API

For information-dense graphics, FLUX.2 renders complex typography, UI simulations, and intricate layouts with absolute clarity and zero character distortion. This use case fits graphic designers, branding experts, and social media creators requiring precise text integration in posters, infographics, and interface prototypes—ensuring even micro-fonts remain legible and perfectly aligned, powered by advanced Transformer-based semantic understanding.

تكوين مشهد منطقي وتحرير بدقة عالية 4 ميجابكسل

يقدم FLUX.2 تفسيرًا لا مثيل له للمطالبات (prompts) الهيكلية ومتعددة الأجزاء، مما يسمح بإنشاء مشاهد متطورة متعددة الموضوعات وترتيبات مكانية معقدة. بفضل دعم التحرير عالي الدقة الذي يصل إلى 4 ملايين بكسل، تسهل واجهة برمجة التطبيقات (API) التحويلات السلسة من صورة إلى صورة والتعديلات المحلية الدقيقة، مما يوفر حلاً شاملاً وفعالاً للفنانين الرقميين المحترفين وأصحاب الرؤى الذين يطلبون التناسق المنطقي في المشاريع الإبداعية واسعة النطاق.

مقارنة النماذج

شاهد كيف تتقارن نماذج مختلف المزودين — قارن الأداء والأسعار ونقاط القوة الفريدة لاتخاذ قرار مدروس.

| نموذج | حد الصور المرجعية | عدد المخرجات | الدقة | نموذج |

|---|---|---|---|---|

| Flux.2 | 10 | 1 | 2K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Flux.1 | 1 | 1 | 256P~4K | Width[256, 4096]px; Height[256, 4096]px |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

How to Use Flux.2 Image Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

لماذا تستخدم Flux.2 Image Models على Atlas Cloud

دمج نماذج Flux.2 Image Models المتقدمة مع منصة Atlas Cloud المسرّعة بـ GPU يوفر أداءً لا مثيل له وقابلية للتوسع وتجربة مطور استثنائية.

الأداء والمرونة

زمن انتقال منخفض:

استدلال محسّن لـ GPU للاستجابة في الوقت الفعلي.

API موحد:

قم بتشغيل Flux.2 Image Models و GPT و Gemini و DeepSeek من خلال تكامل واحد.

تسعير شفاف:

فواتير يمكن التنبؤ بها لكل رمز مع خيارات بدون خادم.

المؤسسات والتوسع

تجربة المطور:

SDKs والتحليلات وأدوات الضبط الدقيق والقوالب.

الموثوقية:

وقت تشغيل 99.99%، RBAC، وتسجيل جاهز للامتثال.

الأمان والامتثال:

SOC 2 Type II، توافق HIPAA، سيادة البيانات في الولايات المتحدة.

الأسئلة الشائعة حول Flux.2 Image Models

يوحّد هذا النموذج بين توليد الصور والتحرير المحلي وتكوين الصور المتعددة. يُعد FLUX.2 أسرع بنسبة 30%-50% من سابقه ويدعم بشكل أصلي إخراجاً عالي الدقة بدقة 4 ميجابكسل، محققاً تميزاً واقعياً في المنطق الفيزيائي والإضاءة والملمس.

يعرض FLUX.2 نصوصًا واضحة ودقيقة حتى في المشاهد المعقدة، ويدعم الفقرات الطويلة والخطوط متناهية الصغر. من خلال دمج نموذج الرؤية واللغة Mistral-3 24B، فإنه يتفوق في الرسوم البيانية (Infographics)، ونماذج واجهة المستخدم (UI mockups)، وأصول العلامة التجارية كثيفة النصوص.

تم تطوير FLUX.2 بواسطة Black Forest Labs (BFL)، التي أسسها المبتكرون الأصليون لنموذج Stable Diffusion (SDXL). كان الفريق رائداً في تقنية Latent Diffusion ويعيد الآن تعريف الذكاء البصري من خلال بنية Rectified Flow المكونة من 32 مليار معلمة.

استكشف المزيد من العائلات

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.