Was ist GLM-5.1? Das autonome Programmiermodell von Zhipu AI

Das GLM 5.1-Modell kommt bald in die Atlas Cloud!

- Was ist GLM-5.1: GLM 5.1 ist das fortschrittlichste Open-Source-Modell von Zhipu AI und verfügt über die stärksten Programmierfähigkeiten unter den offenen Modellen, die mit Opus 4.6 konkurrieren!

- Hauptmerkmale: GLM 5.1 bietet erstklassige Programmierfähigkeiten. Es automatisiert Aufgaben für bis zu acht Stunden und sorgt mit adaptiver Problemlösung für reibungslose Arbeitsabläufe und voll funktionsfähige Ergebnisse.

- Startzeit: Diesen Monat.

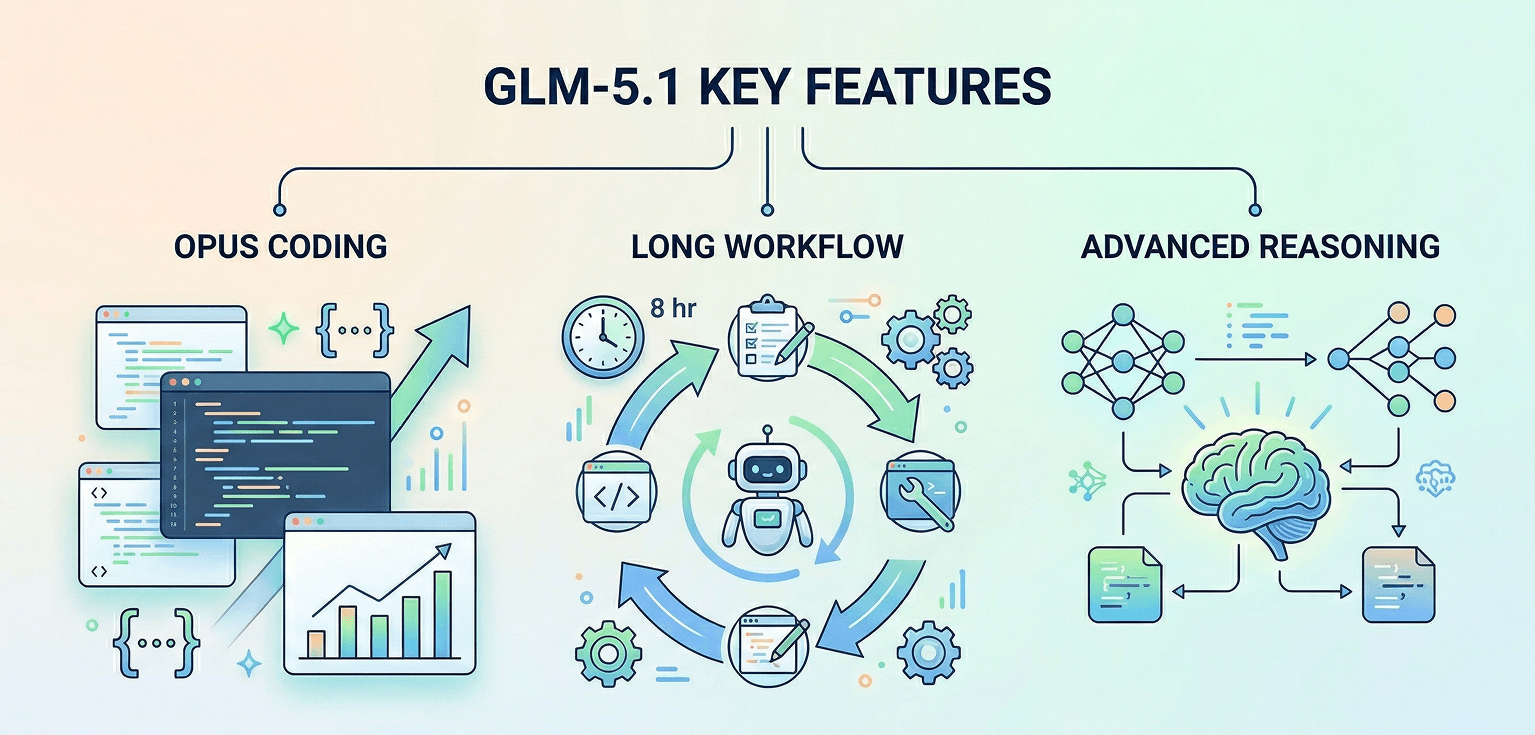

GLM-5.1 Hauptmerkmale

Programmierleistung: Opus 4.6-Niveau

GLM-5.1 erzielt die stärksten Benchmark-Ergebnisse bei Programmieraufgaben und erreicht die Leistung von Claude Opus 4.6. Es steht bei den wichtigsten öffentlichen Benchmarks an der Spitze der Open-Source-Modelle.

Vergleich mit Claude 3.5 Sonnet:

- Claude 3.5 Sonnet: Starke Programmierfähigkeiten, weit verbreitet für die Entwicklung

- GLM-5.1: Erreicht Leistung auf Opus 4.6-Niveau, wettbewerbsfähige Preise

Vergleich mit DeepSeek V3.2:

- DeepSeek V3.2: Exzellentes Open-Source-Programmiermodell mit umfassenden Fähigkeiten

- GLM-5.1: Überlegen bei spezialisierten Programmier-Benchmarks, einzigartige Ausführung bei Langzeitaufgaben

Langzeit-Aufgabenausführung: 8 Stunden Autonomie

GLM-5.1 geht weit über normale Dialoge hinaus. Geben Sie ihm ein echtes Ingenieursprojekt, und es plant den Workflow, schreibt Code, führt Tests durch, wechselt bei Problemen die Strategie, behebt Fehler und arbeitet bis zu 8 Stunden lang weiter, um ein vollständiges Ergebnis zu liefern. Nur wenige Modelle verfügen über diese Fähigkeit.

Vergleich mit GPT-4o:

- GPT-4o: Exzellent für Multi-Turn-Konversationen und kurze Aufgaben

- GLM-5.1: Konzipiert für erweiterte autonome Ausführung mit Zustandsverwaltung

Vergleich mit Qwen2.5:

- Qwen2.5: Starke Leistung bei vielfältigen Aufgaben

- GLM-5.1: Spezialisiert auf komplexe, langwierige technische Workflows

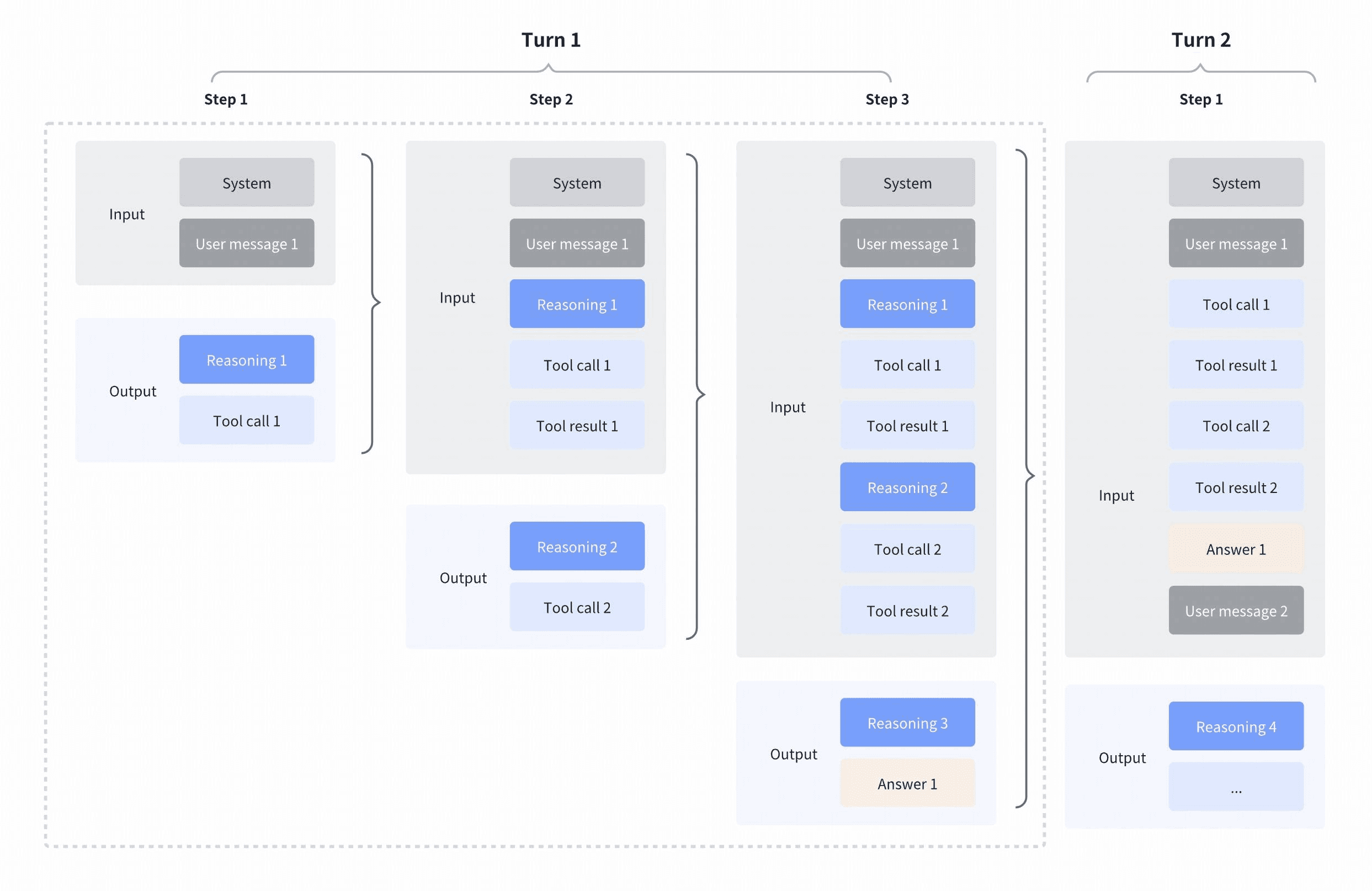

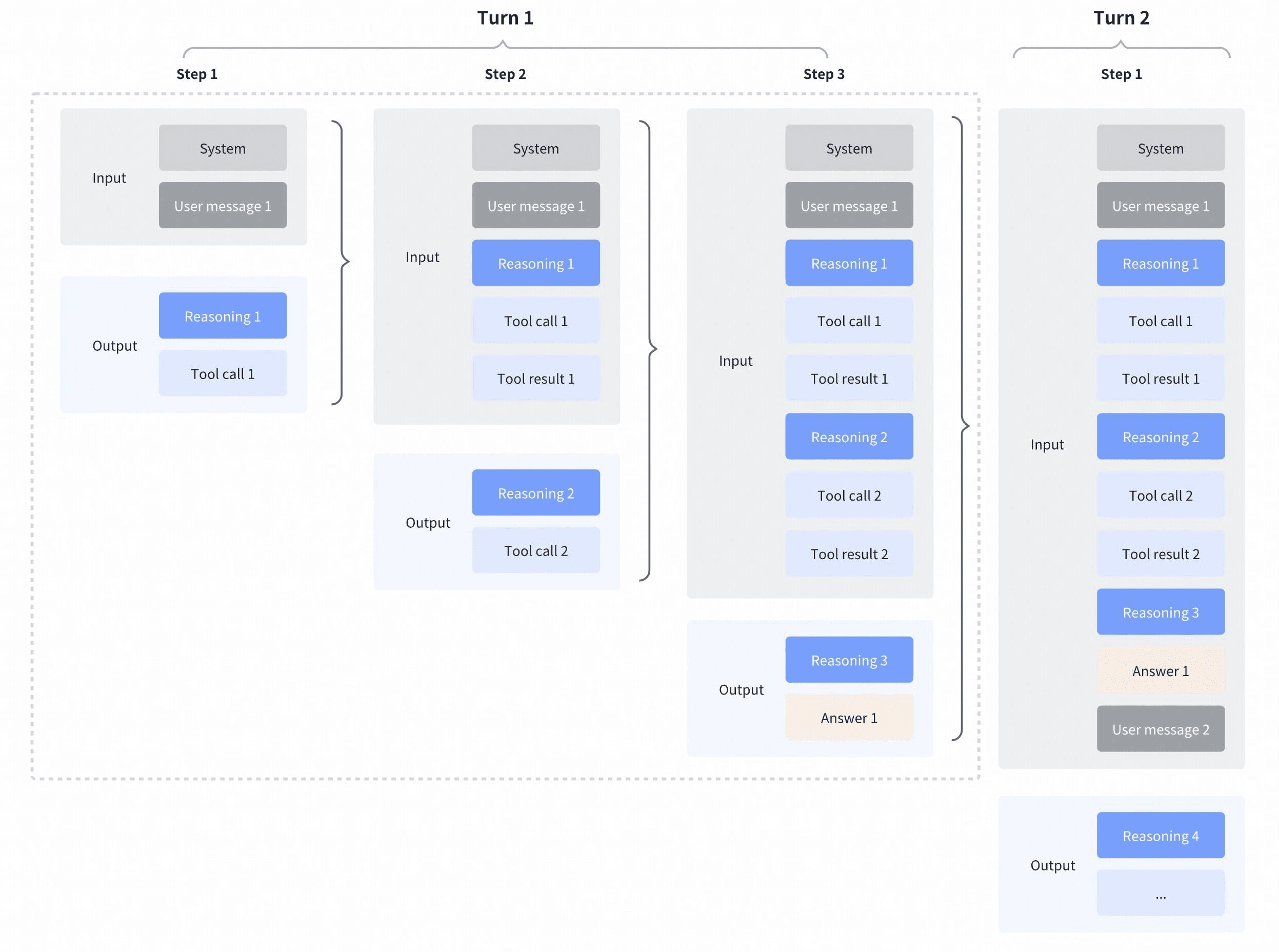

Interleaved & Preserved Thinking (Verschachteltes & Bewahrtes Denken)

- Interleaved Thinking

Ermöglicht es GLM, zwischen und nach Tool-Aufrufen zu schlussfolgern, was schrittweises Denken ermöglicht: Interpretieren von Ausgaben, Verketten von Aufrufen und Treffen präziser Entscheidungen basierend auf Zwischenergebnissen.

- Preserved Thinking

GLM-5.1 behält Schlussfolgerungen aus früheren Turns bei, was Kontinuität gewährleistet, die Leistung verbessert, die Cache-Trefferquote erhöht und bei realen Aufgaben Token einspart.

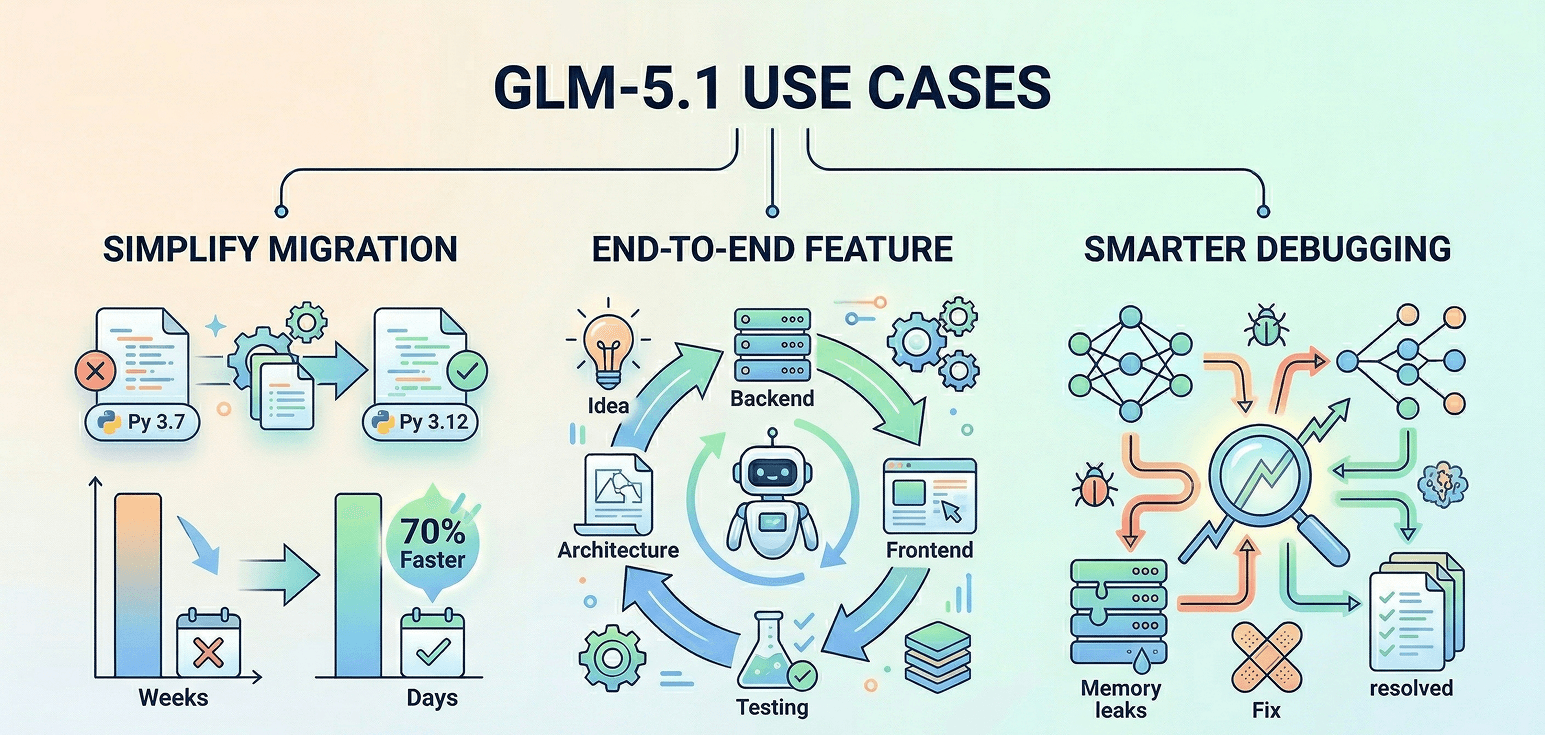

GLM-5.1 Anwendungsfälle: Code-Migration, Feature-Entwicklung, Debugging

Vereinfachung der Code-Migration

GLM-5.1 übernimmt zeitaufwändige Code-Migrationsaufgaben und verkürzt wochenlange Arbeit auf wenige Tage. Es überprüft die Codebasis, erstellt eine Strategie, bearbeitet Dateien im großen Stil und führt gründliche Tests durch. Dies hat gängige Projekte, wie das Upgrade von Python-Versionen oder die Modernisierung von Frameworks, um bis zu 70 % schneller und einfacher gemacht.

End-to-End-Feature-Entwicklung

Von der ersten Idee bis zur vollständig aufgebauten Anwendung führt GLM-5.1 den gesamten Prozess durch. Es plant die Architektur, baut Backend- und Frontend-Systeme, schreibt Tests und kümmert sich sogar um die Dokumentation. Ohne ständige Überwachung liefert es komplette Lösungen, die bereit für die Bereitstellung sind, einschließlich Sicherheit, Datenbanken und Produktionskonfigurationen.

Intelligenteres Debugging

Wenn komplexe Fehler in großen Systemen auftreten, übernimmt GLM-5.1 die Schwerstarbeit. Es verfolgt Probleme hartnäckig, egal ob es sich um Race Conditions oder Speicherlecks handelt, und wendet Korrekturen basierend auf sorgfältigen Tests an. Jeder Schritt wird dokumentiert, sodass Entwickler Lösungen erhalten, auf denen sie aufbauen können.

Warum GLM-5.1 in der Atlas Cloud nutzen?

Was ist Atlas Cloud?

Es ist eine Plattform, die KI vereinfacht, indem sie Ihnen Zugriff auf über 300 Top-Modelle an einem Ort bietet – Text, Bilder, Videos und mehr.

Für wen ist es geeignet?

• Entwickler, die einen einfachen und erschwinglichen KI-Zugang wünschen. • Teams, die Projekte bearbeiten, die KI in mehreren Bereichen erfordern. • Unternehmen, die zuverlässige KI für wichtige Arbeiten benötigen. • Nutzer von Tools wie ComfyUI und n8n.

Warum sollte man sich dafür entscheiden?

• Eine API ermöglicht die Nutzung von allem – nur ein Schlüssel. • Klare Preisgestaltung, keine Überraschungen und niedrige Kosten. • Entwickelt für Unternehmen: stabil, sicher und von Experten unterstützt. • Funktioniert mit den Tools, die Sie bereits verwenden. • Ihre Daten bleiben sicher und erfüllen Compliance-Anforderungen.

Wie ist der Vergleich?

• Fal.ai: Atlas bietet mehr Modelle und bessere Preise. • Wavespeed: Atlas kostet weniger und beinhaltet Enterprise-Support. • Kie.ai: Atlas ist transparenter bei der Preisgestaltung und bietet eine größere Auswahl. • Replicate: Kleinere Bibliothek und höhere Kosten. • Andere Anbieter (wie OpenAI): Atlas kombiniert alles auf einer einfachen Plattform.

So nutzen Sie GLM-5.1 in der Atlas Cloud

Atlas Cloud ermöglicht es Ihnen, Modelle nebeneinander zu nutzen – zuerst im Playground, dann über eine einzelne API.

Methode 1: Direkte Nutzung im Atlas Cloud Playground

Methode 2: Zugriff über API

Schritt 1: API-Schlüssel abrufen

Erstellen Sie einen API-Schlüssel in Ihrer Konsole und kopieren Sie ihn für die spätere Verwendung.

Schritt 2: API-Dokumentation prüfen

Überprüfen Sie den Endpunkt, die Anfrageparameter und die Authentifizierungsmethode in unserer API-Dokumentation.

Schritt 3: Erste Anfrage stellen (Python-Beispiel)

Beispiel: Generieren Sie ein Video mit GLM-5-Turbo

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

FAQ: Häufig gestellte Fragen zu GLM-5.1

F: Wie schneidet GLM-5.1 im Vergleich zu Claude 3.5 Sonnet bei der Programmierung ab?

A: GLM-5.1 entspricht Claude Opus 4.6 bei Programmier-Benchmarks und übertrifft Claude 3.5 Sonnet. Seine Fähigkeit, komplexe, langwierige Aufgaben zu bewältigen, macht es besonders hervorstechend.

F: Was ist das Besondere an der "Langzeit-Aufgabenausführung"?

A: Normale Chat-Modelle reagieren auf einzelne Prompts. GLM-5.1 hingegen kann bis zu 8 Stunden lang an einer Aufgabe arbeiten, sich anpassen und dabei selbst korrigieren.

F: Ist GLM-5.1 Open Source?

A: Ja, es ist vollständig Open Source. Entwickelt von Zhipu AI, finden Sie Lizenzdetails in der offiziellen Dokumentation.

F: Ist es bereit für den produktiven Einsatz?

A: Auf jeden Fall! GLM-5.1 bietet ein 128K-Kontextfenster und läuft auf der zuverlässigen Infrastruktur der Atlas Cloud, was es produktionsbereit macht.

F: Wie integriere ich die 8-stündige Ausführungsfähigkeit?

A: Für lange Aufgaben verwenden Sie einen Webhook oder ein Polling-Setup. Atlas Cloud kümmert sich um das Backend, und Ihre App erhält das Endergebnis nach Abschluss.

F: Für welche Aufgaben ist GLM-5.1 am besten geeignet?

A: Es ist ideal für anspruchsvolle Projekte wie Code-Migration, das Debuggen komplexer Systeme und die Full-Stack-Softwareentwicklung.