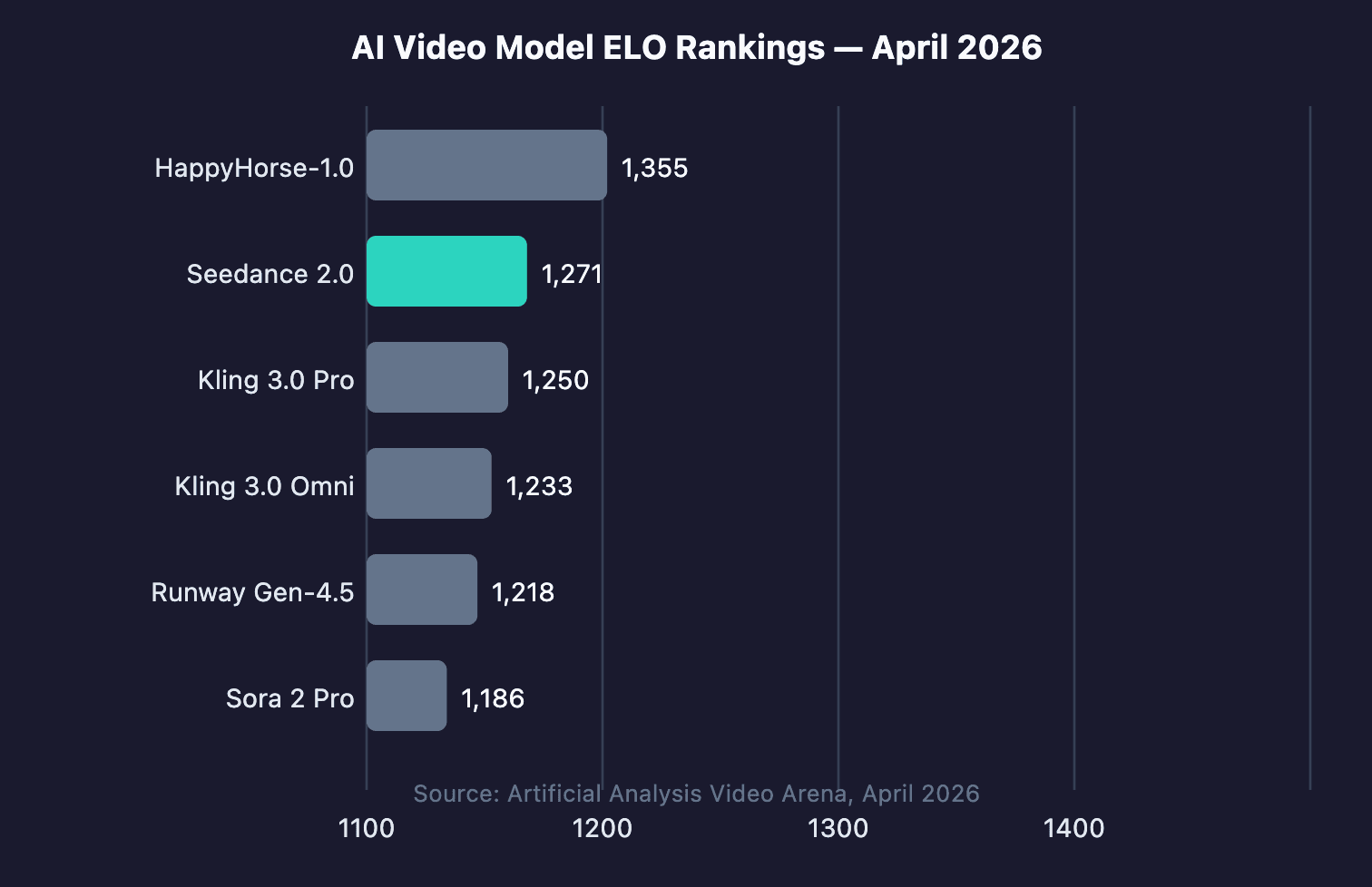

Wenn Sie nach einer klaren, praktischen Anleitung suchen, wie Sie Seedance 2.0 nutzen, sind Sie hier genau richtig. Früher dauerte die Produktion eines 60-sekündigen Marketingvideos 13 Tage. Mit KI-Videotools wie Seedance 2.0 ist derselbe Job heute in 27 Minuten erledigt – eine Reduzierung der Produktionszeit um 99,7 % (Zebracat via AutoFaceless, 2026). ByteDance hat Seedance 2.0 am 12. Februar 2026 veröffentlicht; es belegt aktuell mit einem ELO-Wert von 1.271 den zweiten Platz in der globalen Artificial Analysis Video Arena.

Dieser Leitfaden deckt alle wichtigen Zugriffsmethoden ab, wie Sie Seedance 2.0 in den USA, Indien oder anderen Ländern außerhalb Chinas verwenden können.

Die wichtigsten Erkenntnisse

- Seedance 2.0 ist weltweit über Dreamina und CapCut verfügbar. Es sind kein VPN und keine chinesische Telefonnummer erforderlich.

- Das kostenlose Kontingent bei Dreamina bietet 225 tägliche Token (mit Wasserzeichen). Bezahlte Tarife beginnen bei 18 USD/Monat.

- Für Entwickler in den USA und international bietet Atlas Cloud den kostengünstigsten API-Zugang ab USD 0,081/Sek.

- Das Modell akzeptiert Text, Bilder, Audio und Video in einem einzigen multimodalen Durchgang unter Verwendung der @AssetName-Syntax.

- 91 % der Unternehmen nutzen im Jahr 2026 Videomarketing (Wyzowl via Ngram, 2026). KI-Produktion senkt die Kosten im Vergleich zu herkömmlichen Videos um bis zu 91 %.

So nutzen Sie Seedance 2.0 kostenlos – Schritt-für-Schritt-Anleitungen

Die Frage, wie man Seedance 2.0 kostenlos nutzen kann, stellen die meisten Anwender zuerst. Dreamina bietet 225 geteilte tägliche Token kostenlos an, was für die Erstellung von etwa 10–15 kurzen Clips pro Tag ausreicht.

Kostenlose Option 1: Dreamina (Empfohlen)

Schritt 1: Gehen Sie in einem beliebigen Browser auf dreamina.capcut.com. Kein Download erforderlich. Die Plattform ist weltweit verfügbar. Melden Sie sich kostenlos mit Ihrem Google-Konto, Ihrer Apple ID oder Ihrer E-Mail-Adresse an. Keine Kreditkarte erforderlich.

Schritt 2: Klicken Sie in der linken Seitenleiste auf „Create“, um das Video-Generierungs-Panel zu öffnen. Wählen Sie Seedance 2.0 aus dem Modell-Dropdown-Menü oben im Panel. Sie sehen dort die Varianten „Standard“ und „Fast“.

Schritt 3: Schreiben Sie Ihren Prompt nach der Fünf-Punkte-Formel: Subjekt + Aktion + Umgebung + Stimmung + Kamerabewegung. Beispiel: „Eine Keramik-Kaffeetasse auf einem Holztisch, aufsteigender Dampf, warmes Küchenlicht, langsamer Dolly-Push nach vorne.“ Legen Sie die Dauer fest (4–8 Sekunden für das Gratis-Kontingent empfohlen) und das Seitenverhältnis (16:9 für Breitbild, 9:16 für vertikale soziale Medien).

Schritt 4: Klicken Sie auf „Generate“. Jeder Clip verbraucht etwa 15–20 Token. Ihre 225 täglichen Token werden alle 24 Stunden aktualisiert. Laden Sie Ihr Video herunter. Die Ausgaben im kostenlosen Tarif enthalten ein Wasserzeichen. Upgraden Sie auf den Standard-Tarif für 18 USD/Monat, um dieses zu entfernen.

Kostenlose Option 2: CapCut App

CapCut teilt sich einen Token-Pool mit Dreamina über dasselbe ByteDance-Konto. Laden Sie CapCut aus dem App Store oder Play Store herunter, melden Sie sich mit demselben Konto an und tippen Sie auf „AI Video“, um auf Seedance 2.0 zuzugreifen. Token werden gemeinsam genutzt; wenn Sie sie in CapCut ausgeben, verringert sich Ihr Dreamina-Guthaben und umgekehrt.

Seedance 2.0 API für Entwickler

Für Entwickler und Unternehmen ist der API-Weg über Atlas Cloud die kostengünstigste und schnellste Integrationsmöglichkeit.

Atlas Cloud ist eine KI-API-Aggregationsplattform, die Entwicklern und Unternehmen einen einheitlichen Zugriff auf über 300 KI-Modelle bietet, einschließlich aller sechs Seedance 2.0-Varianten. Dies funktioniert über einen einzigen API-Schlüssel, ein zentrales Abrechnungs-Dashboard und eine einheitliche Basis-URL. Es ist der schnellste Weg, Seedance 2.0 in jede Anwendung, Pipeline oder jedes Produkt zu integrieren, ohne sich mit direkten Unternehmensverträgen von ByteDance befassen zu müssen.

Hauptmerkmale von Atlas Cloud

- 300+ KI-Modelle (Video, Bild, LLM, Audio) über einen einzigen API-Schlüssel

- Alle 6 Seedance 2.0-Varianten: Text-to-Video, Image-to-Video, Reference-to-Video (Standard & Fast)

- Seedance 2.0 Fast für USD 0,081/Sek. – niedrigster Preis unter den großen Plattformen

- OpenAI SDK-kompatible Endpunkte (Drop-in-Ersatz)

- Pay-as-you-go, keine monatlichen Abonnements

- 99,9 % Uptime SLA mit internationaler Datenkonformität

- MCP-Server-Integration für über 100 IDE-Clients

- Akzeptiert Kreditkarte, PayPal, Krypto, WeChat Pay, Alipay

Methode 1: Direkte Nutzung im Atlas Cloud Playground

Kein Code erforderlich. Gehen Sie auf atlascloud.ai, melden Sie sich an, navigieren Sie zur Modell-Seite, suchen Sie nach Seedance 2.0 und klicken Sie auf „Try in Playground“. Geben Sie Ihren Prompt ein, wählen Sie Ihre Einstellungen und generieren Sie direkt im Browser. Dies ist der schnellste Weg, eine Idee zu validieren, bevor Sie die API anbinden.

Methode 2: Zugriff über API

Schritt 1: API-Schlüssel abrufen

Gehen Sie zu atlascloud.ai/console/api-keys. Klicken Sie auf „Create API Key“, vergeben Sie einen Namen und kopieren Sie ihn sofort – er wird nur einmal angezeigt. Hinterlegen Sie ihn in Ihrer Umgebung als ATLASCLOUD_API_KEY.

Schritt 2: API-Dokumentation prüfen

Die vollständige Referenz finden Sie unter atlascloud.ai/docs. Dort finden Sie alle Parameter, Modell-IDs, den Upload-Endpunkt für Referenzdateien und den Abfrage-Lebenszyklus. Es lohnt sich, diese 5 Minuten lang zu lesen, bevor Sie mit der Programmierung beginnen.

Schritt 3: Erste Anfrage stellen

Der Ablauf ist immer gleich: Generierungsauftrag absenden → Vorhersage-ID (Prediction ID) erhalten → Status abfragen, bis er abgeschlossen ist → Video-URL abrufen. Hier ist ein funktionierendes Python-Beispiel für den Einstieg:

python1import requests 2import time 3 4# Schritt 1: Video-Generierung starten 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/text-to-video", # Erforderlich. Modellname 12 "prompt": "Eine filmische Ansicht des unendlichen Ozeans bei Sonnenaufgang, goldenes Sonnenlicht breitet sich über das tiefblaue Meer aus, mächtige Wellen steigen auf und brechen mit weißem Schaum. Die Kamera fliegt tief über die Wasseroberfläche, Wassertropfen und Gischt glühen im Licht. Epische filmische Atmosphäre, 4K.", 13 "duration": 5, # Videodauer in Sekunden (4–15), oder -1 für automatisch 14 "resolution": "720p", # Optionen: 480p | 720p 15 "ratio": "adaptive", # 9:16 | 16:9 | 1:1 | 4:3 | adaptive 16 "generate_audio": True, # Synchronisierte Stimme, SFX und Hintergrundmusik generieren 17 "watermark": False, 18} 19 20generate_response = requests.post(generate_url, headers=headers, json=data) 21prediction_id = generate_response.json()["data"]["id"] 22 23# Schritt 2: Ergebnis abfragen (Polling) 24poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 25 26def check_status(): 27 while True: 28 response = requests.get( 29 poll_url, 30 headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"} 31 ) 32 result = response.json() 33 status = result["data"]["status"] 34 35 if status in ["completed", "succeeded"]: 36 video_url = result["data"]["outputs"][0] 37 print("Generiertes Video:", video_url) 38 return video_url 39 elif status == "failed": 40 raise Exception(result["data"].get("error", "Generierung fehlgeschlagen")) 41 else: 42 time.sleep(2) # Wird noch verarbeitet – in 2 Sekunden erneut prüfen 43 44video_url = check_status()

Der Seedance 2.0 Fast-Tarif von Atlas Cloud kostet USD 0,081 pro Sekunde, im Vergleich zu Kling 3.0 mit USD 0,153/Sek. Der Upload von Referenzdateien wird nicht berechnet – Sie zahlen nur für die generierte Videodauer. Neue Konten erhalten 1 USD Startguthaben ohne Kreditkartenanforderung (Atlas Cloud Dokumentation, 2026).

Was ist Seedance 2.0 und warum ist es wichtig?

Im April 2026 erreichte Seedance 2.0 einen ELO-Wert von 1.271 in der Artificial Analysis Video Arena und platzierte sich damit weltweit auf dem zweiten Platz und auf Platz 1 aller Audio-fähigen Modelle (mit einem Wert von 1.221). Dieses Ranking spiegelt eine reale Stärke wider: Es ist eines der wenigen Modelle, das Text, Bilder, Videoclips und Audio in einem einzigen einheitlichen Durchgang verarbeitet, anstatt verschiedene Tools miteinander zu verketten.

ByteDance entwickelte Seedance 2.0 in seinem SEED-Labor und veröffentlichte es am 12. Februar 2026. Die Architektur basiert auf einer vereinheitlichten, multimodalen Audio-Video-Generierung. In der Praxis bedeutet das: Sie stellen einen Prompt, optionale Referenzbilder, einen Videoclip und eine Audiodatei bereit, und das Modell verarbeitet alles zusammen. Kein separater Schritt für Audio-Synchronisation. Kein manueller Lip-Sync-Prozess.

Die Ausgabeauflösung erreicht bis zu 1080p über die Dreamina-Benutzeroberfläche und 720p über die API. Sie können Clips zwischen 4 und 15 Sekunden Länge in sechs Seitenverhältnissen generieren: 21:9, 16:9, 4:3, 1:1, 3:4 und 9:16. Letzteres ist besonders für soziale Medien relevant. Jede Ausgabe enthält C2PA-Provenienz-Wasserzeichen, die in die Dateimetadaten eingebettet sind.

Warum ist der ELO-Abstand wichtig? Kling 3.0 Pro erreicht 1.250 Punkte und Runway Gen-4.5 1.218 Punkte. Diese Abstände von 21 bis 53 Punkten führen zu deutlich saubereren Bewegungen und einer besseren Umsetzung von Prompts bei komplexen Szenen. Es lohnt sich, eigene A/B-Tests für Ihren spezifischen Anwendungsfall durchzuführen, aber Seedance 2.0 punktet meist bei filmischen Kamerabewegungen und mehrsprachigem Audio.

Seedance 2.0 erzielte im April 2026 einen ELO-Wert von 1.271 in der Artificial Analysis Video Arena und belegte damit den zweiten Platz weltweit unter allen Text-to-Video-Modellen und den ersten Platz unter den Audio-fähigen Modellen, die auf einem parallelen Audio-Sub-Leaderboard 1.221 Punkte erreichten (Artificial Analysis Video Arena, April 2026).

Der KI-Videomarkt beschleunigt sich rasant. Laut Fortune Business Insights lag der globale Markt für KI-Videogeneratoren im Jahr 2025 bei 716,8 Millionen USD und wächst bis 2026 auf 847 Millionen USD, was einem Anstieg von 18,8 % gegenüber dem Vorjahr entspricht. Grand View Research beziffert den Markt für 2026 auf 946,4 Millionen USD mit einer jährlichen Wachstumsrate von 20,3 % bis 2033. Diese Zahlen bestätigen, dass es sich nicht um ein Nischenexperiment handelt. Es ist ein Markt, in dem die heute getroffenen Entscheidungen über die Werkzeuge über Jahre hinweg Auswirkungen haben werden.

Fortschrittliches Prompting für Seedance 2.0 und multimodale Eingaben

Im Jahr 2026 nutzten laut Wyzowl via Ngram 63 % der Videovermarkter KI-Tools zur Erstellung oder Bearbeitung von Marketingvideos. Der Unterschied zwischen durchschnittlichen Ergebnissen und professioneller Qualität liegt in der Präzision der Prompts. Die multimodalen Eingaben von Seedance 2.0 machen das Prompting noch wirkungsvoller, führen aber auch zu Fehlerquellen, die die meisten Anleitungen nicht abdecken.

Verwendung von @AssetName-Referenz-Tags

Die @AssetName-Syntax dient dazu, hochgeladene Dateien bestimmten Rollen in der Szene zuzuweisen. Sie können ein Produktfoto, ein Hintergrundvideo und eine Hintergrundmusik hochladen und dann schreiben: „@product_front auf einem minimalistischen Schreibtisch, langsame Orbit-Kamera, sanfter Jazz über @ambient_track.“ Das Modell nutzt das Bild als visuellen Anker, den Videoclip als Bewegungsreferenz und das Audio für die klangliche Ebene. Dies ist der entscheidende Vorteil gegenüber der reinen Textgenerierung.

Optionen zur Kamerasteuerung

Seedance 2.0 unterstützt drei definierte Kamerabewegungen: Dolly (Vorwärts-/Rückwärtsbewegung), Pan (Links-/Rechtsdrehung) und Push (Zoom mit Bewegung). Dies sind Fachbegriffe, verwenden Sie sie daher wörtlich in Ihrem Prompt. „Langsamer Dolly-Push nach vorne“ führt zu einem anderen Ergebnis als „Zoom in“. Verwenden Sie pro Clip nur eine Kamerabewegung. Das Stapeln von zwei Bewegungen in einem einzigen 8-Sekunden-Clip führt meist zu visuellen Artefakten.

Fehler bei Prompts und deren Behebung

Hier ist ein Muster, das immer wieder auftritt: Vage Prompts führen zu vagen Ergebnissen. Bedenken Sie den Unterschied zwischen diesen beiden Prompts für dasselbe Produktfoto:

Vorher (schwach): „Zeige eine Wasserflasche in einer schönen Umgebung mit gutem Licht.“ Nachher (stark): „@bottle durchsichtige blaue Wasserflasche auf einer nassen Steinoberfläche, Wassertropfen fangen das Morgenlicht ein, verschwommener Waldhintergrund, langsamer Dolly-Push, cooler filmischer Ton.“

Die schwache Version erzeugt ein generisches Studio-Mockup. Die starke Version generiert etwas, das Sie tatsächlich in einer Anzeige verwenden könnten. Was hat sich geändert? Spezifikationen zu Oberflächentextur, Lichtquelle, Hintergrundtiefe und Kamerabewegung. Das Modell reagiert auf konkrete Substantive und präzise Deskriptoren, nicht auf Adjektive wie „schön“ oder „gut“.

Seedance 2.0 unterstützt eine Kamerasteuerung auf Regie-Niveau, einschließlich Dolly-, Pan- und Push-Bewegungen. Behandeln Sie Kameraanweisungen in jedem Prompt als wörtliche Anweisungen. Quelle: Unsplash / Harrison Kugler.

Seedance 2.0 akzeptiert bis zu 12 Referenzdateien pro Anfrage – eine Mischung aus 9 Bildern, 3 Videoclips und 3 Audiodateien –, die alle in einem einzigen multimodalen Durchgang unter Verwendung der @AssetName-Syntax für gezielte Referenzierung verarbeitet werden. Kein Konkurrent in den Top-6 der ELO-Ranglisten bietet dieses Niveau an kombinierter Eingabekontrolle (ByteDance SEED Lab Dokumentation, 2026).

Häufig gestellte Fragen zu Seedance 2.0

- Ist Seedance 2.0 kostenlos nutzbar?

Ja, bis zu einem gewissen Grad. Der kostenlose Dreamina-Tarif beinhaltet 225 geteilte tägliche Token und fügt allen Ausgaben ein Wasserzeichen hinzu. Bezahlte Pläne beginnen bei 18 USD/Monat für den Standard-Tarif, der Wasserzeichen entfernt und Token-Limits erhöht. Die Anzahl der monatlich aktiven Nutzer auf KI-Videoplattformen erreichte im Januar 2026 124 Millionen (Ngram, 2026), daher können die kostenlosen Kontingente zu Stoßzeiten überlastet sein.

- Was ist die maximale Videolänge, die Seedance 2.0 generieren kann?

Die maximale Dauer eines einzelnen Clips beträgt 15 Sekunden, sowohl über die Dreamina-Benutzeroberfläche als auch über die API. Das Minimum beträgt 4 Sekunden. Für längere Videos verketten Sie mehrere Clips mithilfe konsistenter Referenz-Assets über das @AssetName-Tag. Dies entspricht der Struktur professioneller KI-Video-Workflows bei den meisten Spitzenmodellen im Jahr 2026.

- Wie schneidet Seedance 2.0 im Vergleich zu Sora 2 bei den Kosten ab?

Auf API-Ebene kostet Seedance 2.0 via Atlas Cloud Fast 0,022 USD pro Sekunde, was einen 10-sekündigen Clip auf 0,22 USD bringt. Sora 2 kostet etwa 0,15 USD pro Sekunde, wodurch derselbe Clip 1,50 USD kostet. Das ist ein Kostenvorteil von etwa 7x für Seedance 2.0. Angesichts des ELO-Werts von 1.271 gegenüber 1.186 von Sora 2 Pro spricht das Verhältnis von Qualität zu Kosten eindeutig für Seedance (Atlas Cloud, März 2026).

- Kann ich die Ausgaben von Seedance 2.0 kommerziell nutzen?

Die kommerzielle Nutzung ist in den kostenpflichtigen Dreamina-Tarifen und über die API gestattet, vorbehaltlich der Nutzungsbedingungen von ByteDance. Jede Ausgabe enthält eingebettete C2PA-Provenienz-Metadaten, die einige Werbeplattformen und Tools zur Markensicherheit erkennen können. Überprüfen Sie die Richtlinien zur Offenlegung von KI-Inhalten der jeweiligen Plattform, bevor Sie bezahlte Kampagnen schalten. Die herkömmliche Produktion kostet 4.500 USD/Min. im Vergleich zu KI mit 400 USD/Min. (vidBoard.ai, 2026), daher ist die Einhaltung der Compliance wichtig.

- Wie lange dauert die API-Generierung?

Die Generierungszeit über die AtlasCloud API liegt zwischen 30 und 120 Sekunden pro Clip. Verwenden Sie das asynchrone Submit-Poll-Download-Muster anstatt einer blockierenden Anfrage. Senden Sie für Batch-Workflows zuerst alle Aufträge ab und fragen Sie dann die Ergebnisse ab.

- Wie nutze ich Seedance 2.0 außerhalb Chinas ohne VPN?

Kein VPN erforderlich. Wie Sie Seedance 2.0 außerhalb Chinas nutzen: Besuchen Sie dreamina.capcut.com direkt aus jedem Land. Dreamina ist die internationale Plattform, die vollständig von Jimeng (nur China) getrennt ist. Sie ist in über 130 Ländern verfügbar, darunter die USA, Großbritannien, Indien, Japan und der größte Teil Europas. Für den API-Zugriff sind Atlas Cloud und fal.ai weltweit ohne geografische Beschränkungen zugänglich.

- Wie nutze ich Seedance 2.0 in CapCut?

Laden Sie CapCut aus Ihrem App Store herunter, melden Sie sich an, tippen Sie auf „AI Video“, wählen Sie Seedance 2.0 aus der Modellauswahl, schreiben Sie Ihren Prompt, legen Sie Seitenverhältnis und Dauer fest und tippen Sie auf „Generate“. CapCut teilt sich denselben Token-Pool mit Dreamina über dasselbe ByteDance-Konto. ByteDance hat den globalen CapCut-Zugang im April 2026 auf über 150 Länder ausgeweitet.

- Wie nutze ich die Seedance 2.0 API als Entwickler?

So nutzen Sie die Seedance 2.0 API: Registrieren Sie sich bei atlascloud.ai, erstellen Sie einen API-Schlüssel, laden Sie Ihr Konto auf (Minimum 10 USD). Fragen Sie den Status alle 5 Sekunden ab, bis status: „completed“ erscheint. Seedance 2.0 Fast kostet 0,022 USD/Sek. – 7-mal günstiger als Sora 2 mit ca. 0,15 USD/Sek. (Atlas Cloud, März 2026).