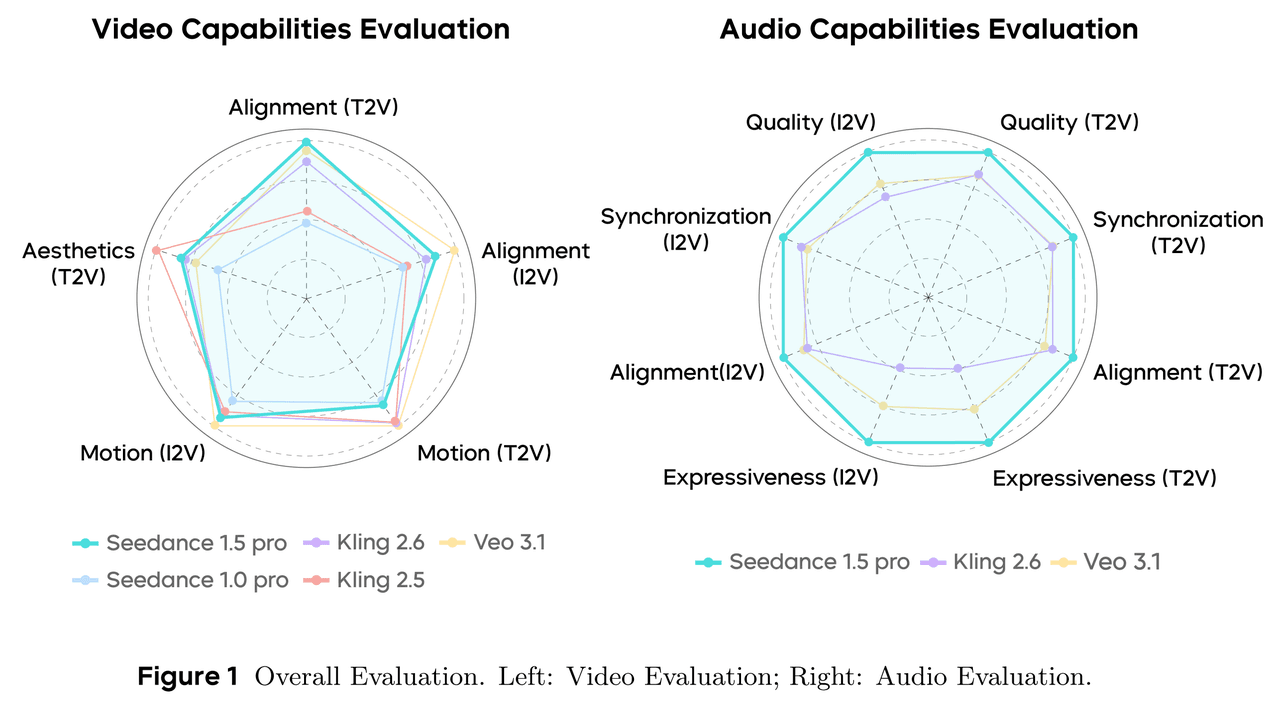

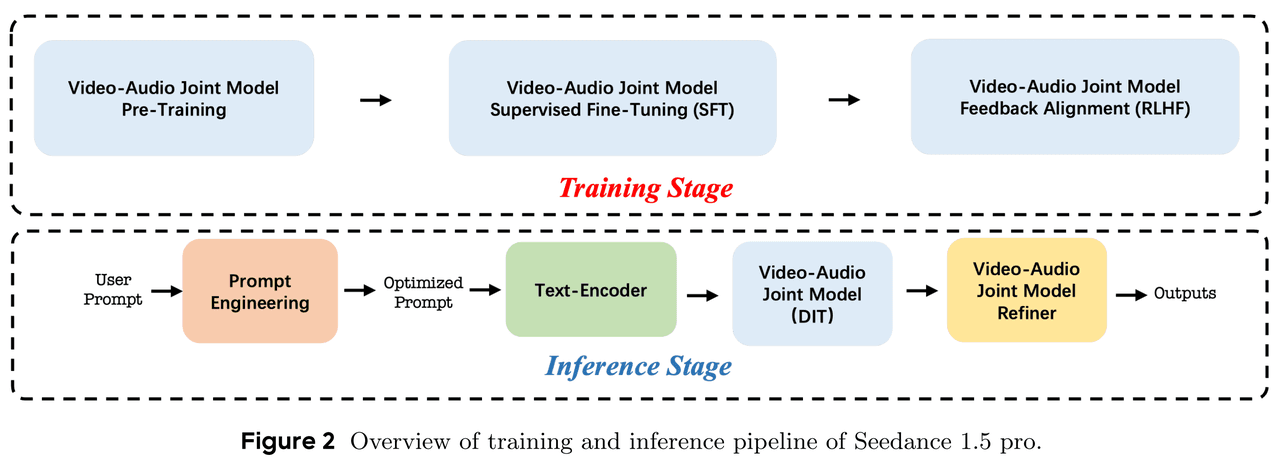

Einleitung: Was ist Seedance 2.0?\n\nSeedance 2.0 ist der mit Spannung erwartete Nachfolger des multimodalen Videogenerierungsmodells von ByteDance.\n\n* Das Upgrade: Während Seedance 1.5 Pro die Grundlage für die native audio-visuelle Generierung legte, wird für Version 2.0 die Einführung von „Acoustic Physics Fields“ und „World Model Priors“ prognostiziert.\n* Das Ziel: Die Lücke zwischen KI-Generierung und physikalischer Realität zu schließen. Es zielt darauf ab, als Allround-Regisseur zu fungieren, der komplexe audio-visuelle Erzählungen für Videos von mehr als 30 Sekunden Länge steuert.\n\n## Wichtige Prognosen: 3 große Upgrades in Seedance 2.0 (Voraussichtlich)\n\n#### 1\. Vom Audio-Sync zur „akustischen Physik“\n\nSeedance 1.5 Pro nutzte einen Dual-branch Diffusion Transformer (MMDiT), um Probleme bei der Lippensynchronisation zu lösen. Es wird jedoch erwartet, dass Seedance 2.0 ein vollständiges akustisches Feld simuliert.\n\n \n\n* Echte multimodale Physik: Wenn im Video ein Glas zerbricht, wird der erzeugte Ton nicht nur ein allgemeiner Soundeffekt sein. Er wird den Nachhall basierend auf dem im Bild sichtbaren Bodenmaterial (z. B. Teppich vs. Fliesen) berechnen.\n* Latente Priors: Dies beinhaltet das Hinzufügen von Priors der Physik-Engine zur MMDiT-Architektur, was dem Klang „Gewicht“ und „Aufprall“ verleiht.\n\n

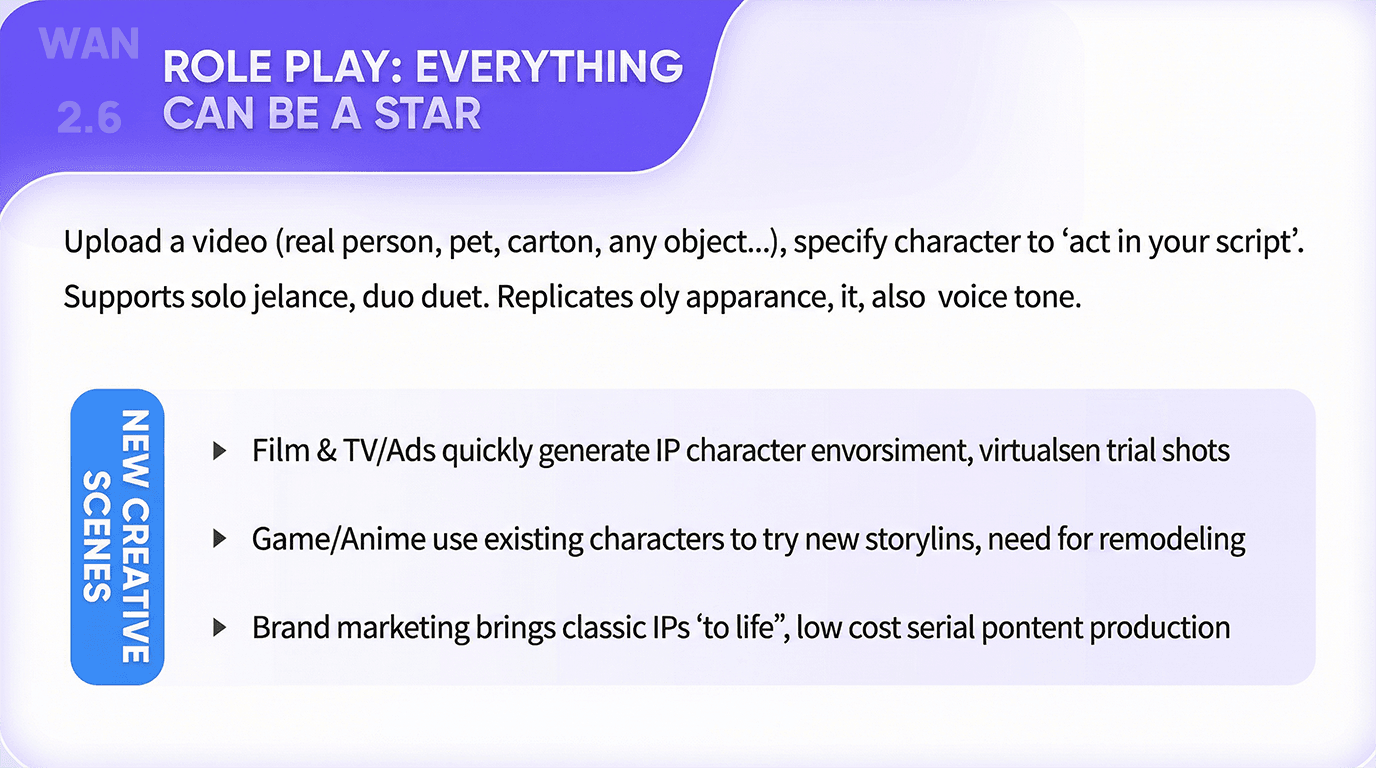

\n\n* Echte multimodale Physik: Wenn im Video ein Glas zerbricht, wird der erzeugte Ton nicht nur ein allgemeiner Soundeffekt sein. Er wird den Nachhall basierend auf dem im Bild sichtbaren Bodenmaterial (z. B. Teppich vs. Fliesen) berechnen.\n* Latente Priors: Dies beinhaltet das Hinzufügen von Priors der Physik-Engine zur MMDiT-Architektur, was dem Klang „Gewicht“ und „Aufprall“ verleiht.\n\n \n\n#### 2\. Im Wettbewerb mit Wan 2.6: Konsistenz in langen Videos\n\n* Derzeit dominiert Wan 2.6 die Charakterkonsistenz mit seiner Reference-to-Video-Funktion, die wie ein Zero-Shot-Charakter-LoRA fungiert. Seedance 2.0 wird voraussichtlich kontern, indem es sich auf die „World ID“ fixiert.

\n\n#### 2\. Im Wettbewerb mit Wan 2.6: Konsistenz in langen Videos\n\n* Derzeit dominiert Wan 2.6 die Charakterkonsistenz mit seiner Reference-to-Video-Funktion, die wie ein Zero-Shot-Charakter-LoRA fungiert. Seedance 2.0 wird voraussichtlich kontern, indem es sich auf die „World ID“ fixiert. \n* Längere Generierung: Seedance 2.0 bricht den „12-Sekunden-Fluch“ und strebt eine native Kohärenz für 30–60 Sekunden lange Videos an.\n* Temporale Aufmerksamkeit: Eine verbesserte Optimierung nach dem Training wird es dem Modell wahrscheinlich ermöglichen, sich an Ereignisse aus der ersten Sekunde zu „erinnern“ und am Ende des Clips darauf Bezug zu nehmen.\n\n#### 3\. Kontrolle auf Regisseur-Niveau\n\n* Seedance 2.0 wird voraussichtlich Node-basierte Steuerung und Echtzeit-Vorschau-Funktionen einführen.\n* Partielles In-Painting & Audio-Remixing: Benutzer könnten in der Lage sein, einen Charakter auszuwählen und dessen Handlung oder Dialog-Emotion (z. B. von wütend zu flehend) zu ändern, während die Hintergrundmusik und die Umgebung unverändert bleiben.\n\n## Vergleich: Seedance 2.0 vs. Wettbewerb\n\n

\n* Längere Generierung: Seedance 2.0 bricht den „12-Sekunden-Fluch“ und strebt eine native Kohärenz für 30–60 Sekunden lange Videos an.\n* Temporale Aufmerksamkeit: Eine verbesserte Optimierung nach dem Training wird es dem Modell wahrscheinlich ermöglichen, sich an Ereignisse aus der ersten Sekunde zu „erinnern“ und am Ende des Clips darauf Bezug zu nehmen.\n\n#### 3\. Kontrolle auf Regisseur-Niveau\n\n* Seedance 2.0 wird voraussichtlich Node-basierte Steuerung und Echtzeit-Vorschau-Funktionen einführen.\n* Partielles In-Painting & Audio-Remixing: Benutzer könnten in der Lage sein, einen Charakter auszuwählen und dessen Handlung oder Dialog-Emotion (z. B. von wütend zu flehend) zu ändern, während die Hintergrundmusik und die Umgebung unverändert bleiben.\n\n## Vergleich: Seedance 2.0 vs. Wettbewerb\n\n

| Feature | <a href="https://www.atlascloud.ai/collections/seedance1.5">Seedance 1.5 Pro | Seedance 2.0 (Voraussichtlich) |

| Architektur | MMDiT (Audio-Visuell) | World-MMDiT (Physik + AV) |

| Audio | Lip-Sync, Emotionsanpassung | Physiksimulation, Umgebungsinteraktion |

| Dauer | Kurz (~10s) | Lang (30s-60s) |

| Rechenlast | Hoch | Extrem hoch |

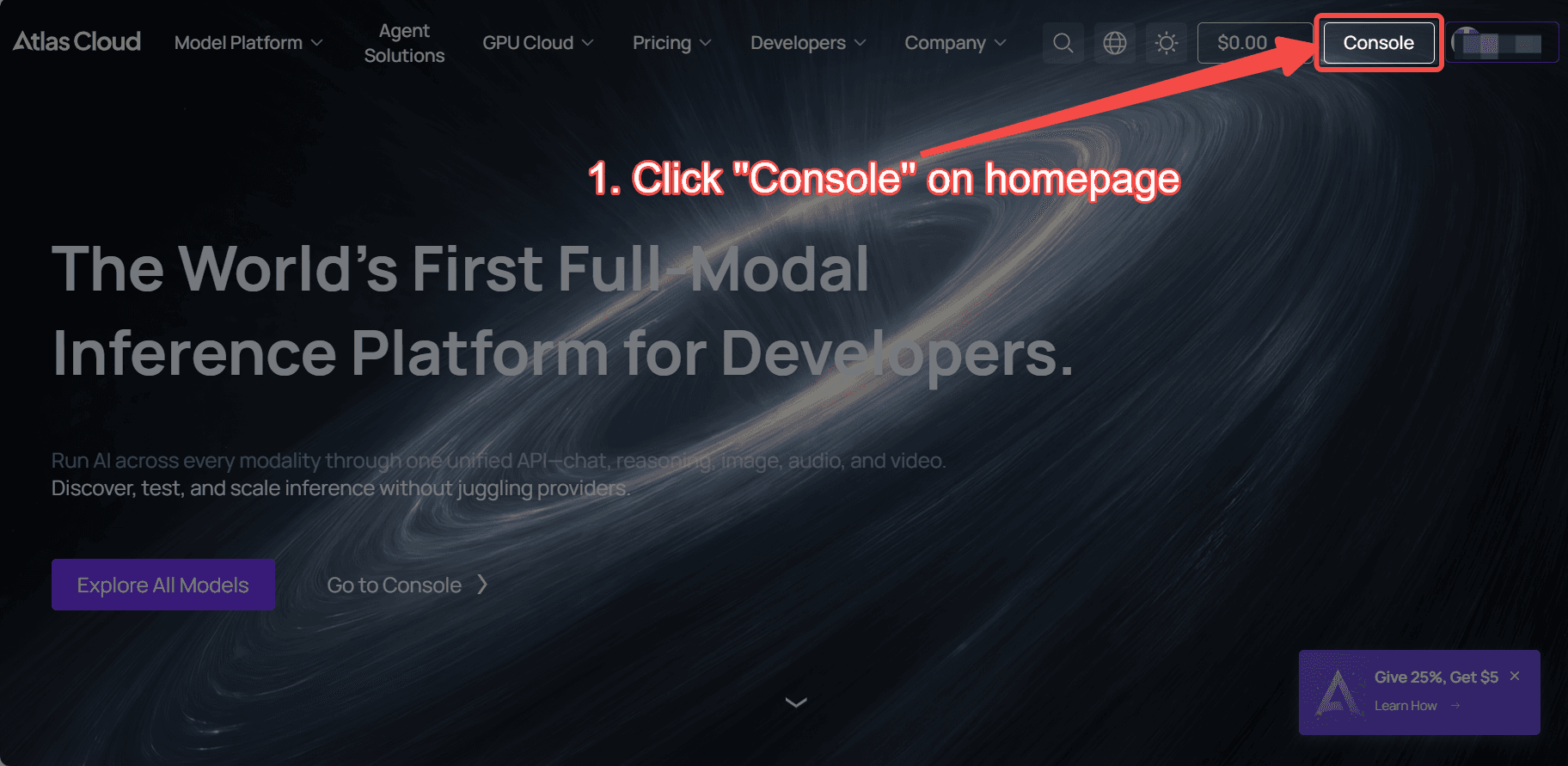

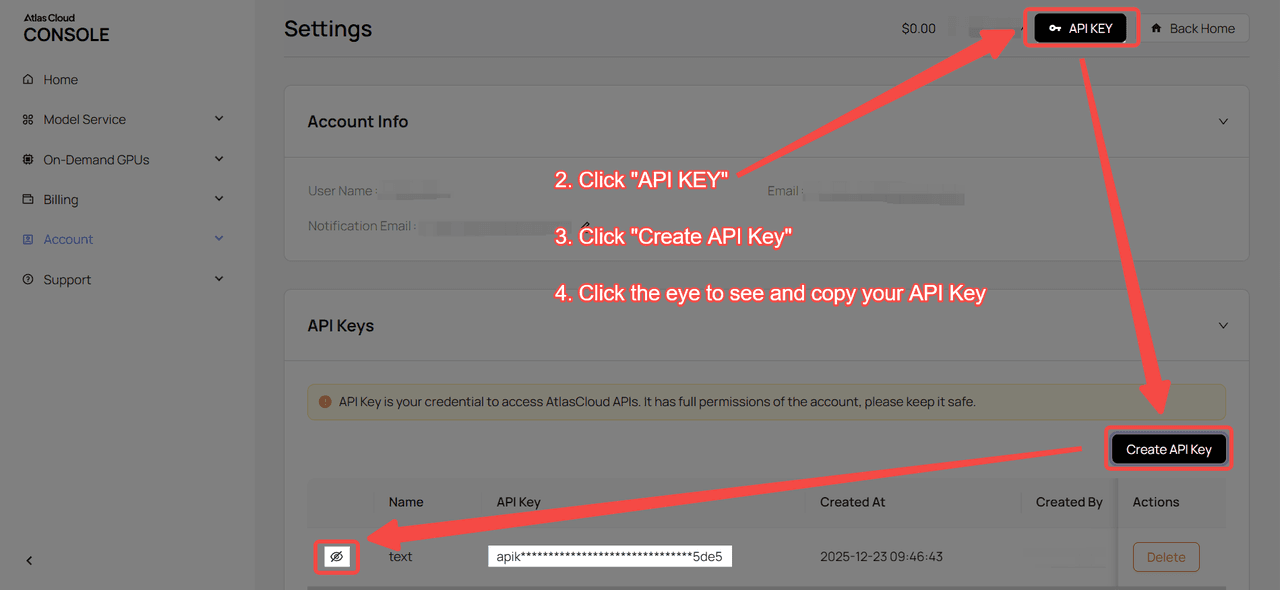

\n\n## So greifen Sie auf Seedance 2.0 zu: Die Hardware-Herausforderung\n\nDie technische Dokumentation für 1.5 Pro hebt hervor, dass die Optimierung zwar die Geschwindigkeit um das Zehnfache erhöht hat, der Sprung zu den „World Model“-Fähigkeiten von Seedance 2.0 jedoch die Anforderungen an VRAM und Rechenleistung exponentiell steigern wird.\n\nSeedance 2.0 lokal auszuführen – selbst auf einer NVIDIA RTX 4090 – wird für die meisten Benutzer aufgrund der massiven multimodalen Verarbeitungslast wahrscheinlich unmöglich sein.\n\n## Die Lösung: Atlas Cloud\n\nAtlas Cloud ist auf den Start vorbereitet. Wir haben die gesamte Seedance-Modellfamilie integriert und werden Seedance 2.0 am Tag 0 der Veröffentlichung unterstützen.\n\n* Zero-Konfigurations-Bereitstellung: Greifen Sie auf Seedance, Kling und Sora-ähnliche Modelle zu, ohne komplexe Python- oder CUDA-Einrichtung.\n* Elastisches Computing: Skalieren Sie Ihre GPU-Leistung sofort. Zahlen Sie sekundengenau für das Rendering langer, komplexer Videos, ohne Ihre lokale Hardware zu überlasten.\n* API-Zugriff: Entwickler können Seedance 2.0-Funktionen unmittelbar nach dem Start über die Atlas Cloud API direkt in ihre Apps integrieren.\n\nLassen Sie Ihre Kreativität nicht durch Hardware einschränken. [Registrieren Sie sich für Atlas Cloud], um sich Ihren Prioritätszugang für den Seedance 2.0-Launch Mitte Februar zu sichern.\n\n## Verwendung auf Atlas Cloud\n\nMit Atlas Cloud können Sie Modelle nebeneinander verwenden – zuerst in einem Playground, dann über eine einzige API.\n\n### Methode 1: Direkt im Atlas Cloud Playground nutzen\n\nSeedance 1.5 Pro\n\nSeedance 1.0 Pro\n\n### Methode 2: Zugriff über die API\n\n#### Schritt 1: API-Key abrufen\n\nErstellen Sie einen API-Key in Ihrer Konsole und kopieren Sie ihn für die spätere Verwendung.\n\n \n\n

\n\n \n\n#### Schritt 2: API-Dokumentation prüfen\n\nÜberprüfen Sie den Endpunkt, die Anfrageparameter und die Authentifizierungsmethode in unserer API-Dokumentation.\n\n#### **Schritt 3: Die erste Anfrage stellen (Python-Beispiel)**\n\nBeispiel: Ein Video mit Seedance 1.5 Pro generieren:\n\ntext

\n\n#### Schritt 2: API-Dokumentation prüfen\n\nÜberprüfen Sie den Endpunkt, die Anfrageparameter und die Authentifizierungsmethode in unserer API-Dokumentation.\n\n#### **Schritt 3: Die erste Anfrage stellen (Python-Beispiel)**\n\nBeispiel: Ein Video mit Seedance 1.5 Pro generieren:\n\ntext1plaintext\nimport requests\nimport time\n\n# Step 1: Start video generation\ngenerate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo"\nheaders = {\n "Content-Type": "application/json",\n "Authorization": "Bearer $ATLASCLOUD_API_KEY"\n}\ndata = {\n "model": "bytedance/seedance-v1.5-pro/image-to-video-fast",\n "aspect_ratio": "16:9",\n "camera_fixed": False,\n "duration": 5,\n "generate_audio": True,\n "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png",\n "last_image": "example_value",\n "prompt": "Use the provided image as the first frame.\\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.",\n "resolution": "720p",\n "seed": -1\n}\n\ngenerate_response = requests.post(generate_url, headers=headers, json=data)\ngenerate_result = generate_response.json()\nprediction_id = generate_result["data"]["id"]\n\n# Step 2: Poll for result\npoll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}"\n\ndef check_status():\n while True:\n response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"})\n result = response.json()\n\n if result["data"]["status"] in ["completed", "succeeded"]:\n print("Generated video:", result["data"]["outputs"][0])\n return result["data"]["outputs"][0]\n elif result["data"]["status"] == "failed":\n raise Exception(result["data"]["error"] or "Generation failed")\n else:\n # Still processing, wait 2 seconds\n time.sleep(2)\n\nvideo_url = check_status()\n

text

1plaintext\nimport requests\nimport time\n\n# Step 1: Start video generation\ngenerate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo"\nheaders = {\n "Content-Type": "application/json",\n "Authorization": "Bearer $ATLASCLOUD_API_KEY"\n}\ndata = {\n "model": "bytedance/seedance-v1.5-pro/image-to-video-fast",\n "aspect_ratio": "16:9",\n "camera_fixed": False,\n "duration": 5,\n "generate_audio": True,\n "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png",\n "last_image": "example_value",\n "prompt": "Use the provided image as the first frame.\\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.",\n "resolution": "720p",\n "seed": -1\n}\n\ngenerate_response = requests.post(generate_url, headers=headers, json=data)\ngenerate_result = generate_response.json()\nprediction_id = generate_result["data"]["id"]\n\n# Step 2: Poll for result\npoll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}"\n\ndef check_status():\n while True:\n response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"})\n result = response.json()\n\n if result["data"]["status"] in ["completed", "succeeded"]:\n print("Generated video:", result["data"]["outputs"][0])\n return result["data"]["outputs"][0]\n elif result["data"]["status"] == "failed":\n raise Exception(result["data"]["error"] or "Generation failed")\n else:\n # Still processing, wait 2 seconds\n time.sleep(2)\n\nvideo_url = check_status()\n