Ihr Prompt ist an einer Sperre gescheitert. Nicht, weil er schädlich war, sondern weil ein Schlüsselwort einen Filter ausgelöst hat.

Entwickler in der Ollama-Community bezeichnen dies als „Refusal Vectors“: durch Schlüsselwörter ausgelöste Blockaden, die nichts mit tatsächlichem Schaden zu tun haben. Reverse Engineering von Malware für die Sicherheitsforschung, Dokumentation medizinischer Fallstudien, Erstellung von Inhalten für Erwachsene, Schreiben von Dark Fiction. Mainstream-KI blockiert all diese Bereiche. Diese Liste bewertet die besten unzensierten KI-Modelle 2026 anhand echter Community-Daten, nicht nach Marketing-Texten. Sie deckt drei Kategorien ab: unzensierte LLM-Modelle für Text und Code, die besten unzensierten lokalen KI-Modelle 2026 für den Einsatz auf privater Hardware sowie unzensierte KI-Modelle 2026 für die Bild- und Videogenerierung via API. Alle Zahlen sind belegt und auf den Stand Mai 2026 datiert.

Für einen Einstieg in die breitere Tool-Landschaft finden Leser, die neu in diesem Bereich sind, den Leitfaden für unzensierte KI-Bildgeneratoren als nützlichen Ausgangspunkt, bevor sie ein spezifisches Modell auswählen.

Wie wir die besten unzensierten KI-Modelle 2026 bewertet haben

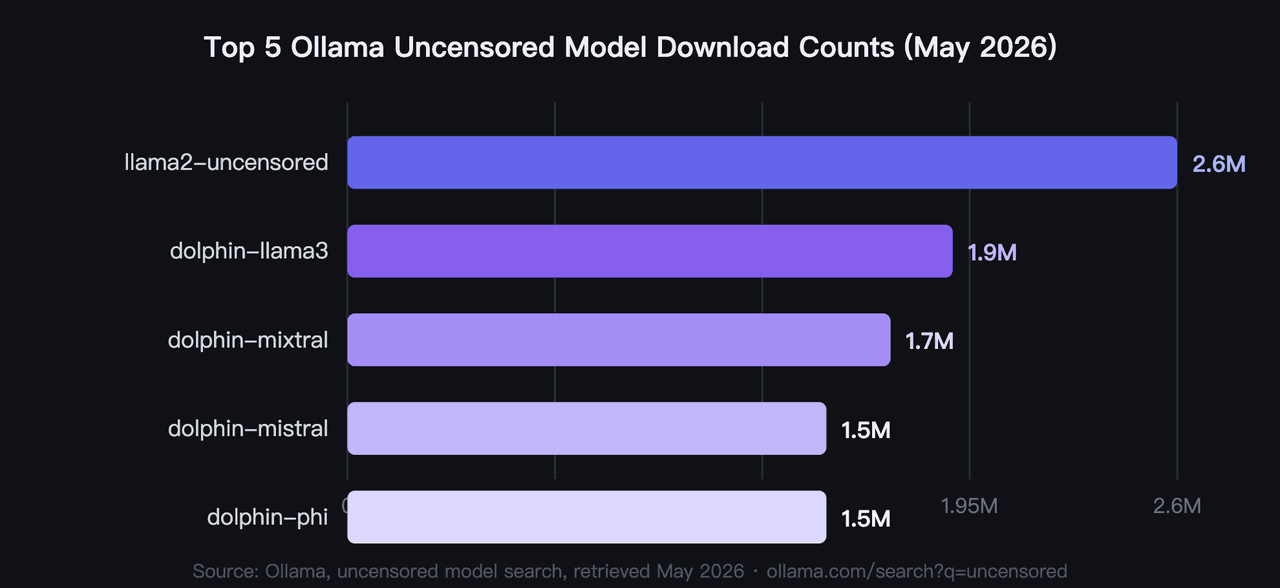

Im Jahr 2026 liefern Community-Downloadzahlen von Ollama ein zuverlässigeres Ranking-Signal als Benchmark-Ergebnisse, die eher für Pressemitteilungen als für die reale Leistung ausgewählt werden (Ollama, Suche nach unzensierten Modellen, 2026). Millionen von Downloads stehen für Tausende von Hardware-Setups und Prompt-Typen. Das ist schwieriger zu manipulieren als ein kuratierter Evaluations-Datensatz.

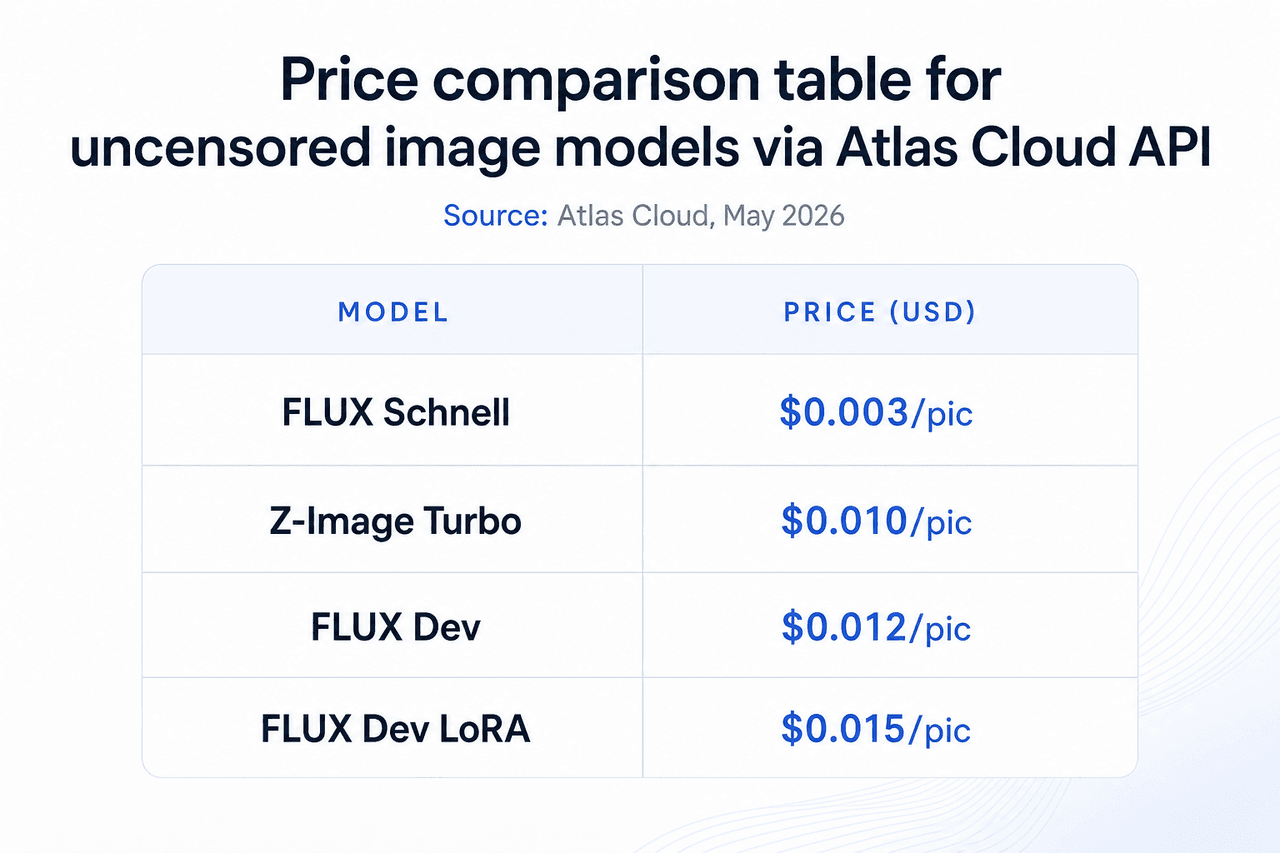

In diesem Artikel werden drei Ranking-Signale verwendet. Bei unzensierten Ollama-Modellen ist das primäre Signal die Download-Anzahl von ollama.com, Stand Mai 2026. Bei OpenRouter-Modellen basiert das Ranking auf der Parameteranzahl und dem Kontextfenster, da Downloadzahlen auf dieser Plattform nicht öffentlich zugänglich sind. Bei Bild- und Videomodellen basiert das Ranking auf dem Preis pro Ausgabe, wobei innerhalb jeder Gruppe die niedrigeren Kosten zuerst aufgeführt sind.

Die meisten unzensierten KI-Modelle 2026 fallen in zwei technische Kategorien: feinabgestimmt (fine-tuned) und „abliteriert“ (abliterated). Feinabgestimmte Modelle wie die Dolphin-Serie werden auf Datensätzen trainiert, die kein Ablehnungsverhalten verstärken. Bei abliterierten Modellen wurden die Ablehnungsgewichte chirurgisch entfernt. Die Community stuft feinabgestimmte Modelle durchweg als stabiler über verschiedene Prompt-Typen hinweg ein.

In der Praxis korrelieren Downloadzahlen auch mit der Modellstabilität. Ein Modell, das über 1 Million Downloads erreicht, wurde auf einer Vielzahl von Hardwarekonfigurationen getestet, wodurch Fehler und Instabilitäten aufgedeckt wurden, die kleineren Testgruppen entgangen wären.

Was sind die 5 am häufigsten heruntergeladenen unzensierten Ollama-Modelle?

Im Jahr 2026 kommen die fünf am häufigsten heruntergeladenen unzensierten Ollama-Modelle zusammen auf über 9,2 Millionen Downloads, wobei llama2-uncensored mit 2,6 Millionen anführt (Ollama, Suche nach unzensierten Modellen, 2026). Dies sind die besten unzensierten Ollama-Modelle 2026 nach Community-Validierung, nicht nach irgendeinem Benchmark. Hardware ist der primäre Filter, den die meisten Nutzer zuerst anwenden: Die VRAM-Anforderungen reichen in dieser Gruppe von unter 4 GB bis 40 GB.

1. llama2-uncensored: Das am häufigsten heruntergeladene unzensierte KI-Modell auf Ollama

Der ursprüngliche Community-Benchmark für unzensierte lokale KI. George Sung und Jarrad Hope veröffentlichten dieses Fine-Tune, um das Ablehnungsverhalten von Llama 2 zu entfernen, ohne die allgemeinen Fähigkeiten zu beeinträchtigen. Es ist das Modell, mit dem die meisten Entwickler beginnen, und seine 2,6 Millionen Downloads spiegeln über zwei Jahre realen Einsatz wider. Kein anderes unzensiertes LLM hat dieses Download-Volumen erreicht.

- Parameter: 7B oder 70B

- VRAM: ~6GB (7B); ~40GB (70B)

- Bestens geeignet für: Allzweck-Chat ohne Einschränkungen und Inhaltserstellung

- Plattform: Ollama

2. dolphin-llama3: Das beste unzensierte Llama 3 LLM-Modell für Agenten-Workflows

Eric Hartfords Dolphin auf einer Llama 3-Basis ist das am häufigsten heruntergeladene unzensierte Modell auf Basis einer modernen Architektur mit 1,9 Millionen Downloads (Ollama, Modellseite dolphin-llama3, 2026). Es unterstützt Funktionsaufrufe (Function Calling) und ein Kontextfenster, das je nach Konfiguration von 8K bis 256K Token reicht. Die 8B-Version wiegt 4,7 GB und passt auf die meisten Mid-Range-Consumer-GPUs.

- Parameter: 8B oder 70B

- VRAM: ~5GB (8B); ~40GB (70B)

- Bestens geeignet für: Programmierung, Agenten-Workflows und Funktionsaufrufe

- Plattform: Ollama

3. dolphin-mixtral 8x7B: Unzensiertes MoE-KI-Modell für komplexes Schlussfolgern

Eine Mixture-of-Experts-Architektur leitet jedes Token durch eine Teilmenge ihrer 8 Expertenebenen. Dies erzeugt eine Qualität beim Schlussfolgern, die fast der eines 70B-Modells entspricht, bei geringeren Inferenzkosten als bei einem dichten Modell mit äquivalenter Gesamtzahl an Parametern. Eric Hartfords unzensiertes Fine-Tune legt durchgehend einen starken Fokus auf Programmierung.

- Parameter: 8x7B (aktive Parameter pro Inferenzlauf sind weit geringer als die Gesamtzahl)

- VRAM: ~12-16GB mit Quantisierung

- Bestens geeignet für: Komplexe Programmieraufgaben, technisches Schlussfolgern und längere Anweisungsketten

- Plattform: Ollama

4. dolphin-mistral: Unzensiertes 7B lokales KI-Modell für schnelle Antworten

Leichter und schneller als dolphin-mixtral auf Hardware mit CPU-Beschränkungen. Es verzeichnet 1,5 Millionen Downloads von Entwicklern, die ein reaktionsschnelles lokales Modell für die Code-Vervollständigung suchen, ohne eine High-End-GPU zu benötigen. Die Basisarchitektur Mistral verleiht ihm ein starkes Verhältnis von Leistung zu Größe für ein 7B-Modell.

- Parameter: 7B

- VRAM: ~5-6GB

- Bestens geeignet für: Leichte Programmierungshilfe und schnelle Chat-Antworten

- Plattform: Ollama

5. dolphin-phi 2.7B: Das leichteste unzensierte lokale KI-Modell

Die Phi-Basisarchitektur von Microsoft packt leistungsfähiges Schlussfolgern in eine Parameterzahl von 2,7B. Eric Hartfords unzensiertes Fine-Tune bewahrt diese Effizienz. Mit unter 4 GB VRAM läuft es auf den meisten Consumer-Laptops mit diskreter GPU, was es zum zugänglichen Einstiegspunkt für die besten unzensierten lokalen KI-Modelle 2026 macht.

- Parameter: 2,7B

- VRAM: Unter 4GB

- Bestens geeignet für: Laptop-Einsatz, schnelles Testen und hardwarebeschränkte Umgebungen

- Plattform: Ollama

Beste unzensierte LLM-Modelle 6-10: Programmierung, Rollenspiele und langer Kontext

Im Jahr 2026 belegt die Dolphin-Serie 5 der Top-10-Plätze im unzensierten Katalog von Ollama nach Downloadzahlen – eine Konzentration, die Eric Hartfords konsistente Fine-Tuning-Methodik über verschiedene Basisarchitekturen hinweg widerspiegelt (Ollama, Modellseite hermes3, 2026). Die Modelle 6 bis 10 decken Rollenspiele, allgemeine Konversation, Entwicklertools, Anweisungsbefolgung und erweiterten Kontext ab: die Anwendungsfälle, in denen die Ablehnungen von Mainstream-KI am störendsten sind.

6. hermes3: Unzensiertes KI-Modell für Rollenspiele und Agenten-Aufgaben

Nous Research hat hermes3 für die Tiefe von Rollenspielen und strukturierte Tool-Nutzung entwickelt. Es ist in vier Größen von 3B bis 405B erhältlich – die größte Auswahl an Modellgrößen in dieser Liste. Mit 1,3 Millionen Downloads befindet sich die 8B-Variante an einem praktischen Punkt für kreatives Schreiben und Workflows zur Agentenplanung (Ollama, Modellseite hermes3, 2026).

- Parameter: 3B, 8B, 70B oder 405B

- VRAM: ~2GB (3B); ~5GB (8B); ~40GB (70B)

- Bestens geeignet für: Rollenspiele, kreative Belletristik und Planung von Agenten-Aufgaben

- Plattform: Ollama

7. wizard-vicuna-uncensored: Unzensiertes Multi-Größen-KI-Modell für den allgemeinen Gebrauch

Ein älteres, aber bewährtes Modell auf Llama 2-Basis, erhältlich in drei Größen bis zu 30B. Seine 1,2 Millionen Downloads stammen von Nutzern, die eine zuverlässige unzensierte Option mit einer größeren Parameter-Bandbreite suchen. Es erreicht nicht die Fähigkeiten des Kontextfensters von dolphin-llama3, bewältigt aber allgemeine Konversationen und kreative Inhalte konsistent.

- Parameter: 7B, 13B oder 30B

- VRAM: ~5GB (7B); ~9GB (13B); ~20GB (30B)

- Bestens geeignet für: Allgemeine Konversation und kreative Inhalte mit verschiedenen Größenoptionen

- Plattform: Ollama

8. dolphincoder: Unzensiertes KI-Programmiermodell auf StarCoder2-Basis

StarCoder2 als Basis macht dolphincoder zu einem echten Spezialisten. Während andere Dolphin-Modelle Generalisten mit unzensiertem Fine-Tuning sind, zielt dieses spezifisch auf die Softwareentwicklung ab. Seine 943.000 Downloads stammen fast ausschließlich von Entwicklern, nicht von kreativen Nutzern. Die 15B-Variante bewältigt größere Codebasen, als die 7B es kann.

- Parameter: 7B oder 15B

- VRAM: ~5GB (7B); ~10GB (15B)

- Bestens geeignet für: Code-Generierung, Debugging und technische Dokumentation

- Plattform: Ollama

9. wizardlm-uncensored: Unzensiertes, anweisungsfolgendes LLM für Forschungs-Workflows

Ein 13B-Modell, das Anweisungen befolgt, mit 610.000 Downloads. Seine Stärke liegt darin, komplexe, mehrstufige Anweisungen zu befolgen, ohne Ausweichmanöver oder Ablehnungen von Teilaufgaben. In Forschungs-Workflows, in denen eine einzige Ablehnung eine lange Kette unterbricht, hat diese Zuverlässigkeit einen direkten Produktivitätswert. Es verfügt nicht über die moderne Basisarchitektur von dolphin-llama3, erfüllt aber die Anweisungsaufgabe konsistent.

- Parameter: 13B

- VRAM: ~9GB

- Bestens geeignet für: Komplexe mehrstufige Anweisungsketten und Forschungs-Workflows

- Plattform: Ollama

10. everythinglm: Unzensiertes LLM mit 16K Kontextfenster

Das herausragende Merkmal ist hier das 16K-Kontextfenster auf einer Llama 2-Basis. Die meisten 7B-Modelle kommen auf maximal 4K oder 8K Token. Dieser zusätzliche Kontext erlaubt es everythinglm, vollständige Codebasen, lange Dokumente oder umfangreiche Konversationsverläufe ohne Kürzung zu verarbeiten. Seine 536.000 Downloads sind nach den Standards dieser Liste bescheiden, aber es schließt eine Lücke, die kein anderes Modell hier in dieser Größe abdeckt.

- Parameter: 13B

- VRAM: ~9GB

- Bestens geeignet für: Analyse langer Dokumente, Chat mit erweitertem Kontext und Überprüfung vollständiger Codebasen

- Plattform: Ollama

Die Dominanz der Dolphin-Serie bei den Ollama-Downloadzahlen spiegelt ein Muster wider, das die Community dokumentiert hat: Feinabgestimmte unzensierte Modelle von einem einzigen Autor mit einer konsistenten Methodik übertreffen punktuelle Abliterationsversuche. Die Abliteration entfernt Ablehnungsgewichte von einem einzelnen Modell. Fine-Tuning baut stabiles unzensiertes Verhalten über verschiedene Prompt-Typen hinweg auf. Diese Konsistenz ist der Grund, warum 5 der Top-10-Plätze auf Eric Hartfords Arbeit entfallen und nicht auf eine einzige Basisarchitektur.

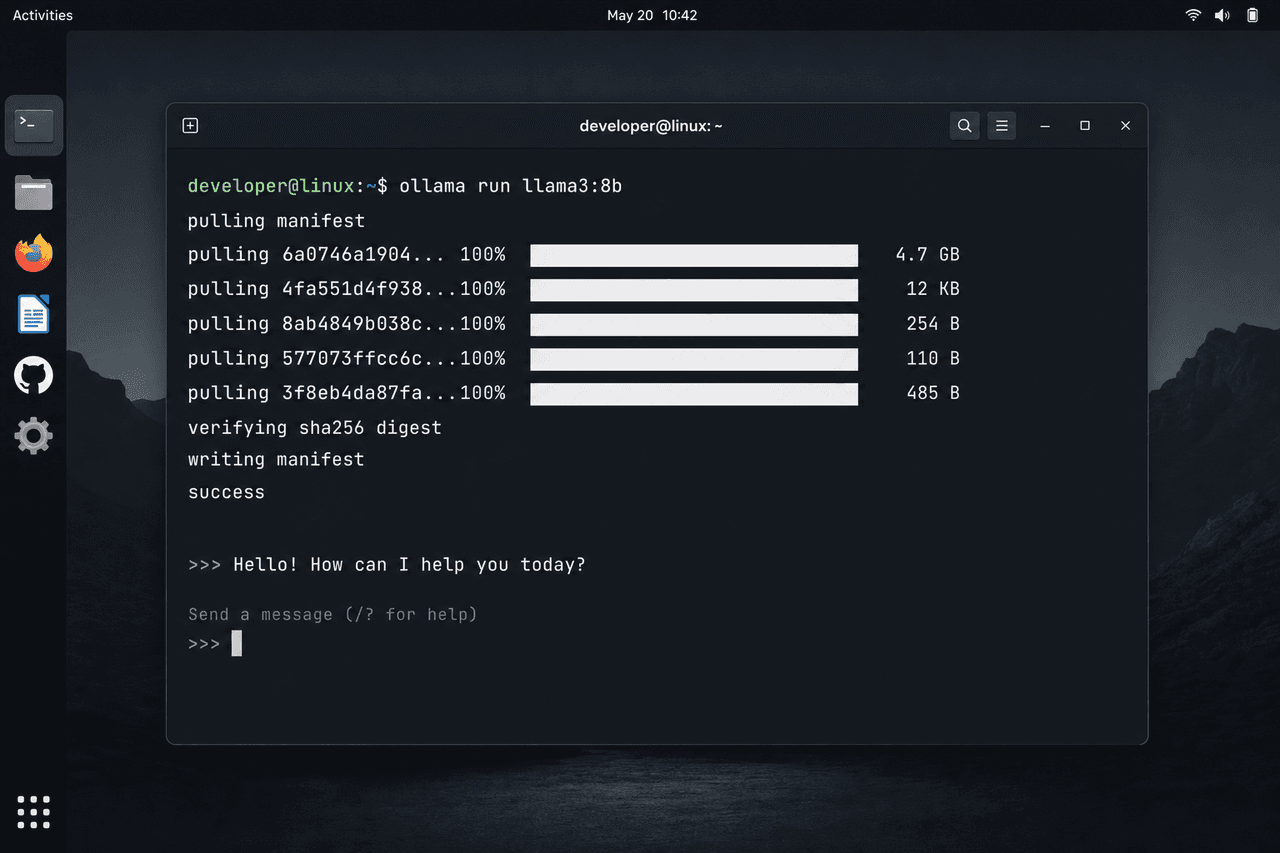

Wie richtet man unzensierte Ollama-Modelle lokal ein?

Im Jahr 2026 installieren drei Befehle jedes Ollama-Modell unter Mac, Linux oder Windows: Installieren Sie Ollama von ollama.com, führen Sie

1ollama pull [Modellname]1ollama run [Modellname]Als konkretes Beispiel für dolphin-llama3:

1ollama pull dolphin-llama31ollama run dolphin-llama3LM Studio bietet eine Desktop-GUI für Nutzer, die lieber nicht im Terminal arbeiten. Es nutzt dieselben GGUF-Modelldateien wie Ollama, mit einer visuellen Schnittstelle für die Modellauswahl und Parameteranpassung. llama.cpp ist die zugrunde liegende Inferenz-Engine beider Tools und unterstützt die direkte Verwendung über die Befehlszeile, wenn Sie mehr Kontrolle über Quantisierungsstufen und Kontextlängeneinstellungen benötigen.

Entwickler, die spezifische Hardwareanforderungen und Quantisierungseinstellungen für den Betrieb der besten unzensierten lokalen KI-Modelle 2026 auf Consumer-GPUs suchen, finden im vollständigen lokalen Setup-Leitfaden detaillierte Informationen zu minimalen VRAM-Konfigurationen und häufigen Einrichtungsfehlern.

Welche unzensierten OpenRouter-Modelle sind ohne lokale GPU verfügbar?

Im Jahr 2026 hostet OpenRouter unzensierte LLMs via API, was die GPU-Anforderung komplett eliminiert. Das Modell

1venice/uncensoredDer Kompromiss ist direkt: OpenRouter leitet Ihren Prompt durch deren Infrastruktur, daher ist die Konversation nicht so privat wie bei einem lokalen Modell. Lokale Ollama-Modelle behalten alles auf Ihrem Gerät. Kein Ansatz ist universell besser. Die richtige Wahl hängt von Ihrem Bedrohungsmodell und der Hardwareverfügbarkeit ab.

11. venice/uncensored: Kostenloses unzensiertes OpenRouter-Modell

Das Venice Uncensored-Modell in der kostenlosen Stufe von OpenRouter. Eine 24B Mistral-Small-Basis, feinabgestimmt für unzensierte Ausgabe von Cognitive Computations in Zusammenarbeit mit Venice.ai. 32K Kontextfenster, USD 0 pro Million Token. Die kostenlose Stufe von OpenRouter wendet eine plattformweite Begrenzung von 200 Anfragen pro Tag für kostenlose Modelle an.

- Parameter: 24B

- VRAM: Nicht erforderlich (cloud-gehostet)

- Bestens geeignet für: Testen von unzensierten LLMs ohne lokale Hardware; kostenlos innerhalb der plattformweiten Ratenbegrenzungen

- Plattform: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B: Großes unzensiertes Modell via OpenRouter

Ein 70B-Modell für kreative Rollenspiele und Anweisungsbefolgung von Sao10k, feinabgestimmt für unzensierte Ausgaben. Basiert auf Llama 3.3 70B mit 131K Kontext. Aktiv gepflegt mit realer Nutzung auf OpenRouter und per Namen in der globalen Suche der Plattform findbar.

- Parameter: 70B

- VRAM: Nicht erforderlich (cloud-gehostet)

- Bestens geeignet für: Komplexes kreatives Schreiben, Rollenspiele und lange Anweisungsketten ohne lokale Hardware

- Plattform: OpenRouter

13. Sao10K: Llama 3 8B Lunaris: Leichtes unzensiertes Modell via OpenRouter

Lunaris 8B ist ein vielseitiger Generalist und ein Rollenspielmodell von Sao10k, basierend auf Llama 3 8B. Es ist eine strategische Zusammenführung mehrerer Modelle, die darauf ausgelegt ist, Kreativität mit verbesserter Logik und Allgemeinwissen in Einklang zu bringen, und bietet eine verbesserte Erfahrung gegenüber Stheno v3.2 mit gesteigerter Kreativität und Schlussfolgerung. Die kostengünstigste unzensierte Option auf OpenRouter für USD 0,04/USD 0,05 pro Million Token, mit über 6 Milliarden Token realer Nutzung auf der Plattform.

- Parameter: 8B

- VRAM: Nicht erforderlich (cloud-gehostet)

- Bestens geeignet für: Leichte unzensierte Konversation und kreatives Schreiben zu minimalen Kosten

- Plattform: OpenRouter

14. TheDrummer: Cydonia 24B V4.1: Unzensiertes Modell für kreatives Schreiben via OpenRouter

Cydonia 24B V4.1 ist ein unzensiertes Modell für kreatives Schreiben von TheDrummer, basierend auf Mistral Small 3.2 24B, mit gutem Erinnerungsvermögen, Prompt-Einhaltung und Intelligenz. 131K Kontextfenster. Aktiv gepflegt und direkt per Namen in der globalen Suche von OpenRouter findbar.

- Parameter: 24B

- VRAM: Nicht erforderlich (cloud-gehostet)

- Bestens geeignet für: Unzensiertes kreatives Schreiben und Rollenspiele ohne lokale Hardware

- Plattform: OpenRouter

Wie man über Atlas Cloud auf unzensierte Bild- und Videomodelle zugreift

Im Jahr 2026 erfordern die meisten unzensierten Bild- und Videomodelle entweder lokale GPU-Hardware oder eine dedizierte API-Plattform, da Mainstream-Cloud-Anbieter Inhaltsfilter anwenden, die NSFW-Ausgaben auf Inferenzebene blockieren. Atlas Cloud ist eine Modell-API-Plattform, die speziell dafür entwickelt wurde, diese Einschränkung aufzuheben, und über 300 kuratierte Modelle für Text, Bild, Video und Audio abdeckt.

Der Einstieg erfordert drei Schritte:

- Erstellen Sie ein Konto bei atlascloud.ai

- Generieren Sie einen API-Key über das Dashboard

- Rufen Sie den Modell-Endpunkt mit dem Key auf – Bild- und Videomodelle verwenden ihr eigenes REST-Format; LLM-Endpunkte folgen dem OpenAI Chat Completions-Format.

Was Atlas Cloud spezifisch für unzensierte Anwendungsfälle relevant macht:

- Die Datenschutzrichtlinie der Plattform besagt: „Ihre generierten Inhalte werden niemals zum Training verwendet und niemals von irgendjemandem überprüft.“ Dies ist eine veröffentlichte, explizite Verpflichtung, keine Standardannahme.

- Es gilt kein tägliches Limit für die Generierung für irgendein Modell im Katalog.

- Der Katalog für unzensierte Bilder umfasst 33 Text-zu-Bild-Modelle ab USD 0,003 pro Bild.

- Der Katalog für unzensierte Videos umfasst 10+ NSFW-Videomodelle ab USD 0,01/Sekunde.

Der vollständige Katalog unzensierter Modelle kann unter atlascloud.ai/models/explore/uncensored durchsucht werden. Die Modelle 15 bis 20 in dieser Liste sind alle über einen einzigen Atlas Cloud API-Key zugänglich.

Was sind die besten unzensierten KI-Bildmodelle für NSFW-Inhalte und Inhalte für Erwachsene?

Im Jahr 2026 treibt die FLUX-Architektur die Mehrheit der hochwertigen unzensierten Bildgenerierung an, verfügbar via Atlas Cloud API über Preis- und Qualitätsstufen hinweg (Atlas Cloud, Liste der Text-zu-Bild-Modelle, 2026). Der Katalog von Atlas Cloud umfasst insgesamt 33 Text-zu-Bild-Modelle. Anwendungsfälle umfassen bildende Kunst, Charakterdesign, unzensierte Lingerie-Models und die Generierung von Porträts für Erwachsene, die Erstellung von Spiele-Assets und Stapelillustrationen in großem Umfang.

Die Homepage von Atlas Cloud gibt an: „Über 300 kuratierte Modelle für Text, Bild, Video und Audio“, und die Datenschutzrichtlinie der Plattform für ihren unzensierten Katalog lautet: „Ihre generierten Inhalte werden niemals zum Training verwendet und niemals von irgendjemandem überprüft.“

Für eine vollständige Aufschlüsselung browserbasierter und API-basierter unzensierter Bild-Tools deckt der Leitfaden für die besten unzensierten KI-Bildgeneratoren beide Kategorien mit Fähigkeitsvergleichen ab. Entwickler, die sich speziell auf die FLUX-Architektur konzentrieren, können den Leitfaden für unzensierte FLUX-Bildgeneratoren für Details zu Fine-Tuning und Workflows lesen.

15. FLUX Schnell: Schnellstes unzensiertes KI-Bildmodell für die Stapelverarbeitung

Die kostengünstigste Option im Atlas Cloud-Bildkatalog. Mit USD 0,003 pro Bild ist es das richtige Tool für Workflows mit Stapelgenerierung, bei denen Geschwindigkeit und Volumen wichtiger sind als feine Details. Es gilt kein Tageslimit, und es werden keine Inhalte für das Training gespeichert.

- Preis: USD 0,003/Bild

- VRAM: Nicht erforderlich (API-Zugriff)

- Bestens geeignet für: Stapelgenerierung von Bildern, Rapid Prototyping und unzensierte Ausgaben mit hohem Volumen

- Plattform: Atlas Cloud API

Bei USD 0,003 pro Bild erzeugt ein Budget von USD 3,00 1.000 Bilder. Diese Kosten pro Ausgabe sind niedriger als die Cloud-Speichergebühren für die resultierenden Dateien bei den meisten Anbietern. Das verändert die Wirtschaftlichkeit für Studios, die zuvor über Nacht teure lokale GPU-Rigs für die Stapelgenerierung betrieben haben: Der API-Ansatz ist jetzt sowohl billiger als auch schneller für Volumenarbeit.

16. FLUX Dev: Hochwertigstes unzensiertes KI-Bildmodell für die finale Produktion

Vierfache Kosten von FLUX Schnell, mit spürbar besserer Anatomie, Beleuchtung und Texturdetails. Für Ausgaben in finaler Qualität, bei denen einzelne Bilder wichtig sind, ist der Preispunkt von USD 0,012 ein praktischer Schritt nach oben. Er eignet sich für Portfolio-Stücke, kommerzielle Inhalte für Erwachsene und Produktions-Assets, bei denen Qualität die primäre Einschränkung ist.

- Preis: USD 0,012/Bild

- VRAM: Nicht erforderlich (API-Zugriff)

- Bestens geeignet für: Hochwertige Einzelbilder, Portfolio-Stücke und finale Produktions-Assets

- Plattform: Atlas Cloud API

17. FLUX Dev LoRA: Unzensiertes Bildmodell mit individuellem Stil-Training

LoRA-Fine-Tuning injiziert einen benutzerdefinierten Stil, ein Charakter-Erscheinungsbild oder ein Subjekt in die FLUX Dev-Basis. Dies ist das Modell, das Sie verwenden sollten, wenn Sie ein konsistentes Charakter-Erscheinungsbild über eine Charge hinweg benötigen oder einen Hausstil auf jedes Bild in einem Set anwenden möchten. Atlas Cloud handhabt das LoRA-Laden serverseitig.

- Preis: USD 0,015/Bild

- VRAM: Nicht erforderlich (API-Zugriff)

- Bestens geeignet für: Charakterkonsistenz, Training individueller Stile und gebrandete Bildserien

- Plattform: Atlas Cloud API

18. Z-Image Turbo: Budget-unzensiertes KI-Bildmodell bei mittlerer Qualitätsstufe

Positioniert zwischen FLUX Schnell und FLUX Dev auf der Preis-Qualitäts-Kurve. Mit USD 0,01 pro Bild bietet Z-Image Turbo eine andere Architektur, die auf Geschwindigkeit optimiert ist, ohne die Bildvereinfachung, die Schnell zu seinem niedrigeren Preispunkt vornimmt. Die praktische Wahl, wenn die Qualität von Schnell nicht ausreicht und die Kosten von FLUX Dev für das benötigte Volumen zu hoch sind.

- Preis: USD 0,01/Bild

- VRAM: Nicht erforderlich (API-Zugriff)

- Bestens geeignet für: Generierung mit moderatem Volumen, bei der Qualität und Kosten ausgeglichen werden müssen

- Plattform: Atlas Cloud API

Was sind die besten unzensierten KI-Videomodelle für NSFW-Animationen im Jahr 2026?

Im Jahr 2026 erfordert unzensierte Videogenerierung einen separaten Prozess als die Bildgenerierung, da Mainstream-Videoplattformen identische Inhaltsfilter anwenden und sich weigern, NSFW-Inhalte zu animieren, selbst wenn das Quellbild an anderer Stelle generiert wurde (Atlas Cloud, unzensierter Modellkatalog, 2026). Die unzensierte Videoseite von Atlas Cloud trägt die Überschrift „Unbeschränkte kreative Freiheit. Keine Filter. Keine Grenzen.“ und umfasst 10+ NSFW-Videomodelle, wobei der vollständige Katalog auch Varianten der Wan 2.6-, Wan 2.5- und Van-Serie enthält.

19. Wan 2.2 Turbo Spicy Infinite I2V: Kostengünstigstes unzensiertes Videomodell

Die Einstiegsoption für NSFW-Animationen aus einem Standbild. Mit USD 0,01/Sekunde ist es der kosteneffizienteste Weg, ein statisches Bild in NSFW-Videoinhalte zu animieren. Die Auflösung erreicht 1080p mit variabler Clip-Dauer, was es zum richtigen Ausgangspunkt für budgetbewusste Produktions-Pipelines macht.

- Preis: USD 0,01/Sekunde

- Auflösung: 1080p

- Dauer: Variabel

- Bestens geeignet für: Kosteneffiziente NSFW-Animation und Vorschau von Bewegungskonzepten

- Plattform: Atlas Cloud API

20. Seedance v1.5 Spicy: Hochwertigstes unzensiertes Videomodell für das finale Ergebnis

Die Option mit Kinoqualität im Katalog. Mit USD 0,049/Sekunde kostet es etwa 2,5-mal mehr als Wan 2.2 Turbo Spicy Infinite, produziert aber flüssigere Bewegungen, bessere Subjektkohärenz über Einzelbilder hinweg und natürlichere Übergänge. Für NSFW-Videoausgaben in finaler Qualität, bei denen die visuelle Wiedergabetreue das primäre Anliegen ist, ist dies die Top-Option im unzensierten Video-Lineup von Atlas Cloud.

- Preis: USD 0,049/Sekunde

- Auflösung: 720p

- Dauer: 5s

- Bestens geeignet für: NSFW-Videos in finaler Qualität, professionelle Inhalte für Erwachsene und auslieferungsbereite Ergebnisse

- Plattform: Atlas Cloud API

Der Leitfaden für die besten unzensierten KI-Videogeneratoren deckt den vollständigen Katalog der Varianten der Serien Wan 2.7 und Wan 2.2 Spicy mit allen Dauer- und Auflösungsoptionen ab.

Kurzanleitung zur Auswahl unzensierter KI-Modelle

| Bedarf | Empfohlen |

|---|---|

| Bestes unzensiertes LLM insgesamt | llama2-uncensored oder dolphin-llama3 |

| Programmieraufgaben | dolphin-mixtral 8x7B oder dolphincoder |

| Rollenspiele und kreatives Schreiben | hermes3 |

| Unter 4GB VRAM | dolphin-phi 2.7B |

| Unzensierte Bildgenerierung | FLUX Schnell via Atlas Cloud (USD 0,003/Bild) |

| NSFW-Video aus Bild | Wan 2.2 Turbo Spicy Infinite via Atlas Cloud (USD 0,01/Sekunde) |

FAQ zu unzensierten KI-Modellen

Was ist das unzensierteste KI-Modell im Jahr 2026?

Nach den Ollama-Downloadzahlen führt

1llama2-uncensored1dolphin-llama3Welche unzensierten Modelle laufen auf Ollama?

Zehn Modelle aus dieser Liste laufen als unzensierte Ollama-Modelle: llama2-uncensored, dolphin-llama3, dolphin-mixtral, dolphin-mistral, dolphin-phi, hermes3, wizard-vicuna-uncensored, dolphincoder, wizardlm-uncensored und everythinglm. Das Community-Modell

1jaahas/qwen3.5-uncensored1ollama pull [Modellname]Welche unzensierten Modelle sind auf OpenRouter verfügbar?

Im Jahr 2026 hostet OpenRouter unzensierte LLMs via API, was die GPU-Anforderung komplett eliminiert. Zu den Optionen gehören das Modell der kostenlosen Stufe

1venice/uncensoredWas ist der Unterschied zwischen einem abliterierten und einem feinabgestimmten unzensierten Modell?

Die Abliteration entfernt Ablehnungsgewichte chirurgisch auf Gewichtsebene aus einem Modell. Feinabgestimmte unzensierte Modelle wie die Dolphin-Serie werden auf Datensätzen trainiert, die ein Ablehnungsverhalten gar nicht erst verstärken. Die Community stuft feinabgestimmte Modelle durchweg als stabiler ein: Abliteration kann über verschiedene Prompt-Typen hinweg zu inkonsistenten Ausgaben führen, während Fine-Tuning zuverlässige Ergebnisse liefert, was erklärt, warum Dolphin-Modelle die Downloadzahlen für unzensierte Ollama-Modelle dominieren.

Kann ich unzensierte KI-Modelle lokal auf einem Laptop ausführen?

Ja.

1dolphin-phi 2.7BFazit

Das beste unzensierte KI-Modell 2026 hängt vollständig von Ihrem Anwendungsfall ab. Für allgemeine LLM-Arbeiten ist

1dolphin-llama31dolphin-phi1venice/uncensored1FLUX SchnellLeser, die einen vollständigen Überblick über unzensierte KI-Tools für Bilder, Videos und Editoren suchen, finden im Leitfaden für unzensierte KI-Bildgeneratoren die gesamte Landschaft abgedeckt.