OpenAI Sora 2 ist ein hochmodernes Modell für die KI-Videogenerierung, insbesondere im Bereich der physikalischen Simulation. Objekte fallen, prallen ab, zerbrechen und interagieren mit ihrer Umgebung auf eine Weise, die absolut glaubwürdig erscheint – eine Leistung, die bisher kein Konkurrenzmodell in vollem Umfang erreicht hat. Dieses Sora 2-Tutorial behandelt alles, was Sie als Entwickler wissen müssen, um Sora 2 über die Sora 2 Atlas Cloud API in Ihren Workflow zu integrieren, einschließlich Preisgestaltung, Python-Codebeispielen, Prompt-Engineering und einem direkten Vergleich mit Seedance 2.0, Kling 3.0 und Veo 3.1.

Sehen Sie Sora 2 in Aktion:Die Sora 2 API ist über Atlas Cloud für 0,15 proSekundegeneriertemVideozuga¨nglich.Atlasbietetzudem1pro Sekunde generiertem Video zugänglich. Atlas bietet zudem 1proSekundegeneriertemVideozuga¨nglich.Atlasbietetzudem1 Startguthaben bei der Anmeldung. Atlas-Kunden können mit einem einzigen API-Key auf Sora 2 sowie über 300 weitere Modelle zugreifen, ohne separate Konten bei OpenAI, Kuaishou, ByteDance und Google führen zu müssen.

Sora 2 auf einen Blick

- Entwickler: OpenAI

- Modell-ID: text

1openai/sora-2/text-to-video-pro-developer - Maximale Auflösung: High Definition

- Maximale Dauer: 12 Sekunden

- Bildrate: 30fps

- Native Audio-Unterstützung: Ja

- Referenz-Input: 1 Bild

- Kernstärke: Physikalische Simulation, realistische Objektinteraktionen

- Atlas Cloud Preis: 0,15 $/Sek.

Hauptfunktionen von Sora 2

Physikalische Simulation

Auch in diesem Bereich setzt sich Sora 2 deutlich von der Konkurrenz ab. Schwerkraft, Impuls, Fluiddynamik und Kollisionsdynamik werden mit einer Genauigkeit simuliert, die andere Modelle nicht konsistent reproduzieren können. Geben Sie einen Prompt ein, der eine Bowlingkugel beschreibt, die auf einige Pins trifft, und das Ergebnis zeigt die korrekte Kraftverteilung, Streumuster der Pins und den Bewegungsablauf. Kling 3.0 und Seedance 2.0 schätzen diese Interaktionen größtenteils; Sora 2 simuliert sie.

Realistische Objektinteraktionen

Sora 2-Modelle verfügen zudem über ein physikalisches Verständnis, das über den Fall eines einzelnen Objekts hinausgeht. Das Eingießen einer Flüssigkeit in ein Glas, das Stapeln von Blöcken, die kippen und fallen, oder eine Katze, die Dinge vom Tisch stößt – all dies erfordert kausales Denken darüber, wie Objekte miteinander interagieren. Sora 2-Modelle zeigen eine größere Robustheit gegenüber komplexen Multi-Objekt-Interaktionen als jedes andere bisher über öffentliche APIs verfügbare Modell.

Material- und Oberflächen-Rendering

Glas, Metall, Wasser, Stoff und Holz verhalten sich in den Ausgaben von Sora 2 mit einzigartigen physikalischen Eigenschaften. Licht bricht sich, wenn es durch transparente Medien fällt. Spiegel erfassen und verzerren ihre Umgebung. Stoffe hängen und falten sich mit entsprechendem Gewicht. Dieses Maß an Materialtreue trägt zur allgemeinen Glaubwürdigkeit bei, die die Ergebnisse von Sora 2 auszeichnet.

Native Audio-Generierung

Sora 2 kann zusammen mit dem Video Audio erzeugen. Schritte haben den richtigen Rhythmus beim Gehen, Aufprallereignisse haben die passenden Klänge und die Hintergrundgeräusche passen zum Szenario. Die Audioqualität ist zwar nicht auf Produktionsniveau, bietet aber eine nützliche Basis, die in vielen Workflows einen zusätzlichen Arbeitsschritt einspart.

Zeitliche Kohärenz

Über die gesamte maximale Länge von 12 Sekunden zeigt Sora 2 ein hohes Maß an interner Konsistenz in Bezug auf Beleuchtung, Charakterdarstellung und Hintergrunddetails. Objekte verändern ihre Farbe oder Form nicht von Frame zu Frame. Schatten folgen Lichtquellen während des gesamten Clips korrekt. Dieses Maß an Kontinuität ist besonders wichtig für Aufnahmen mit langsamen, methodischen Bewegungen, die bei Unstimmigkeiten schnell störend wirken würden.

Sora 2 Preisgestaltung

Offizieller Zugriff auf OpenAI Sora 2

Der Zugriff auf OpenAI Sora 2 wird durch ChatGPT als Teil des Plus-Abonnements (20 /Monat)oderPro−Abonnements(200/Monat) oder Pro-Abonnements (200 /Monat)oderPro−Abonnements(200/Monat) mit strengen Einschränkungen gewährt. Während Nutzer des Plus-Abonnements eine begrenzte Anzahl an Generierungen pro Monat erhalten, kann es zu Stoßzeiten zu langen Wartezeiten kommen. Der Zugriff über die direkte API von OpenAI ist ebenfalls möglich, steht jedoch nur Entwicklerkonten zur Verfügung, die von OpenAI genehmigt wurden, und Sora 2 wird zu einem höheren Premium-Preis angeboten.

Atlas Cloud API Preisgestaltung (Empfohlen)

Der einfachste Weg für Entwickler, auf die Sora 2 API zuzugreifen, ist Atlas Cloud:

- Modell: text

1openai/sora-2/text-to-video-pro-developer - Preis: 0,15 $/Sek.

- 10-Sekunden-Clip: 1,50 $

- 12-Sekunden-Clip (max): 1,80 $

- Kostenloses Startguthaben: 1,00 $

- Warteschlange: Keine Wartezeiten

Das 1 $ Startguthaben entspricht etwa 6 Sekunden Sora 2-Video – ideal, um die Qualität und physikalische Genauigkeit zu testen, bevor man sich entscheidet, mehr gegen Gebühr zu nutzen. Bei der Sora 2-Preisgestaltung skalieren die Kosten linear und sehr vorhersehbar für Teams, die in großem Maßstab produzieren.

Sora 2 API auf Atlas Cloud nutzen -- 1 $ kostenloses Guthaben

So greifen Sie auf die Sora 2 API zu

Option 1: OpenAI direkt

Sora 2 ist für Benutzer über die offiziellen Wege von OpenAI zugänglich, d. h. über ChatGPT-Abonnements oder die Entwickler-API. Der Zugriff auf die Entwickler-API setzt ein genehmigtes Konto voraus und verursacht höhere Kosten pro Generierung. Die Dokumentation finden Sie unter platform.openai.com, wobei der Onboarding-Prozess eine Genehmigung durch eine Warteliste für Video-Generierungs-Endpunkte beinhaltet.

Option 2: Atlas Cloud (Empfohlen)

Für viele Entwickler führt der schnellste Weg zur Produktion über die Sora 2 Atlas Cloud-Integration. Ein API-Key für die Power von OpenAI Sora 2 und über 300 weitere Modelle, einschließlich Seedance 2.0, Kling 3.0 und Veo 3.1. Keine Warteliste. Keine separaten Konten. Eine zentrale Abrechnung.

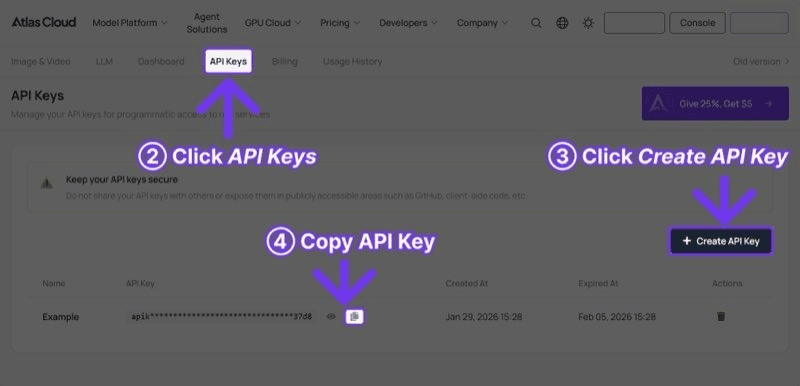

Schritt 1: Melden Sie sich auf atlascloud.ai (https://www.atlascloud.ai?utm_medium=article&utm_source=blog&utm_campaign=sora-2-guide) an und holen Sie sich Ihren API-Key aus dem Dashboard. 1 $ kostenloses Guthaben wird Ihrem Konto automatisch gutgeschrieben.

Schritt 2: Video mit Sora 2 in Python generieren:

python1import requests 2import time 3 4 5API_KEY = "your-atlas-cloud-api-key" 6BASE_URL = "https://api.atlascloud.ai/api/v1" 7 8 9# Video mit Sora 2 generieren 10response = requests.post( 11 f"{BASE_URL}/model/generateVideo", 12 headers={ 13 "Authorization": f"Bearer {API_KEY}", 14 "Content-Type": "application/json" 15 }, 16 json={ 17 "model": "openai/sora-2/text-to-video-pro-developer", 18 "prompt": "Eine Glaskugel rollt eine Holztreppe hinunter, jeder Aufprall erzeugt Lichtreflexionen, realistische Physik und Reflexionen, filmische Zeitlupe", 19 "duration": 10, 20 "resolution": "1080p" 21 } 22) 23 24 25result = response.json() 26 27 28# Auf Ergebnisse warten 29while True: 30 status = requests.get( 31 f"{BASE_URL}/model/prediction/{result['request_id']}/get", 32 headers={"Authorization": f"Bearer {API_KEY}"} 33 ).json() 34 if status["status"] == "completed": 35 print(f"Video: {status['output']['video_url']}") 36 break 37 time.sleep(5)

Schritt 3: Die API gibt sofort eine

1request_id1completedSora 2 Prompt-Tipps

Nach umfangreichen Tests mit der Sora 2 API enthält dieser Abschnitt des Tutorials verschiedene Prompting-Methoden, die zuverlässig zu qualitativ hochwertigen Ergebnissen geführt haben. Sora 2 glänzt bei Prompts, die auf physikalische Interaktionen und Materialverhalten fokussiert sind.

- Seien Sie explizit bei der Physik. Die mächtigste Engine unter Sora 2 ist die physikalische Simulation, nutzen Sie diese aus. Statt nur "ein Ball hüpft", sagen Sie "ein Gummiball fällt aus Schulterhöhe auf einen Hartholzboden, hüpft 3 Mal mit abnehmender Höhe, realistische Elastizität und Schattenbewegung". Das Modell reagiert gut auf physikspezifische Details.

- Beschreiben Sie Materialien und Oberflächen. Sora 2 simuliert Materialien mit unterschiedlichen Eigenschaften. Verwenden Sie Materialnamen: "satiniertes Glas", "gebürstetes Aluminium", "nasses Kopfsteinpflaster", "Seidenvorhang". Das Modell erkennt diese Texturen und bildet die Lichtphysik korrekt darauf ab.

- Verwenden Sie filmische Sprache für die Kameraarbeit. Sora 2 übersetzt grundlegendes filmisches Vokabular recht gut in Kamerabefehle. "Langsamer Dolly nach vorne", "Schärfeverlagerung vom Vordergrund zum Hintergrund", "Kamerafahrt aus der Froschperspektive" – all diese Begriffe führen dazu, dass die Kamera das tut, was Sie erwarten. Vermeiden Sie vage Anweisungen wie "coole Kamerabewegung".

- Entwerfen Sie Prompts für 10-12 Sekunden. Angesichts des Maximums von 12 Sekunden sollten Prompts eine Aktion oder eine Reihe von zusammenhängenden Aktionen beschreiben. Ein Subjekt, eine Hauptbewegung, ein finales Bild. Versuchen Sie nicht, mehrere Szenen und Schnitte in eine einzige Generierung zu erzwingen.

- Nutzen Sie Ursache-Wirkungs-Ketten. Sora 2 ist stark darin, Abfolgen in der physischen Welt darzustellen. "Dominosteine fallen über einen Schreibtisch und stoßen einen Stiftbecher um" oder "ein Streichholz wird angezündet, welches brennt und den Docht einer Kerze entzündet" – diese Phrasen mit mehreren Schritten, die physische Ereignisse beinhalten, spielen die Stärken des Modells voll aus.

Beispiel-Prompts, die in Tests gut funktioniert haben:

Physik-Demonstration:

plaintext1Eine Keramiktasse kippt in Zeitlupe vom Rand einer Küchentheke, 2zersplittert beim Aufprall auf einen Fliesenboden, Fragmente und Flüssigkeit spritzen 3realistisch umher, weiches Morgenlicht von einem nahe gelegenen Fenster, filmische Tiefenschärfe

Produktdemonstration:

plaintext1Ein Smartphone auf einer reflektierenden dunklen Oberfläche, Wassertropfen fallen 2auf den Bildschirm und perlen natürlich ab, Demonstration der Wasserbeständigkeit, 3Studiobeleuchtung mit dezenten blauen Akzentlichtern, 4K Commercial-Stil

Natur-Simulation:

plaintext1Ein einzelner Wassertropfen fällt in einen stillen Teich, erzeugt konzentrische 2Kräuselwellen, die sich nach außen ausbreiten, ein herbstliches Blatt schwimmt auf der Oberfläche 3und wird sanft von den Wellen bewegt, Goldene Stunde Beleuchtung, Makro-Objektiv-Perspektive

Sora 2 vs. Konkurrenz

- Sora 2: Max. Auflösung: High Definition, Max. Dauer: 12s, Referenz-Input: 1 Bild, Native Audio: Ja, API-Preis (Atlas Cloud): 0,15 $/Sek., Beste Stärke: Physik-Realismus, Inhaltsfilter: Strenge

- Seedance 2.0: Max. Auflösung: High Definition, Max. Dauer: 15s, Referenz-Input: 12 Dateien, Native Audio: Ja, API-Preis (Atlas Cloud): 0,022 $/Sek., Beste Stärke: Multimodale Steuerung, Inhaltsfilter: Strenge

- Kling 3.0: Max. Auflösung: Ultra HD, Max. Dauer: 10s, Referenz-Input: 1-2 Bilder, Native Audio: Ja (5 Sprachen), API-Preis (Atlas Cloud): 0,126 $/Sek., Beste Stärke: Auflösung + Preis-Leistung, Inhaltsfilter: Sehr streng

- Veo 3.1: Max. Auflösung: HD Cinematic, Max. Dauer: 8s, Referenz-Input: 1-2 Bilder, Native Audio: Ja, API-Preis (Atlas Cloud): 0,03 $/Sek., Beste Stärke: Filmischer Schliff, Inhaltsfilter: Moderat

Wo Sora 2 gewinnt

OpenAI Sora 2 ist führend in der Treue der physikalischen Simulation und der Glaubwürdigkeit des Objektverhaltens. Wenn es um physikbasierten, kausalen Videoinhalt geht – Produktdemos, Erklärvideos, physikbasierte Kunst und Kreativität – erreicht kein anderes Modell dessen Qualität. Und die maximale Dauer von 12 Sekunden ist eine Verbesserung gegenüber Kling 3.0 (10s) und Veo 3.1 (8s), was mehr erzählerischen Inhalt innerhalb eines einzelnen Clips ermöglicht.

Wo Sora 2 Defizite aufweist

Vergleicht man die Preisgestaltung, ist 0,15 /Sek.fu¨rSora2derho¨chstePreisindiesemArtikel.Seedance2.0istmit0,022/Sek. für Sora 2 der höchste Preis in diesem Artikel. Seedance 2.0 ist mit 0,022 /Sek.fu¨rSora2derho¨chstePreisindiesemArtikel.Seedance2.0istmit0,022/Sek. etwa 85 % günstiger pro Sekunde. Die Auflösung ist auf High Definition begrenzt, was niedriger ist als die Ultra-High-Definition von Kling 3.0. Der Referenz-Input ist auf ein Bild beschränkt, während Seedance 2.0 bis zu 12 Dateien (neun Bilder, drei Videos, drei Audio-Dateien) verarbeiten kann. Für budgetbeschränkte Teams oder Projekte, die eine starke referenzbasierte Kontrolle benötigen, sind diese Unterschiede signifikant.

Der praktische Ansatz

Wie in diesem Sora 2-Tutorial beschrieben, werden die meisten Teams mehr als ein Modell benötigen und Sora 2 nicht ausschließlich nutzen wollen. Sora 2 eignet sich für die Produktion physikalisch anspruchsvoller Szenen. Seedance 2.0 ist ideal für komplexe, referenzintensive Projekte. Kling 3.0 ist für finale Renderings in voller Auflösung gedacht. Veo 3.1 sorgt für filmischen Glanz. Atlas Cloud macht diesen Multi-Modell-Ansatz mit einem einzigen API-Key und konsolidierter Abrechnung praktikabel.

Wer sollte Sora 2 nutzen?

Wählen Sie Sora 2, wenn:

- Physikalische Genauigkeit die primäre Anforderung ist. Schwerkraft, Fluiddynamik, Kollisionen und Materialinteraktionen sind die definierende Stärke von Sora 2.

- Das Projekt Produktdemonstrationen umfasst, bei denen Objekte realistisch agieren müssen – Tropfen, Spritzer, Drehungen, mechanische Bewegungen.

- Bildungs- oder wissenschaftliche Visualisierungsarbeiten glaubwürdiges physikalisches Verhalten erfordern, das einer genauen Prüfung standhält.

- Die Obergrenze von 12 Sekunden ausreichend Zeit für den beabsichtigten Inhalt bietet. Sora 2 bietet mehr Zeit pro Clip als Kling 3.0 und Veo 3.1.

- Das Budget eine geringere Rolle spielt als die Qualität des Outputs bei physikgetriebenen Inhalten.

Wählen Sie stattdessen Seedance 2.0, wenn:

- Das Projekt umfangreiches Referenzmaterial erfordert – mehrere Bilder, Videos und Audiodateien als Input.

- Budgeteffizienz oberste Priorität hat. Mit 0,022 $/Sek. auf Atlas Cloud ist Seedance 2.0 etwa 7x günstiger als Sora 2.

- Längere Clips (bis zu 15 Sekunden) benötigt werden.

- Multimodale Input-Steuerung wichtiger ist als physikalische Genauigkeit.

Wählen Sie stattdessen Kling 3.0, wenn:

- Ultra-High-Definition-Output erforderlich ist. Sora 2 gibt in High-Definition aus.

- Zugang zur kostenlosen Stufe wichtig ist. Kling 3.0 bietet 66 tägliche Credits; Sora 2 erfordert ein kostenpflichtiges Abonnement.

- E-Commerce-Inhalte gestochen scharfe, lesbare Text-Renderings im generierten Video erfordern.

Wählen Sie stattdessen Veo 3.1, wenn:

- Filmische visuelle Qualität und Color Grading die höchsten Prioritäten sind.

- Kosteneffiziente Skalierung benötigt wird. Mit 0,03 $/Sek. ist Veo 3.1 5x günstiger als Sora 2.

- Kürzere Clips (bis zu 8 Sekunden) für den Anwendungsfall akzeptabel sind.

Häufig gestellte Fragen

Wie greife ich auf die Sora 2 API zu?

Der einfachste Weg führt über Atlas Cloud. Melden Sie sich an, holen Sie sich einen API-Key und fügen Sie die Modell-ID

1openai/sora-2/text-to-video-pro-developerWie viel kostet Sora 2 pro Video?

Sora 2 kostet auf Atlas Cloud 0,15 proSekundegeneriertemVideo.Ein10−Sekunden−Clipkostet1,50pro Sekunde generiertem Video. Ein 10-Sekunden-Clip kostet 1,50proSekundegeneriertemVideo.Ein10−Sekunden−Clipkostet1,50. Ein Clip in maximaler Länge von 12 Sekunden kostet 1,80 $. Die direkte Preisgestaltung von OpenAI für Sora 2 variiert je nach Abonnement-Stufe, ist jedoch im Vergleich zur Atlas Cloud-Rate für Sora 2 bei vergleichbarer Ausgabe in der Regel teurer.

Was ist die maximale Videolänge, die Sora 2 generieren kann?

Sora 2 hat eine maximale Länge von 12 Sekunden bei HD-Auflösung. Es liegt zwischen Seedance 2.0 (max. 15 Sekunden) und Kling 3.0 (max. 10 Sekunden). Die meisten Nutzer erstellen mehrere Clips und kombinieren diese bei der Bearbeitung zu längeren Werken.

Kann Sora 2 Image-to-Video-Generierung?

Ja. Sora 2 akzeptiert ein einzelnes Referenzbild, und das Modell nimmt das Bild als Anfangs-Frame oder Stilreferenz für das erstellte Video, erlaubt jedoch nur eines. Seedance 2.0 erlaubt bis zu 12 Referenzdateien für komplexere, referenzbasierte Generierungen.

Ist Sora 2 besser als Seedance 2.0 oder Kling 3.0?

Die Modelle sind in verschiedenen Bereichen jeweils am stärksten. Sora 2 hat die beste physikalische Simulation und reale Objektinteraktion. Seedance 2.0 hat die beste multimodale Input-Steuerung und die niedrigsten API-Preise (0,022 $/Sek.). Kling 3.0 hat die höchste Auflösung und die großzügigste kostenlose Stufe. Für die meisten Teams ist die beste Strategie, alle drei über eine vereinheitlichte Plattform wie Atlas Cloud zu nutzen und jede Aufgabe an das jeweils am besten geeignete Modell zu leiten.

Generiert Sora 2 Audio mit dem Video?

Ja. Die native Audio-Generierung von Sora 2 ist auf die Visuals abgestimmt. Der Ton ist für Entwürfe und Social-Media-Inhalte brauchbar, für professionelle Inhalte kann er jedoch in der Postproduktion ersetzt oder verbessert werden.

Fazit

Sora 2 hat einen ganz spezifischen Platz im Ökosystem der KI-Videogenerierung. Es ist nicht das kosteneffizienteste Modell, hat nicht die höchste Auflösung und kein offenes Input-System. Es bietet jedoch die physikalisch präziseste Videogenerierung, die in irgendeiner öffentlichen API verfügbar ist. Wenn Ihre Anwendung oder Ihr Inhalt auf Physik angewiesen ist, die der realen Welt entspricht – Produktdemos, Bildung, wissenschaftliche Visualisierung, in der Realität verankerte Kunst –, ist Sora 2 die leistungsfähigste Option für Sie.

Die wichtigste praktische Erkenntnis aus diesem Sora 2-Tutorial: Greifen Sie auf Sora 2 + Seedance 2.0, Kling 3.0, Veo 3.1 und über 300 weitere Modelle über Atlas Cloud zu. Ein API-Key. Eine Abrechnung. Die Freiheit, für jeden Auftrag das beste Modell zu wählen. 1 $ Startguthaben, um Sora 2-Physiksimulationen direkt auszuprobieren und mit der Skalierung zu wachsen.

1 $ Startguthaben auf Atlas Cloud sichern -- Sora 2 und 300+ Modelle testen

────────────────────────────────────────────────────────────