Vor nicht allzu langer Zeit erforderte die Erstellung eines anständigen Social-Media-Videos ein ganzes Team: Drehbuchschreiben, Dreharbeiten, Schnitt, Sounddesign. Bis 2026 wurde dieser gesamte Prozess auf einen Text-Prompt und einen API-Aufruf komprimiert. Die Infrastruktur, die eine Produktbeschreibung, eine Textzeile oder ein Content-Briefing direkt in einen veröffentlichungsreifen Videoclip verwandelt, ist nun Realität.

Dieser Artikel erklärt, wie diese Infrastruktur aussieht, wie man darauf aufbaut und was erforderlich ist, damit sie zuverlässig in großem Maßstab funktioniert.

Warum die Automatisierung von Social-Media-Videos jetzt wichtig ist

Kurzvideos sind längst nicht mehr nur Unterhaltung. TikTok, Instagram Reels und YouTube Shorts haben sich zu zentralen Distributionsmaschinen für Kultur, Marketing und E-Commerce entwickelt. Doch es gibt eine einfache Einschränkung: Die Content-Produktion skaliert nicht mit der Nachfrage.

Selbst für erfahrene Creator erfordert die Produktion eines hochwertigen Videos viel Zeit – Drehbuch, Storyboarding, Dreharbeiten oder die Suche nach Filmmaterial, Schnitt, Color Grading, Soundmischung, Untertitel. Der Engpass sind selten die Ideen. Es ist die Geschwindigkeit der Umsetzung. Wenn ein Trend nur wenige Stunden anhält, gewinnt, wer zuerst veröffentlicht. KI-Videogenerierung verändert das Spiel, indem sie die Batch-Produktion von einem kapitalintensiven Projekt zu einem routinemäßigen Betriebskostenpunkt macht.

Warum APIs wichtiger sind als Benutzeroberflächen

Viele KI-Videotools bieten hübsche Weboberflächen: Prompt eingeben, Knopf klicken, Ergebnis sehen. Das ist praktisch für einzelne Creator. Aber wenn Sie ein automatisiertes Content-System aufbauen, hilft Ihnen eine UI nicht weiter. Was echte Skalierbarkeit ermöglicht, ist die API.

APIs bringen Programmierbarkeit. Sie können Jobs stapelweise (in Batches) übermitteln. Sie können das Seitenverhältnis für verschiedene Plattformen automatisch anpassen. Sie können die Videogenerierung als native Funktion in Ihre SaaS-Plattform einbetten. Sie können programmatische A/B-Tests durchführen – generieren Sie zehn stilistische Variationen derselben Produktbeschreibung, veröffentlichen Sie diese für verschiedene Zielgruppensegmente und nutzen Sie dann die Engagement-Daten, um die nächsten Prompts zu verfeinern.

Stellen Sie sich eine E-Commerce-Plattform vor, die jeden Tag zweihundert neue Produkte listet. Ein Showcase-Video für jedes Produkt manuell zu erstellen, würde Dutzende Videoprofis erfordern. Mit einer API schreiben Sie ein Skript, das die Produktdatenbank liest, automatisch eine Prompt-Vorlage zusammenstellt, die API aufruft und die Ergebnisse an einen Social-Media-Planer sendet. Kein Mensch öffnet jemals eine Schnittsoftware. UIs sind für Menschen. APIs sind für Systeme. Der eigentliche Durchbruch kommt von Letzteren.

Der Lebenszyklus eines API-Aufrufs

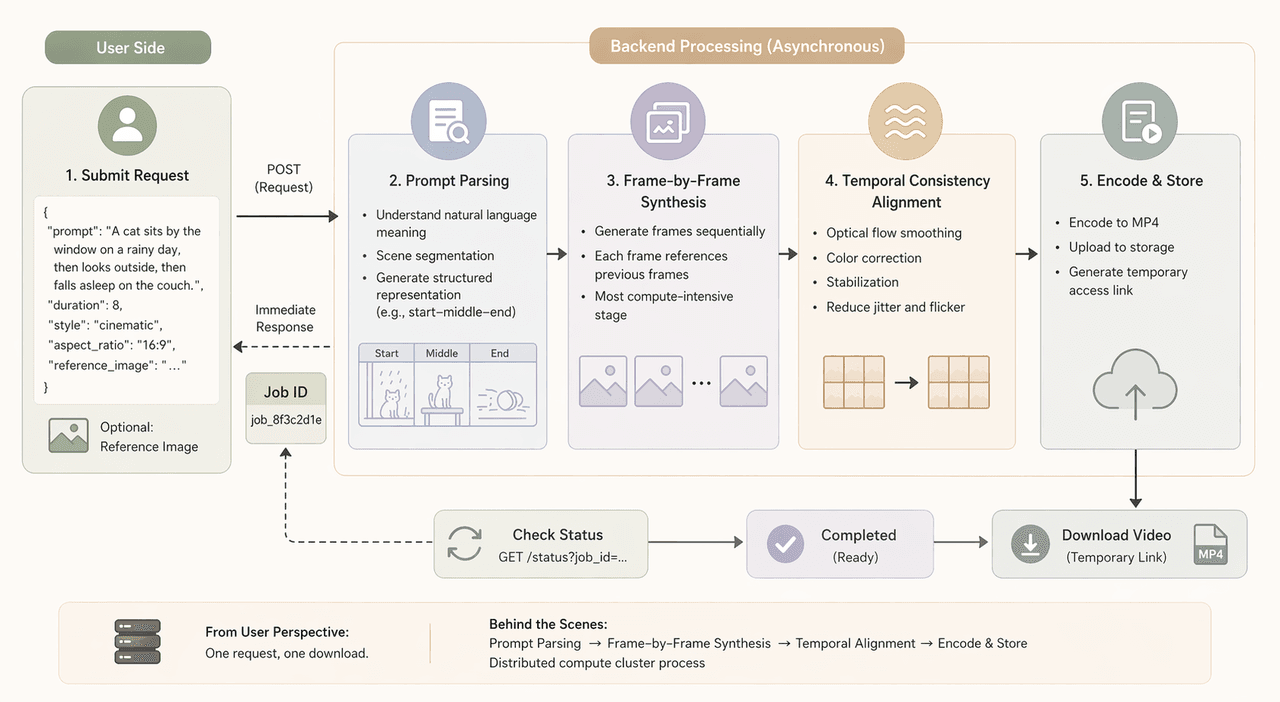

Verfolgen wir einen realen API-Aufruf von der Übermittlung bis zum Download.

Zuerst verpacken Sie Ihren Prompt und Ihre Parameter in JSON. Die Anfrage enthält typischerweise den Prompt, die Dauer (z. B. acht Sekunden), eine Stilvorlage, das

1aspect_ratioNach der Übermittlung beginnt das Backend zu arbeiten.

Schritt eins ist das Prompt-Parsing – das Umwandeln Ihrer natürlichen Sprache in eine strukturierte Repräsentation. Dies umfasst die Szenensegmentierung: Wenn Ihre Beschreibung drei aufeinanderfolgende Aktionen impliziert, berechnet das Modell den Anfang, den Mittelteil und das Ende.

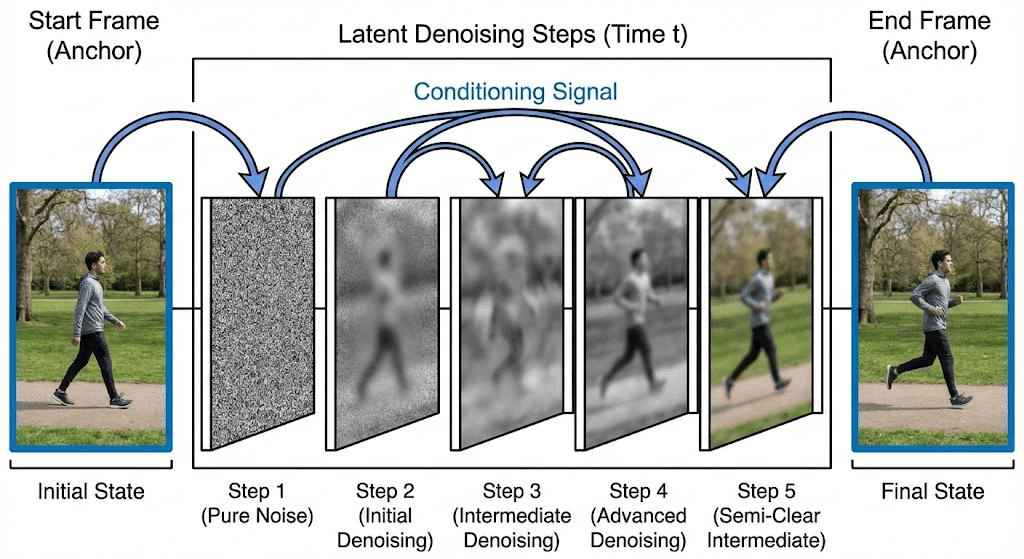

Schritt zwei ist die Frame-für-Frame-Synthese. Das Modell generiert Bilder nacheinander, wobei jedes auf die vorherigen Frames Bezug nimmt, um die Kohärenz zu wahren. Dies ist die rechenintensivste Phase.

Schritt drei ist das Alignment der zeitlichen Konsistenz. Trotz der besten Bemühungen des Modells können rohe Frames leicht zittern. Eine Nachbearbeitungsphase wendet optische Flussglättung, Farbkorrektur und Stabilisierung an.

Schließlich kodiert das System das Video in MP4, lädt es in den Speicher hoch und generiert einen temporären Zugriffslink. Aus der Sicht des Benutzers sind es eine Anfrage und ein Download. Hinter den Kulissen hat ein verteiltes Rechencluster viel Arbeit geleistet.

Wie verschiedene Akteure dies nutzen

Unabhängige Creator nutzen die API, um ihren Output zu vervielfachen. Sie können eine Kernidee nehmen und ein Dutzend Variationen generieren – ändern Sie den Farbton, tauschen Sie den Voiceover-Stil aus, passen Sie die Kamerabewegung an. Statt drei Videos pro Woche können Sie zehn pro Tag erstellen. Der Engpass verlagert sich von der Produktionsgeschwindigkeit zu Ihrem Urteilsvermögen, was behalten werden soll.

Kurze Demo: Eine Idee, viele Variationen

plaintext1import requests 2 3API_KEY = "YOUR_API_KEY" 4url = "https://api.atlascloud.ai/api/v1" 5 6styles = ["cinematic", "anime", "documentary", "vlog"] 7 8for style in styles: 9 payload = { 10 "prompt": "A cat sitting by the window, wind blowing curtain", 11 "duration": 6, 12 "style": style, 13 "aspect_ratio": "1:1" 14 } 15 16 res = requests.post(url, json=payload, headers={ 17 "Authorization": f"Bearer {API_KEY}" 18 }).json() 19 20 print(f"{style} → job_id:", res["job_id"])

Marketing-Teams nutzen systematischere Ansätze. Ein häufiger Anwendungsfall ist die Lokalisierung für mehrere Regionen. Eine globale Marke, die in zwanzig Ländern startet, kann ein Master-Video erstellen und dann ein Skript ausführen, das automatisch den Text auf dem Bildschirm, das Voiceover und visuelle Details für jede Sprache ersetzt. Ein Monat Arbeit wird zu wenigen Tagen.

E-Commerce ist ein weiterer schnell wachsender Bereich. Ein statisches Produktbild plus eine kurze Beschreibung wird zu einem dynamischen Showcase. Für eine Smartwatch geben Sie eine Nahaufnahme-Beschreibung mit Licht- und Kamerabewegung ein, und das System generiert eine sechssekündige Schleife. Auf einer Produktseite platziert, schneiden solche Clips oft besser ab als statische Bilder. Und Sie können den gesamten Katalog in Batches verarbeiten.

Entwickler und SaaS-Plattformen verpacken Videogenerierung als Service. Ein Social-Media-Planungstool könnte eine API integrieren, damit Benutzer einen Tweet eingeben können und das Tool diesen automatisch in ein kurzes Videoskript erweitert, das Video generiert und es plant. Diese Plattformen verwandeln Videogenerierung in eine grundlegende Fähigkeit.

KI-Output produktionsreif machen

Eine harte Wahrheit: Der rohe API-Output ist selten sofort veröffentlichungsreif. Erfolgreiche Produktionssysteme kapseln die API mit mehreren Ebenen.

Erstens: Prompt-Engineering. Etablierte Teams pflegen Bibliotheken mit Prompt-Vorlagen für verschiedene Kategorien, Stile und Plattformen. Ein Prompt für Instagram Reels betont hohe Sättigung und schnelle Schnitte. Ein YouTube-Shorts-Prompt konzentriert sich auf den narrativen Fluss. Vorlagen enthalten Variablen, die Skripte dynamisch ausfüllen.

Zweitens: Qualitätsmanagement bei der Generierung. Derselbe Prompt fünfmal ausgeführt, kann drei brauchbare Clips und zwei mit Fehlern hervorbringen – ein deformierter Finger, ein unlogisches Objekt im Hintergrund. Sie schreiben automatisierte Prüfungen, die häufige Fehlermuster erkennen und Clips für die Neugenerierung markieren.

Drittens: Nachbearbeitungs-Pipelines. Nach der Generierung müssen Sie möglicherweise ein Logo, ein Intro/Outro oder eingebrannte Untertitel hinzufügen. Tun Sie dies mit Skripten, nicht durch Re-Import in eine Schnittsoftware.

Viertens: Caching und Wiederverwendung. Wenn Ihre Bibliothek wiederholt dasselbe Produkt oder denselben Charakter verwendet, cachen Sie die Ergebnisse. Dies senkt die Kosten und wahrt die visuelle Konsistenz.

All diese Schichten zusammen ergeben eine echte Content-Maschine. Die API ist nur eine Komponente. Der Wert liegt darin, wie Sie das System zusammensetzen.

Was noch nicht funktioniert

KI-Videogenerierung ist bei weitem nicht perfekt. Wenn Sie versuchen, etwas Längeres als etwa fünfzehn Sekunden zu generieren, werden Sie wahrscheinlich auf Probleme stoßen – Objekte deformieren sich, die Szenenlogik bricht zusammen, Charaktere werden inkonsistent. Das effektive narrative Zeitfenster aktueller Modelle ist kurz.

Die Rechenkosten sind eine weitere Einschränkung. Die Generierung einer Sekunde hochwertigen Videos benötigt viel mehr GPU-Zeit als die Generierung eines Bildes. Die Preise sinken, aber für Teams, die Hunderte von Videos pro Tag benötigen, ist die Wirtschaftlichkeit entscheidend. Ein pragmatischer Ansatz reserviert die teure Generierung für kritische Inhalte und nutzt günstigere Optionen für Tests.

Die Unvorhersehbarkeit von Prompts ist ein ständiges Ärgernis. Derselbe Prompt liefert heute möglicherweise andere Ergebnisse als gestern. Die Ergebnisse variieren stark zwischen den Anbietern. Automatisierte Systeme benötigen zusätzliche Robustheit – gehen Sie davon aus, dass nicht jede Generierung den Erwartungen entspricht, und bauen Sie Wiederholungsversuche ein.

Die narrative Kohärenz über mehrere Szenen hinweg ist noch sehr schwach. Sie können "eine Person, die in einem Café Kaffee trinkt" generieren und auch "dieselbe Person, wie sie auf die Straße hinausgeht", aber das Modell versteht den Übergang nicht automatisch. Um ein Multi-Szenen-Video zu erhalten, müssen Sie derzeit jeden Schnitt detailliert beschreiben.

Wohin die Reise geht

Trotz dieser Einschränkungen ist die Richtung klar. Videogenerierung wird kein eigenständiges Werkzeug bleiben. Erwarten Sie in den nächsten Jahren vollautomatisierte Content-Pipelines: Ein System scannt jeden Morgen Trends, generiert automatisch Videokonzepte, führt kleine Tests durch, wählt die besten Performer aus und verstärkt sie. Kein Mensch trifft kreative Entscheidungen – nur noch eine abschließende Überprüfung der Markensicherheit.

Erwarten Sie auch agentische kreative Systeme. Sie geben einem KI-Agenten ein Ziel – "Steigere das Bewusstsein für neue Produkte in dieser Woche" – und er schlägt Skriptrichtungen vor, generiert Kandidaten, veröffentlicht Testanzeigen für Zielgruppen, analysiert das Feedback, passt die Strategie an und generiert die nächste Charge.

Personalisierte Echtzeit-Videostreams werden erscheinen. Eine Fitness-App könnte eine personalisierte wöchentliche Zusammenfassung mit den Daten des Benutzers, Fortschrittsvisualisierungen und einem motivierenden Voiceover erstellen.

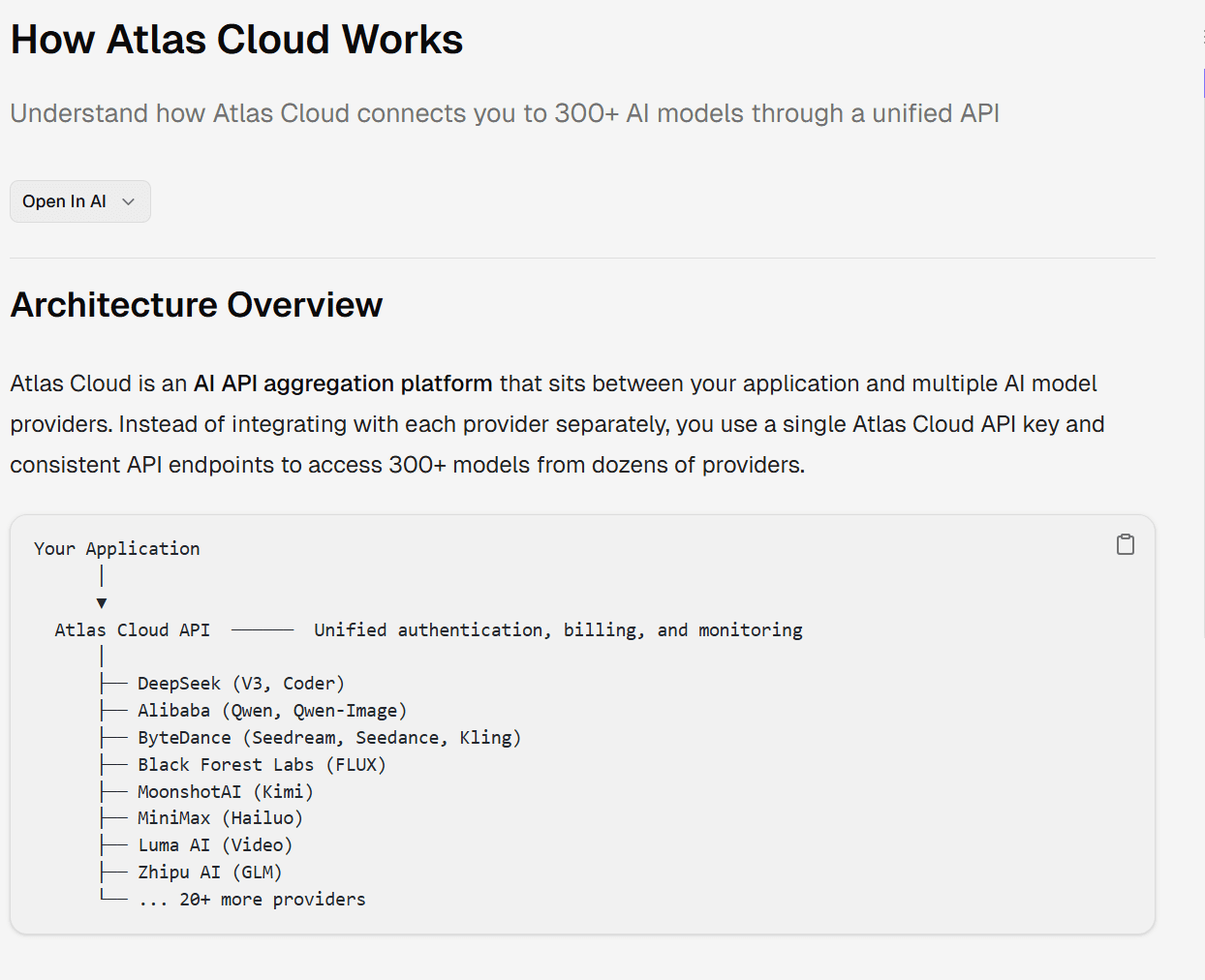

Erwarten Sie schließlich eine tiefe Integration in Marketing-Automatisierungs-Stacks. Plattformen wie AtlasCloud unterstützen die Aggregation mehrerer Modelle für Bild- und Videogenerierung, was es für Benutzer einfacher macht, diese in ihre eigenen kreativen oder kommerziellen Projekte zu integrieren.

Abschließende Gedanken

Der Wechsel vom manuellen Schnitt zur API-basierten Generierung ist kein bloßes Upgrade der Werkzeuge. Es ist eine strukturelle Veränderung darin, wie Inhalte erstellt und konsumiert werden. Videogenerierungs-APIs werden zur Infrastrukturschicht des modernen digitalen Storytellings. Für Creator bedeutet dies Skalierbarkeit. Für Entwickler Chancen. Für Plattformen Automatisierung. Und für das Internet den Übergang von der statischen Batch-Produktion zu kontinuierlichen generativen Mediensystemen. Dieser Wandel findet bereits statt. Jeder mit einem API-Key und einer Idee kann beginnen, seine eigene Videopipeline aufzubauen – ein Millionenbudget ist nicht erforderlich.