¿Qué es GLM-5.1? El modelo de codificación autónoma de Zhipu AI

¡El modelo GLM 5.1 llegará pronto a Atlas Cloud!

- ¿Qué es GLM-5.1?: GLM 5.1 es el modelo de código abierto más avanzado de Zhipu AI, con las capacidades de programación más sólidas entre los modelos abiertos, ¡compitiendo con Opus 4.6!

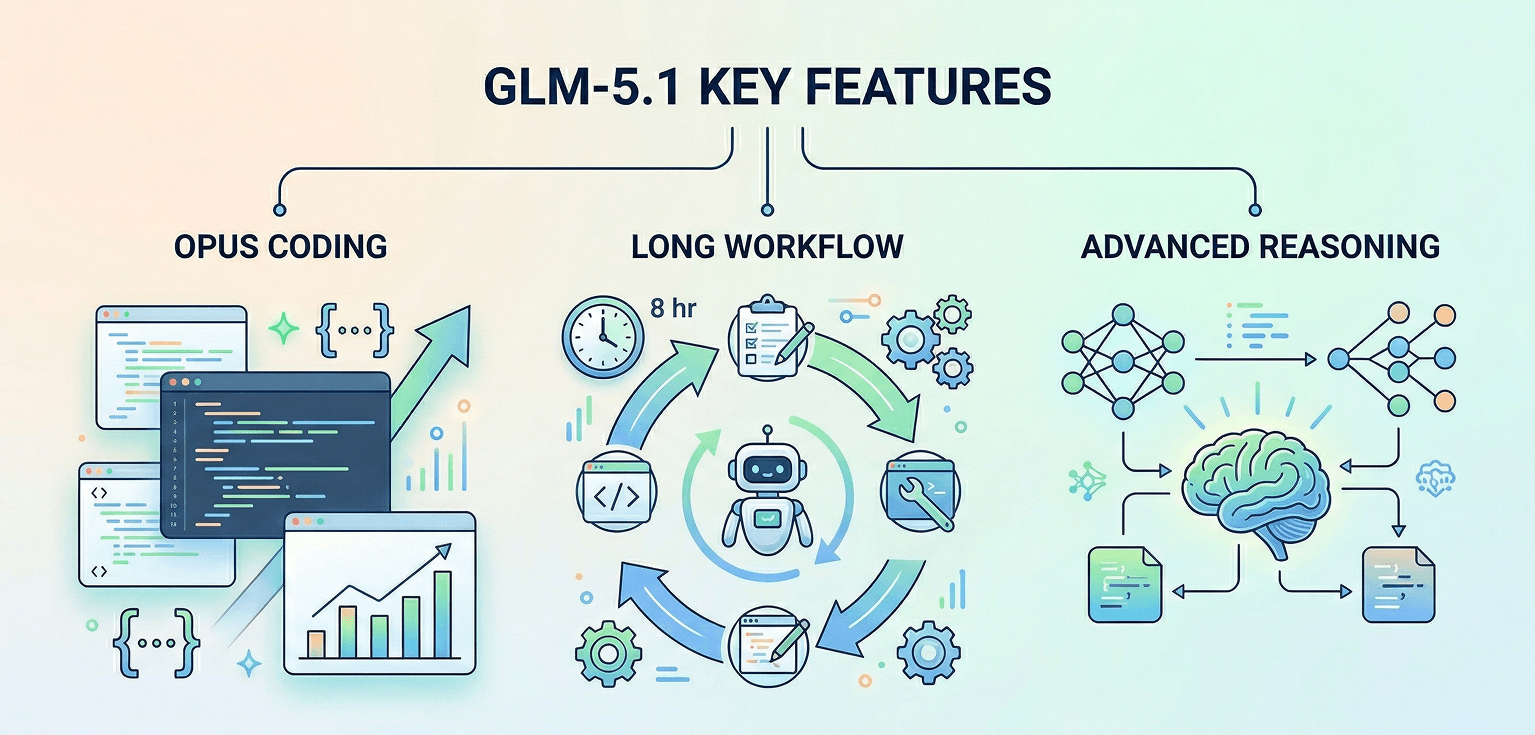

- Características principales: GLM 5.1 cuenta con capacidades de codificación de primer nivel. Automatiza tareas durante hasta ocho horas, con una resolución de problemas adaptativa para garantizar flujos de trabajo fluidos y resultados completamente funcionales.

- Fecha de lanzamiento: Este mes.

Características principales de GLM-5.1

Rendimiento de codificación: Nivel Opus 4.6

GLM-5.1 logra los resultados de referencia más sólidos en tareas de codificación, igualando el rendimiento de Claude Opus 4.6. Se clasifica en la parte superior entre los modelos de código abierto en los principales benchmarks públicos.

Comparación con Claude 3.5 Sonnet:

- Claude 3.5 Sonnet: Sólidas capacidades de codificación, ampliamente adoptado para el desarrollo.

- GLM-5.1: Iguala el rendimiento a nivel de Opus 4.6, con precios competitivos.

Comparación con DeepSeek V3.2:

- DeepSeek V3.2: Excelente modelo de codificación de código abierto con amplias capacidades.

- GLM-5.1: Superior en benchmarks de codificación especializados, ejecución única de largo plazo.

Ejecución de tareas a largo plazo: 8 horas de autonomía

GLM-5.1 va mucho más allá del diálogo normal. Asígnale un proyecto de ingeniería real y planificará el flujo de trabajo, escribirá código, ejecutará pruebas, cambiará de estrategia si se bloquea, solucionará problemas cuando algo falle, y seguirá trabajando hasta por 8 horas para entregar un resultado completo. Pocos modelos tienen esta capacidad.

Comparación con GPT-4o:

- GPT-4o: Excelente para conversaciones de varios turnos y tareas cortas.

- GLM-5.1: Diseñado para una ejecución autónoma extendida con gestión de estado.

Comparación con Qwen2.5:

- Qwen2.5: Sólido rendimiento en diversas tareas.

- GLM-5.1: Especializado en flujos de trabajo de ingeniería complejos y de larga duración.

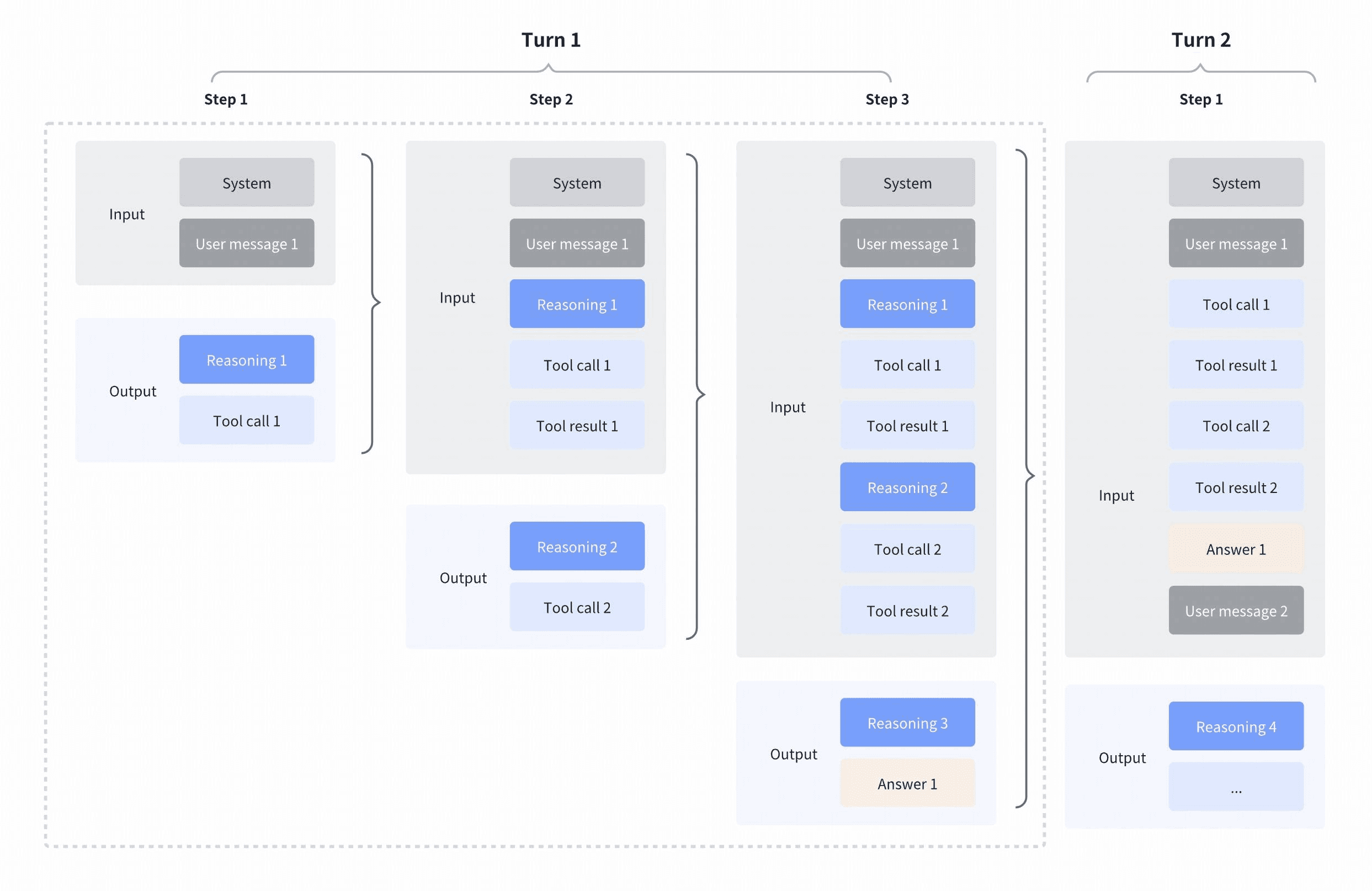

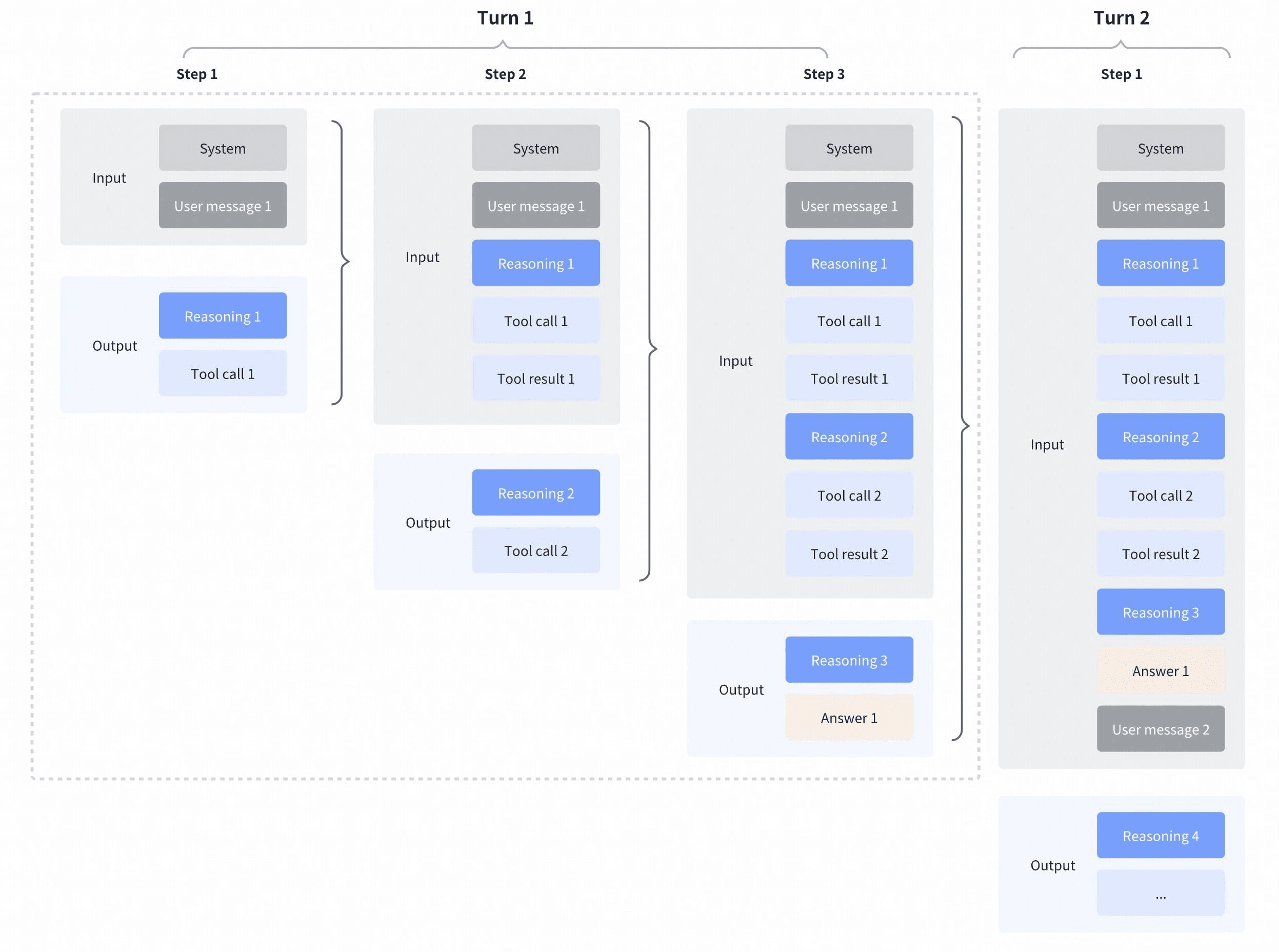

Pensamiento entrelazado y preservado

- Pensamiento entrelazado (Interleaved Thinking)

Permitir que GLM razone entre y después de las llamadas a herramientas habilita el pensamiento paso a paso: interpretar resultados, encadenar llamadas y tomar decisiones precisas basadas en resultados intermedios.

- Pensamiento preservado (Preserved Thinking)

GLM-5.1 conserva el razonamiento de turnos anteriores, asegurando continuidad, mejorando el rendimiento, aumentando los aciertos de caché y ahorrando tokens en tareas reales.

Casos de uso de GLM-5.1: Migración de código, desarrollo de funciones, depuración

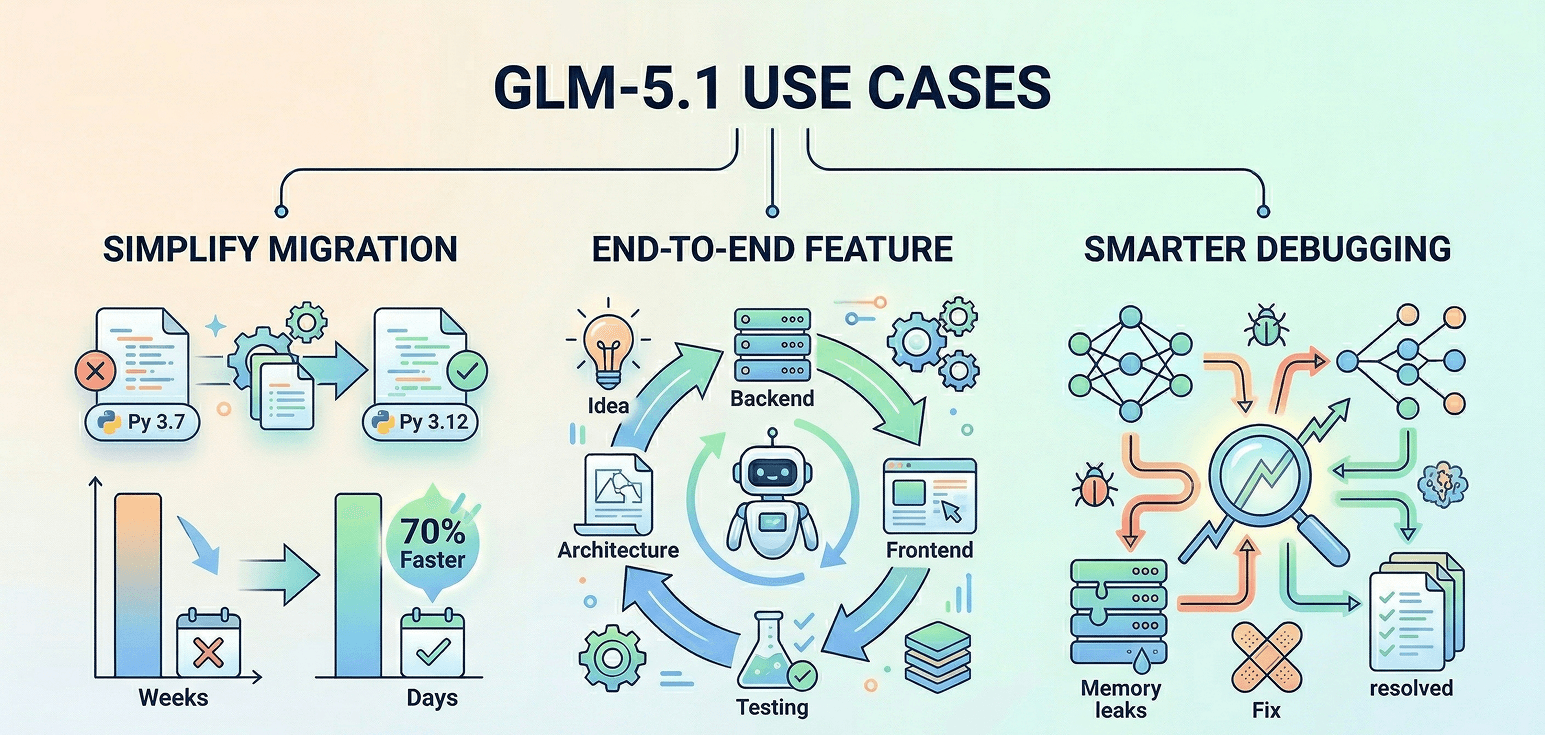

Simplificación de la migración de código

GLM-5.1 asume tareas de migración de código que consumen mucho tiempo, convirtiendo semanas de esfuerzo en cuestión de días. Revisa la base de código, crea una estrategia, edita archivos a escala y realiza pruebas exhaustivas. Esto ha hecho que proyectos comunes, como actualizar versiones de Python o modernizar marcos de trabajo, sean hasta un 70% más rápidos y fáciles.

Desarrollo de funciones de extremo a extremo

Desde ideas iniciales hasta aplicaciones completamente construidas, GLM-5.1 ejecuta todo el proceso. Planifica la arquitectura, construye sistemas backend y frontend, escribe pruebas e incluso maneja la documentación. Sin necesidad de supervisión constante, entrega soluciones completas listas para su implementación, incluyendo seguridad, bases de datos y configuraciones de producción.

Depuración más inteligente

Cuando aparecen errores complejos en sistemas grandes, GLM-5.1 hace el trabajo pesado. Rastrea problemas de forma persistente, ya sean condiciones de carrera o fugas de memoria, y aplica correcciones basadas en pruebas cuidadosas. Cada paso queda documentado, dejando a los desarrolladores con soluciones sobre las que pueden seguir trabajando.

¿Por qué usar GLM-5.1 en Atlas Cloud?

¿Qué es Atlas Cloud?

Es una plataforma que simplifica la IA al brindarte acceso a más de 300 modelos de primer nivel en un solo lugar: texto, imágenes, video y más.

¿Para quién es?

• Desarrolladores que desean un acceso fácil y asequible a la IA. • Equipos que manejan proyectos que requieren IA en múltiples áreas. • Empresas que necesitan una IA confiable para trabajos importantes. • Personas que utilizan herramientas como ComfyUI y n8n.

¿Por qué elegirla?

• Una API te permite usar todo: solo una clave. • Precios claros, sin sorpresas y con costos bajos. • Diseñada para empresas: estable, segura y respaldada por expertos. • Funciona con las herramientas que ya tienes. • Tus datos permanecen seguros y cumplen con las necesidades de cumplimiento.

¿Cómo se compara?

• Fal.ai: Atlas tiene más modelos y mejores precios. • Wavespeed: Atlas cuesta menos e incluye soporte empresarial. • Kie.ai: Atlas es más transparente con los precios y ofrece una mayor selección. • Replicate: Biblioteca más pequeña y costos más altos. • Otros proveedores (como OpenAI): Atlas combina todo en una plataforma simple.

Cómo usar GLM-5.1 en Atlas Cloud

Atlas Cloud te permite usar modelos lado a lado: primero en un entorno de pruebas (playground), luego a través de una única API.

Método 1: Usar directamente en el entorno de pruebas de Atlas Cloud

Método 2: Acceso a través de API

Paso 1: Obtén tu clave de API

Crea una clave de API en tu consola y cópiala para usarla más tarde.

Paso 2: Consulta la documentación de la API

Revisa el endpoint, los parámetros de solicitud y el método de autenticación en nuestra documentación de API.

Paso 3: Realiza tu primera solicitud (ejemplo en Python)

Ejemplo: genera un video con GLM-5-Turbo

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

FAQ: Preguntas frecuentes sobre GLM-5.1

P: ¿Cómo se compara GLM-5.1 con Claude 3.5 Sonnet para la codificación?

R: GLM-5.1 iguala a Claude Opus 4.6 en los benchmarks de codificación, superando a Claude 3.5 Sonnet. Su capacidad para manejar tareas extendidas lo hace destacar.

P: ¿Qué tiene de diferente la "ejecución de tareas a largo plazo"?

R: Los modelos de chat regulares responden a mensajes individuales. GLM-5.1, sin embargo, puede mantenerse en la tarea durante hasta 8 horas, adaptándose y autocorrigiéndose durante todo el proceso.

P: ¿Es GLM-5.1 de código abierto?

R: Sí, es totalmente de código abierto. Desarrollado por Zhipu AI, puedes encontrar los detalles de la licencia en la documentación oficial.

P: ¿Está listo para su uso en producción?

R: ¡Definitivamente! GLM-5.1 ofrece una ventana de contexto de 128K y funciona en la infraestructura confiable de Atlas Cloud, lo que lo hace listo para producción.

P: ¿Cómo integro su capacidad de ejecución de 8 horas?

R: Para tareas largas, utiliza un webhook o una configuración de sondeo (polling). Atlas Cloud maneja el backend y tu aplicación recibe el resultado final al finalizar.

P: ¿Para qué tareas es más adecuado GLM-5.1?

R: Es ideal para proyectos desafiantes como la migración de código, la depuración de sistemas complejos y el desarrollo de software full-stack.