Resumen/Abstract:

MiniMax M2.7 se ha lanzado oficialmente en Atlas Cloud. Como el primer modelo en participar profundamente en su propia iteración, M2.7 se basa en la serie M2 con un enfoque principal en mejorar las capacidades de los agentes. En escenarios de programación, la construcción lógica y las capacidades de autocorrección de errores de M2.7 se han fortalecido, permitiéndole iterar autónomamente a través de 100 rondas de código. En aplicaciones de agentes, la habilidad "práctica" de M2.7 ha mejorado, permitiéndole construir complejos "Agent Harnesses" y completar tareas de productividad altamente complejas basadas en capacidades como equipos de agentes (Agent Teams), habilidades complejas (Complex Skills) y búsqueda de herramientas (Tool Search).

Recomendamos usar el modelo a través de la API compatible con OpenAI proporcionada por Atlas Cloud. Esto no solo permite el uso concurrente de múltiples modelos generativos convencionales, sino que también ofrece precios más transparentes y económicos que los de competidores similares.

MiniMax M2.7, desarrollado por MiniMax, ¡ya está disponible en Atlas Cloud!

- Qué esMiniMax M2.7: Es el primer modelo lanzado por el equipo de MiniMax en participar profundamente en su propia iteración, ampliando su línea de productos de Modelos de Lenguaje Extensos (LLM) de la serie M2.

- Ventajas principales:MiniMax M2.7 logra capacidades de evolución autónoma profunda, posee capacidades de ingeniería de software de extremo a extremo y ofrece un rendimiento de entrega de oficina profesional "MAX".

- Precio: 💲0.3/1.2 M in/out

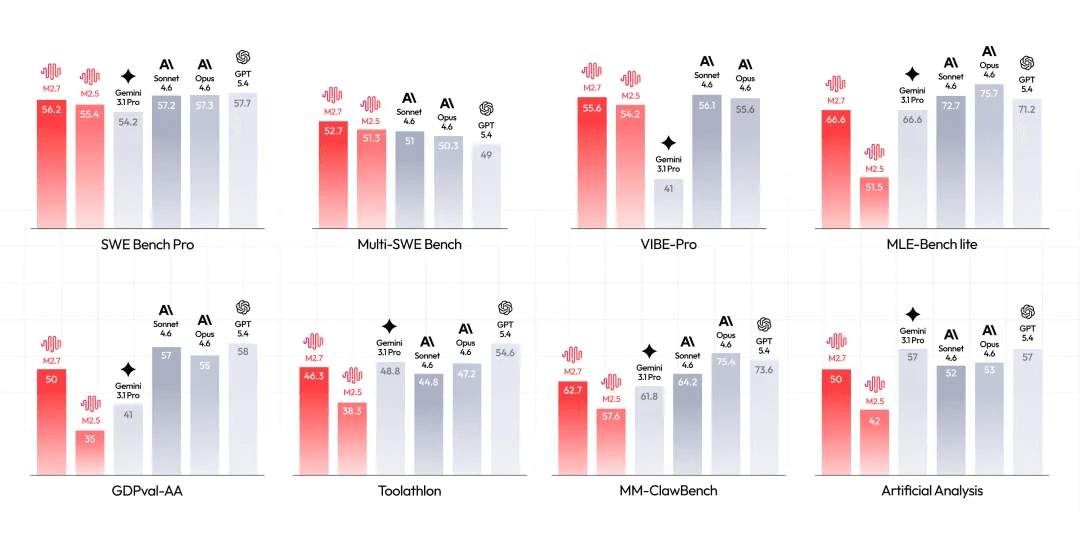

El anterior M2.5 captó la atención del mercado al igualar el rendimiento de Opus 4.6 a un coste ultrabajo (hasta 20 veces menor). Ahora, M2.7 da un paso más allá, con capacidades de programación independientes que igualan a GPT-5.3-Codex, mientras iguala el rendimiento integral de Opus 4.6 en la entrega de proyectos completos. En las siguientes secciones, profundizaremos en las características excepcionales de MiniMax M2.7.

Características principales de MiniMax M2.7

Capacidad de autoevolución profunda

Basándose en el marco de trabajo de agentes orientado a la investigación establecido dentro de la serie M2, el equipo de MiniMax diseñó e implementó un "andamio" simple para guiar al agente a través de una optimización autónoma. Esto permite a M2.7 interactuar y colaborar con múltiples grupos de proyectos de investigación y explorar autónomamente soluciones óptimas.

- Cobertura integral del sistema: Tuberías de datos, entornos de entrenamiento, infraestructura de evaluación, colaboración entre equipos y memoria persistente.

- Inteligencia de proceso completo: Supervisa y analiza automáticamente los estados de los experimentos, activa dinámicamente la lectura de registros, la resolución de problemas y el análisis de métricas. Incluso puede completar correcciones de código, solicitudes de fusión y pruebas de humo para identificar y manejar cambios sutiles pero críticos.

- Módulos principales: Memoria a corto plazo, retroalimentación propia y autooptimización.

Los investigadores solo necesitan intervenir durante decisiones y discusiones clave; M2.7 puede encargarse perfectamente del resto del trabajo. Más allá de aumentar significativamente la eficiencia de entrega, M2.7 nos permite imaginar un futuro donde la IA construye y optimiza la IA.

Capacidad de entrega de oficina profesional

MiniMax M2.7 demuestra una adherencia superior al ejecutar las instrucciones del usuario. Específicamente, el modelo piensa y presiona de manera más proactiva para satisfacer las necesidades del usuario, como buscar activamente soluciones, iterar sobre resultados antiguos y proporcionar explicaciones detalladas. Su poderoso conocimiento del mundo, su capacidad para manejar Word, Excel y PPT, y su competencia en escenarios diarios generalizados conducen a un aumento masivo en la productividad de oficina.

- Recuperación de información y traducción: M2.7 puede invocar habilidades con mayor precisión para completar eficientemente las solicitudes del usuario.

- Lectura de informes y análisis de datos: Exhibe capacidades de comprensión y salida de nivel de investigación.

- Procesamiento y entrega de documentos de oficina: Admite edición y salida en múltiples rondas basadas en plantillas designadas.

Estas mejoras reducen eficazmente el trabajo de corrección manual requerido por parte de los desarrolladores y creadores de contenido, optimizando significativamente todo el flujo de trabajo desde la intención de entrada hasta el producto final. La documentación oficial afirma que en ciertos escenarios de I+D, M2.7 puede manejar aproximadamente entre el 30% y el 50% de la carga de trabajo.

Capacidad de ingeniería de software de extremo a extremo

M2.7 muestra una destreza de primer nivel en escenarios de ingeniería de software del mundo real, dominando el ciclo de ingeniería completo desde la depuración hasta la colaboración.

- Resolución de problemas en entornos de producción: Completa la localización y reparación de problemas en 3 minutos a través del razonamiento causal y la verificación de la causa raíz, aumentando enormemente la eficiencia.

- Generación de código y cognición del sistema: Mantiene una alta precisión en tareas de ingeniería complejas con una comprensión profunda de la lógica del sistema y los flujos de trabajo de ingeniería.

- Colaboración nativa multi-agente: Admite el desarrollo en equipo con una división de roles estable, equilibrando la lógica y la eficiencia al manejar tareas complejas.

M2.7 representa una revolución integral en las capacidades de ingeniería de software.

Tareas de agentes: Rendimiento mejorado en escenarios como OpenClaw

En escenarios complejos que involucran aplicaciones de agentes, MiniMax M2.7 funciona como un verdadero profesional. Con su mejor comprensión del contexto y memoria, se mantiene perfectamente alineado con los objetivos a lo largo de diálogos complejos y tareas largas.

- Uso de herramientas: Selecciona y utiliza herramientas con precisión y eficiencia.

- Planificación de tareas: Desglosa las tareas a largo plazo científicamente, manteniéndolas prácticas y ejecutables.

- Manejo de errores: Detecta errores y los corrige por sí mismo.

Este nivel de robustez mejora enormemente la fiabilidad de los agentes en operaciones del mundo real. Ya sea para automatizar su trabajo de oficina o realizar análisis de datos complejos, MiniMax M2.7 lo respalda.

Ejemplos de escenarios de aplicación

Informes de investigación intensivos en conocimiento

En campos profesionales como las finanzas, M2.7 ya puede comprender, juzgar y generar resultados como un analista junior. Se autocorrige a través de interacciones de múltiples rondas, lee autónomamente informes anuales, integra información de investigación, construye modelos de ingresos y genera PPT e informes de investigación.

Diseño de páginas frontend

En comparación con M2.5, la capacidad estética de M2.7 ha mejorado. M2.7 demuestra mejores resultados en fuentes, diseños de tarjetas y efectos interactivos.

M2.7 vs M2.5, Fuente: @Aibattle_ en X

¿Por qué usar MiniMax M2.7 en Atlas Cloud?

Como plataforma de infraestructura de IA multimodal, Atlas Cloud proporciona a los usuarios una interfaz API unificada. Una vez conectado, los usuarios pueden desbloquear fácilmente más de 300 modelos de IA avanzados, incluyendo modelos generativos de texto, imágenes, vídeo o multimodales.

Público objetivo

- Desarrolladores independientes que buscan soluciones simplificadas y de bajo coste para llamar a varios modelos de IA.

- Empresas que requieren una infraestructura estable, segura y escalable para respaldar su negocio principal.

- Equipos de desarrollo que necesitan integrar eficientemente múltiples modelos multimodales en sus proyectos.

- Usuarios de flujos de trabajo que priorizan la compatibilidad de la cadena de herramientas y utilizan ComfyUI o n8n.

Características del producto

- Integración muy simplificada: La plataforma proporciona una API compatible con OpenAI, simplificando instantáneamente la carga de trabajo del desarrollador. No más malabarismos con claves de múltiples proveedores ni estrés por costes de mantenimiento entre plataformas.

- Ventaja de costes: En comparación con la competencia, Atlas Cloud tiene costes de implementación más bajos. Nano Banana 2 cuesta **0.056 /imagen∗∗(competencia:0.07/imagen** (competencia: 0.07 /imagen∗∗(competencia:0.07/imagen); Veo 3.1 tiene un precio de **0.09 /segundo∗∗(competencia:0.1/segundo** (competencia: 0.1 /segundo∗∗(competencia:0.1/segundo). Además, la interfaz del Playground ofrece una transparencia total de precios, con el botón "Run" etiquetando directamente el importe de deducción por imagen o segundo de vídeo.

- Estabilidad y soporte de nivel empresarial: Atlas Cloud garantiza que la protección de datos cumpla con estrictos estándares de privacidad y pueda manejar información sensible.

- Amigable para "conectar y usar": Diseñado para funcionar sin esfuerzo con herramientas como ComfyUI y n8n, ayudando a las empresas a reducir los costes de cambio y empezar a trabajar de inmediato.

Comparación con productos similares

- Fal.ai: Aunque ofrecen algunos modelos, Atlas Cloud proporciona una selección más amplia (más de 300), precios más competitivos y los nuevos usuarios registrados reciben un crédito de prueba de 1 $.

- Wavespeed: El precio es significativamente más alto. Atlas Cloud ofrece soporte de cumplimiento empresarial adicional y orientación técnica experta que Wavespeed no enfatiza.

- Kie.ai: Utiliza un sistema de créditos opaco. Atlas Cloud muestra el coste exacto de cada ejecución directamente en la interfaz. El recuento de modelos es también mayor que el de Kie.ai.

- Replicate: Se centra en el alojamiento de modelos. Las ventajas de Atlas Cloud residen en la unificación de la API, la velocidad de despliegue de modelos y políticas de soporte más amigables para el desarrollador.

- OpenAI o Google: Estos proveedores solo ofrecen sus propios modelos. Los usuarios con necesidades multimodales suelen necesitar integrar múltiples servicios. Atlas Cloud integra modelos propietarios y de código abierto bajo una única API, reduciendo la complejidad del sistema.

¿Cómo usar MiniMax M2.7 en Atlas Cloud?

Método 1: Usar directamente en la plataforma

Método 2: Usar a través de integración API

Paso 1: Obtenga su clave API. Cree y pegue su clave API en la consola:

Paso 2: Consulte la documentación de la API. Revise los parámetros de solicitud, los métodos de autenticación, etc.

Paso 3: Realice su primera solicitud (ejemplo en Python)

plaintext1{ 2 "model": "minimaxai/minimax-m2.7", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

Preguntas frecuentes (FAQ)

En la competencia de modelos convencionales de 2026, ¿cómo se compara la relación precio-rendimiento de M2.7?

En comparación con Claude Opus 4.6, M2.7 reduce significativamente los costes de inferencia cuando se llama a través de Atlas Cloud, manteniendo la misma capacidad de entrega.

Especialmente con la popularidad actual del marco OpenClaw, M2.7 ha sido optimizado específicamente para tareas de secuencia larga y llamadas a herramientas (la tasa de cumplimiento de habilidades alcanza el 97%), lo que resulta en una relación "productividad unitaria-precio" extremadamente alta.

¿Cuál es el avance fundamental de MiniMax M2.7 en comparación con las versiones anteriores?

MiniMax M2.7 es el primer modelo en lograr una participación profunda en la "autoiteración". No solo ve un aumento masivo en las capacidades de los agentes, sino que también posee capacidades de ingeniería de software de extremo a extremo.

¿Cuál es el nivel de las capacidades de programación e ingeniería de software de MiniMax M2.7?

La capacidad de programación independiente de M2.7 ha alcanzado al potente GPT-5.3-Codex, mientras que su rendimiento integral en la entrega de proyectos completos rivaliza con Opus 4.6. Admite localizar y solucionar fallos en entornos de producción en 3 minutos y posee una comprensión profunda de la lógica de sistemas complejos, manejando aproximadamente entre el 30% y el 50% de la carga de trabajo en escenarios de I+D reales.