DeepSeek v4: Todo lo que sabemos hasta ahora – Características, fecha de lanzamiento y cómo acceder en Atlas Cloud

Introducción: ¿Qué es DeepSeek v4?

AtlasCloud está expandiendo su arsenal de IA generativa con la próxima incorporación de DeepSeek v4.

- Qué es: El último modelo insignia del equipo de DeepSeek. Si DeepSeek v3.2 marca el estándar para modelos de código abierto rentables, v4 supera los límites de la lógica y la memoria mediante tecnologías patentadas de Manifold-Constrained Hyper-Connections (mHC) y Engram Memory.

- Beneficio clave: Más allá de solo generar fragmentos de código, v4 actúa como un arquitecto senior, comprendiendo estructuras completas de repositorios para el razonamiento entre archivos y la resolución de errores complejos.

- Estado: Próximo lanzamiento (esperado para mediados de febrero de 2026).

¿Por qué estamos seguros de que DeepSeek v4 cambiará las reglas del juego? Porque resuelve el mayor punto de dolor de la industria: la IA necesita recordar y comprender la lógica de un proyecto.

📣 Actualización — 24 de abril de 2026: DeepSeek-V4 se ha lanzado oficialmente. Lee nuestra cobertura completa sobre lo que realmente se lanzó, incluyendo la nueva arquitectura de atención dispersa (sparse attention), el contexto de 1M de tokens y los resultados en el benchmark de agentes, en Lanzamiento de la vista previa de DeepSeek-V4.

Análisis técnico: Características clave

Para desafiar a Claude Opus 4.5, DeepSeek ha reconstruido el modelo desde cero. Los documentos filtrados indican un cambio fundamental en cómo el modelo maneja la memoria y la estabilidad lógica. Analicemos los cuatro pilares de esta actualización.

Arquitectura: Razonamiento lógico superior

-

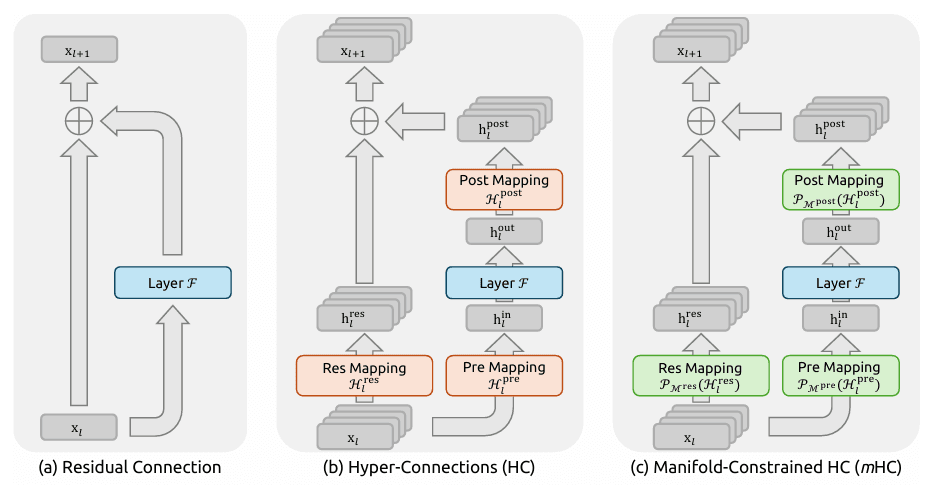

Manifold-Constrained Hyper-Connections (mHC)

- El concepto: DeepSeek v4 inventa un nuevo método de "cableado neuronal". Las conexiones tradicionales a menudo pierden información en redes profundas, pero mHC actúa como una "superautopista lógica" para el cerebro de la IA.

- El resultado: Al manejar lógica masiva y compleja (como refactorizar miles de líneas de código), el modelo aprende más rápido y retiene mejor la lógica. Esto elimina las "alucinaciones lógicas" e inconsistencias comunes en la generación de contextos largos.

Eficiencia: Menores costos de inferencia

-

Mixture-of-Experts (MoE) 2.0

- El concepto: Aunque v4 es un gigante en parámetros (cientos de miles de millones), utiliza una arquitectura MoE optimizada para activar solo a los "expertos" más relevantes para cada token.

- El resultado: Logra un equilibrio perfecto entre Alta Capacidad (base de conocimientos masiva) y Escalado Eficiente (ejecutándose tan ligero como un modelo más pequeño).

-

Atención dispersa (Sparse Attention)

- El concepto: Abandonando el método de fuerza bruta de escanear todo el texto, el modelo ahora se enfoca inteligentemente solo en la información clave. Esto reduce drásticamente los costos de cómputo y acelera el procesamiento de contexto largo.

Memoria: Gestión inteligente del contexto

-

Engram Memory (Almacenamiento y recuperación selectiva)

- El concepto: La IA deja de memorizar por repetición y comienza a "comprender". Reconoce estructuras de proyectos, sigue convenciones de nombres (snake_case vs. camelCase) e identifica patrones de codificación (imitando los patrones específicos de fábrica de tu equipo).

- El resultado: Programa como un empleado con experiencia.

-

Multi-Head Latent Attention (MLA)

- El concepto: Piensa en esto como una "taquigrafía avanzada". Donde otros modelos necesitan 100 tokens para almacenar información, MLA la comprime en 10 símbolos clave.

- El resultado: Cuando se necesita la recuperación, el modelo reconstruye matemáticamente el significado original sin pérdidas. Esto mantiene una retención de detalles increíble con un uso de VRAM significativamente menor.

Aplicación: Ingeniería en el mundo real

- Comprensión a nivel de repositorio y resolución de errores

- El objetivo no es solo escribir una función, sino controlar el código base. En las pruebas de SWE-bench, DeepSeek v4 tiene como objetivo resolver más del 80.9% de los problemas complejos del mundo real mediante la comprensión de las dependencias entre archivos.

Casos de uso: Reducción de costos y aumento de eficiencia

DeepSeek v4 está diseñado para la ingeniería de alto nivel. Así es como se compara con la competencia:

Refactorización de código heredado

Para sistemas heredados caóticos y sin documentación, la arquitectura mHC es un salvavidas. Rastrea dependencias lógicas de larga distancia para una refactorización segura.

- VS GPT-4o: GPT-4o a menudo sufre de "alucinaciones lógicas" (inventando llamadas a funciones inexistentes) cuando el contexto supera los 10k tokens. DeepSeek v4 mantiene una consistencia lógica del 100% en contextos largos.

- VS Claude 3.5 Sonnet: Aunque Sonnet es de alta calidad, es lento y costoso para trabajos de refactorización masivos. La arquitectura MoE de DeepSeek v4 ofrece velocidades de inferencia ~40% más rápidas a un costo menor en Atlas Cloud.

Desarrollo de funciones a nivel de repositorio

Al agregar una nueva API a un proyecto maduro, v4 utiliza "Engram Memory" para captar el contexto al instante.

- VS Autocompletado tradicional: Las herramientas estándar a menudo ignoran las normas específicas del proyecto, introduciendo inconsistencias de estilo. DeepSeek v4 imita tu código base existente tan bien que parece un copiar y pegar de tu mejor desarrollador.

Seguimiento de errores de enlace completo

Apuntar a una tasa de éxito del 80.9% en SWE-bench significa manejar errores que abarcan frontend, backend y bases de datos.

- VS Claude Opus 4.5 (esperado): Es probable que Opus 4.5 sea potente, pero con un precio premium. DeepSeek v4 ofrece un rendimiento casi SOTA a un precio que permite ciclos iterativos de "reflexión y corrección" sin arruinar el presupuesto.

📉 Conclusión: ROI para equipos

Para startups y equipos de desarrollo, la combinación de DeepSeek v4 + AtlasCloud ofrece un ROI tangible:

- Productividad: Reduce el tiempo de codificación para desarrolladores senior en un 30-50%.

- Costo: Comparado con alquilar servidores con doble RTX 4090 o pagar por APIs de código cerrado, la API integrada de AtlasCloud puede ahorrar a los equipos más del 60% en costos totales de cómputo.

La línea roja del hardware: ¿Alojamiento local? Piénsalo dos veces.

A estas alturas, podrías sentir la tentación de ejecutar este "Dios de la codificación" en tu máquina local. Pero tenemos que darte un golpe de realidad: El rendimiento tiene un precio.

- Entrada mínima: Doble RTX 4090

- Traducción: Estás comprando dos de las GPU de consumo más caras del mercado y conectándolas. El costo de las GPU por sí solo es aproximadamente equivalente a 3 dispositivos iPhone 17 Pro Max (o un automóvil usado decente).

- Recomendado: RTX 5090 individual (Insignia 2026)

- Traducción: Este es el "Ferrari" de las GPU. El precio será altísimo debido a los revendedores y la disponibilidad será escasa.

Con los precios de las GPU manteniéndose altos, pregúntate: ¿Vale la pena gastar miles de dólares y lidiar con el ruido de los ventiladores, el calor y la configuración del entorno solo para ejecutar un modelo?

La solución inteligente: Acceso desde el día 0 en Atlas Cloud

No necesitas ser rico para usar DeepSeek v4; solo necesitas ser inteligente. En lugar de comprar "ladrillos electrónicos" que se deprecian, elige la nube.

AtlasCloud está listo para el lanzamiento:

-

Nuestra promesa: Disfruta tus vacaciones. Déjanos a nosotros el trabajo sucio del despliegue. Monitoreamos los canales de lanzamiento oficial las 24 horas del día, los 7 días de la semana.

-

Ventajas principales:

- Acceso instantáneo: Tan pronto como salgan los pesos de código abierto, nuestra integración de API estará activa.

- Cero barreras: Sin hardware costoso, sin el infierno de las dependencias de CUDA. Solo trae tu Prompt.

- Experiencia sin concesiones: Proporcionamos soporte completo de contexto, asegurando que el mecanismo de memoria "Engram" funcione al 100% de su capacidad sin pérdida por cuantización.

Cómo usarlo en Atlas Cloud

Atlas Cloud te permite usar modelos uno al lado del otro, primero en un área de pruebas (playground) y luego a través de una única API.

Método 1: Úsalo directamente en el playground de Atlas Cloud

Método 2: Acceso vía API

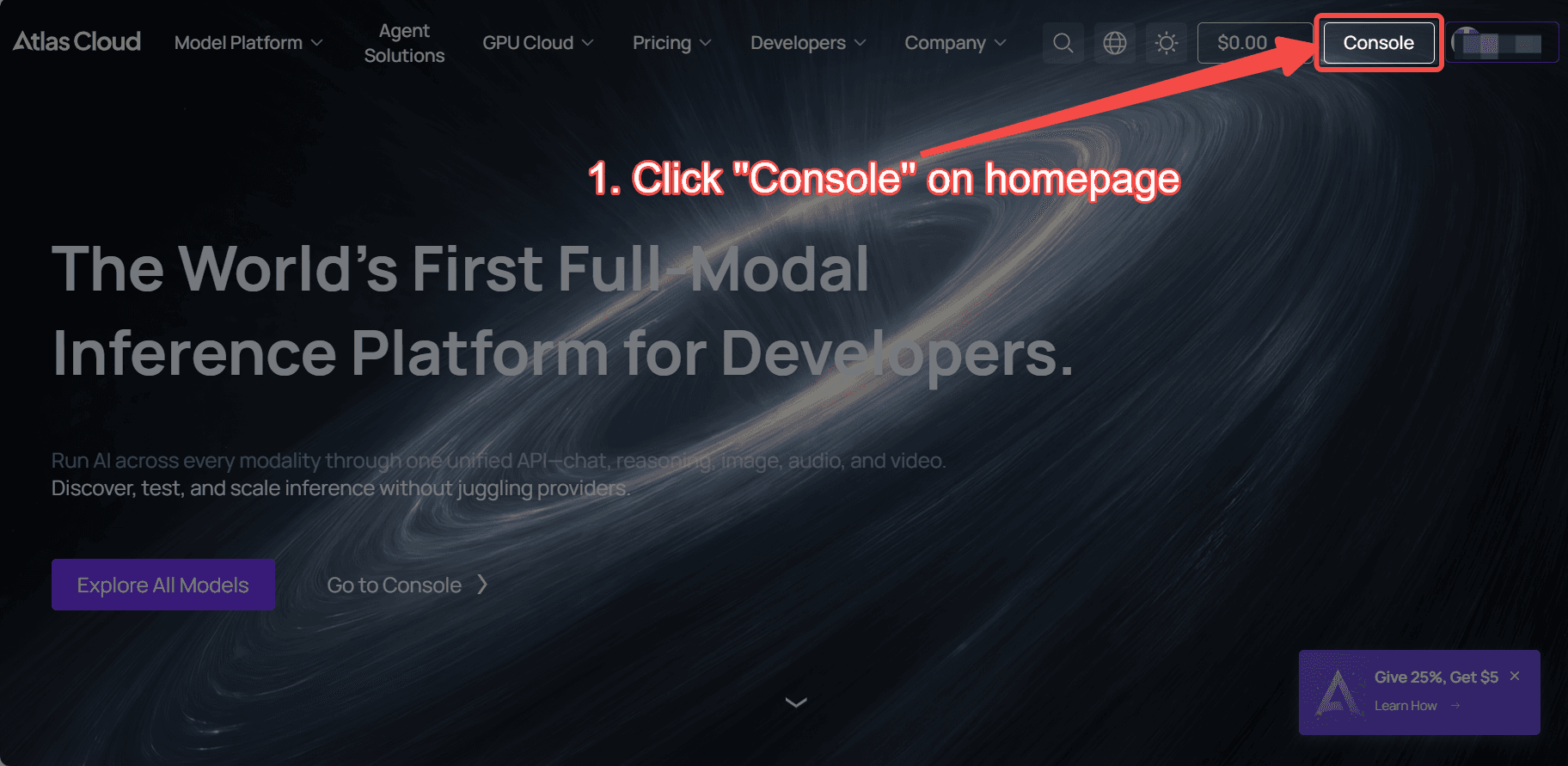

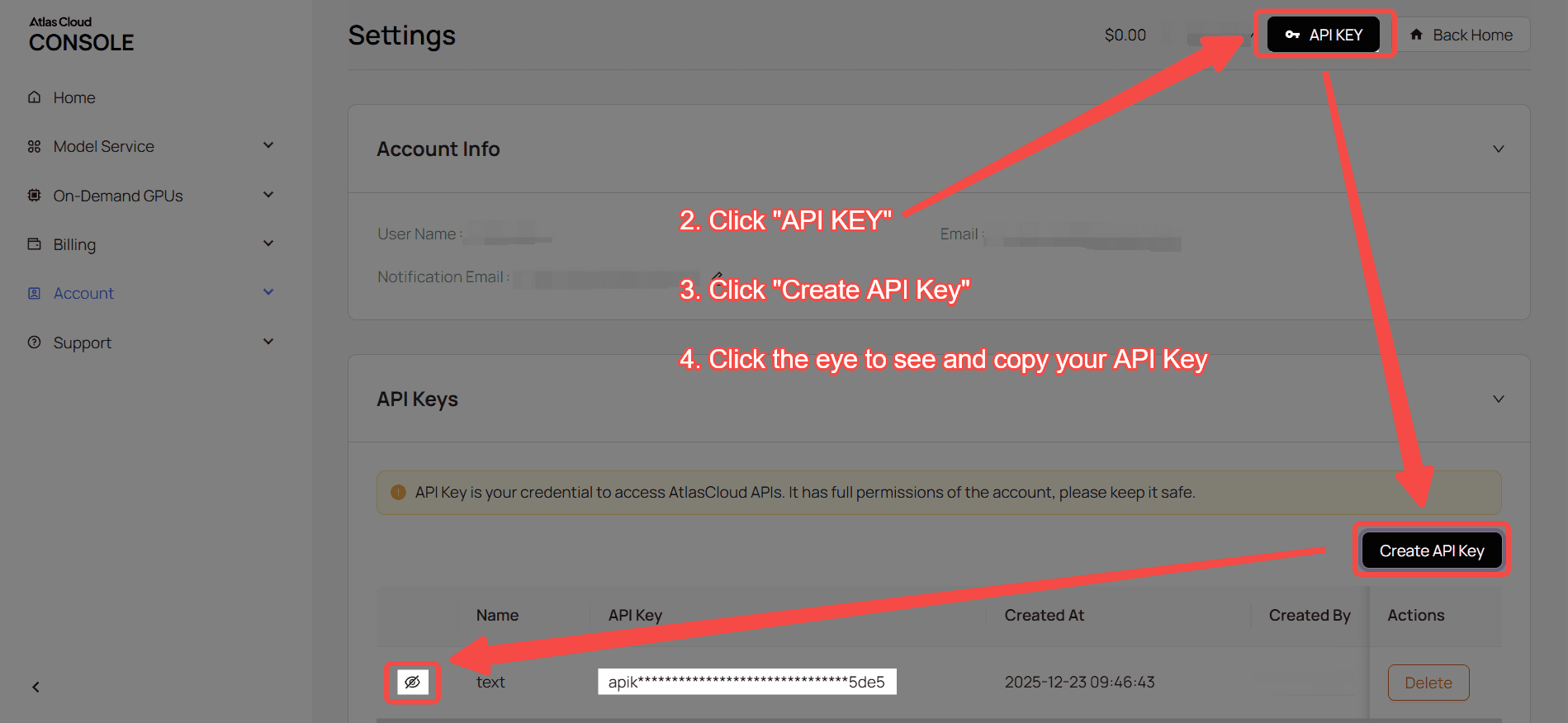

Paso 1: Obtén tu clave de API

Crea una clave de API en tu consola y cópiala para usarla más tarde.

Paso 2: Revisa la documentación de la API

Revisa el endpoint, los parámetros de solicitud y el método de autenticación en nuestra documentación de la API.

Paso 3: Realiza tu primera solicitud (ejemplo en Python)

Ejemplo: genera contenido con DeepSeek v3.2:

plaintext1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "deepseek-ai/deepseek-v3.2", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "what is difference between http and https" 14 } 15 ], 16 "max_tokens": 32768, 17 "temperature": 1, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())