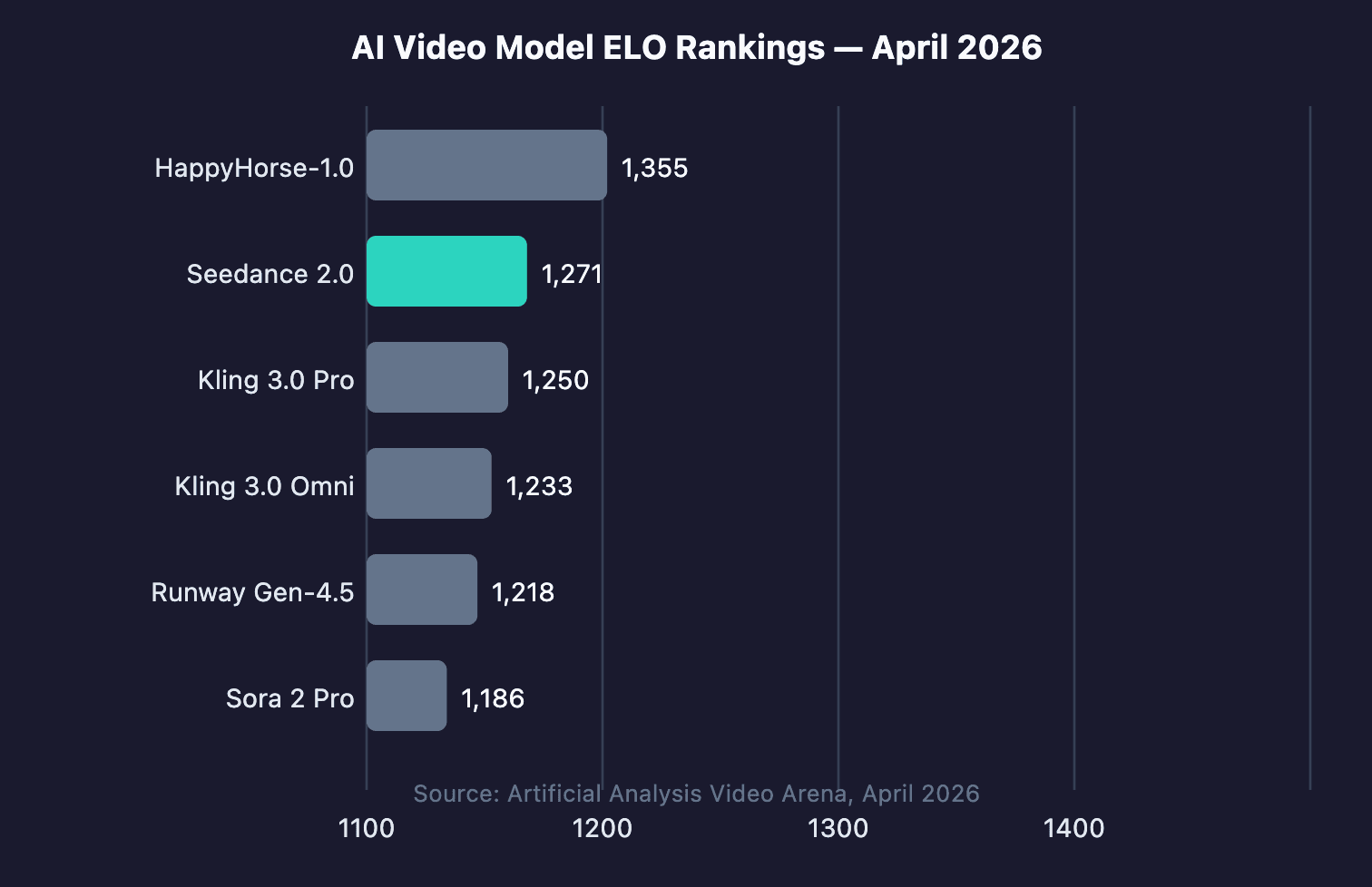

Si has estado buscando una guía clara y práctica sobre cómo usar Seedance 2.0, has llegado al lugar indicado. Un vídeo de marketing de 60 segundos solía tardar 13 días en producirse. Con herramientas de vídeo por IA como Seedance 2.0, el mismo trabajo ahora toma 27 minutos, una reducción del 99,7% en el tiempo de producción (Zebracat vía AutoFaceless, 2026). ByteDance lanzó Seedance 2.0 el 12 de febrero de 2026, y actualmente ocupa el segundo lugar a nivel mundial en el Artificial Analysis Video Arena con un ELO de 1.271.

Esta guía cubre todos los métodos de acceso principales sobre cómo usar Seedance 2.0 en EE. UU., India u otros países fuera de China.

Puntos clave

- Seedance 2.0 está disponible globalmente a través de Dreamina y CapCut. No requiere VPN ni número de teléfono chino.

- El nivel gratuito en Dreamina ofrece 225 tokens diarios (con marca de agua). Los planes de pago comienzan en $18/mes.

- Para desarrolladores en EE. UU. y a nivel internacional, Atlas Cloud ofrece el acceso a API más asequible a USD0.081/seg.

- El modelo acepta texto, imágenes, audio y vídeo en una sola pasada multimodal usando la sintaxis @AssetName.

- El 91% de las empresas utilizan vídeo marketing en 2026 (Wyzowl vía Ngram, 2026). La producción con IA reduce los costes hasta en un 91% frente al vídeo tradicional.

Cómo usar Seedance 2.0 gratis: Tutoriales paso a paso

Saber cómo usar Seedance 2.0 gratis es la primera pregunta que hacen la mayoría de los usuarios. Dreamina ofrece 225 tokens diarios compartidos sin coste, suficientes para generar aproximadamente 10–15 clips cortos al día.

Opción gratuita 1: Dreamina (Recomendado)

Paso 1: Ve a dreamina.capcut.com en cualquier navegador. No requiere descarga. La plataforma está disponible globalmente. Regístrate gratis usando tu cuenta de Google, Apple ID o correo electrónico. No se necesita tarjeta de crédito.

Paso 2: Haz clic en "Create" en la barra lateral izquierda para abrir el panel de generación de vídeo. Selecciona Seedance 2.0 en el menú desplegable de modelos en la parte superior del panel. Verás las variantes Standard y Fast.

Paso 3: Escribe tu prompt usando la fórmula de cinco partes: Sujeto + Acción + Entorno + Estado de ánimo + Movimiento de cámara. Ejemplo: "Una taza de café de cerámica sobre una mesa de madera, vapor subiendo, luz de cocina cálida, movimiento lento de cámara (dolly push forward)". Define la duración (se recomiendan 4–8 segundos para el nivel gratuito) y la relación de aspecto (16:9 para pantalla panorámica, 9:16 para redes sociales verticales).

Paso 4: Haz clic en "Generate". Cada clip consume aproximadamente 15–20 tokens. Tus 225 tokens diarios se actualizan cada 24 horas. Descarga tu vídeo. Los resultados del nivel gratuito incluyen una marca de agua. Actualiza al plan Standard de $18/mes para eliminarla.

Opción gratuita 2: Aplicación CapCut

CapCut comparte un conjunto de tokens con Dreamina bajo la misma cuenta de ByteDance. Descarga CapCut desde la App Store o Play Store, inicia sesión con la misma cuenta y toca "AI Video" para acceder a Seedance 2.0. Los tokens son compartidos; gastarlos en CapCut reduce tu saldo de Dreamina y viceversa.

API de Seedance 2.0 para desarrolladores

Para desarrolladores y empresas, la ruta de la API a través de Atlas Cloud es la integración más rápida y rentable.

Atlas Cloud es una plataforma de agregación de API de IA que brinda a desarrolladores y empresas acceso unificado a más de 300 modelos de IA, incluyendo las seis variantes de Seedance 2.0. Funciona mediante una única clave API, un único panel de facturación y una única URL base. Es la forma más rápida de integrar Seedance 2.0 en cualquier aplicación, flujo de trabajo o producto sin lidiar con los contratos empresariales directos de ByteDance.

Características clave de Atlas Cloud

- Más de 300 modelos de IA (vídeo, imagen, LLM, audio) mediante una sola clave API

- Las 6 variantes de Seedance 2.0: texto a vídeo, imagen a vídeo, referencia a vídeo (Standard y Fast)

- Seedance 2.0 Fast a USD0.081/seg. El coste más bajo entre las principales plataformas

- Endpoints compatibles con el SDK de OpenAI (sustitución directa)

- Pago por uso, sin suscripciones mensuales

- SLA de tiempo de actividad del 99,9% con cumplimiento de datos internacionales

- Integración con servidor MCP para más de 100 clientes IDE

- Acepta tarjeta de crédito, PayPal, criptomonedas, WeChat Pay, Alipay

Método 1: Usar directamente en el Playground de Atlas Cloud

No se requiere código. Ve a atlascloud.ai, regístrate, navega a la página de Modelos, encuentra Seedance 2.0 y haz clic en "Try in Playground". Escribe tu prompt, elige tus ajustes y genera directamente en el navegador. Es la forma más rápida de validar una idea antes de conectar la API.

Método 2: Acceso mediante API

Paso 1: Obtén tu clave API

Dirígete a atlascloud.ai/console/api-keys. Haz clic en Create API Key, nómbrala y cópiala inmediatamente; solo se muestra una vez. Guárdala en tu entorno como ATLASCLOUD_API_KEY.

Paso 2: Consulta la documentación de la API

La referencia completa está en atlascloud.ai/docs. Encontrarás cada parámetro, todos los IDs de los modelos, el endpoint de carga para archivos de referencia y el ciclo de vida de sondeo (polling). Vale la pena leerlo 5 minutos antes de construir.

Paso 3: Realiza tu primera solicitud

El flujo es siempre el mismo: enviar un trabajo de generación → obtener un ID de predicción → realizar sondeos hasta completar → obtener la URL del vídeo. Aquí tienes un ejemplo funcional en Python para comenzar:

python1import requests 2import time 3 4# Paso 1: Iniciar la generación de vídeo 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/text-to-video", # Obligatorio. Nombre del modelo 12 "prompt": "A cinematic view of the endless ocean at sunrise, golden sunlight spreading " 13 "across the deep blue sea, powerful waves rising and crashing with white foam. " 14 "The camera flies low above the water surface, water droplets and mist glowing " 15 "in the light. Epic cinematic atmosphere, 4K.", 16 "duration": 5, # Duración del vídeo en segundos (4–15), o -1 para auto 17 "resolution": "720p", # opciones: 480p | 720p 18 "ratio": "adaptive", # 9:16 | 16:9 | 1:1 | 4:3 | adaptive 19 "generate_audio": True, # Generar voz sincronizada, SFX y música de fondo 20 "watermark": False, 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24prediction_id = generate_response.json()["data"]["id"] 25 26# Paso 2: Sondear el resultado 27poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 28 29def check_status(): 30 while True: 31 response = requests.get( 32 poll_url, 33 headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"} 34 ) 35 result = response.json() 36 status = result["data"]["status"] 37 38 if status in ["completed", "succeeded"]: 39 video_url = result["data"]["outputs"][0] 40 print("Generated video:", video_url) 41 return video_url 42 elif status == "failed": 43 raise Exception(result["data"].get("error", "Generation failed")) 44 else: 45 time.sleep(2) # Procesando — revisar de nuevo en 2 segundos 46 47video_url = check_status()

El nivel Seedance 2.0 Fast de Atlas Cloud cuesta USD0,081 por segundo, frente a Kling 3.0 a USD0,153/seg. Las cargas de archivos de referencia no cuentan para la facturación; solo se te cobra por la duración del vídeo generado. Las nuevas cuentas reciben USD1 de crédito gratuito sin necesidad de tarjeta de crédito (Documentación de Atlas Cloud, 2026).

¿Qué es Seedance 2.0 y por qué es importante?

En abril de 2026, Seedance 2.0 obtuvo una puntuación ELO de 1.271 en el Artificial Analysis Video Arena, ubicándose en segundo lugar a nivel mundial y en primero entre todos los modelos capaces de generar audio con 1.221 puntos. Esa clasificación refleja algo real: es uno de los pocos modelos que maneja texto, imágenes, clips de vídeo y audio en una única pasada unificada, en lugar de encadenar herramientas separadas.

ByteDance creó Seedance 2.0 dentro de su laboratorio SEED y lo lanzó públicamente el 12 de febrero de 2026. La arquitectura se denomina generación conjunta de audio y vídeo multimodal unificada. Lo que esto significa en la práctica: proporcionas un prompt, imágenes de referencia opcionales, un clip de vídeo y un archivo de audio, y el modelo los procesa todos juntos. Sin paso de sincronización de audio por separado. Sin flujo de trabajo manual de sincronización labial.

La resolución de salida alcanza hasta 1080p a través de la interfaz de Dreamina y 720p a través de la API. Puedes generar clips de entre 4 y 15 segundos en seis relaciones de aspecto: 21:9, 16:9, 4:3, 1:1, 3:4 y 9:16. Esa última es fundamental para contenido social. Cada salida lleva una marca de agua de procedencia C2PA incrustada en los metadatos del archivo.

¿Por qué importa la brecha de ELO? Kling 3.0 Pro puntúa 1.250 y Runway Gen-4.5 puntúa 1.218. Esas brechas de 21 a 53 puntos se traducen en un movimiento notablemente más limpio y una mejor adherencia al prompt en escenas complejas. Vale la pena realizar tu propia prueba A/B en tu caso de uso específico, pero Seedance 2.0 tiende a ganar en movimientos de cámara cinemáticos y audio multilingüe.

Seedance 2.0 obtuvo un ELO de 1.271 en el Artificial Analysis Video Arena en abril de 2026, ocupando el segundo lugar a nivel mundial entre todos los modelos de texto a vídeo y el primero entre los modelos capaces de audio, que puntuaron 1.221 en una sub-tabla de clasificación de audio paralela (Artificial Analysis Video Arena, abril de 2026).

El mercado de vídeo por IA se está acelerando rápidamente. Fortune Business Insights situó el mercado global de generadores de vídeo por IA en USD716,8 millones en 2025, creciendo a USD847 millones en 2026, un aumento interanual del 18,8%. Grand View Research, también en 2026, valora el mercado en USD946,4 millones con una tasa de crecimiento anual compuesta del 20,3% hasta 2033. Ambas cifras confirman que esto no es un experimento de nicho. Es un mercado donde las decisiones de herramientas que se tomen ahora se verán multiplicadas durante años.

Prompts avanzados de Seedance 2.0 y entradas multimodales

En 2026, el 63% de los profesionales del vídeo marketing utilizaron herramientas de IA para crear o editar vídeos de marketing, según Wyzowl vía Ngram. La diferencia entre resultados promedio y resultados de grado profesional reside en la precisión del prompt. Las entradas multimodales de Seedance 2.0 hacen que los prompts sólidos sean aún más impactantes, pero también introducen modos de fallo que la mayoría de las guías no cubren.

Uso de etiquetas de referencia @AssetName

La sintaxis @AssetName es cómo vinculas los archivos cargados a roles específicos en la escena. Puedes cargar una imagen de producto, un vídeo de fondo y un archivo de música de fondo, luego escribir: "@product_front en un escritorio minimalista, órbita lenta, jazz @ambient_track sonando suavemente". El modelo utiliza la imagen como ancla visual, el clip de vídeo como referencia de movimiento y el audio para la capa sonora. Esta es la ventaja principal sobre la generación basada solo en texto.

Opciones de control de cámara

Seedance 2.0 admite tres movimientos de cámara con nombre: dolly (movimiento hacia adelante/atrás), pan (rotación izquierda/derecha) y push (zoom con movimiento). Estos son términos a nivel de director, así que trátalos como literales en tu prompt. "Slow dolly push forward" producirá un resultado diferente a "zoom in". Usa un movimiento de cámara por clip. Apilar dos movimientos en un solo clip de 8 segundos generalmente produce artefactos visuales.

Errores en los prompts y soluciones

Aquí hay un patrón que aparece constantemente. Los prompts vagos producen resultados vagos. Considera la diferencia entre estos dos prompts para la misma toma de producto:

Antes (débil): "Muestra una botella de agua en un entorno agradable con buena iluminación." Después (fuerte): "@bottle Botella de agua azul translúcida sobre una superficie de piedra mojada, gotas de agua capturando la luz de la mañana, fondo de bosque borroso, slow dolly push, tono cinemático frío."

La versión débil produce una maqueta de estudio genérica. La versión fuerte genera algo que realmente podrías usar en un anuncio. ¿Qué cambió? Especificidad en la textura de la superficie, fuente de iluminación, profundidad del fondo y movimiento de cámara. El modelo responde a sustantivos concretos y descriptores precisos, no a adjetivos como "agradable" o "bueno".

Seedance 2.0 admite control de cámara a nivel de director, incluidos movimientos de dolly, pan y push. Trata la dirección de cámara como instrucciones literales en cada prompt. Fuente: Unsplash / Harrison Kugler.

Seedance 2.0 acepta hasta 12 archivos de referencia por solicitud —una mezcla de 9 imágenes, 3 clips de vídeo y 3 archivos de audio— todos procesados en una sola pasada multimodal usando la sintaxis @AssetName para referencias dirigidas. Ningún competidor en los 6 primeros puestos del ranking ELO ofrece este nivel de control de entrada combinado (Documentación del laboratorio SEED de ByteDance, 2026).

Preguntas frecuentes sobre Seedance 2.0

1. ¿Es Seedance 2.0 gratis?

Sí, hasta cierto punto. El nivel gratuito de Dreamina incluye 225 tokens diarios compartidos y añade una marca de agua a todos los resultados. Los planes de pago comienzan en $18/mes para Standard, lo que elimina las marcas de agua y aumenta los límites de tokens. Los usuarios activos mensuales de plataformas de vídeo por IA alcanzaron los 124 millones en enero de 2026 (Ngram, 2026), por lo que los niveles gratuitos pueden congestionarse durante las horas punta.

2. ¿Cuál es la duración máxima de vídeo que puede generar Seedance 2.0?

La duración máxima de un solo clip es de 15 segundos tanto a través de la interfaz de Dreamina como de la API. El mínimo es de 4 segundos. Para vídeos más largos, encadena varios clips usando activos de referencia consistentes mediante la etiqueta @AssetName. Esto coincide con la forma en que se estructuran los flujos de trabajo profesionales de vídeo por IA en la mayoría de los modelos de primer nivel en 2026.

3. ¿Cómo se compara Seedance 2.0 con Sora 2 en cuanto a costes?

A nivel de API, Seedance 2.0 vía Atlas Cloud Fast cuesta USD0,022 por segundo, lo que sitúa un clip de 10 segundos en USD0,22. Sora 2 cuesta aproximadamente USD0,15 por segundo, haciendo que el mismo clip cueste USD1,50. Eso es aproximadamente una ventaja de coste de 7x para Seedance 2.0. Dada su puntuación ELO de 1.271 frente a los 1.186 de Sora 2 Pro, la relación calidad-coste favorece claramente a Seedance (Atlas Cloud, marzo de 2026).

4. ¿Puedo usar las salidas de Seedance 2.0 comercialmente?

El uso comercial está permitido en los niveles de pago de Dreamina y a través de la API, sujeto a los términos de servicio de ByteDance. Cada resultado lleva metadatos de procedencia C2PA integrados, que algunas plataformas publicitarias y herramientas de seguridad de marca pueden detectar. Revisa la política de divulgación de contenido de IA de cada plataforma antes de ejecutar campañas de pago. La producción tradicional cuesta USD4.500/min frente a la IA a USD400/min (vidBoard.ai, 2026), por lo que cumplir con las normativas es importante.

5. ¿Cuánto tiempo tarda la generación por API?

El tiempo de generación a través de la API de AtlasCloud oscila entre 30 y 120 segundos por clip. Utiliza el patrón asíncrono de enviar-sondear-descargar en lugar de una solicitud bloqueante. Para flujos de trabajo por lotes, envía todos los trabajos primero y luego realiza sondeos para obtener los resultados.

6. ¿Cómo uso Seedance 2.0 fuera de China sin una VPN?

No se necesita VPN. Cómo usar Seedance 2.0 fuera de China: visita dreamina.capcut.com directamente desde cualquier país. Dreamina es la plataforma internacional, totalmente separada de Jimeng (solo para China). Está disponible en más de 130 países, incluidos EE. UU., Reino Unido, India, Japón y la mayor parte de Europa. Para el acceso a la API, Atlas Cloud y fal.ai son accesibles globalmente sin restricciones geográficas.

7. ¿Cómo uso Seedance 2.0 en CapCut?

Descarga CapCut desde tu tienda de aplicaciones, inicia sesión, toca "AI Video", selecciona Seedance 2.0 en el selector de modelos, escribe tu prompt, configura la relación de aspecto y la duración, y toca Generar. CapCut comparte el mismo conjunto de tokens que Dreamina en la misma cuenta de ByteDance. ByteDance amplió el acceso global a CapCut en abril de 2026 a más de 150 países.

8. ¿Cómo uso la API de Seedance 2.0 como desarrollador?

Cómo usar la API de Seedance 2.0: regístrate en atlascloud.ai, crea una clave API, añade fondos a tu cuenta (mínimo de USD10). Realiza sondeos de estado cada 5 segundos hasta que el estado sea: "completed". Seedance 2.0 Fast cuesta USD0,022/seg: 7 veces más barato que Sora 2 a ~USD0,15/seg (Atlas Cloud, marzo de 2026).