Para 2026, la novedad de los "videos generados por IA" se ha desvanecido, reemplazada por una demanda de fidelidad visual total. El desafío principal sigue siendo el "valle inquietante", donde las herramientas gratuitas de IA de foto a video suelen sufrir de "derretimiento espacial" o parpadeo de luz que rompe la inmersión. Para los creadores, el "realismo" no es solo una estética; es el requisito técnico para contenido de calidad profesional.

La tabla comparativa de "Elección rápida"

| Nombre de la herramienta | Puntuación de realismo /10 | Acceso al nivel gratuito | Especialidad clave | Mejor para |

| Wan 2.7 | 9.8 | 10 créditos diarios (1 video) | Lógica cinética y física | B-roll profesional y realismo |

| Runway Gen-4 Turbo | 9.5 | Regístrate para obtener 125 créditos | Manipulación directa | Control creativo preciso |

| Google Veo 3.1 | 9.3 | Estipendio diario del Creative Lab | Color profundo y entorno | Narrativa cinematográfica |

| Kling 3.0 | 9 | Regístrate para obtener 66 créditos | Consistencia anatómica | Moda y retratos |

| Pika Labs | 8.8 | Regístrate para obtener 80 créditos | Realismo atmosférico | Efectos de clima e iluminación |

| Vidu 2.0 | 8.7 | Regístrate para obtener 20 créditos | Profundidad espacial 3D | Dolly zooms y movimientos de cámara |

| WAN 2.6 | 8.5 | 10 créditos diarios (1 video) | Micro-movimiento sutil | Naturaleza y fondos |

| PixVerse | 8.4 | 60 créditos gratuitos diarios | Mapeo facial | Fotos parlantes y sincronización labial |

| Hailuo 2.3 | 8.2 | Regístrate para recibir 300 créditos, válidos por 3 días | Velocidad de generación | Prototipado social rápido |

| Van 2.6 | 8 | 10 créditos diarios (1 video) | Consistencia heredada | Contenido de gran volumen |

Los 3 grandes: Los líderes de "calidad de producción"

El panorama de las herramientas gratuitas de IA de foto a video ha cambiado hacia la "Lógica Cinética", donde la IA comprende la gravedad y la luz antes de renderizar píxeles. Estos tres modelos se posicionan actualmente como los modelos de video por IA mejor clasificados para obtener resultados de calidad profesional.

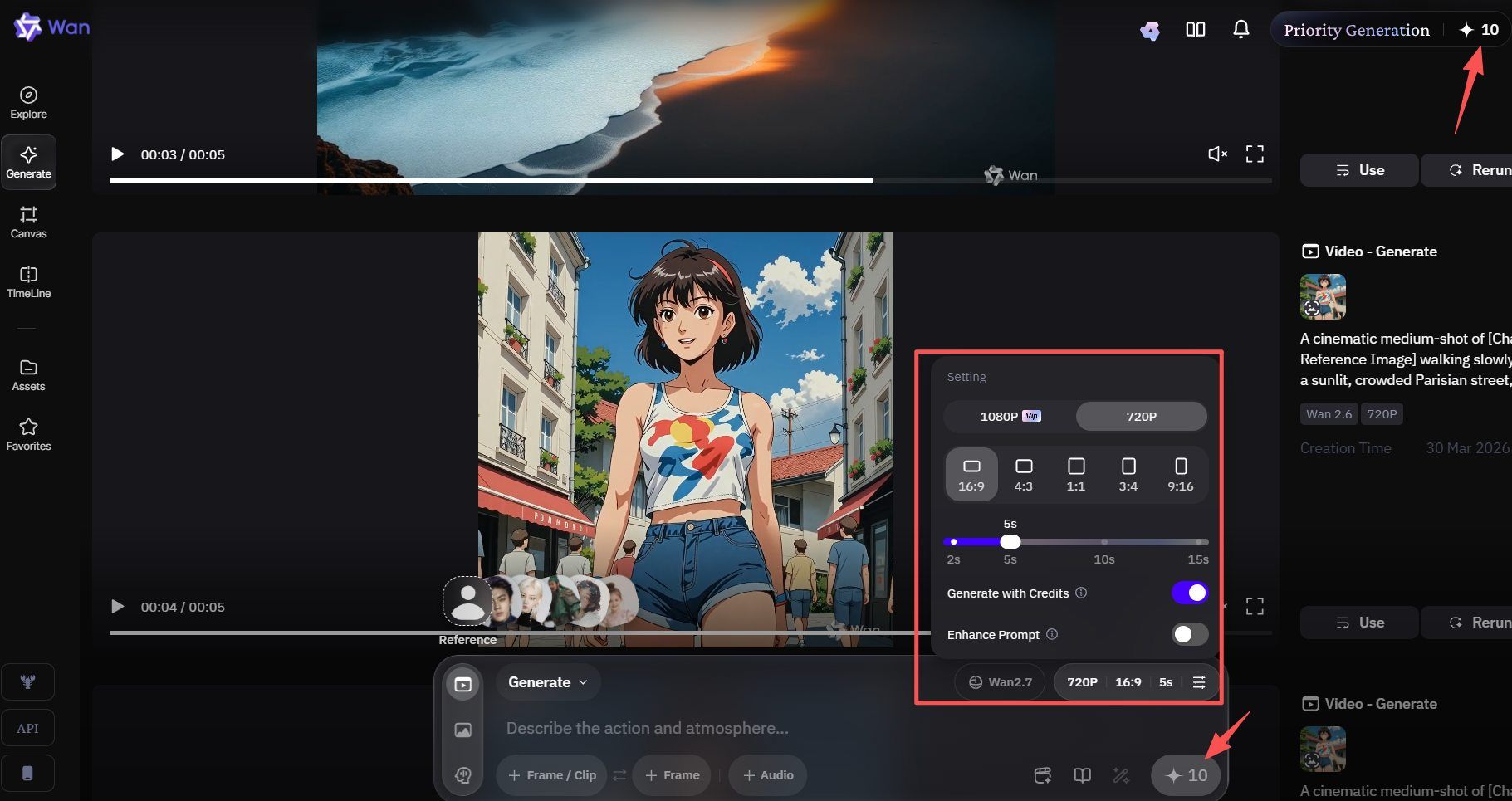

Wan 2.7 Image-to-Video (El rey de la física)

Wan 2.7 es ahora uno de los modelos de video por IA mejor clasificados en la línea Qwen para 2026. Es la herramienta de video por IA más realista disponible en este momento. Esta versión es un gran avance respecto a Wan 2.6, ya que ofrece detalles mucho más nítidos y movimientos más fluidos que los modelos anteriores.

Para ahorrarme la molestia de eliminar marcas de agua, utilicé WAN 2.7 de Atlas Cloud para generar directamente un video de 5 segundos, lo cual me costó $0.75.

La ventaja: Síntesis y control avanzados

Wan 2.7 destaca porque maneja cada parte de la creación de video en un solo lugar. Convierte fotos estáticas en escenas cinematográficas con facilidad. Se pueden crear clips claros en 1080P con una duración de 2 a 15 segundos. Además, este modelo se mantiene nítido y asegura que su visión se vea exactamente como debe ser.

Las ventajas técnicas clave incluyen:

- Control de primer y último fotograma: Esto permite a los creadores definir los puntos de inicio y fin de una escena, asegurando una transición lógica y fluida.

- Soporte de referencia múltiple: Esta herramienta utiliza hasta cinco clips a la vez. Ayuda a mantener a sus personajes y estilo consistentes en cada toma.

- Edición basada en instrucciones: Puede ajustar sus videos simplemente escribiendo notas sencillas. Funciona más como un compañero creativo que como una máquina básica.

- Síntesis de cuadrícula 3x3: Utilice este modo especial para crear prototipos rápidos. Permite probar muchas versiones diferentes de una escena lado a lado.

Métricas de rendimiento

Wan 2.7 supera constantemente a modelos comparables como Jimeng en sincronización de audio y física ambiental.

| Característica | Capacidad de Wan 2.7 |

| Resolución máx. | Alta definición 1080P |

| Duración del clip | 2 a 15 segundos |

| Flexibilidad de entrada | Imágenes de personas reales y referencias múltiples |

| Motor de consistencia | Lógica de movimiento consciente de la física |

Accesibilidad y nivel gratuito

Para aquellos que buscan una solución gratuita de IA de foto a video, Wan 2.7 ofrece un punto de entrada predecible y sostenible. Este sitio utiliza un sistema de regalo diario. Solo tiene que iniciar sesión y hacer clic en "Check In" para obtener 10 créditos gratis. Por lo general, se necesitan 10 créditos para hacer un video de alta calidad. Esto significa que puede crear un clip de nivel profesional cada día de forma gratuita. Este modelo lo convierte en la opción principal para narradores digitales y agencias de marketing boutique que buscan integrar video de alta calidad en su estrategia de contenido sin costos iniciales.

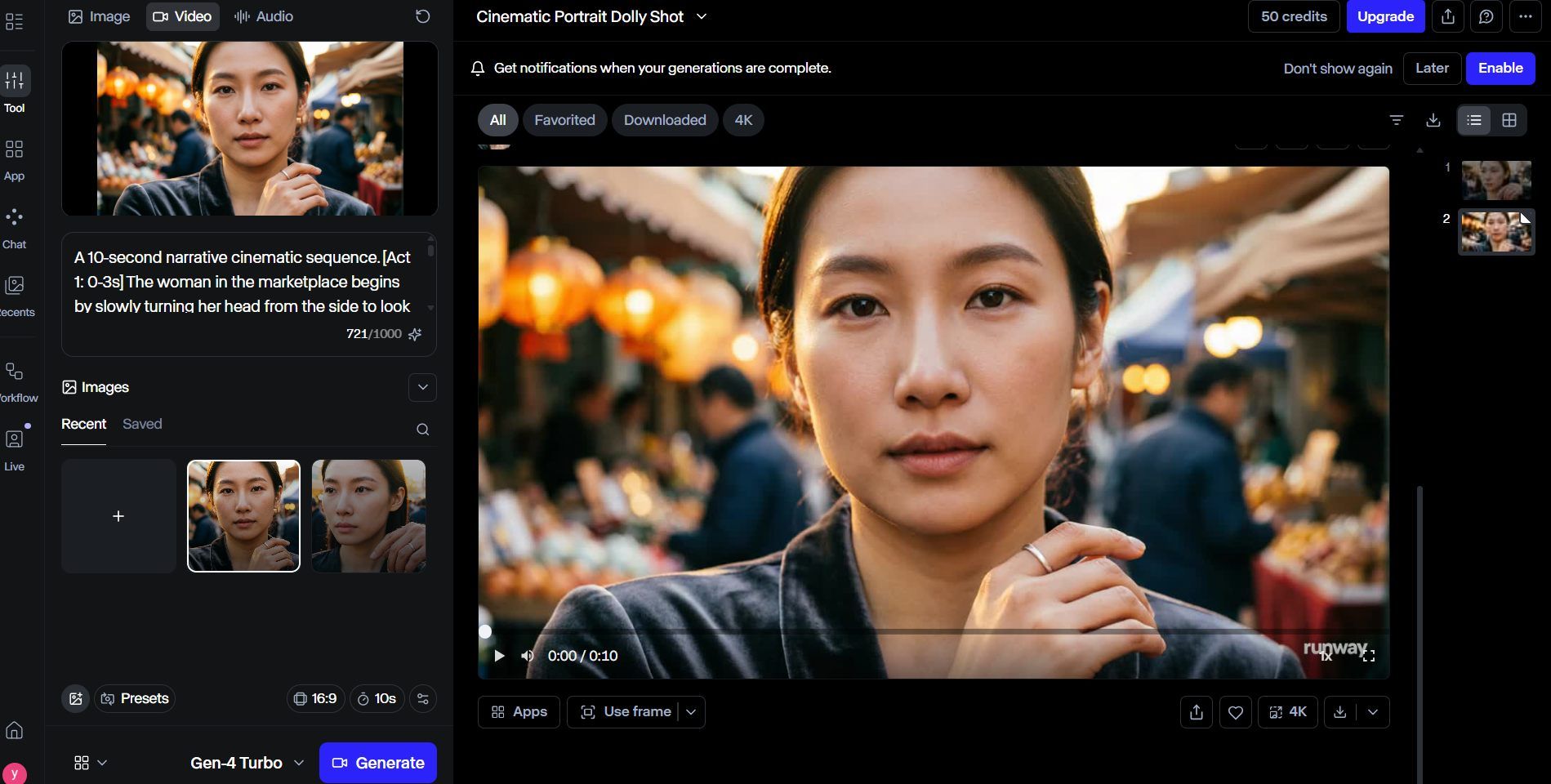

Runway Gen-4 Turbo (La herramienta de precisión)

Runway Gen-4 Turbo es una gran elección cuando necesita resultados rápidos que se vean increíbles. La gente lo clasifica como una herramienta de video líder para 2026. Fue creada para profesionales que necesitan trabajar rápido. Puede hacer muchas versiones de un proyecto y aun así mantener ese aspecto pulido y de alta calidad para cada clip.

La ventaja: La velocidad se encuentra con el control

El modelo "Turbo" está diseñado para la velocidad. Convierte sus imágenes en clips de 10 segundos en aproximadamente medio minuto. Muchas herramientas de video gratuitas pierden calidad cuando aceleran las cosas, pero esta no. Mantiene las texturas de alta calidad presentes en la versión estándar Gen-4. La herramienta más útil aquí es la Manipulación Directa. Le brinda control práctico sobre su foto. Simplemente arrastre áreas de la imagen para decirle a la IA exactamente cómo moverlas. Esto convierte los paneos, inclinaciones o zooms básicos en un trabajo de cámara deliberado y profesional en lugar de un movimiento aleatorio.

Rendimiento de un vistazo

Para ayudarle a entender cómo se compara Gen-4 Turbo con otros modelos, hemos analizado sus métricas de rendimiento clave basadas en nuestra auditoría de 2026:

| Métrica | Rendimiento de Gen-4 Turbo |

| Velocidad de generación | ~30 segundos (clip de 10s) |

| Enfoque en realismo | Retención de textura de alta fidelidad |

| Control de movimiento | Alto (Manipulación directa) |

| Mejor para | Anuncios en redes sociales, prototipado rápido |

Accesibilidad y nivel gratuito

Runway ofrece un punto de entrada accesible para aquellos que buscan explorar el generador de video por IA más realista de 2026. Las cuentas nuevas generalmente reciben 125 créditos no renovables, lo que permite realizar pruebas exhaustivas de las capacidades del modelo. Aunque esto opera con menor prioridad durante las horas pico de tráfico, sigue siendo una forma robusta de producir contenido de video de IA de alta calidad sin costo alguno.

Ya sea que usted sea un creador de redes sociales que necesita animar fotos de productos estáticos o un cineasta probando conceptos narrativos, Gen-4 Turbo proporciona el flujo de trabajo esencial de "creatividad primero" que define la generación de video moderna.

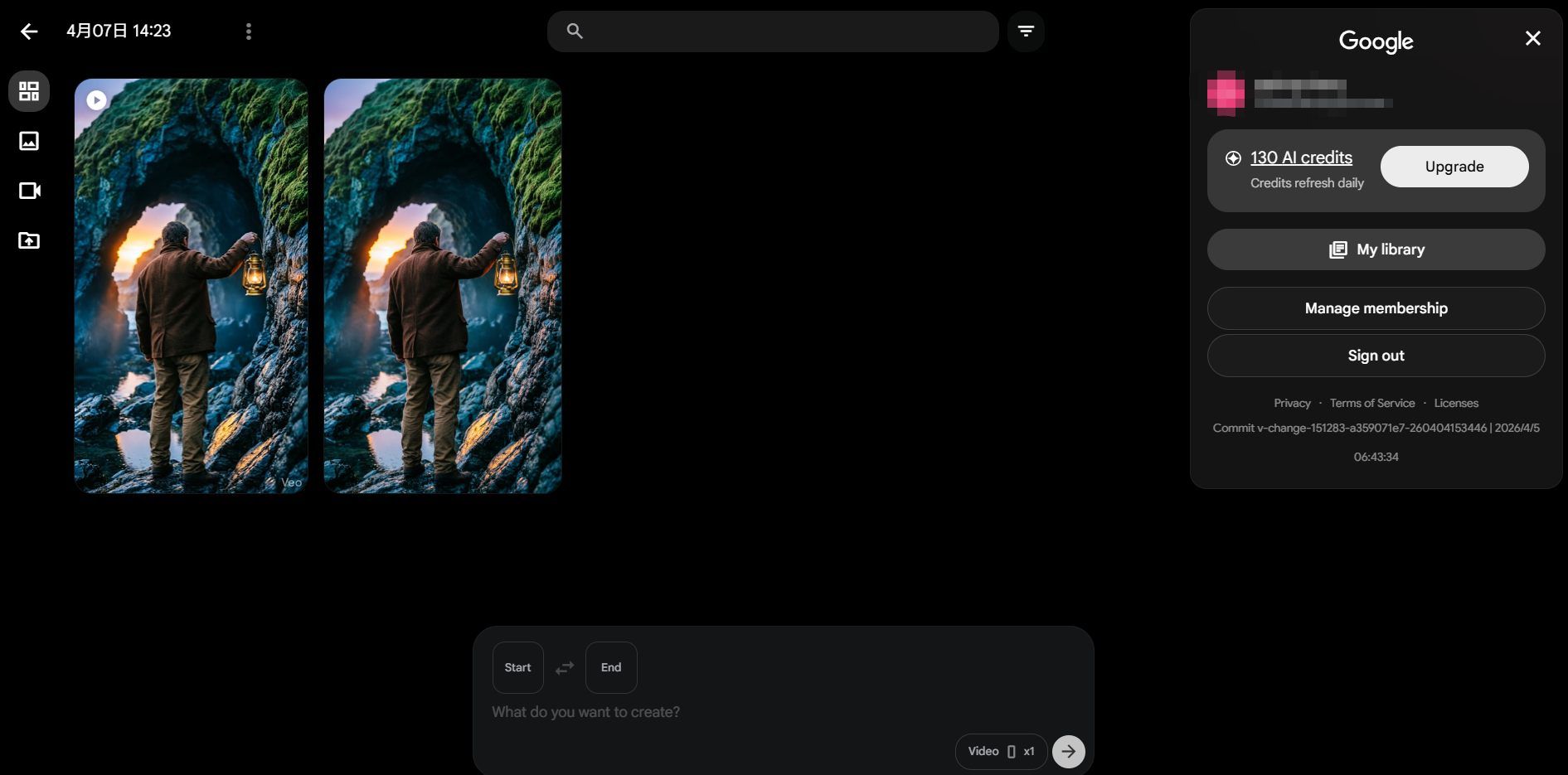

Google Veo 3.1 (El estándar cinematográfico)

Como el modelo creativo más capaz en el ecosistema Google DeepMind, Google Veo 3.1 ha consolidado su posición como un modelo de video por IA mejor clasificado al priorizar la textura artística y la profundidad narrativa. A diferencia de las herramientas que se enfocan únicamente en la coincidencia de píxeles, Veo 3.1 está diseñado para cineastas que requieren renderizado de "Color Profundo" de alta fidelidad y un grano fílmico natural que imita al celuloide tradicional.

La vibra: Narrativa ambiental

Veo 3.1 sobresale en movimientos de cámara complejos, como paneos cinematográficos amplios y tomas de seguimiento, que mantienen una iluminación y perspectiva consistentes. Muchos expertos llaman a esta la mejor herramienta de video por IA de 2026 para escenas de naturaleza. Su motor personalizado "Consciente de la Física" es el secreto. Este sistema gestiona la iluminación, las sombras y el movimiento natural con un detalle increíble. Sabe exactamente cómo se mueve la tela con la brisa o cómo la luz del sol golpea una lente.

La herramienta también integra audio de 48kHz durante el proceso de creación. Puede exportar videos en 1080p o 4K que cuentan con paisajes sonoros nítidos y perfectamente adaptados. Hace que la producción de video de alta calidad sea rápida y sencilla.

Análisis de rendimiento: Modos cinematográfico vs. rápido

Basado en los últimos puntos de referencia de Google AI Studio, los usuarios pueden alternar entre dos modos de generación distintos según las necesidades de su proyecto:

| Característica | Veo 3.1 (Estándar) | Veo 3.1 (Rápido) |

| Calidad máx. | Fidelidad ultra alta / 4K | Optimizado para velocidad / 1080p |

| Uso principal | Producción cinematográfica final | Prototipado rápido e iteración |

| Precisión física | Máxima (Simulaciones complejas) | Estándar (Movimiento controlado) |

| Calidad de audio | Calidad profesional 48kHz | Estéreo estándar |

Nivel gratuito: El estipendio del Google Creative Lab

Para aquellos que buscan un punto de entrada gratuito de IA de foto a video, Google ha integrado Veo 3.1 en el Google Creative Lab y AI Studio. Cada cuenta personal de Google recibe un estipendio diario de créditos. Aunque la cuota exacta puede fluctuar según la demanda regional, los usuarios normalmente reciben suficientes créditos para generar varios clips en modo "Rápido" o un clip de alta calidad en modo "Calidad" cada 24 horas.

30 créditos diarios. El inicio de sesión inicial otorga un bono de 100 créditos, válido por un mes.

Los competidores especializados (Clasificados del 4 al 10)

Aunque los "3 grandes" dominan la producción de alta gama, varias herramientas especializadas se han hecho un hueco dominando desafíos visuales específicos. Estos modelos de video por IA mejor clasificados ofrecen fortalezas únicas que a menudo superan a los modelos generales en sus respectivas categorías.

Características clave de las herramientas de video por IA especializadas

| Rango | Nombre de la herramienta | Especialización central | Caso de uso ideal |

| 4 | Kling 3.0 | Anatomía humana | Moda y retratos |

| 5 | Pika Labs | Realismo atmosférico | Iluminación ambiental, lluvia y niebla |

| 6 | Hailuo 2.3 | Velocidad de generación | Prototipado en redes sociales |

| 7 | WAN 2.6 | Movimiento sutil | Fondos y tomas de naturaleza suave |

| 8 | PixVerse | Mapeo facial | Fotos parlantes realistas |

| 9 | Vidu 2.0 | Profundidad espacial 3D | Dolly zooms y navegación 3D |

| 10 | Van 2.6 | Valor de alto volumen | Calidad constante para tareas masivas |

Destacados de los mejores modelos especializados

- Kling 3.0: El especialista en anatomía: Kling 3.0 ha ganado fama por resolver el persistente error del "dedo extra". Su comprensión superior de las restricciones esqueléticas lo convierte en el generador de video por IA más realista que 2026 ofrece para movimientos humanos complejos y modelado de alta moda.

- Pika Labs: Maestro de la atmósfera: Para los creadores que buscan "Realismo Atmosférico", Pika sigue siendo el estándar de oro. Sobresale en la simulación de texturas ambientales como niebla arremolinada o lluvia golpeando una ventana, proporcionando una profundidad de ánimo que muchos modelos pesados en física pasan por alto.

- Hailuo 2.3: Creado para la velocidad: Si necesita resultados rápidamente, esta es su mejor opción. Finaliza clips de 5 segundos en menos de medio minuto. Es perfecto para probar escenas antes de invertir tiempo en un renderizado final.

- Van 2.6 Image-to-Video: La serie Van es una excelente opción para video de alta calidad. Utiliza visuales 3D VAE y Flow Matching para un movimiento suave. El sistema utiliza tecnología inteligente para mantener los costos bajos y las velocidades altas. Es el mejor motor para realizar muchos videos de alta gama con un presupuesto ajustado.

Consejos profesionales: Cómo extraer realismo de un nivel gratuito

Maximizar un flujo de trabajo gratuito de IA de foto a video requiere algo más que una buena imagen base; requiere comprender cómo los motores de primer nivel de 2026 interpretan la física. Incluso con los modelos de video por IA mejor clasificados, la diferencia entre un aspecto "de plástico" y el realismo verdadero a menudo radica en la configuración.

El secreto del "Deslizador de movimiento"

Un error común entre los principiantes es llevar al máximo la intensidad del movimiento. En 2026, los modelos del generador de video por IA más realista utilizan "Kinetic Overdrive", que puede provocar deformaciones con valores altos.

- El punto ideal: Configurar el deslizador de movimiento en "3" o "4" imita el movimiento humano natural y los cambios ambientales sutiles.

- Por qué funciona: Los valores más bajos permiten a la IA priorizar la "Consistencia Temporal" sobre el desplazamiento agresivo de píxeles, evitando el efecto de "derretimiento".

Prompts avanzados para 2026

Para lograr el título del mejor IA para humanos fotorrealistas, debe usar terminología técnica de cámara. Al usar palabras clave de cinematografía específicas, obliga a la IA a simular hardware de cámara físico.

| Técnica | Palabra clave recomendada | Resultado |

| Desenfoque de movimiento | "1/50 shutter speed blur" | Movimiento natural sin "brillo" de IA. |

| Profundidad de campo | "f/1.8 aperture bokeh" | Separa los sujetos de los fondos de manera realista. |

| Iluminación | "Subsurface scattering" | Asegura que los tonos de piel se vean orgánicos, no como cera. |

Apilamiento de resolución

Los niveles gratuitos a menudo exportan a 720p para ahorrar en computación. Para ocultar la "suavidad" de estas exportaciones, utilice el Apilamiento de Resolución. Al pasar su video de IA final a través de un escalador secundario gratuito, como los que se encuentran en la suite de Google Creative Lab, puede reconstruir detalles finos como poros de la piel y texturas de tela que se perdieron en la generación inicial.

Resolución de problemas: ¿Por qué su video se ve "falso"?

Incluso cuando se utilizan modelos de video por IA mejor clasificados, muchos creadores encuentran el temido aspecto "falso", donde el video se siente como un sueño distorsionado en lugar de una grabación de la vida real.

El culpable común: Movimiento global

El mayor problema es el "Movimiento Global". Esto sucede cuando la IA piensa que usted quiere que todo el encuadre se mueva en lugar de solo su sujeto. Hace que el fondo parezca que está nadando o doblándose. Ese problema arruina el sentimiento realista de inmediato.

La solución: Prompting regional

Para asentar su video, debe aislar el movimiento. La mayoría de los flujos de trabajo profesionales ahora utilizan Prompting Regional o "Pinceles de movimiento".

- Bloquee el fondo: Defina su fondo como "estático" o "fijo" en su prompt.

- Aísle a los sujetos: Aplique movimiento específicamente al sujeto, ej.: "sujeto caminando, fondo permanece estático".

- Use fotogramas iniciales: Proporcione siempre una imagen estática de alta calidad como base para ayudar a la IA a comprender el entorno fijo.

| Tipo de movimiento | Comportamiento resultante de la IA | Cómo corregir |

| Movimiento global | Toda la escena se desplaza/deforma | Use imagen base estática y máscaras regionales. |

| Movimiento del sujeto | Movimiento natural y localizado | Describa la acción del sujeto con precisión. |

Conclusión: Eligiendo su camino realista

La tecnología detrás de los modelos de video por IA más realistas para 2026 ha crecido rápidamente. Estas herramientas han pasado de simples experimentos a activos reales de calidad profesional.

A medida que los pruebe, tenga en cuenta que los grandes resultados ocurren a través de prueba y error. ¿Qué generador manejó mejor la iluminación y el movimiento en su foto? ¡Cuénteme sus pensamientos en los comentarios!

Preguntas frecuentes

¿Puedo generar resolución 4K usando herramientas "gratuitas de IA de foto a video"?

El 4K será el estándar para los modelos de video de alta gama para 2026. Sin embargo, rara vez lo obtendrá gratis sin límites. Se requiere una potencia de cómputo masiva para ejecutarlo. Para controlar el tráfico del servidor, la mayoría de los planes gratuitos limitan la salida a 720p o 1080p.

| Resolución | Disponibilidad (Nivel gratuito) | Caso de uso recomendado |

| 720p / 1080p | Estándar (Van 2.7, Runway) | Redes sociales, borradores y prototipado. |

| 4K (Upscaled) | Vía "Apilamiento de resolución" | Ocultar la "suavidad" del nivel gratuito con herramientas externas. |

| 4K nativo | Limitado (Veo 3.1 Pro) | Producción cinematográfica profesional y pantallas grandes. |

¿Por qué mi video de 10 segundos parpadea más que los cortos?

El parpadeo, que la gente llama "inestabilidad temporal", ocurre cuando el modelo no logra mantener los objetos consistentes. Durante un tiempo más largo, la IA pierde el rastro de su "Anclaje de Identidad".

- La causa: Los modelos de IA a menudo "olvidan" la imagen inicial después de 5 segundos, haciendo que las texturas y los rasgos faciales se desvíen.

- La solución: Use Wan 2.7 para secuencias más largas, ya que su arquitectura está diseñada para el "Encadenamiento de acciones". Al solicitar "Tiempos temporales" específicos (ej.: Acto 1: Mirar, Acto 2: Parpadear), usted proporciona los puntos de anclaje necesarios para mantener un renderizado de 10 segundos estable y sin parpadeos.

¿Cómo puedo lograr la mejor IA para humanos fotorrealistas en mis videos?

El realismo en sujetos humanos a menudo falla debido al "rastreo de texturas". Para solucionar esto, use Kling 3.0 o Van 2.7 con este prompt: Incluya términos técnicos como "subsurface scattering" (dispersión subsuperficial) y "1/50 shutter blur" (desenfoque de obturación de 1/50) para forzar a la IA a imitar el hardware de cámara real.