Tu prompt se topó con un muro de rechazo. No porque fuera dañino, sino porque una palabra clave activó un filtro.

Los desarrolladores de la comunidad de Ollama describen esto como "vectores de rechazo": bloqueos activados por palabras clave que no tienen nada que ver con daños reales. Ingeniería inversa de malware para investigación de seguridad, documentación de casos de estudio médicos, creación de contenido para adultos, escritura de ficción oscura. La IA convencional bloquea todo esto. Esta lista clasifica los mejores modelos de IA sin censura de 2026 mediante datos reales de la comunidad, no por notas de marketing. Cubre tres categorías: modelos LLM sin censura para texto y código, los mejores modelos locales de IA sin censura de 2026 para despliegue en hardware privado, y modelos de IA sin censura de 2026 para generación de imagen y video vía API. Cada cifra está respaldada y fechada a mayo de 2026.

Para una introducción al panorama general de herramientas, los lectores nuevos en este espacio encontrarán útil la guía de generadores de imágenes por IA sin censura como punto de partida antes de seleccionar un modelo específico.

Cómo clasificamos los mejores modelos de IA sin censura de 2026

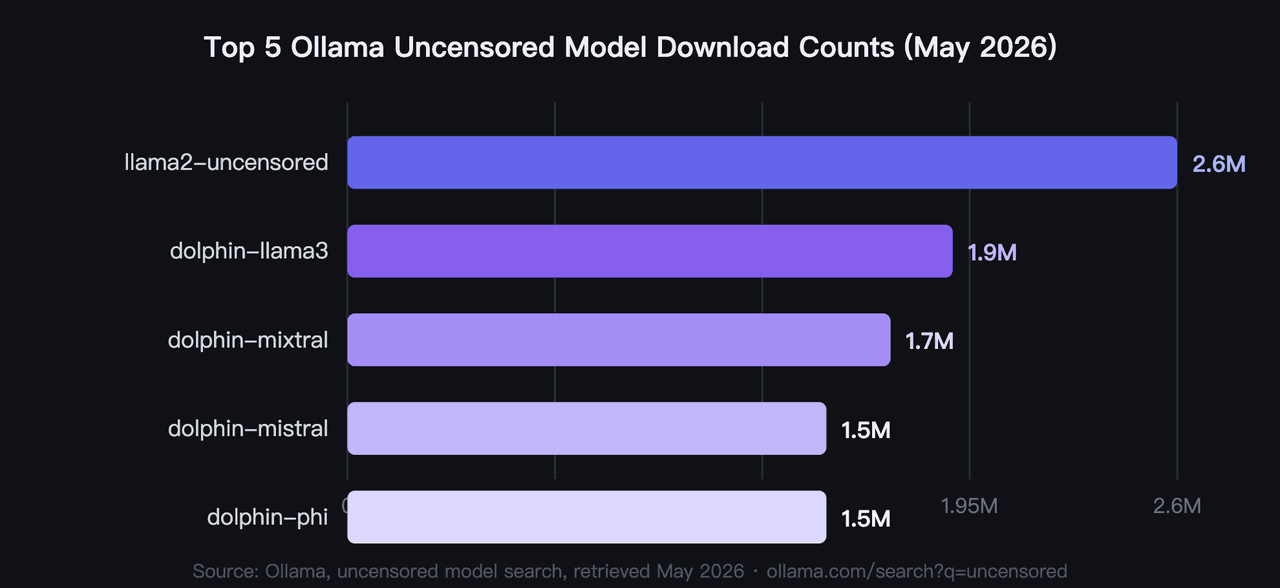

En 2026, el conteo de descargas de la comunidad en Ollama proporciona una señal de clasificación más fiable que los puntajes de los benchmarks, los cuales pueden ser seleccionados para comunicados de prensa en lugar de un rendimiento en el mundo real (Ollama, búsqueda de modelos sin censura, 2026). Millones de descargas representan miles de configuraciones de hardware y tipos de prompts. Eso es más difícil de manipular que un conjunto de evaluación curado.

Se utilizan tres señales de clasificación a lo largo de este artículo. Para los modelos sin censura de Ollama, la señal principal es el número de descargas de ollama.com, obtenido en mayo de 2026. Para los modelos de OpenRouter, la clasificación se basa en el número de parámetros y la ventana de contexto, ya que las cifras de descarga no están disponibles públicamente en esa plataforma. Para los modelos de imagen y video, la clasificación se basa en el precio por resultado, listando primero los costos más bajos dentro de cada grupo.

La mayoría de los modelos de IA sin censura de 2026 caen en dos categorías técnicas: ajustados (fine-tuned) y ablacionados (abliterated). Los modelos ajustados como la serie Dolphin son entrenados en conjuntos de datos que no refuerzan el comportamiento de rechazo. Los modelos ablacionados tienen sus pesos de rechazo eliminados quirúrgicamente. La comunidad encuentra constantemente que los modelos ajustados son más estables en diversos tipos de prompts.

En la práctica, el conteo de descargas también correlaciona con la estabilidad del modelo. Un modelo que alcanza más de 1 millón de descargas ha sido probado en una amplia gama de configuraciones de hardware, revelando errores e inestabilidades que grupos de prueba más pequeños pasan por alto.

¿Cuáles son los 5 modelos de IA sin censura más descargados en Ollama?

En 2026, los cinco modelos de IA sin censura más descargados en Ollama suman colectivamente más de 9.2 millones de descargas, con llama2-uncensored liderando con 2.6 millones (Ollama, búsqueda de modelos sin censura, 2026). Estos son los mejores modelos de Ollama sin censura de 2026 según la validación de la comunidad, no por ningún benchmark. El hardware es el filtro principal que la mayoría de los usuarios aplican primero: los requisitos de VRAM oscilan entre menos de 4 GB hasta 40 GB en este grupo.

1. llama2-uncensored: El modelo de IA sin censura más descargado en Ollama

El benchmark comunitario original para IA local sin censura. George Sung y Jarrad Hope lanzaron este ajuste para eliminar el comportamiento de rechazo de Llama 2 sin degradar la capacidad general. Es el modelo con el que empiezan la mayoría de los desarrolladores, y su cuenta de 2.6 millones de descargas refleja más de dos años de uso en el mundo real. Ningún otro LLM sin censura ha igualado ese volumen de descargas.

- Parámetros: 7B o 70B

- VRAM: ~6 GB (7B); ~40 GB (70B)

- Ideal para: Chat y generación de contenido sin restricciones de propósito general

- Plataforma: Ollama

2. dolphin-llama3: El mejor LLM sin censura basado en Llama 3 para flujos de trabajo agentes

Dolphin de Eric Hartford sobre una base Llama 3 es el modelo sin censura más descargado construido sobre una arquitectura moderna, con 1.9 millones de descargas (Ollama, página del modelo dolphin-llama3, 2026). Soporta llamadas a funciones (function calling) y una ventana de contexto que se extiende de 8K a 256K tokens según la configuración. La versión de 8B pesa 4.7 GB, ajustándose a la mayoría de las GPUs de gama media.

- Parámetros: 8B o 70B

- VRAM: ~5 GB (8B); ~40 GB (70B)

- Ideal para: Programación, flujos de trabajo agentes y llamadas a funciones

- Plataforma: Ollama

3. dolphin-mixtral 8x7B: Modelo de IA MoE sin censura para razonamiento complejo

Una arquitectura de mezcla de expertos (Mixture-of-Experts) dirige cada token a través de un subconjunto de sus 8 capas expertas. Esto produce una calidad de razonamiento cercana a 70B con un costo de inferencia menor que un modelo denso de equivalente cantidad total de parámetros. El ajuste sin censura de Eric Hartford mantiene un fuerte énfasis en la programación.

- Parámetros: 8x7B (los parámetros activos por paso de inferencia son mucho menores que el total)

- VRAM: ~12-16 GB con cuantización

- Ideal para: Tareas complejas de programación, razonamiento técnico y cadenas de instrucciones largas

- Plataforma: Ollama

4. dolphin-mistral: Modelo local de IA sin censura de 7B para respuestas rápidas

Más ligero y rápido que dolphin-mixtral en hardware con limitaciones de CPU. Acumula 1.5 millones de descargas de desarrolladores que desean un modelo local responsivo para autocompletado de código sin necesitar una GPU de gama alta. La arquitectura base Mistral le otorga una sólida relación rendimiento-tamaño para un modelo de 7B.

- Parámetros: 7B

- VRAM: ~5-6 GB

- Ideal para: Asistencia de programación ligera y respuestas de chat rápidas

- Plataforma: Ollama

5. dolphin-phi 2.7B: El modelo local de IA sin censura más ligero

La arquitectura base Phi de Microsoft incluye razonamiento capaz en un conteo de 2.7B de parámetros. El ajuste sin censura de Eric Hartford preserva esa eficiencia. Con menos de 4 GB de VRAM, funciona en la mayoría de las laptops de consumo con una GPU dedicada, convirtiéndolo en el punto de entrada accesible para los mejores modelos locales de IA sin censura de 2026.

- Parámetros: 2.7B

- VRAM: Menos de 4 GB

- Ideal para: Despliegue en laptop, pruebas rápidas y entornos con limitaciones de hardware

- Plataforma: Ollama

Los mejores modelos LLM sin censura del 6 al 10: Programación, Rol y Contexto Largo

En 2026, la serie Dolphin ocupa 5 de los 10 primeros puestos en el catálogo de modelos sin censura de Ollama por cantidad de descargas, una concentración que refleja la metodología de ajuste constante de Eric Hartford aplicada a través de diferentes arquitecturas base (Ollama, página del modelo hermes3, 2026). Los modelos del 6 al 10 cubren rol, conversación general, herramientas para desarrolladores, seguimiento de instrucciones y contexto extendido: los casos de uso donde los rechazos de la IA convencional son más disruptivos.

6. hermes3: Modelo de IA sin censura para Rol y tareas de agentes

Nous Research creó hermes3 para profundidad de rol y uso estructurado de herramientas. Está disponible en cuatro tamaños, desde 3B hasta 405B, el rango más amplio de cualquier modelo en esta lista. Con 1.3 millones de descargas, la variante de 8B se sitúa en un lugar práctico para la escritura creativa y flujos de trabajo de planificación de agentes (Ollama, página del modelo hermes3, 2026).

- Parámetros: 3B, 8B, 70B o 405B

- VRAM: ~2 GB (3B); ~5 GB (8B); ~40 GB (70B)

- Ideal para: Rol, ficción creativa y planificación de tareas agentes

- Plataforma: Ollama

7. wizard-vicuna-uncensored: Modelo de IA multiescala sin censura para uso general

Un modelo más antiguo pero probado, construido sobre Llama 2, disponible en tres tamaños de hasta 30B. Sus 1.2 millones de descargas provienen de usuarios que desean una opción sin censura fiable con un rango mayor de parámetros. No iguala las capacidades de ventana de contexto de dolphin-llama3, pero maneja la conversación general y el contenido creativo de manera consistente.

- Parámetros: 7B, 13B o 30B

- VRAM: ~5 GB (7B); ~9 GB (13B); ~20 GB (30B)

- Ideal para: Conversación de propósito general y contenido creativo con múltiples opciones de tamaño

- Plataforma: Ollama

8. dolphincoder: Modelo de IA de programación sin censura sobre base StarCoder2

Tener StarCoder2 como base hace de dolphincoder un especialista genuino. Mientras que otros modelos Dolphin son generalistas con ajuste sin censura, este se dirige específicamente al desarrollo de software. Sus 943K descargas provienen casi totalmente de desarrolladores, no de usuarios creativos. La variante de 15B maneja bases de código más grandes que lo que el 7B puede gestionar.

- Parámetros: 7B o 15B

- VRAM: ~5 GB (7B); ~10 GB (15B)

- Ideal para: Generación de código, depuración y documentación técnica

- Plataforma: Ollama

9. wizardlm-uncensored: LLM de seguimiento de instrucciones sin censura para flujos de investigación

Un modelo de seguimiento de instrucciones de 13B con 610K descargas. Su fortaleza es seguir instrucciones complejas de varios pasos sin evadir o rechazar subtareas. En flujos de trabajo de investigación donde un rechazo rompe una cadena larga, esa fiabilidad tiene un valor de productividad directo. No tiene la arquitectura base moderna de dolphin-llama3, pero cumple la tarea de instrucciones de forma consistente.

- Parámetros: 13B

- VRAM: ~9 GB

- Ideal para: Cadenas de instrucciones complejas de varios pasos y flujos de trabajo de investigación

- Plataforma: Ollama

10. everythinglm: LLM sin censura con ventana de contexto de 16K

La característica destacada aquí es la ventana de contexto de 16K sobre una base Llama 2. La mayoría de los modelos de 7B terminan en 4K u 8K tokens. Ese contexto adicional permite a everythinglm procesar bases de código completas, documentos largos o historiales de conversación extensos sin truncamiento. Sus 536K descargas son modestas según los estándares de esta lista, pero llena un vacío que ningún otro modelo aquí cubre a este tamaño.

- Parámetros: 13B

- VRAM: ~9 GB

- Ideal para: Análisis de documentos largos, chat con contexto extendido y revisión de código base completo

- Plataforma: Ollama

La dominancia de la serie Dolphin en las descargas de Ollama refleja un patrón que la comunidad ha documentado: los modelos sin censura ajustados de un solo autor con una metodología consistente superan a los intentos de ablación aislados. La ablación elimina los pesos de rechazo de un solo modelo. El ajuste fino construye un comportamiento sin censura estable en diversos tipos de prompts. Esa consistencia es la razón por la cual 5 de los 10 primeros puestos pertenecen al trabajo de Eric Hartford, no a ninguna arquitectura base individual.

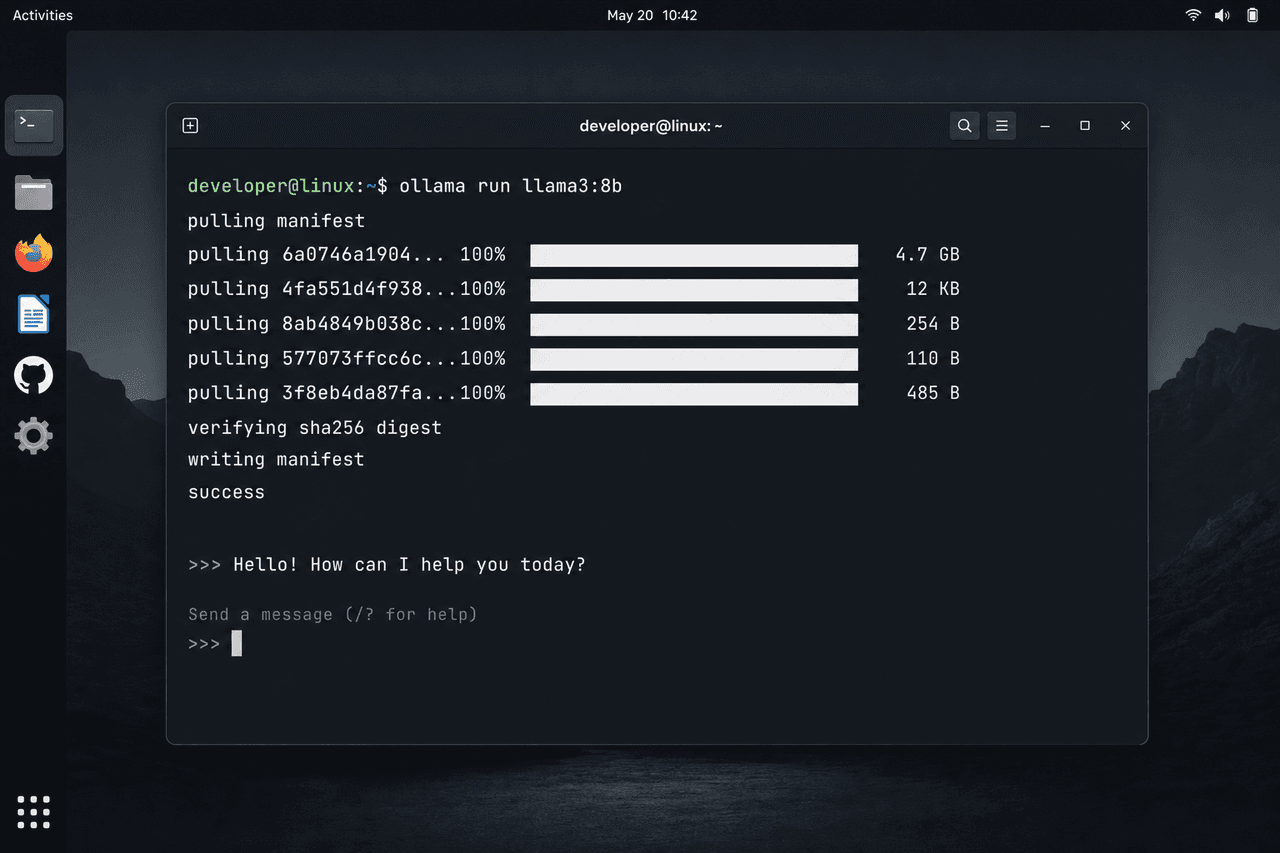

¿Cómo configurar modelos de Ollama sin censura localmente?

En 2026, tres comandos instalan cualquier modelo de Ollama en Mac, Linux o Windows: instala Ollama desde ollama.com, ejecuta

1ollama pull [nombre-del-modelo]1ollama run [nombre-del-modelo]Como ejemplo concreto con dolphin-llama3:

1ollama pull dolphin-llama31ollama run dolphin-llama3LM Studio proporciona una interfaz gráfica de escritorio para usuarios que prefieren no trabajar en la terminal. Utiliza los mismos archivos de modelo GGUF que usa Ollama, con una interfaz visual para la selección del modelo y ajuste de parámetros. llama.cpp es el motor de inferencia subyacente detrás de ambas herramientas, y permite el uso directo por línea de comandos cuando necesitas más control sobre los niveles de cuantización y los ajustes de longitud de contexto.

Los desarrolladores que deseen requisitos de hardware específicos y ajustes de cuantización para ejecutar los mejores modelos locales de IA sin censura de 2026 en GPUs de consumo encontrarán que la guía de configuración local completa cubre las configuraciones mínimas de VRAM y errores comunes de configuración en detalle.

¿Qué modelos de OpenRouter sin censura están disponibles sin una GPU local?

En 2026, OpenRouter aloja LLMs sin censura vía API, eliminando completamente el requisito de GPU. El modelo venice/uncensored está disponible como un modelo de nivel gratuito a USD0 por millón de tokens de entrada y salida (OpenRouter, página del modelo venice/uncensored, 2026). Esto convierte a los modelos de OpenRouter sin censura en el punto de entrada práctico para usuarios sin hardware dedicado.

El compromiso es directo: OpenRouter enruta tu prompt a través de su infraestructura, por lo que la conversación no es privada de la misma manera que un modelo local. Los modelos locales de Ollama mantienen todo en tu dispositivo. Ningún enfoque es universalmente mejor. La elección correcta depende de tu modelo de amenazas y de la disponibilidad de hardware.

11. venice/uncensored: Modelo de OpenRouter gratuito sin censura

El modelo Venice Uncensored en el nivel gratuito de OpenRouter. Una base Mistral-Small de 24B, ajustada para salida sin censura por Cognitive Computations en colaboración con Venice.ai. Ventana de contexto de 32K, USD0 por millón de tokens. El nivel gratuito de OpenRouter aplica un límite a toda la plataforma de 200 solicitudes por día en todos los modelos gratuitos.

- Parámetros: 24B

- VRAM: No requiere (alojado en la nube)

- Ideal para: Probar LLMs sin censura sin hardware local; gratis dentro de los límites de tasa de la plataforma

- Plataforma: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B: Modelo grande sin censura vía OpenRouter

Modelo de rol creativo y seguimiento de instrucciones de 70B de Sao10k, ajustado para salida sin censura. Basado en Llama 3.3 70B con 131K de contexto. Mantenido activamente con uso real en OpenRouter y buscable por nombre en la búsqueda global de la plataforma.

- Parámetros: 70B

- VRAM: No requiere (alojado en la nube)

- Ideal para: Escritura creativa compleja, rol y cadenas largas de instrucciones sin hardware local

- Plataforma: OpenRouter

13. Sao10K: Llama 3 8B Lunaris: Modelo ligero sin censura vía OpenRouter

Lunaris 8B es un modelo versátil generalista y de rol de Sao10k, basado en Llama 3 8B. Es una fusión estratégica de múltiples modelos diseñada para equilibrar la creatividad con una mejor lógica y conocimiento general, ofreciendo una experiencia mejorada sobre Stheno v3.2 con mayor creatividad y razonamiento. La opción sin censura de menor costo en OpenRouter a USD0.04/USD0.05 por millón de tokens, con más de 6 mil millones de tokens de uso real en la plataforma.

- Parámetros: 8B

- VRAM: No requiere (alojado en la nube)

- Ideal para: Conversación ligera sin censura y escritura creativa a costo mínimo

- Plataforma: OpenRouter

14. TheDrummer: Cydonia 24B V4.1: Modelo de escritura creativa sin censura vía OpenRouter

Cydonia 24B V4.1 es un modelo de escritura creativa sin censura de TheDrummer, basado en Mistral Small 3.2 24B, con buen recuerdo, adherencia al prompt e inteligencia. Ventana de contexto de 131K. Mantenido activamente y directamente buscable por nombre en la búsqueda global de OpenRouter.

- Parámetros: 24B

- VRAM: No requiere (alojado en la nube)

- Ideal para: Escritura creativa sin censura y rol sin hardware local

- Plataforma: OpenRouter

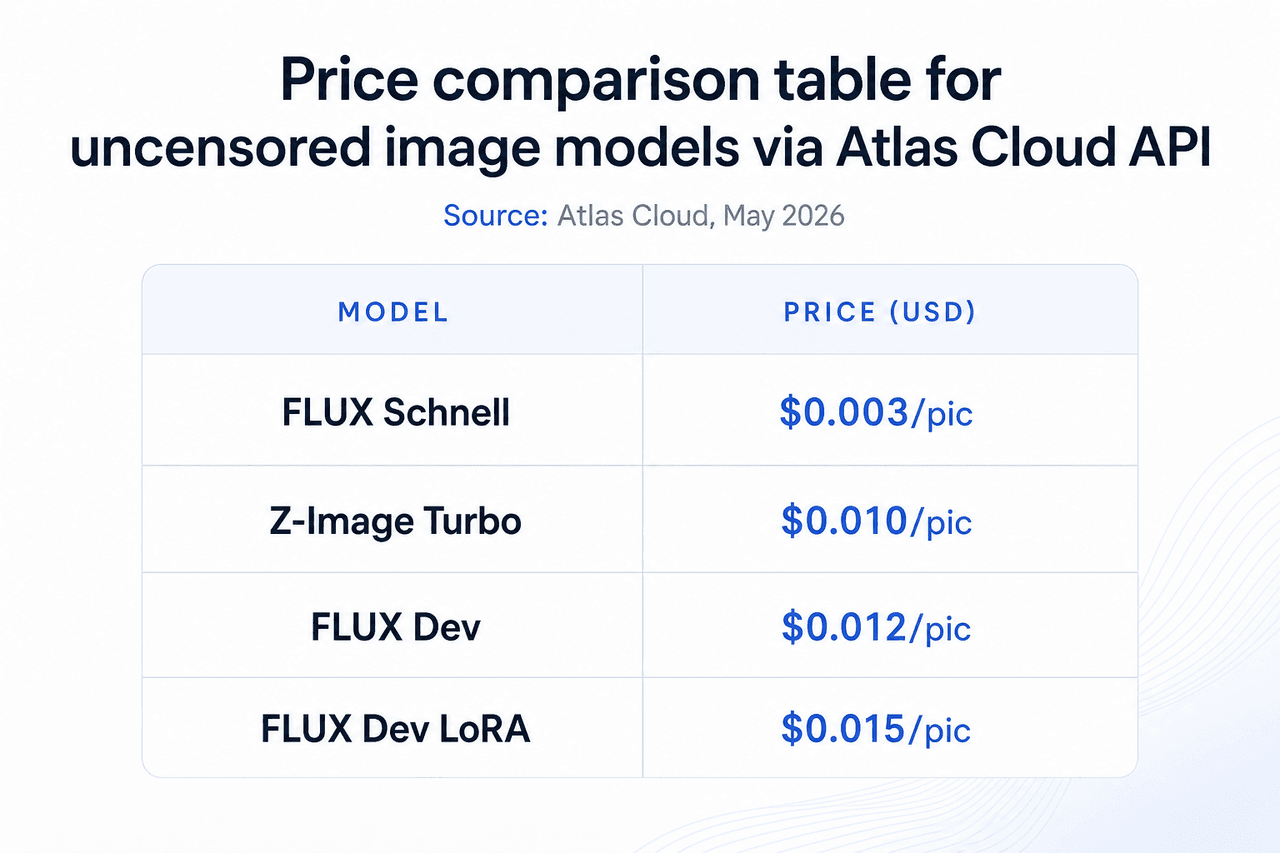

Cómo acceder a modelos de imagen y video sin censura a través de Atlas Cloud

En 2026, la mayoría de los modelos de imagen y video sin censura requieren hardware GPU local o una plataforma API dedicada, porque los proveedores de nube convencionales aplican filtros de contenido que bloquean la salida NSFW al nivel de la inferencia. Atlas Cloud es una plataforma de API de modelos construida específicamente para eliminar esa restricción, cubriendo más de 300 modelos curados de texto, imagen, video y audio.

Comenzar toma tres pasos:

- Crea una cuenta en atlascloud.ai

- Genera una API key desde el panel de control

- Llama al endpoint del modelo usando la llave — los modelos de imagen y video usan su propio formato REST; los endpoints de LLM siguen el formato Chat Completions de OpenAI

Qué hace que Atlas Cloud sea relevante específicamente para casos de uso sin censura:

- La política de privacidad de la plataforma establece: "Tu contenido generado nunca se utiliza para entrenamiento y nunca es revisado por nadie". Este es un compromiso publicado y explícito, no una suposición por defecto.

- No se aplica límite diario de generación a ningún modelo en el catálogo.

- El catálogo de imágenes sin censura cubre 33 modelos de texto a imagen a partir de USD0.003 por imagen.

- El catálogo de video sin censura cubre más de 10 modelos de video NSFW a partir de USD0.01/seg.

El catálogo completo de modelos sin censura es navegable en atlascloud.ai/models/explore/uncensored. Los modelos #15 al #20 en esta lista son todos accesibles a través de una única API key de Atlas Cloud.

¿Cuáles son los mejores modelos de imagen de IA sin censura para NSFW y generación de contenido adulto?

En 2026, la arquitectura FLUX potencia la mayoría de la generación de imágenes sin censura de alta calidad, disponible vía la API de Atlas Cloud a través de niveles de precio y calidad (Atlas Cloud, lista de modelos texto-a-imagen, 2026). El catálogo de Atlas Cloud cubre 33 modelos de texto-a-imagen en total. Los casos de uso incluyen arte fino, diseño de personajes, modelos de lencería sin censura y generación de retratos adultos, creación de activos para juegos e ilustración por lotes en volumen.

La página principal de Atlas Cloud indica "más de 300 modelos curados de texto, imagen, video y audio", y la política de privacidad de la plataforma para su catálogo sin censura dice: "Tu contenido generado nunca se utiliza para entrenamiento y nunca es revisado por nadie".

Para un desglose completo de herramientas de imagen sin censura basadas en navegador y API, la guía de los mejores generadores de imágenes por IA sin censura cubre ambas categorías con comparaciones de capacidades. Los desarrolladores enfocados específicamente en la arquitectura FLUX pueden leer la guía del generador de imágenes sin censura FLUX para detalles de ajuste y flujo de trabajo.

15. FLUX Schnell: El modelo de IA sin censura más rápido para generación por lotes

La opción de menor costo en el catálogo de imágenes de Atlas Cloud. A USD0.003 por imagen, es la herramienta adecuada para flujos de trabajo de generación por lotes donde la velocidad y el volumen importan más que el detalle fino. No se aplica tope diario y no se almacena contenido para entrenamiento.

- Precio: USD0.003/imagen

- VRAM: No requiere (acceso API)

- Ideal para: Generación de imágenes por lotes, prototipado rápido y salida sin censura de alto volumen

- Plataforma: Atlas Cloud API

A USD0.003 por imagen, un presupuesto de USD3.00 produce 1,000 imágenes. Ese costo por salida es menor que las tarifas de almacenamiento en la nube para los archivos resultantes en la mayoría de los proveedores. Eso invierte la economía para los estudios que antes ejecutaban costosos equipos de GPU locales durante la noche para la generación por lotes: el enfoque API ahora es más barato y rápido para el trabajo de volumen.

16. FLUX Dev: El modelo de IA sin censura de mayor calidad para producción final

Cuatro veces el costo de FLUX Schnell, con una anatomía, iluminación y detalle de textura notablemente mejores. Para una salida de calidad final donde las imágenes individuales importan, el punto de precio de USD0.012 es un salto práctico. Se adapta a piezas de portafolio, contenido adulto comercial y activos de producción donde la calidad es la restricción principal.

- Precio: USD0.012/imagen

- VRAM: No requiere (acceso API)

- Ideal para: Imágenes individuales de alta calidad, piezas de portafolio y activos de producción final

- Plataforma: Atlas Cloud API

17. FLUX Dev LoRA: Modelo de imagen sin censura con entrenamiento de estilo personalizado

El ajuste LoRA inyecta un estilo personalizado, apariencia de personaje o sujeto en la base FLUX Dev. Este es el modelo a usar cuando necesitas una apariencia de personaje consistente en un lote o quieres que un estilo de casa se aplique a cada imagen en un conjunto. Atlas Cloud maneja la carga de LoRA en el servidor.

- Precio: USD0.015/imagen

- VRAM: No requiere (acceso API)

- Ideal para: Consistencia de personajes, entrenamiento de estilo personalizado y series de imágenes con marca

- Plataforma: Atlas Cloud API

18. Z-Image Turbo: Modelo de imagen de IA sin censura de presupuesto con calidad de nivel medio

Posicionado entre FLUX Schnell y FLUX Dev en la curva de precio-calidad. A USD0.01 por imagen, Z-Image Turbo ofrece una arquitectura diferente optimizada para la velocidad sin la simplificación de imagen que hace Schnell a su precio menor. La elección práctica cuando la calidad de Schnell no es suficiente y el costo de FLUX Dev es demasiado alto para el volumen necesario.

- Precio: USD0.01/imagen

- VRAM: No requiere (acceso API)

- Ideal para: Generación de volumen moderado donde la calidad y el costo deben equilibrarse

- Plataforma: Atlas Cloud API

¿Cuáles son los mejores modelos de video de IA sin censura para animación NSFW en 2026?

En 2026, la generación de video sin censura requiere un pipeline separado del de la generación de imagen porque las plataformas de video convencionales aplican filtros de contenido idénticos y se niegan a animar contenido NSFW incluso cuando la imagen de origen fue generada en otro lugar (Atlas Cloud, catálogo de modelos sin censura, 2026). La página de video sin censura de Atlas Cloud lleva el titular "Libertad creativa sin restricciones. Sin filtros. Sin límites." y cubre más de 10 modelos de video NSFW, con el catálogo completo incluyendo también variantes de las series Wan 2.6, Wan 2.5 y Van.

19. Wan 2.2 Turbo Spicy Infinite I2V: El modelo de video sin censura de menor costo

La opción de nivel de entrada para animación NSFW desde una imagen fija. A USD0.01/seg es la forma más rentable de animar una imagen estática a contenido de video NSFW. La resolución alcanza los 1080p con duración de clip variable, convirtiéndolo en el punto de partida adecuado para pipelines de producción conscientes del presupuesto.

- Precio: USD0.01/seg

- Resolución: 1080p

- Duración: Variable

- Ideal para: Animación NSFW rentable y previsualización de conceptos de movimiento

- Plataforma: Atlas Cloud API

20. Seedance v1.5 Spicy: El modelo de video sin censura de mayor calidad para salida final

La opción de calidad cinemática en el catálogo. A USD0.049/seg cuesta aproximadamente 2.5 veces más que Wan 2.2 Turbo Spicy Infinite, pero produce un movimiento más suave, mejor coherencia de sujeto a través de los cuadros y transiciones más naturales. Para una salida de video NSFW de calidad final donde la fidelidad visual es la preocupación principal, esta es la opción superior en la línea de video sin censura de Atlas Cloud.

- Precio: USD0.049/seg

- Resolución: 720p

- Duración: 5s

- Ideal para: Video NSFW de calidad final, contenido adulto profesional y salida lista para entrega

- Plataforma: Atlas Cloud API

La guía de los mejores generadores de video de IA sin censura cubre el catálogo completo de las variantes de las series Wan 2.7 y Wan 2.2 Spicy con todas las opciones de duración y resolución.

Guía de selección rápida de modelos de IA sin censura

| Necesidad | Recomendación |

|---|---|

| Mejor LLM sin censura general | llama2-uncensored o dolphin-llama3 |

| Tareas de programación | dolphin-mixtral 8x7B o dolphincoder |

| Rol y escritura creativa | hermes3 |

| Menos de 4GB VRAM | dolphin-phi 2.7B |

| Generación de imagen sin censura | FLUX Schnell vía Atlas Cloud (USD0.003/imagen) |

| Video NSFW desde imagen | Wan 2.2 Turbo Spicy Infinite vía Atlas Cloud (USD0.01/seg) |

Preguntas frecuentes sobre modelos de IA sin censura

¿Cuál es el modelo de IA más sin censura en 2026?

Por conteo de descargas en Ollama, llama2-uncensored lidera con 2.6 millones de descargas, lo que la convierte en la opción más validada por la comunidad entre los modelos de IA sin censura de 2026 (Ollama, búsqueda de modelos sin censura, 2026). Por capacidad bruta, dolphin-llama3 ofrece más: llamadas a funciones, hasta 256K de contexto y una arquitectura base Llama 3. La respuesta depende de si la estabilidad probada o la capacidad moderna importan más para tu caso de uso.

¿Qué modelos sin censura funcionan en Ollama?

Diez modelos de esta lista funcionan como modelos sin censura de Ollama: llama2-uncensored, dolphin-llama3, dolphin-mixtral, dolphin-mistral, dolphin-phi, hermes3, wizard-vicuna-uncensored, dolphincoder, wizardlm-uncensored y everythinglm. El modelo comunitario jaahas/qwen3.5-uncensored también funciona en Ollama para uso multilingüe. Todos se instalan con

1ollama pull [nombre-del-modelo]¿Qué modelos sin censura están disponibles en OpenRouter?

En 2026, OpenRouter aloja LLMs sin censura vía API, eliminando el requisito de GPU por completo. Las opciones incluyen el modelo venice/uncensored de nivel gratuito a USD0 por millón de tokens (200 solicitudes por día), además de modelos de pago incluyendo Sao10K Euryale 70B, Lunaris 8B y TheDrummer Cydonia 24B (OpenRouter, página del modelo venice/uncensored, 2026). Estos modelos de OpenRouter sin censura no requieren GPU local ni inversión en hardware para comenzar.

¿Cuál es la diferencia entre un modelo ablacionado y uno ajustado sin censura?

La ablación elimina los pesos de rechazo de un modelo quirúrgicamente al nivel de peso. Los modelos sin censura ajustados como la serie Dolphin son entrenados en conjuntos de datos que no refuerzan el comportamiento de rechazo en primer lugar. La comunidad encuentra constantemente que los modelos ajustados son más estables: la ablación puede introducir una salida inconsistente en diversos tipos de prompts, mientras que el ajuste fino produce resultados fiables, lo que explica por qué los modelos Dolphin dominan las descargas de Ollama sin censura.

¿Puedo ejecutar modelos de IA sin censura localmente en una laptop?

Sí. dolphin-phi 2.7B se ejecuta con menos de 4 GB de VRAM, lo que lo convierte en el punto de entrada para el despliegue en laptops con una GPU dedicada. Con 6-8 GB de VRAM puedes ejecutar cualquier modelo 7B de esta lista. Los gráficos integrados no funcionarán. La guía de configuración local para modelos de IA sin censura cubre las configuraciones mínimas de hardware y ajustes de cuantización en detalle.

Conclusión

El mejor modelo de IA sin censura en 2026 depende enteramente de tu caso de uso. Para el trabajo general de LLM, dolphin-llama3 es la opción más capaz de Ollama. Para laptops, dolphin-phi cubre el requisito de menos de 4 GB de VRAM. Para acceso a LLM en la nube sin hardware, venice/uncensored en el nivel gratuito de OpenRouter es el punto de partida práctico a USD0 por millón de tokens. Para la generación de imágenes sin censura a escala, FLUX Schnell vía la API de Atlas Cloud produce resultados a USD0.003 por imagen sin límite diario. Para video NSFW, el catálogo de Atlas Cloud comienza en USD0.01/seg con una política verificada de no entrenamiento y no revisión.

Los lectores que busquen una visión general completa de las herramientas de IA sin censura para imágenes, video y editores encontrarán que la guía de generadores de imágenes por IA sin censura cubre todo el panorama.