La mayoría de la gente todavía piensa que mejores palabras equivalen a mejores imágenes. Eso era cierto hace dos años. Ya no.

En 2026, la verdadera brecha no está entre los modelos. Está entre los usuarios que describen y los usuarios que construyen. Un grupo escribe "iluminación cinematográfica, 4k, ultra detallado". El otro grupo construye escenas: dirección de luz, capas de profundidad, ángulos de cámara.

Si sus imágenes todavía se ven planas, el problema probablemente no sea el modelo. Es lo que no le está diciendo.

Por qué sus prompts ya no son suficientes (perspectiva de 2026)

Los prompts genéricos han dejado de funcionar. Los modelos han visto frases como "mejor calidad" y "alta definición" millones de veces. Esas palabras apenas marcan la diferencia ahora.

¿Qué es lo que realmente importa? Entradas estructuradas. ¿De dónde viene la luz? ¿Qué hay en primer plano frente al fondo? ¿Qué lente está usando? Los modelos modernos responden a estas variables. Ignoran el relleno.

Aquí hay un patrón común. Alguien escribe: "un retrato hermoso con iluminación suave". El modelo entrega algo plano. ¿Por qué? No hay dirección de luz. No hay separación de profundidad. No hay ángulo de cámara. El modelo tiene que adivinar. Y adivinar conduce a resultados promedio.

El cambio que debe hacer es simple. Deje de describir el resultado. Empiece a construir la escena.

Los 7 consejos avanzados

-

Dígale a la luz hacia dónde ir

"Iluminación suave" es vago. Iluminación lateral, contraluz, de arriba hacia abajo: eso le da al modelo algo concreto. La dirección crea sombras. Las sombras crean profundidad. La profundidad hace que una imagen parezca real.

Pruebe esto en lugar de "iluminación de retrato suave":

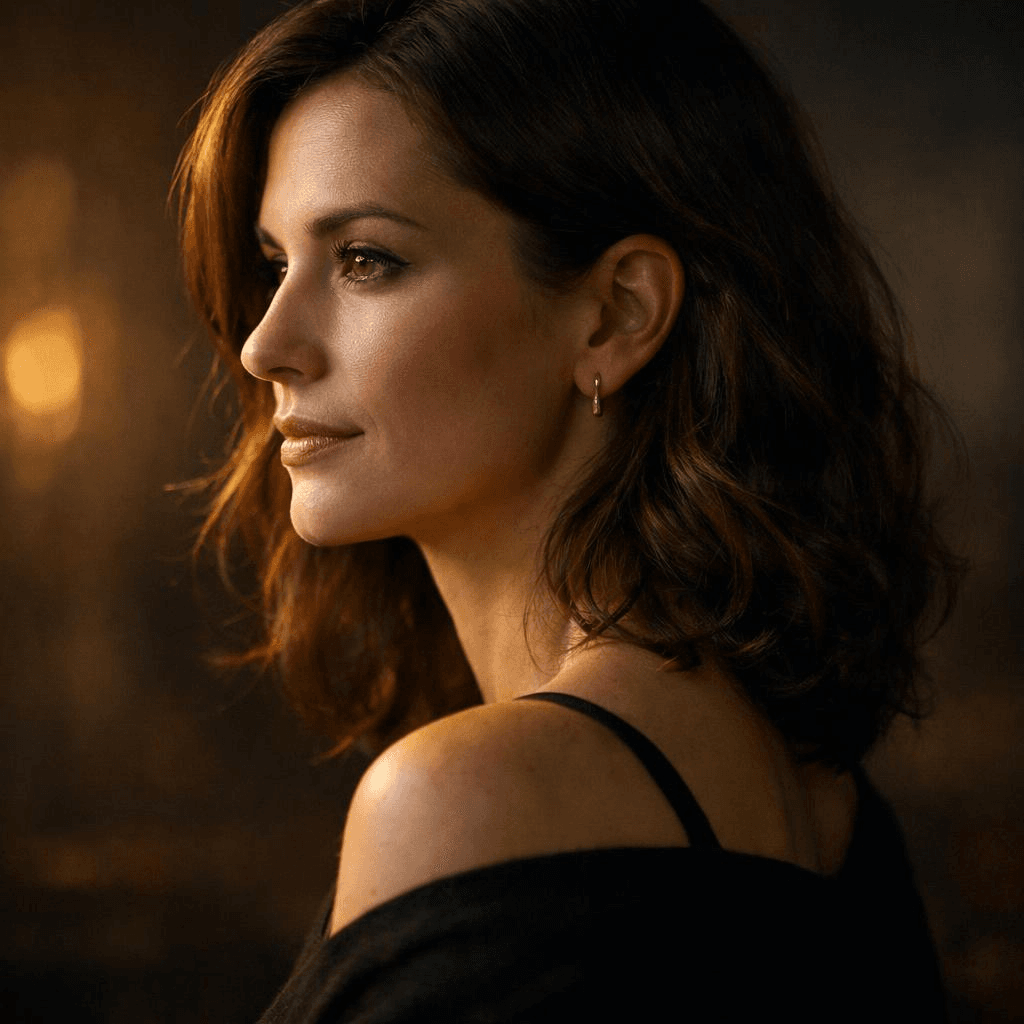

Un retrato de una mujer, iluminación lateral desde la izquierda, sombras suaves en el lado derecho de la cara, luz ambiental sutil desde el fondo

Puede ver la diferencia de inmediato. El modelo sabe exactamente dónde se sitúa la luz.

-

Use configuraciones de fotografía real

Iluminación de tres puntos. Iluminación de contorno (rim light). Iluminación Rembrandt. Estos no son solo términos elegantes. Son patrones que el modelo vio miles de veces durante su entrenamiento. Úselos y sus resultados serán más estables.

Ejemplo:

Foto de producto de una zapatilla, configuración de iluminación de tres puntos, luz principal fuerte, luz de relleno suave, luz de contorno sutil que separa el producto de un fondo oscuro

Eso funciona mejor que "iluminación dramática" en cada ocasión.

-

Construya profundidad capa por capa

Las imágenes planas generalmente significan que todo está en el mismo plano. Soluciónelo nombrando explícitamente el primer plano, el plano medio y el fondo.

Ejemplo:

Una taza de café sobre una mesa de madera (primer plano), una persona trabajando en una computadora portátil (plano medio), un interior de café suavemente desenfocado con luces cálidas (fondo)

Ahora el modelo tiene relaciones espaciales con las que trabajar.

-

Use lenguaje de cámara, no etiquetas de estilo

"Estilo cyberpunk" es difuso. "Lente de 35mm, ángulo bajo, plano general" es preciso. Los ajustes de la cámara se corresponden directamente con la forma en que se construyen las imágenes.

Guarde esto en su bolsillo:

- 35mm para un aspecto natural y cotidiano

- 85mm para retratos con compresión

- Gran angular para drama y escala

- Ángulo bajo, al nivel de los ojos, de arriba hacia abajo para perspectiva

Ejemplo:

Un retrato en primer plano, lente de 85mm, poca profundidad de campo, ángulo al nivel de los ojos, desenfoque de fondo suave

Eso le da al modelo instrucciones mucho más claras que "retrato estético".

-

Guíe la atención a través del contraste

El objetivo no es tener mucho detalle en todas partes. Es el contraste. Luz frente a sombra. Cálido frente a frío. Sujeto nítido frente a fondo desenfocado.

Tres tipos de contraste funcionan bien:

- Contraste de luz: sujeto brillante contra un fondo oscuro

- Contraste de color: foco cálido sobre un fondo de tonos fríos

- Contraste de detalle: sujeto nítido, entorno desenfocado

Ejemplo:

Un sujeto iluminado por un foco cálido contra un fondo oscuro de tonos fríos, iluminación de alto contraste, enfoque fuerte en el sujeto

La mirada del espectador va exactamente a donde usted quiere.

-

Añada restricciones para limpiar el caos

Genere composiciones más limpias y controladas.

Los prompts largos se vuelven desordenados. En lugar de añadir más detalles, añada límites. Dígale al modelo lo que no quiere. Sin desorden. Sin distorsión. Sin objetos adicionales.

Ejemplo:

Foto de producto minimalista, composición centrada, fondo blanco limpio, sin desorden, sin texto, sin distorsión

Las restricciones a menudo hacen más que las descripciones adicionales.

-

Itere como un director, no como un jugador

Nadie obtiene la imagen final al primer intento. Los profesionales generan, ajustan y vuelven a generar.

Un flujo de trabajo simple:

- Paso uno: composición básica, sujeto y entorno

- Paso dos: añadir iluminación direccional y contraste

- Paso tres: refinar detalles, eliminar desorden

Cada paso mejora el resultado. Así es como se pasa de la suerte a la consistencia.

Juntándolo todo: un marco de trabajo profesional para prompts

Deje de escribir prompts como oraciones largas. Escríbalos como sistemas modulares.

Aquí hay una estructura que funciona:

plaintext1[Sujeto] + [Entorno] + [Iluminación] + [Cámara] + [Composición] + [Color] + [Restricciones]

Observe la diferencia entre un prompt básico y uno estructurado.

Ejemplo: De un prompt básico a un prompt profesional

Prompt básico (usuario típico):

Una modelo femenina usando un vestido de verano blanco, fondo limpio, iluminación de estudio, alto detalle, estilo de comercio electrónico

Prompt profesional (estructurado):

Una modelo femenina con un vestido de verano blanco (sujeto), de pie en un estudio minimalista con un fondo texturizado beige suave (entorno), iluminación lateral desde la derecha creando sombras suaves en el lado izquierdo del cuerpo, luz de contorno sutil que separa la silueta del fondo (iluminación), tomada con una lente de 85mm, ángulo al nivel de los ojos (cámara), sujeto ligeramente descentrado con poca profundidad de campo, desenfoque de primer plano suave añadiendo profundidad (composición), tonos naturales cálidos, contraste suave (color), composición limpia, sin desorden, sin distorsión, sin objetos extra (restricciones)

Conclusión: de hacer prompts a dirigir

Obtener una sola imagen genial está bien. Pero los proyectos reales necesitan cientos de imágenes consistentes y de alta calidad. Hacer prompts manualmente no escala.

Se encontrará con problemas prácticos. Latencia. Costo por imagen. Mantener el mismo estilo visual en todos los lotes. El diseño de prompts por sí solo no puede resolver esto. Necesita un sistema.

Ahí es donde la generación de imágenes basada en API se vuelve esencial. En lugar de escribir prompts en un patio de juegos cada vez, integra la generación en su flujo de trabajo. Los prompts estructurados se reutilizan. Automatizados. Optimizados con el tiempo.

Plataformas como Atlas Cloud proporcionan una capa de API unificada para esto.

Y si usted es:

• Desarrollador que desea un acceso a IA fácil y asequible. • Equipo que maneja proyectos que necesitan IA en múltiples áreas. • Empresa que necesita IA confiable para trabajos importantes. • Usuario de herramientas como ComfyUI y n8n.

Pruebe AtlasCloud y verá cómo pasa de experimentar a producir. No es necesario reconstruir la infraestructura desde cero.

El futuro no se trata de escribir mejores prompts de forma aislada. Se trata de construir sistemas visuales controlables, repetibles y listos para la producción.

Preguntas frecuentes

¿Por qué mis imágenes de IA todavía se ven planas?

Las imágenes planas generalmente significan que omitió las señales de profundidad. Piense en cómo funciona la fotografía. La profundidad proviene de las sombras, las cosas superpuestas y las diferencias de enfoque. Su prompt tiene que deletrearlas.

Tomemos un prompt simple: "una persona sentada en un escritorio". Eso no le dice al modelo casi nada sobre la profundidad. Intente algo como esto: "una persona sentada en un escritorio (plano medio), una ventana desenfocada con luces de la ciudad (fondo), una taza de café en enfoque nítido (primer plano)". Ahora el modelo tiene capas con las que trabajar.

La iluminación es otro aspecto en el que la gente se equivoca. Muchos prompts solo mencionan la luz ambiental. Eso le da una iluminación plana y uniforme en toda la imagen. Agregue una fuente direccional. Luz lateral. Contraluz. Luz de contorno. Elija una. El modelo comenzará a proyectar sombras y, de repente, su imagen tendrá volumen.

Una cosa más. No intente llenar cada rincón del marco con detalles. El espacio vacío y el desenfoque son útiles. Le dicen al espectador dónde mirar. A veces, menos detalles le dan más profundidad.

¿Puede la IA reemplazar la fotografía de producto?

Sí, para muchos casos. Pero seamos honestos acerca de dónde funciona y dónde no.

Si necesita una foto principal para un reloj de lujo, del tipo en el que cada reflejo en el metal importa y la textura de la correa de cuero tiene que ser exacta, la fotografía tradicional sigue ganando. No puede superar a un estudio real para eso.

Para casi todo lo demás, la IA es más rápida y barata. Imágenes de catálogo. Escenas de estilo de vida. Variaciones estacionales. Creatividades para pruebas A/B. Puede generar una foto de producto limpia sobre un fondo blanco en segundos. Luego tome esa imagen y colóquela en una escena de playa, una cabaña de invierno o una cocina moderna usando un generador de fotografía de producto con IA.

Sin alquiler de estudio. Sin equipo de iluminación. Sin retoques. Cada imagen cuesta centavos.

Para pequeñas marcas y startups directas al consumidor, esto cambia el juego. Ahora pueden producir imágenes que compiten con empresas que tienen grandes presupuestos. Eso no era posible hace dos años.

¿En qué se diferencia el modelo de generación visual de OpenAI de las versiones anteriores?

El nuevo modelo, GPT‑image‑1.5, tiene algunos cambios arquitectónicos bajo el capó. Utiliza un transformador de difusión. Esa es una forma elegante de decir que maneja mejor las relaciones espaciales.

Las versiones anteriores a menudo dividían escenas complejas en piezas que no encajaban del todo. Una mano podría flotar cerca de una taza en lugar de sostenerla. Las sombras apuntarían en direcciones incorrectas. La nueva versión mantiene las cosas conectadas. Una mano sostiene la taza. La sombra cae donde debería.

La representación de texto es otro gran salto. Los modelos anteriores producían caracteres ilegibles que parecían símbolos aleatorios. GPT‑image‑1.5 genera palabras legibles en múltiples idiomas. Puede mezclar inglés y chino en la misma imagen. Eso realmente funciona ahora.

El modelo también admite resoluciones más altas de forma nativa, hasta 2K sin necesidad de escalado. Menos artefactos. Detalles más nítidos.

Hay una desventaja. El modelo es menos tolerante con los prompts vagos. No puede simplemente decir "un bonito retrato" y esperar magia. Tiene que ser más cuidadoso. Pero cuando le da instrucciones estructuradas (dirección de la luz, capas de profundidad, configuraciones de cámara), la calidad de salida es mejor que cualquier cosa de las generaciones anteriores.