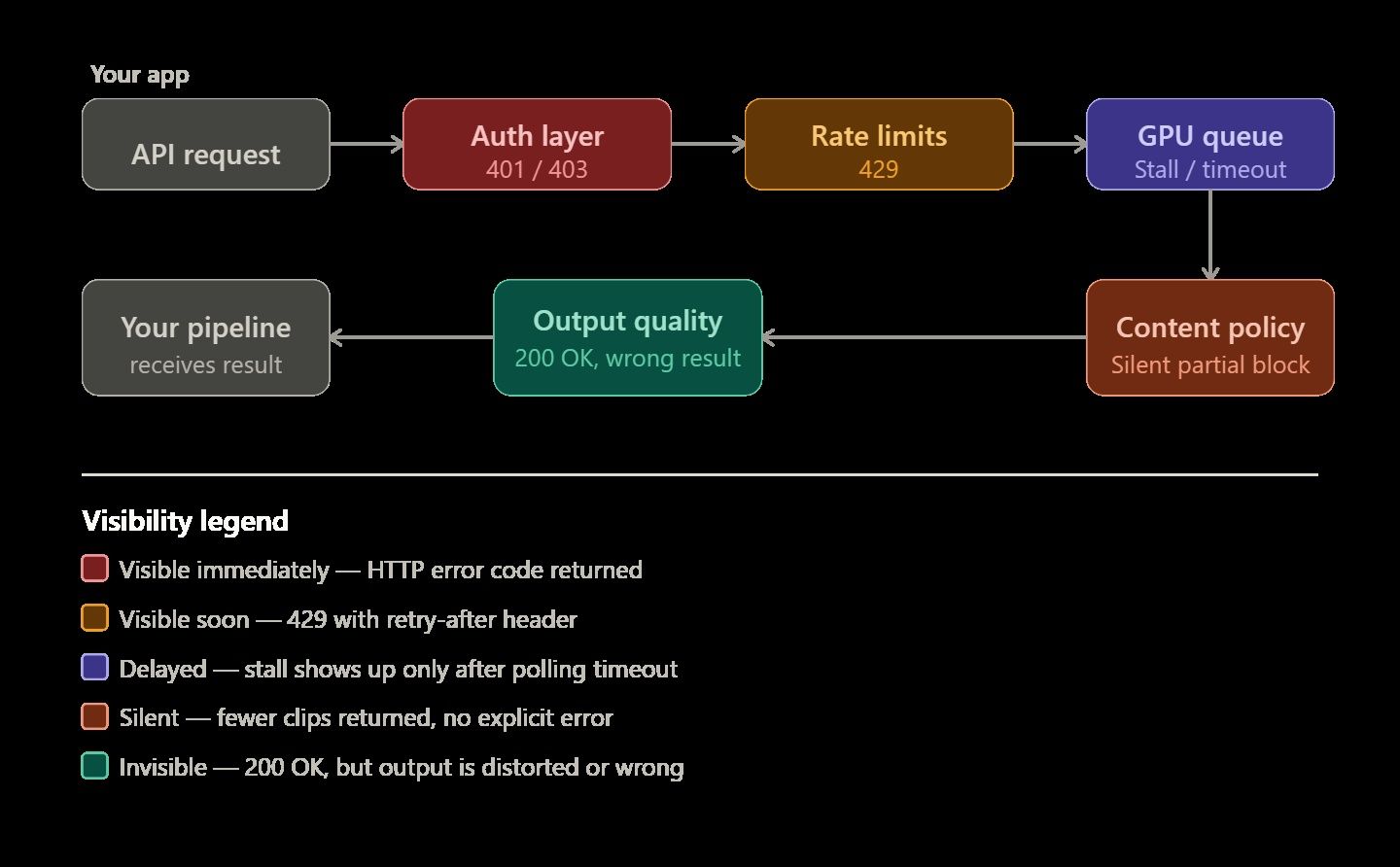

Las API de generación de video con IA tienen fama de ser temperamentales, y por una buena razón. Las finalizaciones de texto fallan inmediatamente con un error 400 cuando algo sale mal. El renderizado de video es diferente y más impredecible. Un trabajo puede permanecer para siempre en una cola de GPU sin previo aviso. Puede devolver solo la mitad de los clips solicitados. A veces, el renderizado termina perfectamente, pero el video final se ve físicamente imposible o distorsionado.

Necesitas saber por qué ocurren estos errores específicos para construir un sistema confiable. Este conocimiento es la principal diferencia entre una demostración simple y un pipeline de video que realmente funciona para usuarios reales.

Esta guía explica los modos de falla más comunes, cómo leer las respuestas de la API con precisión y estrategias concretas para construir un pipeline de renderizado de video que cueste menos y falle con menos frecuencia. Los ejemplos de código utilizan Atlas Cloud API, una plataforma de inferencia unificada que proporciona acceso a más de 300 modelos de video y multimodales a través de un único endpoint, lo que la convierte en una referencia útil para patrones de modelos múltiples.

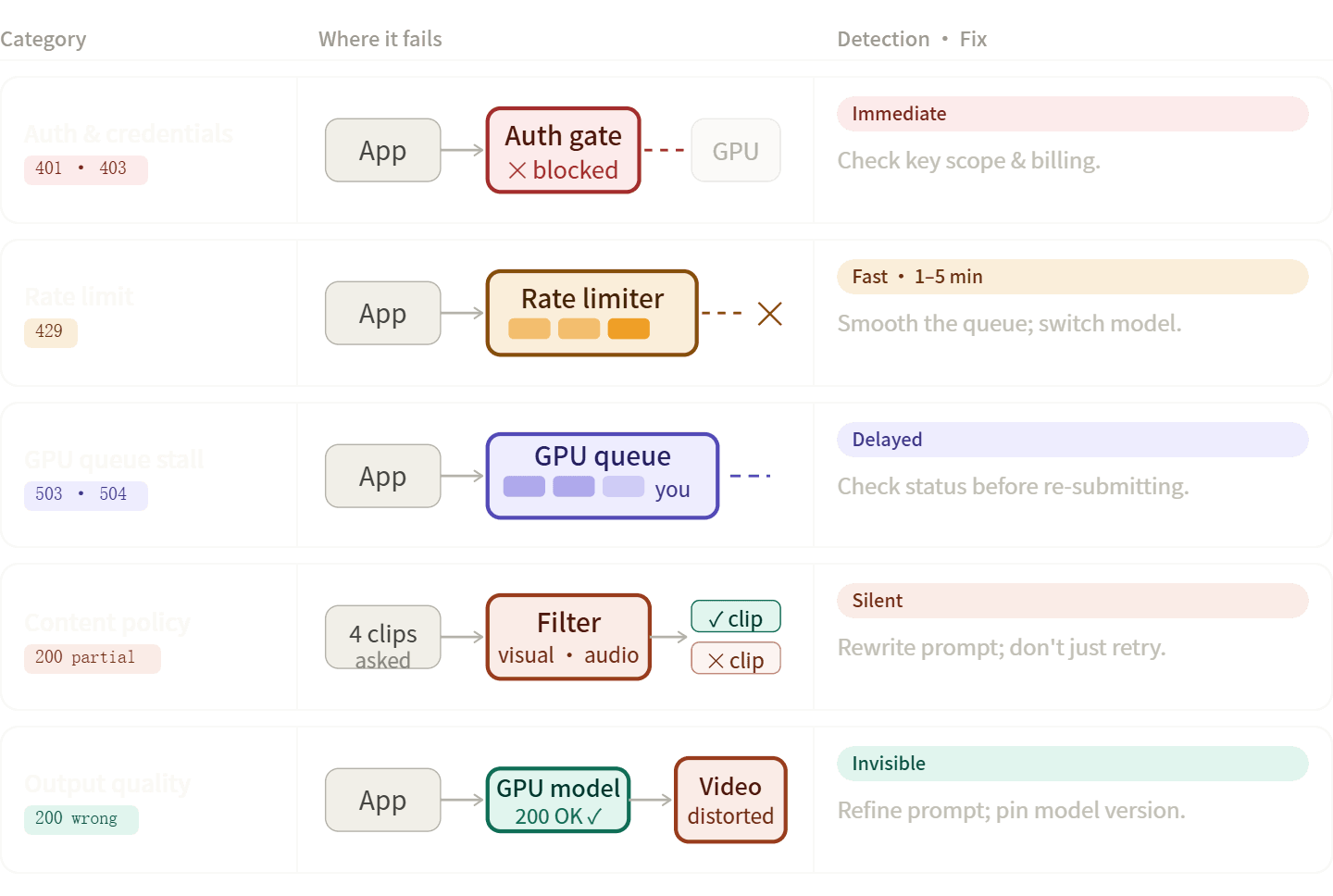

Las cinco categorías de errores de la API de video con IA

Los errores en los pipelines de video con IA suelen encajar en cinco grupos específicos. Conocer la categoría correcta te ayuda a resolver problemas más rápido, ya sea corrigiendo tu código, reescribiendo tu prompt o simplemente esperando.

Errores de autenticación y credenciales 401, 403

| Código | Causa típica | Solución |

| 401 No autorizado | Falta o malformación del encabezado Authorization: Bearer | Verifica que la clave se cargue desde variables de entorno, no codificada de forma rígida |

| 403 Prohibido (cuota) | Créditos de API agotados | Añadir facturación o actualizar plan |

| 403 Prohibido (permiso) | La clave carece de alcance para el modelo solicitado | Regenerar clave con los permisos correctos |

La gente suele confundirse aquí. Un error 403 por alcanzar una cuota y un 403 por permisos denegados usan el mismo código pero necesitan soluciones diferentes. No te fijes solo en el número de estado. Lee siempre el mensaje de error completo en el cuerpo para ver qué salió mal.

En plataformas como Atlas Cloud, una sola clave de API cubre todos los modelos, lo que significa que la deriva de autenticación, donde las claves del Proveedor A funcionan pero las del Proveedor B han caducado, simplemente no ocurre.

Errores de límite de tasa (429)

Los límites de tasa en las API de video son más castigadores que en las API de texto porque cada solicitud mantiene un slot de GPU durante 30–90 segundos. Un puñado de solicitudes concurrentes puede saturar un límite que parece generoso sobre el papel.

Distinciones clave para verificar primero:

- RPM (Solicitudes por minuto): Los modelos de producción en la API Veo 3.1 de Google permiten 50 RPM; los modelos de vista previa limitan a 10 RPM con un máximo de 10 solicitudes concurrentes por proyecto.

- Límites de solicitudes concurrentes: Incluso dentro de tu presupuesto de RPM, alcanzar el límite de concurrencia te dará un error 429.

- TPM (Tokens por minuto): Menos común para video, pero relevante en plataformas con facturación unificada entre modalidades.

Lo que realmente ayuda:

| Enfoque | Cuándo funciona | Cuándo no funciona |

| Retroceso exponencial + reintento | 429 causados por ráfagas momentáneas | Cuando la concurrencia es el límite real |

| Suavizado de ráfagas / encolamiento de solicitudes | Pipelines de procesamiento por lotes de alto volumen | UX interactiva y sensible a la latencia |

| Programación fuera de horas pico (lotes nocturnos) | Flujos de trabajo de pregeneración de contenido | Generación en tiempo real |

| Enrutamiento de modelos a una variante menos cargada | Plataformas unificadas con múltiples modelos equivalentes | Configuraciones de un solo proveedor |

Rechazos por políticas de contenido y filtros de seguridad

Estos son fáciles de diagnosticar erróneamente porque la respuesta de la API no siempre puede ser un error claro; puede ser simplemente menos clips de los que solicitaste. La documentación de Veo de Google señala explícitamente que si se devuelven menos videos de los solicitados, es posible que parte del resultado haya sido bloqueado por filtros de seguridad en lugar de que toda la solicitud falle en la capa de transporte.

Dos superficies de activación distintas:

- Prompts visuales: Temática, contexto de la escena o violencia implícita/contenido explícito.

- Prompts de audio/diálogo: El contenido del habla, las solicitudes de canciones y los paisajes sonoros densos activan pilas de filtros separadas.

Si tu clip falla solo cuando el audio es parte del prompt, depura el audio por separado de la escena visual. Reintentar un prompt bloqueado por políticas rara vez lo resuelve; el prompt debe cambiar.

Errores de transporte e infraestructura (500, 503, 504)

| Código | Tiempo de resolución típico | Qué hacer |

| 429 RESOURCE_EXHAUSTED | 1–5 minutos | Retroceder y reintentar |

| 503 Servicio no disponible | 30–120 minutos | Esperar; verificar panel de estado |

| 504 Tiempo de espera de puerta de enlace | Variable | Verificar si el renderizado sigue procesándose antes de volver a enviar |

| 500 Error interno del servidor | Depende | Registrar el ID de predicción; no reintentar automáticamente sin verificar el estado |

La regla crítica con los errores 500/504: verifica si tu renderizado sigue procesándose antes de volver a enviarlo. Los reintentos a ciegas en un 504 pueden resultar en renderizados duplicados y costos duplicados.

Fallas de calidad de salida

Estos no son errores HTTP; la API devuelve 200, pero el resultado es incorrecto. Formas comunes:

- Artefactos visuales o imprecisiones geométricas: El video con IA es probabilístico. El modelo interpreta las entradas en lugar de calcularlas físicamente.

- Falta de audio en modelos que lo soportan: Suele ser un problema de prompt o parámetro, no una falla de infraestructura.

- Duración o resolución incorrecta: Provocado por combinaciones no compatibles; no todos los modelos admiten todos los pares de duración/resolución.

- Caídas silenciosas del pipeline: Algunos pipelines de codificación descartan silenciosamente videos bajo ciertos formatos, apareciendo solo en el control de calidad.

Lectura de respuestas asíncronas: ID de predicción y sondeo de estado

La generación de video con IA es asíncrona por diseño. El ciclo de solicitud-respuesta tiene dos fases:

- POST al endpoint de generación → recibir un prediction_id

- GET al endpoint de resultados con ese ID → sondear hasta el estado terminal

El esquema de respuesta de Atlas Cloud ilustra cómo se ve una predicción completada:

plaintext1{ 2 "id": "pred_abc123", 3 "status": "completed", 4 "model": "bytedance/seedance-2.0/text-to-video", 5 "outputs": ["https://storage.atlascloud.ai/outputs/result.mp4"], 6 "metrics": { "predict_time": 45.2 }, 7 "created_at": "2025-01-01T00:00:00Z", 8 "completed_at": "2025-01-01T00:00:45Z" 9}

Los tres estados terminales:

| Estado | Significado | Acción |

| completed | Renderizado exitoso; las salidas están disponibles | Descargar dentro de la ventana de caducidad |

| failed | El renderizado falló; verificar el campo de error | Registrar mensaje de error; decidir sobre el reintento |

| expired | Las salidas ya no están disponibles | Volver a enviar si aún es necesario |

El error de sondeo más común

Los desarrolladores comprueban habitualmente status === "failed" pero nunca leen el campo de error que le sigue. Ese campo es donde vive la información procesable; sin él, sabes que un renderizado falló pero no si debes corregir el prompt, verificar tu cuota o esperar a que pase un fallo de infraestructura.

Patrón de sondeo listo para producción

plaintext1import time 2import requests 3 4def poll_prediction(prediction_id: str, api_key: str, max_wait: int = 600) -> dict: 5 url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 6 headers = {"Authorization": f"Bearer {api_key}"} 7 terminal_states = {"completed", "failed", "expired"} 8 wait = 5 9 10 for _ in range(max_wait // wait): 11 resp = requests.get(url, headers=headers).json() 12 status = resp.get("status") 13 14 if status in terminal_states: 15 if status == "failed": 16 print(f"Render failed: {resp.get('error')}") 17 return resp 18 19 time.sleep(wait) 20 wait = min(wait * 1.5, 60) # limitar retroceso a 60s 21 22 raise TimeoutError(f"Prediction {prediction_id} did not complete within {max_wait}s")

Registra metrics.predict_time en cada renderizado completado. Los picos en este valor son un indicador principal de la degradación de la infraestructura, una señal útil antes de empezar a ver fallas totales.

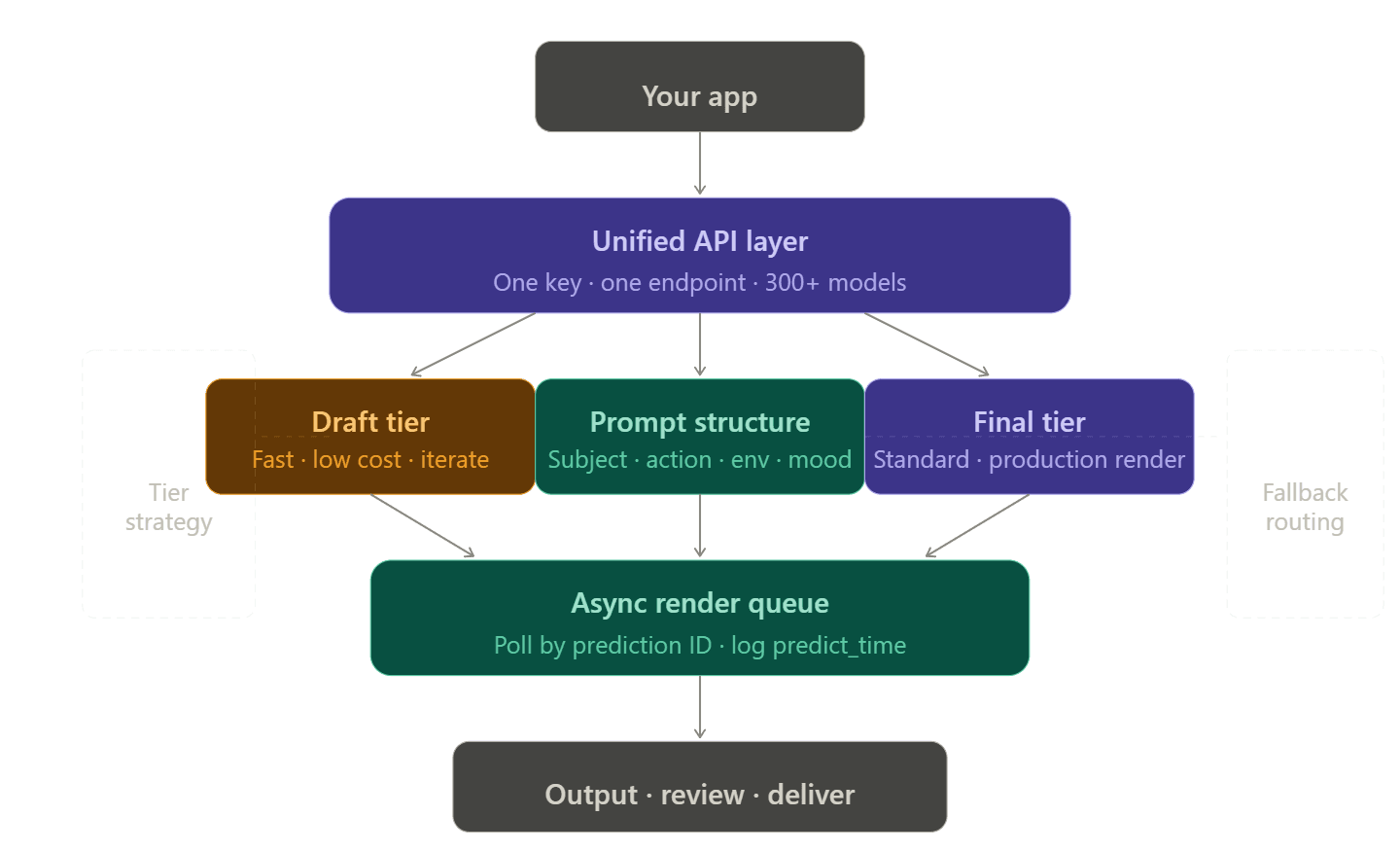

Estructuración de un pipeline de renderizado resiliente

Arquitectura de un solo proveedor vs. API unificada

Administrar múltiples cuentas, tokens y páginas de facturación para cada proveedor de video es un verdadero dolor de cabeza. Los desarrolladores suelen llamar a esto el "impuesto de integración". Empeora rápidamente. Si un modelo alcanza un límite, necesitas un respaldo. Ese respaldo luego necesita su propia clave de API, configuración de facturación y código personalizado para manejar los errores.

Las plataformas de API unificada eliminan esto enrutando a múltiples proveedores a través de un único endpoint. En Atlas Cloud, cambiar de openai/sora-2/text-to-video a bytedance/seedance-2.0/text-to-video requiere cambiar una cadena: los encabezados, la autenticación y la facturación permanecen idénticos.

Niveles de borrador a final

Una de las mejoras de costos y confiabilidad de mayor apalancamiento disponibles es simplemente elegir el nivel de modelo correcto para la etapa correcta del flujo de trabajo:

| Etapa | Nivel recomendado | Por qué |

| Exploración de prompts / prueba de concepto | Nivel rápido / económico | Ahorro de costos de más del 78% vs Estándar; los errores surgen a bajo costo |

| Borradores de revisión interna | Nivel rápido | Lo suficientemente bueno para la revisión de las partes interesadas |

| Renderizados de producción final | Nivel estándar / Pro | La diferencia de calidad justifica el costo |

| Contenido por lotes (redes sociales, marketing) | Nivel rápido | El volumen hace que la diferencia de costos sea significativa |

En Atlas Cloud, el nivel rápido de Seedance 2.0 funciona a $0.081/seg frente a $0.10/seg para el estándar, una diferencia que se suma rápidamente a escala. Un equipo que genere 200 clips de diez segundos por mes gastaría $162 en rápido frente a $200 en estándar para el mismo conjunto de prompts.

Ingeniería de prompts como prevención de errores

Los prompts vagos son una fuente subestimada de fallas en el pipeline. Un prompt como "una persona caminando" obliga al modelo a tomar demasiadas decisiones arbitrarias, produciendo resultados inconsistentes que requieren más reintentos.

Una estructura de prompt de 4 componentes confiable:

plaintext1[Sujeto + detalle] + [Acción + estilo de movimiento] + [Entorno + iluminación] + [Cámara + estado de ánimo] 2 3Ejemplo: 4"Una mujer con un abrigo rojo caminando enérgicamente por una calle de Tokio mojada por la lluvia durante la noche, 5reflejos de neón en el pavimento mojado, plano medio de seguimiento, cinematográfico y tenso"

Al usar modelos que admiten entrada multimodal (Seedance 2.0 acepta hasta 12 archivos de referencia: imágenes, clips de video y audio), proporcionar referencias visuales reduce la ambigüedad que conduce a fallas en la calidad de la salida.

Elección del modelo correcto

No todas las herramientas de video con IA fallan por la misma razón. Esto se debe a que están creadas para objetivos diferentes. Usar el modelo incorrecto para tu tarea específica es un gran error. Conduce a malos resultados que parecen errores técnicos, pero por lo general, el modelo simplemente no está hecho para hacer ese trabajo.

Referencia de capacidad del modelo

| Modelo | Fortaleza | Ten cuidado con | Precio (Atlas Cloud) |

| wan 2.7 | Simulación de física, interacción realista de objetos | Solo referencia de imagen única; mayor costo | $0.1/seg |

| Kling 3.0 | Salida de alta resolución; sincronización labial nativa; nivel gratuito (66 créditos diarios) | Tiempos de generación más largos a resolución máxima | $0.071–0.143/seg |

| Veo 3.1 | Calidad cinematográfica; fuerte cumplimiento de seguridad | Límites de tasa del modelo de vista previa (10 RPM) | $0.05–0.20/seg |

| Seedance 2.0 | Control de entrada de referencia múltiple; audio nativo | Requiere una construcción de prompt más cuidadosa | $0.081–0.10/seg |

| Wan 2.6 | Menor costo; contenido de alto volumen | Sin audio nativo; máx 1080p | $0.018–0.07/seg |

Precios obtenidos de la documentación de Atlas Cloud, abril de 2026. Para precios específicos, consulte el sitio web oficial.

Cuándo cambiar de modelo vs. Corregir la solicitud

Cambia el modelo si:

- Los clips fallan constantemente solo cuando hay audio o diálogo en el prompt, es posible que el modelo carezca de capacidad de audio

- La falla está en la calidad de la física o la interacción de los objetos, no en el prompt

- Estás en un modelo de vista previa alcanzando límites de tasa que un modelo de producción no tendría

Corrige el prompt si:

- El resultado es estilísticamente incorrecto pero estructuralmente correcto

- Los filtros de seguridad se están activando con un lenguaje específico

- Se están rechazando parámetros de duración o resolución

Fíjate a una cadena de versión específica (p. ej., kling-v3.0-std no kling-latest). Las actualizaciones silenciosas de modelos pueden introducir regresiones de calidad que son casi imposibles de depurar sin fijar la versión.

Tu kit de herramientas de depuración

Qué registrar en cada etapa

El registro es la forma más rápida de reducir el tiempo de depuración a la mitad. Un registro efectivo mínimo captura:

En la solicitud:

- ID y versión del modelo

- Hash del prompt, no el prompt completo; mantiene los registros compactos

- Parámetros de duración, resolución y modo

- Marca de tiempo

En la respuesta:

- ID de predicción

- Estado inicial

- Cualquier mensaje de error inmediato

Al completar el sondeo:

- Estado final

- predict_time de las métricas

- Contenido del campo de error (si falló)

- URL de salida (si se completó)

Lectura de errores de infraestructura vs. errores de aplicación

Cuando una generación falla, una secuencia de diagnóstico rápida ahorra tiempo:

- Primero verifica el panel de salud de la API: si la plataforma está degradada, estás depurando lo incorrecto.

- Lee los encabezados de respuesta x-deny-reason: las denegaciones del proxy de egreso aparecen aquí y parecen errores de modelo sin este encabezado.

- Verifica si hay errores CORS si estás llamando desde un frontend; producen el mismo síntoma que las fallas de autenticación en las DevTools del navegador.

- Verifica las restricciones de archivos antes de asumir un error de modelo: la mayoría de las plataformas imponen un tamaño máximo de archivo de entrada (a menudo 16 MB) y un conjunto limitado de formatos aceptados.

El panel de monitoreo de Atlas Cloud muestra el estado de escalado automático y los datos de uso por solicitud, lo que ayuda a distinguir un día lento de infraestructura de un problema de prompt o código.

Optimización de costos

Las tres palancas

El costo de renderizado es producto de tres variables. Optimizar las tres simultáneamente, en lugar de simplemente elegir un modelo más barato, produce los mayores ahorros:

| Palanca | Opción de bajo costo | Opción de alto costo | Multiplicador típico |

| Nivel de modelo | Rápido | Estándar/Pro | 3–5× |

| Duración | 4–5 segundos | 12–15 segundos | 3× |

| Resolución | 720p | 4K | 2–4× |

Un solo renderizado Estándar 4K de 8 segundos puede costar 6-8 veces más que un equivalente Rápido de 720p de la misma duración. Si tu canal de distribución son redes sociales o web, 720p o 1080p suele ser indistinguible para los usuarios finales.

Facturación basada en uso vs. suscripción

Los planes de IA para consumidores, como Google AI Pro a $19.99/mes o AI Ultra a $249.99/mes, proporcionan una generación de video limitada a través de la interfaz de Google AI pero no incluyen acceso a la API. Este es un error común de planificación presupuestaria para los equipos que pasan de herramientas de consumo a pipelines de producción.

Atlas Cloud utiliza facturación basada en el uso para igualar tus costos con cuánto construyes realmente. Esto funciona mejor si las necesidades de tu proyecto cambian de una semana a otra. Debes realizar un seguimiento del costo por segundo de video terminado. Esta es la mejor manera de comparar diferentes modelos y niveles de precios de manera justa.

Reutilización de activos de referencia

Si estás generando muchos clips con los mismos personajes, escenas o referencias de estilo, registra previamente esos activos:

- Sube imágenes o videos de referencia una vez; almacena el ID del activo devuelto

- Pasa asset://<ark_asset_id> en solicitudes posteriores en lugar de volver a cargarlos

- Las subidas de archivos de referencia no se miden en la mayoría de las plataformas; solo se factura la duración de la salida generada

Lista de verificación de preparación para producción

Antes de enviar un pipeline de generación de video a producción, verifica cada uno de los siguientes puntos:

Autenticación

- [ ] Clave de API cargada desde variables de entorno, no codificada de forma rígida

- [ ] La clave tiene los alcances correctos para todos los modelos en uso

- [ ] Política de rotación en vigor

Límites de tasa y concurrencia

- [ ] Límites de RPM y de solicitudes concurrentes confirmados para cada nivel de modelo

- [ ] Suavizado de ráfagas o cola en vigor para flujos de trabajo por lotes

- [ ] Modelo de respaldo configurado para escenarios de límite de tasa

Manejo de errores

- [ ] Estados terminales (completado, fallido, caducado) todos manejados

- [ ] Campo de error capturado y registrado en cada estado fallido

- [ ] Tiempo de espera del subproceso/solicitud establecido en ≥ 10 minutos para renderizados largos

- [ ] Sin reintento automático a ciegas en 500/504 sin verificar primero el estado

Contenido y prompts

- [ ] Prompts revisados previamente contra las pautas de contenido de la plataforma

- [ ] Disparadores de audio y visuales aislados en las pruebas

- [ ] Estructura de prompt de 4 componentes adoptada como estándar del equipo

Configuración del modelo

- [ ] Cadena de versión específica fijada (no la última)

- [ ] Nivel de modelo adaptado a la etapa del flujo de trabajo (Rápido para borradores, Estándar para finales)

- [ ] Todos los parámetros requeridos confirmados para el modelo elegido (duración, resolución, audio)

Controles de costos

- [ ] Panel de facturación basado en el uso configurado con alertas

- [ ] Nivel rápido predeterminado para todos los renderizados que no sean finales

- [ ] IDs de activos de referencia utilizados para activos recurrentes

Observabilidad

- [ ] ID de predicción, estado y predict_time registrados en cada renderizado

- [ ] Panel de salud de la API marcado y verificado antes de una depuración profunda

- [ ] Alertas configuradas sobre picos de predict_time

Un pipeline de video que maneja errores no es mucho más difícil de construir que uno que se rompe. Solo necesitas ser inteligente sobre cómo lidias con las fallas en cada paso. Asegúrate de que tu registro sea sólido y mantente en versiones de modelo específicas. Antes de preocuparte por cualquier otra cosa, configura un pipeline que pase de borradores rápidos a renderizados finales. El resto sigue naturalmente.

Preguntas frecuentes

¿Qué causa los errores 429 de Resource Exhausted en el plan premium?

El error 429 simplemente significa que has alcanzado tus límites de tasa. Para seguir funcionando sin problemas, los proveedores limitarán tus solicitudes y tokens.

- La solución: Añade retroceso exponencial a tu código. Esto ayuda al sistema a esperar y reintentar por sí mismo. Verifica también tu "Nivel de uso" en el panel. Tienes que gastar más dinero para desbloquear velocidades más rápidas.

¿Cómo se pueden evitar los falsos positivos de "Moderación de contenido"?

Los filtros de seguridad a menudo malinterpretan los prompts técnicos como violaciones de políticas.

- La solución: Corrige tu prompt intercambiando palabras vagas por otras técnicas. No digas "energía caótica" cuando te refieres a "movimiento de cámara de alta velocidad". También puedes usar un LLM para limpiar tus prompts. Esto los convierte en descripciones claras que la máquina entiende y evita errores.

¿Cómo se puede reducir la latencia de mi pipeline de renderizado?

La latencia suele provenir de un mal sondeo o de tamaños de modelo grandes. Usa Webhooks en lugar de sondeo manual para recibir datos de finalización. Si realizas autoalojamiento, aplica la Cuantización FP8 para acelerar la inferencia. Para los usuarios de API, cambia al procesamiento asíncrono para manejar múltiples generaciones en paralelo en lugar de secuencialmente.