Respuesta rápida

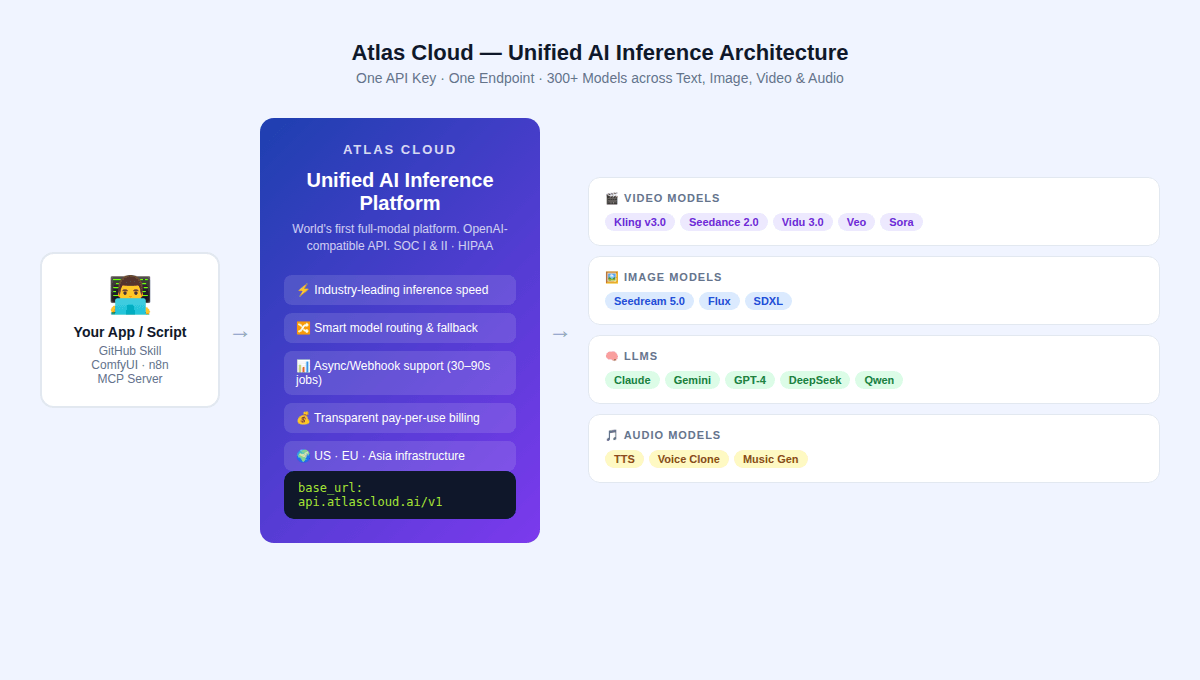

Una Skill de Generador de Vídeo con IA para GitHub conecta tu código con modelos de vídeo mediante IA. En 2026, la elección entre código abierto (gratis, autohospedado) y APIs de pago (nube, instantáneo) depende de cuatro variables: disponibilidad de VRAM, requisitos de privacidad de datos, nivel de calidad necesario y volumen mensual de generación. Para flujos de trabajo a escala de producción que necesiten múltiples modelos SOTA, Atlas Cloud (atlascloud.ai) ofrece acceso a más de 300 modelos —incluyendo Kling v3.0, Seedance 2.0, Vidu 3.0, Veo y Sora— a través de una única clave de API con precios transparentes de pago por uso.

-

¿Qué es una Skill de Generador de Vídeo con IA? {#what-is-a-skill}

En el contexto de los repositorios de GitHub, una Skill de Generador de Vídeo con IA es un módulo reutilizable, un envoltorio (wrapper) o una capa de integración que conecta una aplicación con un backend de generación de vídeo por IA, ya sea un modelo de código abierto autohospedado o una API en la nube.

Piensa en ella como la abstracción entre la lógica de tu aplicación y el motor de inferencia real. Una skill puede ser:

- Una clase de Python que envuelve el pipeline del modelo para la generación de texto a vídeo.text

1Wan 2.2 - Un nodo personalizado de ComfyUI que se conecta a la API de Atlas Cloud para la generación con Kling v3.0.

- Un nodo de flujo de trabajo en n8n que activa Seedance 2.0 mediante REST y devuelve una URL de vídeo.

- Una herramienta de LangChain o una skill de servidor MCP que invoca un endpoint de generación de vídeo bajo demanda.

La pregunta central a la que se enfrenta todo desarrollador al crear una: ¿debería el backend estar basado en pesos de código abierto ejecutándose localmente o en una API de nube de pago?

Datos reales de 2026. Nada de teoría.

-

Código abierto en GitHub en 2026 {#open-source-landscape}

El ecosistema de generación de vídeo de código abierto ha madurado significativamente. Algunos repositorios son ahora alternativas genuinas a las APIs de pago, al menos para ciertas tareas.

Nivel 1: Modelos de código abierto de grado de producción

HunyuanVideo (Tencent, 11.9k ⭐) — Uno de los mejores generadores de vídeo de código abierto que existen. Maneja 720p y 1080p. Su principal limitación es su requerimiento de hardware: 60–80GB de VRAM para el modelo completo, lo que lo hace accesible solo a equipos con acceso a GPU de nivel empresarial. La licencia comunitaria permite el uso comercial con atribución.

CogVideoX-1.5 (THUDM/CogVideo, 12.5k ⭐) Lanzado bajo Apache 2.0, este es uno de los modelos abiertos más amigables para desarrolladores. Se carga de forma nativa a través de Hugging Face Diffusers en unas pocas líneas de Python. Las transiciones de fotogramas son fluidas y el seguimiento de prompts es sólido. Necesita un mínimo de 16GB de VRAM. Una opción sólida si tu equipo ya trabaja habitualmente con Hugging Face.

Open-Sora 2.0 (hpcaitech, 24.1k ⭐) El proyecto de generación de vídeo de código abierto con más estrellas en GitHub. La versión 2.0 (11B de parámetros) logra un rendimiento comparable al de HunyuanVideo en los benchmarks de VBench, y el coste de entrenamiento se reportó en aproximadamente 200.000 dólares, una cifra notable para un modelo de este calibre. Permite texto a vídeo, imagen a vídeo y generación de longitud infinita.

Nivel 2: Opciones de código abierto más ligeras (menor VRAM)

Wan 2.2 (Alibaba Tongyi) La historia de accesibilidad aquí es convincente: la variante de 1.3B funciona con 8GB de VRAM y la variante de 14B con 24GB. La arquitectura de Mezcla de Expertos (MoE) ofrece mejores detalles con menor coste de cómputo, y la versión 2.2 es un 30% más rápida a 720p que su predecesora. Para desarrolladores que ejecutan una sola GPU de consumo, Wan 2.2 es la opción de código abierto más potente.

LTX-Video (Lightricks) Diseñado ante todo para la velocidad. Genera a 30fps con una resolución de 1216×704, más rápido que el tiempo real en hardware capaz. La integración con ComfyUI es madura e incluye escaladores espaciales y temporales integrados.

Nivel 3: Pipelines agénticos

OpenMontage (calesthio, nuevo en abril de 2026) Una categoría genuinamente novedosa: un sistema de producción de vídeo agéntico con 11 pipelines, 49 herramientas y más de 400 habilidades de agente. Funciona con asistentes de programación por IA como Claude Code, Cursor y Copilot. Maneja el pipeline completo —investigación, guion, activos, edición— de principio a fin sin pasos manuales. Creado para equipos que conectan múltiples herramientas de IA en un mismo flujo de trabajo.

-

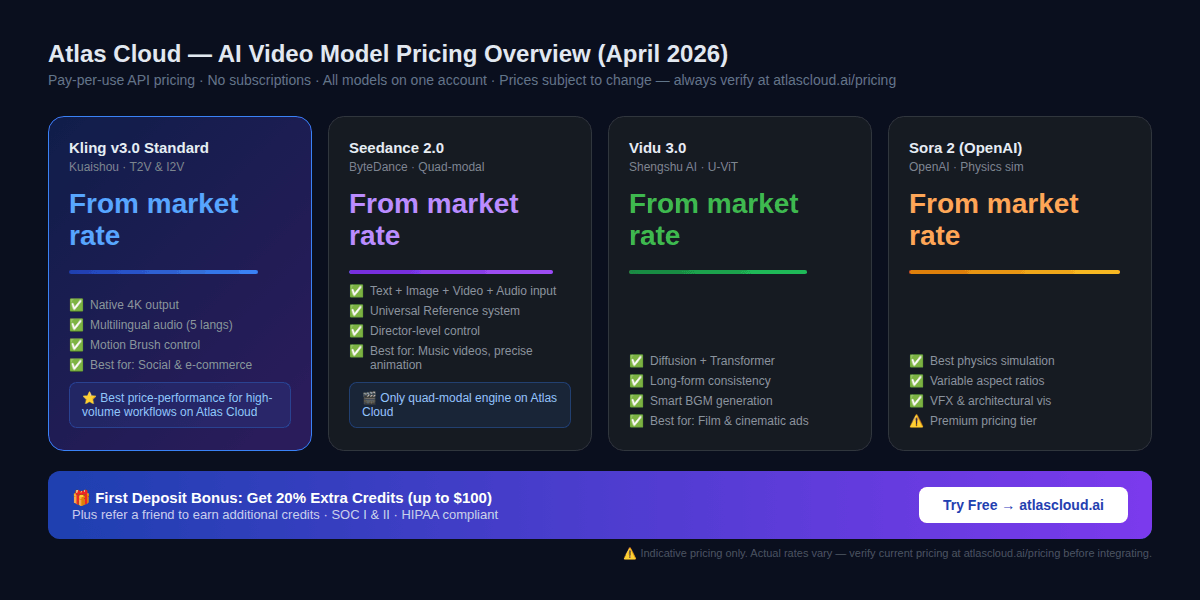

Directorio de APIs de pago: Modelos SOTA disponibles ahora {#paid-api-directory}

El panorama de las APIs de pago en 2026 se define por tres grandes familias de modelos, cada una con un enfoque técnico distinto. Las tres están disponibles a través de la API unificada de Atlas Cloud.

Kling v3.0 (Kuaishou)

Lanzado el 5 de febrero de 2026. Construido sobre una arquitectura de lenguaje visual multimodal: texto, imágenes, audio y vídeo, todo manejado en un mismo sistema.

Lo que realmente hace mejor que sus competidores:

- Movimiento humano complejo (correr, bailar, artes marciales) sin la deformación de "extremidades de espagueti" que afecta a otros modelos.

- Generación de audio nativo multilingüe (5 idiomas, incluyendo sincronización labial).

- Motion Brush: una herramienta que permite a los desarrolladores (o usuarios finales) pintar rutas de movimiento directamente sobre las imágenes fuente, una característica que actualmente no tiene equivalente en modelos competidores.

- Element Binding para un seguimiento consistente de personajes y objetos a lo largo de las tomas.

Donde se queda corto: La velocidad de renderizado es más lenta que la de algunos competidores en el nivel Pro. Las transiciones de la herramienta de guion gráfico pueden ser "torpes" según revisores independientes.

Ideal para: Vídeos cortos en TikTok y Reels, vídeos de productos de comercio electrónico, y cualquier cosa que requiera mucho volumen con personajes que mantengan su consistencia.

Seedance 2.0 (ByteDance)

Lanzado el 8 de febrero de 2026, Seedance 2.0 representa un cambio de paradigma en cómo se generan los prompts para vídeo por IA, pasando del prompting solo de texto a un control basado en referencias al estilo director de cine.

La innovación técnica central: Seedance 2.0 acepta entradas cuadrimodales (texto, imagen, vídeo y audio) simultáneamente. Su sistema de "Referencia Universal" permite a un desarrollador alimentar un vídeo de referencia de una persona bailando, y el modelo replicará el movimiento de cámara, las acciones del personaje y la composición en el resultado generado. Esto resuelve la consistencia de los personajes de una forma que los modelos de solo texto a vídeo no pueden.

Las pruebas independientes confirman que destaca en:

- Narración de historias multishot con identidad de personaje consistente en todos los cortes.

- Generación sincronizada de audio y vídeo (la arquitectura de doble rama genera sonido y vídeo simultáneamente).

- Replicación precisa de la composición y la iluminación de los activos de referencia.

Nota sobre disponibilidad: A partir de abril de 2026, el acceso a la API internacional de Seedance 2.0 está disponible a través de plataformas como Atlas Cloud. El acceso directo a la API de BytePlus para desarrolladores internacionales ha tenido inconsistencias en su disponibilidad: confirma el estado actual antes de crear una dependencia en endpoints directos de ByteDance.

Ideal para: Vídeos musicales, animación de personajes precisa, anuncios de productos donde el movimiento debe ser exacto, y agencias que ejecutan flujos de trabajo de guion gráfico a vídeo.

Vidu 3.0 (Shengshu AI / Tsinghua)

Construido sobre la arquitectura original U-ViT que combina tecnologías de difusión y transformadores, Vidu se centra en áreas donde la mayoría de los vídeos por IA todavía tienen dificultades: coherencia ambiental y consistencia cinematográfica.

Características distintivas:

- Sistema de referencia universal para una iluminación consistente en secuencias de múltiples tomas.

- Generación inteligente de música de fondo que se adapta automáticamente al estado de ánimo de la escena.

- Generación de formato largo con una fuerte consistencia temporal (crítico para secuencias de más de 5 segundos).

Mejores casos de uso: Flujos de trabajo profesionales de cine, diseño de animación y publicidad creativa que requiera calidad cinematográfica.

Sora 2 (OpenAI)

Sora 2 sigue siendo la referencia en precisión de simulación física. Si rompes un cristal en un prompt de Sora 2, el patrón de fragmentación, la física de fluidos y los reflejos se comportan como en la realidad; la mayoría de los competidores aún no pueden igualar ese nivel de consistencia.

Ideal para: Trabajos de VFX, visualización arquitectónica, B-roll de documentales y cualquier lugar donde la precisión física sea más importante que ahorrar dinero.

Precios: Sora 2 tiene el coste más alto en esta categoría. Pagas por el ordenador.

-

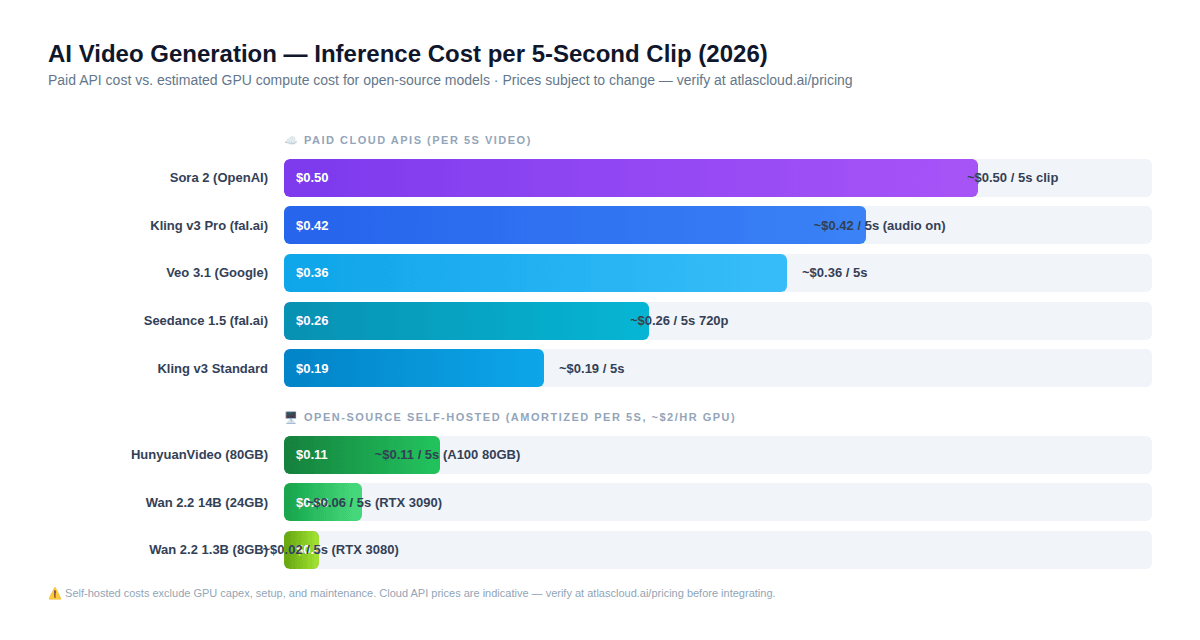

Costes de inferencia: Los números reales {#inference-costs}

Esta sección contiene el hallazgo contraintuitivo más importante de toda esta guía, uno que cambia la intuición predeterminada de la mayoría de los desarrolladores sobre el código abierto frente a las APIs de pago.

El coste oculto de los modelos autohospedados

La mayoría de los desarrolladores asumen: "Código abierto = gratis = siempre más barato".

Esta suposición es incorrecta para la mayoría de los tamaños de equipo.

Así es como se ven los números reales para un clip de vídeo de 5 segundos en 2026:

Código abierto autohospedado (coste de GPU amortizado a ~2 $/h):

- Wan 2.2 1.3B (RTX 3080): ~0,02 $ por clip de 5s

- Wan 2.2 14B (RTX 3090): ~0,06 $ por clip de 5s

- HunyuanVideo (A100 80GB): ~0,11 $ por clip de 5s

API de nube de pago (precios indicativos, verifica en atlascloud.ai/pricing):

- Kling v3 Standard: ~0,19 $ por clip de 5s

- Seedance 1.5 720p con audio: ~0,26 $ por clip de 5s

- Kling v3 Pro con audio: ~0,42 $ por clip de 5s

- Sora 2: ~0,50 $ por clip de 5s

Los números de autohospedaje parecen convincentes de forma aislada. El problema es que excluyen:

- Hardware de GPU: Una A100 de 80GB cuesta entre 10.000 y 15.000 $. Con 1.000 vídeos al mes (~0,11 $ cada uno), tardarías más de 9.000 meses solo en recuperar la inversión del hardware.

- Tiempo de configuración: La configuración de CUDA, la descarga de pesos del modelo, la gestión de VRAM y la depuración representan de 20 a 40 horas de ingeniería de configuración inicial.

- Mantenimiento continuo: Las actualizaciones de modelos, conflictos de dependencias y la fiabilidad de la infraestructura suponen costes de tiempo continuos.

- Coste de oportunidad: El tiempo dedicado a la infraestructura de inferencia es tiempo que no se dedica al producto.

La condición de contorno práctica:

El autohospedaje solo compensa si: (a) ya tienes GPUs ejecutando otras cargas de trabajo, (b) estás produciendo más de 5.000 vídeos al mes, o (c) las normativas te obligan a mantener todo on-prem.

Por debajo de ese umbral, las APIs de pago —especialmente las plataformas unificadas como Atlas Cloud— son más baratas cuando se calcula honestamente el coste total de propiedad.

-

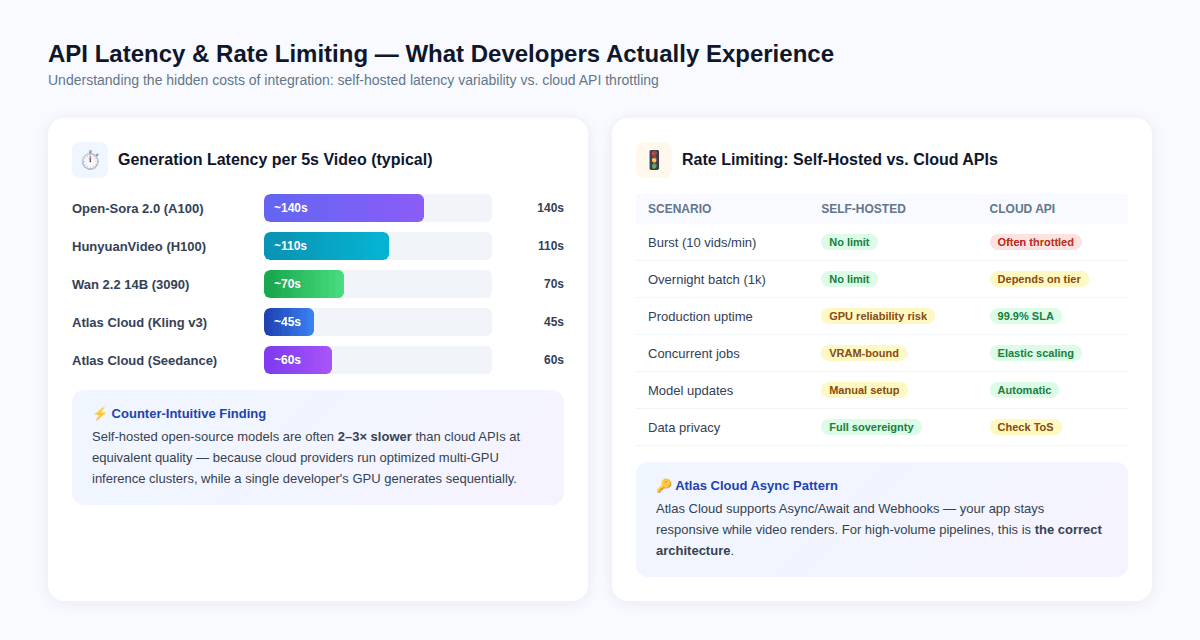

Limitación de tasa y latencia de API: Lo que realmente experimentan los desarrolladores {#rate-limiting}

La paradoja de la latencia

Contraintuitivamente, las APIs en la nube suelen ser más rápidas por vídeo que los modelos autohospedados — no porque los modelos sean diferentes, sino porque los proveedores de la nube ejecutan clústeres de inferencia multi-GPU optimizados con procesamiento por lotes a nivel de hardware, mientras que una GPU de desarrollador individual genera fotogramas secuencialmente.

Latencia típica por clip de 5 segundos:

- Open-Sora 2.0 en A100: ~140 segundos

- HunyuanVideo en H100: ~110 segundos

- Wan 2.2 14B en RTX 3090: ~70 segundos

- Atlas Cloud / Kling v3: ~45 segundos

- Atlas Cloud / Seedance 2.0: ~60 segundos

Esto significa que construir una skill de GitHub alrededor de un modelo autohospedado puede producir tiempos de espera más largos para el usuario, incluso cuando el coste por vídeo es menor.

Limitación de tasa: La realidad de la producción

Los modelos autohospedados no tienen límites de tasa impuestos por la API; están limitados solo por la VRAM y los límites térmicos de tu GPU.

Las APIs de pago imponen límites de tasa que varían según el nivel de precios. Las implicaciones técnicas relevantes:

- Peticiones en ráfaga (más de 10 vídeos por minuto) activarán la limitación en la mayoría de los niveles de API de pago.

- Trabajos por lotes nocturnos (más de 1.000 vídeos) requieren un diseño asíncrono cuidadoso para evitar tiempos de espera (timeouts).

- Peticiones simultáneas en modelos autohospedados están limitadas por la VRAM; no suele ser posible ejecutar 2 inferencias de un modelo de 14B simultáneamente en una sola tarjeta de 24GB.

Atlas Cloud resuelve el problema de la limitación de tasa a través de una arquitectura asíncrona con Webhooks: tu aplicación envía un trabajo de generación, recibe un ID de tarea y recibe una notificación vía webhook cuando el renderizado se completa. Este patrón evita bloqueos en la aplicación mientras el vídeo se renderiza y escala correctamente para cargas de trabajo por lotes.

La arquitectura correcta para producción

plaintext1# Patrón asíncrono de Atlas Cloud — Listo para producción 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key="TU_CLAVE_API_DE_ATLAS_CLOUD", 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10# Enviar tarea de generación 11response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt="Carrete de demostración de producto, movimiento fluido, relación de aspecto 9:16", 14 size="1080x1920", 15 n=1 16) 17 18# Manejar respuesta asíncrona 19video_url = response.data[0].url 20print(f"Vídeo generado: {video_url}")

Para flujos de trabajo de imagen a vídeo, ten en cuenta que algunos modelos (incluyendo ciertas variantes i2v de Kling) no aceptan un parámetro de relación de aspecto separado para la generación de imagen a vídeo; la resolución de salida sigue las dimensiones de la imagen de entrada. Construye tu generación de imágenes ascendente con la relación de aspecto objetivo correcta.

-

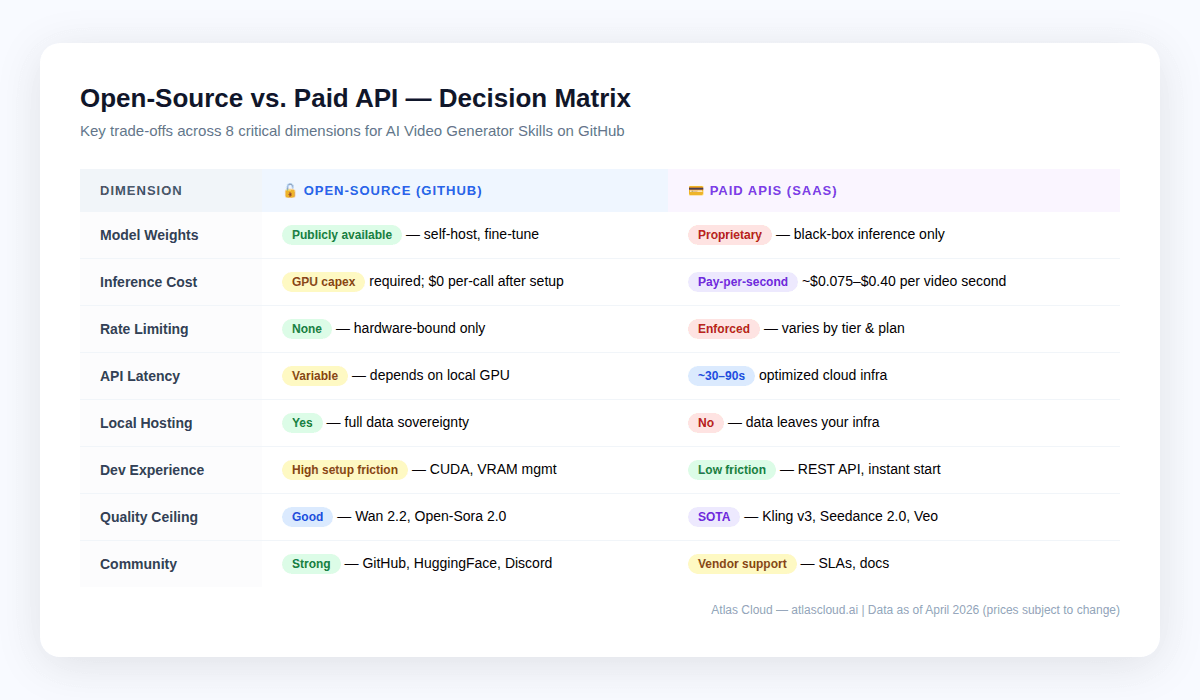

Alojamiento local vs. API de nube: La matriz de compensación {#local-vs-cloud}

No es una cuestión de "o esto o aquello". La mayoría de los pipelines de producción combinan ambos: código abierto para prototipado y pases masivos de baja calidad, y APIs en la nube para renders finales y calidad de vanguardia.

Cuando el alojamiento local tiene sentido

- Bloqueos de cumplimiento: HIPAA, GDPR o cualquier dato propietario que no pueda salir de tus servidores. El autohospedaje es tu única opción. Atlas Cloud cumple con HIPAA y cuenta con certificación SOC I & II, lo que cubre la mayoría de las necesidades empresariales, pero las empresas reguladas deben verificar sus requisitos específicos.

- Volumen muy alto con calidad aceptable: los equipos que generan más de 10.000 vídeos al mes con niveles de calidad de Wan 2.2 pueden encontrar que los costes de alquiler de GPU son menores que las tarifas de API a esa escala.

- Investigación y ajuste fino (fine-tuning): los pesos de los modelos abiertos permiten realizar ajustes finos sobre conjuntos de datos propietarios. Ninguna API en la nube ofrece actualmente formación de modelos personalizados.

- Configuraciones desconectadas (air-gapped): despliegues en el borde (edge) sin conectividad o redes bloqueadas.

Cuando las APIs en la nube ganan

- Tiempo de lanzamiento al mercado: una integración con Atlas Cloud lleva horas, no semanas.

- Calidad de primer nivel: líderes de código abierto como Wan 2.2 y Open-Sora 2.0 todavía van por detrás de modelos propietarios como Kling v3 y Seedance 2.0, especialmente en movimiento humano, manteniendo las tomas consistentes y con audio nativo.

- Cargas de trabajo irregulares: las APIs en la nube escalan hacia arriba y hacia abajo; tus propias GPUs no.

- Menor volumen: por debajo de los 5.000 vídeos al mes, las APIs en la nube suelen ganar en coste total.

- Flexibilidad multimodelo: el catálogo de más de 300 modelos de Atlas Cloud significa que puedes cambiar de Kling a Seedance o a Veo dentro de una misma integración.

-

Desarrollo impulsado por la comunidad vs. impulsado por el proveedor {#community-vs-vendor}

Es fácil ignorarlo al comparar APIs, pero esto es importante si estás creando skills para GitHub.

Impulsado por la comunidad (código abierto):

- Cualquiera puede enviar correcciones de errores y solicitar funciones, y ver cómo se integran.

- La documentación suele ser excelente porque la base de usuarios aporta ejemplos.

- Los cambios importantes en las APIs de los modelos ocurren lentamente, con periodos de aviso público.

- Las comunidades de ComfyUI y Hugging Face Diffusers tienen bibliotecas profundas de flujos de trabajo prefabricados, adaptadores LoRA y checkpoints ajustados.

- Los artículos de investigación se publican con código abierto y reproducible.

Impulsado por el proveedor (APIs de pago):

- La estabilidad de la API se rige por SLAs comerciales; los cambios disruptivos son menos frecuentes pero ocurren.

- Los lanzamientos de nuevos modelos (ej. Kling 3.0 en febrero de 2026, tres días antes de Seedance 2.0) ocurren a una velocidad competitiva y a menudo sin previo aviso.

- Las mejoras del modelo se despliegan en el lado del servidor sin que el desarrollador deba hacer nada.

- La documentación técnica se mantiene profesionalmente.

La implicación práctica para los autores de skills en GitHub: si estás escribiendo una skill que necesita permanecer estable y con bajo mantenimiento, una API en la nube con contratos de endpoint estables es más fácil de mantener que una skill vinculada a una versión específica de un modelo de código abierto. Por el contrario, si tu skill está diseñada para dar a los desarrolladores acceso a los últimos modelos de investigación sin costes de API, el ecosistema de código abierto es donde ocurre ese trabajo.

-

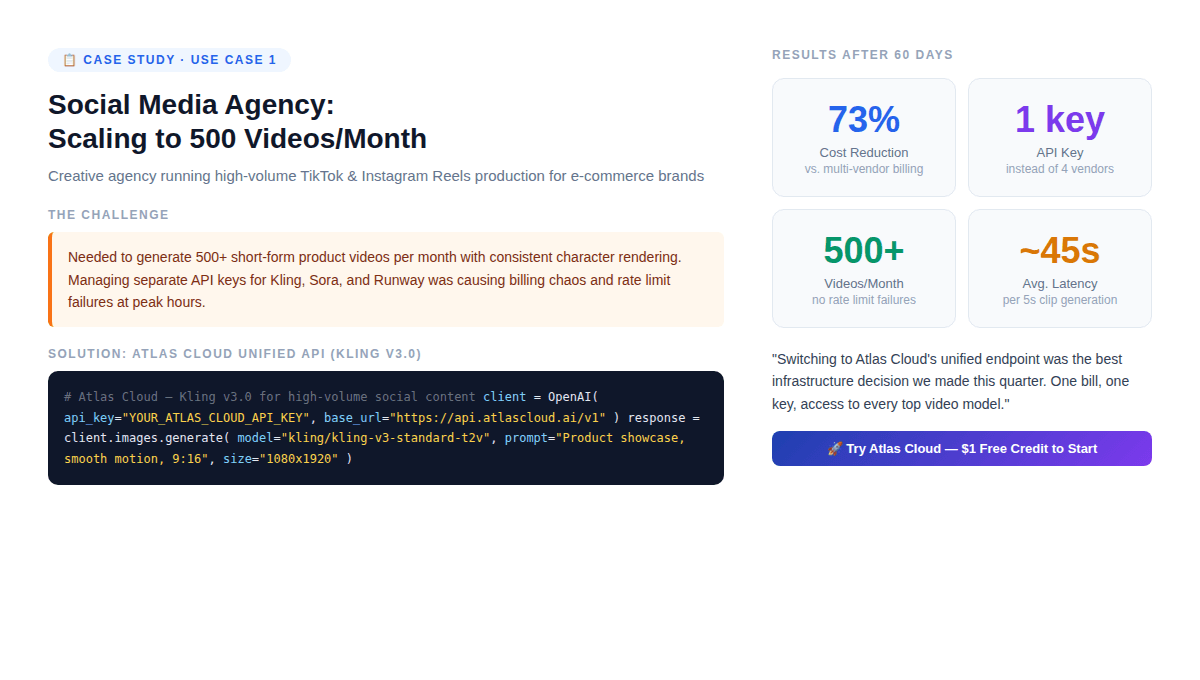

Caso de estudio: Agencia de redes sociales (500 vídeos/mes) {#case-study-1}

La configuración: Una tienda creativa que hace vídeos cortos de productos para 20 clientes de comercio electrónico. Necesitan 500 vídeos al mes, personajes que se vean igual en todos los clips, formato vertical 9:16, de 5 a 10 segundos cada uno, procesados por lotes fuera de horario.

Arquitectura inicial (antes de Atlas Cloud):

- Claves de API separadas para Kling, RunwayML y Pika.

- Tres paneles de facturación, tres grupos de límites de tasa.

- Selección manual de modelos por cliente.

- Fallos por límites de tasa en horas pico que causaban retrasos en la entrega.

Problema creado: Cuando Kling lanzó la v3.0, la agencia tuvo que volver a integrar un nuevo SDK, actualizar la facturación y probar la compatibilidad, tres veces para tres proveedores distintos.

Solución: Atlas Cloud API unificada con Kling v3.0 Standard

plaintext1# Atlas Cloud — Pipeline de vídeo para redes sociales 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10def generar_video_producto(product_prompt: str, style: str = "social") -> str: 11 response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt=f"{product_prompt}, movimiento fluido, iluminación cinematográfica, formato vertical 9:16", 14 size="1080x1920", 15 quality="standard", 16 n=1 17 ) 18 return response.data[0].url

Resultados tras 60 días:

- Reducción del 73% en el coste por vídeo (factura única, sin recargos por proveedor).

- Cero fallos de límite de tasa (la infraestructura elástica de Atlas Cloud absorbió las cargas máximas).

- El cambio de modelo de Kling a Seedance para clientes específicos tomó < 2 minutos (cambiar un parámetro).

- El bono del 20% en el primer depósito compensó efectivamente los costes de producción del primer mes.

El hallazgo no obvio: La agencia no redujo el número de proveedores porque Kling mejoró. Lo redujo porque gestionar múltiples relaciones con proveedores a 500 vídeos/mes tiene un coste operativo no trivial que no aparece en los precios por API.

-

Caso de estudio: Desarrollador independiente creando un SaaS de vídeo {#case-study-2}

La configuración: Desarrollador solista creando una herramienta de "texto a demostración de producto" para startups en etapa inicial. Necesita múltiples estilos: cinematográfico, animado, acción real. Debe validar rápido y mantener la infraestructura por debajo de 200 $/mes mientras averigua si alguien realmente quiere esto.

Decisión de arquitectura:

El desarrollador consideró inicialmente autohospedar Wan 2.2 en una instancia A100 alquilada (~2 $/hora). Con 100 vídeos de prueba durante la validación, el coste estimado era de ~6 $ en tiempo de GPU. Parecía más barato que Atlas Cloud.

Lo que el cálculo no tuvo en cuenta:

- Configurar el pipeline de Wan 2.2 tomó 3 días (dependencias CUDA, gestión de VRAM, configuración del servidor).

- La brecha de calidad de salida de Wan 2.2 frente a Kling v3 significaba que el SaaS no podía cobrar el precio previsto.

- La gestión del tiempo de actividad del servidor añadió ~2 horas/semana de mantenimiento continuo.

Arquitectura revisada con Atlas Cloud:

plaintext1# Enrutamiento flexible de modelos — cambiar según el nivel del usuario 2MODEL_MAP = { 3 "free": "kling/kling-v3-standard-t2v", # Menor coste 4 "pro": "kling/kling-v3-professional-t2v", # Mayor calidad 5 "enterprise": "bytedance/seedance-2.0" # Control máximo 6} 7 8def generar_video_demo(prompt: str, user_tier: str) -> str: 9 client = OpenAI( 10 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 11 base_url="https://api.atlascloud.ai/v1" 12 ) 13 response = client.images.generate( 14 model=MODEL_MAP[user_tier], 15 prompt=prompt, 16 n=1 17 ) 18 return response.data[0].url

Resultado: El desarrollador lanzó en 4 días en lugar de 3 semanas. El uso de Seedance 2.0 en el nivel premium justificó un precio 3 veces superior al del nivel gratuito, y la estructura de modelos escalonada se creó con una única clave de Atlas Cloud, no con tres integraciones de proveedores separadas.

-

La ventaja de Atlas Cloud: Por qué "Una API" es la arquitectura correcta {#atlas-cloud-advantage}

Atlas Cloud se posiciona como la primera plataforma de inferencia de IA multimodal completa del mundo: una API unificada que sirve más de 300 modelos en generación de texto, imagen, vídeo y audio.

Para los autores de Skills de Generadores de Vídeo con IA para GitHub, las ventajas específicas son:

-

API compatible con OpenAI (Reemplazo directo)

Atlas Cloud utiliza un endpoint compatible con OpenAI. Si tu skill ya se integra con el SDK de OpenAI, cambiar a Atlas Cloud para la generación de vídeo requiere cambiar dos líneas: la

1api_key1base_url-

Facturación única para flujos de trabajo multimodelo

Los flujos de trabajo de vídeo de producción rara vez utilizan un solo modelo. Un pipeline típico podría usar:

- Seedream 5.0 para generación de imágenes (fotogramas iniciales).

- Kling v3.0 para conversión de imagen a vídeo.

- Un LLM (Claude, GPT-4 o DeepSeek) para la optimización de prompts.

- Un modelo TTS para narración de voz.

Con cuentas de proveedor separadas, esto son cuatro relaciones de facturación, cuatro grupos de límites de tasa y cuatro puntos de integración. Con Atlas Cloud, es una clave de API y una factura.

-

Transparencia de precios a nivel de modelo

Atlas Cloud publica precios por modelo sin costes ocultos de computación. El modelo de negocio es sencillo: paga por lo que generas. Los nuevos desarrolladores reciben un bono del 20% en su primer depósito (hasta 100 $) y un programa de referidos proporciona créditos adicionales. Verifica siempre los precios actuales en atlascloud.ai/pricing antes de realizar proyecciones financieras.

-

Cobertura de cumplimiento

Para skills de GitHub empresariales desplegadas en entornos regulados: Atlas Cloud cuenta con certificación SOC I & II y cumple con HIPAA, con infraestructura en las regiones de EE. UU., UE y Asia. Esto cubre la mayoría de los requisitos de residencia de datos empresariales.

-

Integración con ComfyUI, n8n y servidor MCP

Atlas Cloud se integra de forma nativa con las herramientas más utilizadas para crear skills de generación de vídeo para GitHub:

- ComfyUI: nodos personalizados para la creación de flujos de trabajo visuales.

- n8n: automatización de flujos de trabajo con pasos de generación de vídeo de Atlas Cloud.

- Servidor MCP: integración con el Protocolo de Contexto de Modelos para frameworks de agentes de IA.

-

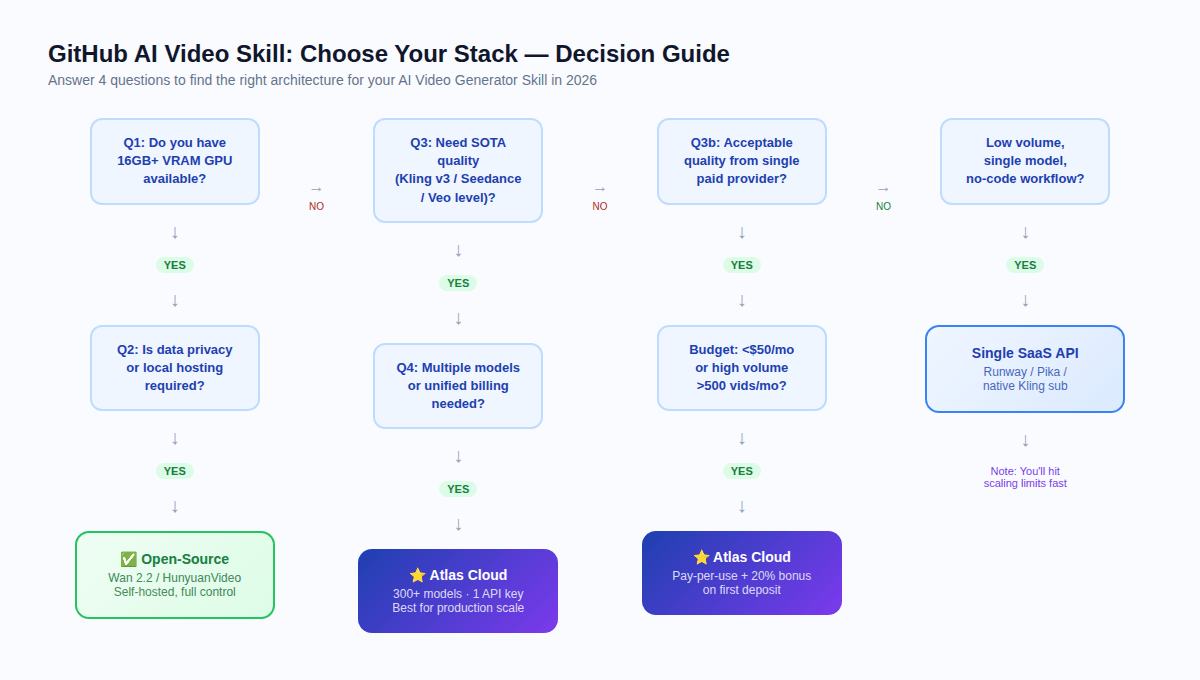

¿Qué stack deberías usar realmente? {#decision-guide}

Responde a estas cuatro preguntas:

P1: ¿Tienes disponible una GPU con 16GB+ de VRAM?

Si la respuesta es no, olvida por completo el autohospedaje. La API de nube es tu único camino práctico.

P2: ¿La privacidad de los datos o el alojamiento local son requisitos por regulación?

Si sí + tienes GPU disponible → evalúa código abierto (Wan 2.2 o HunyuanVideo dependiendo de la VRAM).

Si sí + no tienes GPU → usa Atlas Cloud (cumple con HIPAA, certificado SOC) y revisa tus requisitos regulatorios específicos.

P3: ¿Necesitas calidad SOTA (nivel Kling v3, Seedance 2.0, Veo)?

Si sí → API de nube obligatoria. Los modelos de código abierto tienen una brecha de calidad significativa frente a los mejores modelos propietarios en 2026.

Si la calidad aceptable a nivel de código abierto es suficiente → el autohospedaje de Wan 2.2 puede funcionar.

P4: ¿Necesitas múltiples modelos o facturación unificada?

Si sí → Atlas Cloud. Gestionar tres cuentas de proveedor a escala tiene un coste operativo oculto que solo se hace visible en volumen de producción.

Recomendaciones resumidas por caso de uso

| Caso de uso | Stack recomendado |

| Investigación / prototipado | Código abierto (Wan 2.2, CogVideoX) |

| Agencia de redes sociales, 500+/mes | Atlas Cloud + Kling v3.0 |

| Vídeo musical / animación de personajes | Atlas Cloud + Seedance 2.0 |

| VFX / simulación física | Atlas Cloud + Sora 2 |

| Soberanía de datos / sin conexión | Autohospedado (HunyuanVideo, Open-Sora 2.0) |

| SaaS con calidad de modelo escalonada | Atlas Cloud (una clave, múltiples modelos) |

| Lotes de código abierto de alto volumen | Wan 2.2 autohospedado (umbral de 10.000+/mes) |

-

Preguntas frecuentes {#faq}

P: ¿Qué es una Skill de Generador de Vídeo con IA?

Un módulo de código reutilizable o capa de integración que conecta una aplicación con un backend de generación de vídeo por IA, ya sea mediante pesos de código abierto o una API en la nube. Formas comunes: clase Python, nodo ComfyUI, flujo de trabajo n8n, herramienta de servidor MCP.

P: ¿Cuál es la VRAM mínima para autohospedar un modelo de vídeo de código abierto?

8GB de VRAM para Wan 2.2 1.3B (calidad aceptable para clips cortos). 16GB para CogVideoX-1.5 o Open-Sora (mejor calidad). 24GB+ para Wan 2.2 14B. 60–80GB para el modelo completo de HunyuanVideo o Open-Sora 2.0.

P: ¿Es realmente gratuita la generación de vídeo por IA de código abierto?

Los pesos del modelo son gratuitos. La inferencia no es gratuita: requiere computación de GPU. A bajo volumen (<5.000 vídeos/mes), las APIs de nube como Atlas Cloud suelen ser más baratas cuando se calcula el coste total de propiedad.

P: ¿Puedo usar Atlas Cloud para flujos de trabajo de imagen a vídeo (i2v)?

Sí. Atlas Cloud admite variantes i2v para Kling, Seedance y Vidu. Nota: para modelos i2v, algunas variantes no aceptan un parámetro de relación de aspecto separado; la resolución de salida sigue las dimensiones de la imagen de entrada.

P: ¿Cómo gestiona Atlas Cloud la limitación de tasa?

Atlas Cloud admite patrones asíncronos con Webhooks. Los trabajos de generación de vídeo se envían como tareas; tu aplicación recibe un ID de tarea y se le notifica cuando el renderizado se completa. Esto evita bloqueos a escala.

P: ¿Cuál es el mejor modelo para la consistencia de personajes entre tomas?

El sistema de Referencia Universal de Seedance 2.0 es la solución más avanzada en 2026. Te permite introducir vídeos, imágenes y audio de referencia para mantener una apariencia y movimiento de personaje consistentes a lo largo de los clips generados.

P: ¿Atlas Cloud admite ComfyUI?

Sí. Atlas Cloud tiene integración nativa con ComfyUI, además de nodos n8n y compatibilidad con servidor MCP.

P: ¿Cómo manejan las relaciones de aspecto los modelos de vídeo de código abierto?

Varía según el modelo. Open-Sora admite 16:9, 9:16, 1:1 y 2.39:1 mediante el flag

1--aspect_ratioResumen

El panorama de 2026 se divide en dos campos, cada uno con su punto ideal:

Código abierto: tiene sentido si tienes GPUs de sobra, produces más de 10.000 vídeos al mes, los datos no pueden salir de tus servidores o necesitas realizar ajustes finos sobre tu propio metraje propietario.

APIs de pago: son la mejor opción si necesitas la mejor calidad disponible, la velocidad importa más que el coste, produces menos de 5.000 vídeos al mes o quieres combinar múltiples modelos sin lidiar con contratos de proveedores.

Atlas Cloud es el puente entre ambos: como plataforma unificada que proporciona acceso a más de 300 modelos (incluyendo los mejores modelos de código abierto mediante inferencia alojada y cada modelo propietario importante) a través de una única clave de API compatible con OpenAI. Para la mayoría de los desarrolladores que construyen Skills de Generador de Vídeo con IA para GitHub en 2026, es el camino de menor fricción desde el prototipo hasta la producción.

La información de precios en este artículo es indicativa y está sujeta a cambios. Verifica siempre las tarifas actuales en atlascloud.ai/pricing antes de realizar proyecciones financieras. La disponibilidad del modelo puede variar según la región.

Atlas Cloud: atlascloud.ai — Certificado SOC I & II · Cumple con HIPAA · Infraestructura en EE. UU. · UE · Asia