A principios de abril, un modelo llamado "HappyHorse-1.0" apareció repentinamente. Encabezó cuatro categorías en la tabla de clasificación de video de Artificial Analysis, superando contundentemente a Seedance 2.0 y a Kling por un amplio margen.

No hubo comunicados de prensa, ni publicaciones en blogs, y el nombre de la empresa estaba oculto. La página del modelo simplemente decía "próximamente".

El 10 de abril, la división ATH de Alibaba reconoció el proyecto. HappyHorse es un proyecto interno de I+D de la unidad de innovación de ATH y actualmente se encuentra en fase beta privada. La API se lanzará el 30 de abril.

Además, HappyHorse-1.0 está configurado para ser de código abierto en su totalidad. Se promociona como el primer modelo de video de código abierto en generar audio y video de forma nativa y simultánea.

Este "lanzamiento silencioso" seguido de un "anuncio espectacular" se está convirtiendo en una tendencia entre las empresas de IA chinas. Xiaomi hizo esto con un nombre en clave "Hunter Alpha", y Zhipu utilizó "Pony Alpha" para su nuevo modelo GLM.

En este artículo, desentrañamos los hechos conocidos sobre HappyHorse y lo que significa.

Posición de HappyHorse en la tabla de clasificación

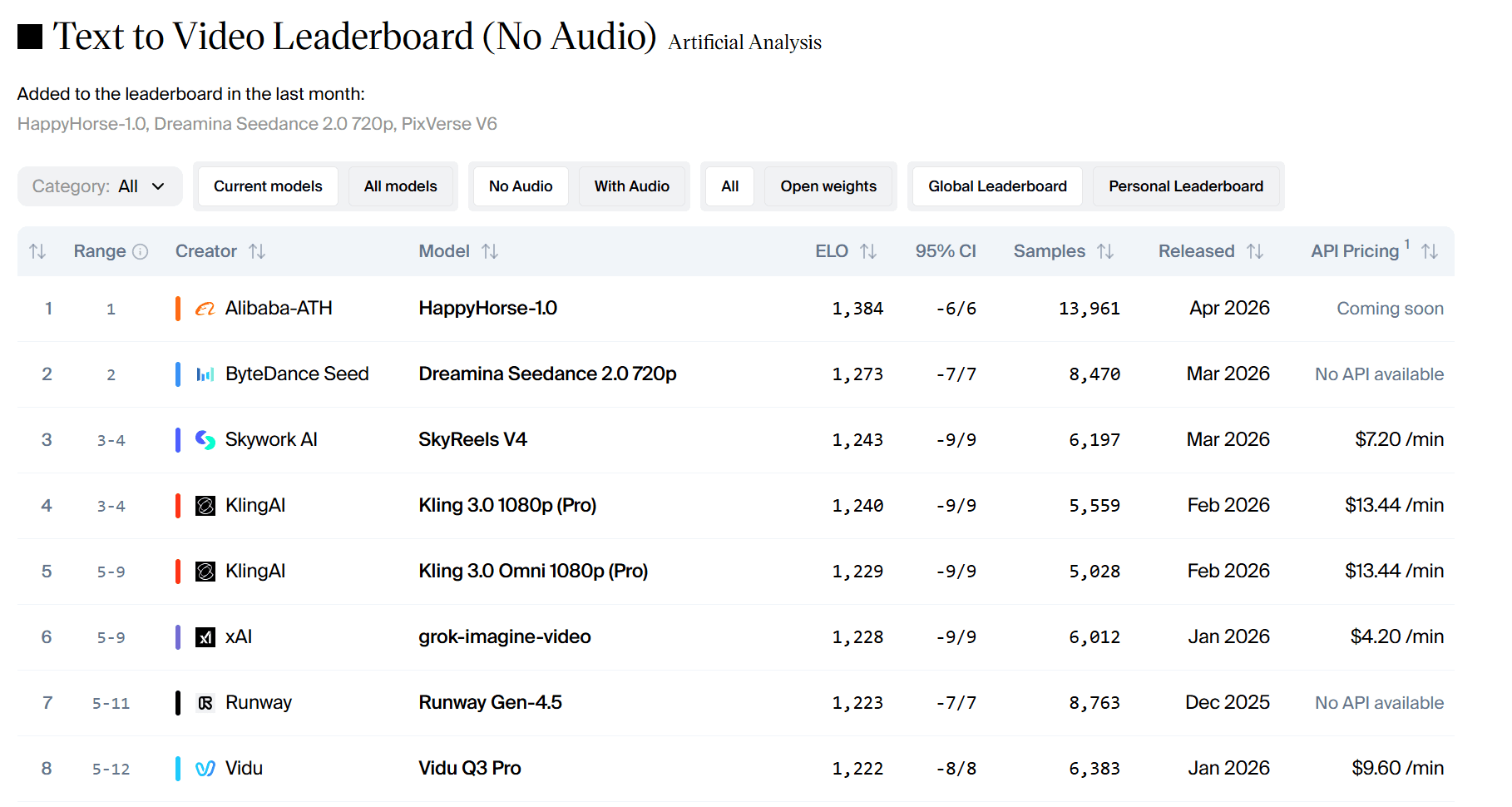

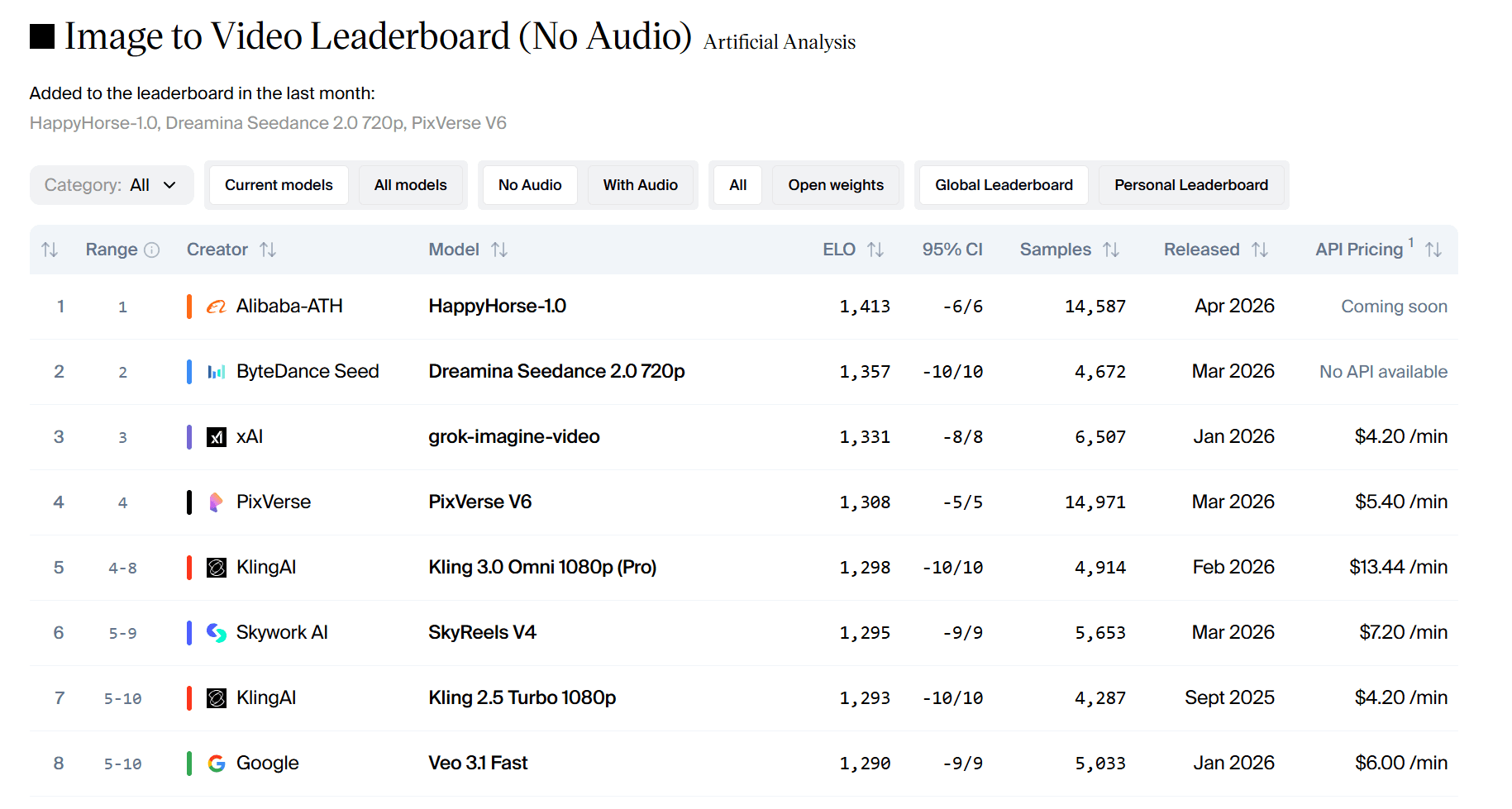

Artificial Analysis opera cuatro tablas de clasificación: Texto a video sin audio, Imagen a video sin audio, Texto a video con audio e Imagen a video con audio.

Los datos al mediodía del 13 de abril son los siguientes:

- Texto a video (sin audio): 1384 Elo. Está 111 puntos por delante de Seedance 2.0.

- Imagen a video (sin audio): 1413 Elo. Esta es la puntuación más alta registrada en la plataforma.

En las puntuaciones Elo, una diferencia de más de 60 puntos indica una preferencia clara. Una diferencia de 111 puntos indica que los usuarios eligieron abrumadoramente a HappyHorse en pruebas a ciegas.

Sin embargo, la situación cambia cuando se incluye el audio. La diferencia se reduce a apenas 1-2 puntos, lo que equivale efectivamente a un empate. Esto demuestra que la sincronización audiovisual y la calidad del sonido de HappyHorse no son drásticamente superiores. En este sentido, está aproximadamente a la par con Seedance.

Comparación entre HappyHorse y Seedance 2.0

| Elemento | HappyHorse-1.0 | Seedance 2.0 |

| Naturaleza del modelo | Código abierto | Sistema comercial cerrado |

| Arquitectura | Transformer unificado | Transformer de difusión bidireccional (DB-DiT) |

| Capacidad multimodal | Generación simultánea de audio/video (One-pass) | Entrada multimodal (Texto, Imagen, Video, Audio) |

| Modo de generación de video | Generación de una sola pasada (One-pass) | Generación basada en canalización |

| Duración de generación de video | Aprox. 5–10 segundos (1080p) | Hasta aprox. 60 segundos (2K) |

Los dos representan filosofías diferentes.

HappyHorse‑1.0: Código abierto. Transformer unificado. Generación simultánea de audio/video. Procesamiento de una sola pasada. Soporte nativo de sincronización labial para 7 idiomas. 15 mil millones de parámetros. Tarda 38 segundos en generar un video de 5 segundos a 1080p en un entorno H100.

Seedance 2.0: Sistema comercial cerrado. Transformer de difusión bidireccional (DB‑DiT). Entrada multimodal. Capaz de generar videos 2K de 60 segundos. Soporta sincronización labial para más de 8 idiomas.

Respecto a la calidad visual pura, HappyHorse es claramente el preferido en las pruebas a ciegas. Respecto a la sincronización audiovisual y la calidad del sonido, ambos son aproximadamente iguales. Respecto a la facilidad de uso, Seedance ya ofrece una API madura a través de servicios como Volcano Engine. La API de HappyHorse está programada para su lanzamiento el 30 de abril, y el rendimiento en la versión beta privada aún se está verificando.

Comparación de ejemplos de generación entre HappyHorse-1.0 y Dreamina Seedance 2.0 (Texto a video con audio) por Artificial Analysis:

Prompt: Una animación corta al estilo Pixar sobre un pequeño cono de tráfico tímido que sueña con ser el cono en la línea de meta de una gran carrera. Los otros conos se ríen de su ambición. Un trabajador de la construcción lo coloca accidentalmente en la línea de meta de un maratón. A medida que pasan los corredores, la expresión pintada del cono cambia del miedo a la alegría. Confeti cae desde arriba. Los otros conos lo ven por televisión y se inspiran. Audio: Desde el ruido del tráfico hasta vítores de la multitud, y luego música inspiradora.

Acerca de la arquitectura

HappyHorse adopta un enfoque inusual.

Tiene 15 mil millones de parámetros y utiliza un Transformer de autoatención unificado de 40 capas. Los tokens de texto, video y audio se alimentan en la misma secuencia y se modelan conjuntamente. Esto es significativamente diferente de la canalización común de "generar el video primero y luego añadir el audio". Aquí, el sonido y la escena existen en el mismo espacio semántico desde el principio.

Este modelo utiliza destilación DMD-2 y optimización de gráfico completo a través de MagiCompiler. En una sola GPU H100, tarda unos 38 segundos en generar un video de 5 segundos a 1080p.

Admite sincronización labial nativa para 7 idiomas: inglés, mandarín, cantonés, japonés, coreano, alemán y francés. Su tasa de error de palabras (WER) es una de las más bajas entre cualquier modelo de código abierto.

Los participantes en la prueba a ciegas de Artificial Analysis afirman que HappyHorse destaca particularmente en la representación de personajes. La textura de la piel y la suavidad del movimiento son superiores. El hecho de que más del 60% de las muestras de prueba fueran retratos o clips de personas hablando fue un factor que impulsó a este modelo a la cima.

Sin embargo, hay críticas. Los videos filtrados han señalado ondulaciones antinaturales, artefactos de rayas en sujetos que se mueven rápidamente y degradación de la calidad de imagen en pantallas grandes.

Código abierto y plan de acceso

El 9 de abril, HappyHorse‑1.0 anunció que sería de código abierto en su totalidad. El repositorio de GitHub está activo, los pesos son completamente abiertos y no existen restricciones comerciales.

El sitio web oficial ofrece demostraciones en línea para texto a video e imagen a video. Según Alibaba ATH, está previsto que la API se publique al público el 30 de abril.

Sin embargo, una advertencia: según el equipo oficial, la mayoría de los "sitios web oficiales" que circulan en línea son falsos. El real aún no está completamente operativo.

Impacto en el mercado y significado

HappyHorse apareció dos semanas después de que OpenAI detuviera el desarrollo de Sora. Su movimiento fue visto como un signo de estancamiento en el campo del video con IA, pero un modelo chino ha tomado el relevo.

El mercado reaccionó rápidamente. El precio de las acciones de Alibaba subió más de un 7% tras la confirmación y siguió aumentando. Al cierre de las operaciones el 10 de abril, subió más de un 3% hasta los 126,6 HK$.

A nivel estratégico, HappyHorse demuestra que ATH posee un segundo equipo capaz de construir modelos multimodales de primer nivel. Este equipo tiene experiencia empresarial y comprende las necesidades de los usuarios y los escenarios comerciales. Esto creó una estructura de motor dual: Tongyi Lab (centrado en la investigación básica) y la Unidad de Innovación (que construye aplicaciones a partir de desafíos comerciales reales).

Veamos la cronología. Lin Junyang renunció a principios de marzo y ATH se estableció el 16 de marzo. El 2 de abril, Qwen 3.6 Plus ocupó el primer lugar en el volumen de llamadas global de OpenRouter, y el 8 de abril, HappyHorse encabezó la lista de Artificial Analysis. En solo un mes, Alibaba produjo resultados potentes tanto en modelos de lenguaje como de video.

Antecedentes del equipo: Zhang Di y Alibaba ATH

Detrás de HappyHorse se encuentra el peso pesado Zhang Di.

Originalmente fue vicepresidente en Kuaishou y se desempeñó como líder técnico de Kling AI. Es conocido como el "padre de Kling". Dejó Kuaishou en noviembre de 2025 y asumió el cargo de director del "Future Life Lab" de Alibaba, reportando directamente al científico jefe Zheng Bo.

Cinco meses después, su equipo construyó HappyHorse‑1.0 y superó a Kling y Seedance 2.0 de ByteDance.

Este equipo formaba parte inicialmente del Future Life Lab de Taobao, pero fue trasladado a la Unidad de Innovación de IA del grupo empresarial ATH tras la última reorganización de Alibaba.

ATH significa "Alibaba Token Hub", establecido por el CEO Wu Yongming el 16 de marzo, quien lo dirige personalmente. Su misión es la "creación, provisión y aplicación de tokens", e integra a Tongyi Lab, la línea de negocio MaaS, el departamento Qianwen, el departamento Wukong y la Unidad de Innovación de IA.

Preguntas frecuentes

¿Qué tipo de GPU se requiere para ejecutar HappyHorse localmente?

Este modelo tiene 15 mil millones de parámetros y no es pequeño en absoluto. En un entorno H100 único, tarda unos 38 segundos en generar un video de 5 segundos a 1080p. Las GPU de consumo como la RTX 4090 (24 GB de VRAM) requerirán cuantización o descarga. Es probable que exceda los 24 GB para la inferencia FP16. Algunos usuarios han informado de éxito con cuantización de 4 bits, pero la calidad se reduce. Para un uso serio, se recomienda una GPU en la nube con más de 40 GB de VRAM. Alternativamente, es prudente esperar al lanzamiento de la API el 30 de abril.

¿Puedo ajustar (fine-tune) HappyHorse con mis propios datos?

Sí, bajo la licencia. No hay restricciones de uso comercial. Sin embargo, ajustar un modelo de video de 15 mil millones de parámetros no es fácil. Requiere un clúster H100 o A100, un gran conjunto de datos de pares de video-audio y recursos de ingeniería significativos. El repositorio de GitHub actualmente no contiene scripts de ajuste y solo admite inferencia. El equipo ha insinuado que lanzará código de entrenamiento en el futuro, pero no se ha fijado ninguna fecha.

¿Hay grupos de comunidad en Discord o WeChat?

Los hay, pero no son oficiales. Varias comunidades de IA han iniciado hilos en Discord y WeChat. El equipo oficial aún no ha abierto canales comunitarios formales. Si se une a un grupo, tenga cuidado con los enlaces falsos y las estafas de phishing. Lo mejor es consultar el repositorio de GitHub y los anuncios oficiales de Alibaba ATH para obtener la información más reciente.

¿Está este modelo disponible en Hugging Face?

No al momento de escribir este artículo. El equipo ha declarado que está trabajando en un lanzamiento en Hugging Face, pero aún no está completo. Actualmente, los pesos solo están en GitHub. Los miembros de la comunidad han comenzado a cargar puntos de control convertidos a Hugging Face, pero no son oficiales. Para estar seguro, utilice la fuente de GitHub hasta que aparezca la página oficial de Hugging Face.