Wan 2.7 de Alibaba aporta la primera cadena de pensamiento integrada a la generación de imágenes por IA, ofreciendo composiciones más precisas, renderizado de texto legible y resultados en 4K para flujos de trabajo creativos profesionales.

¿Qué es Wan 2.7?

Wan 2.7 es el modelo de IA más reciente de Alibaba para la generación de imágenes y video, construido dentro del ecosistema Qwen. Admite cuatro funciones clave: texto a imagen, edición de imágenes, texto a video e imagen a video, todas accesibles a través de una API unificada.

Alibaba diseñó Wan 2.7 para redefinir la creación y edición de imágenes por IA, ayudando a los creadores a realizar imágenes nítidas y personalizadas con precisión profesional. A diferencia de las versiones anteriores de Wan que se centraban principalmente en la calidad de imagen y la resolución, Wan 2.7 utiliza una arquitectura mejorada para entender e interpretar mejor las instrucciones del usuario, en lugar de solo renderizar píxeles.

Por qué es importante: La mayoría de los modelos de texto a imagen procesan las instrucciones en una sola pasada: son rápidos, pero propensos a errores espaciales y texto ilegible. La capa de razonamiento de Wan 2.7 es la primera de su tipo en un modelo de generación de imágenes disponible comercialmente, abordando los modos de fallo más persistentes en el contenido visual generado por IA.

Wan 2.7 es accesible a través de Atlas Cloud, sin necesidad de infraestructura local. Esto significa que los equipos de todos los tamaños pueden usarlo fácilmente, sin la molestia de configurar GPU o gestionar el modelo ellos mismos.

Wan 2.7 frente a modelos competidores de generación de imágenes por IA

| Característica | Wan 2.7 | Midjourney V7 | FLUX.1 | Seedream |

|---|---|---|---|---|

| Razonamiento / modo de pensamiento integrado | ✓ | — | — | — |

| Calidad de renderizado de texto | Excelente | Limitada | Buena | Moderada |

| Resolución máxima de salida | 4K (Pro) | 4K | 4K | 2K |

| Acceso a API | ✓ REST total | ✗ Cerrado | ✓ | ✓ |

| Soporte de múltiples referencias (hasta 9) | ✓ | — | Parcial | — |

| Edición basada en instrucciones | ✓ | Limitada | ✓ | ✓ |

| Renderizado de texto en 12 idiomas | ✓ | — | — | — |

| Generación de video integrada | ✓ | — | — | — |

| Control de semilla | ✓ | ✓ | ✓ | ✓ |

Midjourney sigue liderando en calidad estética artística; su distintivo estilo visual sigue siendo un punto de referencia para los flujos de trabajo enfocados en la creatividad. Sin embargo, su falta de acceso a API limita la integración en los procesos de producción. FLUX funciona bien en instrucciones directas con tiempos de generación rápidos, pero el modo de razonamiento de Wan 2.7 le da una clara ventaja en escenas complejas de múltiples elementos donde la generación de una sola pasada pierde coherencia espacial. Para los equipos que necesitan un seguimiento de instrucciones fiable, un renderizado de texto preciso, accesibilidad a API y soporte de múltiples referencias dentro de un solo modelo, Wan 2.7 representa la mejor opción actual disponible a través de Atlas Cloud.

Características principales de Wan 2.7 texto a imagen

1. Modo de pensamiento (Chain-of-Thought)

El avance técnico más significativo en Wan 2.7 es su capa de razonamiento integrada. A diferencia de los modelos tradicionales de texto a imagen que generan imágenes directamente a partir de una instrucción (a menudo resultando en una composición pobre, elementos faltantes o detalles defectuosos), el Modo de pensamiento de Wan 2.7 permite que el modelo analice la instrucción, planifique la composición, determine la ubicación del sujeto y la dirección de la luz, verifique que la lógica de composición sea sólida y luego genere la imagen final.

Este mecanismo de "pensar antes de dibujar" produce resultados considerablemente mejores en instrucciones complejas: relaciones espaciales más coherentes, un posicionamiento del sujeto más preciso y menos artefactos visuales en la primera generación. Para los equipos que realizan trabajo creativo iterativo, el beneficio práctico es menos ciclos de regeneración para llegar a un resultado utilizable.

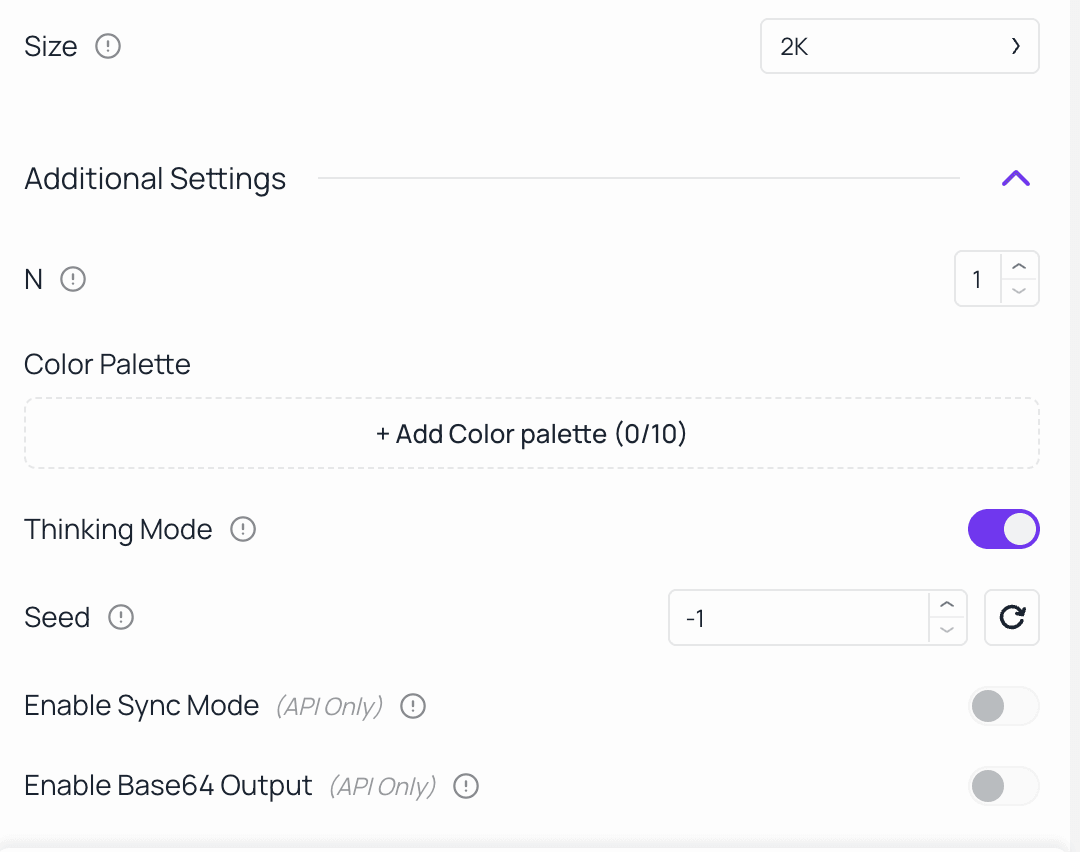

El Modo de pensamiento está habilitado por defecto y se puede activar o desactivar según el equilibrio entre velocidad y calidad requerido para una tarea determinada.

2. Renderizado de texto superior en imágenes generadas por IA

El renderizado de texto ha sido históricamente una de las áreas más débiles en las herramientas de generación de imágenes por IA. Wan 2.7 aborda esto a través de un marco de aprendizaje de contexto largo.

Wan 2.7 maneja entradas de texto de hasta 3,000 tokens y ofrece un gran avance en el renderizado de texto, admitiendo 12 idiomas como chino, inglés, japonés y otros idiomas globales principales.

En el uso real, esto significa que las imágenes generadas tienen texto claro y preciso, ya sean letreros, etiquetas de productos, titulares de pósteres o detalles tipográficos. A diferencia de la mayoría de los modelos de la competencia, no produce caracteres distorsionados o ilegibles. Para los equipos de marketing, diseñadores de productos y creadores de contenido que operan en mercados multilingües, esto ofrece una ventaja práctica importante.

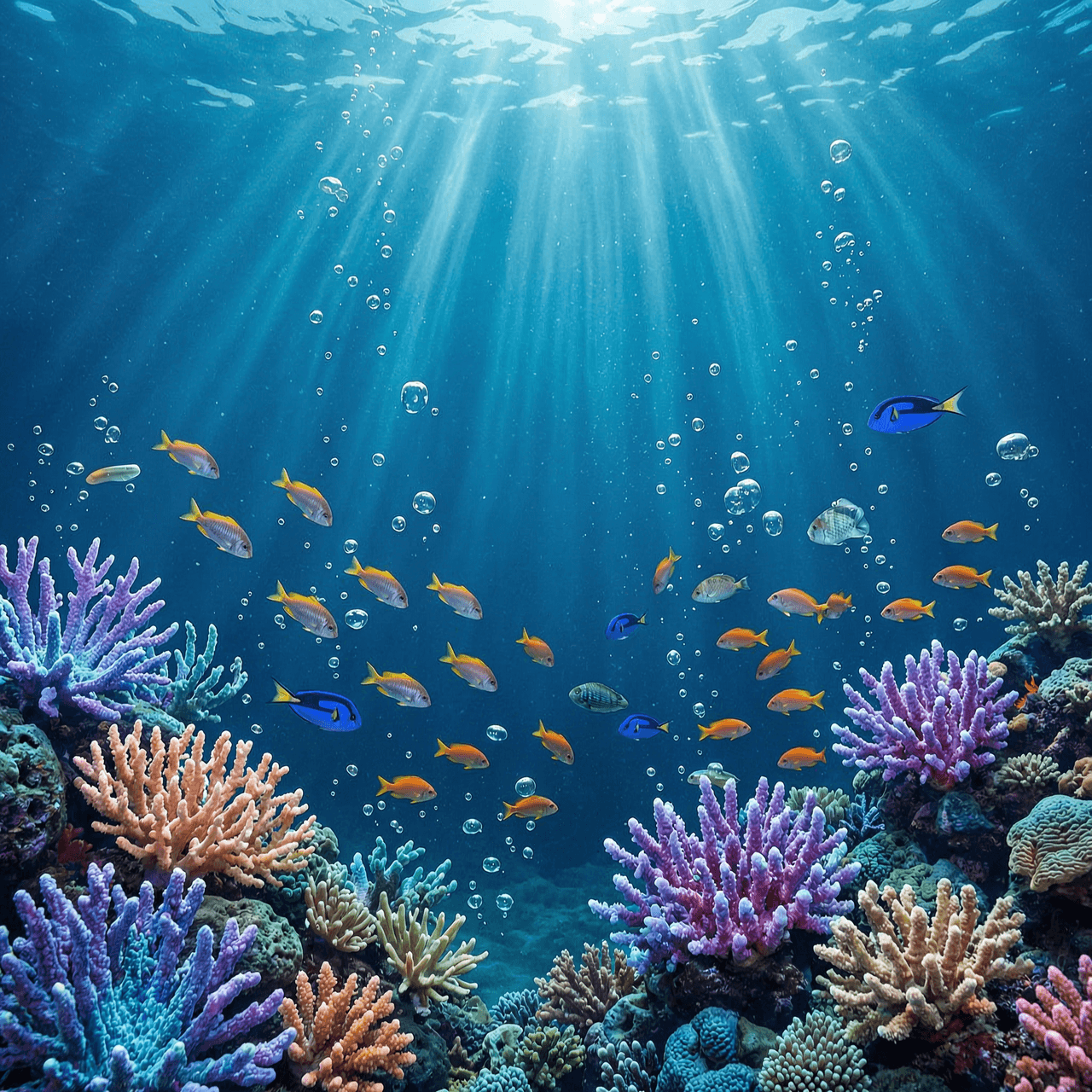

3. Capacidades de salida de alta resolución

Wan 2.7 Texto a Imagen admite tamaños de salida flexibles en tres niveles:

- Resolución estándar: optimizada para una iteración rápida y trabajo creativo diario

- Resolución 2K (hasta 2048×2048 píxeles): nuestra opción predeterminada recomendada para la mayoría de los flujos de trabajo profesionales

- Resolución 4K (hasta 4096×4096 píxeles, nivel Pro): ideal para materiales listos para impresión y necesidades de pantallas de gran formato

Wan 2.7-Image-Pro ofrece una composición de imagen más estable, una comprensión más nítida y precisa de las instrucciones, y una salida 4K de alta definición. Para el contenido digital, la salida 2K proporciona una gran calidad de imagen con tiempos de generación más rápidos. El nivel 4K Pro está mejor reservado para activos finales, imágenes de campaña y trabajos de producción de impresión.

4. Soporte de múltiples imágenes de referencia

Wan 2.7 permite cargar hasta nueve imágenes de referencia dentro de una sola solicitud de generación o edición. Estas imágenes de referencia pueden dirigir el estilo general, definir el sujeto principal y dar forma al fondo de sus ediciones, abriendo posibilidades como la transferencia de estilo, el intercambio de elementos entre diferentes imágenes y la combinación de múltiples referencias en una pieza final coherente.

Poder usar hasta nueve imágenes de referencia distingue a Wan 2.7 de la mayoría de las plataformas de la competencia. Es especialmente útil para equipos de marca que necesitan imágenes coherentes en todas sus bibliotecas de activos, o agencias que crean regularmente múltiples versiones de campañas a partir de un único brief visual.

5. Control de semilla y generación repetible

Para los equipos que trabajan dentro de pautas de marca definidas o que producen grandes volúmenes de contenido relacionado, Wan 2.7 incluye control de generación basado en semillas. Bloquear un valor de semilla produce resultados idénticos a partir de la misma instrucción, lo que permite realizar pruebas creativas repetibles y mantener una identidad visual coherente en todas las campañas. Variar la semilla mientras se mantiene la instrucción constante genera diversas alternativas creativas a partir de la misma dirección creativa.

6. Edición de imágenes basada en instrucciones

Más allá de la generación, Wan 2.7 incluye un punto final de edición de imágenes dedicado impulsado por la misma capa de razonamiento. El modelo de edición entiende qué debe cambiar y qué no; por ejemplo, cambiar el fondo de un retrato a una puesta de sol en la playa mientras se preserva la cara, la pose y la ropa con una precisión de nivel de píxel. Esta comprensión semántica de la intención de edición separa la capacidad de edición de Wan 2.7 de las herramientas tradicionales de inpainting basadas en máscaras.

7. Características exclusivas de Wan2.7‑Image: personajes diversos, colores precisos y tipografía profesional

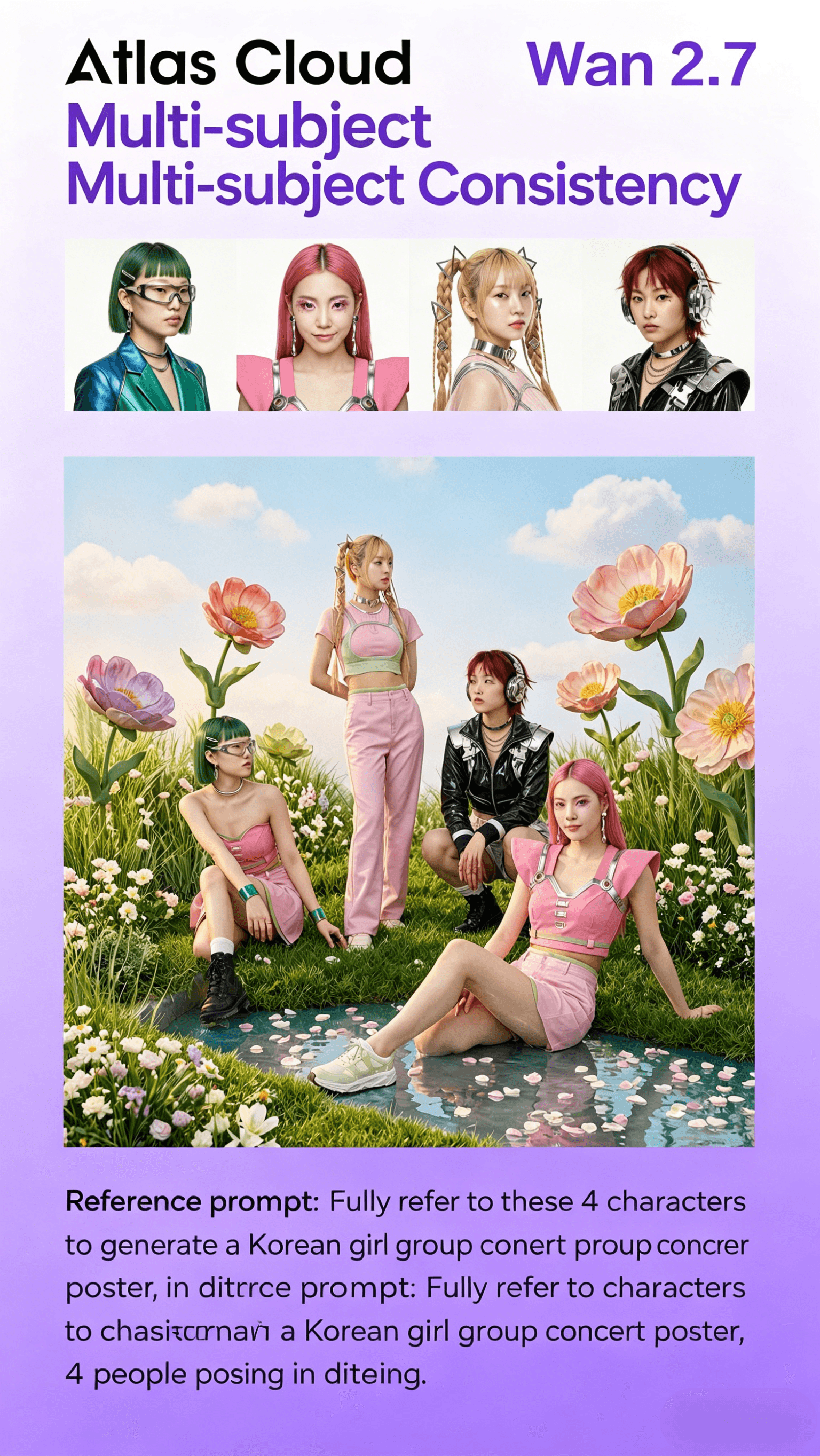

Wan 2.7‑Image destaca en la resolución de problemas de la industria, permitiendo a los usuarios crear un grupo de chicas con "mil caras", y controlar con precisión los detalles faciales y los colores a través de las instrucciones. Sus actualizaciones clave incluyen:

1⃣ Miles de rostros: personalización de personajes virtuales

Wan2.7‑Image ha mejorado la función de deformación de imagen virtual para despedirse de la "cara de IA" estereotipada. Admite una personalización completa desde la estructura ósea, los ojos hasta las facciones faciales, como cambiar la forma de la cara (cara ovalada, cara redonda, cara cuadrada, cara rectangular, etc.) y las características de los ojos (ojos de almendra, cuencas profundas, ojos redondos, ojos de fénix, etc.) en las instrucciones, logrando "miles de rostros para miles de personas". Esto es particularmente útil para crear grupos de chicas diversos, ídolos virtuales o activos de personajes personalizados sin características faciales repetitivas.

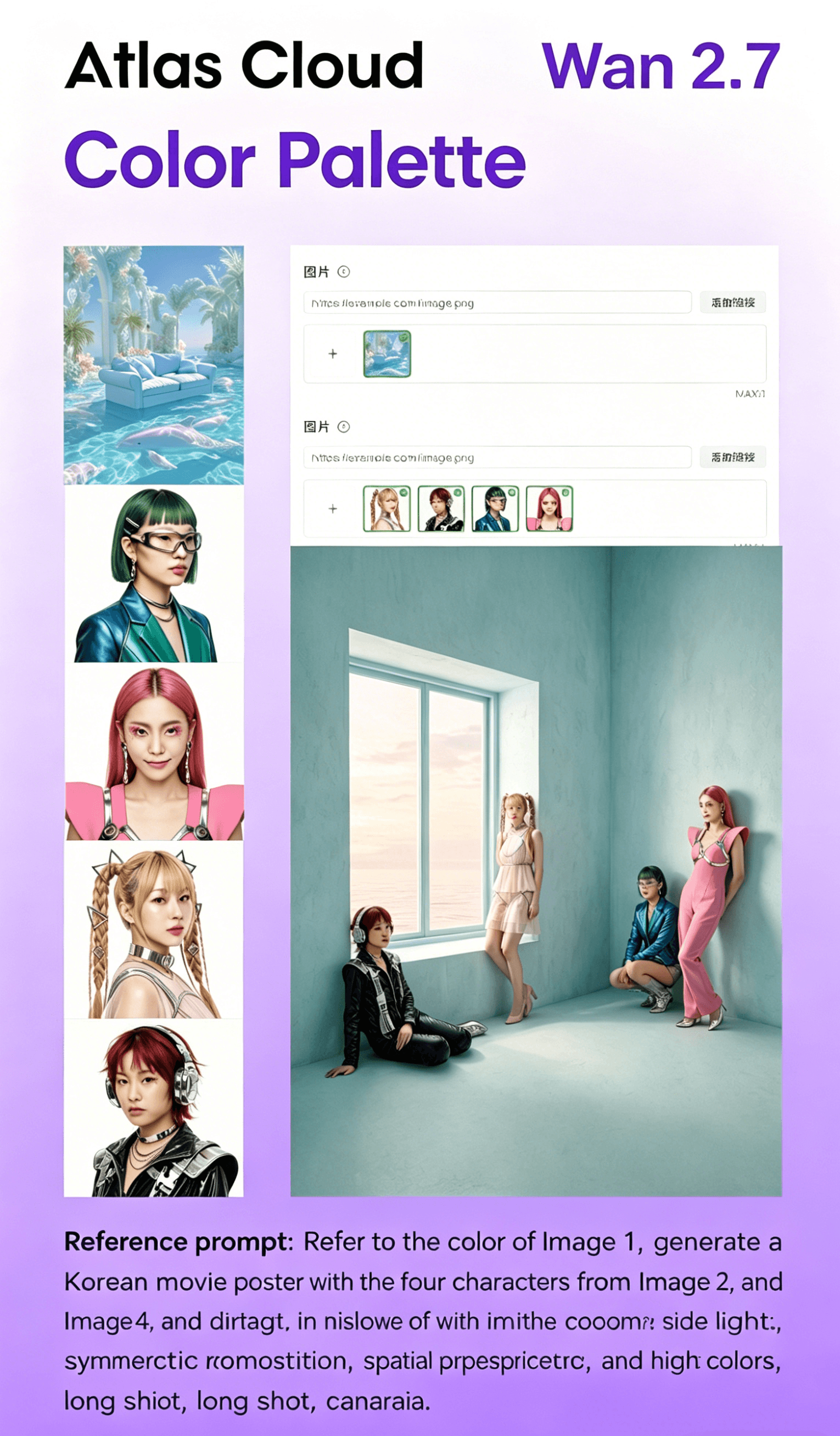

2⃣ Consistencia de múltiples agentes: soporte para hasta 5 imágenes

Al generar fotos grupales, pósteres de películas o combinaciones de muebles, Wan2.7‑Image puede mantener la unidad de estilo y características en hasta 5 imágenes. Esto garantiza que múltiples visuales relacionados (como una serie de pósteres de campaña o un grupo de retratos de personajes) tengan una coherencia estética y estilística, reduciendo la necesidad de ajustes de posproducción.

3⃣ Paleta: control de color preciso

Wan2.7‑Image admite la nueva función de "paleta de colores". Los usuarios pueden extraer o ingresar varios colores y proporciones de imágenes de referencia con un solo clic. Desde el rojo intenso de Matisse, el amarillo brillante de Van Gogh, hasta el azul frío de Picasso, pueden hacer referencia y generar imágenes del mismo esquema de color. Los usuarios pueden ajustar libremente el número y la proporción de colores y personalizar el esquema de color, resolviendo el problema de la "caja ciega de color" y garantizando la consistencia del color con las pautas de la marca o las visiones creativas.

4⃣ Maestro de composición tipográfica integral: renderizado de texto multidimensional y gráficos grupales eficientes

Basándose en sus sólidas capacidades de renderizado de texto, Wan2.7‑Image tiene un potente control de texto y capacidades de creación por lotes, admitiendo texto largo y renderizado de fórmulas complejas en 12 idiomas, incluidos el chino y el inglés. Puede restaurar con precisión el diseño de la tabla y lograr una precisión de nivel de impresión. Combinado con la función de generación de imágenes grupales, los usuarios pueden producir una serie de contenido altamente unificada con un solo clic, lo que la convierte en la herramienta definitiva para la planificación visual de múltiples imágenes y el diseño de pósteres profesionales.

Mejores prácticas de instrucciones para Wan 2.7

Obtener el máximo provecho de las capacidades de razonamiento de Wan 2.7 se reduce a cómo estructurar sus instrucciones. Las siguientes prácticas producen constantemente mejores resultados:

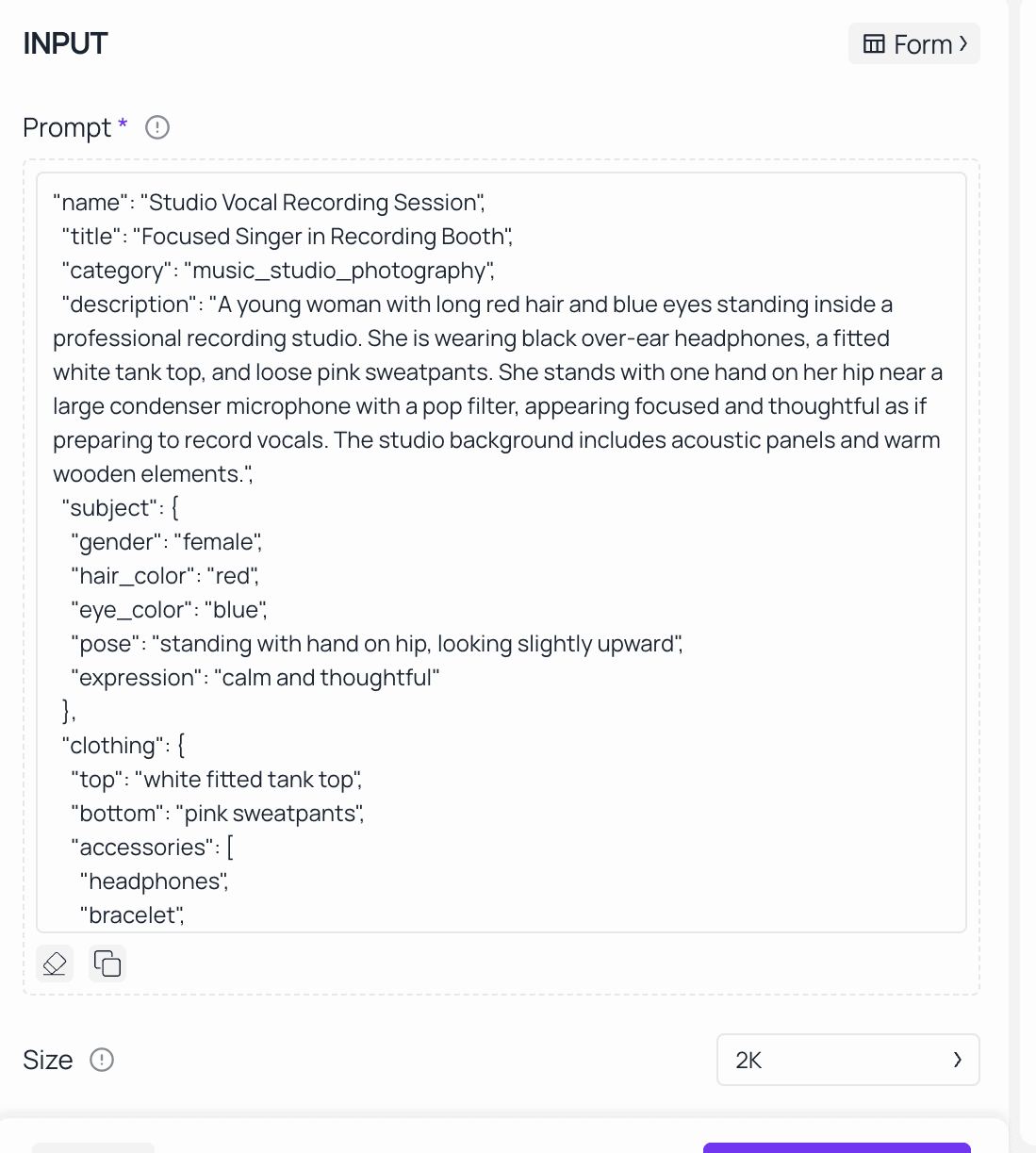

Estructura las instrucciones por elementos. Describe el sujeto, el estilo, la iluminación y la composición como descriptores distintos en lugar de una sola oración corrida. La capa de razonamiento procesa cada elemento con mayor precisión cuando están claramente separados dentro de la instrucción.

Especifica el contenido del texto con precisión. Para cualquier texto que deba aparecer dentro de la imagen generada, escríbelo exactamente como debe renderizarse, usando comillas dentro de la instrucción. Esto le da al modelo un objetivo literal claro en lugar de una interpretación que realizar.

Usa la resolución 2K como base. Para la mayoría de los casos de uso digital profesional (web, social, presentación y activos de campaña digital), la salida 2K ofrece una gran calidad de imagen con tiempos de generación eficientes. Reserva 4K Pro para activos de producción final y entregables listos para imprimir.

Aplica el Modo de pensamiento de forma selectiva. Habilita el Modo de pensamiento para instrucciones que involucren múltiples sujetos que interactúan, relaciones espaciales precisas o requisitos estilísticos en capas. Para instrucciones más simples (tomas de productos limpias sobre fondos sólidos, generaciones de retratos directos), el modo estándar ofrece resultados rápidos sin una pérdida de calidad significativa.

Aprovecha las entradas de múltiples referencias para el trabajo de marca. Al generar activos que deben reflejar referencias visuales específicas, carga imágenes de referencia junto con tu instrucción. Usa referencias separadas para guiar la paleta de colores, el estilo compositivo y la apariencia del personaje de forma independiente, permitiendo que el modelo sintetice en lugar de copiar una sola fuente.

Usa códigos de color para una coincidencia exacta de marca. Wan 2.7 admite la entrada directa de códigos de color dentro de las instrucciones, lo que permite una coincidencia precisa del color de la marca sin ajustes iterativos de la instrucción. Ingresar valores hex específicos y su distribución proporcional garantiza que las imágenes generadas se alineen con los estándares de marca definidos.

¿Quién debería usar Wan 2.7?

Los equipos de marketing y marca que producen activos de campaña que requieren superposiciones de texto precisas, cumplimiento preciso del color de la marca y producción de gran volumen con una calidad constante encontrarán que la combinación de renderizado de texto y control de semilla de Wan 2.7 aborda directamente sus requisitos de producción.

Los equipos de diseño que utilizan IA para crear tableros de estado de ánimo (moodboards), iterar sobre conceptos de productos y explorar direcciones visuales se beneficiarán enormemente de la capacidad del modelo para seguir instrucciones de estilo detalladas y producir composiciones bien estructuradas y de múltiples elementos a la primera.

Los equipos de comercio electrónico que producen grandes volúmenes de imágenes de estilo de vida de productos, visuales variantes y contenido localizado pueden usar entradas de múltiples referencias para mantener una apariencia de sujeto coherente en extensas bibliotecas de activos, mientras ajustan libremente los fondos, la iluminación y los entornos de la escena.

Los desarrolladores y agencias que crean flujos de trabajo de contenido impulsados por IA pueden integrar Wan 2.7 a través de la API unificada de Atlas Cloud junto con otros modelos líderes, sin necesidad de gestionar infraestructura separada, alojamiento de modelos o acuerdos de facturación para cada plataforma.

Los creadores de contenido que producen contenido visual multilingüe (en redes sociales, editorial o comunicación de marca) se benefician del renderizado de texto en 12 idiomas de Wan 2.7 y el soporte de instrucciones de contexto largo, particularmente para campañas dirigidas al idioma chino y otros mercados que no son de habla inglesa.

¿Por qué ejecutar Wan 2.7 en Atlas Cloud?

Ejecutar Wan 2.7 a través de Atlas Cloud proporciona varias ventajas prácticas sobre la implementación autohospedada o proveedores de API alternativos:

La inferencia acelerada por GPU garantiza una latencia consistentemente baja en todos los niveles de generación, incluidos los resultados 4K Pro y las solicitudes de Modo de pensamiento que implican la pasada de razonamiento adicional.

La API unificada permite a los equipos ejecutar Wan 2.7 junto con GPT, Gemini, DeepSeek y otros modelos principales a través de un único punto de integración, simplificando la arquitectura y reduciendo el trabajo de integración para flujos de trabajo de múltiples modelos.

Con precios transparentes por token y opciones sin servidor, los equipos pueden eliminar los costos de cómputo inactivo, además de obtener una facturación predecible, ya sea que estén usando la plataforma para experimentos o para producción a gran escala.

Atlas Cloud proporciona fiabilidad de nivel empresarial y características de cumplimiento (incluyendo un SLA de tiempo de actividad del 99.99%, certificación SOC 2 Tipo II, alineación con HIPAA, control de acceso basado en roles y soberanía de datos de EE. UU.) para adaptarse a industrias reguladas e implementaciones organizacionales a gran escala.

Sus herramientas para desarrolladores (como SDK, paneles de análisis, soporte para ajuste fino y plantillas de flujo de trabajo prediseñadas) ayudan a los equipos a reducir el tiempo de producción, ya sean nuevos en la generación de imágenes por IA o estén cambiando desde otra plataforma.

Cómo usar Wan 2.7 en Atlas Cloud: paso a paso

Paso 1 — Crear una cuenta de Atlas Cloud

Regístrate en atlascloud.ai y completa la verificación de la cuenta. Los nuevos usuarios reciben créditos gratuitos para explorar la plataforma y probar Wan 2.7 en diferentes modos de generación antes de comprometerse a un plan de pago. Esto incluye probar las características exclusivas de Wan2.7-Image como la personalización de personajes virtuales y el control de la paleta de colores.

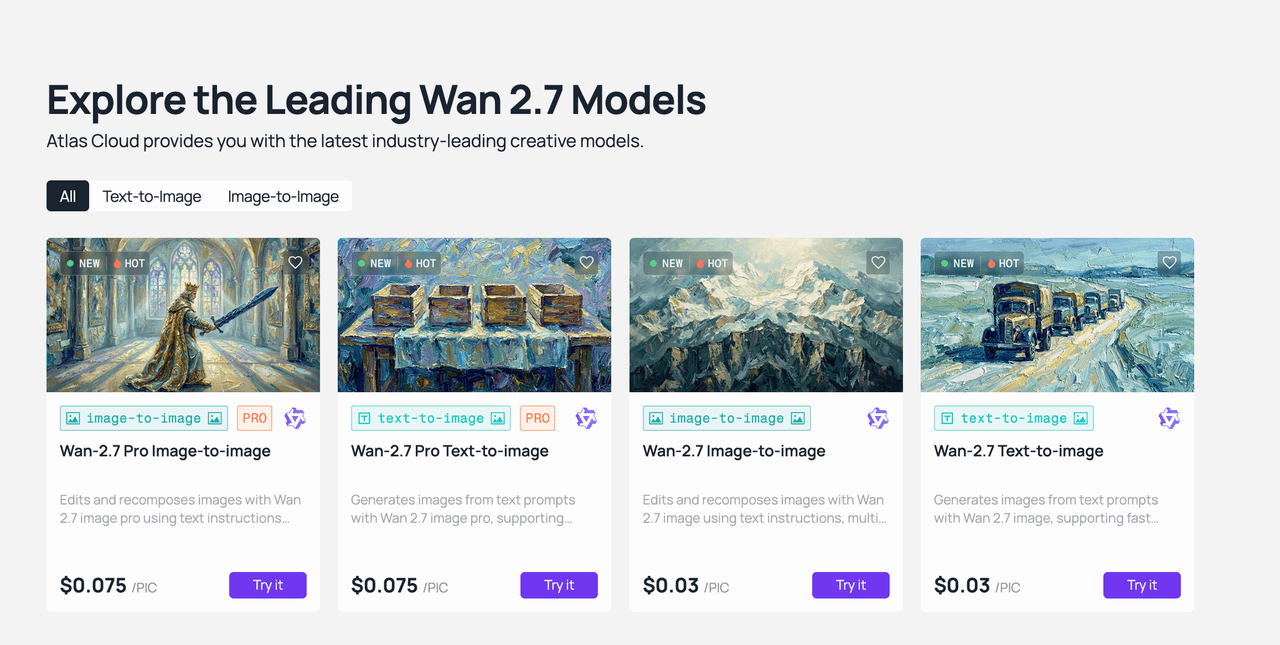

Paso 2 — Navegar al modelo Wan 2.7

https://www.atlascloud.ai/collections/wan2.7

Desde el panel de control de Atlas Cloud, ve a la Biblioteca de modelos y busca "Wan 2.7". Elige la versión que se adapte a tus necesidades: texto a imagen estándar (Wan2.7-Image) para imágenes estáticas y características exclusivas como personalización de personajes, texto a imagen Pro para salida 4K o el modelo de video para contenido en movimiento.

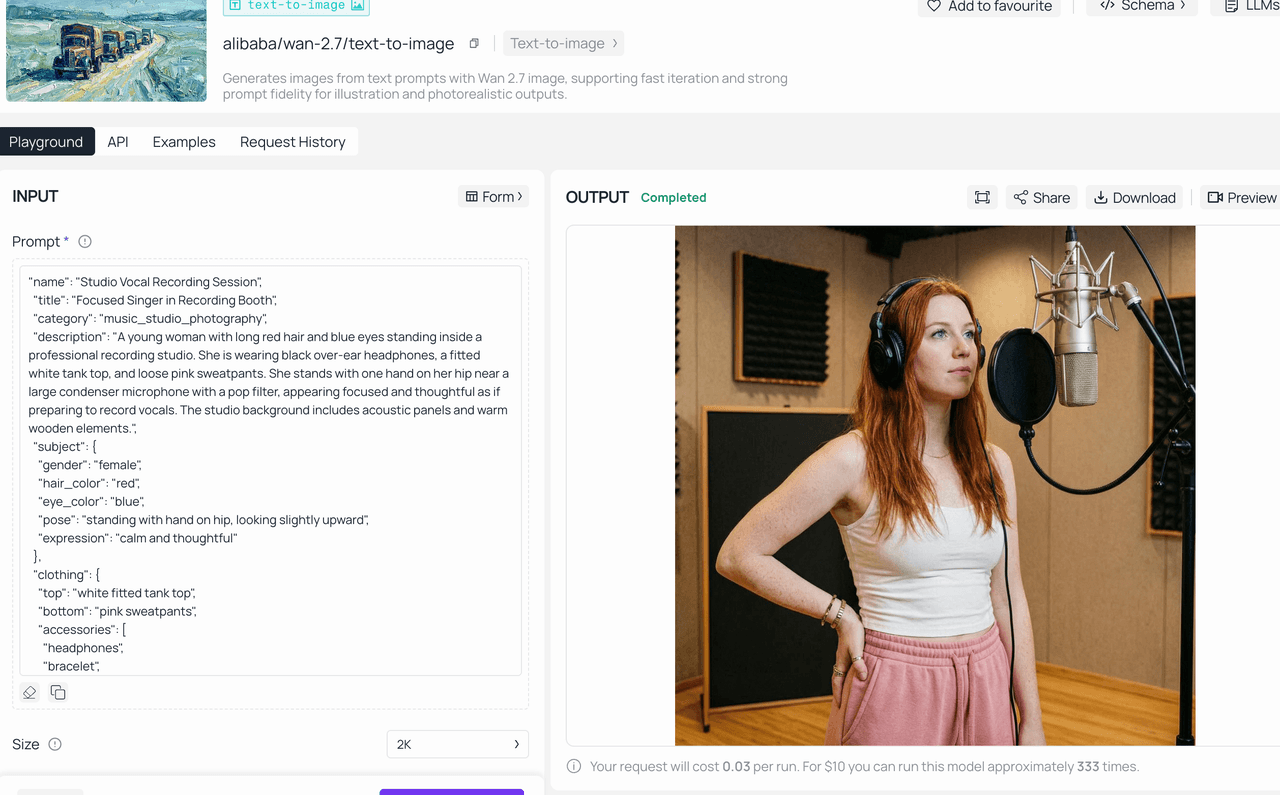

Paso 3 — Escribir tu instrucción

La capa de razonamiento de Wan 2.7 maneja instrucciones detalladas de múltiples elementos con mayor precisión que la mayoría de los modelos. Describe tu sujeto, estilo, iluminación y composición con claridad. Para imágenes con texto como etiquetas de productos, letreros o tipografía, incluye la redacción exacta directamente en tu instrucción. Para la personalización de personajes de Wan2.7-Image, especifica detalles faciales (p. ej., "cara ovalada, ojos de almendra, cabello castaño claro") y requisitos de color (p. ej., "usa la paleta de colores rojo intenso de Matisse, 60% rojo, 30% oro, 10% negro") para lograr resultados precisos.

Paso 4 — Configurar los ajustes de salida

Selecciona tu resolución objetivo según el caso de uso previsto. Habilita el Modo de pensamiento para instrucciones complejas donde la precisión importa más que la velocidad de generación. Establece un valor de semilla fijo para garantizar resultados consistentes y repetibles para la consistencia de la marca o la creación iterativa de campañas. Para Wan2.7-Image, también puedes habilitar la función de paleta de colores y cargar imágenes de referencia para extraer esquemas de color.

Paso 5 — Generar, revisar y refinar

Para un trabajo preciso de calidad final, realiza una sola generación. Si estás explorando opciones creativas, genera múltiples variaciones en su lugar. Usa el punto final de Edición de imagen para refinar elementos específicos de un resultado seleccionado sin empezar desde cero, ajustando fondos, iluminación o detalles compositivos mediante instrucciones en lenguaje natural. Para Wan2.7-Image, puedes refinar los rasgos faciales del personaje o ajustar las proporciones de color directamente mediante instrucciones de edición.

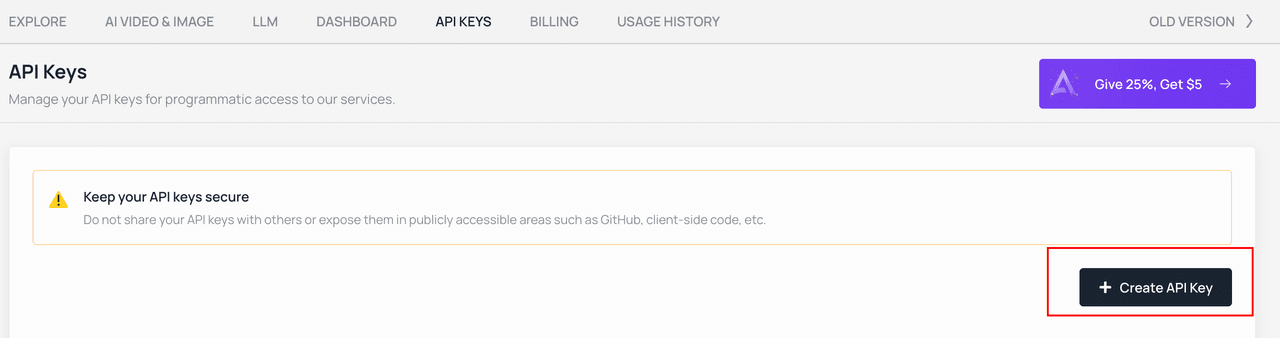

Paso 6 — Integrar a través de la API de Atlas Cloud

Para integrar la generación de equipos en los procesos de producción, Atlas Cloud proporciona una API REST unificada que ejecuta Wan 2.7 junto con otros modelos líderes (GPT, Gemini y DeepSeek) a través de una única integración. La documentación detallada de la API, el soporte de SDK y las plantillas de código están disponibles en el portal para desarrolladores de Atlas Cloud, incluido el soporte para las características exclusivas de Wan2.7-Image.

Preguntas frecuentes

¿Qué es Wan 2.7 y en qué se diferencia de Wan 2.6?

Wan 2.7 es el modelo de generación de imágenes y video por IA más reciente de Alibaba. Su mayor actualización respecto a Wan 2.6 es la capa de razonamiento de cadena de pensamiento integrada, también conocida como Modo de pensamiento. Esta característica admite una comprensión de instrucciones mucho más precisa, una estructura compositiva más sólida y un renderizado de texto más claro en las imágenes generadas.

¿Wan 2.7 admite acceso a API?

Sí. Wan 2.7 está totalmente disponible a través de la API REST de Atlas Cloud, por lo que puede integrarse sin problemas en procesos de contenido de producción, plataformas CMS, sistemas de comercio electrónico y aplicaciones personalizadas.

¿Cuál es la resolución máxima para la generación de texto a imagen de Wan 2.7?

El nivel estándar admite hasta 2K (2048×2048 píxeles), mientras que el nivel Pro alcanza 4K (4096×4096 píxeles), perfecto para impresión y uso en pantallas grandes.

¿Cómo gestiona Wan 2.7 el renderizado de texto en idiomas distintos al inglés?

Wan 2.7 admite el renderizado de texto en 12 idiomas, con una optimización particular para las instrucciones y el texto de imagen en chino, dado su desarrollo dentro del ecosistema de Alibaba.

¿Puede Wan 2.7 generar videos además de imágenes?

Sí. Wan 2.7 en Atlas Cloud incluye capacidades de generación de texto a video e imagen a video, admitiendo resultados de hasta 15 segundos en 1080P HD, con control del primer y último cuadro, audio nativo y entradas de video de múltiples referencias.

Empieza hoy con Wan 2.7 en Atlas Cloud : regístrate en atlascloud.ai y recibe créditos gratuitos para comenzar a generar.