Hace no mucho tiempo, crear un vídeo para redes sociales decente requería un equipo completo: guion, rodaje, edición y diseño de sonido. Para 2026, todo ese proceso se ha comprimido en un prompt de texto y una llamada a una API. Ya existe la infraestructura necesaria para transformar directamente una descripción de producto, una línea de guion o un resumen de contenido en un clip de vídeo publicable.

Este artículo explica cómo es dicha infraestructura, cómo desarrollar sobre ella y qué se necesita para que funcione de forma fiable a escala.

Por qué la automatización de vídeo social es importante ahora

El vídeo de formato corto ya no es solo entretenimiento. TikTok, Instagram Reels y YouTube Shorts se han convertido en motores de distribución clave para la cultura, el marketing y el comercio electrónico. Pero existe una limitación sencilla: la producción de contenido no crece al mismo ritmo que la demanda.

Incluso para los creadores experimentados, producir un vídeo de alta calidad requiere mucho tiempo: guion, guion gráfico (storyboarding), rodaje o búsqueda de material, edición, corrección de color, mezcla de sonido y subtítulos. El cuello de botella rara vez son las ideas; es la velocidad de ejecución. Cuando una tendencia dura solo unas horas, quien publica primero, gana. La generación de vídeo mediante IA cambia las reglas del juego al convertir la producción por lotes de un proyecto de capital en un coste operativo rutinario.

Por qué las API son más importantes que las interfaces de usuario

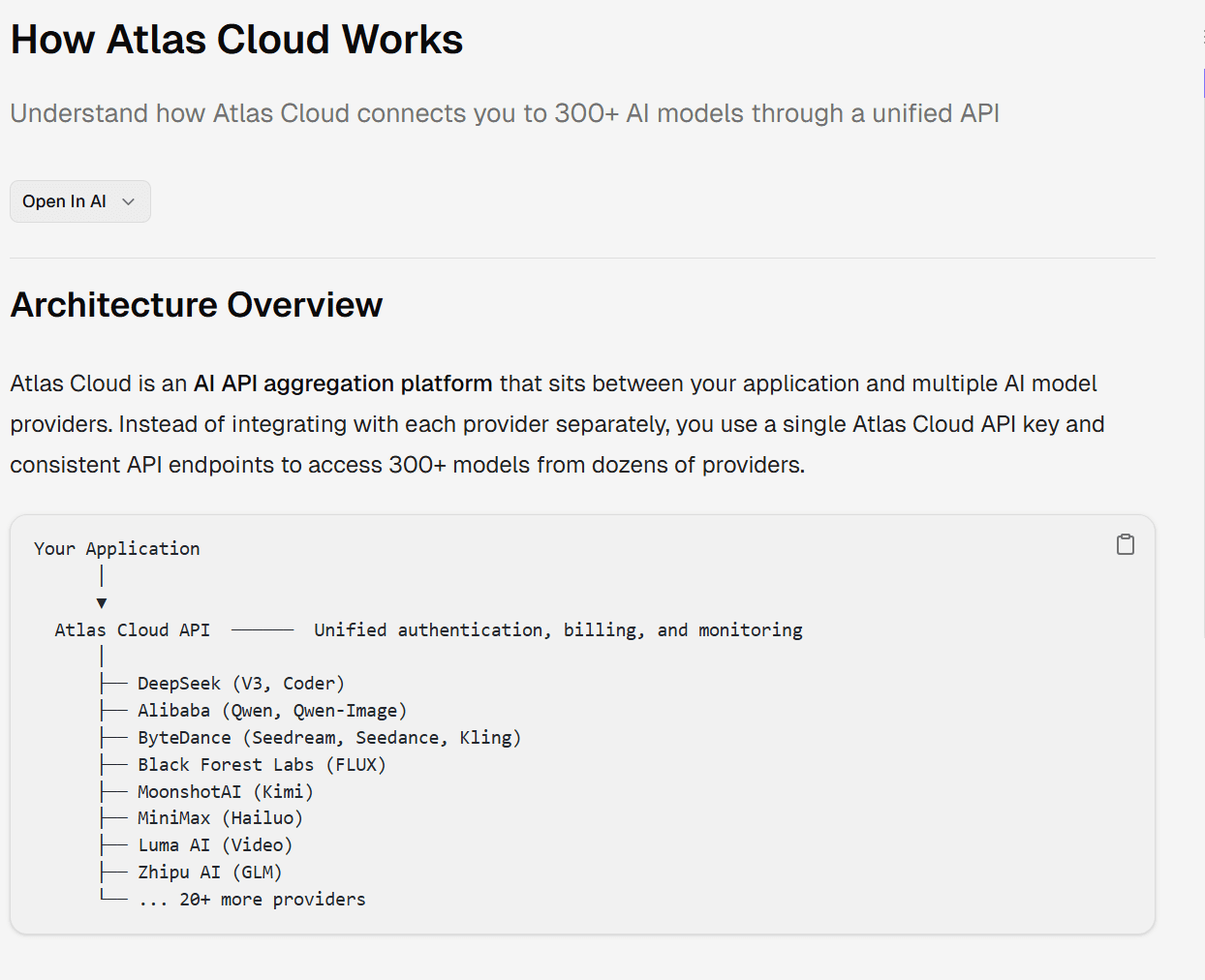

Muchas herramientas de vídeo con IA ofrecen interfaces web atractivas: escribes un prompt, haces clic en un botón y ves el resultado. Eso es cómodo para los creadores individuales, pero si estás construyendo un sistema de contenido automatizado, una interfaz no te servirá. Lo que permite una verdadera escalabilidad es la API.

Las API aportan programabilidad. Puedes enviar tareas por lotes, ajustar automáticamente las relaciones de aspecto para distintas plataformas e integrar la generación de vídeo en tu plataforma SaaS como una función nativa. Puedes realizar pruebas A/B programáticas: generar diez variaciones estilísticas de la misma descripción de producto, publicarlas en diferentes segmentos de audiencia y utilizar los datos de interacción para refinar el siguiente lote de prompts.

Imagina una plataforma de comercio electrónico que añade doscientos productos nuevos cada día. Hacer un vídeo de presentación para cada uno manualmente requeriría docenas de profesionales del vídeo. Con una API, escribes un script que lee la base de datos de productos, ensambla automáticamente una plantilla de prompt, llama a la API y envía los resultados a un programador de redes sociales. Ninguna persona tiene que abrir un software de edición. Las interfaces son para las personas; las API son para los sistemas. El verdadero avance proviene de estas últimas.

La vida de una llamada a la API

Sigamos una llamada a la API real, desde el envío hasta la descarga.

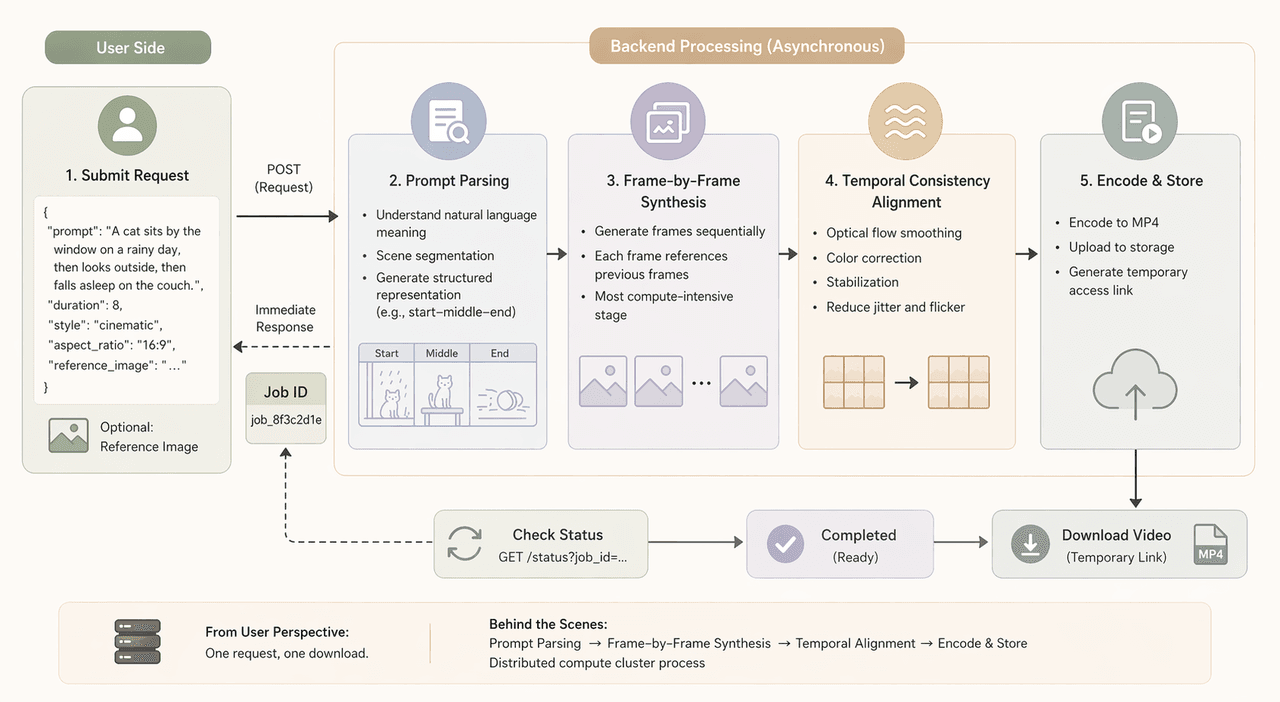

Primero, empaquetas tu prompt y tus parámetros en JSON. La solicitud suele incluir el prompt, la duración (por ejemplo, ocho segundos), un ajuste preestablecido de estilo, la relación de aspecto y, a veces, una imagen de referencia para fijar a un personaje o escena. Envías esto al endpoint y el sistema devuelve inmediatamente un ID de tarea único. La generación tarda de segundos a minutos, por lo que el proceso es asíncrono.

Tras el envío, el backend comienza a trabajar.

El primer paso es el análisis del prompt (prompt parsing): convertir tu lenguaje natural en una representación estructurada. Esto incluye la segmentación de escenas: si tu descripción implica tres acciones secuenciales, el modelo calcula el principio, el desarrollo y el final.

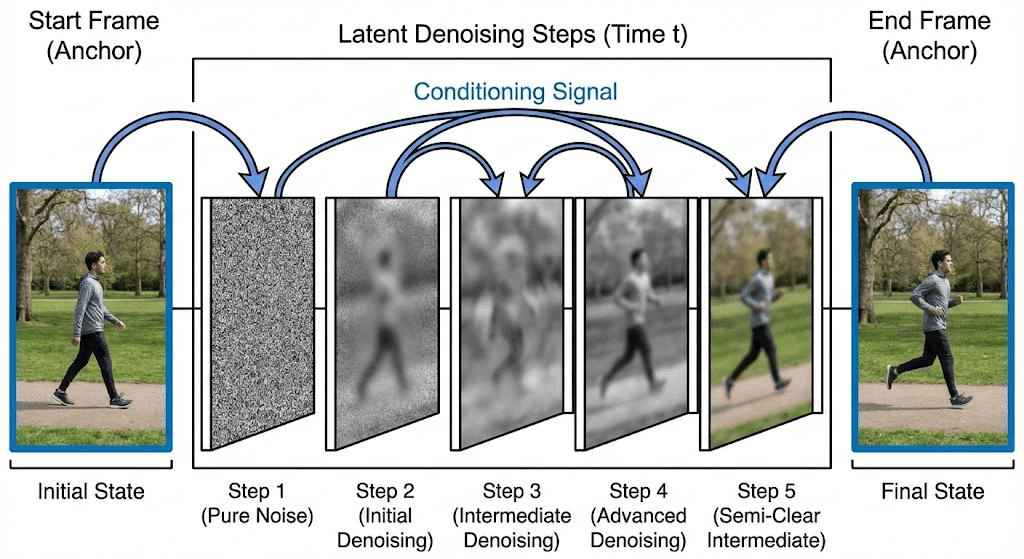

El segundo paso es la síntesis fotograma a fotograma. El modelo genera los fotogramas secuencialmente, cada uno tomando como referencia los anteriores para mantener la coherencia. Esta es la etapa con mayor consumo de computación.

El tercer paso es la alineación de la consistencia temporal. Incluso con el mayor esfuerzo del modelo, los fotogramas sin procesar pueden tener pequeñas fluctuaciones (jitter). Una etapa de posprocesamiento aplica suavizado de flujo óptico, corrección de color y estabilización.

Finalmente, el sistema codifica el vídeo en MP4, lo sube al almacenamiento y genera un enlace de acceso temporal. Desde la perspectiva del usuario, es una sola solicitud y una descarga. Detrás de escena, un clúster de computación distribuida ha realizado una gran cantidad de trabajo.

Cómo utilizan esto diferentes perfiles

Los creadores independientes utilizan la API para multiplicar su producción. Puedes tomar una idea central y generar una docena de variaciones: cambiar el tono de color, intercambiar el estilo de la voz en off o ajustar el movimiento de la cámara. En lugar de tres vídeos a la semana, puedes hacer diez al día. El cuello de botella se desplaza de la velocidad de producción a tu criterio sobre qué conservar.

Demostración rápida: Una idea, muchas variaciones

plaintext1import requests 2 3API_KEY = "YOUR_API_KEY" 4url = "https://api.atlascloud.ai/api/v1" 5 6styles = ["cinematic", "anime", "documentary", "vlog"] 7 8for style in styles: 9 payload = { 10 "prompt": "A cat sitting by the window, wind blowing curtain", 11 "duration": 6, 12 "style": style, 13 "aspect_ratio": "1:1" 14 } 15 16 res = requests.post(url, json=payload, headers={ 17 "Authorization": f"Bearer {API_KEY}" 18 }).json() 19 20 print(f"{style} → job_id:", res["job_id"])

Los equipos de marketing utilizan enfoques más sistemáticos. Un caso de uso común es la localización multirregional. Una marca global que se lanza en veinte países puede generar un vídeo maestro y luego ejecutar un script que reemplace automáticamente el texto en pantalla, la voz en off y los detalles visuales para cada idioma. Un mes de trabajo se convierte en unos pocos días.

El comercio electrónico es otra área de rápido crecimiento. Una imagen estática de producto más una breve descripción se convierte en un escaparate dinámico. Para un reloj inteligente, introduces una descripción de primer plano con iluminación y movimiento de cámara, y el sistema genera un bucle de seis segundos. Al colocarlos en la página de producto, estos clips suelen superar en rendimiento a las imágenes estáticas. Y puedes procesar todo el catálogo por lotes.

Los desarrolladores y las plataformas SaaS empaquetan la generación de vídeo como un servicio. Una herramienta de programación de redes sociales podría integrar una API para que los usuarios introduzcan un tuit y la herramienta lo convierta automáticamente en un guion de vídeo, genere el vídeo y lo programe. Estas plataformas están convirtiendo la generación de vídeo en una capacidad fundamental.

Cómo hacer que la salida de la IA esté lista para la producción

Una dura verdad: la salida de la API en bruto rara vez está lista para ser publicada. Los sistemas de producción exitosos envuelven la API con varias capas.

Primero, la ingeniería de prompts. Los equipos maduros mantienen bibliotecas de plantillas de prompts para diferentes categorías, estilos y plataformas. Un prompt para Instagram Reels enfatiza la alta saturación y los cortes rápidos. Un prompt para YouTube Shorts se centra en el flujo narrativo. Las plantillas tienen variables que los scripts rellenan dinámicamente.

Segundo, la gestión de la calidad de generación. El mismo prompt ejecutado cinco veces puede producir tres clips utilizables y dos con fallos: un dedo deformado, un objeto de fondo ilógico. Debes escribir comprobaciones automáticas que detecten errores comunes y marquen los clips para su regeneración.

Tercero, flujos de posprocesamiento. Tras la generación, es posible que necesites añadir un logotipo, una introducción/cierre o subtítulos incrustados. Haz esto con scripts, no reimportando el material en un software de edición.

Cuarto, caché y reutilización. Si tu biblioteca utiliza repetidamente el mismo producto o personaje, guarda los resultados en caché. Esto reduce los costes y mantiene la consistencia visual.

Todas estas capas juntas conforman un verdadero motor de contenido. La API es solo un componente. El valor reside en cómo ensamblas el sistema.

Lo que aún no funciona

La generación de vídeo con IA dista mucho de ser perfecta. Si intentas generar algo de más de unos quince segundos, probablemente te encontrarás con problemas: los objetos se deforman, la lógica de la escena se rompe, los personajes se vuelven inconsistentes. La ventana narrativa efectiva de los modelos actuales es corta.

El coste computacional es otra limitación. Generar un segundo de vídeo de alta calidad requiere mucho más tiempo de GPU que generar una imagen. Los precios están bajando, pero para los equipos que necesitan cientos de vídeos al día, las matemáticas siguen importando. Un enfoque pragmático reserva la generación de alto coste para contenido crítico y utiliza opciones más económicas para pruebas.

La imprevisibilidad de los prompts es una molestia persistente. El mismo prompt puede dar resultados diferentes hoy que ayer. Los resultados entre proveedores varían enormemente. Los sistemas automatizados necesitan una solidez adicional: asume que no toda generación cumplirá las expectativas y diseña intentos de reintento.

La coherencia narrativa de múltiples escenas es todavía muy débil. Puedes generar "una persona bebiendo café en una cafetería" y también generar "la misma persona saliendo a la calle", pero el modelo no entenderá automáticamente la transición. Para obtener un vídeo de varias escenas, actualmente tienes que describir cada corte en detalle.

Hacia dónde se dirige todo

A pesar de estas limitaciones, la dirección es clara. La generación de vídeo no seguirá siendo una herramienta aislada. En los próximos años, espera flujos de trabajo de contenido totalmente automatizados: un sistema escanea tendencias cada mañana, genera conceptos de vídeo automáticamente, ejecuta pequeñas pruebas, elige los de mejor rendimiento y los amplifica. Ningún humano toma decisiones creativas, solo la revisión final de seguridad de marca.

También espera sistemas creativos con agentes. Le das a un agente de IA un objetivo —"aumentar el conocimiento de nuevos productos esta semana"— y este propone direcciones de guion, genera candidatos, publica en audiencias de prueba, analiza la retroalimentación, ajusta la estrategia y genera el siguiente lote.

Aparecerán flujos de vídeo personalizados en tiempo real. Una aplicación de fitness podría producir un resumen semanal personalizado con los propios datos del usuario, visualizaciones de su progreso y una voz en off motivadora.

Finalmente, espera una integración profunda con los stacks de automatización de marketing. Plataformas como AtlasCloud admiten la agregación de múltiples modelos para la generación de imágenes y vídeo, facilitando a los usuarios su integración en sus propios proyectos creativos o comerciales.

Pensamiento final

El cambio de la edición manual a la generación basada en API no es una actualización de herramientas. Es un cambio estructural en cómo se crea y consume el contenido. Las API de generación de vídeo se están convirtiendo en la capa de infraestructura de la narración digital moderna. Para los creadores, esto significa escala. Para los desarrolladores, oportunidad. Para las plataformas, automatización. Y para Internet, una transición de la producción por lotes estática a los sistemas de medios generativos continuos. Esa transición ya está ocurriendo. Cualquiera con una clave de API y una idea puede empezar a construir su propio flujo de trabajo de vídeo: sin necesidad de un presupuesto millonario.