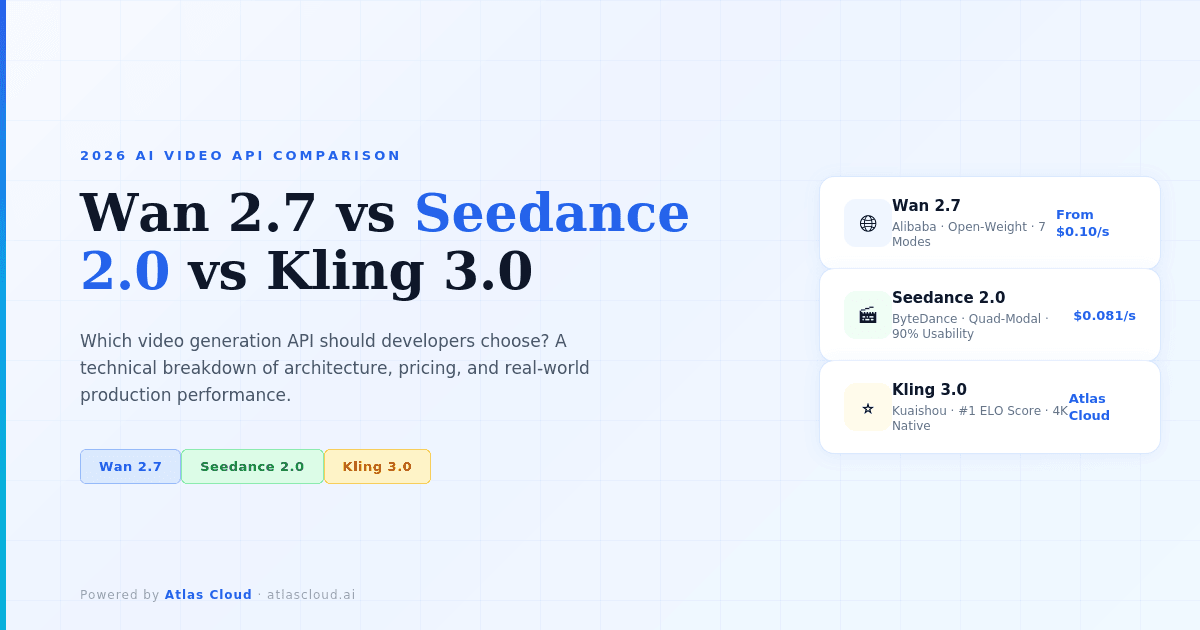

Tres potentes APIs de generación de video se lanzaron con semanas de diferencia a principios de 2026. Wan 2.7 (Alibaba), Seedance 2.0 (ByteDance) y Kling 3.0 (Kuaishou) reclaman ser la mejor. Los desarrolladores que crean canales de video para producción necesitan una respuesta clara, no un folleto de marketing.

Tres potentes APIs de generación de video se lanzaron con semanas de diferencia a principios de 2026. Wan 2.7 (Alibaba), Seedance 2.0 (ByteDance) y Kling 3.0 (Kuaishou) reclaman ser la mejor. Los desarrolladores que crean canales de video para producción necesitan una respuesta clara, no un folleto de marketing.

Esta guía elimina el ruido. Compararemos arquitectura, calidad de resultados real, precios y las condiciones específicas de flujo de trabajo donde cada modelo gana, con ejemplos concretos de equipos de producción que utilizan Atlas Cloud.

La respuesta corta, antes de profundizar: Ningún modelo domina todos los casos de uso. Seedance 2.0 gana en control multimodal y fidelidad facial. Kling 3.0 gana en narrativa cinematográfica y puntuaciones de referencia. Wan 2.7 gana en flexibilidad, economía de pesos abiertos y edición de video. La elección correcta depende de lo que su aplicación realmente necesite.

Qué es realmente nuevo en el panorama de las APIs de video de 2026

Antes de comparar los modelos, vale la pena señalar qué ha cambiado. La suposición ingenua —que los modelos más nuevos son simplemente "mejores"— pierde la esencia de la historia.

Antes de comparar los modelos, vale la pena señalar qué ha cambiado. La suposición ingenua —que los modelos más nuevos son simplemente "mejores"— pierde la esencia de la historia.

La generación de 2026 de APIs de video cruzó tres umbrales que los modelos anteriores no habían alcanzado:

Umbral 1: El audio nativo es ahora esencial. Tanto Seedance 2.0 como Kling 3.0 generan audio y video en una sola pasada, con sincronización labial a nivel de fonema. Wan 2.7 añadió acondicionamiento de audio nativo en su última versión. Hace seis meses, cualquier capacidad de audio nativo era un diferenciador. Ahora es una expectativa básica.

Umbral 2: Las entradas de referencia reemplazaron a los prompts como superficie de control principal. Los tres modelos ahora aceptan referencias de imagen y video, no solo texto. Esto cambia el flujo de trabajo del desarrollador de "escribir mejores prompts" a "proporcionar mejores materiales de referencia". El techo de calidad subió, pero también la complejidad de la preparación de entradas.

Umbral 3: La consistencia de personajes es resoluble, pero las implementaciones difieren. Mantener el mismo rostro, vestuario y postura a través de múltiples clips generados era el problema sin resolver más difícil en video con IA. Los tres modelos lo abordan, a través de mecanismos diferentes, con perfiles de fiabilidad distintos.

Comprender estos cambios ayuda a aclarar qué significa realmente la comparación de modelos.

Desglose modelo por modelo

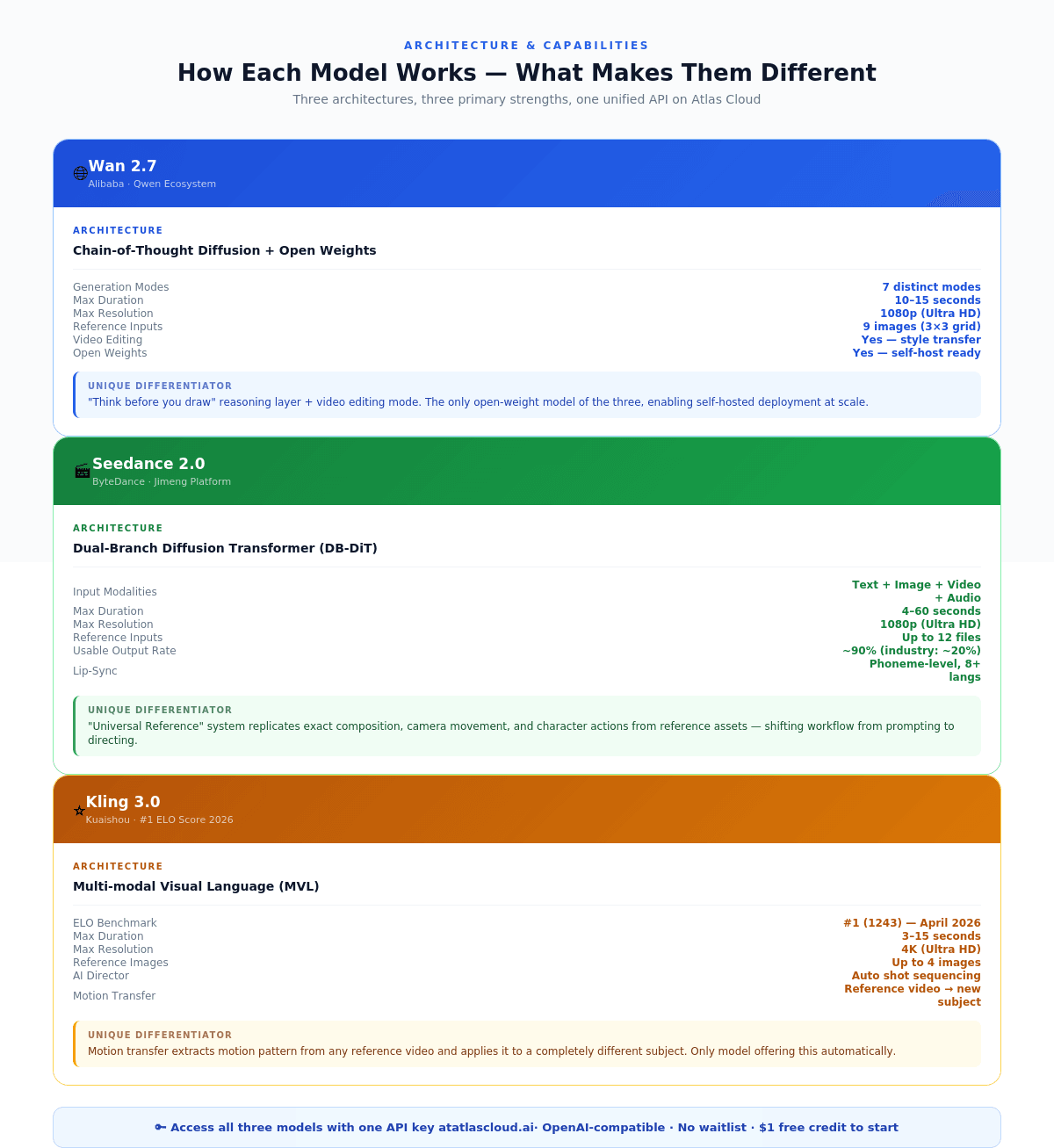

Wan 2.7 — El caballo de batalla de pesos abiertos de Alibaba

Wan 2.7 es la última entrada de Alibaba en la serie de generación de video Wan, lanzada a principios de 2026 dentro del ecosistema Qwen. Es un modelo de pesos abiertos, lo que es el hecho más importante desde la perspectiva de costo y despliegue para un desarrollador.

Qué hace realmente Wan 2.7: Wan 2.7 admite siete modos de generación distintos: texto a video, imagen a video, control de fotograma inicial y final, continuación de video, edición de video (transferencia de estilo), audio a video y referencia a video. Ningún otro punto de control de modelo iguala actualmente este rango.

La arquitectura añade una capa de razonamiento de cadena de pensamiento antes de la generación de imagen y video, descrita internamente como "pensar antes de dibujar". Esto es significativo: la mayoría de los modelos de texto a video procesan prompts en una sola pasada, lo que produce errores espaciales e inconsistencias de diseño en escenas complejas. La capa de razonamiento de Wan 2.7 detecta esto antes de que comience la generación.

Especificaciones clave:

- Resolución: 720p y 1080p (Ultra HD)

- Duración: hasta 15 segundos, configurable

- Audio: acondicionamiento de audio nativo, sincroniza movimiento y labios con la pista de audio proporcionada durante la generación (no post-procesamiento)

- Entradas de referencia: hasta 9 imágenes mediante síntesis de cuadrícula 3×3 para consistencia de carácter y estilo

- Control de primer y último fotograma: define ambos fotogramas clave; el modelo interpola la transición

- Edición de video: transferencia de estilo desde metraje existente mediante prompt de texto

- Relaciones de aspecto: 5 opciones incluyendo 9:16, 16:9, 1:1

Donde destaca Wan 2.7:

El control del primer y último fotograma es una capacidad de producción genuina. Para equipos de comercio electrónico que animan tomas de producto —"producto en reposo" a "producto en movimiento"— esto produce transiciones controladas sin una pasada de animación completa. Las restricciones del endpoint son deterministas; lo que sucede entre fotogramas es estocástico, pero las guías compositivas están ahí.

El modo de edición de video cubre un vacío que otros modelos no abordan a nivel de API. Wan 2.7 Video Edit toma metraje existente y reescribe su estilo visual basado en un prompt de texto, preservando movimiento, tiempo y estructura. Una agencia con un video fuente puede generar tres variantes específicas para plataformas (pulido para pre-roll de YouTube, animado para TikTok, ilustrado para Instagram) como tres llamadas a la API.

La cuadrícula de referencia de 9 imágenes para consistencia de personajes consolida lo que antes requería múltiples pasadas de generación o soluciones alternativas con ControlNet.

Donde Wan 2.7 tiene límites:

Wan 2.7 interpreta los prompts con más "licencia creativa" que Seedance 2.0. Los equipos que necesitan una salida precisa —comportamiento exacto del personaje, movimiento de cámara específico— encontrarán que el sistema de referencia de Seedance 2.0 es más determinista. Wan 2.7 es mejor cuando se le guía; Seedance 2.0 es mejor cuando puedes mostrarle exactamente lo que quieres.

**Precios en Atlas Cloud:** Desde $0.10/s para imagen a video. Opción de pesos abiertos también disponible para equipos con infraestructura de GPU que deseen eliminar costos por generación a escala.

Seedance 2.0 — La consola de dirección de ByteDance

Seedance 2.0, desarrollado por ByteDance y disponible desde febrero de 2026, toma un enfoque arquitectónico diferente. Su Transformador de Difusión de Doble Rama (DB-DiT) procesa transmisiones de video y audio simultáneamente en ramas separadas y sincronizadas, imponiendo una alineación audiovisual durante la generación en lugar de después.

La característica más distintiva del modelo es lo que su equipo llama el sistema de "Referencia Universal": la capacidad de replicar composición, movimiento de cámara y acciones de los personajes a partir de activos de referencia con una precisión que los modelos anteriores no podían igualar. Esto cambia el flujo de trabajo del desarrollador de programar a dirigir: en lugar de describir lo que quieres, muestras al modelo exactamente lo que quieres.

Qué hace realmente Seedance 2.0: Seedance 2.0 acepta entradas cuadrimodales: texto, hasta 9 imágenes, hasta 3 clips de video y audio, simultáneamente. Su modelo de mundo basado en física simula movimiento de objetos realista y consistencia espacial a lo largo del tiempo. El modelo logra una sincronización labial a nivel de fonema en más de 8 idiomas, lo que significa que los movimientos de la boca coinciden con el habla generada a una granularidad sub-palabra.

Especificaciones clave:

- Resolución: Hasta 1080p (Ultra HD); la resolución de salida del modelo para imagen a video sigue la relación de aspecto de la imagen de entrada

- Duración: 4 a 60 segundos (ajuste de duración = -1 para longitud óptima automática)

- Audio: nativo, sincronización labial a nivel de fonema en más de 8 idiomas

- Entradas de referencia: hasta 12 archivos (imágenes, clips de video, audio) simultáneamente

- Tasa de salida utilizable: ~90% frente a un promedio industrial del ~20%

- Velocidad: 30% más rápido que los sistemas predecesores

Donde destaca Seedance 2.0:

La tasa de salida utilizable del 90% no es un número de marketing que deba descartarse. Para canales de producción donde las generaciones fallidas significan costos de cómputo desperdiciados y tiempo de revisión humana, esto importa sustancialmente. Un canal que genera 1,000 clips por mes con un 20% de usabilidad necesita 5,000 generaciones para obtener 1,000 salidas utilizables. Con un 90% de usabilidad, necesitas 1,111. Esa es una diferencia de 4.5x en el gasto real de API.

La fidelidad facial es la ventaja técnica más clara de Seedance 2.0 sobre los otros dos modelos. Nuestra versión de Seedance 2.0 admite rostros humanos realistas sin las restricciones de contenido que se aplican en la plataforma Jimeng de ByteDance. Para marketing, comercio electrónico y contenido de marca donde deben aparecer rostros reales en el video generado, este suele ser el factor decisivo.

El sistema de Referencia Universal hace que Seedance 2.0 sea la opción correcta cuando el resumen es específico. Si el cliente dice "haz que el personaje se mueva exactamente como en este video de referencia", Seedance 2.0 es el camino más confiable hacia esa salida.

Donde Seedance 2.0 tiene límites:

La relación de aspecto para imagen a video sigue la imagen de entrada; no puedes especificarla independientemente. Los equipos que trabajan con dimensiones de salida fijas deben tener esto en cuenta en su flujo de trabajo de preparación de entradas.

Atlas Cloud Seedance 2.0: Ofrecemos la **versión Full-Power** al **1.8× de la tarifa oficial** — primeros en el mercado con soporte real para rostros humanos y generación sin censura. RPM ilimitado, sin tiempos de espera, infraestructura de nivel empresarial.

Kling 3.0 — El director cinematográfico de Kuaishou

Kling 3.0 se lanzó el 5 de febrero de 2026 —tres días antes de que Seedance 2.0 apareciera— y ostenta la puntuación de referencia ELO más alta (1243) entre todos los modelos de video IA hasta abril de 2026, por delante de Google Veo 3.1, Runway Gen-4.5 y otros.

La suite de modelos incluye dos variantes: Kling 3.0 (actualizado desde Kling 2.6) para una narración cinematográfica inteligente, y Kling 3.0 Omni (Kling O3, actualizado desde Kling O1) para consistencia de sujeto de nivel profesional con sujetos personalizados y clones de voz.

Qué hace realmente Kling 3.0: Kling 3.0 utiliza una arquitectura de Lenguaje Visual Multimodal (MVL) que procesa texto, imagen, audio y video en un sistema unificado. El modelo incluye un "Director IA" que planifica automáticamente ángulos de cámara, tipos de toma y puesta en escena de personajes a través de secuencias. Admite salida 4K nativa y audio multilingüe en chino, inglés, japonés, coreano y español con diálogos multijugador.

Especificaciones clave:

- Resolución: Hasta 4K nativo (Ultra HD)

- Duración: 3 a 15 segundos

- Audio: nativo, sincronización labial multilingüe con soporte para diálogos multijugador

- Planificación de escenas: el Director IA automatiza la secuenciación de tomas

- Transferencia de movimiento: extrae el patrón de movimiento del video de referencia, aplícalo a un sujeto diferente

- Consistencia de sujeto: hasta 4 imágenes de referencia para bloqueo de personaje a través de generaciones

- Renderizado de texto: legibilidad líder en su clase para letreros, logotipos de marca y etiquetas de precio dentro del video

Donde destaca Kling 3.0:

La capacidad de transferencia de movimiento de Kling 3.0 —subir un video de referencia para extraer su patrón de movimiento y aplicarlo a un sujeto completamente diferente— provocó un momento viral a principios de 2026 y sigue siendo su diferenciador más distintivo. Ningún otro modelo en esta comparación ofrece esto automáticamente.

El renderizado de texto es una ventaja práctica que es fácil subestimar. Los letreros, logotipos de marca y etiquetas de precio permanecen legibles dentro de los videos de Kling 3.0. Cualquiera que haya intentado mantener texto legible en video generado por IA con modelos competidores entiende lo significativo que es esto. Para equipos de comercio electrónico que generan videos de productos donde la información de precio o SKU debe aparecer en pantalla, la fidelidad de texto de Kling 3.0 es un requisito funcional, no un lujo.

El techo de salida 4K nativo es el más alto de los tres modelos. Para contenido que aparecerá en pantallas grandes o requerirá un escalado importante de post-producción, Kling 3.0 tiene más margen de resolución.

Donde Kling 3.0 tiene límites:

El modelo de precios de suscripción de Kling 3.0 para acceso de consumidores puede ser opaco. La plataforma nativa cobra créditos por generaciones fallidas, tiene tiempos de cola que superan los 30 minutos durante las horas pico y restringe el acceso a la API a niveles empresariales. Los equipos que necesitan acceso programático sin fricción de suscripción deberían acceder a través de nuestra plataforma.

Kling 3.0 también interpreta los prompts con más "licencia creativa" que Seedance 2.0, lo que lo hace menos confiable cuando el resumen requiere un movimiento preciso y predeterminado.

**Precios en nuestra plataforma:** El acceso a la API de Kling 3.0 está disponible con precios competitivos por segundo. Consulte nuestra página de precios en tiempo real para conocer las tarifas actuales, ya que están sujetas a cambios.

Comparación lado a lado

td {white-space:nowrap;border:0.5pt solid #dee0e3;font-size:10pt;font-style:normal;font-weight:normal;vertical-align:middle;word-break:normal;word-wrap:normal;}

| Dimensión | Wan 2.7 | Seedance 2.0 | Kling 3.0 |

| Resolución Máxima | 1080p (Ultra HD) | 1080p (Ultra HD) | 4K (Ultra HD) |

| Duración Máxima | 15s | 60s | 15s |

| Audio Nativo | Sí | Sí (a nivel de fonema) | Sí (multilingüe) |

| Modalidades de Ent. | Texto, imagen, audio, video | Texto, imagen, audio, video | Texto, imagen, audio, video |

| Imág. de referencia | Hasta 9 (cuadrícula 3×3) | Hasta 9 imág. + 3 videos | Hasta 4 imágenes |

| Modo Edición Video | Sí | No | Sí (Omni) |

| Fidelidad Facial | Buena | La mejor en su clase | Buena |

| Texto en video | Moderada | Moderada | El mejor en su clase |

| Pesos Abiertos | Sí | No | No |

| Precios Atlas Cloud | Desde $0.10/s | $0.081–$0.10/s | Ver pág. de precios |

| Ideal para | Edición, economía abierta | Rostros, control preciso | Narrativa, 4K |

Precios precisos a fecha de abril de 2026. Consulte atlascloud.ai/pricing para conocer las tarifas actuales.

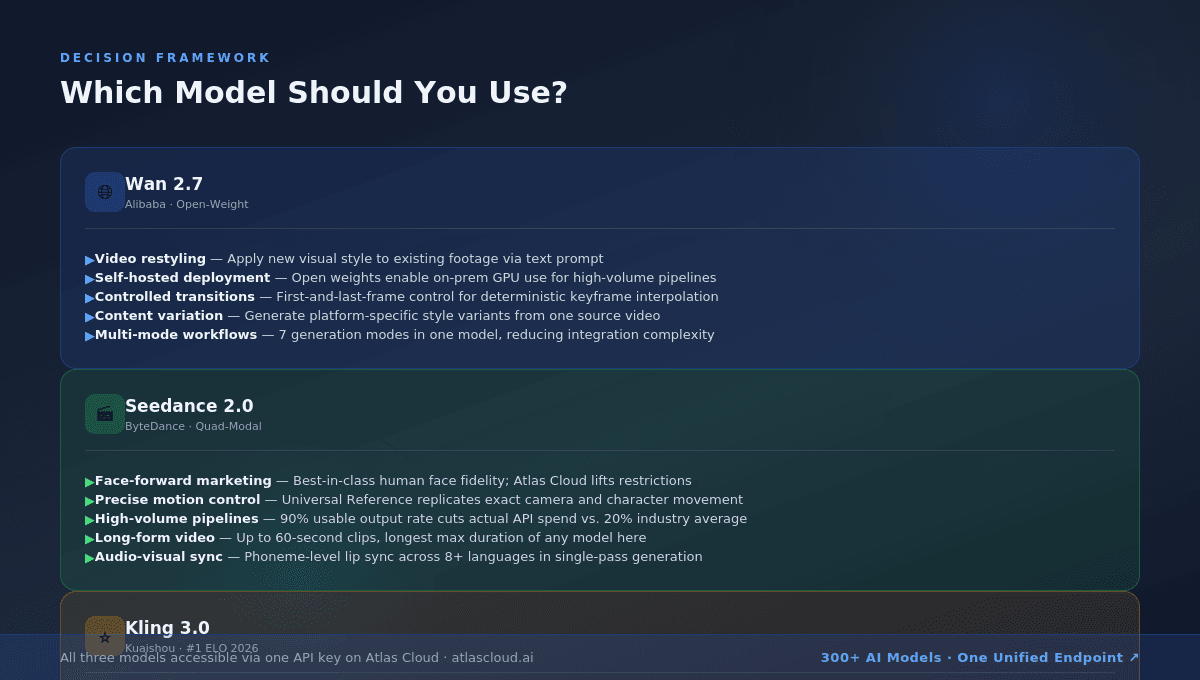

Marco de decisión: Qué modelo para cada caso de uso

Use Seedance 2.0 cuando:

**Esté creando contenido donde los rostros son protagonistas.** Campañas de marketing, videos de portavoces, secuencias de cabezas parlantes y contenido de comercio electrónico donde los rostros reales deban aparecer de forma consistente en los clips. La fidelidad facial de Seedance 2.0 y nuestro acceso sin censura a la generación de rostros humanos hacen de esta la elección más clara.

Su resumen creativo es específico. Cuando tiene un video de referencia que muestra exactamente cómo debe moverse el personaje, o una imagen de referencia que muestra exactamente cómo debe verse la escena, el sistema de Referencia Universal de Seedance 2.0 ofrece la réplica más fiel.

Su flujo de trabajo funciona a gran volumen. La tasa de salida utilizable del 90% y el precio del nivel Rápido de $0.081/s se combinan para reducir significativamente el costo real por clip utilizable en comparación con la competencia. Para flujos de trabajo que generan miles de clips al mes, esto se suma.

Necesita clips largos. La duración máxima de 60 segundos de Seedance 2.0 es la más larga disponible. Kling 3.0 y Wan 2.7 tienen un límite de 15 segundos.

Use Kling 3.0 cuando:

Esté creando contenido narrativo. Trailers, cortometrajes, contenido social serializado y secuencias de narración de marca donde la planificación automática de escenas del Director IA ahorra mucho trabajo manual.

La legibilidad del texto en video sea un requisito. Listados de productos de comercio electrónico, tarjetas de precios, logotipos de marca dentro de escenas generadas: el renderizado de texto de Kling 3.0 es el mejor en su clase.

Necesite transferencia de movimiento. Extraer el movimiento de metraje de referencia y aplicarlo a un sujeto diferente es la capacidad más distintiva de Kling 3.0. No existe una función comparable en los otros dos modelos.

La resolución máxima sea importante. Salida 4K para contenido de visualización grande o flujos de trabajo de post-producción que requieran margen para el escalado.

Use Wan 2.7 cuando:

Necesite cambiar el estilo de metraje existente. El modo de edición de video (transferencia de estilo desde video fuente mediante prompt de texto) aborda un flujo de trabajo que Seedance 2.0 y Kling 3.0 no cubren con tanta limpieza.

Su volumen sea lo suficientemente alto para justificar el auto-alojamiento. Como modelo de pesos abiertos, Wan 2.7 se puede desplegar en su propia infraestructura de GPU. Para equipos que generan miles de videos al mes, eliminar los costos de API por segundo hace que la economía sea drásticamente diferente.

Necesite múltiples modos de generación en un solo modelo. Siete modos distintos (texto a video, imagen a video, fotograma inicio-fin, continuación de video, edición de video, audio a video, referencia a video) desde un solo modelo reduce la complejidad de integración.

Esté realizando variación de contenido a escala. El modo de edición de video está diseñado específicamente para agencias que necesitan múltiples variantes visuales del mismo metraje fuente sin necesidad de volver a grabar.

Por qué elegir Atlas Cloud para los tres

Cada uno de estos modelos está disponible en la plataforma de su desarrollador. ¿Por qué usar Atlas Cloud en su lugar?

**Facturación unificada.** Gestionar tres claves API separadas, tres cuentas de facturación y tres conjuntos de documentación para Alibaba Cloud, BytePlus de ByteDance y la plataforma Kling de Kuaishou es una carga operativa que escala mal. Proporcionamos una única clave API, un único endpoint (`https://api.atlascloud.ai/v1`) y una única factura.

Mejores precios mediante enrutamiento inteligente. BytePlus factura Seedance 2.0 con un mínimo de 1 minuto, lo que significa que un clip de 5 segundos se factura como 60 segundos. Atlas Cloud utiliza facturación real por segundo. Para flujos de trabajo de contenido de formato corto, esta diferencia por sí sola cubre el costo del cambio.

**Sin lista de espera, sin tiempos de cola.** La plataforma nativa de Kling tiene tiempos de espera extendidos (a veces superando los 30 minutos) durante las horas pico. Nuestra infraestructura elimina el tiempo de espera para los tres modelos.

**Soporte real para rostros humanos en Seedance 2.0.** La plataforma Jimeng de ByteDance restringe la generación de rostros humanos realistas. Nuestra versión de Seedance 2.0 levanta esta restricción, haciéndolo utilizable para marketing y contenido comercial.

**Formato API compatible con OpenAI.** Si su base de código ya llama a GPT o cualquier endpoint compatible con OpenAI, cambiar a cualquier modelo en nuestra plataforma solo requiere cambiar la `base_url` y la `api_key`. Sin cambios en la biblioteca cliente, sin reescritura de esquemas.

Fiabilidad empresarial. Certificación SOC 2 Tipo II, cumplimiento con HIPAA, SLA de tiempo de actividad del 99.99%, controles de acceso RBAC y soberanía de datos en EE. UU. para equipos con requisitos de cumplimiento.

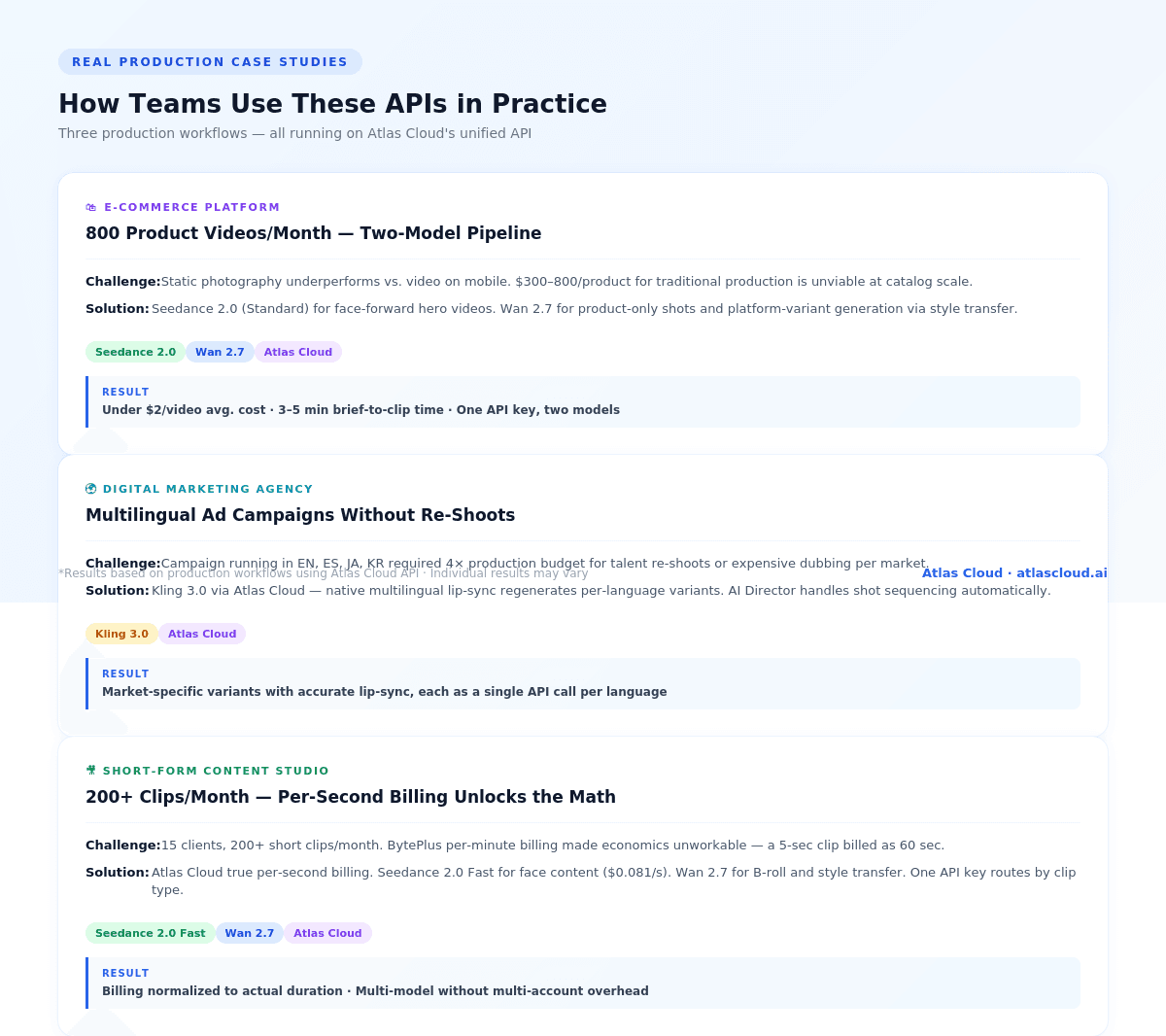

Casos de estudio de producción real

Caso de estudio 1: Plataforma de Comercio Electrónico — Video de producto a escala

Equipo: Una plataforma de comercio electrónico de moda que genera videos de estilo de vida de productos para más de 800 SKUs al mes.

Problema: La fotografía estática de productos estaba rindiendo menos que el video en plataformas móviles. La producción de video tradicional a $300–800 por producto era económicamente imposible a escala.

**Solución:** El equipo construyó un flujo de trabajo de dos modelos con nosotros. Seedance 2.0 (nivel Estándar) maneja videos de productos destacados (hero) —la fidelidad facial del modelo garantiza una apariencia consistente del modelo en todo el catálogo, y el sistema de Referencia Universal les permite mantener la misma estética de estudio alimentando un clip de referencia del estilo de iluminación y cámara deseado. Wan 2.7 maneja el trabajo de volumen —tomas solo de producto sin rostros, donde el menor costo por segundo y el modo de edición de video permiten variantes rápidas de estilo para diferentes plataformas (estilo de vida cálido para Instagram, blanco limpio para páginas de producto, animado para TikTok).

**Resultado:** 800 videos al mes a aproximadamente $0.081–$0.10/s para contenido hero y menor para variantes. Costo promedio por video: muy por debajo de $2. Tiempo desde el resumen hasta el clip final: 3–5 minutos. Accedieron a ambos modelos a través de una clave API sin trabajo de integración adicional.

Caso de estudio 2: Agencia de Marketing Digital — Campañas publicitarias multilingües

Equipo: Una agencia mediana que ejecuta campañas globales para marcas de consumo en América del Norte, Europa y el Sudeste Asiático.

Problema: Los anuncios de video localizados requieren re-grabaciones con talento o doblaje costoso para cada mercado. Una campaña en inglés, español, japonés y coreano requería 4 veces el presupuesto de producción solo para la localización de audio.

**Solución:** La agencia cambió a Kling 3.0 a través de nuestra plataforma por su sincronización labial multilingüe nativa. Un solo video generado con el personaje y la escena deseados podía ser regenerado con un prompt de audio en diferente idioma. La función Director IA maneja la secuenciación de tomas a nivel de escena, eliminando la necesidad de especificar manualmente cada ángulo de cámara. La sincronización labial a nivel de fonema en los cuatro idiomas objetivo significaba que las salidas no requerían revisión de doblaje en post-producción.

Resultado: Costo de localización reducido significativamente. La agencia ahora puede entregar variantes de video específicas para el mercado desde el mismo resumen creativo, cada una con sincronización labial precisa, a través de llamadas API únicas por variante.

Caso de estudio 3: Estudio de contenido de formato corto — Contenido social de alto volumen

Equipo: Un estudio de contenido que gestiona canales sociales para 15 clientes, produciendo más de 200 clips cortos al mes.

Problema: A ese volumen, la facturación por minuto de BytePlus era insostenible —un clip de 5 segundos facturado como 60 segundos hace que las matemáticas sean inviables. El equipo también necesitaba múltiples opciones de modelos dependiendo del tipo de clip.

**Solución:** Nuestra facturación por segundo y la API unificada resolvieron ambos problemas. El nivel Rápido de Seedance 2.0 maneja clips enfocados en rostros a $0.081/s. Wan 2.7 maneja B-roll y contenido de transferencia de estilo. La clave API única significa que su flujo de trabajo de generación se dirige al modelo apropiado según el tipo de clip sin manejo de autenticación por separado.

Resultado: Facturación normalizada a la duración real del video, no a intervalos mínimos. Acceso multimodelo sin gestión de múltiples cuentas.

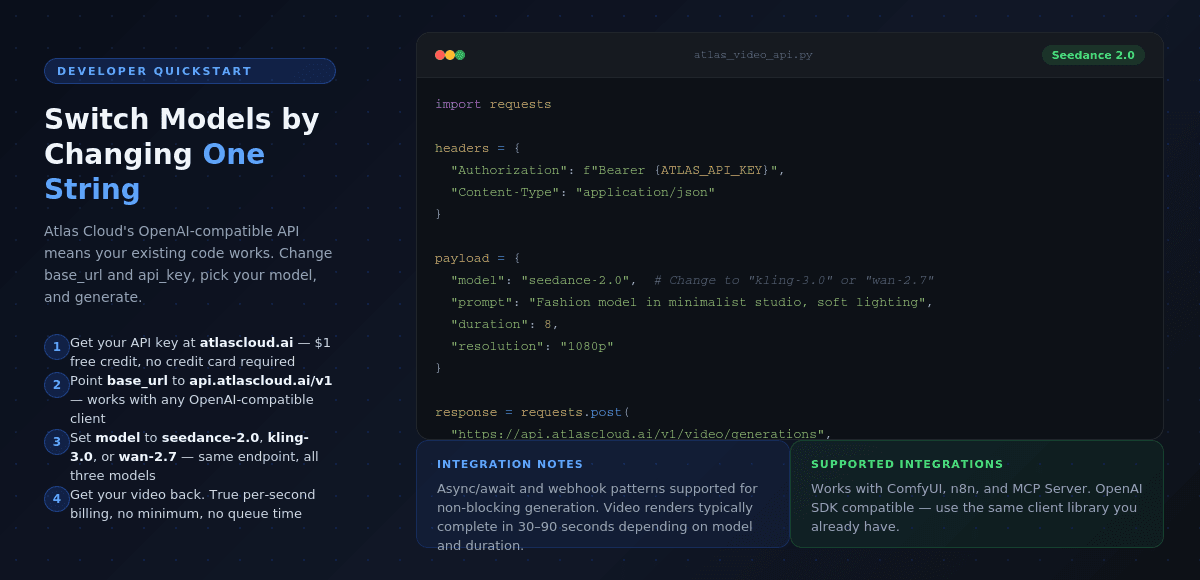

La ruta de integración del desarrollador

Los tres modelos son accesibles a través de nuestra API unificada, que es compatible con OpenAI. Aquí hay un ejemplo mínimo en Python para texto a video con Seedance 2.0:

plaintext1import os 2import requests 3 4headers = { 5 "Authorization": f"Bearer {os.environ['ATLAS_API_KEY']}", 6 "Content-Type": "application/json" 7} 8 9payload = { 10 "model": "seedance-2.0", 11 "prompt": "A fashion model walks through a minimalist studio, soft directional lighting, 9:16 vertical", 12 "duration": 8, 13 "resolution": "1080p" 14} 15 16response = requests.post( 17 "https://api.atlascloud.ai/v1/video/generations", 18 headers=headers, 19 json=payload 20) 21 22video_url = response.json()["data"]["url"]

Para cambiar a Kling 3.0, cambie

1model1"kling-3.0"1"wan-2.7"Preguntas frecuentes

P: ¿Qué modelo tiene la mejor calidad en general?

Kling 3.0 ostenta la puntuación de referencia ELO más alta a abril de 2026. Pero la puntuación de referencia y "mejor para mi caso de uso" son preguntas diferentes. Seedance 2.0 supera a Kling 3.0 en fidelidad facial y control de movimiento preciso. Wan 2.7 supera a ambos en edición de video y economía de pesos abiertos.

P: ¿Está disponible Seedance 2.0 sin las restricciones de contenido de la plataforma de ByteDance?

Sí. Nuestra versión de Seedance 2.0 admite la generación realista de rostros humanos sin las restricciones que se aplican en Jimeng (la propia plataforma de ByteDance). Esta es una de las razones clave por las que los desarrolladores nos eligen sobre el endpoint nativo.

P: ¿Puedo acceder a los tres modelos con una única clave API?

Sí. Proporcionamos una única clave API y un único endpoint para los más de 300 modelos en la plataforma, incluyendo Wan 2.7, Seedance 2.0 y Kling 3.0.

P: ¿Cómo se comparan los precios de Atlas Cloud con las plataformas nativas?

Para Seedance 2.0, nuestra facturación por segundo es de 6 a 12 veces más barata que la facturación por minuto de BytePlus para contenido de formato corto. Para Kling 3.0, eliminamos los tiempos de cola y la fricción de suscripción. Los precios actuales están disponibles en atlascloud.ai/pricing.

P: ¿Las generaciones fallidas cuestan dinero en Atlas Cloud?

No cobramos por generaciones fallidas, a diferencia de la plataforma nativa de Kling.

P: ¿Qué pasa si necesito Wan 2.7 para despliegue auto-alojado?

Como modelo de pesos abiertos, Wan 2.7 puede ser desplegado en su propia infraestructura de GPU. También ofrecemos acceso a nube GPU si necesita auto-alojamiento gestionado sin la dependencia de Alibaba Cloud.

Tabla de decisión resumida

| Si necesita... | Use |

| Mejor fidelidad facial | Seedance 2.0 |

| Movimiento preciso desde referencia | Seedance 2.0 |

| Mayor duración de clip (hasta 60s) | Seedance 2.0 |

| Mayor volumen, menor costo por clip utiliz. | Seedance 2.0 Fast |

| Narrativa cinematográfica y planif. escena | Kling 3.0 |

| Transferencia de mov. desde metraje ref. | Kling 3.0 |

| Legibilidad de texto dentro de video | Kling 3.0 |

| Salida 4K nativa | Kling 3.0 |

| Edición de video / transferencia de estilo | Wan 2.7 |

| Opción de auto-alojamiento de pesos abiertos | Wan 2.7 |

| Múltiples modos de gen., un solo modelo | Wan 2.7 |

| Los tres modelos, una sola clave API | Atlas Cloud |

Acceda a Wan 2.7, Seedance 2.0 y Kling 3.0 a través de una API unificada en atlascloud.ai. Primer depósito: 20% de bonificación (hasta $100). Además, obtenga recompensas al referir amigos. Sin lista de espera, acceso instantáneo.

La información de precios en este artículo refleja las tarifas a partir de abril de 2026 y está sujeta a cambios. Verifique siempre los precios actuales en atlascloud.ai/pricing antes de construir canales de producción.