Together AI couvre une large gamme de LLM open-source, d'inférence serverless et de location de GPU sur une seule plateforme. Pour de nombreux développeurs, c'est un point de départ solide. Cependant, deux lacunes apparaissent rapidement à l'échelle de la production : un modèle de facturation par vidéo qui devient coûteux pour des durées de génération classiques, et l'absence de certifications de conformité publiées pour les équipes dans des secteurs réglementés. Ce guide compare Together AI et Atlas Cloud en utilisant uniquement des tarifs vérifiés en mai 2026, afin que vous puissiez prendre une décision basée sur des données pour votre stack. Pour un contexte plus large, consultez le comparatif complet des meilleures alternatives d'API d'inférence IA en 2026.

Qu'est-ce que Together AI et qui l'utilise ?

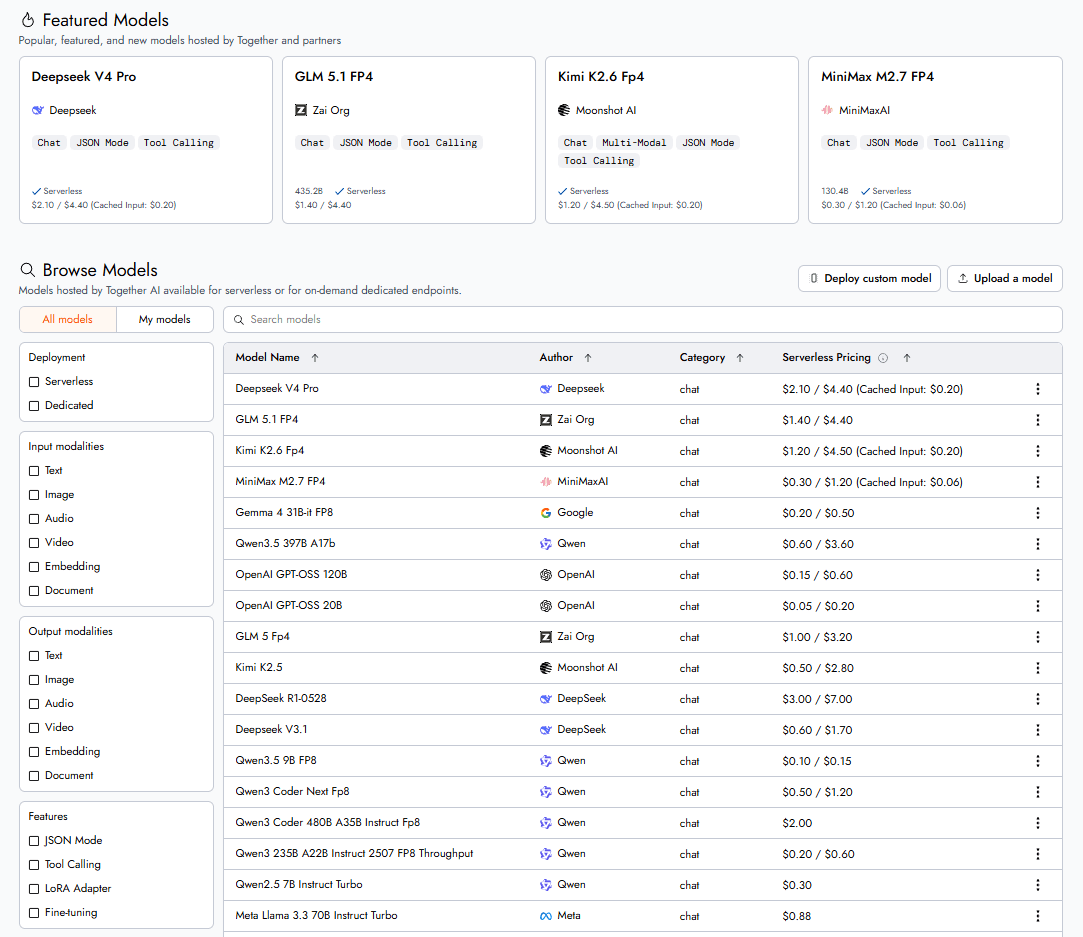

Together AI est une plateforme d'inférence LLM serverless, un cloud GPU et un service de fine-tuning. Selon les tarifs publiés par Together AI (mai 2026), le catalogue couvre les principaux modèles à poids ouverts, notamment Llama 3.3 70B à $0,88/M de tokens, DeepSeek R1-0528 à $3,00/M d'entrées, et des modèles compacts ultra-économiques comme LFM2 24B à $0,03/M d'entrées. Des instances GPU dédiées, l'inférence par lots et des endpoints en temps réel sont tous accessibles depuis le même compte.

Trois groupes utilisent Together AI le plus fréquemment. Premièrement, les équipes ML qui ont besoin d'une infrastructure de fine-tuning sans gérer leur propre cluster GPU. Together AI propose un fine-tuning supervisé pour les modèles allant jusqu'à 100B de paramètres, avec une tarification de $0,48/M de tokens pour les modèles jusqu'à 16B et $2,90/M pour les modèles de 70B à 100B. Deuxièmement, les chercheurs et les startups qui souhaitent un accès large aux LLM open-source avec une structure de paiement à l'usage. Troisièmement, les équipes ayant besoin d'instances GPU H100, H200 ou B200 dédiées pour des charges de travail d'inférence personnalisées.

Together AI prend également en charge la génération d'images et de vidéos. Les modèles d'image sont facturés au mégapixel (MP) : FLUX.1 [schnell] à $0,0027/MP et Stable Diffusion 3 à $0,0019/MP — à la résolution standard 1024×1024 (≈1 MP), cela correspond respectivement à environ $0,003 et $0,002 par image. Les modèles vidéo, notamment Google Veo 3.0, Sora 2, Kling 2.1 Master, Wan 2.7, Vidu, PixVerse, Seedance et plus de 30 autres sont disponibles. Le modèle de facturation pour chaque vidéo est un tarif forfaitaire par vidéo, indépendamment de la longueur de la sortie.

Together AI vs Atlas Cloud : Comparaison directe

Le tableau ci-dessous utilise uniquement les tarifs vérifiés provenant des pages officielles en mai 2026. La tarification vidéo nécessite une précision : Together AI facture par vidéo (forfait), tandis qu'Atlas Cloud facture par seconde de sortie. Les deux chiffres sont indiqués pour un clip de 5 secondes afin de permettre une comparaison directe.

| Fonctionnalité | Together AI | Atlas Cloud |

|---|---|---|

| LLM : DeepSeek V4 Pro (entrée/sortie par 1M) | $2,10 / $4,40 | $1,68 / $3,38 |

| LLM : modèle le moins cher (entrée par 1M) | $0,03 (LFM2 24B) | $0,14 (DeepSeek V4 Flash) |

| LLM : Kimi K2.6 (entrée/sortie par 1M) | $1,20 / $4,50 | $0,95 / $4,00 |

| LLM : MiniMax M2.7 (entrée/sortie par 1M) | $0,30 / $1,20 | $0,30 / $1,20 |

| Image : moins cher par image | $0,0019/MP (SD3, ≈$0,002 à 1024px) | $0,004 (GPT Image-1 Mini) |

| Modèle de facturation vidéo | Par vidéo (forfait) | Par seconde de sortie |

| Vidéo : génération Veo, 5 secondes | $1,60 (Veo 3.0, forfait) | $0,25 (Veo 3.1 Lite à $0,05/sec) |

| Fine-tuning | Oui (jusqu'à 100B params) | Non listé |

| Location de GPU | Oui (H100, H200, B200) | Non listé |

| Conformité | Non publiée | SOC I & II, HIPAA |

| Régions de déploiement | Non publiées | 12 régions mondiales |

| Intégration serveur MCP | Non listé | Oui |

| Format endpoint LLM | Compatible OpenAI | Compatible OpenAI (changement de base URL uniquement) |

| SLA publié | Non publié | Non publié |

| Total modèles | 200+ | 300+ |

Atlas Cloud est gratuit pour commencer sans carte de crédit requise. Créez un compte gratuit sur Atlas Cloud et effectuez votre premier appel API en moins de 10 minutes.

Comment comparer réellement les prix ?

Les comparaisons tarifaires entre les plateformes d'inférence sont souvent trompeuses car elles sélectionnent les modèles où la plateforme est la plus avantageuse. La section ci-dessous compare les mêmes modèles sur les deux plateformes, en utilisant uniquement les chiffres vérifiés fournis ci-dessus.

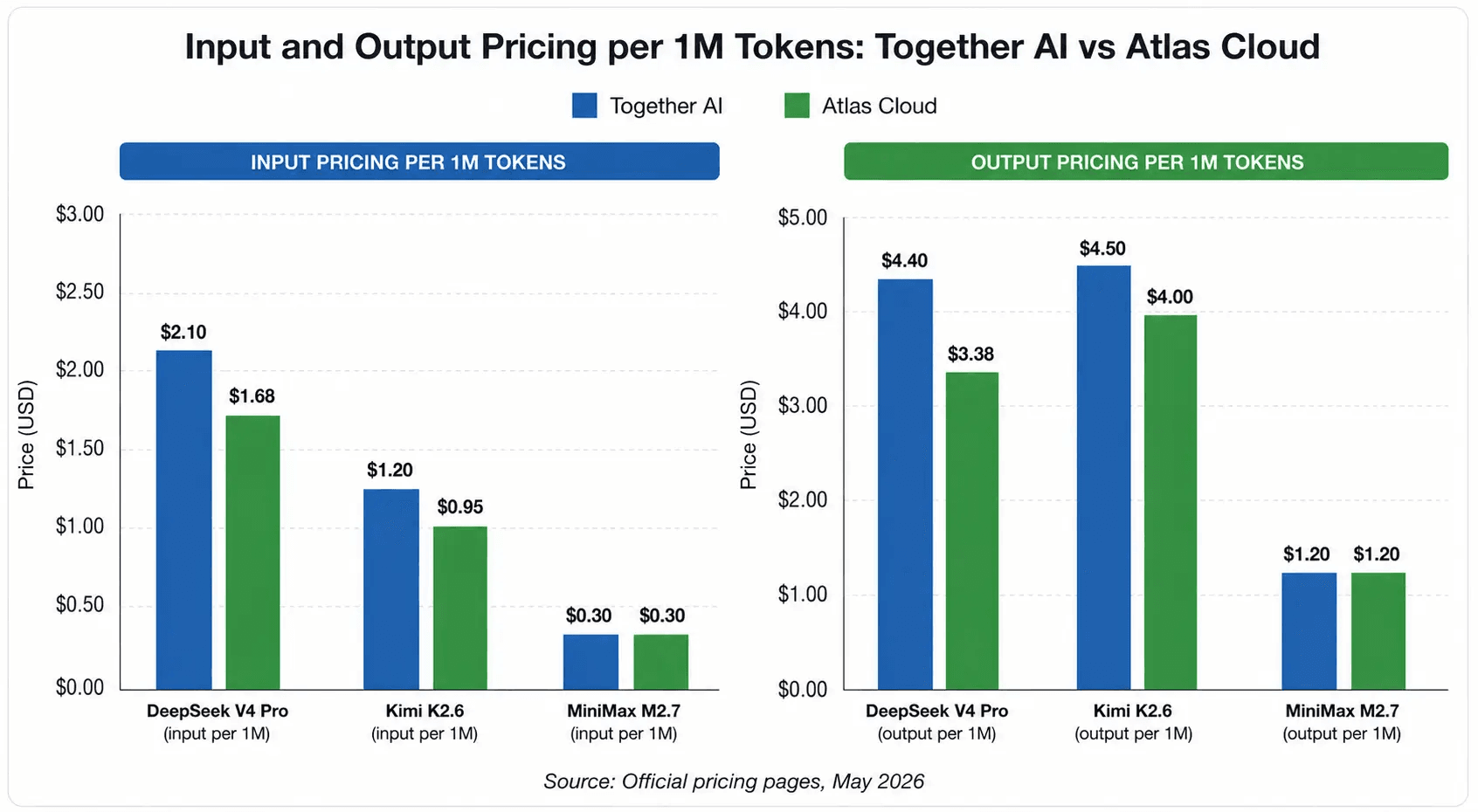

Tarification LLM

Pour les modèles frontières de grande taille, Atlas Cloud est systématiquement moins cher. DeepSeek V4 Pro coûte $1,68/M d'entrées sur Atlas Cloud contre $2,10/M sur Together AI, soit une économie de 20 % sur les tokens d'entrée et de 23 % sur la sortie. Kimi K2.6 suit le même modèle : $0,95/M d'entrées sur Atlas Cloud contre $1,20/M sur Together AI. MiniMax M2.7 est le seul modèle où la tarification est identique à $0,30/M d'entrées et $1,20/M de sortie sur les deux plateformes.

La situation s'inverse pour les petits modèles. Le LFM2 24B A2B de Together AI fonctionne à $0,03/M d'entrées, bien en dessous de l'option la moins chère d'Atlas Cloud à $0,14/M pour DeepSeek V4 Flash. Si votre charge de travail repose principalement sur des modèles compacts, le catalogue de petits modèles de Together AI offre un réel avantage en termes de coûts. Atlas Cloud propose également OWL gratuitement, ce qui est utile pour les tâches légères où chaque centime compte.

Tarification Vidéo

C'est ici que le modèle de facturation importe plus que le tarif annoncé. Together AI facture un forfait par vidéo. Atlas Cloud facture par seconde de sortie. La différence devient significative selon les durées habituelles de génération vidéo.

Pour un clip de 5 secondes, la comparaison est la suivante : le Veo 3.0 de Together AI coûte $1,60 quelle que soit la durée. Le Veo 3.1 Lite d'Atlas Cloud coûte $0,05/sec, ce qui signifie que 5 secondes coûtent $0,25. C'est une différence de 6x pour la même sortie approximative. À 10 secondes, l'écart se creuse davantage : le Veo 3.1 Lite d'Atlas Cloud coûte $0,50, tandis que le forfait de Together AI reste à $1,60.

Le modèle par vidéo de Together AI avantage les équipes générant systématiquement des clips très courts, et son Sora 2 à $0,80/vidéo est compétitif pour des sorties de moins de 3 secondes. Mais pour toute durée égale ou supérieure à 5 secondes, la facturation à la seconde génère des coûts nettement inférieurs.

Le catalogue vidéo d'Atlas Cloud couvre plus de 10 familles de modèles allant de $0,02/sec (Wan 2.2 Turbo) à $0,20/sec (Veo 3.1), toutes facturées à la seconde, offrant aux équipes un contrôle granulaire sur les compromis qualité/coût par génération. Vous pouvez lire comment un modèle de facturation similaire fonctionne sur une autre plateforme dans le comparatif des alternatives à Replicate.

Pour 1 000 vidéos de cinq secondes par mois, les chiffres sont les suivants : Together AI à $1,60/vidéo coûte $1 600. Atlas Cloud à $0,05/sec coûte $250. C'est une économie de $1 350 par mois, soit $16 200 par an, avant même de prendre en compte l'augmentation du volume de génération.

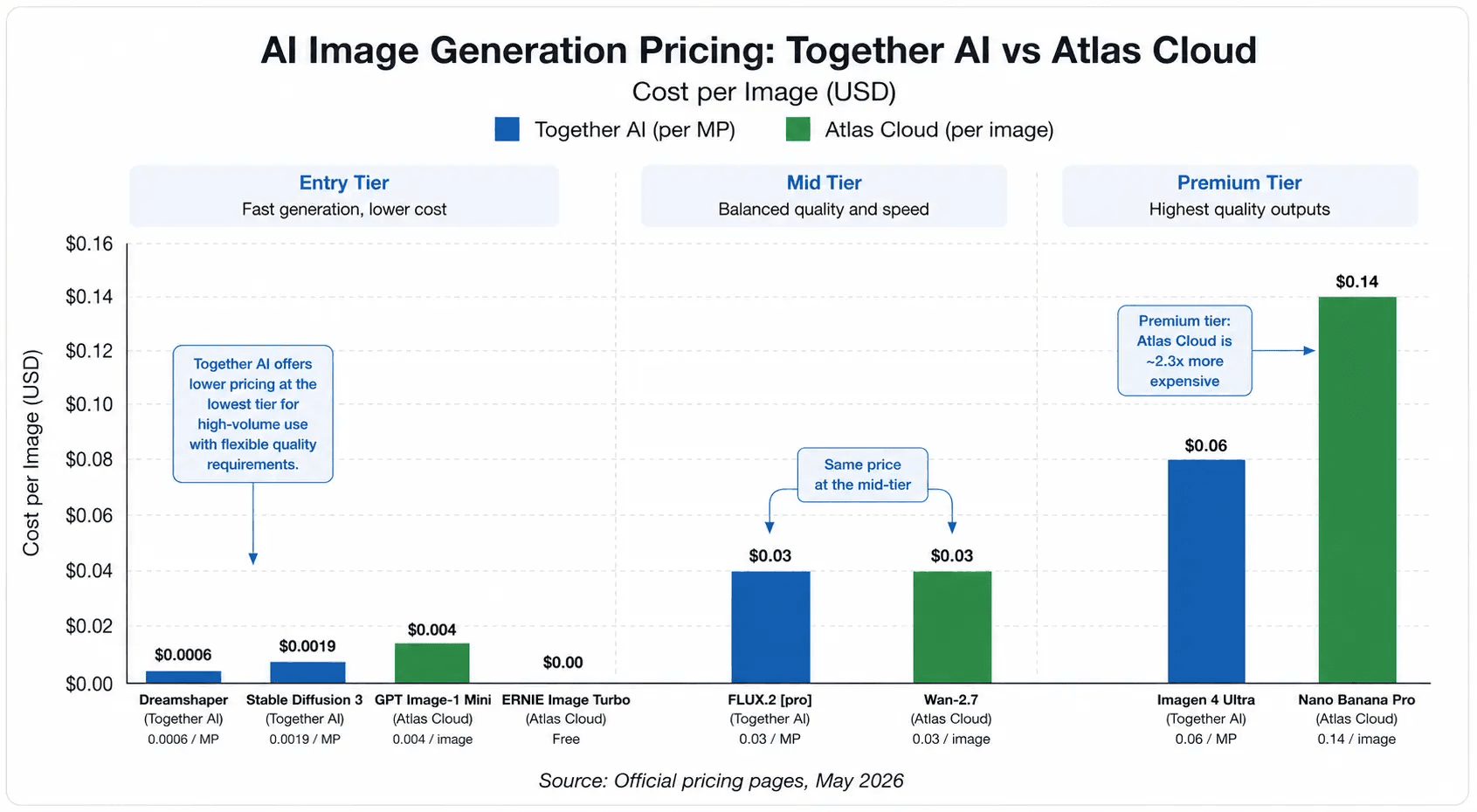

Tarification Image

La tarification des images est proche entre les deux plateformes. L'option payante la moins chère de Together AI est Stable Diffusion 3 à $0,0019/MP (environ $0,002 à 1024×1024), avec des modèles encore moins chers comme Dreamshaper à $0,0006/MP. Le modèle payant le moins cher d'Atlas Cloud est GPT Image-1 Mini à $0,004/image, avec Baidu ERNIE Image Turbo disponible gratuitement. Pour une génération d'images à très haut volume où les exigences de qualité de sortie sont flexibles, le niveau le plus bas de Together AI a un avantage de coût.

Au niveau intermédiaire, FLUX.2 [pro] sur Together AI coûte $0,03/MP, le même tarif que Wan-2.7 sur Atlas Cloud à $0,03/image. Pour des sorties de meilleure qualité, Imagen 4 Ultra sur Together AI coûte $0,06/MP contre $0,14/image pour le Nano Banana Pro d'Atlas Cloud — des familles de modèles différentes avec des caractéristiques de sortie différentes, mais ciblant toutes deux le créneau de la génération d'images premium.

Ce qu'Atlas Cloud propose que Together AI n'a pas

Plusieurs capacités d'Atlas Cloud n'ont pas d'équivalent direct sur Together AI, et elles sont importantes pour des catégories spécifiques de charges de travail en production.

Conformité SOC I & II et HIPAA. Atlas Cloud détient les certifications SOC I & II et est conforme à la norme HIPAA. Together AI ne liste aucune certification de conformité sur ses pages officielles. Pour les équipes travaillant dans la santé, la fintech ou tout secteur réglementé où la résidence des données et les pistes d'audit sont des exigences, il s'agit d'un filtre éliminatoire. Une plateforme sans posture de conformité publiée ne peut pas passer les examens de sécurité des organisations d'entreprise avec des processus d'achat standards.

12 régions de déploiement mondiales. Atlas Cloud déploie sur 12 régions, ce qui est crucial pour les applications sensibles à la latence et pour les exigences de résidence des données imposées par le RGPD ou les lois régionales sur les données. Together AI ne publie pas le nombre de ses régions de déploiement.

Facturation vidéo à la seconde. Comme indiqué ci-dessus, la facturation à la seconde génère des coûts nettement inférieurs pour les longueurs de génération de vidéo classiques. Il ne s'agit pas d'une différence mineure sur une ligne de facture. À l'échelle, cela se traduit par un écart budgétaire significatif.

Intégration serveur MCP. Atlas Cloud prend en charge le Model Context Protocol (MCP), de plus en plus important pour les charges de travail d'agents où les modèles doivent appeler des outils, récupérer du contexte externe ou enchaîner des étapes d'inférence. Together AI ne liste pas la prise en charge de MCP sur ses pages officielles.

Profondeur du modèle vidéo. Atlas Cloud propose plus de 10 familles de modèles vidéo facturées à la seconde — de $0,02/sec (Wan 2.2 Turbo) à $0,20/sec (Veo 3.1) — offrant aux équipes un contrôle granulaire sur les compromis qualité/coût pour chaque génération. Together AI propose également un catalogue vidéo étendu avec plus de 30 modèles, dont Veo 3.0, Sora 2, Kling 2.1 Master, Wan 2.7, Vidu, PixVerse, Seedance et d'autres — mais chaque modèle utilise une facturation forfaitaire par vidéo, quelle que soit la longueur de la sortie. Découvrez comment cela se compare avec une autre plateforme dans le comparatif des alternatives à Fireworks AI.

Comment démarrer avec Atlas Cloud

Passer de zéro à un appel API fonctionnel prend moins de 10 minutes.

Étape 1 : Créez un compte gratuit. Inscrivez-vous sur atlascloud.ai. Aucune carte de crédit requise pour commencer.

Étape 2 : Obtenez votre clé API. Votre clé est immédiatement disponible dans le tableau de bord après l'inscription.

Étape 3 : Appelez un LLM. L'endpoint LLM d'Atlas Cloud suit le format OpenAI Chat Completions. Modifiez l'URL de base et la clé API dans votre code existant :

plaintext1from openai import OpenAI 2 3client = OpenAI( 4 base_url="https://api.atlascloud.ai/v1", 5 api_key="YOUR_ATLAS_CLOUD_KEY" 6) 7 8response = client.chat.completions.create( 9 model="deepseek-v4-flash", 10 messages=[{"role": "user", "content": "Hello"}] 11)

Étape 4 : Générez une image. La génération d'images utilise directement l'API REST d'Atlas Cloud :

plaintext1import requests 2 3response = requests.post( 4 "https://api.atlascloud.ai/api/v1/model/generateImage", 5 headers={"Authorization": "Bearer YOUR_ATLAS_CLOUD_KEY"}, 6 json={"model": "gpt-image-2", "prompt": "A developer at a desk with multiple monitors"} 7)

Étape 5 : Parcourez le catalogue de modèles. Visitez atlascloud.ai/pricing/models pour découvrir chaque modèle disponible avec sa tarification à l'unité actuelle pour le LLM, l'image, la vidéo et l'audio.

Quand Together AI est-il plus judicieux ?

Il existe des cas d'usage où Together AI est un choix plus pertinent, et il est important d'être transparent à ce sujet.

Le fine-tuning est une exigence fondamentale. Together AI propose un pipeline de fine-tuning supervisé géré jusqu'à 100B de paramètres, à $0,48/M de tokens pour les modèles jusqu'à 16B et $2,90/M pour les modèles de 70B à 100B. Il s'agit d'une capacité significative qu'Atlas Cloud ne liste pas actuellement. Les équipes ayant besoin d'entraîner des points de contrôle de modèles personnalisés sur des données propriétaires, sans gérer leur propre cluster GPU, trouveront le pipeline de Together AI réellement utile.

Location de GPU pour l'inférence personnalisée. Together AI propose des H100 80GB dédiés à $3,99/heure, des H200 141GB à $5,49/heure et des B200 180GB à $9,95/heure. Si votre équipe a besoin d'un accès direct aux GPU pour des charges de travail personnalisées, le service de modèles ou du calcul autre que l'inférence, Together AI fournit cette infrastructure. Atlas Cloud ne propose pas actuellement de location de GPU.

Inférence très bon marché pour les petits modèles. LFM2 24B A2B à $0,03/M d'entrées et gpt-oss-120B à $0,15/M font partie des prix les plus bas disponibles pour leurs classes de modèles. Si votre charge de travail repose entièrement sur des modèles compacts et que le volume est élevé, la tarification des petits modèles de Together AI est difficile à battre. Le modèle OWL d'Atlas Cloud est gratuit, mais spécifiquement pour les modèles de la catégorie LFM2, Together AI conserve l'avantage tarifaire.

Génération d'images à très haut volume avec des exigences de qualité moindres. Dreamshaper à $0,0006/MP et Stable Diffusion 3 à $0,0019/MP de Together AI sont moins chers que le modèle d'image payant le plus bas d'Atlas Cloud (GPT Image-1 Mini à $0,004). Si le débit brut à coût minimal est la priorité et que la qualité de sortie est secondaire, le catalogue d'images d'entrée de gamme de Together AI l'emporte.

FAQ

Atlas Cloud est-il moins cher que Together AI pour l'inférence LLM ?

Cela dépend du modèle. Atlas Cloud est moins cher pour les grands modèles frontières : DeepSeek V4 Pro coûte $1,68/M d'entrées sur Atlas Cloud contre $2,10/M sur Together AI, soit une différence de 20 %. Pour les petits modèles, Together AI est en tête, avec LFM2 24B à $0,03/M d'entrées contre un plancher de $0,14/M chez Atlas Cloud pour DeepSeek V4 Flash.

Comment comparer la tarification vidéo entre Together AI et Atlas Cloud ?

Together AI facture un tarif forfaitaire par vidéo : Veo 3.0 est à $1,60/vidéo quelle que soit la durée. Atlas Cloud facture par seconde de sortie : Veo 3.1 Lite est à $0,05/sec, donc un clip de 5 secondes coûte $0,25. C'est une différence de 6x pour le même clip approximatif. La facturation à la seconde avantage Atlas Cloud pour toute durée de génération supérieure à environ 3 secondes.

Atlas Cloud prend-il en charge le fine-tuning comme Together AI ?

Atlas Cloud ne liste pas actuellement le fine-tuning sur ses pages officielles. Together AI propose un pipeline de fine-tuning supervisé géré couvrant des modèles jusqu'à 100B de paramètres, à $0,48/M de tokens pour les modèles jusqu'à 16B et $2,90/M pour les modèles de 70B à 100B. Si le fine-tuning personnalisé est une exigence majeure pour votre équipe, Together AI est l'option la plus robuste pour ce workflow spécifique.

Quelle plateforme dois-je utiliser pour les secteurs réglementés comme la santé ou la finance ?

Atlas Cloud détient les certifications SOC I & II et est conforme à la norme HIPAA, selon la documentation publiée de la plateforme. Together AI ne liste pas de certifications de conformité sur ses pages officielles. Pour les équipes soumises à la norme HIPAA, aux exigences d'audit SOC 2 ou aux achats d'entreprise nécessitant une posture de conformité documentée, Atlas Cloud est la seule plateforme des deux possédant des certifications publiées.

Conclusion

Together AI et Atlas Cloud servent des audiences qui se chevauchent mais restent distinctes. Together AI est le plus performant pour les équipes qui ont besoin de location de GPU, de fine-tuning géré ou d'une inférence très peu coûteuse pour les petits modèles. Il s'agit de capacités réelles qui n'ont pas d'équivalent actuel sur Atlas Cloud.

Pour les équipes axées sur l'inférence de production multi-modale, le calcul est différent. Atlas Cloud est moins cher sur les grands LLM frontières, nettement moins cher sur la vidéo pour les durées de génération habituelles, et est la seule plateforme des deux à disposer de certifications de conformité publiées. Les 12 régions de déploiement mondiales et la prise en charge du serveur MCP sont importantes pour les charges de travail d'entreprise et d'agents.

Aucune des deux plateformes ne publie de SLA de disponibilité. Il est utile d'en tenir compte dans votre décision d'infrastructure, parallèlement à la tarification.

Le moyen le plus rapide de savoir si les chiffres correspondent à votre stack est de les tester. Atlas Cloud est gratuit pour commencer, aucune carte de crédit n'est requise, et vous pouvez effectuer votre premier appel API en moins de 10 minutes. Créez votre compte Atlas Cloud gratuit et comparez-le directement avec vos coûts Together AI actuels.

Si votre évaluation couvre davantage de plateformes, le comparatif complet des API d'inférence IA pour 2026 couvre Atlas Cloud, Together AI, Fireworks AI, Replicate, DeepInfra et d'autres, en adoptant la même approche basée sur des données vérifiées que cet article.