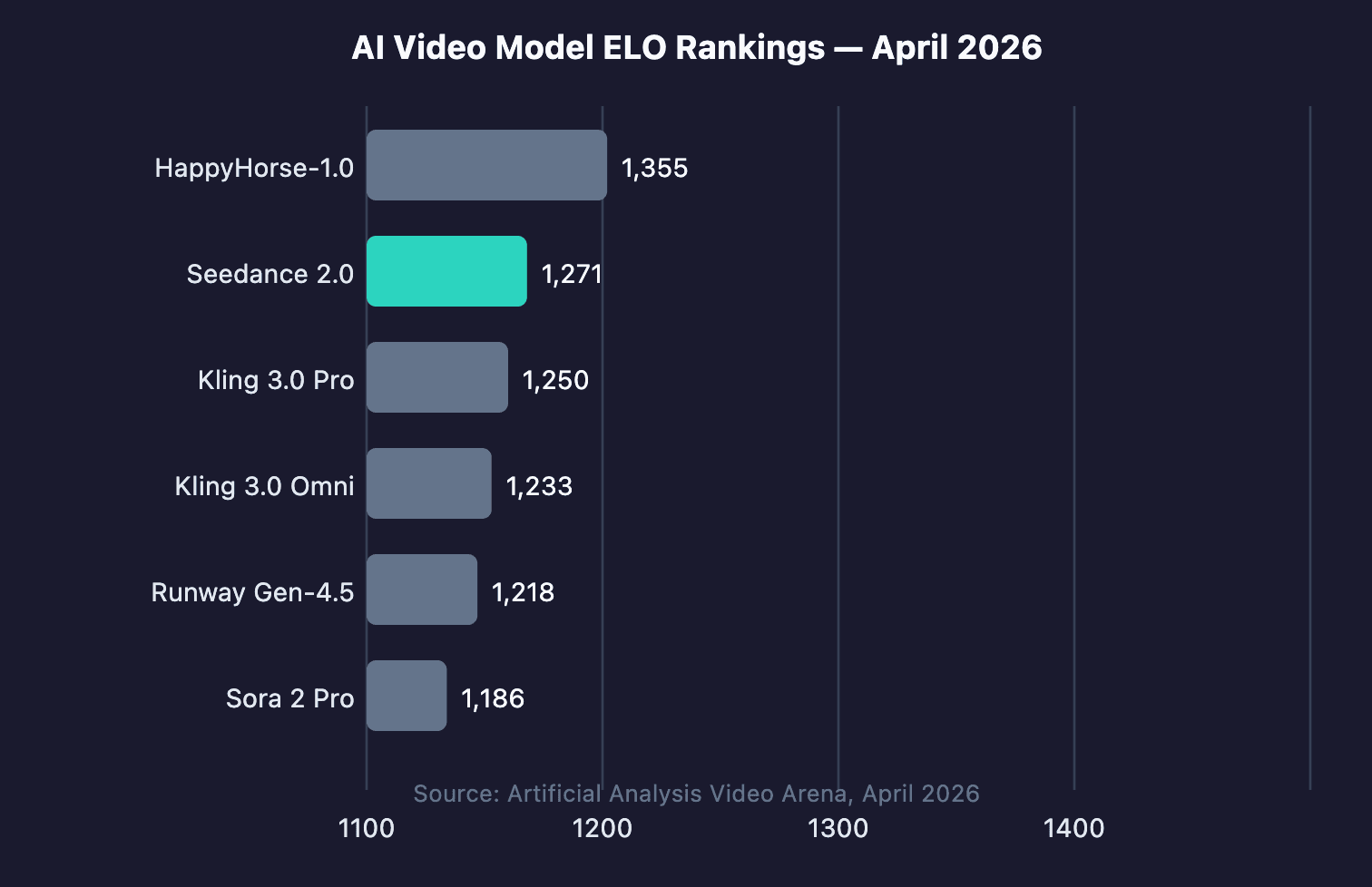

Si vous recherchez un guide clair et pratique sur comment utiliser Seedance 2.0, vous êtes au bon endroit. Auparavant, la production d'une vidéo marketing de 60 secondes prenait 13 jours. Avec des outils vidéo basés sur l'IA comme Seedance 2.0, le même travail ne prend plus que 27 minutes, soit une réduction de 99,7 % du temps de production (Zebracat via AutoFaceless, 2026). ByteDance a lancé Seedance 2.0 le 12 février 2026, et il se classe actuellement 2e au niveau mondial sur l'Artificial Analysis Video Arena avec un ELO de 1 271.

Ce guide couvre toutes les principales méthodes d'accès pour utiliser Seedance 2.0 aux États-Unis, en Inde ou dans tout autre pays en dehors de la Chine.

Points clés à retenir

- Seedance 2.0 est disponible mondialement via Dreamina et CapCut. Aucun VPN ni numéro de téléphone chinois n'est requis.

- L'offre gratuite sur Dreamina permet d'obtenir 225 jetons quotidiens (avec filigrane). Les plans payants débutent à 18 USD/mois.

- Pour les développeurs aux États-Unis et à l'international, Atlas Cloud offre l'accès API le plus abordable à USD 0.081/sec.

- Le modèle accepte du texte, des images, de l'audio et de la vidéo en un seul passage multimodal grâce à la syntaxe @AssetName.

- 91 % des entreprises utilisent le marketing vidéo en 2026 (Wyzowl via Ngram, 2026). La production par IA réduit les coûts jusqu'à 91 % par rapport à la vidéo traditionnelle.

Comment utiliser Seedance 2.0 gratuitement - Tutoriels étape par étape

Savoir comment utiliser Seedance 2.0 gratuitement est la première question que posent la plupart des utilisateurs. Dreamina propose 225 jetons partagés par jour sans frais, ce qui suffit pour générer environ 10 à 15 clips courts par jour.

Option gratuite 1 : Dreamina (Recommandée)

Étape 1 : Rendez-vous sur dreamina.capcut.com depuis n'importe quel navigateur. Aucun téléchargement n'est requis. La plateforme est disponible dans le monde entier. Inscrivez-vous gratuitement avec votre compte Google, Apple ID ou adresse e-mail. Aucune carte bancaire n'est nécessaire.

Étape 2 : Cliquez sur "Create" (Créer) dans la barre latérale gauche pour ouvrir le panneau de génération vidéo. Sélectionnez Seedance 2.0 dans le menu déroulant des modèles en haut du panneau. Vous verrez des variantes Standard et Fast.

Étape 3 : Rédigez votre prompt en utilisant la formule en cinq parties : Sujet + Action + Décor + Ambiance + Mouvement de caméra. Exemple : "Une tasse de café en céramique sur une table en bois, vapeur s'élevant, lumière de cuisine chaude, lent mouvement de caméra vers l'avant (dolly push)." Définissez la durée (4–8 secondes recommandées pour l'offre gratuite) et le rapport hauteur/largeur (16:9 pour le format large, 9:16 pour les réseaux sociaux verticaux).

Étape 4 : Cliquez sur "Generate" (Générer). Chaque clip utilise environ 15–20 jetons. Vos 225 jetons quotidiens se renouvellent toutes les 24 heures. Téléchargez votre vidéo. Les sorties de l'offre gratuite incluent un filigrane. Passez au plan Standard à 18 USD/mois pour le supprimer.

Option gratuite 2 : Application CapCut

CapCut partage un pool de jetons avec Dreamina sur le même compte ByteDance. Téléchargez CapCut depuis l'App Store ou le Play Store, connectez-vous avec le même compte et appuyez sur "AI Video" pour accéder à Seedance 2.0. Les jetons sont partagés : les dépenser dans CapCut réduit votre solde Dreamina et inversement.

API Seedance 2.0 pour les développeurs

Pour les développeurs et les entreprises, le passage par l'API via Atlas Cloud est le chemin d'intégration le plus rapide et le plus rentable.

Atlas Cloud est une plateforme d'agrégation d'API d'IA qui offre aux développeurs et aux entreprises un accès unifié à plus de 300 modèles d'IA, y compris les six variantes de Seedance 2.0. Tout fonctionne via une seule clé API, un tableau de bord de facturation unique et une seule URL de base. C'est le moyen le plus rapide d'intégrer Seedance 2.0 dans n'importe quelle application, pipeline ou produit sans avoir à gérer les contrats d'entreprise directs de ByteDance.

Fonctionnalités clés d'Atlas Cloud

- 300+ modèles d'IA (vidéo, image, LLM, audio) via une seule clé API

- Les 6 variantes de Seedance 2.0 : texte-vers-vidéo, image-vers-vidéo, référence-vers-vidéo (Standard & Fast)

- Seedance 2.0 Fast à USD 0.081/sec. Le coût le plus bas parmi les grandes plateformes

- Points de terminaison compatibles avec le SDK OpenAI (remplacement transparent)

- Paiement à l'usage, aucun abonnement mensuel

- SLA de disponibilité de 99,9 % avec conformité aux données internationales

- Intégration du serveur MCP pour plus de 100 clients IDE

- Accepte carte bancaire, PayPal, cryptomonnaies, WeChat Pay, Alipay

Méthode 1 : Utilisation directe dans le Playground d'Atlas Cloud

Aucun code n'est nécessaire. Rendez-vous sur atlascloud.ai, inscrivez-vous, accédez à la page des modèles, trouvez Seedance 2.0 et cliquez sur "Try in Playground". Saisissez votre prompt, choisissez vos réglages et générez directement dans le navigateur. C'est le moyen le plus rapide de valider une idée avant de configurer l'API.

Méthode 2 : Accès via API

Étape 1 : Obtenez votre clé API

Rendez-vous sur atlascloud.ai/console/api-keys. Cliquez sur Create API Key, donnez-lui un nom et copiez-la immédiatement — elle ne sera affichée qu'une seule fois. Définissez-la dans votre environnement sous le nom ATLASCLOUD_API_KEY.

Étape 2 : Consultez la documentation de l'API

La référence complète se trouve sur atlascloud.ai/docs. Vous y trouverez chaque paramètre, tous les ID de modèles, le point de terminaison de téléchargement pour les fichiers de référence et le cycle de vie du sondage (polling). Une lecture de 5 minutes est recommandée avant de commencer.

Étape 3 : Effectuez votre première requête

Le flux est toujours le même : soumettre un travail de génération → obtenir un ID de prédiction → interroger (poll) jusqu'à ce que ce soit terminé → récupérer l'URL de la vidéo. Voici un exemple en Python pour vous aider à démarrer :

python1import requests 2import time 3 4# Étape 1 : Lancer la génération vidéo 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/text-to-video", 12 "prompt": "Une vue cinématographique de l'océan infini au lever du soleil, lumière dorée s'étendant sur la mer bleu profond, vagues puissantes se levant et s'écrasant avec de l'écume blanche. La caméra survole la surface de l'eau, gouttelettes et brume scintillant dans la lumière. Ambiance cinématographique épique, 4K.", 13 "duration": 5, 14 "resolution": "720p", 15 "ratio": "adaptive", 16 "generate_audio": True, 17 "watermark": False, 18} 19 20generate_response = requests.post(generate_url, headers=headers, json=data) 21prediction_id = generate_response.json()["data"]["id"] 22 23# Étape 2 : Interroger pour obtenir le résultat 24poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 25 26def check_status(): 27 while True: 28 response = requests.get( 29 poll_url, 30 headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"} 31 ) 32 result = response.json() 33 status = result["data"]["status"] 34 35 if status in ["completed", "succeeded"]: 36 video_url = result["data"]["outputs"][0] 37 print("Vidéo générée :", video_url) 38 return video_url 39 elif status == "failed": 40 raise Exception(result["data"].get("error", "La génération a échoué")) 41 else: 42 time.sleep(2) 43 44video_url = check_status()

Le niveau Seedance 2.0 Fast d'Atlas Cloud coûte USD 0.081 par seconde, contre USD 0.153/sec pour Kling 3.0. Les téléchargements de fichiers de référence ne sont pas facturés — vous n'êtes facturé que pour la durée de la vidéo générée. Les nouveaux comptes reçoivent un crédit gratuit de 1 USD sans carte bancaire requise (Documentation Atlas Cloud, 2026).

Qu'est-ce que Seedance 2.0 et pourquoi est-ce important ?

En avril 2026, Seedance 2.0 a obtenu un score ELO de 1 271 sur l'Artificial Analysis Video Arena, le plaçant 2e au niveau mondial et 1er parmi tous les modèles capables de gérer l'audio avec 1 221. Ce classement reflète une réalité : c'est l'un des rares modèles à traiter le texte, les images, les clips vidéo et l'audio en un seul passage unifié, plutôt que de devoir enchaîner plusieurs outils.

ByteDance a construit Seedance 2.0 au sein de son laboratoire SEED et l'a lancé publiquement le 12 février 2026. L'architecture est appelée "génération conjointe audio-vidéo multimodale unifiée". En pratique, cela signifie que vous fournissez un prompt, des images de référence optionnelles, un clip vidéo et un fichier audio, et le modèle traite le tout simultanément. Aucune étape de synchronisation audio séparée. Aucun pipeline de synchronisation labiale manuel.

La résolution de sortie atteint 1080p via l'interface Dreamina et 720p via l'API. Vous pouvez générer des clips entre 4 et 15 secondes selon six rapports hauteur/largeur : 21:9, 16:9, 4:3, 1:1, 3:4 et 9:16. Ce dernier est important pour le contenu social. Chaque sortie porte le filigrane de provenance C2PA intégré dans les métadonnées du fichier.

Pourquoi l'écart ELO est-il important ? Kling 3.0 Pro obtient 1 250 et Runway Gen-4.5 obtient 1 218. Ces écarts de 21 à 53 points se traduisent par un mouvement sensiblement plus propre et une meilleure adhésion au prompt sur les scènes complexes. Il est utile d'effectuer votre propre test A/B sur votre cas d'usage spécifique, mais Seedance 2.0 a tendance à l'emporter sur les mouvements de caméra cinématographiques et l'audio multilingue.

Seedance 2.0 a obtenu un score ELO de 1 271 sur l'Artificial Analysis Video Arena en avril 2026, se classant deuxième mondial parmi tous les modèles texte-vers-vidéo et premier parmi les modèles capables de gérer l'audio (Artificial Analysis Video Arena, avril 2026).

Le marché de la vidéo IA lui-même s'accélère rapidement. Fortune Business Insights a évalué le marché mondial des générateurs vidéo par IA à 716,8 millions de dollars en 2025, pour atteindre 847 millions de dollars en 2026, soit une augmentation de 18,8 % d'une année sur l'autre. Grand View Research, également en 2026, valorise le marché à 946,4 millions de dollars avec un taux de croissance annuel composé de 20,3 % jusqu'en 2033. Ces chiffres confirment qu'il ne s'agit pas d'une expérience de niche. C'est un marché où les choix d'outils effectués aujourd'hui se cumuleront pendant des années.

Prompting avancé et entrées multimodales de Seedance 2.0

En 2026, 63 % des marketeurs vidéo ont utilisé des outils d'IA pour créer ou modifier des vidéos marketing, selon Wyzowl via Ngram. L'écart entre des résultats moyens et des résultats de qualité professionnelle réside dans la précision du prompt. Les entrées multimodales de Seedance 2.0 rendent le prompting encore plus percutant, mais elles introduisent également des modes de défaillance que la plupart des guides ne couvrent pas.

Utilisation des balises de référence @AssetName

La syntaxe @AssetName est la façon dont vous liez des fichiers téléchargés à des rôles spécifiques dans la scène. Vous pouvez télécharger une photo de produit, une vidéo d'arrière-plan et un fichier de musique, puis écrire : "@produit_front sur un bureau minimaliste, orbite lente, jazz @piste_ambiante jouant doucement". Le modèle utilise l'image comme ancre visuelle, le clip vidéo comme référence de mouvement et l'audio pour la couche sonore. C'est l'avantage majeur par rapport à la génération basée uniquement sur du texte.

Options de contrôle de caméra

Seedance 2.0 prend en charge trois mouvements de caméra nommés : dolly (mouvement avant/arrière), pan (rotation gauche/droite) et push (zoom avec mouvement). Ce sont des termes de niveau réalisateur, utilisez-les donc de manière littérale dans votre prompt. "Slow dolly push forward" produira un résultat différent d'un simple "zoom in". Utilisez un seul mouvement de caméra par clip. Empiler deux mouvements dans un seul clip de 8 secondes produit généralement des artefacts visuels.

Échecs de prompts et correctifs

Voici un modèle qui apparaît systématiquement : les prompts vagues produisent des résultats vagues. Considérez la différence entre ces deux prompts pour la même prise de vue de produit :

Avant (faible) : "Montre une bouteille d'eau dans un beau décor avec un bon éclairage." Après (fort) : "@bouteille Bouteille d'eau bleue translucide sur une surface en pierre humide, gouttelettes captant la lumière du matin, arrière-plan de forêt flou, lent mouvement dolly push, ton cinématographique froid."

La version faible produit une maquette de studio générique. La version forte génère quelque chose que vous pourriez réellement utiliser dans une publicité. Qu'est-ce qui a changé ? La précision sur la texture de la surface, la source d'éclairage, la profondeur d'arrière-plan et le mouvement de la caméra. Le modèle répond aux noms concrets et aux descripteurs précis, pas à des adjectifs comme "beau" ou "bon".

Seedance 2.0 prend en charge le contrôle de la caméra au niveau du réalisateur, y compris les mouvements de dolly, pan et push. Traitez la direction de la caméra comme des instructions littérales dans chaque prompt. Source : Unsplash / Harrison Kugler.

Seedance 2.0 accepte jusqu'à 12 fichiers de référence par requête — un mélange de 9 images, 3 clips vidéo et 3 fichiers audio — le tout traité en un seul passage multimodal utilisant la syntaxe @AssetName. Aucun concurrent du top 6 du classement ELO n'offre ce niveau de contrôle d'entrée combiné (Documentation du laboratoire ByteDance SEED, 2026).

Foire aux questions sur Seedance 2.0

- Seedance 2.0 est-il gratuit ?

Oui, jusqu'à un certain point. L'offre gratuite de Dreamina inclut 225 jetons partagés par jour et ajoute un filigrane à toutes les sorties. Les plans payants débutent à 18 USD/mois pour le Standard, ce qui supprime les filigranes et augmente les limites de jetons. Le nombre d'utilisateurs actifs mensuels des plateformes vidéo IA a atteint 124 millions en janvier 2026 (Ngram, 2026), les offres gratuites peuvent donc être saturées pendant les heures de pointe.

- Quelle est la durée maximale de vidéo que Seedance 2.0 peut générer ?

La durée maximale d'un clip unique est de 15 secondes via l'interface Dreamina et l'API. Le minimum est de 4 secondes. Pour des vidéos plus longues, enchaînez plusieurs clips en utilisant des actifs de référence cohérents via la balise @AssetName. C'est ainsi que les flux de travail vidéo IA professionnels sont structurés sur la plupart des modèles de premier plan en 2026.

- Comment Seedance 2.0 se compare-t-il à Sora 2 en termes de coût ?

Au niveau de l'API, Seedance 2.0 via Atlas Cloud Fast coûte 0,022 USD par seconde, ce qui place un clip de 10 secondes à 0,22 USD. Sora 2 coûte environ 0,15 USD par seconde, rendant le même clip à 1,50 USD. Cela représente un avantage de coût d'environ 7x pour Seedance 2.0. Compte tenu de son score ELO de 1 271 contre 1 186 pour Sora 2 Pro, le rapport qualité-coût favorise clairement Seedance (Atlas Cloud, mars 2026).

- Puis-je utiliser les sorties de Seedance 2.0 commercialement ?

L'utilisation commerciale est autorisée sur les plans Dreamina payants et via l'API, sous réserve des conditions d'utilisation de ByteDance. Chaque sortie porte des métadonnées de provenance C2PA intégrées, que certaines plateformes publicitaires et outils de sécurité de marque peuvent détecter. Vérifiez la politique de divulgation de contenu IA de chaque plateforme avant de lancer des campagnes payantes. La production traditionnelle coûte 4 500 USD/min contre 400 USD/min pour l'IA (vidBoard.ai, 2026), il est donc important de respecter la conformité.

- Combien de temps prend la génération via API ?

Le temps de génération via l'API AtlasCloud varie de 30 à 120 secondes par clip. Utilisez le modèle asynchrone soumettre-interroger-télécharger plutôt qu'une requête bloquante. Pour les flux de travail par lots, soumettez d'abord tous les travaux, puis interrogez les résultats.

- Comment utiliser Seedance 2.0 hors de Chine sans VPN ?

Aucun VPN n'est nécessaire. Comment utiliser Seedance 2.0 hors de Chine : visitez dreamina.capcut.com directement depuis n'importe quel pays. Dreamina est la plateforme internationale, totalement distincte de Jimeng (réservée à la Chine). Elle est disponible dans plus de 130 pays, dont les États-Unis, le Royaume-Uni, l'Inde, le Japon et la majeure partie de l'Europe. Pour l'accès API, Atlas Cloud et fal.ai sont accessibles mondialement sans restriction géographique.

- Comment utiliser Seedance 2.0 dans CapCut ?

Téléchargez CapCut depuis votre boutique d'applications, connectez-vous, appuyez sur "AI Video", sélectionnez Seedance 2.0 dans le sélecteur de modèle, écrivez votre prompt, définissez le rapport hauteur/largeur et la durée, puis appuyez sur Générer. CapCut partage le même pool de jetons que Dreamina sur le même compte ByteDance. ByteDance a étendu l'accès mondial à CapCut en avril 2026 à plus de 150 pays.

- Comment utiliser l'API Seedance 2.0 en tant que développeur ?

Comment utiliser l'API Seedance 2.0 : inscrivez-vous sur atlascloud.ai, créez une clé API, approvisionnez votre compte (minimum 10 USD). Interrogez le statut toutes les 5 secondes jusqu'à ce que statut:"completed". Seedance 2.0 Fast coûte 0,022 USD/sec — 7x moins cher que Sora 2 à ~0,15 USD/sec (Atlas Cloud, mars 2026).