Votre prompt a heurté un mur de refus. Non pas parce qu'il était dangereux, mais parce qu'un mot-clé a déclenché un filtre.

Les développeurs de la communauté Ollama décrivent cela comme des « vecteurs de refus » : des blocages déclenchés par des mots-clés qui n'ont rien à voir avec un danger réel. Rétro-ingénierie de logiciels malveillants pour la recherche en sécurité, documentation d'études de cas médicaux, création de contenu pour adultes, rédaction de fiction sombre. L'IA grand public bloque tout cela. Cette liste classe les meilleurs modèles d'IA non censurés de 2026 selon des données réelles de la communauté, et non des textes marketing. Elle couvre trois catégories : les modèles LLM non censurés pour le texte et le code, les meilleurs modèles d'IA locaux non censurés de 2026 pour un déploiement sur matériel privé, et les modèles d'IA non censurés de 2026 pour la génération d'images et de vidéos via API. Chaque chiffre est sourcé et daté de mai 2026.

Pour une introduction au paysage plus large des outils, les lecteurs novices trouveront le guide du générateur d'images IA non censuré utile comme point de départ avant de sélectionner un modèle spécifique.

Comment nous avons classé les meilleurs modèles d'IA non censurés 2026

En 2026, les nombres de téléchargements de la communauté sur Ollama fournissent un signal de classement plus fiable que les scores des benchmarks, qui peuvent être sélectionnés pour des communiqués de presse plutôt que pour des performances réelles (Ollama, recherche de modèles non censurés, 2026). Des millions de téléchargements représentent des milliers de configurations matérielles et de types de prompts. C'est plus difficile à manipuler qu'un ensemble d'évaluation organisé.

Trois signaux de classement sont utilisés dans cet article. Pour les modèles Ollama non censurés, le signal principal est le nombre de téléchargements sur ollama.com, récupéré en mai 2026. Pour les modèles OpenRouter, le classement se base sur le nombre de paramètres et la fenêtre de contexte, car les nombres de téléchargements ne sont pas publics sur cette plateforme. Pour les modèles d'image et de vidéo, le classement se fait par prix à la sortie, avec les coûts les plus bas listés en premier au sein de chaque groupe.

La plupart des modèles d'IA non censurés de 2026 tombent dans deux catégories techniques : affinés (fine-tuned) et « ablitérés » (abliterated). Les modèles affinés comme la série Dolphin sont entraînés sur des ensembles de données qui ne renforcent pas le comportement de refus. Les modèles ablitérés voient leurs poids de refus supprimés chirurgicalement. La communauté trouve systématiquement que les modèles affinés sont plus stables sur divers types de prompts.

En pratique, les nombres de téléchargements sont également corrélés à la stabilité du modèle. Un modèle qui atteint plus d'un million de téléchargements a été testé sur une large gamme de configurations matérielles, faisant apparaître des bugs et une instabilité que les petits groupes de test ignorent totalement.

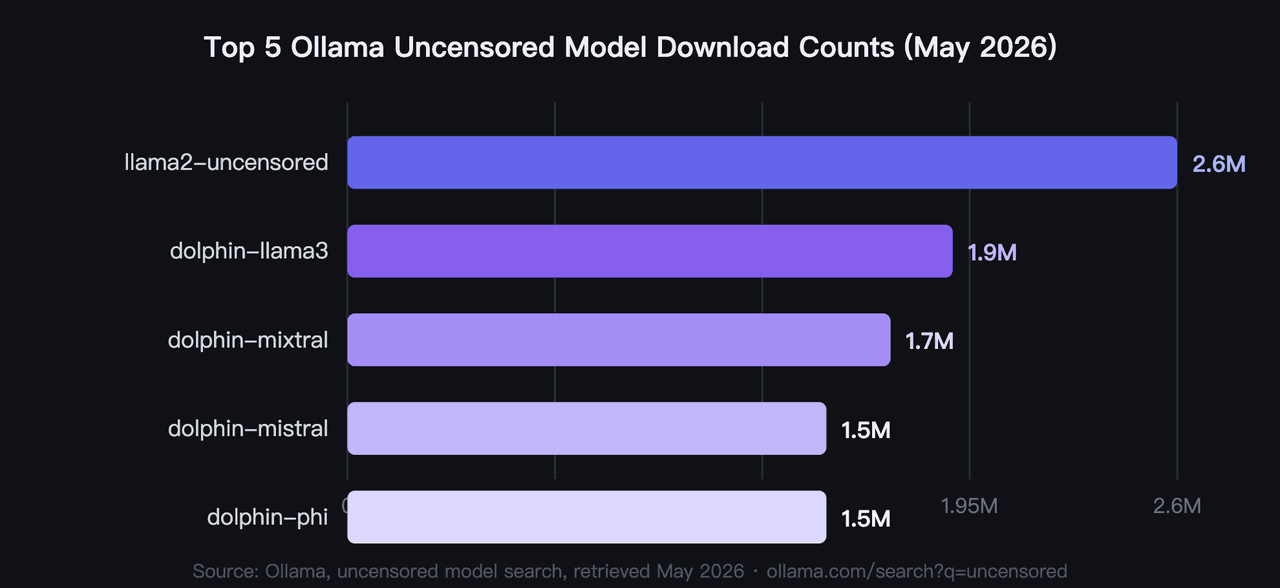

Quels sont les 5 modèles d'IA non censurés les plus téléchargés sur Ollama ?

En 2026, les cinq modèles Ollama non censurés les plus téléchargés totalisent plus de 9,2 millions de téléchargements, avec llama2-uncensored en tête à 2,6 millions (Ollama, recherche de modèles non censurés, 2026). Ce sont les meilleurs modèles Ollama non censurés de 2026 par validation communautaire, et non par un quelconque benchmark. Le matériel est le filtre principal que la plupart des utilisateurs appliquent en premier : les exigences en VRAM varient de moins de 4 Go à 40 Go dans ce groupe.

1. llama2-uncensored : Le modèle d'IA non censuré le plus téléchargé sur Ollama

La référence communautaire originale pour l'IA locale non censurée. George Sung et Jarrad Hope ont publié cet affinage pour supprimer le comportement de refus de Llama 2 sans dégrader les capacités générales. C'est le modèle avec lequel la plupart des développeurs commencent, et son nombre de 2,6 millions de téléchargements reflète plus de deux ans d'utilisation réelle. Aucun autre LLM non censuré n'a égalé ce volume de téléchargement.

- Paramètres : 7B ou 70B

- VRAM : ~6 Go (7B) ; ~40 Go (70B)

- Idéal pour : Chat et génération de contenu sans restriction à usage général

- Plateforme : Ollama

2. dolphin-llama3 : Le meilleur modèle LLM Llama 3 non censuré pour les flux de travail agentiques

Le Dolphin d'Eric Hartford basé sur Llama 3 est le modèle non censuré le plus téléchargé construit sur une architecture moderne, avec 1,9 million de téléchargements (Ollama, page du modèle dolphin-llama3, 2026). Il prend en charge l'appel de fonctions (function calling) et une fenêtre de contexte qui s'étend de 8K à 256K jetons selon la configuration. La version 8B pèse 4,7 Go, s'adaptant à la plupart des GPU grand public de milieu de gamme.

- Paramètres : 8B ou 70B

- VRAM : ~5 Go (8B) ; ~40 Go (70B)

- Idéal pour : Codage, flux de travail agentiques et appel de fonctions

- Plateforme : Ollama

3. dolphin-mixtral 8x7B : Modèle d'IA MoE non censuré pour le raisonnement complexe

Une architecture de mélange d'experts (MoE) achemine chaque jeton via un sous-ensemble de ses 8 couches expertes. Cela produit une qualité de raisonnement proche de 70B à un coût d'inférence inférieur à celui d'un modèle dense ayant le même nombre total de paramètres. L'affinage non censuré d'Eric Hartford maintient une forte emphase sur le codage.

- Paramètres : 8x7B (les paramètres actifs par passage d'inférence sont bien inférieurs au total)

- VRAM : ~12-16 Go avec quantification

- Idéal pour : Tâches de codage complexes, raisonnement technique et chaînes d'instructions longues

- Plateforme : Ollama

4. dolphin-mistral : Modèle d'IA local 7B non censuré pour des réponses rapides

Plus léger et plus rapide que dolphin-mixtral sur du matériel limité par le CPU. Il cumule 1,5 million de téléchargements de développeurs qui souhaitent un modèle local réactif pour la complétion de code sans avoir besoin d'un GPU haut de gamme. L'architecture de base Mistral lui confère un excellent rapport performance/taille pour un modèle 7B.

- Paramètres : 7B

- VRAM : ~5-6 Go

- Idéal pour : Assistance au codage légère et réponses rapides en chat

- Plateforme : Ollama

5. dolphin-phi 2.7B : Le modèle d'IA local non censuré le plus léger

L'architecture de base Phi de Microsoft intègre un raisonnement performant dans un modèle de 2,7 milliards de paramètres. L'affinage non censuré d'Eric Hartford préserve cette efficacité. Avec moins de 4 Go de VRAM, il fonctionne sur la plupart des ordinateurs portables grand public équipés d'un GPU dédié, ce qui en fait le point d'entrée accessible pour les meilleurs modèles d'IA locaux non censurés de 2026.

- Paramètres : 2.7B

- VRAM : Moins de 4 Go

- Idéal pour : Déploiement sur ordinateur portable, tests rapides et environnements à matériel limité

- Plateforme : Ollama

Meilleurs modèles LLM non censurés 6-10 : Codage, jeu de rôle et contexte long

En 2026, la série Dolphin occupe 5 des 10 premières places du catalogue non censuré d'Ollama par nombre de téléchargements, une concentration qui reflète la méthodologie d'affinage cohérente d'Eric Hartford appliquée à différentes architectures de base (Ollama, page du modèle hermes3, 2026). Les modèles 6 à 10 couvrent le jeu de rôle, la conversation générale, les outils de développement, le suivi d'instructions et le contexte étendu : les cas d'utilisation où les refus de l'IA grand public sont les plus perturbateurs.

6. hermes3 : Modèle d'IA non censuré pour le jeu de rôle et les tâches agentiques

Nous Research a construit hermes3 pour la profondeur du jeu de rôle et l'utilisation d'outils structurés. Il est disponible en quatre tailles de 3B à 405B, la gamme de tailles la plus large de tous les modèles de cette liste. Avec 1,3 million de téléchargements, la variante 8B se situe à un point pratique pour l'écriture créative et les flux de travail de planification agentique (Ollama, page du modèle hermes3, 2026).

- Paramètres : 3B, 8B, 70B ou 405B

- VRAM : ~2 Go (3B) ; ~5 Go (8B) ; ~40 Go (70B)

- Idéal pour : Jeu de rôle, fiction créative et planification de tâches agentiques

- Plateforme : Ollama

7. wizard-vicuna-uncensored : Modèle d'IA multi-taille non censuré pour usage général

Un modèle plus ancien mais éprouvé construit sur Llama 2, disponible en trois tailles jusqu'à 30B. Ses 1,2 million de téléchargements proviennent d'utilisateurs qui souhaitent une option non censurée fiable avec une gamme de paramètres plus large. Il n'égale pas les capacités de fenêtre de contexte de dolphin-llama3, mais gère la conversation générale et le contenu créatif de manière cohérente.

- Paramètres : 7B, 13B ou 30B

- VRAM : ~5 Go (7B) ; ~9 Go (13B) ; ~20 Go (30B)

- Idéal pour : Conversation à usage général et contenu créatif avec plusieurs options de taille

- Plateforme : Ollama

8. dolphincoder : Modèle de codage IA non censuré basé sur StarCoder2

StarCoder2 comme base fait de dolphincoder un spécialiste authentique. Là où les autres modèles Dolphin sont des généralistes avec un affinage non censuré, celui-ci cible spécifiquement le développement logiciel. Ses 943 000 téléchargements proviennent presque exclusivement de développeurs, et non d'utilisateurs créatifs. La variante 15B gère des bases de code plus importantes que la 7B.

- Paramètres : 7B ou 15B

- VRAM : ~5 Go (7B) ; ~10 Go (15B)

- Idéal pour : Génération de code, débogage et documentation technique

- Plateforme : Ollama

9. wizardlm-uncensored : LLM de suivi d'instructions non censuré pour les flux de recherche

Un modèle de suivi d'instructions 13B avec 610 000 téléchargements. Sa force est de suivre des instructions complexes en plusieurs étapes sans hésiter ni refuser les sous-tâches. Dans les flux de recherche où un seul refus interrompt une longue chaîne, cette fiabilité a une valeur de productivité directe. Il n'a pas l'architecture de base moderne de dolphin-llama3, mais il fait le travail d'instruction de manière cohérente.

- Paramètres : 13B

- VRAM : ~9 Go

- Idéal pour : Chaînes d'instructions complexes en plusieurs étapes et flux de recherche

- Plateforme : Ollama

10. everythinglm : LLM non censuré avec fenêtre de contexte 16K

La caractéristique remarquable ici est la fenêtre de contexte de 16K sur une base Llama 2. La plupart des modèles 7B plafonnent à 4K ou 8K jetons. Ce contexte supplémentaire permet à everythinglm de traiter des bases de code entières, de longs documents ou des historiques de conversation étendus sans troncature. Ses 536 000 téléchargements sont modestes selon les normes de cette liste, mais il comble une lacune qu'aucun autre modèle ici ne couvre à cette taille.

- Paramètres : 13B

- VRAM : ~9 Go

- Idéal pour : Analyse de documents longs, chat à contexte étendu et revue de base de code complète

- Plateforme : Ollama

La domination de la série Dolphin dans les nombres de téléchargements d'Ollama reflète un schéma que la communauté a documenté : les modèles non censurés affinés par un seul auteur avec une méthodologie cohérente surpassent les tentatives d'ablitération ponctuelles. L'ablitération supprime les poids de refus d'un modèle unique. L'affinage construit un comportement non censuré stable à travers divers types de prompts. Cette cohérence est la raison pour laquelle 5 des 10 premières places appartiennent au travail d'Eric Hartford, et non à une architecture de base unique.

Comment configurer les modèles Ollama non censurés localement ?

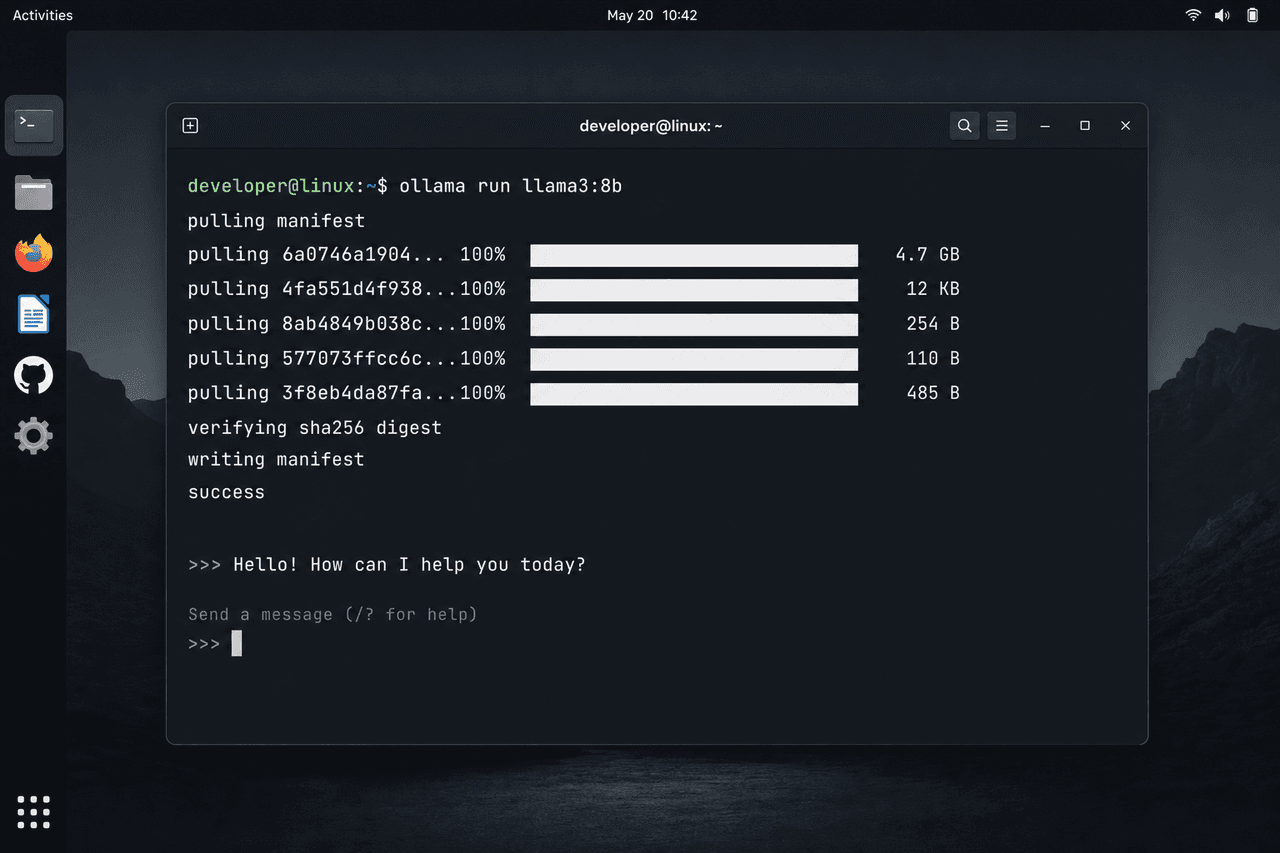

En 2026, trois commandes installent n'importe quel modèle Ollama sur Mac, Linux ou Windows : installez Ollama depuis ollama.com, exécutez

1ollama pull [nom-du-modèle]1ollama run [nom-du-modèle]Pour dolphin-llama3 comme exemple concret :

1ollama pull dolphin-llama31ollama run dolphin-llama3LM Studio fournit une interface graphique de bureau pour les utilisateurs qui préfèrent ne pas travailler dans le terminal. Il utilise les mêmes fichiers de modèle GGUF qu'Ollama, avec une interface visuelle pour la sélection du modèle et l'ajustement des paramètres. llama.cpp est le moteur d'inférence sous-jacent derrière les deux outils, et il prend en charge l'utilisation directe en ligne de commande lorsque vous avez besoin de plus de contrôle sur les niveaux de quantification et les paramètres de longueur de contexte.

Les développeurs qui souhaitent des exigences matérielles et des paramètres de quantification spécifiques pour exécuter les meilleurs modèles d'IA locaux non censurés de 2026 sur des GPU grand public trouveront que le guide de configuration locale complet couvre en détail les configurations VRAM minimales et les erreurs de configuration courantes.

Quels modèles OpenRouter non censurés sont disponibles sans GPU local ?

En 2026, OpenRouter héberge des LLM non censurés via API, éliminant complètement l'exigence de GPU. Le modèle venice/uncensored est disponible en tant que modèle de niveau gratuit à 0 USD par million de jetons d'entrée et de sortie (OpenRouter, page du modèle venice/uncensored, 2026). Cela fait des modèles OpenRouter non censurés le point d'entrée pratique pour les utilisateurs sans matériel dédié.

Le compromis est simple : OpenRouter achemine votre prompt via son infrastructure, donc la conversation n'est pas privée comme le serait un modèle local. Les modèles Ollama locaux gardent tout sur votre appareil. Aucune approche n'est universellement meilleure. Le bon choix dépend de votre modèle de menace et de la disponibilité du matériel.

11. venice/uncensored : Modèle OpenRouter non censuré gratuit

Le modèle Venice Uncensored sur le niveau gratuit d'OpenRouter. Une base Mistral-Small 24B, affinée pour une sortie non censurée par Cognitive Computations en collaboration avec Venice.ai. Fenêtre de contexte 32K, 0 USD par million de jetons. Le niveau gratuit d'OpenRouter applique une limite à l'échelle de la plateforme de 200 requêtes par jour sur les modèles gratuits.

- Paramètres : 24B

- VRAM : Aucune requise (hébergé dans le cloud)

- Idéal pour : Tester des LLM non censurés sans matériel local ; gratuit dans les limites de débit de la plateforme

- Plateforme : OpenRouter

12. Sao10K : Llama 3.3 Euryale 70B : Grand modèle non censuré via OpenRouter

Modèle de jeu de rôle créatif et de suivi d'instructions 70B de Sao10k, affiné pour une sortie non censurée. Basé sur Llama 3.3 70B avec 131K de contexte. Activement maintenu avec une utilisation réelle sur OpenRouter, et consultable par nom dans la recherche globale de la plateforme.

- Paramètres : 70B

- VRAM : Aucune requise (hébergé dans le cloud)

- Idéal pour : Écriture créative complexe, jeu de rôle et chaînes d'instructions longues sans matériel local

- Plateforme : OpenRouter

13. Sao10K : Llama 3 8B Lunaris : Modèle non censuré léger via OpenRouter

Lunaris 8B est un modèle généraliste et de jeu de rôle polyvalent de Sao10k, basé sur Llama 3 8B. Il s'agit d'une fusion stratégique de plusieurs modèles conçus pour équilibrer créativité avec une logique et des connaissances générales améliorées, offrant une expérience améliorée par rapport à Stheno v3.2 avec une créativité et un raisonnement accrus. L'option non censurée la moins chère sur OpenRouter à 0,04 USD / 0,05 USD par million de jetons, avec plus de 6 milliards de jetons d'utilisation réelle sur la plateforme.

- Paramètres : 8B

- VRAM : Aucune requise (hébergé dans le cloud)

- Idéal pour : Conversation non censurée légère et écriture créative à un coût minimal

- Plateforme : OpenRouter

14. TheDrummer : Cydonia 24B V4.1 : Modèle d'écriture créative non censuré via OpenRouter

Cydonia 24B V4.1 est un modèle d'écriture créative non censuré de TheDrummer, basé sur Mistral Small 3.2 24B, avec une bonne mémorisation, une bonne adhésion aux prompts et de l'intelligence. Fenêtre de contexte 131K. Activement maintenu et directement consultable par nom dans la recherche globale d'OpenRouter.

- Paramètres : 24B

- VRAM : Aucune requise (hébergé dans le cloud)

- Idéal pour : Écriture créative et jeu de rôle non censurés sans matériel local

- Plateforme : OpenRouter

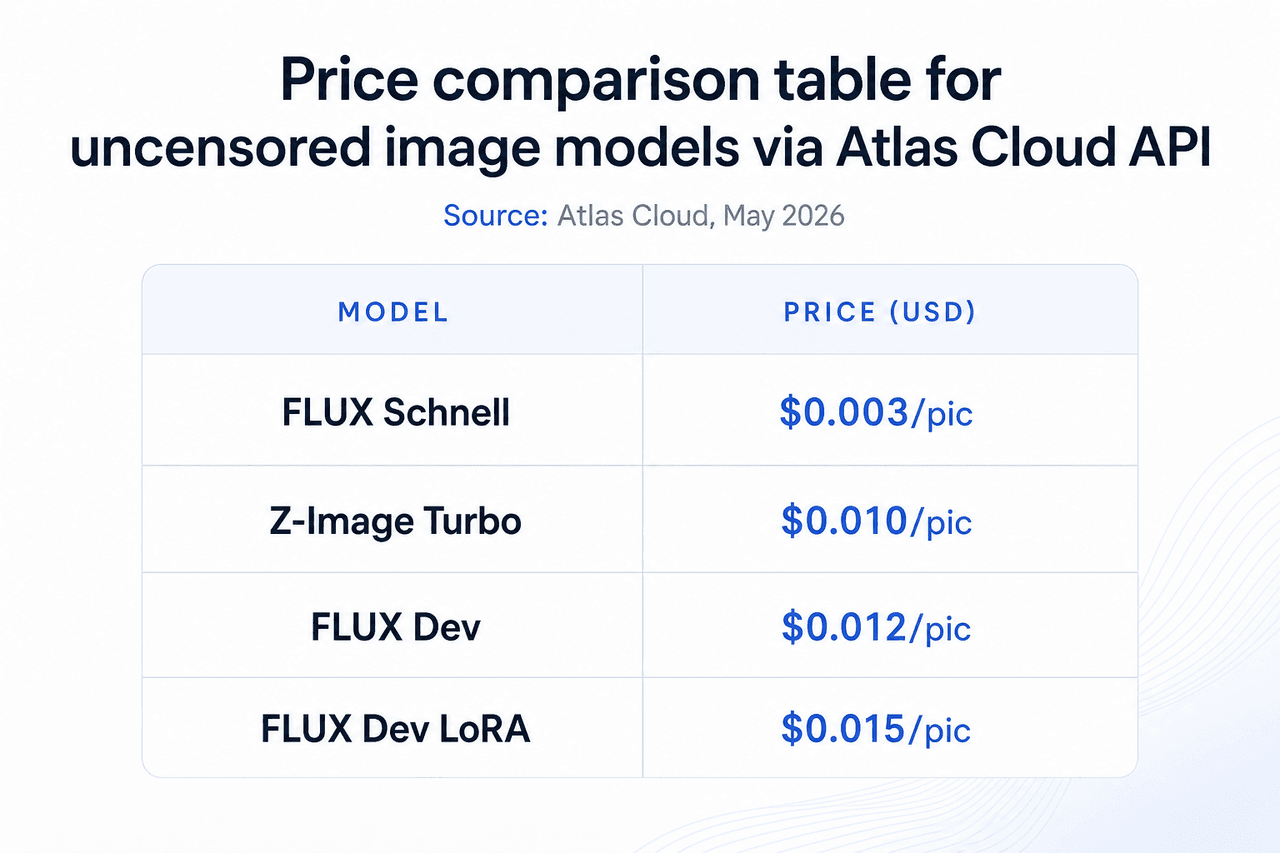

Comment accéder aux modèles d'image et de vidéo non censurés via Atlas Cloud

En 2026, la plupart des modèles d'image et de vidéo non censurés nécessitent soit un matériel GPU local, soit une plateforme API dédiée, car les fournisseurs de cloud grand public appliquent des filtres de contenu qui bloquent les sorties NSFW au niveau de l'inférence. Atlas Cloud est une plateforme d'API de modèles construite spécifiquement pour supprimer cette contrainte, couvrant plus de 300 modèles organisés en texte, image, vidéo et audio.

Se lancer prend trois étapes :

- Créez un compte sur atlascloud.ai

- Générez une clé API depuis le tableau de bord

- Appelez le point de terminaison du modèle en utilisant la clé — les modèles d'image et de vidéo utilisent leur propre format REST ; les points de terminaison LLM suivent le format OpenAI Chat Completions

Ce qui rend Atlas Cloud pertinent pour les cas d'utilisation non censurés spécifiquement :

- La politique de confidentialité de la plateforme stipule : « Votre contenu généré n'est jamais utilisé pour l'entraînement et n'est jamais examiné par personne. » Il s'agit d'un engagement explicite et publié, et non d'une supposition par défaut.

- Aucun plafond de génération quotidien ne s'applique à aucun modèle du catalogue.

- Le catalogue d'images non censurées couvre 33 modèles de texte vers image commençant à 0,003 USD par image.

- Le catalogue de vidéos non censurées couvre plus de 10 modèles vidéo NSFW commençant à 0,01 USD/sec.

Le catalogue complet des modèles non censurés peut être parcouru sur atlascloud.ai/models/explore/uncensored. Les modèles #15 à #20 de cette liste sont tous accessibles via une seule clé API Atlas Cloud.

Quels sont les meilleurs modèles d'image IA non censurés pour la génération de contenu NSFW et adulte ?

En 2026, l'architecture FLUX alimente la majorité de la génération d'images non censurées de haute qualité, disponible via l'API Atlas Cloud à travers des niveaux de prix et de qualité (Atlas Cloud, liste des modèles texte vers image, 2026). Le catalogue d'Atlas Cloud couvre 33 modèles de texte vers image au total. Les cas d'utilisation incluent les beaux-arts, la conception de personnages, les modèles de lingerie non censurés et la génération de portraits d'adultes, la création d'assets de jeux et l'illustration par lots en volume.

La page d'accueil d'Atlas Cloud indique « Plus de 300 modèles organisés en texte, image, vidéo et audio », et la politique de confidentialité de la plateforme pour son catalogue non censuré se lit comme suit : « Votre contenu généré n'est jamais utilisé pour l'entraînement et n'est jamais examiné par personne. »

Pour une ventilation complète des outils d'image non censurés basés sur navigateur et API, le guide des meilleurs générateurs d'images IA non censurés couvre les deux catégories avec des comparaisons de capacités. Les développeurs concentrés spécifiquement sur l'architecture FLUX peuvent lire le guide du générateur d'images non censuré FLUX pour les détails d'affinage et de flux de travail.

15. FLUX Schnell : Le modèle d'image IA non censuré le plus rapide pour la génération par lots

L'option la moins chère du catalogue d'images Atlas Cloud. À 0,003 USD par image, c'est l'outil idéal pour les flux de travail de génération par lots où la vitesse et le volume comptent plus que les détails fins. Aucun plafond quotidien ne s'applique, et aucun contenu n'est stocké pour l'entraînement.

- Prix : 0,003 USD/image

- VRAM : Aucune requise (accès API)

- Idéal pour : Génération d'images par lots, prototypage rapide et sortie non censurée à haut volume

- Plateforme : API Atlas Cloud

À 0,003 USD par image, un budget de 3,00 USD produit 1 000 images. Ce coût par sortie est inférieur aux frais de stockage cloud pour les fichiers résultants chez la plupart des fournisseurs. Cela change l'économie pour les studios qui faisaient auparavant tourner des rigs GPU locaux coûteux pendant la nuit pour la génération par lots : l'approche API est désormais à la fois moins chère et plus rapide pour le travail en volume.

16. FLUX Dev : Le modèle d'image IA non censuré de la plus haute qualité pour la production finale

Quatre fois le coût de FLUX Schnell, avec une anatomie, un éclairage et des détails de texture sensiblement meilleurs. Pour une sortie de qualité finale où les images individuelles comptent, le prix de 0,012 USD est une avancée pratique. Il convient aux portfolios, au contenu adulte commercial et aux assets de production où la qualité est la contrainte principale.

- Prix : 0,012 USD/image

- VRAM : Aucune requise (accès API)

- Idéal pour : Images uniques de haute qualité, portfolios et assets de production finaux

- Plateforme : API Atlas Cloud

17. FLUX Dev LoRA : Modèle d'image non censuré avec entraînement de style personnalisé

L'affinage LoRA injecte un style personnalisé, une apparence de personnage ou un sujet dans la base FLUX Dev. C'est le modèle à utiliser lorsque vous avez besoin d'une apparence de personnage cohérente sur un lot ou que vous voulez qu'un style maison soit appliqué à chaque image d'un ensemble. Atlas Cloud gère le chargement LoRA côté serveur.

- Prix : 0,015 USD/image

- VRAM : Aucune requise (accès API)

- Idéal pour : Cohérence des personnages, entraînement de style personnalisé et séries d'images de marque

- Plateforme : API Atlas Cloud

18. Z-Image Turbo : Modèle d'image IA non censuré budgétaire avec qualité de milieu de gamme

Positionné entre FLUX Schnell et FLUX Dev sur la courbe prix-qualité. À 0,01 USD par image, Z-Image Turbo offre une architecture différente optimisée pour la vitesse sans la simplification d'image que Schnell effectue à son prix inférieur. Le choix pratique lorsque la qualité de Schnell n'est pas suffisante et que le coût de FLUX Dev est trop élevé pour le volume nécessaire.

- Prix : 0,01 USD/image

- VRAM : Aucune requise (accès API)

- Idéal pour : Génération en volume modéré où la qualité et le coût doivent s'équilibrer

- Plateforme : API Atlas Cloud

Quels sont les meilleurs modèles de vidéo IA non censurés pour l'animation NSFW en 2026 ?

En 2026, la génération de vidéo non censurée nécessite un pipeline séparé de la génération d'image car les plateformes vidéo grand public appliquent des filtres de contenu identiques et refusent d'animer du contenu NSFW même lorsque l'image source a été générée ailleurs (Atlas Cloud, catalogue de modèles non censurés, 2026). La page vidéo non censurée d'Atlas Cloud porte le titre « Liberté créative sans restriction. Pas de filtres. Pas de limites. » et couvre plus de 10 modèles vidéo NSFW, le catalogue complet incluant également des variantes des séries Wan 2.6, Wan 2.5 et Van.

19. Wan 2.2 Turbo Spicy Infinite I2V : Le modèle vidéo non censuré le moins cher

L'option d'entrée de gamme pour l'animation NSFW à partir d'une image fixe. À 0,01 USD/sec, c'est le moyen le plus rentable d'animer une image statique en contenu vidéo NSFW. La résolution atteint 1080p avec une durée de clip variable, ce qui en fait le point de départ idéal pour les pipelines de production soucieux de leur budget.

- Prix : 0,01 USD/sec

- Résolution : 1080p

- Durée : Variable

- Idéal pour : Animation NSFW rentable et prévisualisation de concepts de mouvement

- Plateforme : API Atlas Cloud

20. Seedance v1.5 Spicy : Le modèle vidéo non censuré de la plus haute qualité pour la sortie finale

L'option de qualité cinématographique du catalogue. À 0,049 USD/sec, il coûte environ 2,5 fois plus cher que Wan 2.2 Turbo Spicy Infinite, mais produit un mouvement plus fluide, une meilleure cohérence des sujets à travers les cadres et des transitions plus naturelles. Pour une sortie vidéo NSFW de qualité finale où la fidélité visuelle est la préoccupation principale, c'est la meilleure option dans la gamme vidéo non censurée d'Atlas Cloud.

- Prix : 0,049 USD/sec

- Résolution : 720p

- Durée : 5s

- Idéal pour : Vidéo NSFW de qualité finale, contenu adulte professionnel et sortie prête à la diffusion

- Plateforme : API Atlas Cloud

Le guide des meilleurs générateurs de vidéo IA non censurés couvre le catalogue complet des variantes de la série Wan 2.7 et Wan 2.2 Spicy avec toutes les options de durée et de résolution.

Guide de sélection rapide des modèles d'IA non censurés

| Besoin | Recommandé |

|---|---|

| Meilleur LLM non censuré global | llama2-uncensored ou dolphin-llama3 |

| Tâches de codage | dolphin-mixtral 8x7B ou dolphincoder |

| Jeu de rôle et écriture créative | hermes3 |

| Moins de 4 Go de VRAM | dolphin-phi 2.7B |

| Génération d'image non censurée | FLUX Schnell via Atlas Cloud (0,003 USD/image) |

| Vidéo NSFW à partir d'image | Wan 2.2 Turbo Spicy Infinite via Atlas Cloud (0,01 USD/sec) |

FAQ sur les modèles d'IA non censurés

Quel est le modèle d'IA le plus non censuré en 2026 ?

Par nombre de téléchargements Ollama, llama2-uncensored mène avec 2,6 millions de téléchargements, ce qui en fait l'option la plus validée par la communauté parmi les modèles d'IA non censurés de 2026 (Ollama, recherche de modèles non censurés, 2026). En termes de capacité brute, dolphin-llama3 en offre plus : appel de fonctions, jusqu'à 256K de contexte et une architecture de base Llama 3. La réponse dépend de si la stabilité prouvée ou la capacité moderne compte le plus pour votre cas d'utilisation.

Quels modèles non censurés fonctionnent sur Ollama ?

Dix modèles de cette liste fonctionnent comme modèles Ollama non censurés : llama2-uncensored, dolphin-llama3, dolphin-mixtral, dolphin-mistral, dolphin-phi, hermes3, wizard-vicuna-uncensored, dolphincoder, wizardlm-uncensored et everythinglm. Le modèle communautaire jaahas/qwen3.5-uncensored fonctionne également sur Ollama pour une utilisation multilingue. Tous s'installent avec

1ollama pull [nom-du-modèle]Quels modèles non censurés sont disponibles sur OpenRouter ?

En 2026, OpenRouter héberge des LLM non censurés via API, éliminant complètement l'exigence de GPU. Les options incluent le modèle venice/uncensored du niveau gratuit à 0 USD par million de jetons (200 requêtes par jour), ainsi que des modèles payants incluant Sao10K Euryale 70B, Lunaris 8B et TheDrummer Cydonia 24B (OpenRouter, page du modèle venice/uncensored, 2026). Ces modèles OpenRouter non censurés ne nécessitent aucun GPU local et aucun investissement matériel pour démarrer.

Quelle est la différence entre un modèle non censuré ablitéré et un modèle affiné ?

L'ablitération supprime chirurgicalement les poids de refus d'un modèle au niveau des poids. Les modèles non censurés affinés comme la série Dolphin sont entraînés sur des ensembles de données qui ne renforcent pas le comportement de refus en premier lieu. La communauté trouve systématiquement que les modèles affinés sont plus stables : l'ablitération peut introduire une sortie incohérente à travers divers types de prompts, tandis que l'affinage produit des résultats fiables, ce qui explique pourquoi les modèles Dolphin dominent les nombres de téléchargements non censurés d'Ollama.

Puis-je exécuter des modèles d'IA non censurés localement sur un ordinateur portable ?

Oui. dolphin-phi 2.7B s'exécute avec moins de 4 Go de VRAM, ce qui en fait le point d'entrée pour le déploiement sur ordinateur portable avec un GPU dédié. Avec 6-8 Go de VRAM, vous pouvez exécuter n'importe quel modèle 7B de cette liste. Les graphiques intégrés ne fonctionneront pas. Le guide de configuration locale pour les modèles d'IA non censurés couvre en détail les configurations matérielles minimales et les paramètres de quantification.

Conclusion

Le meilleur modèle d'IA non censuré en 2026 dépend entièrement de votre cas d'utilisation. Pour le travail LLM général, dolphin-llama3 est l'option Ollama la plus capable. Pour les ordinateurs portables, dolphin-phi couvre l'exigence de moins de 4 Go de VRAM. Pour un accès LLM cloud sans matériel, venice/uncensored sur le niveau gratuit d'OpenRouter est le point de départ pratique à 0 USD par million de jetons. Pour la génération d'images non censurées à grande échelle, FLUX Schnell via l'API Atlas Cloud produit une sortie à 0,003 USD par image sans plafond quotidien. Pour la vidéo NSFW, le catalogue Atlas Cloud commence à 0,01 USD/sec avec une politique vérifiée de non-entraînement et de non-examen.

Les lecteurs à la recherche d'un aperçu complet des outils d'IA non censurés à travers les images, les vidéos et les éditeurs trouveront que le guide du générateur d'images IA non censuré couvre tout le paysage.