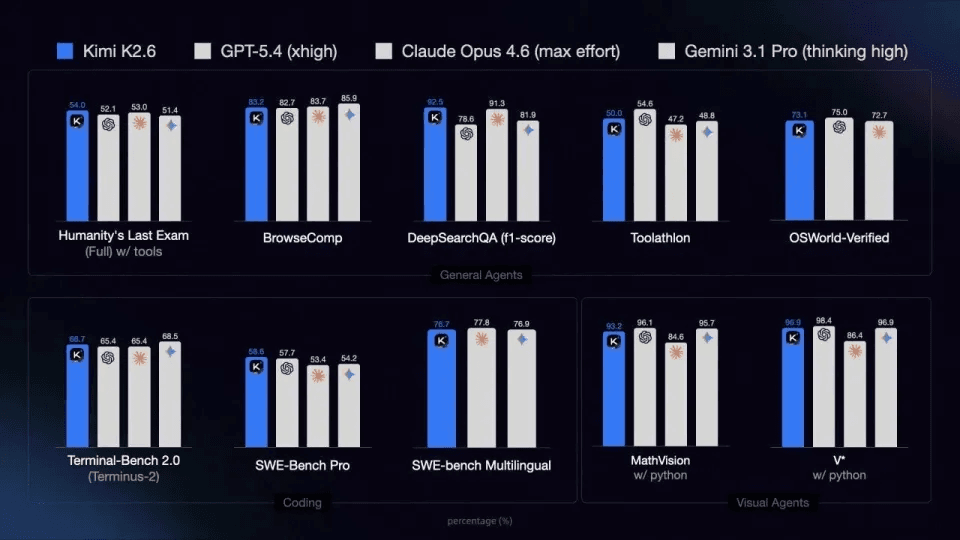

Kimi vient de lancer K2.6, en open source sur HuggingFace, avec des benchmarks comparés à GPT-5.4, Claude Opus 4.6 et Gemini 3.1 Pro. Il surpasse les trois sur Humanity's Last Exam, DeepSearchQA et SWE-Bench Pro, avec des capacités de codage en hausse de près de 20 % par rapport à K2.5, une réduction de 35 % des étapes de tâches moyennes, et une tarification à 1/8e de celle de Claude Opus 4.6 pour les charges de travail d'agents.

Si vous utilisez des agents IA et souhaitez intégrer K2.6 dans votre chaîne d'outils existante, ce guide couvre les quatre frameworks majeurs — Claude Code, OpenCode, OpenClaw et Hermes Agent — via un point de terminaison API partagé sur atlascloud.ai. La seconde moitié de l'article montre ce que K2.6 réalise concrètement une fois en production.

Référence rapide

| Outil | Emplacement config | Changer de modèle | Point d'attention |

| Claude Code | variables env ANTHROPIC_* | changer env ou /model | aucun |

| OpenCode | ~/.config/opencode/config.json | modifier le champ model | utiliser @ai-sdk/openai-compatible |

| OpenClaw | ~/.openclaw/openclaw.json | modifier primary | démarrer la passerelle d'abord |

| Hermes Agent | config interactive hermes | relancer la config | format ID modèle strict |

Tous les tutoriels de cet article sont effectués sur Windows via WSL2.

Partie 1 — Installation

-

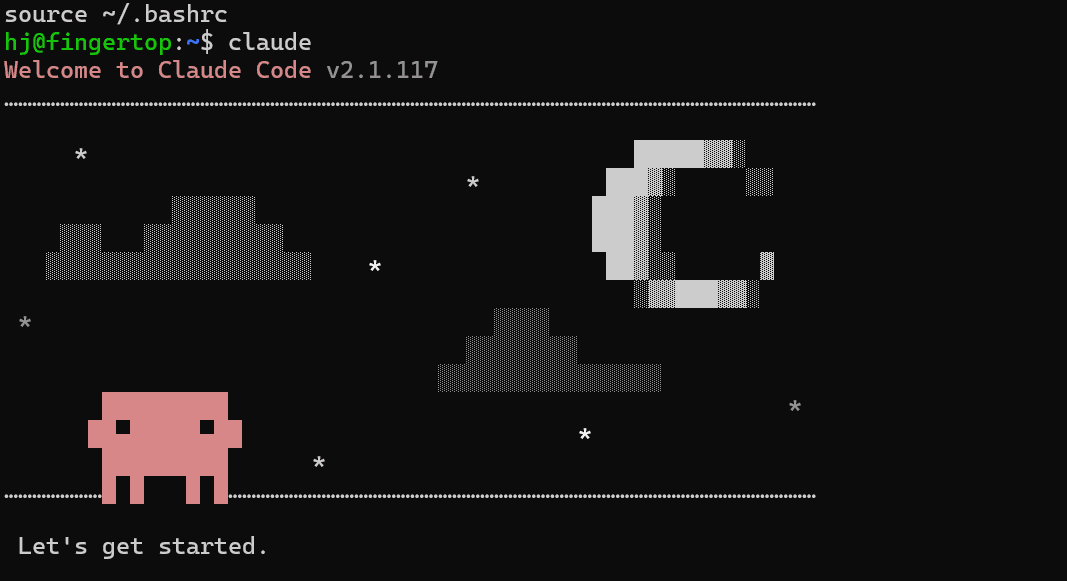

Claude Code (Le plus simple)

Documentation officielle de téléchargement de Claude Code : https://github.com/anthropics/claude-code

Claude Code utilise nativement le format Anthropic. Définissez trois variables d'environnement et le tour est joué :

plaintext1# Ajouter à ~/.bashrc ou ~/.zshrc 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

Après avoir exécuté

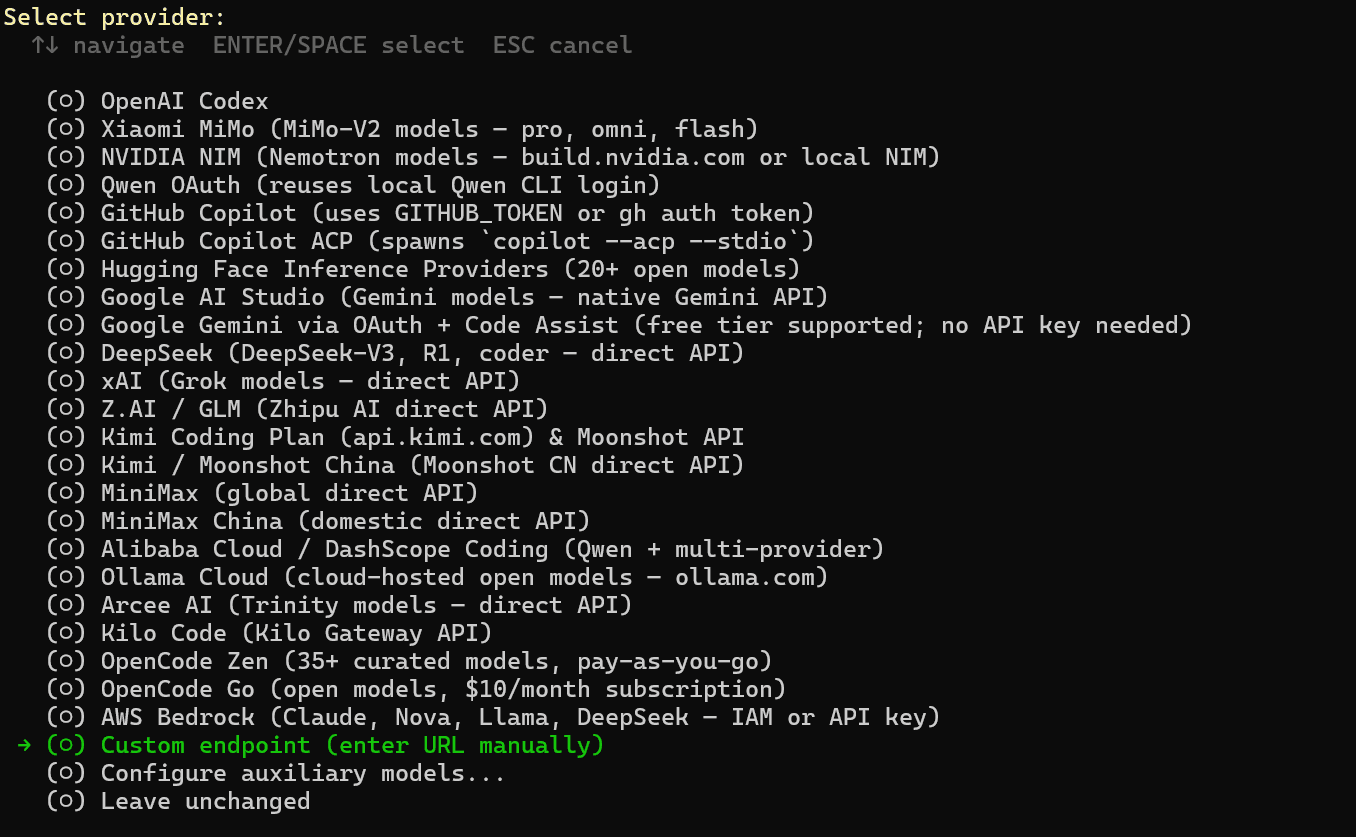

1source ~/.bashrc1/model2. OpenCode (Fichier de configuration)

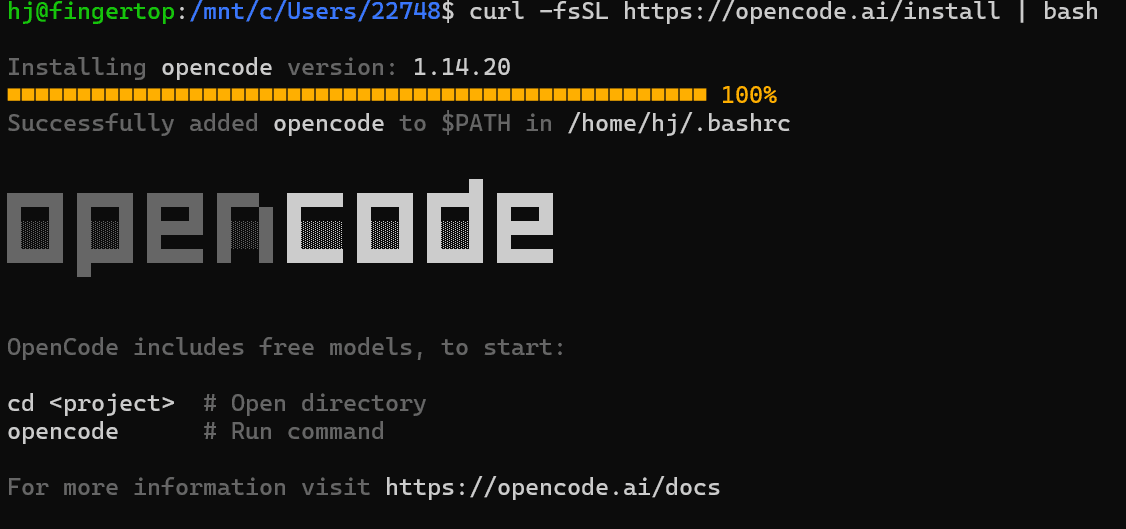

Documentation officielle de téléchargement d'OpenCode : https://github.com/anomalyco/opencode

OpenCode dispose d'un fournisseur

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonplaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

Le champ

1model1providerName/modelKey

3. OpenClaw (Fichier de config + Deux terminaux)

OpenClaw s'exécute via deux processus distincts : une passerelle (gateway) et une interface TUI. Les deux doivent être actifs avant utilisation.

1~/.openclaw/openclaw.jsonplaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

Ordre de démarrage :

plaintext1# Terminal 1 2openclaw gateway 3 4# Terminal 2 5openclaw tui

Pour une reconfiguration interactive :

1openclaw configurePour changer de modèle, modifiez le champ

1primary4. Hermes Agent (Configuration interactive)

Hermes utilise un assistant plutôt qu'un fichier de configuration :

plaintext1hermes setup

Remplissez les prompts :

- Provider : text

1custom - Endpoint : text

1https://api.atlascloud.ai/v1 - API Key : text

1apikey-xxx - Model : text

1moonshot/kimi-k2.6

Important : L'ID du modèle doit inclure le préfixe

. Saisirtext1moonshot/seul renverra une erreur 404.text1kimi-k2.6

Pour changer de modèle plus tard, relancez

1hermes setup

Partie 2 — Ce que fait réellement K2.6

Claude Code × K2.6 — Que se passe-t-il avec 23 agents simultanés ?

Qu'est-ce qui lâche en premier lorsqu'on pousse un système d'IA dans ses derniers retranchements ?

Un développeur a testé cela en faisant tourner 23 agents simultanément via Claude Code pendant une journée entière. Sur 26 sessions, le système a géré des appels d'outils haute fréquence, des pipelines multi-étapes et des tâches complexes comme la rédaction de PRD et la planification SEO. En somme, une charge de travail "type production" réaliste où tout commence généralement à craquer.

Mais cette fois, quelque chose d'inhabituel s'est produit.

Il y a eu zéro erreur de limitation de débit (429).

Pour quiconque a essayé de mettre à l'échelle des workflows d'agents, c'est ce point qui frappe. Dans des conditions similaires, des modèles comme GLM 5.1 ont tendance à atteindre fréquemment les limites, forçant des tentatives, rompant les pipelines et introduisant de l'instabilité. K2.6, au contraire, est resté stable — non pas en étant le plus rapide, mais en étant d'une fiabilité constante sous pression.

Et cette distinction est plus importante qu'il n'y paraît.

Car une fois que l'on dépasse les simples prompts pour passer aux systèmes multi-agents, le véritable défi n'est plus "le modèle répond-il bien ?", mais :

Peut-il continuer à bien répondre — à travers des dizaines de tâches parallèles — sans faire planter le système ?

Une qualité qui ressemble à de la planification, pas juste à de la génération

La différence ne tient pas qu'à la stabilité. Elle se manifeste aussi dans la gestion des tâches complexes par K2.6.

Lorsqu'on lui demande de rédiger un PRD, le modèle ne se contente pas de répondre : il structure l'espace de résolution de lui-même. Analyse concurrentielle, témoignages utilisateurs, priorisation des fonctionnalités — rien de tout cela n'était explicitement demandé, mais c'est apparu comme si le système comprenait ce à quoi un PRD "complet" devrait ressembler.

Sur les tâches SEO, le comportement était similaire. Au lieu de suggérer immédiatement des mots-clés, K2.6 a d'abord déduit l'intention de recherche, puis aligné la stratégie de contenu en conséquence. Le résultat ressemblait moins à de la génération brute qu'à de la planification stratégique.

C'est une nuance subtile, mais capitale :

Vous ne recevez plus seulement des réponses, vous recevez une réflexion organisée.

Et dans les environnements multi-agents, cela se cumule. Lorsque chaque agent produit des sorties structurées et de haute qualité, la couche de coordination a beaucoup moins de travail de nettoyage à effectuer.

Le compromis : la stabilité a un prix

Cela dit, ces performances ne sont pas gratuites.

K2.6 est sensiblement plus lent que GLM 5.1, surtout concernant la latence du premier jeton. Le délai n'est pas négligeable : il est environ dix fois plus élevé. Dans une interaction simple, cela peut être tolérable. Mais dans un système où 23 agents tournent en parallèle, chaque étape ajoute une petite pause, et ces pauses s'accumulent.

Cela vient en partie de son architecture. K2.6 utilise une conception de mélange d'experts (MoE), avec environ 1 000 milliards de paramètres au total et 32 milliards activés par inférence. Cette échelle apporte de la puissance, mais aussi une surcharge de planification. Et comme il s'agit encore d'une version préliminaire, il est probable que l'optimisation de l'inférence n'ait pas encore atteint son plein potentiel.

Le compromis devient donc clair :

- Si vous privilégiez le débit et la vitesse, cela compte.

- Si vous privilégiez la stabilité et des sorties structurées à grande échelle, le jeu en vaut la chandelle.

OpenCode × K2.6 — D'un prompt à neuf flux de travail parallèles

Si l'expérience Claude Code montre comment K2.6 se comporte sous pression, OpenCode révèle une autre facette : sa façon d'organiser le travail.

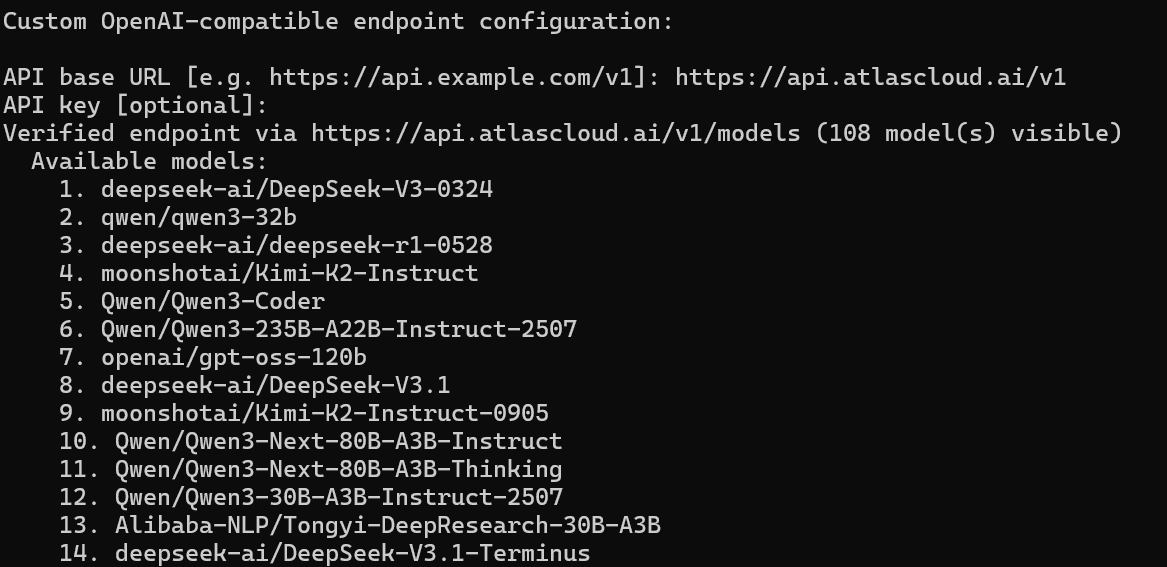

K2.6 introduit une couche de coordination appelée AgentSwarm, où un seul agent "Coordinateur" peut générer des dizaines de sous-agents spécialisés, chacun affecté à un rôle précis. Au lieu de gérer une tâche étape par étape dans un thread unique, le système la décompose et exécute plusieurs processus en parallèle.

Pour visualiser cela, prenez cet exemple :

Un chercheur a demandé à K2.6 de produire un profil approfondi de Dario Amodei, retraçant son parcours depuis son doctorat en physique à Princeton jusqu'à la création d'Anthropic. Au lieu de traiter cela comme une tâche de génération unique, K2.6 l'a décomposée en neuf pistes parallèles.

Chaque piste avait une responsabilité distincte. Un agent s'est concentré uniquement sur la recherche d'informations publiques. Un autre a géré la mise en page et le formatage du contenu en un PDF structuré. Un agent séparé a construit un jeu de données des points de décision clés de sa carrière. Pendant ce temps, un agent de rédaction a produit un récit à la première personne intitulé "Cher 2008".

Tout cela a été exécuté simultanément.

Le résultat n'était pas qu'une simple réponse, mais un package coordonné : une présentation de 80 diapositives, appuyée par des données structurées et des documents mis en forme. Ce qui aurait normalement nécessité plusieurs outils, sessions et un assemblage manuel a été produit comme un livrable unifié.

Pourquoi cela change votre façon d'utiliser l'IA

Le moteur clé ici est le système de Compétences (Skill system).

Au lieu de traiter chaque tâche comme un nouveau prompt, K2.6 vous permet de charger des connaissances structurées — un rapport Goldman Sachs, une analyse concurrentielle ou un cahier des charges bien rédigé — et de les transformer en une "Compétence" réutilisable. Lorsqu'un sous-agent s'exécute, il hérite de ce framework : le style analytique, le ton, et même la structure.

Avec le temps, cela transforme votre système en quelque chose de très différent d'un flux de travail basé sur les prompts.

Cela devient un pipeline de production reproductible.

Et cela conduit à un changement dans la façon dont vous concevez l'utilisation de l'IA :

Vous ne sollicitez plus un modèle, vous gérez une équipe.

Si vous construisez des workflows basés sur des agents, cette différence est difficile à ignorer.

Les quatre outils se connectent via

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6FAQ

-

Quelle est la différence entre utiliser Hermes Agent et appeler l'API Kimi K2.6 directement ?

La différence fondamentale réside dans l'exécution vs la réponse.

Lorsque vous appelez l'API Kimi K2.6 directement, vous obtenez essentiellement une réponse unique par requête. Même pour des tâches complexes, vous devez manuellement les décomposer, itérer sur plusieurs prompts et combiner les résultats vous-même. Cela fonctionne bien pour des cas simples ou interactifs, mais devient vite inefficace pour des workflows structurés.

Hermes change cela en introduisant l'orchestration de flux de travail. Au lieu d'un seul prompt, vous définissez un pipeline avec plusieurs étapes — recherche, planification, exécution, etc. — et Hermes assigne chaque étape à un agent. Ces agents peuvent se transmettre les résultats, valider les sorties intermédiaires et même retenter des étapes en cas d'erreur.

En pratique, vous passez du "prompt engineering" à l'orchestration de tâches. L'API devient un composant d'un système plutôt que le système lui-même.

-

Kimi K2.6 est-il bon pour les workflows multi-agents et l'automatisation ?

Oui, c'est là qu'il excelle particulièrement.

Dans les configurations multi-agents, les plus gros défis sont généralement :

- la cohérence entre les étapes

- la stabilité durant les exécutions longues

- la capacité à suivre des tâches structurées

Kimi K2.6 affiche de solides performances dans ces trois domaines. Utilisé au sein d'Hermes, il peut maintenir des sorties structurées à travers plusieurs étapes et gérer des chaînes de tâches complexes sans rompre le format ni perdre le fil.

Un autre aspect important est l'auto-correction. Si un résultat intermédiaire dévie de l'objectif, le système peut régénérer cette étape plutôt que de poursuivre avec des données erronées. Cela le rend bien plus adapté aux scénarios d'automatisation où vous ne souhaitez pas superviser manuellement chaque étape.

Globalement, il ressemble davantage à une couche d'exécution fiable qu'à un simple générateur de texte.

-

Pourquoi Kimi K2.6 est-il plus lent dans les workflows d'agents que d'autres modèles ?

La lenteur provient principalement de la manière dont il est utilisé, et pas seulement du modèle lui-même.

Dans un scénario de chat classique, vous n'attendez qu'une seule réponse. Dans un workflow d'agent, une seule tâche peut impliquer plusieurs étapes — chacune nécessitant un appel de modèle distinct, ajouté à la surcharge de coordination entre les agents. Cela introduit naturellement de la latence à chaque étape.

De plus, Kimi K2.6 est conçu avec une architecture plus complexe (routage type MoE), ce qui peut augmenter la charge d'inférence par rapport à des modèles plus petits ou optimisés. Combiné à une orchestration multi-agents, le délai devient plus perceptible.

Cependant, la contrepartie est que chaque étape produit des sorties de meilleure qualité et mieux structurées, ce qui réduit le besoin de retentatives ou de corrections manuelles. S'il est plus lent en temps de réponse brut, il peut s'avérer plus efficace au niveau global du workflow.