Il n'y a pas si longtemps, créer une vidéo sociale correcte nécessitait toute une équipe : écriture, tournage, montage, design sonore. D'ici 2026, l'ensemble de ce processus aura été compressé en une simple requête textuelle et un appel API. L'infrastructure permettant de convertir directement une description de produit, une ligne de script ou un brief de contenu en un clip vidéo publiable existe désormais.

Cet article explique à quoi ressemble cette infrastructure, comment construire par-dessus et ce qu'il faut pour la faire fonctionner de manière fiable à grande échelle.

Pourquoi l'automatisation de la vidéo sociale est cruciale aujourd'hui

La vidéo courte n'est plus seulement un divertissement. TikTok, les Instagram Reels et les YouTube Shorts sont devenus les principaux moteurs de diffusion de la culture, du marketing et du commerce électronique. Mais il existe une contrainte simple : la production de contenu ne suit pas la demande.

Même pour les créateurs expérimentés, produire une vidéo de haute qualité prend un temps considérable : écriture du script, storyboarding, tournage ou recherche d'images, montage, étalonnage, mixage sonore, sous-titres. Le goulot d'étranglement n'est que rarement les idées. C'est la vitesse d'exécution. Lorsqu'une tendance ne dure que quelques heures, le premier à publier gagne. La génération de vidéo par IA change la donne en transformant la production en série : ce qui était un investissement lourd devient un coût opérationnel courant.

Pourquoi les API sont plus importantes que les interfaces utilisateur

De nombreux outils vidéo IA proposent des interfaces web agréables : tapez une requête, cliquez sur un bouton, voyez le résultat. C'est pratique pour les créateurs individuels. Mais si vous construisez un système de contenu automatisé, une interface ne vous aidera pas. Ce qui permet une réelle mise à l'échelle, c'est l'API.

Les API apportent la programmabilité. Vous pouvez soumettre des tâches par lots. Vous pouvez ajuster automatiquement les formats d'image pour différentes plateformes. Vous pouvez intégrer la génération vidéo à votre plateforme SaaS en tant que fonctionnalité native. Vous pouvez effectuer des tests A/B programmatiques : générer dix variantes stylistiques de la même description de produit, les publier auprès de différents segments d'audience, puis utiliser les données d'engagement pour affiner la série de requêtes suivante.

Considérez une plateforme e-commerce qui répertorie deux cents nouveaux produits chaque jour. Faire une vidéo de présentation pour chacun manuellement nécessiterait des dizaines de professionnels de la vidéo. Avec une API, vous écrivez un script qui lit la base de données produits, assemble automatiquement un modèle de prompt, appelle l'API et envoie les résultats vers un outil de programmation sur les réseaux sociaux. Aucun humain n'ouvre de logiciel de montage. Les interfaces sont faites pour les gens. Les API sont faites pour les systèmes. La véritable avancée vient de ces derniers.

Le cycle de vie d'un appel API

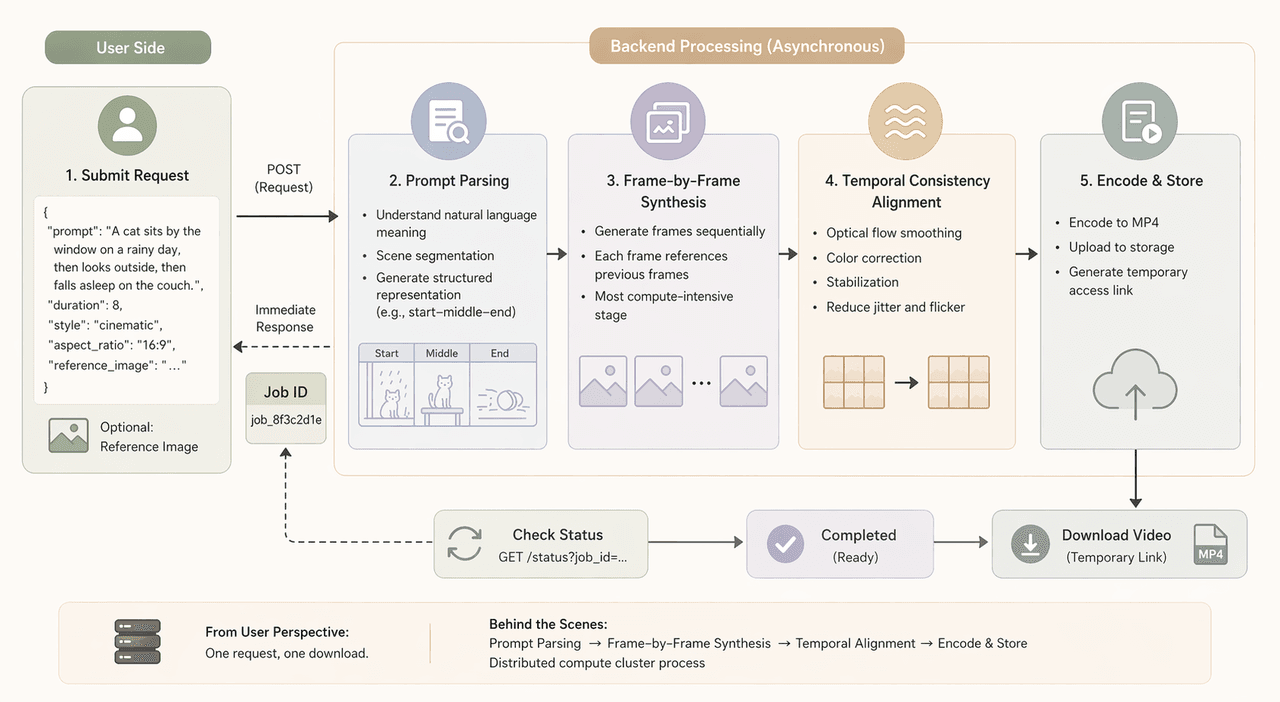

Suivons un appel API réel, de la soumission au téléchargement.

Tout d'abord, vous encapsulez votre prompt et vos paramètres dans un format JSON. La requête inclut généralement le prompt, la durée (disons huit secondes), un préréglage de style, le format (aspect_ratio) et parfois une image de référence pour verrouiller un personnage ou une scène. Vous envoyez cela au point de terminaison, et le système renvoie immédiatement un identifiant de tâche unique (job ID). La génération prenant de quelques secondes à quelques minutes, le processus est asynchrone.

Après la soumission, le backend commence à travailler.

La première étape est l'analyse du prompt (parsing) : transformer votre langage naturel en une représentation structurée. Cela inclut la segmentation de la scène : si votre description implique trois actions séquentielles, le modèle identifie le début, le milieu et la fin.

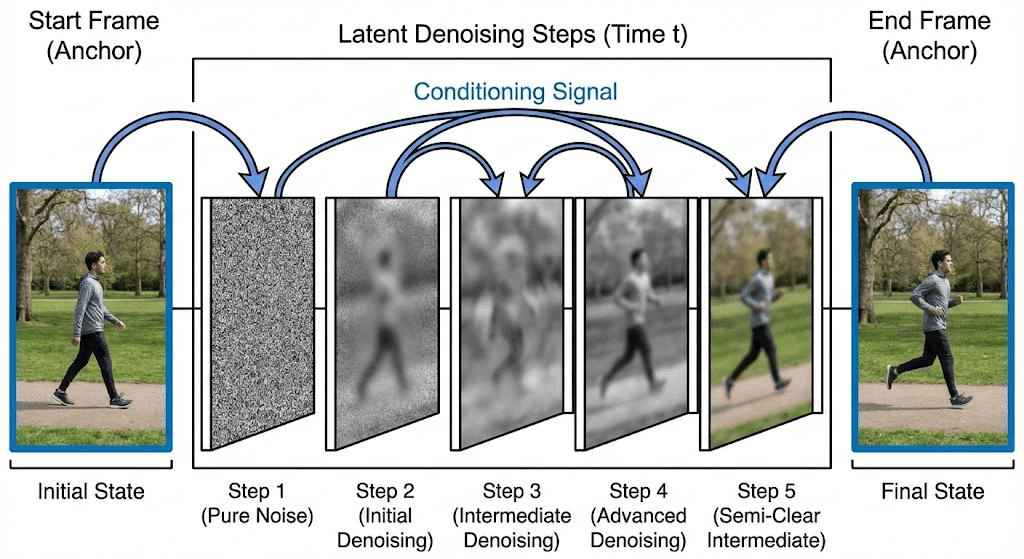

La deuxième étape est la synthèse image par image. Le modèle génère les images de manière séquentielle, chacune faisant référence aux précédentes pour maintenir la cohérence. C'est l'étape la plus intensive en calcul.

La troisième étape est l'alignement de la cohérence temporelle. Même avec les meilleurs efforts du modèle, les images brutes peuvent présenter un léger scintillement. Une étape de post-traitement applique un lissage par flux optique, une correction colorimétrique et une stabilisation.

Enfin, le système encode la vidéo en MP4, l'envoie vers un espace de stockage et génère un lien d'accès temporaire. Du point de vue de l'utilisateur, il s'agit d'une requête et d'un téléchargement. En coulisses, un cluster de calcul distribué a effectué un travail important.

Comment différentes personnes utilisent cela

Les créateurs indépendants utilisent l'API pour multiplier leur production. Vous pouvez prendre une idée centrale et générer une douzaine de variantes : changer la tonalité des couleurs, modifier le style de la voix off, ajuster le mouvement de caméra. Au lieu de trois vidéos par semaine, vous pouvez en faire dix par jour. Le goulot d'étranglement se déplace de la vitesse de production vers votre jugement sur ce qu'il faut garder.

Démo rapide : Une idée, plusieurs variantes

plaintext1import requests 2 3API_KEY = "VOTRE_CLE_API" 4url = "https://api.atlascloud.ai/api/v1" 5 6styles = ["cinematic", "anime", "documentary", "vlog"] 7 8for style in styles: 9 payload = { 10 "prompt": "Un chat assis près de la fenêtre, le vent souffle sur le rideau", 11 "duration": 6, 12 "style": style, 13 "aspect_ratio": "1:1" 14 } 15 16 res = requests.post(url, json=payload, headers={ 17 "Authorization": f"Bearer {API_KEY}" 18 }).json() 19 20 print(f"{style} → job_id:", res["job_id"])

Les équipes marketing utilisent des approches plus systématiques. Un cas d'usage courant est la localisation multi-régions. Une marque mondiale se lançant dans vingt pays peut générer une vidéo maîtresse, puis exécuter un script qui remplace automatiquement le texte à l'écran, la voix off et les détails visuels pour chaque langue. Un mois de travail devient quelques jours.

L'e-commerce est un autre domaine en forte croissance. Une image produit statique combinée à une courte description devient une vitrine dynamique. Pour une montre connectée, vous saisissez une description détaillée avec éclairage et mouvement de caméra, et le système génère une boucle de six secondes. Placés sur une page produit, ces clips surpassent souvent les images statiques. Et vous pouvez traiter tout le catalogue par lots.

Les développeurs et les plateformes SaaS conditionnent la génération vidéo comme un service. Un outil de programmation pour les réseaux sociaux pourrait intégrer une API afin que les utilisateurs puissent saisir un tweet et laisser l'outil le transformer automatiquement en script vidéo, générer la vidéo et la programmer. Ces plateformes font de la génération vidéo une capacité fondamentale.

Rendre la production vidéo par IA exploitable

Une dure réalité : les sorties brutes des API sont rarement prêtes à être publiées. Les systèmes de production performants entourent l'API de plusieurs couches.

Premièrement, le prompt engineering. Les équipes matures maintiennent des bibliothèques de modèles de prompts pour différentes catégories, styles et plateformes. Un prompt pour Instagram Reels met l'accent sur la saturation élevée et les coupes rapides. Un prompt pour YouTube Shorts se concentre sur la fluidité narrative. Les modèles possèdent des variables que les scripts remplissent dynamiquement.

Deuxièmement, la gestion de la qualité de génération. Le même prompt exécuté cinq fois peut produire trois clips utilisables et deux avec des défauts (un doigt déformé, un objet d'arrière-plan illogique). Vous écrivez des contrôles automatisés qui détectent les échecs courants et marquent les clips pour une nouvelle génération.

Troisièmement, les pipelines de post-traitement. Après la génération, vous pourriez avoir besoin d'ajouter un logo, une introduction/outro ou des sous-titres incrustés. Faites-le avec des scripts, pas en réimportant le tout dans un logiciel de montage.

Quatrièmement, la mise en cache et la réutilisation. Si votre bibliothèque utilise de manière répétée le même produit ou personnage, mettez les résultats en cache. Cela réduit les coûts et maintient la cohérence visuelle.

Toutes ces couches réunies forment un véritable moteur de contenu. L'API n'est qu'un composant. La valeur réside dans la manière dont vous assemblez le système.

Ce qui ne fonctionne pas encore

La génération de vidéo par IA est loin d'être parfaite. Si vous essayez de générer quelque chose de plus long qu'environ quinze secondes, vous rencontrerez probablement des problèmes : les objets se déforment, la logique de scène s'effondre, les personnages deviennent incohérents. La fenêtre narrative efficace des modèles actuels est courte.

Le coût computationnel est une autre contrainte. Générer une seconde de vidéo de haute qualité demande beaucoup plus de temps GPU que de générer une image. Les prix chutent, mais pour les équipes ayant besoin de centaines de vidéos par jour, le calcul reste important. Une approche pragmatique réserve la génération coûteuse aux contenus critiques et utilise des options moins chères pour les tests.

L'imprévisibilité des prompts est une gêne persistante. Le même prompt peut donner des résultats différents aujourd'hui par rapport à hier. Les résultats varient énormément selon les fournisseurs. Les systèmes automatisés ont besoin d'une robustesse supplémentaire : partez du principe que chaque génération ne sera pas à la hauteur et intégrez des tentatives de répétition (retries).

La cohérence narrative entre plusieurs scènes reste très faible. Vous pouvez générer "une personne buvant un café dans un café" et aussi générer "la même personne sortant dans la rue", mais le modèle ne comprendra pas automatiquement la transition. Pour obtenir une vidéo multi-scènes, vous devez actuellement décrire chaque coupe en détail.

Vers quoi nous nous dirigeons

Malgré ces limitations, la direction est claire. La génération vidéo ne restera pas un outil isolé. Au cours des prochaines années, attendez-vous à des pipelines de contenu entièrement automatisés : un système scanne les tendances chaque matin, génère automatiquement des concepts vidéo, exécute de petits tests, sélectionne les meilleurs résultats et les amplifie. Aucun humain ne prend de décision créative, seule la revue finale de sécurité de la marque est humaine.

Attendez-vous également à des systèmes créatifs agents. Vous donnez un objectif à un agent IA — "augmenter la notoriété de ce nouveau produit cette semaine" — et il propose des directions de scripts, génère des candidats, publie auprès d'audiences tests, analyse les retours, ajuste la stratégie et génère la série suivante.

Des flux vidéo personnalisés en temps réel apparaîtront. Une application de fitness pourrait produire un résumé hebdomadaire personnalisé avec les propres données de l'utilisateur, des visuels de progression et une voix off encourageante.

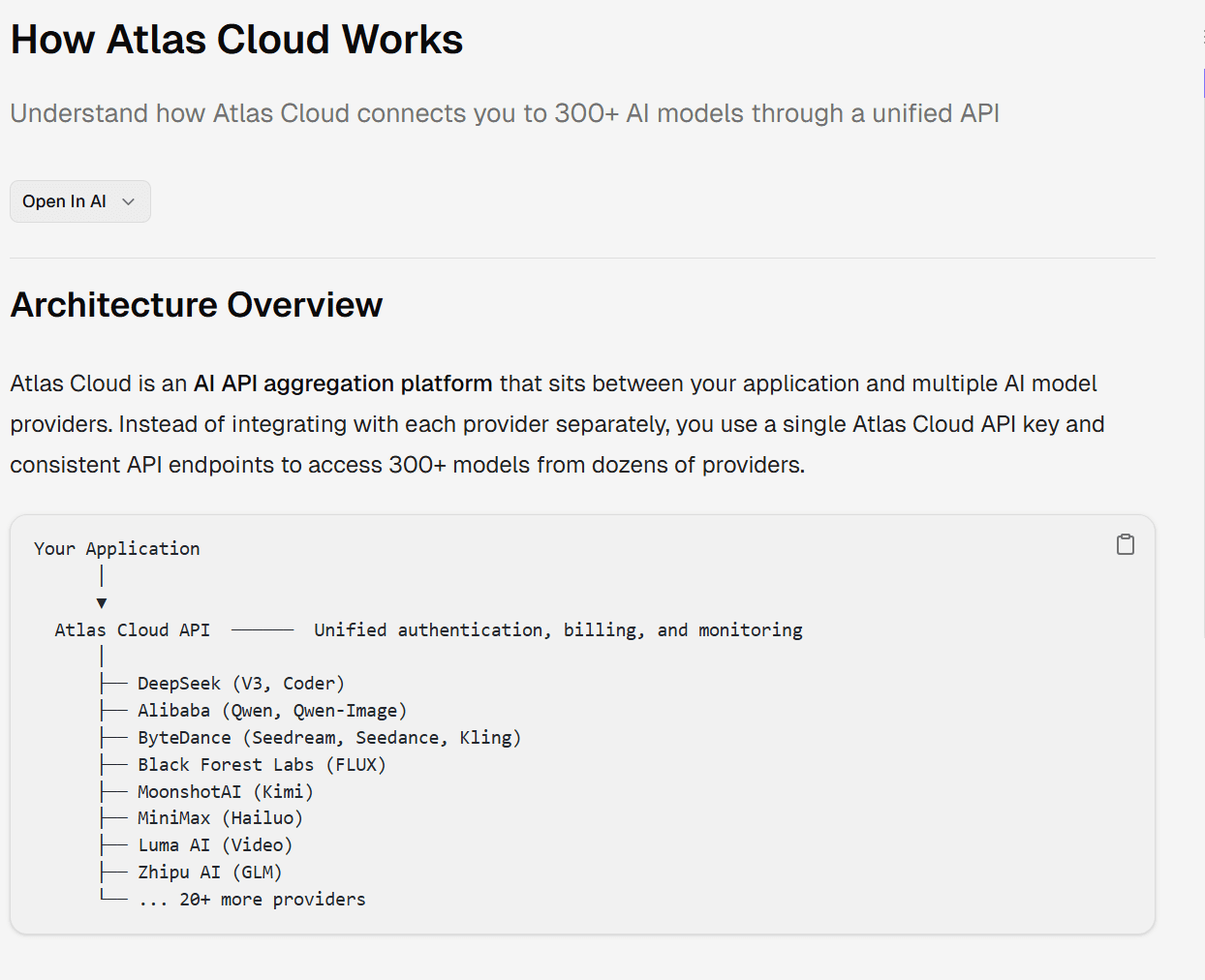

Enfin, attendez-vous à une intégration profonde avec les suites d'automatisation marketing. Des plateformes comme AtlasCloud permettent d'agréger plusieurs modèles pour la génération d'images et de vidéos, facilitant ainsi leur intégration par les utilisateurs dans leurs propres projets créatifs ou commerciaux.

Pensée finale

Le passage du montage manuel à la génération par API n'est pas une simple mise à jour d'outil. C'est un changement structurel dans la manière dont le contenu est produit et consommé. Les API de génération vidéo deviennent la couche d'infrastructure du storytelling numérique moderne. Pour les créateurs, cela signifie une mise à l'échelle. Pour les développeurs, une opportunité. Pour les plateformes, l'automatisation. Et pour Internet, une transition de la production par lots statiques vers des systèmes médiatiques génératifs continus. Cette transition est déjà en marche. Quiconque possède une clé API et une idée peut commencer à construire son propre pipeline vidéo — nul besoin d'un budget d'un million de dollars.