**H1:**DeepSeek-V4 プレビュー版リリース:100万トークンのコンテキスト、エージェント機能の強化、およびオープンソースでのモデル公開

本日(4月24日)、DeepSeekは最新のモデルシリーズであるDeepSeek-V4のプレビュー版を正式にリリースし、オープンソースとして公開しました。

DeepSeek-V4は最大100万トークンのコンテキストをサポートし、エージェント機能、一般知識、推論能力において、国内モデルおよびオープンソースモデルの中でトップクラスの性能を実現しています。本シリーズは2つのサイズで展開されます。

- DeepSeek-V4-Pro — フラッグシップモデル。総パラメータ数1.6兆を誇る大規模なMoE(Mixture of Experts)モデルですが、フォワードパスあたりの有効パラメータ数は490億に抑えられており、これが効率性の鍵となっています。

- DeepSeek-V4-Flash — より高速でコスト効率に優れたオプション。V4-Proと同じMoE設計を採用しつつ、より小規模(総数2840億 / 有効130億)にすることで、より高速かつ安価な推論を可能にしました。

- 両モデルとも100万トークンのコンテキストウィンドウを共有しており、完全オープンソースかつAPIアクセスが可能です。

| モデル名 | パラメータ数 | 有効数 | 事前学習データ | コンテキスト長 | オープンソース | APIサービス | Web/App利用モード |

| deepseek-v4-pro | 1.6T | 49B | 33T | 1M | ✓ | ✓ | エキスパートモード |

| deepseek-v4-flash | 284B | 13B | 32T | 1M | ✓ | ✓ | ファストモード |

本日より、chat.deepseek.comまたは公式アプリからDeepSeek-V4と対話が可能です。APIも公開されており、

1model_name1deepseek-v4-pro1deepseek-v4-flash以前に発表した推測やリリース前の分析(DeepSeek V4 期待値ガイドおよび技術詳細解説を参照)に加え、今回は公式情報源からの確定した詳細をお届けします。本記事では、リリース内容、新機能、そして現在のAIモデル開発や評価において何が重要なのかを解説します。

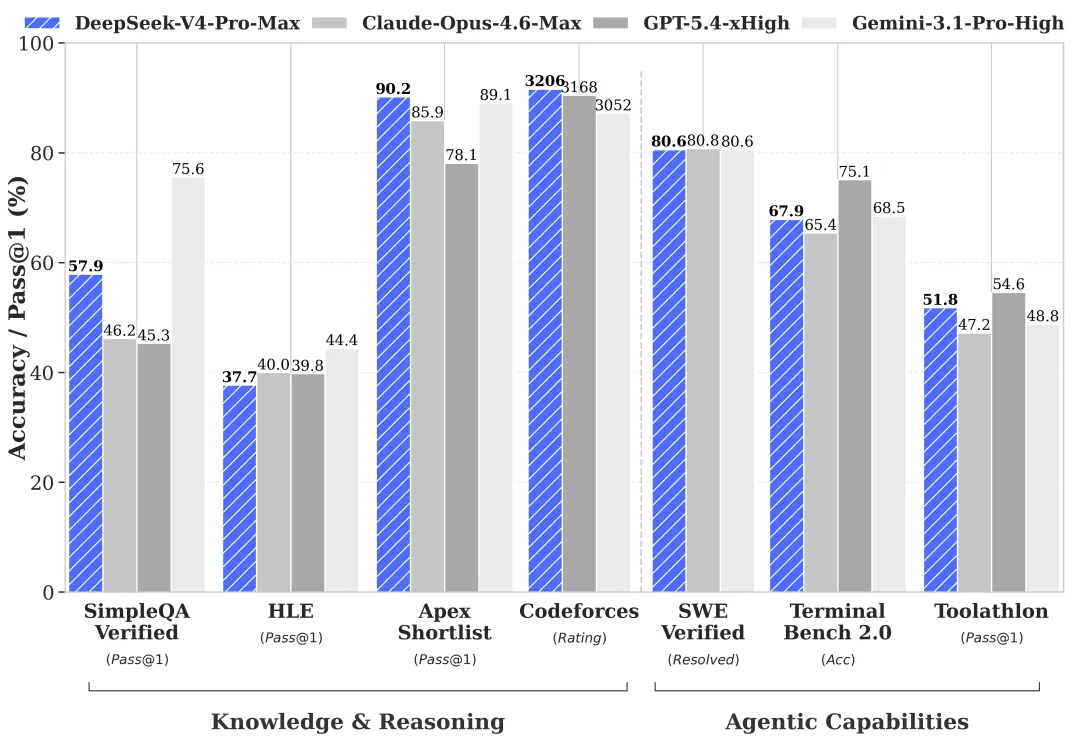

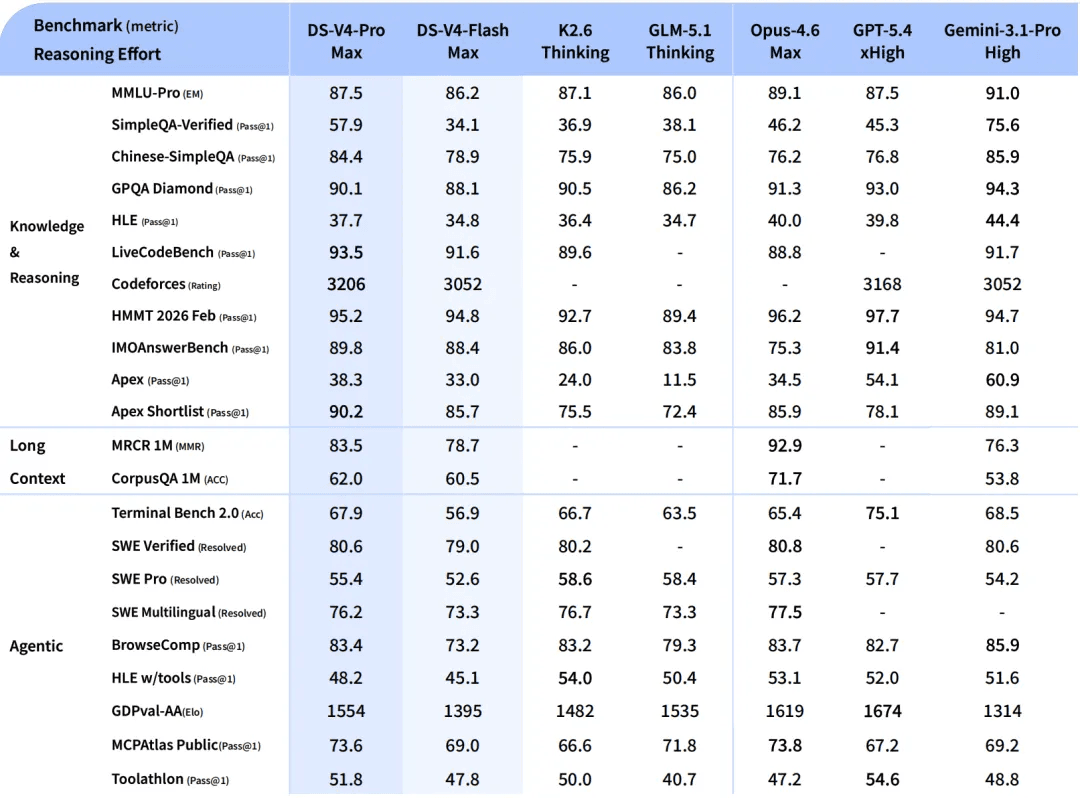

DeepSeek-V4-Pro:クローズドソースのトップモデルに匹敵

エージェント機能の大幅な強化。 前世代と比較して、DeepSeek-V4-Proはエージェントタスクにおいて劇的な進化を遂げました。Agentic Coding(AIエージェントによるコーディング)のベンチマークにおいて、V4-Proは現在、すべてのオープンソースモデルの中でトップに位置しています。DeepSeek社内でも、V4-Proがコーディングエージェントとして採用されており、社員のフィードバックによれば、その体験はClaude Sonnet 4.5を上回り、ノンシンキングモードではClaude Opus 4.6に近い出力品質を実現しています(Opus 4.6のシンキングモードには及びませんが)。

豊富な世界知識。 DeepSeek-V4-Proは、世界知識のベンチマークにおいて他のオープンソースモデルを大きく引き離しており、クローズドソースのトップモデルであるGemini Pro 3.1にわずかに及ばない程度となっています。

世界クラスの推論能力。 数学、STEM、競技プログラミングの評価において、DeepSeek-V4-Proはこれまでベンチマークされたすべてのオープンソースモデルを凌駕し、世界をリードするクローズドソースモデルの性能に匹敵します。

DeepSeek-V4-Flash:高速かつ手頃な選択肢

V4-Proと比較すると、DeepSeek-V4-Flashは世界知識の面ではわずかに劣りますが、同等の推論性能を発揮します。パラメータ数が少なく、有効化コストが低いため、V4-Flashはより高速な応答時間と経済的なAPI料金を実現しています。

エージェントベンチマークでは、単純なタスクにおいてはV4-Proと同等の性能を発揮しますが、複雑なタスクでは依然として差が見られます。

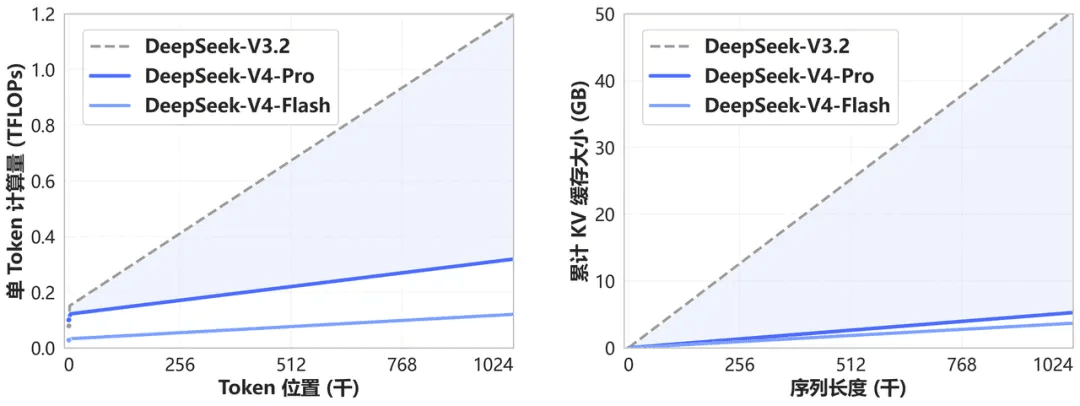

アーキテクチャの革新と極限のコンテキスト効率

DeepSeek-V4は、トークン次元で圧縮を行う新しいアテンション機構を導入しました。これに**DSA(DeepSeek Sparse Attention)**を組み合わせることで、従来の手法と比較して計算コストとメモリ要件を大幅に削減しつつ、世界トップレベルの長文脈処理性能を実現しています。

今後は、100万トークンのコンテキストがすべてのDeepSeek公式サービスの標準となります。

エージェントユースケース向けの特化型最適化

DeepSeek-V4は、Claude Code、OpenClaw、OpenCode、CodeBuddyなど、主要なエージェント製品向けに微調整と最適化が行われています。コード生成、ドキュメント作成、その他のエージェント主導タスク全体で性能向上が確認されています。

このようなフレームワーク固有のチューニングは、実際には非常に重要です。単体では高性能でも、構造化されたエージェントループ内では動作が不安定になるモデルは、信頼性の高いデプロイが困難だからです。主要なエージェントフレームワークを第一級の最適化ターゲットとして扱うという決断は、AIの実運用がどのように進化しているかを反映しています。

DeepSeek-V4 APIアクセス

V4-ProおよびV4-Flashは、DeepSeek API経由で利用可能です。OpenAI ChatCompletionsインターフェースとAnthropicインターフェースの両方をサポートしているため、既存の統合を最小限のコード変更でV4モデルに切り替えることができます。

1base_url1model1deepseek-v4-pro1deepseek-v4-flash両モデルとも最大100万トークンのコンテキスト長をサポートし、**ノンシンキング(non-thinking)モードとシンキング(thinking)**モードの両方を提供します。シンキングモードでは、

1reasoning_effort1high1max1max⚠️ 非推奨通知: レガシーモデル名の

およびtext1deepseek-chatは、**3ヶ月後(2026年7月24日)**に廃止されます。移行期間中は、それぞれtext1deepseek-reasonerのノンシンキングモードおよびシンキングモードにマッピングされます。プロダクション環境でこれらのモデル名を使用している場合は、早急に移行計画を立ててください。text1deepseek-v4-flash

オープンソースウェイトとローカルデプロイ

- モデルウェイト:Hugging Face | ModelScope

- 技術レポート:DeepSeek-V4 PDF

ローカルまたはオンプレミスでのデプロイを検討しているチームにとって、このパラメータ規模(特にV4-Proの総数1.6T)はハードウェアに多大な負荷をかける点に注意が必要です。オープンソースとしての利用可能性は、企業のコンプライアンスやカスタマイズのユースケースにおいて大きな利点ですが、多くのチームにとってはクラウドAPIアクセスの方が現実的な出発点となるでしょう。

今回のDeepSeek-V4リリースの意味

今回のリリースには、注目すべき点が3つあります。

第一に、100万トークンのコンテキストへのコミットメントは、見かけ以上の重要性があります。DeepSeekはこれをプレミアム枠として提供するのではなく、すべての公式サービスのベースラインとしています。これはオープンソースのフロンティアがどこに向かっているかを示すシグナルであり、他のすべてのプロバイダーに対して追従を促す無言のプレッシャーとなります。

第二に、エージェント優先の最適化(特にClaude CodeやOpenCode等への適応)は、DeepSeekがデプロイをどのように捉えているかという成熟度を反映しています。ベンチマーク性能は最低条件であり、本番環境で重要なのは開発者が実際に使うツールの中でどのような振る舞いをするかです。

第三に、Claude Opus 4.6との誠実な競合評価が注目に値します。全面的に優れていると主張するのではなく、「Sonnet 4.5より優秀」「ノンシンキングモードではOpus 4.6に肉薄する」「シンキングモードではOpus 4.6に及ばない」という階層的な評価を示しています。この具体性が、主張の信頼性を高めています。

エージェントワークフロー、長文ドキュメント処理、あるいは複雑な推論タスクのためにモデルを評価している開発者にとって、DeepSeek-V4-Proは現在、極めて強力なオープンソースの選択肢となりました。コスト最適化や低レイテンシが求められるパイプラインには、V4-Flashが妥当な軽量代替案を提供します。

Atlas CloudでDeepSeek-V4を試す

Atlas Cloudは、インフラ管理を気にすることなく、世界をリードするAIモデルに信頼性とコスト効率の良いアクセスを求める開発者やチームのために設計された、プロダクショングレードのAIプラットフォームです。統一されたAPI、透明性の高い料金設定、エンタープライズレベルのコンプライアンス(SOC 2準拠、HIPAA対応)により、Atlas Cloudは開発者がオペレーションではなく構築に集中できるようにします。

Atlas CloudでDeepSeekを。 私たちはすでにDeepSeekファミリー(DeepSeek V3.2、V3.2 Fast、V3.2 Speciale、V3.2 Exp)をサポートしており、単一のAPIエンドポイント経由で競争力のある価格で今日から利用可能です。Atlas Cloud上のDeepSeekモデルは、長文脈ワークロードとエージェントパイプライン向けに最適化されており、コンテキストウィンドウをフル活用でき、量子化ロスもありません。**DeepSeek以外にも、**Atlas CloudではLLMの広大なエコシステムにまたがる300以上のモデルにアクセス可能です。

DeepSeek-V4がAtlas Cloudに登場します。 現在、DeepSeek-V4-ProおよびV4-Flashの統合を積極的に進めています。ローンチ発表をお待ちください。それまでの間、プラットフォームで既に利用可能なモデル群をぜひ探索してみてください。