4月上旬、突如として「HappyHorse-1.0」というモデルが登場しました。これはArtificial Analysisのビデオリーダーボードの4部門でトップに立ち、ByteDanceのSeedance 2.0やKlingを大差で圧倒しました。

プレスリリースはなく、ブログ記事もなく、企業名も伏せられていました。モデルページにはただ「近日公開(coming soon)」とだけ記されていました。

4月10日、AlibabaのATH部門がこれを認めました。HappyHorseはATHのイノベーションユニットによる社内研究開発プロジェクトであり、現在はプライベートベータ版です。APIは4月30日に公開されます。

また、HappyHorse-1.0は完全にオープンソース化される予定です。音声と動画をネイティブに同時生成する初のオープンソースビデオモデルであると謳われています。

このような「静かな立ち上げ」の後に「華々しい発表」を行う手法は、中国のAI企業の間でトレンドになりつつあります。Xiaomiはコードネーム「Hunter Alpha」でこれを行い、Zhipuは新しいGLMモデルに「Pony Alpha」を使用しました。

この記事では、HappyHorseについて判明している事実と、それが意味するところを紐解きます。

リーダーボードにおけるHappyHorseの立ち位置

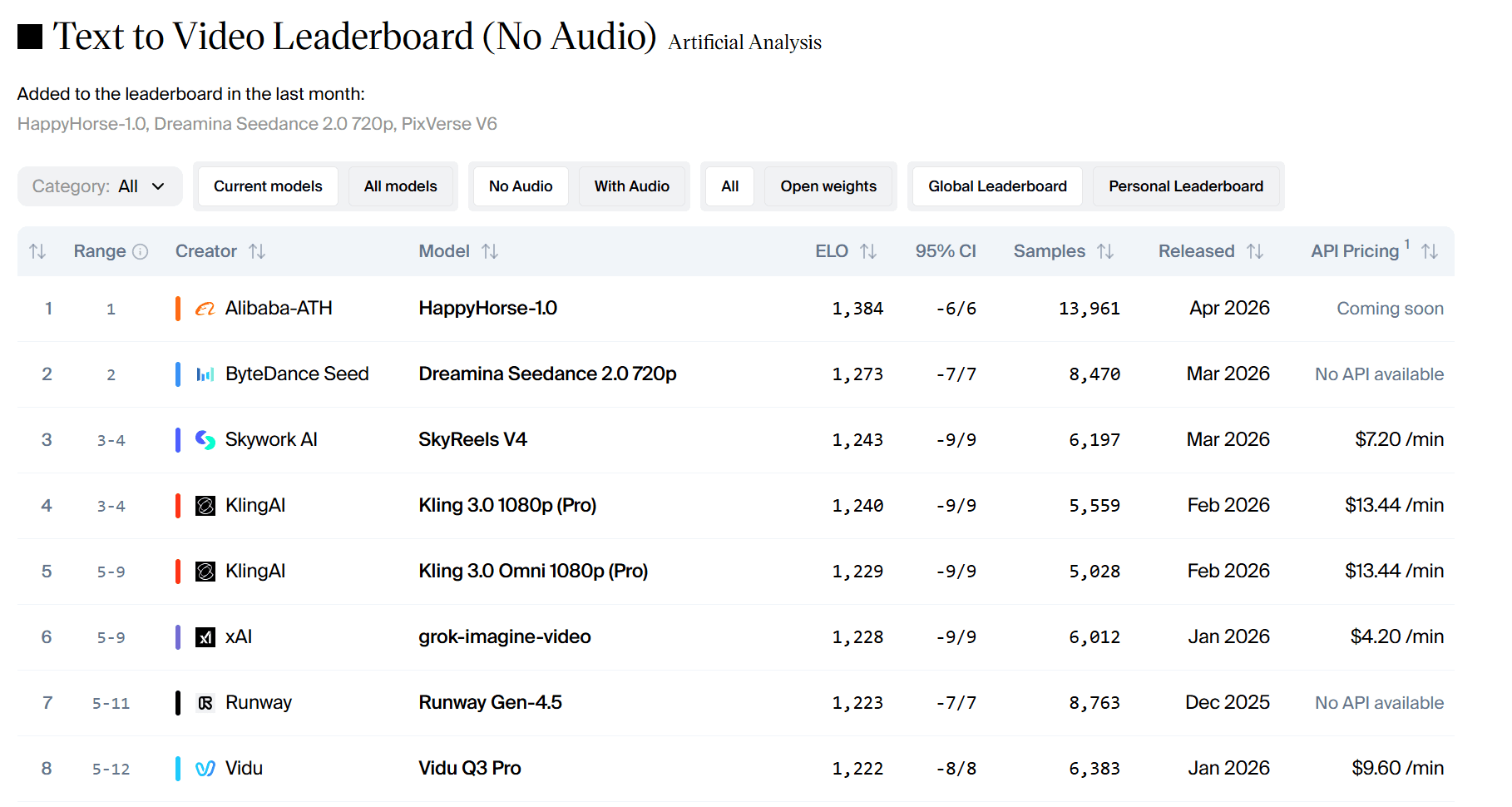

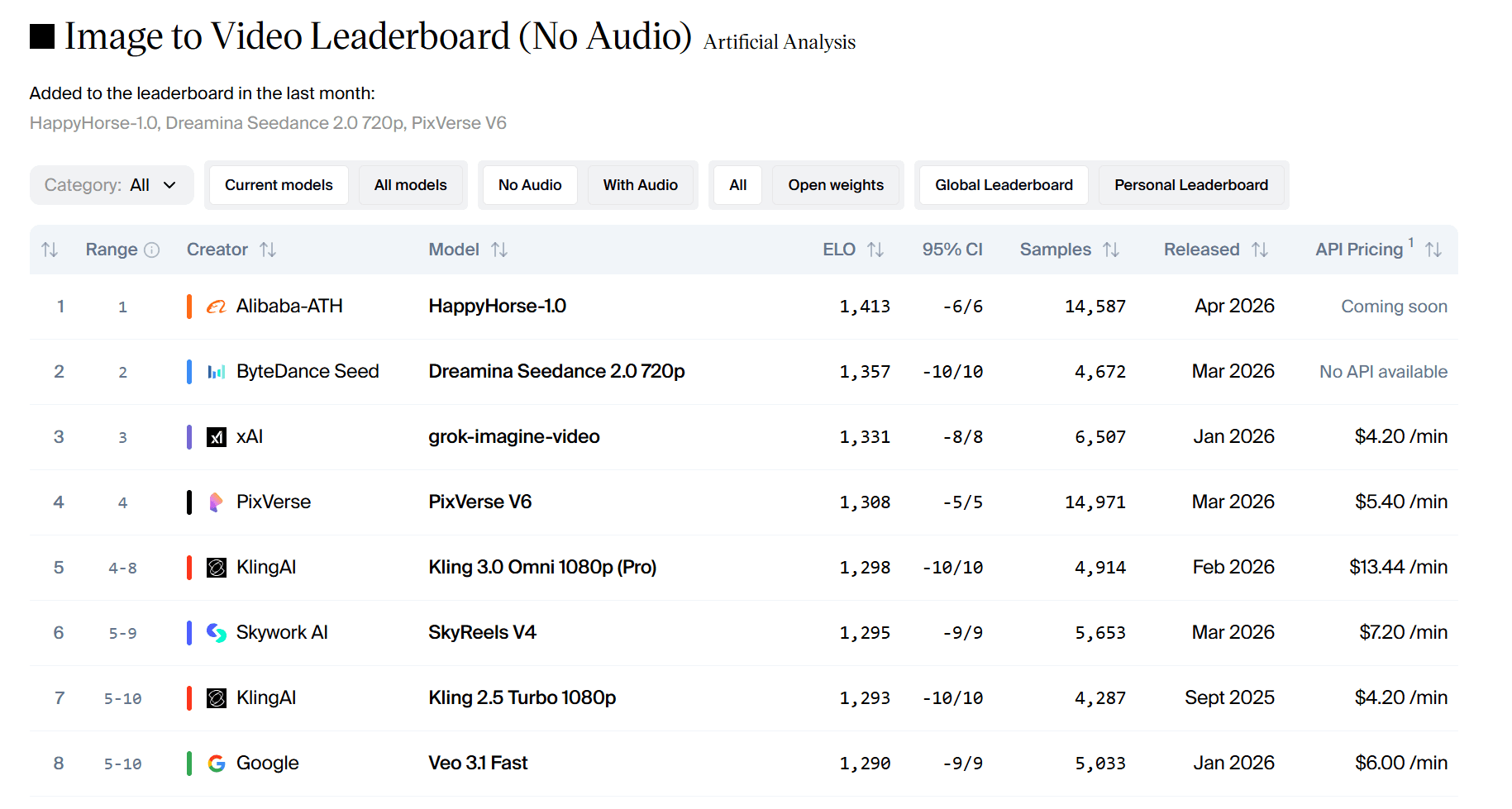

Artificial Analysisは4つのリーダーボードを運営しています。音声なしのテキスト・トゥ・ビデオ、音声なしの画像・トゥ・ビデオ、音声ありのテキスト・トゥ・ビデオ、音声ありの画像・トゥ・ビデオです。

4月13日正午時点のデータは以下の通りです:

- テキスト・トゥ・ビデオ(音声なし):1384 Elo。Seedance 2.0を111ポイント上回っています。

- 画像・トゥ・ビデオ(音声なし):1413 Elo。同プラットフォームで記録された最高スコアです。

Eloスコアにおいて、60ポイント以上の差があれば明確な選好差があると言えます。111ポイントという差は、ブラインドテストにおいてユーザーが圧倒的にHappyHorseを選んだことを示しています。

しかし、音声を含めると状況は一変します。その差はわずか1〜2ポイントに縮まり、実質的な引き分けとなります。これは、HappyHorseの視聴覚同期や音質が劇的に優れているわけではないことを示しています。この点に関しては、Seedanceとほぼ同等です。

HappyHorseとSeedance 2.0の比較

| 項目 | HappyHorse-1.0 | Seedance 2.0 |

| モデルの性質 | オープンソース | クローズドな商用システム |

| アーキテクチャ | 統合型Transformer | 双方向拡散Transformer (DB-DiT) |

| マルチモーダル能力 | 音声・動画の同時生成 (ワンパス) | マルチモーダル入力 (テキスト、画像、動画、音声) |

| 動画生成モード | ワンパス生成 | パイプラインベースの生成 |

| 動画生成の長さ | 約5~10秒 (1080p) | 最大約60秒 (2K) |

両者は異なる哲学を代表しています。

HappyHorse‑1.0:オープンソース。統合型Transformer。音声・動画の同時生成。ワンパス処理。7言語のネイティブ・リップシンク対応。150億パラメータ。H100環境で5秒の1080p動画を生成するのに38秒かかります。

Seedance 2.0:クローズドな商用システム。双方向拡散Transformer (DB‑DiT)。マルチモーダル入力。60秒の2K動画生成が可能。8言語以上のリップシンクに対応。

純粋な視覚的品質に関しては、ブラインドテストでHappyHorseが明確に選ばれています。視聴覚の同期や音質に関しては両者はほぼ互角です。実用性に関しては、SeedanceはVolcano Engineなどを通じてすでに成熟したAPIを提供しています。HappyHorseのAPIは4月30日に公開予定であり、プライベートベータでの性能は現在も検証中です。

rtificial AnalysisによるHappyHorse-1.0とDreamina Seedance 2.0(音声ありのテキスト・トゥ・ビデオ)の生成例比較:

プロンプト:大レースのゴールラインのパイロンになることを夢見る、臆病な小さなカラーコーンについてのピクサー風ショートアニメ。他のコーンはその野心を笑う。工事作業員が誤ってマラソン大会のゴールラインにそれを設置してしまう。ランナーたちが通り過ぎる中、コーンのペイントされた表情が恐怖から喜びに変わる。頭上に紙吹雪が舞う。他のコーンはテレビでそれを見てインスピレーションを受ける。音声:交通音から観客の歓声へ、そして高揚感のある音楽へ。

アーキテクチャについて

HappyHorseは異例のアプローチをとっています。

150億のパラメータを持ち、40層の統合型セルフアテンションTransformerを使用しています。テキスト、動画、音声のトークンすべてが同一のシーケンスに入力され、共同モデル化されます。これは、「動画を先に生成してから音声を追加する」という一般的なパイプラインとは大きく異なります。ここでは、音とシーンが最初から同じ意味空間に存在します。

このモデルはDMD‑2蒸留とMagiCompilerによるフルグラフ最適化を使用しています。単一のH100 GPUで、5秒の1080p動画を生成するのに約38秒かかります。

英語、北京語、広東語、日本語、韓国語、ドイツ語、フランス語の7言語のネイティブ・リップシンクに対応しています。単語誤り率(WER)は、オープンソースモデルの中でも最低水準です。

Artificial Analysisのブラインドテスト参加者は、HappyHorseは特に人物描写において真価を発揮すると述べています。肌の質感や、動作の滑らかさが優れています。テストサンプルの60%以上が人物のポートレートやトーキングヘッドのクリップであったことが、このモデルを首位に押し上げる要因となりました。

とはいえ、批判もあります。リークされた動画では、不自然な波紋、動きの速い被写体でのストライプの乱れ、大画面での画質低下などが指摘されています。

オープンソース化とアクセス計画

4月9日、HappyHorse‑1.0は完全なオープンソース化を発表しました。GitHubリポジトリは公開済みであり、重みも完全にオープンで、商用制限はありません。

公式サイトでは、テキスト・トゥ・ビデオと画像・トゥ・ビデオのオンラインデモを提供しています。Alibaba ATHによると、APIは4月30日に一般公開される予定です。

ただし注意点があります。公式チームによると、オンラインに出回っている「公式サイト」のほとんどは偽物です。本物はまだ完全に稼働していません。

市場への影響と本件の重要性

HappyHorseは、OpenAIがSoraの開発を停止してから2週間後に登場しました。その動きはAI動画分野の停滞の兆しと見られていましたが、中国のモデルがそのバトンを引き継ぎました。

市場は迅速に反応しました。Alibabaの株価は確認後に7%以上急騰し、その後も上昇を続けました。4月10日の終値では、3%以上上昇して126.6香港ドルとなりました。

戦略的レベルで見ると、HappyHorseはATHがトップクラスのマルチモーダルモデルを構築できる2つ目のチームを擁していることを示しています。このチームはビジネスの背景を持ち、ユーザーのニーズと商用シナリオを理解しています。これにより、Tongyi Lab(基礎研究に注力)とイノベーションユニット(実際のビジネス課題から応用を構築)という2つのエンジンの構造が構築されました。

タイムラインを見てみましょう。3月上旬にLin Junyang氏が退社し、3月16日にATHが設立されました。4月2日にはQwen 3.6 PlusがOpenRouterのグローバル呼び出し量で1位を獲得し、4月8日にはHappyHorseがArtificial Analysisで首位に立ちました。わずか1ヶ月で、Alibabaは言語モデルと動画モデルの両方で強力な結果を出しました。

チームの背景:Zhang Di氏とAlibaba ATH

HappyHorseの背後には、大物であるZhang Di氏の存在があります。

彼は元々Kuaishouの副社長であり、Kling AIの技術リーダーを務めていました。彼は「Klingの父」と呼ばれています。2025年11月にKuaishouを退社し、チーフサイエンティストのZheng Bo氏の直属として、Alibabaの「Future Life Lab」の責任者に就任しました。

その5ヶ月後、彼のチームはHappyHorse‑1.0を構築し、KlingやByteDanceのSeedance 2.0を打ち負かしました。

このチームは当初、TaobaoのFuture Life Labに属していましたが、Alibabaの最新の再編により、ATHビジネスグループのAIイノベーションユニットに移動しました。

ATHは「Alibaba Token Hub」の略称で、3月16日にCEOのWu Yongming氏が設立し、自ら指揮を執っています。その使命は「トークンの作成、提供、応用」であり、Tongyi Lab、MaaSビジネスライン、Qianwen部門、Wukong部門、AIイノベーションユニットを統合するものです。

FAQ

HappyHorseをローカル環境で実行するにはどのようなGPUが必要ですか?

このモデルは150億パラメータあり、決して小さくありません。単一のH100環境で、5秒の1080p動画を生成するのに約38秒かかります。RTX 4090(VRAM 24GB)のようなコンシューマー向けGPUでは、量子化やオフロードが必要です。FP16推論では24GBを超える可能性が高いです。一部のユーザーからは4ビット量子化での成功が報告されていますが、品質は低下します。本格的な利用には、VRAM 40GB以上のクラウドGPUが推奨されます。あるいは、4月30日のAPI公開を待つのが賢明です。

自分のデータでHappyHorseをファインチューニングできますか?

ライセンス上は可能です。商用利用の制限もありません。しかし、150億パラメータのビデオモデルのファインチューニングは容易ではありません。H100やA100のクラスター、大規模な動画・音声ペアのデータセット、そして多大なエンジニアリングリソースが必要です。GitHubリポジトリには現時点でファインチューニングのスクリプトは含まれておらず、推論のみ可能です。チームは将来的な学習コードの公開を示唆していますが、期日は未定です。

DiscordやWeChatのコミュニティグループはありますか?

ありますが、非公式です。いくつかのAIコミュニティがDiscordやWeChatでスレッドを立ち上げています。公式チームはまだ正式なコミュニティチャンネルを開設していません。グループに参加する場合は、偽のリンクやフィッシング詐欺に注意してください。最新情報はGitHubリポジトリとAlibaba ATHの公式発表で確認するのが最善です。

このモデルはHugging Faceで公開されていますか?

執筆時点では公開されていません。チームはHugging Faceでのリリースに取り組んでいると述べていますが、まだ完了していません。現時点では重みはGitHubのみです。コミュニティメンバーが変換されたチェックポイントをHugging Faceにアップロードし始めていますが、これらは非公式です。安全を期すなら、公式のHugging Faceページが登場するまではGitHubソースを利用してください。