GLM-5.1とは?Zhipu AIの自律型コーディングモデル

GLM 5.1モデルがAtlas Cloudに間もなく登場します!

- GLM-5.1とは: GLM 5.1はZhipu AIの最も先進的なオープンソースモデルであり、オープンモデルの中で最強のプログラミング能力を誇り、Opus 4.6に匹敵します!

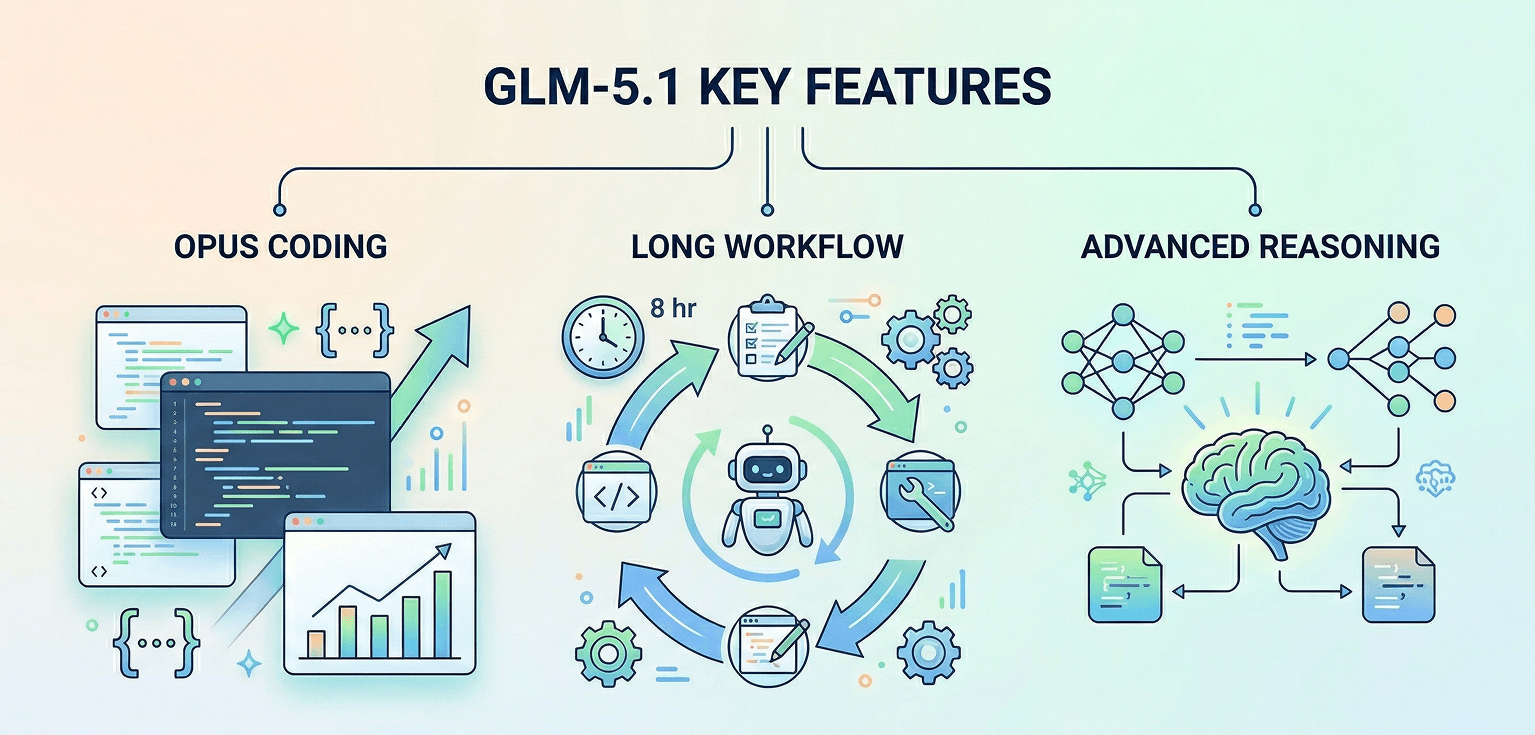

- 主な特徴: GLM 5.1は最高クラスのコーディング能力を備えています。最大8時間のタスクを自動化し、適応的な問題解決によってスムーズなワークフローと完全に機能する成果物を実現します。

- リリース時期: 今月中。

GLM-5.1のコア機能

コーディング性能:Opus 4.6レベル

GLM-5.1はコーディングタスクにおいて最強のベンチマーク結果を達成し、Claude Opus 4.6の性能に並びます。主要なパブリックベンチマーク全体においても、オープンソースモデルの中でトップクラスに位置しています。

Claude 3.5 Sonnetとの比較:

- Claude 3.5 Sonnet:強力なコーディング能力を備え、開発現場で広く採用されている

- GLM-5.1:Opus 4.6レベルの性能に匹敵し、価格競争力もある

DeepSeek V3.2との比較:

- DeepSeek V3.2:広範な能力を持つ優れたオープンソースコーディングモデル

- GLM-5.1:専門的なコーディングベンチマークにおいてより優れており、独自の長時間実行能力を持つ

長時間タスク実行:8時間の自律性

GLM-5.1は通常の対話の枠を大きく超えています。本格的なエンジニアリングプロジェクトを任せれば、ワークフローの計画、コードの記述、テストの実行、詰まった際の戦略の切り替え、エラー発生時の修正を行い、最大8時間稼働し続けて最終的な成果物を届けます。この能力を持つモデルは稀です。

GPT-4oとの比較:

- GPT-4o:マルチターン会話や短時間のタスクに優れている

- GLM-5.1:状態管理を伴う長時間の自律実行向けに設計されている

Qwen2.5との比較:

- Qwen2.5:多様なタスクで高いパフォーマンスを発揮

- GLM-5.1:長時間かつ複雑なエンジニアリングワークフローに特化

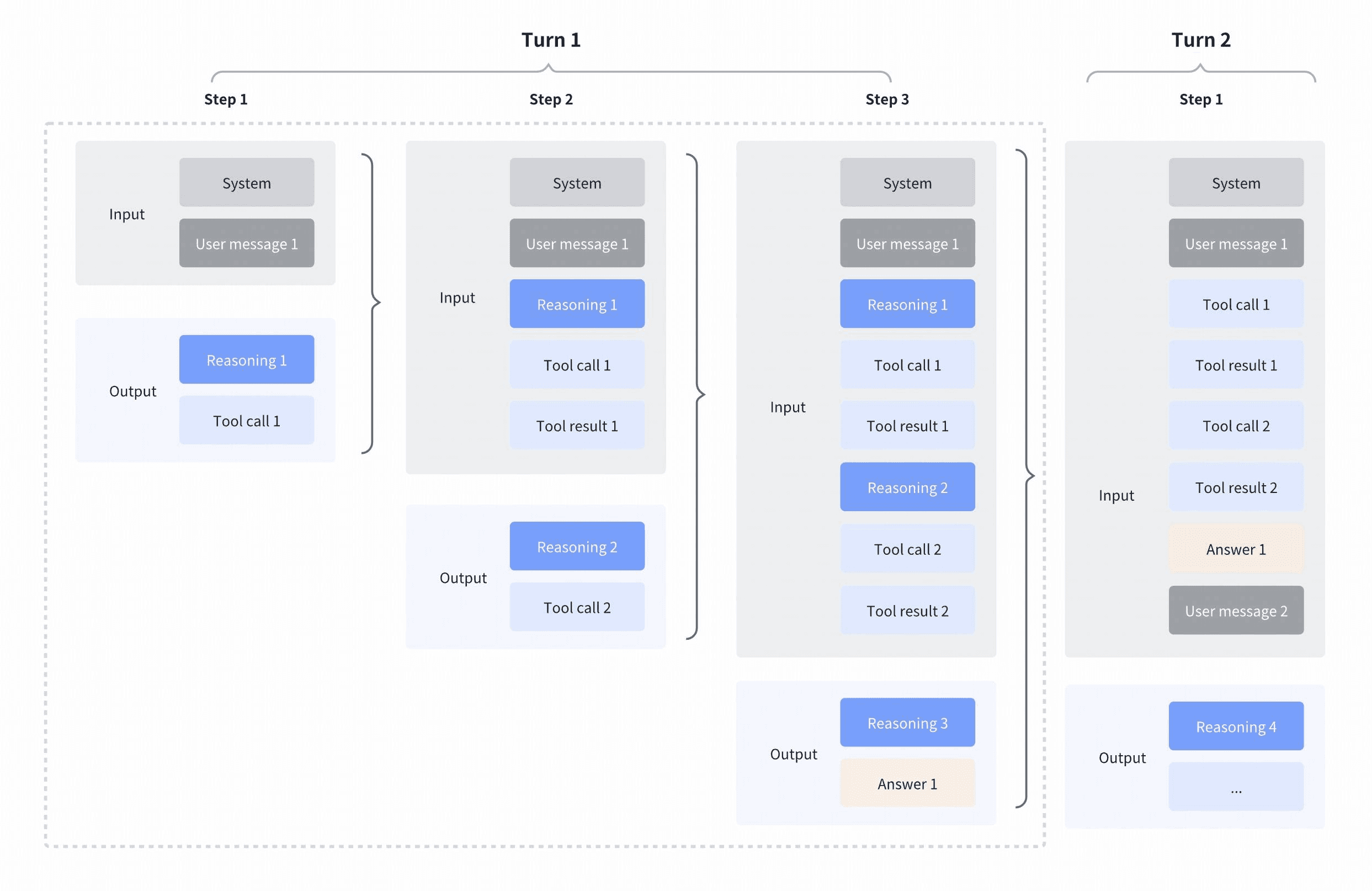

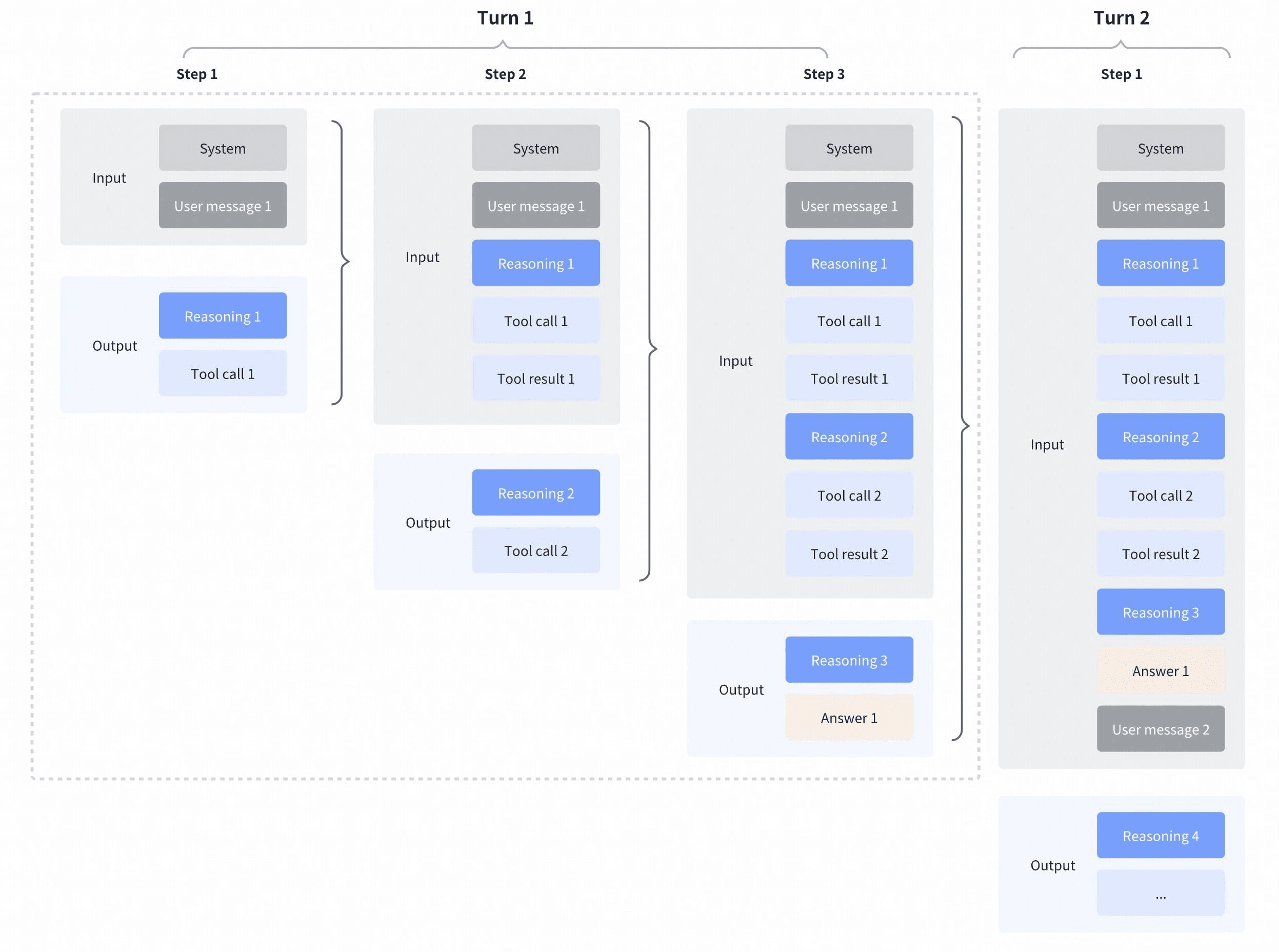

インターリーブされた思考と維持される思考

- インターリーブされた思考

GLMがツール呼び出しの合間やその後に推論を行うことで、段階的な思考が可能になります。出力の解釈、連鎖的な呼び出し、中間結果に基づいた正確な意思決定が行えます。

- 維持される思考

GLM-5.1は前ターンの推論内容を保持するため、一貫性が確保され、パフォーマンスが向上し、キャッシュヒット率が高まり、実際のタスクにおけるトークン消費が節約されます。

GLM-5.1のユースケース:コード移行、機能開発、デバッグ

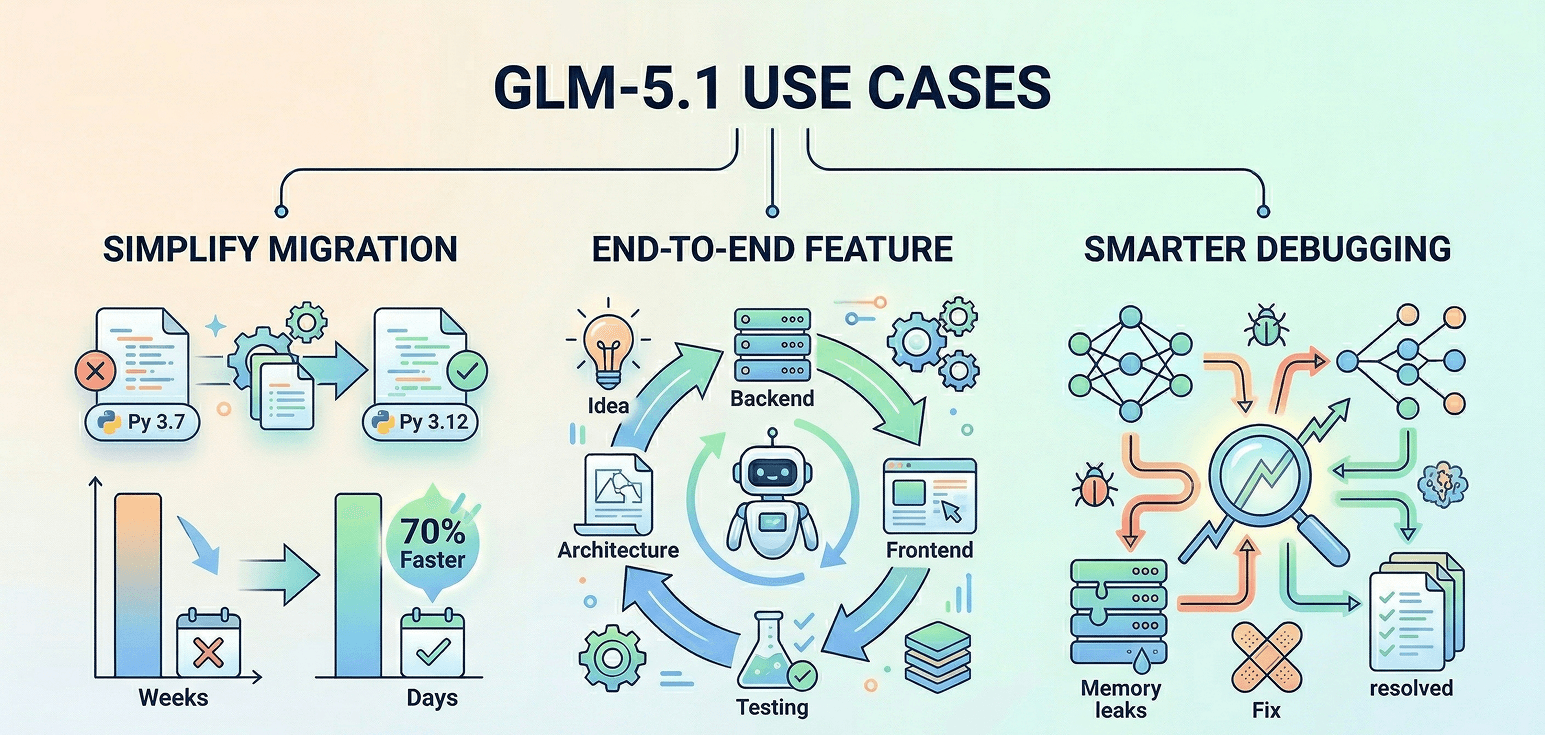

コード移行の簡素化

GLM-5.1は時間のかかるコード移行タスクを引き受け、数週間かかる作業を数日に短縮します。コードベースをレビューし、戦略を立て、大規模なファイル編集を行い、徹底的なテストを実行します。これにより、Pythonのバージョンアップやフレームワークのモダナイゼーションといった一般的なプロジェクトを、最大70%高速かつ容易にします。

エンドツーエンドの機能開発

初期のアイデア出しからアプリケーションの完全な構築まで、GLM-5.1が全プロセスを実行します。アーキテクチャの設計、バックエンドおよびフロントエンドシステムの構築、テスト作成、さらにはドキュメント作成まで行います。継続的な監視なしで、セキュリティ、データベース、本番環境構成を含むデプロイ準備完了のソリューションを提供します。

よりスマートなデバッグ

大規模システムで複雑なバグが発生した際、GLM-5.1がその重労働をこなします。レースコンディションやメモリリークなどを執拗に追跡し、慎重なテストに基づいた修正を適用します。すべてのステップが記録されるため、開発者はその後のベースとなる解決策をすぐに得ることができます。

なぜAtlas CloudでGLM-5.1を使うのか?

Atlas Cloudとは?

300以上のトップモデル(テキスト、画像、動画など)にワンストップでアクセスでき、AIの利用を簡素化するプラットフォームです。

誰のためのもの?

• AIを簡単かつ手頃な価格で利用したい開発者。• 複数の領域でAIを必要とするプロジェクトを担当するチーム。• 重要な業務に信頼できるAIを必要とする企業。• ComfyUIやn8nなどのツールを使用しているユーザー。

選ばれる理由は?

• 1つのAPIキーで、すべてにアクセス可能。 • 明確な料金設定で、不測のコストが発生しない。 • エンタープライズ向けに構築されており、安定、安全で専門家によるサポートがある。 • 既存のツールと連携可能。 • データは安全に保護され、コンプライアンス要件を満たしている。

他社との比較は?

• Fal.ai:Atlasの方がモデル数が多く、価格もより優れている。 • Wavespeed:Atlasの方がコストを抑えられ、エンタープライズサポートが含まれている。 • Kie.ai:Atlasの方が料金体系が明確で、より幅広い選択肢を提供。 • Replicate:ライブラリが小さく、コストが高い。 • その他のプロバイダー(OpenAIなど):Atlasはすべてを1つのシンプルなプラットフォームに集約している。

Atlas CloudでGLM-5.1を使う方法

Atlas Cloudでは、プレイグラウンドで試した後、単一のAPIを通じてモデルを並行して使用できます。

方法1:Atlas Cloudのプレイグラウンドで直接使用する

方法2:API経由でアクセスする

ステップ1:APIキーを取得する

コンソールでAPIキーを作成し、後で使用するためにコピーします。

ステップ2:APIドキュメントを確認する

APIドキュメントで、エンドポイント、リクエストパラメータ、認証方法を確認してください。

ステップ3:最初のリクエストを送る(Pythonの例)

例:GLM-5-Turboで動画を生成する

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

FAQ:GLM-5.1に関するよくある質問

Q:コーディングにおいて、GLM-5.1はClaude 3.5 Sonnetと比べてどうですか?

A:GLM-5.1はコーディングベンチマークでClaude Opus 4.6に匹敵し、Claude 3.5 Sonnetを上回ります。長時間タスクを処理できる能力が際立っています。

Q:「長時間のタスク実行」とは何が違うのですか?

A:通常のチャットモデルは個別のプロンプトに応答しますが、GLM-5.1は最大8時間タスクに集中し続け、その間、適応や自己修正を行うことができます。

Q:GLM-5.1はオープンソースですか?

A:はい、完全にオープンソースです。Zhipu AIによって開発されており、ライセンスの詳細は公式ドキュメントで確認できます。

Q:本番環境で使用する準備はできていますか?

A:もちろんです!GLM-5.1は128Kのコンテキストウィンドウを提供し、Atlas Cloudの信頼性の高いインフラ上で稼働するため、本番環境での利用が可能です。

Q:8時間の実行機能をどのように統合しますか?

A:長時間のタスクには、Webhookまたはポーリング設定を使用してください。Atlas Cloudがバックエンドを処理し、タスク完了時にアプリケーションが最終的な出力結果を受け取ります。

Q:GLM-5.1はどのようなタスクに最適ですか?

A:コードの移行、複雑なシステムのデバッグ、フルスタックのソフトウェア開発といった困難なプロジェクトに最適です。