多くの人は、今でも「言葉を磨けば、より良い画像が生成される」と考えています。それは2年前までの話です。今はもう違います。

2026年現在、モデル間の性能差はもはや重要ではありません。真の差は、「説明するユーザー」と「構築するユーザー」の間にあります。前者は「シネマティックな照明、4K、超詳細」といった言葉を並べますが、後者は光の向き、奥行き、カメラアングルといった要素を組み合わせてシーンを作り上げます。

生成された画像が平坦に見えるなら、問題はモデルではなく、モデルに伝えていない情報にあるのです。

プロンプトだけでは不十分な理由(2026年の視点)

ありきたりなプロンプトはもう通用しません。「最高品質」「高精細」といったフレーズは、モデルが何百万回も学習済みであり、今となってはほとんど効果がありません。

実際に重要なのは、構造化された入力です。光はどこから差し込んでいるのか?前景には何があり、背景には何があるのか?どのレンズを使っているのか?現代のAIモデルはこうした変数に反応します。無駄な修飾語は無視されてしまいます。

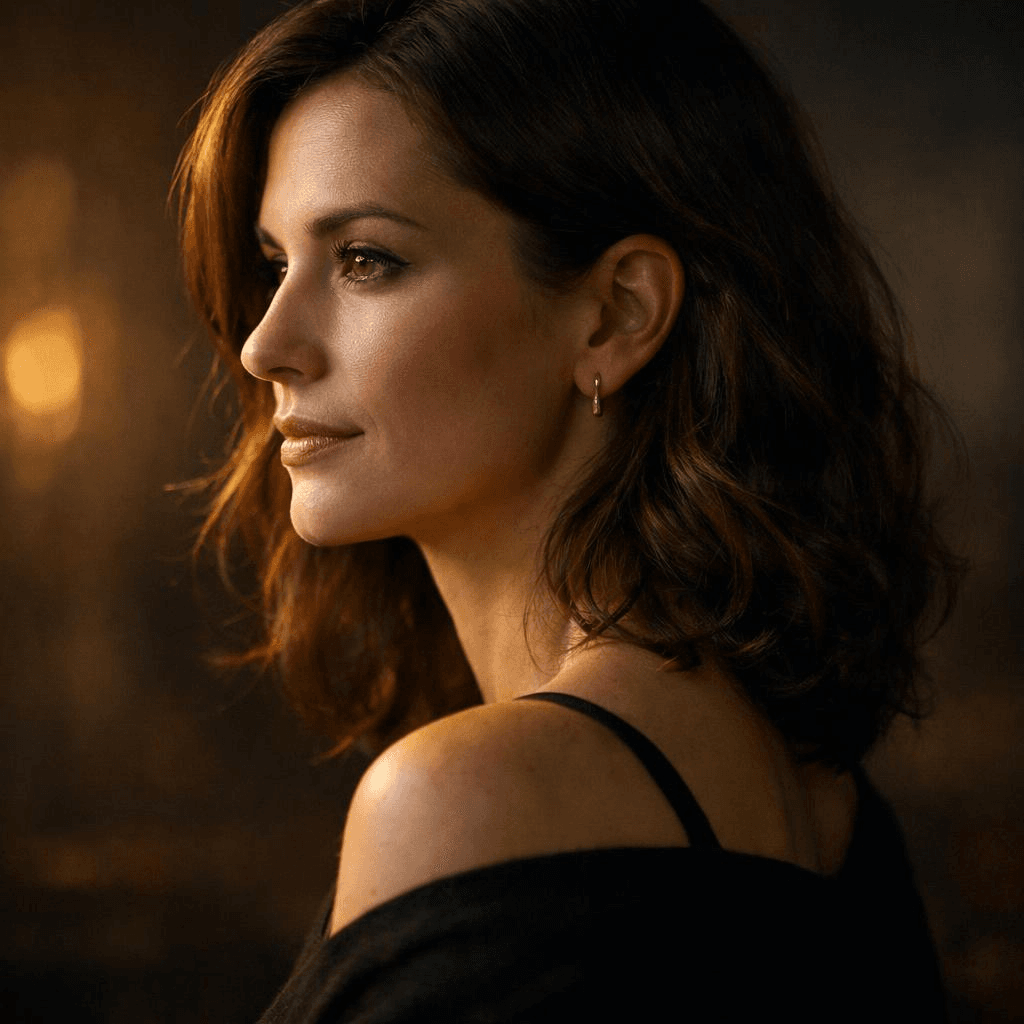

よくある例として、「柔らかな照明の美しいポートレート」と入力するケースがあります。すると、モデルは平坦な画像を出力します。なぜでしょうか?光の向き、奥行きの分離、カメラアングルが指定されていないからです。モデルは推測せざるを得ず、推測の結果、平凡な仕上がりになってしまうのです。

今すぐ切り替えるべき考え方はシンプルです。結果を「説明する」のをやめ、シーンを「構築する」のです。

高度なヒント7選

-

光の向きを指定する

「柔らかな照明」では曖昧すぎます。サイドライト、バックライト、トップライトなど、具体的な指定をすることでモデルは明確な挙動をとります。方向性があることで影が生まれ、影によって奥行きが生じ、画像にリアリティが宿ります。

「柔らかなポートレート照明」の代わりに、以下を試してみてください。

女性のポートレート、左側からのサイドライト、顔の右側に柔らかい影、背景にはほのかな環境光

その差は一目瞭然です。モデルは光の位置を正確に把握できます。

-

実際の撮影手法を活用する

3点照明(スリーポイントライティング)、リムライト、レンブラントライト。これらは単なる専門用語ではありません。モデルが学習過程で数千回も目にしてきたパターンです。これらを使うことで、出力の安定性が格段に向上します。

例:

スニーカーの製品ショット、3点照明セットアップ、強いキーライト、柔らかなフィルライト、製品を暗い背景から浮かび上がらせる繊細なリムライト

これなら、「ドラマチックな照明」と指示するよりも遥かに高い効果が得られます。

-

層を重ねて奥行きを作る

平坦な画像は、すべてが同じ平面上に配置されていることが原因です。前景、中景、背景を明示的に定義することで解決します。

例:

木製テーブルの上のコーヒーカップ(前景)、ノートPCで作業をする人物(中景)、温かみのある明かりが灯るカフェの柔らかくぼけたインテリア(背景)

こうすることで、モデルは空間的な関係性を理解できるようになります。

-

スタイルラベルではなくカメラ用語を使う

「サイバーパンク風」は曖昧ですが、「35mmレンズ、ローアングル、ワイドショット」は精密です。カメラの設定は、画像の構築方法と直結しています。

以下の設定を覚えておくと便利です:

- 35mm:自然で日常的な見た目

- 85mm:圧縮効果のあるポートレート

- 広角:ドラマチックで壮大なスケール

- ローアングル、アイレベル、トップダウン:視点の制御

例:

クローズアップのポートレート、85mmレンズ、浅い被写界深度、アイレベル、背景のソフトなぼけ

「美的なポートレート」よりもはるかに明確な指示となります。

-

コントラストで視線を誘導する

画面全体を詳細にする必要はありません。重要なのはコントラストです。光と影、暖色と寒色、シャープな被写体とぼけた背景。

特に効果的な3つのコントラスト:

- 明暗のコントラスト:暗い背景に浮かぶ明るい被写体

- 色のコントラスト:寒色系の背景に差し込む温かいスポットライト

- 詳細のコントラスト:シャープな被写体とぼけた背景

例:

温かいスポットライトに照らされた被写体、暗く冷たい色調の背景、高コントラストのライティング、被写体への強い焦点

これによって、見る人の視線を意図した通りに誘導できます。

-

制約を加えて混沌を整理する

プロンプトが長くなりすぎると、かえって画像が乱れます。情報を詰め込むのではなく、あえて制限を加えましょう。不要なもの(雑多な物、歪み、余計なオブジェクトなど)を除外するよう指示します。

例:

ミニマルな製品ショット、中央配置、クリーンな白背景、雑多な物なし、文字なし、歪みなし

追加の形容詞よりも、こうした制約の方が構成を整える力を持っています。

-

ギャンブラーではなく監督として試行錯誤する

最初の一回で完璧な画像が出せることはまずありません。プロは生成し、微調整し、再度生成します。

シンプルなワークフロー:

- ステップ1:基本的な構成、被写体、環境の設定

- ステップ2:方向性のある照明とコントラストの追加

- ステップ3:詳細の調整と不要な要素の削除

このプロセスを繰り返すことで結果が洗練され、偶然ではなく再現性のある品質へと変わります。

統合:プロフェッショナルなプロンプトフレームワーク

プロンプトを長い文章にするのはやめ、モジュール化したシステムとして書きましょう。

推奨される構造:

plaintext1[被写体] + [環境] + [照明] + [カメラ] + [構図] + [色] + [制約]

基本的なプロンプトと構造化されたプロンプトの比較をご覧ください。

例:基本的なプロンプトからプロ仕様へ

基本プロンプト(典型的なユーザー):

白いサマードレスを着た女性モデル、クリーンな背景、スタジオライティング、高精細、Eコマーススタイル

プロ仕様プロンプト(構造化):

白いサマードレスを着た女性モデル(被写体)、テクスチャ感のある柔らかなベージュの背景のミニマルなスタジオに立つ(環境)、右側からのサイドライトにより体の左側に柔らかな影を作り、繊細なリムライトがシルエットを背景から切り出す(照明)、85mmレンズ、アイレベル(カメラ)、浅い被写界深度で被写体を少し中央からずらし、前景のぼけで奥行きを演出(構図)、温かみのある自然な色調、ソフトなコントラスト(色)、クリーンな構図、雑多な物なし、歪みなし、余計なオブジェクトなし(制約)

結論:プロンプトからディレクションへ

一枚の素晴らしい画像を作るだけなら簡単です。しかし、実際のプロジェクトでは、何百枚もの一貫した高品質なビジュアルが必要です。手動のプロンプト入力ではスケールしません。

レイテンシ、コスト、バッチごとの一貫性の維持など、実務上の課題に直面するはずです。これらをプロンプトだけで解決するのは不可能です。システムが必要です。

そこでAPIベースの画像生成が不可欠になります。都度プロンプトを入力するのではなく、ワークフローに生成プロセスを組み込むのです。構造化されたプロンプトを再利用し、自動化し、継続的に最適化していきます。

Atlas Cloudのようなプラットフォームは、このための統合APIレイヤーを提供しています。

・AIを簡単かつ手頃に利用したい開発者。 ・複数の領域でAIを活用するチーム。 ・重要な業務で信頼性の高いAIを必要とする企業。 ・ComfyUIやn8nのようなツールを使っている方。

Atlas Cloudを試せば、単なる実験から本格的な制作へとステップアップできるはずです。インフラをゼロから構築する必要はありません。

未来は、個別に優れたプロンプトを書くことではなく、制御可能で再現性の高い、プロダクションレディなビジュアルシステムを構築することにあります。

FAQ

AI画像が平坦に見えるのはなぜですか?

平坦に見えるのは、奥行きの要素が欠けているためです。写真の仕組みを考えてみましょう。奥行きは、影、被写体の重なり、焦点の違いから生まれます。プロンプトでこれらを具体的に指定する必要があります。

例えば「デスクに座る人」という単純なプロンプトでは、奥行きに関する情報はほぼゼロです。「デスクに座る人(中景)、都会の明かりが灯るぼけた窓(背景)、ピントの合ったコーヒーカップ(前景)」のように指定すれば、モデルは層を理解して作業できます。

ライティングも重要な要素です。アンビエントライトのみを指定すると、画面全体が均一に照らされ平坦になります。方向性のあるソース(サイドライト、バックライト、リムライトなど)を最低でも1つ追加してください。影が生まれ、画像にボリューム感が生まれます。

もう一点、フレームの隅々まで情報を詰め込もうとしないでください。余白やぼかしも重要な情報です。それらは見るべき場所を指示する役割を果たします。時には情報の少なさが、より深い奥行きを生むこともあります。

AIは商品写真の代わりになりますか?

多くのケースで、はい。しかし、適材適所を理解する必要があります。

高級腕時計のヒーローショットのように、金属の反射が重要で、革ストラップの質感を正確に再現しなければならないような場合は、従来の写真撮影が勝ります。スタジオでのライティングには敵いません。

それ以外のほとんどのケースでは、AIの方が高速かつ低コストです。カタログ写真、ライフスタイルシーン、季節ごとのバリエーション、A/Bテスト用クリエイティブなど。クリーンな製品ショットを数秒で作成し、それをビーチ、冬のキャビン、モダンなキッチンといったシーンにAIで合成できます。

スタジオのレンタルも、照明機材も、レタッチも不要です。一枚あたりのコストはわずかです。

小規模ブランドやD2Cスタートアップにとって、これはゲームチェンジャーです。これまで大予算を投じていた企業と競合できるクオリティのビジュアルを制作可能になったのです。2年前には不可能だったことです。

OpenAIのビジュアル生成モデルは以前と何が違いますか?

新しいモデルGPT‑image‑1.5は、内部アーキテクチャが大きく変わりました。「ディフュージョン・トランスフォーマー」を採用しており、空間的な関係性をより的確に処理できます。

旧バージョンでは複雑なシーンをバラバラに生成し、整合性が取れないことがありました(例えば、カップを持っているはずの手が浮いているなど)。新バージョンでは、これらが統合され、手はカップを正しく持ち、影も正しい位置に落ちます。

また、文字のレンダリングも飛躍的に向上しました。以前はランダムな記号のような文字が表示されていましたが、GPT‑image‑1.5は多言語で読み取り可能な単語を生成できます。同じ画像内に英語と中国語を混在させることも可能です。

さらに、ネイティブで最大2Kまでの解像度をサポートしており、アップスケーリングなしでアーティファクトの少ない、シャープな詳細表現が可能です。

唯一の欠点は、曖昧なプロンプトへの寛容さが減ったことです。「きれいなポートレート」とだけ言っても魔法は起きません。より注意深く指示を出す必要があります。しかし、光の向き、奥行き、カメラ設定といった構造化された指示を与えれば、これまでのどの世代よりも優れた品質が得られます。