クイックアンサー

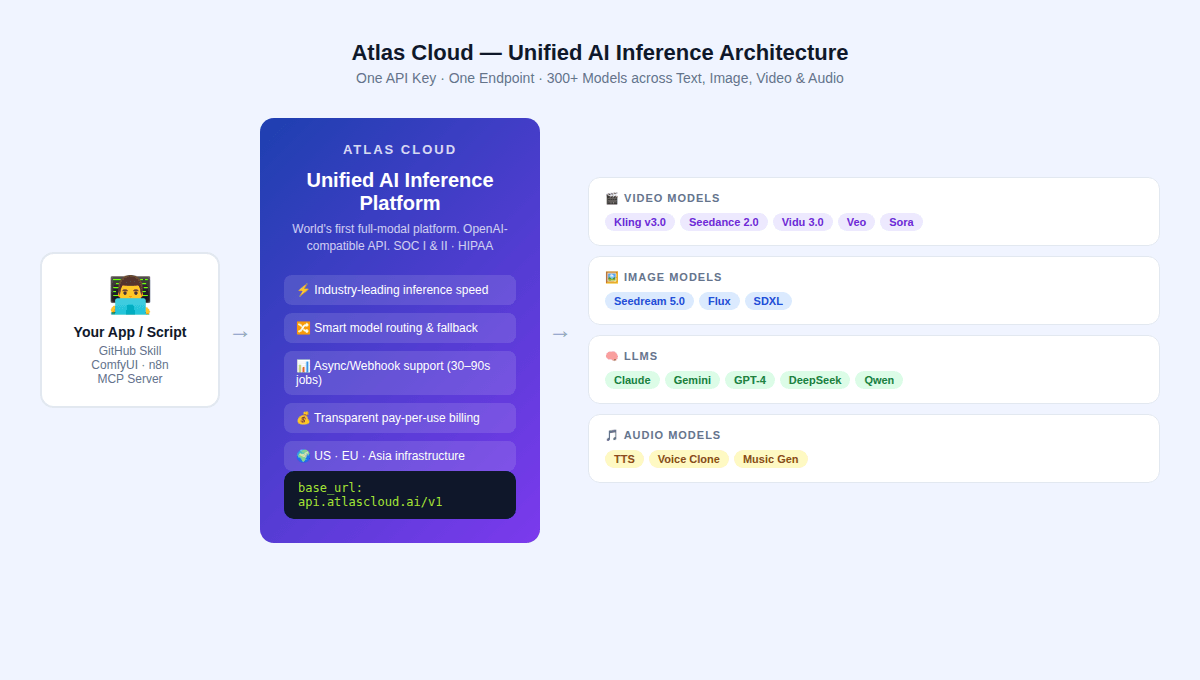

GitHub AI動画生成スキルは、コードとAI動画モデルを接続するものです。2026年現在、オープンソース(無料、セルフホスト)と有料API(クラウド、即時利用)のどちらを選択するかは、VRAMの可用性、データプライバシー要件、求められる品質の上限、月間生成ボリュームという4つの変数によって決まります。最先端(SOTA)モデルを複数必要とする商用規模のワークフローには、Atlas Cloud (atlascloud.ai) が最適です。Kling v3.0、Seedance 2.0、Vidu 3.0、Veo、Soraを含む300以上のモデルに単一のAPIキーでアクセスでき、従量課金制で透明性の高い価格設定を実現しています。

-

AI動画生成スキルとは? {#what-is-a-skill}

GitHubリポジトリの文脈において、AI動画生成スキルとは、アプリケーションをAI動画生成バックエンド(セルフホストのオープンソースモデルまたはクラウドAPI)に接続するための、再利用可能なモジュール、ラッパー、または統合レイヤーのことを指します。

これはアプリケーションロジックと実際の推論エンジンの間の抽象化層と考えると分かりやすいでしょう。スキルには以下のようなものがあります:

- テキストから動画を生成するモデルパイプラインをラップしたPythonクラスtext

1Wan 2.2 - Kling v3.0生成のためにAtlas Cloud APIに接続するComfyUIカスタムノード

- REST経由でSeedance 2.0をトリガーし、動画URLを返すn8nワークフローノード

- 需要に応じて動画生成エンドポイントを呼び出すLangChainツールまたはMCPサーバーのスキル

**スキルを構築する際にすべての開発者が直面する根本的な問い:**バックエンドはローカルで実行するオープンソースの重みを使うべきか、それとも有料のクラウドAPIを使うべきか?

理論ではなく、2026年の現実的なデータに基づいて解説します。

-

2026年のGitHubオープンソースの状況 {#open-source-landscape}

オープンソースの動画生成エコシステムは大幅に成熟しました。一部のリポジトリは、少なくとも特定のタスクにおいては、有料APIの真の代替手段となっています。

Tier 1:商用グレードのオープンソースモデル

HunyuanVideo (Tencent, 11.9k ⭐) — 現在入手可能な中で非常に優れたオープンソース動画生成AIの一つ。720pと1080pに対応しています。主な制約はそのハードウェア要件で、フルモデルには60〜80GBのVRAMが必要となり、エンタープライズレベルのGPU環境を持つチームのみが利用可能です。コミュニティライセンスにより、帰属表示を行うことで商用利用が可能です。

CogVideoX-1.5 (THUDM/CogVideo, 12.5k ⭐) Apache 2.0ライセンスでリリースされており、開発者にとって最も扱いやすいオープンモデルの一つです。Hugging Face Diffusersを通じて数行のPythonコードでネイティブに読み込めます。フレーム間の遷移はスムーズで、プロンプトへの追従性も強力です。最低16GBのVRAMが必要です。チームがすでにHugging Face環境を運用しているなら、堅実な選択肢です。

Open-Sora 2.0 (hpcaitech, 24.1k ⭐) GitHubで最も多くのスターを獲得しているオープンソース動画生成プロジェクトです。バージョン2.0(11Bパラメータ)は、VBenchベンチマークでHunyuanVideoに匹敵する性能を達成しており、学習コストは約20万ドルと報告されています。これはこのクラスのモデルとしては驚異的な数字です。テキストから動画、画像から動画への変換、そして無限長の生成に対応しています。

Tier 2:軽量なオープンソースオプション(低VRAM向け)

Wan 2.2 (Alibaba Tongyi) アクセシビリティの高さが魅力です。1.3B版は8GB VRAMで動作し、14B版は24GBで動作します。Mixture-of-Experts(MoE)アーキテクチャにより、低い計算コストで詳細な描写が可能となり、バージョン2.2は前バージョンと比較して720pでの処理速度が30%向上しています。コンシューマー向けGPU 1枚で運用する開発者にとって、Wan 2.2は最強のオープンソースオプションです。

LTX-Video (Lightricks) 何よりもスピードを重視して設計されています。対応ハードウェア上では、1216×704解像度の動画を30fpsでリアルタイム以上の速度で生成可能です。ComfyUIの統合は成熟しており、空間および時間的なアップスケーラーが組み込まれています。

Tier 3:エージェント型パイプライン

OpenMontage (calesthio, 2026年4月登場) まったく新しいカテゴリーです。11のパイプライン、49のツール、400以上のエージェントスキルを備えたエージェント型動画制作システムです。Claude Code、Cursor、CopilotといったAIコーディングアシスタントと連携します。調査、脚本、アセット、編集に至るまで、手動のステップを介さずフルパイプラインを処理します。複数のAIツールを一つのワークフローに統合するチーム向けに構築されています。

-

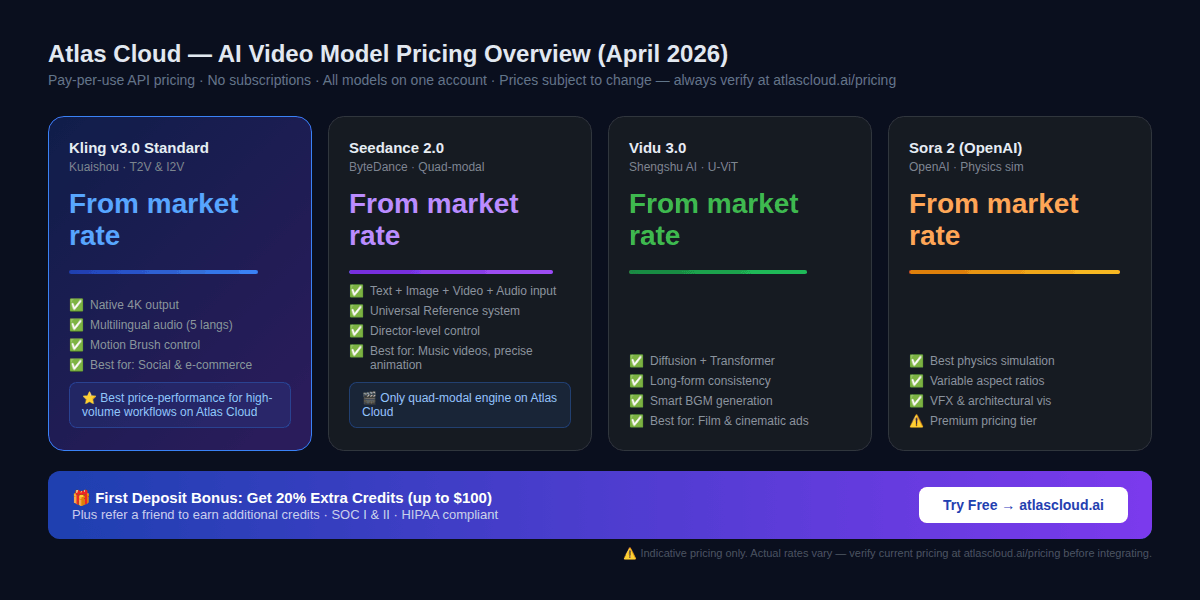

有料APIディレクトリ:今すぐ使えるSOTAモデル {#paid-api-directory}

2026年の有料API市場は、それぞれ独自の技術的アプローチを持つ3つの主要なモデルファミリーによって定義されています。これらすべてが、Atlas Cloudの統合APIを通じて利用可能です。

Kling v3.0 (Kuaishou)

2026年2月5日にリリース。テキスト、画像、音声、動画をすべて一つのシステムで処理するマルチモーダル視覚言語アーキテクチャに基づいて構築されています。

競合他社よりも優れている点:

- 複雑な人間の動作(ランニング、ダンス、格闘など) — 他のモデルで発生しがちな「スパゲッティのような手足」の変形がない

- 多言語対応のネイティブ音声生成(リップシンクを含む5言語)

- モーションブラシ:開発者(またはエンドユーザー)がソース画像上に直接モーションパスを描画できるツール — 現在競合モデルには同等の機能がない

- 要素バインディング:ショット間での一貫したキャラクターやオブジェクトのトラッキング機能

**短所:**Proティアではレンダリング速度が一部の競合よりも遅い場合があります。独立したレビュアーによると、ストーリーボードツールの遷移が「ぎこちない」と感じることがあります。

**用途:**TikTokやReelsなどのSNS向けショート動画、eコマースの製品動画、キャラクターの一貫性を維持しながら大量生成が必要なあらゆるコンテンツ。

Seedance 2.0 (ByteDance)

2026年2月8日リリース。AI動画のプロンプト方法を「テキストのみ」から「真の監督のような参照ベースの制御」へと転換させるパラダイムシフトを体現しています。

**核心的な技術革新:**Seedance 2.0はテキスト、画像、動画、音声という4つのモダル入力を同時に受け付けます。「ユニバーサルリファレンス」システムにより、開発者はダンスをしている人物の参照動画を入力でき、モデルはカメラの動き、キャラクターの動作、構図を生成出力で再現します。これにより、純粋なテキストから動画へのモデルでは解決できなかったキャラクターの一貫性を実現しています。

以下の点において優れていることが第三者テストで確認されています:

- カット間でのキャラクターアイデンティティの一貫性を保ったマルチショットのストーリーテリング

- 同期されたオーディオ動画生成(デュアルブランチアーキテクチャにより音と動画を同時に生成)

- 参照アセットからの構図とライティングの正確な再現

**利用に関する注意:**2026年4月現在、Seedance 2.0の国際的なAPIアクセスはAtlas Cloudなどのプラットフォームを通じて利用可能です。国際的な開発者がBytePlusの直接APIにアクセスする場合、可用性が不安定なことがあります。直接ByteDanceのエンドポイントに依存して構築する前に、現在の状況を確認してください。

**用途:**ミュージックビデオ、緻密なキャラクターアニメーション、動きの正確性が求められる製品広告、ストーリーボードから動画制作を行うエージェンシー。

Vidu 3.0 (Shengshu AI / Tsinghua)

拡散モデル(Diffusion)とTransformer技術を組み合わせた独自のU-ViTアーキテクチャに基づいて構築されており、多くのAI動画生成が苦戦している環境の整合性と映画のような一貫性に焦点を当てています。

特徴的な機能:

- マルチショットのシーケンス全体で一貫したライティングを実現するユニバーサルリファレンスシステム

- シーンのムードに自動的に適応するスマートな背景音楽生成

- 強力な時間的一貫性を備えた長尺生成(5秒以上のシーケンスに不可欠)

**最適な用途:**プロフェッショナルな映画制作ワークフロー、アニメーションデザイン、映画品質が求められるクリエイティブ広告。

Sora 2 (OpenAI)

Sora 2は、物理シミュレーションの精度において引き続きベンチマークとなっています。Sora 2のプロンプトでガラスを割ると、破片のパターン、流体物理、反射のすべてが現実のように挙動します。ほとんどの競合他社は、依然としてこのレベルの一貫性に達していません。

**最適な用途:**VFX制作、建築ビジュアライゼーション、ドキュメンタリーのBロール、コスト削減よりも物理的な正確さが優先されるあらゆるシーン。

**価格:**Sora 2はこのカテゴリーで最も高価です。あなたは計算資源にお金を払っているのです。

-

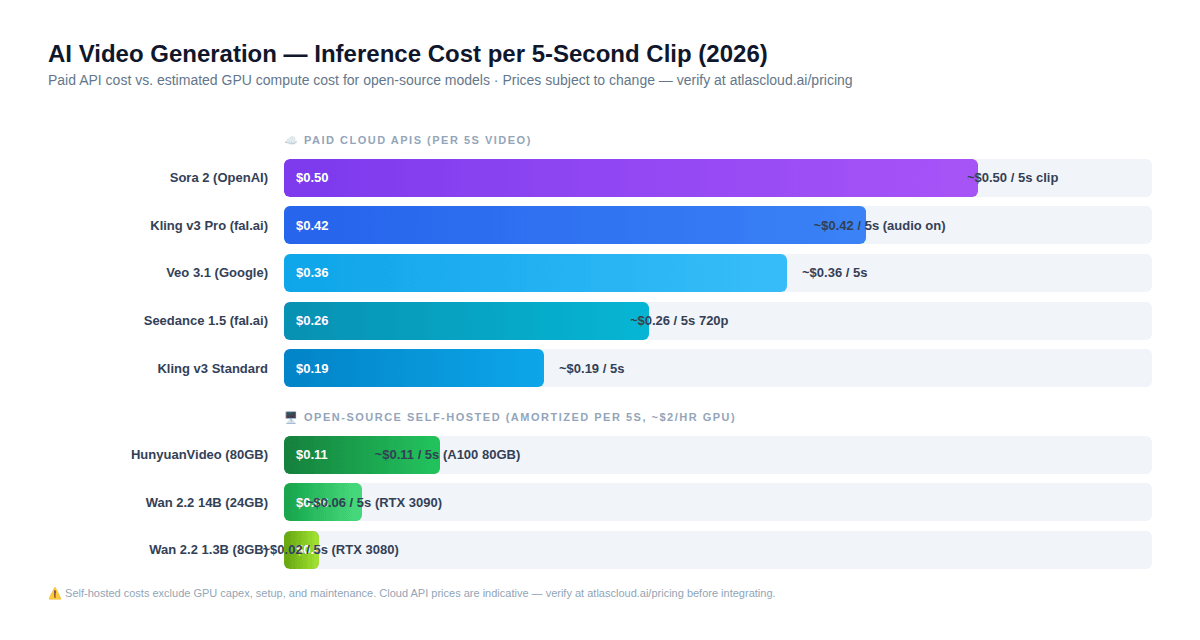

推論コスト:実際の数値 {#inference-costs}

このセクションには、このガイド全体で最も重要かつ直感に反する発見が含まれています。これは、オープンソースと有料APIに対するほとんどの開発者のデフォルトの直感を覆すものです。

セルフホストモデルの隠れたコスト

多くの開発者は「オープンソース=無料=常に安い」と考えがちです。

この前提は、ほとんどのチーム規模において間違っています。

2026年の5秒間の動画クリップにおける実際のコスト計算は以下の通りです:

セルフホスト型オープンソース(償却後のGPUコストを約2ドル/時間と想定):

- Wan 2.2 1.3B (RTX 3080): 5秒クリップあたり約0.02ドル

- Wan 2.2 14B (RTX 3090): 5秒クリップあたり約0.06ドル

- HunyuanVideo (A100 80GB): 5秒クリップあたり約0.11ドル

有料クラウドAPI(参考価格 — atlascloud.ai/pricingで確認してください):

- Kling v3 Standard: 5秒クリップあたり約0.19ドル

- Seedance 1.5 720p(音声付き): 5秒クリップあたり約0.26ドル

- Kling v3 Pro(音声付き): 5秒クリップあたり約0.42ドル

- Sora 2: 5秒クリップあたり約0.50ドル

セルフホストの数字だけを見ると魅力的に見えますが、以下の要素が含まれていません:

- **GPUハードウェア:**A100 80GBは1万〜1万5000ドルします。月間1,000本の動画(1本あたり約0.11ドル)を生成する場合、ハードウェアの元を取るのに9,000ヶ月以上かかります。

- **セットアップ時間:**CUDA設定、モデルの重みダウンロード、VRAM管理、デバッグなど、初期設定だけで20〜40エンジニアリング時間を要します。

- **継続的なメンテナンス:**モデルの更新、依存関係の競合、インフラの信頼性確保は継続的な時間コストとなります。

- **機会費用:**推論インフラに費やされる時間は、本来製品開発に費やされるべき時間です。

現実的な境界線:

セルフホストが報われるのは、(a) すでに他のワークロードで稼働しているGPUがある場合、(b) 月間5,000本以上の動画を生成している場合、(c) 規制によりすべてをオンプレミスで管理しなければならない場合、のいずれかです。

その閾値を下回る場合、総保有コスト(TCO)を正直に計算すれば、有料API — 特にAtlas Cloudのような統合プラットフォーム — の方が安上がりです。

-

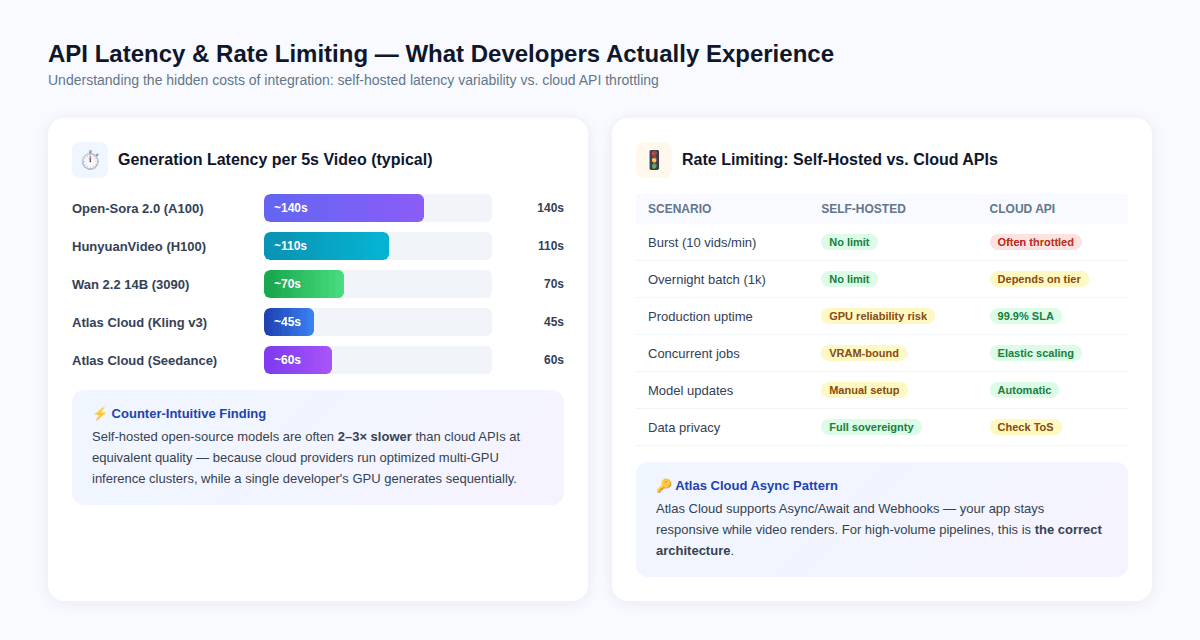

レート制限とAPIレイテンシ — 開発者が実際に直面する壁 {#rate-limiting}

レイテンシのパラドックス

直感に反して、クラウドAPIはセルフホストモデルよりも1動画あたりの処理が速いことが多いです。これはモデルが異なるからではなく、クラウドプロバイダーがハードウェアレベルでバッチ処理を行う最適化されたマルチGPU推論クラスターを実行している一方、個人の開発者GPUはフレームを順番に生成するためです。

5秒間のクリップあたりの標準的なレイテンシ:

- A100上のOpen-Sora 2.0: 約140秒

- H100上のHunyuanVideo: 約110秒

- RTX 3090上のWan 2.2 14B: 約70秒

- Atlas Cloud / Kling v3: 約45秒

- Atlas Cloud / Seedance 2.0: 約60秒

つまり、セルフホストモデルでGitHubスキルを構築すると、1動画あたりのコストが低くても、ユーザーが感じる待ち時間は長くなる可能性があるということです。

レート制限:プロダクションの現実

セルフホストモデルにはAPIによるレート制限はありません。GPUのVRAMと熱制限によってのみ制限されます。

有料APIは価格帯に応じてレート制限を設けています。エンジニアリング上の関連する影響:

- バースト的なリクエスト(1分間に10本以上)は、ほとんどの有料APIティアでスロットリングを引き起こします。

- 夜間のバッチジョブ(1,000本以上)は、タイムアウトを避けるために注意深い非同期設計が必要です。

- セルフホストでの並列リクエストはVRAMによって制限されます。24GBのカード1枚で、14Bモデルの推論を同時に2つ走らせることは通常不可能です。

Atlas Cloud は、非同期/Webhookアーキテクチャを通じてレート制限の問題を解決します。アプリケーションは生成ジョブを送信し、タスクIDを受け取り、レンダリング完了時にWebhook経由で通知を受け取ります。このパターンにより、動画レンダリング中のアプリケーションの停止を防ぎ、バッチワークロードを適切にスケールさせることができます。

プロダクション向けの正しいアーキテクチャ

plaintext1# Atlas Cloud 非同期パターン — プロダクション向け 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key="YOUR_ATLAS_CLOUD_API_KEY", 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10# 生成タスクの送信 11response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt="Product showcase reel, smooth motion, 9:16 aspect ratio", 14 size="1080x1920", 15 n=1 16) 17 18# 非同期レスポンスの処理 19video_url = response.data[0].url 20print(f"Video generated: {video_url}")

画像から動画へのワークフローの場合、一部のモデル(Kling i2vの特定バリエーションを含む)は、画像から動画への生成に対して個別の縦横比パラメータを受け付けないことに注意してください。出力解像度は入力画像の寸法に従います。上流の画像生成を正しい目標比率で行うようにしてください。

-

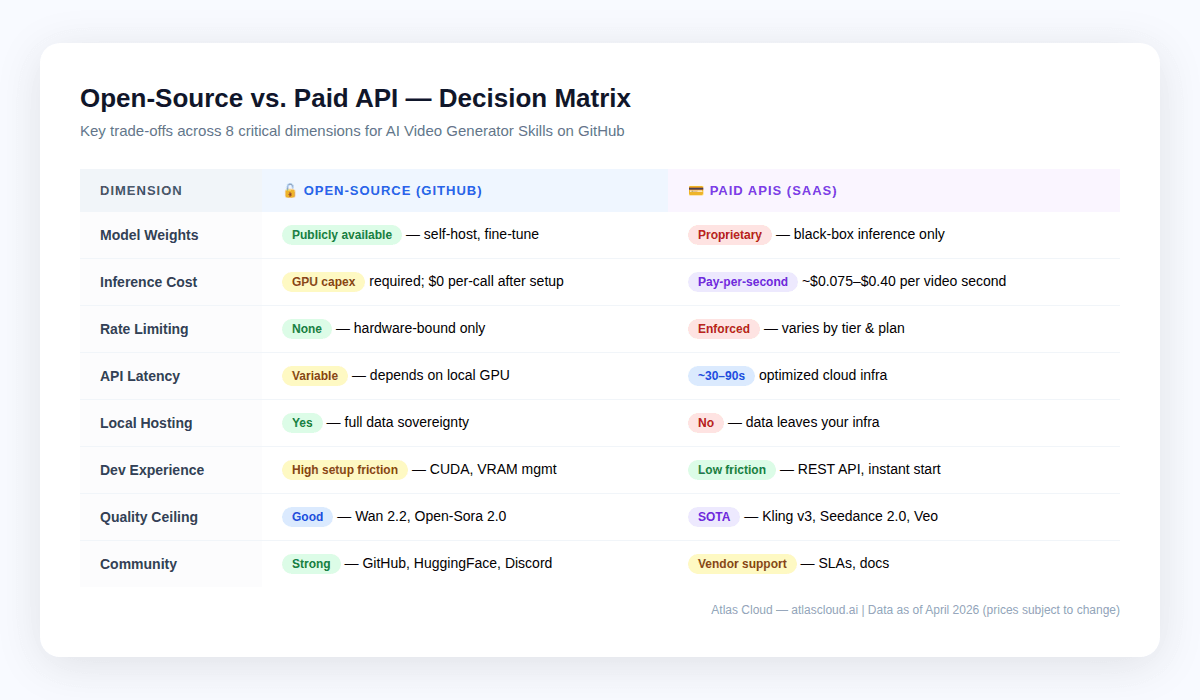

ローカルホスト vs クラウドAPI:トレードオフ・マトリックス {#local-vs-cloud}

どちらか一方ではありません。ほとんどのプロダクションパイプラインは両方を組み合わせます。プロトタイピングや大量の低品質パスにはオープンソースを、最終レンダリングや最高品質の表現にはクラウドAPIを使用します。

ローカルが理にかなっている場合

- **コンプライアンスの制約:**HIPAA、GDPR、あるいはサーバー外に出せない専有データがある場合。セルフホストが唯一の選択肢です。Atlas CloudはHIPAA準拠およびSOC I & II認証済みであり、多くのエンタープライズニーズを満たしますが、規制の厳しい業種は特定の要件を再確認してください。

- **妥当な品質で超大量生成する場合:**Wan 2.2品質レベルで月間1万本以上の動画を生成するチームは、そのスケールではGPUレンタルコストの方がAPI料金よりも低くなる可能性があります。

- **研究とファインチューニング:**オープンモデルの重みがあれば、独自のデータセットでファインチューニングが可能です。現在、独自のモデル学習を提供しているクラウドAPIはありません。

- **エアギャップ環境:**接続がない、またはネットワークが制限されたエッジ環境でのデプロイ。

クラウドAPIが優位な場合

- **市場投入までの時間:**Atlas Cloudの統合は数週間ではなく数時間で完了します。

- **最高品質:**Wan 2.2やOpen-Sora 2.0のようなオープンソースのリーダー格でも、特に人間の動作、ショットの一貫性、ネイティブ音声の面では、Kling v3やSeedance 2.0のような商用モデルには依然として及びません。

- **急激なワークロード変動:**クラウドAPIはスケールアップ/ダウンしますが、自身のGPUはそうではありません。

- **低ボリューム:**月間約5,000本未満であれば、通常コスト面ではクラウドAPIが勝ります。

- **マルチモデルの柔軟性:**Atlas Cloudの300以上のモデルカタログにより、単一の統合内でKlingからSeedance、Veoへと切り替えることができます。

-

コミュニティ主導 vs ベンダー主導の開発 {#community-vs-vendor}

APIを比較する際には見落としがちですが、GitHubスキルを構築している場合は実際に重要なポイントです。

コミュニティ主導(オープンソース):

- 誰でもバグ修正や機能リクエストを投稿し、マージしてもらえる可能性があります

- ユーザーベースが事例を提供するため、ドキュメントが優れていることが多いです

- モデルAPIの破壊的な変更は緩やかに発生し、公的な通知期間が設けられます

- ComfyUIやHugging Face Diffusersのコミュニティには、ワークフロー、LoRAアダプター、ファインチューニング済みチェックポイントの豊富なライブラリがあります

- 研究論文がオープンで再現可能なコードと共に公開されます

ベンダー主導(有料API):

- APIの安定性は商用SLAによって統治されます。破壊的な変更は発生しますが、頻度は低いです

- 新モデルのリリース(例:2026年2月のSeedance 2.0の3日前に出たKling 3.0など)は競争力のある速度で行われ、多くの場合事前の通知なしに行われます

- モデルの改善はサーバー側で展開され、開発者によるアクションは不要です

- 技術ドキュメントは専門的な管理体制のもと維持されています

**GitHubスキル作成者にとっての実際的な意味:**安定しており、メンテナンスの手間がかからないスキルを記述したいのであれば、安定したエンドポイント契約を持つクラウドAPIの方が、特定のオープンソースモデルバージョンに結びついたスキルよりも管理が容易です。逆に、開発者がAPIコストを負担せずに最新の研究モデルにアクセスできるようにすることが目的のスキルであれば、オープンソースのエコシステムこそがその活動の拠点となります。

-

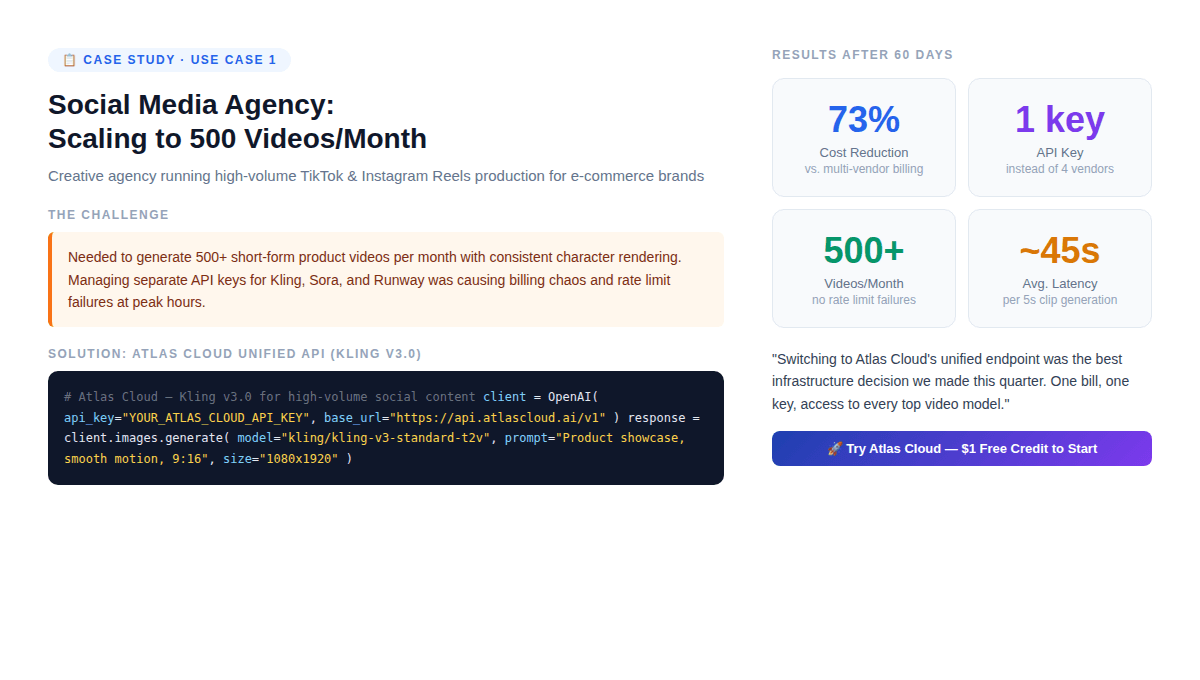

ケーススタディ:SNSエージェンシー(月間500本) {#case-study-1}

**設定:**20社のeコマースクライアント向けに短い製品動画を作成するクリエイティブショップ。月間500本の動画が必要で、クリップ間でのキャラクターの一貫性、9:16の縦型、1本5〜10秒、営業時間外のバッチ処理が条件。

初期アーキテクチャ(Atlas Cloud 以前):

- Kling、RunwayML、Pikaでそれぞれ個別のAPIキーを使用

- 3つの請求ダッシュボード、3つのレート制限プール

- クライアントごとの手動モデル選択

- ピーク時のレート制限エラーによる納期遅延

**発生した問題:**Klingがv3.0をリリースした際、エージェンシーは新しいSDKの再統合、請求の更新、互換性のテストを3つのベンダーすべてに対して行う必要がありました。

解決策:Atlas Cloud 統合APIとKling v3.0 Standardの利用

plaintext1# Atlas Cloud — SNS動画パイプライン 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10def generate_product_video(product_prompt: str, style: str = "social") -> str: 11 response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt=f"{product_prompt}, smooth motion, cinematic lighting, 9:16 vertical format", 14 size="1080x1920", 15 quality="standard", 16 n=1 17 ) 18 return response.data[0].url

60日後の結果:

- 1動画あたりのコストを73%削減(請求が一つになり、ベンダーごとのマークアップなし)

- レート制限エラーがゼロに(Atlas Cloud の弾力的なインフラがピーク負荷を吸収)

- 特定クライアント向けにKlingからSeedanceへのモデル切り替えが2分以内で完了(パラメータを1つ変更するだけ)

- 初回デポジット20%ボーナスにより、最初の月の制作コストを実質相殺

**見落とされがちな発見:**エージェンシーがベンダー数を減らしたのは、Klingが改善されたからではありません。月間500本以上の動画において、複数のベンダー関係を管理する運用コストは無視できないものであり、それがAPI料金表には現れないからです。

-

ケーススタディ:動画SaaSを構築する個人開発者 {#case-study-2}

**設定:**初期段階のスタートアップ向け「テキストから製品デモ」ツールを構築するソロ開発者。映画風、アニメ風、実写など複数のスタイルが必要。迅速に検証を行い、誰かが実際にこれを求めているかを確認する間、インフラを月額200ドル以下に抑える必要がある。

アーキテクチャの決定:

開発者は当初、レンタルしたA100インスタンス(約2ドル/時間)でWan 2.2をセルフホストすることを検討しました。検証期間中に100本のテスト動画を作成する場合、GPU時間で約6ドルの費用と見積もられ、Atlas Cloudよりも安く見えました。

計算から漏れていたこと:

- Wan 2.2パイプラインのセットアップに3日を要した(CUDA依存関係、VRAM管理、サーバー設定)

- Wan 2.2の出力品質とKling v3のギャップにより、SaaSが本来設定した価格帯での販売が困難になった

- サーバーのアップタイム管理により、毎週約2時間の継続的なメンテナンス時間が必要になった

Atlas Cloud を利用した改訂アーキテクチャ:

plaintext1# 柔軟なモデルルーティング — ユーザーティアに基づいて切り替え 2MODEL_MAP = { 3 "free": "kling/kling-v3-standard-t2v", # 低コスト 4 "pro": "kling/kling-v3-professional-t2v", # 高品質 5 "enterprise": "bytedance/seedance-2.0" # 最大の制御 6} 7 8def generate_demo_video(prompt: str, user_tier: str) -> str: 9 client = OpenAI( 10 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 11 base_url="https://api.atlascloud.ai/v1" 12 ) 13 response = client.images.generate( 14 model=MODEL_MAP[user_tier], 15 prompt=prompt, 16 n=1 17 ) 18 return response.data[0].url

**結果:**開発者は3週間ではなく4日でローンチしました。プレミアムティアでSeedance 2.0を使用することで、無料ティアの3倍の価格設定が正当化され、ティア別のモデル構造は3つの個別ベンダー統合ではなく、1つのAtlas Cloud キーで構築されました。

-

Atlas Cloud の優位性:なぜ「単一のAPI」が正しいアーキテクチャなのか {#atlas-cloud-advantage}

Atlas Cloud は、世界初のフルモーダルAI推論プラットフォームとして位置づけられています。テキスト、画像、動画、音声生成にわたる300以上のモデルを提供する統合APIです。

GitHub AI動画生成スキルの作成者にとっての具体的なメリット:

-

OpenAI互換API(ドロップイン置換)

Atlas Cloud はOpenAI互換のエンドポイントを使用します。もしあなたのスキルがすでにOpenAI SDKと統合されているなら、動画生成のためにAtlas Cloud に切り替えるには

1api_key1base_url-

マルチモデルワークフローの単一請求

本番環境の動画ワークフローで一つのモデルを使うことは稀です。一般的なパイプラインは以下のようになります:

- 画像生成(開始フレーム)用のSeedream 5.0

- 画像から動画変換用のKling v3.0

- プロンプト最適化用のLLM(Claude、GPT-4、DeepSeek)

- ナレーション用のTTSモデル

ベンダーごとにアカウントを分けると、4つの請求関係、4つのレート制限プール、4つの統合ポイントが生まれます。Atlas Cloudなら、APIキー1つと請求書1枚で済みます。

-

モデルレベルでの価格透明性

Atlas Cloud は隠れた計算手数料なしでモデルごとの価格を公開しています。ビジネスモデルはシンプルで、生成した分だけ支払う従量制です。新規開発者は初回デポジットで20%のボーナス(最大100ドルまで)を受け取ることができ、紹介プログラムでは追加クレジットも提供されます。財務予測を立てる前に、必ずatlascloud.ai/pricingで現在の価格を確認してください。

-

コンプライアンス対応

規制環境にデプロイされるエンタープライズGitHubスキルのために、Atlas Cloud はSOC I & II認証を保有し、HIPAA準拠を維持しています。米国、EU、アジア地域にインフラを備えており、エンタープライズのデータ主権要件の大部分をカバーします。

-

ComfyUI、n8n、MCPサーバー統合

Atlas Cloud は、GitHub動画生成スキルの構築に最も一般的に使われるツールとネイティブに統合されています:

- ComfyUI — ビジュアルワークフロー作成のためのカスタムノード

- n8n — Atlas Cloud 動画生成ステップを組み込んだワークフロー自動化

- MCPサーバー — AIエージェントフレームワークのためのModel Context Protocol統合

-

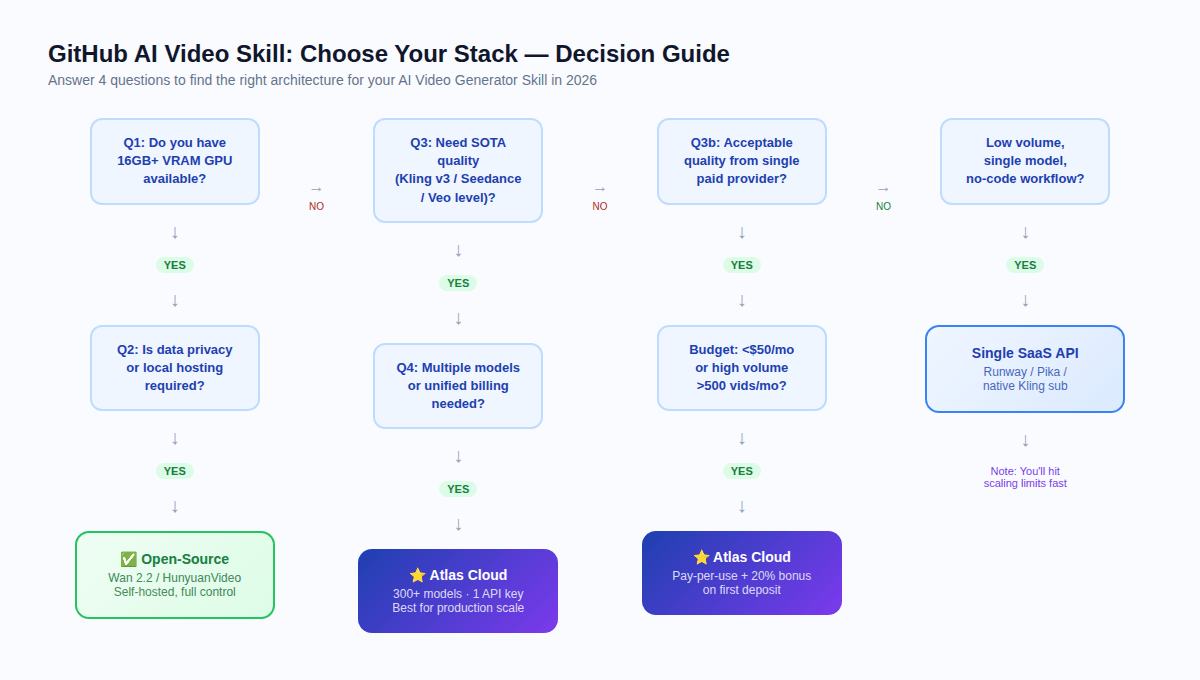

どのスタックを使うべきか? {#decision-guide}

次の4つの質問に答えてください:

Q1: 16GB以上のVRAMを持つGPUが利用可能か?

いいえなら → セルフホストを完全に除外してください。クラウドAPIが唯一の実践的な道です。

Q2: 規制によってデータプライバシーやローカルホストが義務付けられているか?

はい+GPU利用可能なら → オープンソース(VRAMに応じてWan 2.2またはHunyuanVideo)を評価してください。

はい+GPUなしなら → Atlas Cloud(HIPAA準拠、SOC認証済み)を使用し、特定の規制要件を確認してください。

Q3: SOTA品質(Kling v3、Seedance 2.0、Veoレベル)が必要か?

はいなら → クラウドAPIが必須です。2026年現在、オープンソースモデルと主要な商用モデルの間には無視できない品質のギャップがあります。

オープンソースレベルの品質で十分なら → Wan 2.2セルフホストで動作する可能性があります。

Q4: 複数のモデルや統合請求が必要か?

はいなら → Atlas Cloud です。規模に応じて複数のベンダーアカウントを管理すると、生産量が増えたときに初めて表面化する隠れた運用コストが発生します。

用途別の推奨スタックまとめ

| 用途 | 推奨スタック |

| 研究/プロトタイピング | オープンソース(Wan 2.2、CogVideoX) |

| SNSエージェンシー、500本+/月 | Atlas Cloud + Kling v3.0 |

| ミュージックビデオ/キャラアニメ | Atlas Cloud + Seedance 2.0 |

| VFX/物理シミュレーション | Atlas Cloud + Sora 2 |

| データ主権/オフライン | セルフホスト(HunyuanVideo、Open-Sora 2.0) |

| ティア制モデル品質を持つSaaS | Atlas Cloud(1つのキーで複数モデル) |

| 大量オープンソースバッチ | Wan 2.2セルフホスト(月間1万本以上の閾値) |

-

FAQ {#faq}

Q: AI動画生成スキルとは何ですか?

アプリケーションとAI動画生成バックエンド(オープンソースの重みまたはクラウドAPI)を接続する、再利用可能なコードモジュールまたは統合レイヤーです。一般的な形態として、Pythonクラス、ComfyUIノード、n8nワークフロー、MCPサーバーツールなどがあります。

Q: オープンソース動画モデルをセルフホストするための最低VRAM容量は?

Wan 2.2 1.3B(短いクリップには許容可能な品質)で8GB。CogVideoX-1.5またはOpen-Sora(より良い品質)で16GB。Wan 2.2 14Bで24GB以上。HunyuanVideoまたはOpen-Sora 2.0のフルモデルでは60〜80GBが必要です。

Q: オープンソースのAI動画生成は本当に無料ですか?

モデルの重みは無料ですが、推論は無料ではありません。GPU計算資源が必要です。小規模な運用(月間5,000本未満)では、TCO(総保有コスト)を計算するとAtlas CloudのようなクラウドAPIの方が通常は安くなります。

Q: Atlas Cloud を画像から動画への変換(i2v)ワークフローに使えますか?

はい。Atlas CloudはKling、Seedance、Viduのi2vバリエーションをサポートしています。注意:i2vモデルの場合、バリエーションによっては個別の縦横比パラメータを受け付けないものがあり、出力解像度は入力画像の寸法に従います。

Q: Atlas Cloud はレート制限をどのように処理しますか?

Atlas Cloudは非同期/Webhookパターンをサポートしています。動画生成ジョブはタスクとして送信され、アプリケーションはタスクIDを受け取り、レンダリング完了時に通知を受け取ります。これにより、スケール時のブロックを防ぎます。

Q: ショット間でキャラクターの一貫性を保つための最適なモデルは?

Seedance 2.0のユニバーサルリファレンスシステムが2026年現在で最も高度なソリューションです。参照動画、画像、音声を供給することで、生成されたクリップ全体でキャラクターの容姿や動きの一貫性を維持できます。

Q: Atlas CloudはComfyUIをサポートしていますか?

はい。Atlas Cloud はネイティブなComfyUI統合のほか、n8nノードやMCPサーバー互換性も備えています。

Q: オープンソース動画モデルは縦横比をどのように処理しますか?

モデルにより異なります。Open-Soraは

1--aspect_ratioまとめ

2026年の市場は2つのキャンプに分かれており、それぞれに得意領域があります:

オープンソースは、予備のGPUがある場合、月間1万本以上の動画を生成する場合、データをサーバー外に出せない場合、あるいは独自の専有フッテージでファインチューニングする必要がある場合に適しています。

有料APIは、最高の品質が必要な場合、コストよりも速度が重要な場合、月間5,000本未満の場合、あるいはベンダー契約を管理せずに複数のモデルをミックスしたい場合に最適な選択肢です。

Atlas Cloud は、この2つを橋渡しします。ホストされた推論による主要なオープンソースモデルから、あらゆる主要な商用モデルまで、300以上のモデルへのアクセスを単一のOpenAI互換APIキーで提供する統合プラットフォームです。2026年に本番環境でGitHub AI動画生成スキルを構築するほとんどの開発者にとって、プロトタイプからプロダクションへ移行するための最も摩擦の少ない道です。

この記事の価格情報は目安であり、変更される可能性があります。財務予測を立てる前に、必ずatlascloud.ai/pricingで現在の料金を確認してください。モデルの可用性は地域によって異なる場合があります。

Atlas Cloud: atlascloud.ai — SOC I & II認証 · HIPAA準拠 · 米国 · EU · アジア地域インフラ