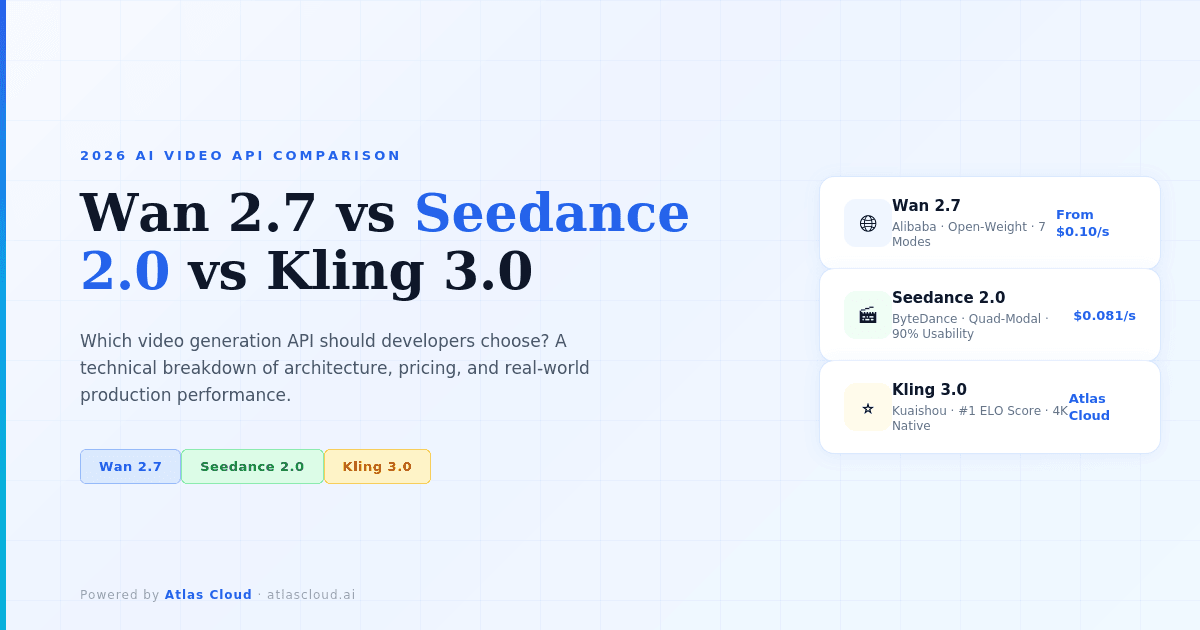

2026年初頭、わずか数週間の間に3つの強力な動画生成APIが相次いでリリースされました。Wan 2.7(Alibaba)、Seedance 2.0(ByteDance)、Kling 3.0(Kuaishou)は、それぞれが最高峰であると謳っています。プロダクションレベルの動画パイプラインを構築する開発者が必要としているのは、マーケティング資料ではなく、明確な判断材料です。

2026年初頭、わずか数週間の間に3つの強力な動画生成APIが相次いでリリースされました。Wan 2.7(Alibaba)、Seedance 2.0(ByteDance)、Kling 3.0(Kuaishou)は、それぞれが最高峰であると謳っています。プロダクションレベルの動画パイプラインを構築する開発者が必要としているのは、マーケティング資料ではなく、明確な判断材料です。

本ガイドではノイズを排除し、Atlas Cloudを利用するプロダクションチームの具体例を交えながら、アーキテクチャ、実用的な出力品質、価格、そして各モデルが真価を発揮するワークフロー条件を比較します。

結論を先に述べます: すべてのユースケースを制する万能なモデルは存在しません。Seedance 2.0はマルチモーダル制御と顔の再現性で優れ、Kling 3.0はシネマティックなストーリーテリングとベンチマークスコアでリードしています。Wan 2.7は柔軟性とオープンウェイトという経済性、そして動画編集機能で勝っています。正しい選択は、アプリケーションが実際に何を必要としているかに依存します。

2026年の動画APIランドスケープ:何が変わったのか

モデルを比較する前に、何が変わったのかを定義しておく必要があります。新しいモデルは単純に「性能が高い」という素朴な仮定だけでは、本質を見失います。

モデルを比較する前に、何が変わったのかを定義しておく必要があります。新しいモデルは単純に「性能が高い」という素朴な仮定だけでは、本質を見失います。

2026年世代の動画APIは、以前のモデルが到達できなかった3つのハードルを越えました:

ハードル1:ネイティブオーディオが当たり前の基準に。 Seedance 2.0とKling 3.0は、音素レベルのリップシンクを備えたオーディオと動画を一度に生成します。Wan 2.7も最新リリースでネイティブのオーディオ調整機能を追加しました。半年前まではネイティブのオーディオ機能自体が差別化要因でしたが、今やそれは基本要件です。

ハードル2:参照入力がプロンプトに代わる主要な制御手法へ。 3つのモデルすべてが、テキストだけでなく画像や動画の参照を受け付けるようになりました。これにより、開発者のワークフローは「プロンプトを磨く」ことから「優れた参照素材を提供する」ことへとシフトしました。品質の天井は上がりましたが、入力準備の複雑さも増しています。

ハードル3:キャラクターの一貫性は解決可能だが、実装は異なる。 複数の生成クリップ間で同じ顔、衣装、姿勢を維持することは、AI動画における最大の未解決問題でした。3つのモデルすべてが異なるメカニズムと信頼性プロファイルでこれに対処しています。

これらの変化を理解することが、モデル比較の真の意味を明確にします。

モデル別解説

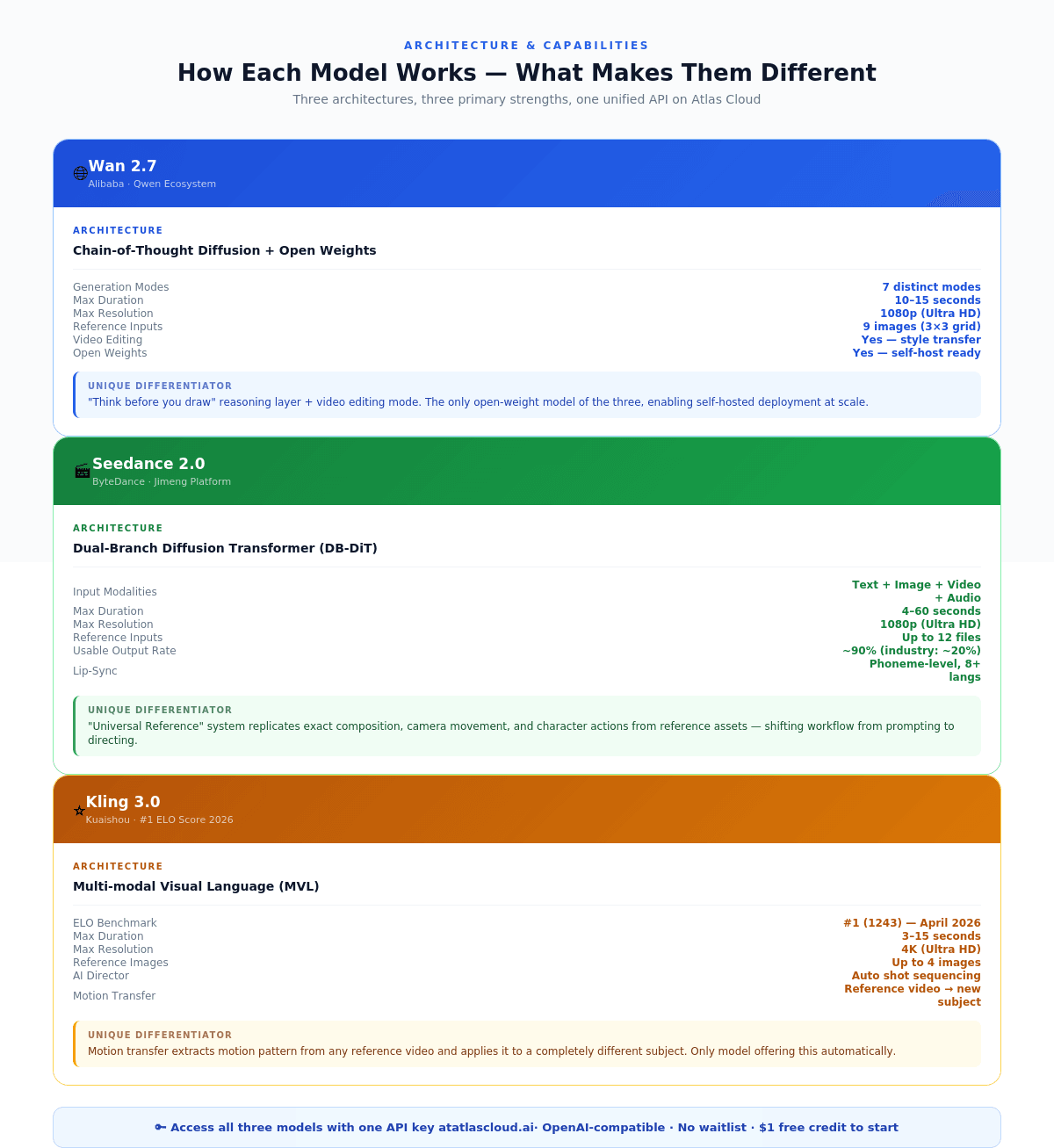

Wan 2.7 — Alibabaのオープンウェイトの主力モデル

Wan 2.7は、2026年初頭にQwenエコシステム内でリリースされた、Alibabaの最新の動画生成シリーズです。これはオープンウェイトモデルであり、開発者のコストや導入の観点から見て最も重要な事実です。

Wan 2.7の機能: Wan 2.7は7つの生成モードをサポートしています:テキストから動画、画像から動画、開始/終了フレーム制御、動画の継続、動画編集(スタイル転換)、音声から動画、参照画像から動画。現時点でこの範囲をカバーする単一のモデルチェックポイントは他にありません。

このアーキテクチャには、画像や動画生成の前に「思考の連鎖(Chain-of-Thought)」推論レイヤーが追加されており、社内では「描く前に考える」と説明されています。これは重要です。ほとんどのテキスト・動画生成モデルは、プロンプトを一度のフォワードパスで処理するため、複雑なシーンでは空間的なエラーやレイアウトの不整合が生じやすくなります。Wan 2.7の推論レイヤーは、生成開始前にこれらを修正します。

主な仕様:

- 解像度:720pおよび1080p(Ultra HD)

- 長さ:最大15秒(設定可能)

- オーディオ:ネイティブのオーディオ調整機能、生成時に動きとリップムーブメントをオーディオトラックに同期(ポスト処理ではありません)

- 参照入力:3x3グリッド合成による最大9枚の画像で、キャラクターやスタイルの整合性を維持

- 開始/終了フレーム制御:両方のキーフレームを定義し、その間をモデルが補完

- 動画編集:テキストプロンプトによる既存映像のスタイル転換

- アスペクト比:9:16、16:9、1:1など5種類

Wan 2.7の強み:

開始/終了フレーム制御は、実用的な機能です。製品映像をアニメーション化するEコマースチームにとって、「静止状態の製品」から「動作中の製品」への遷移をフルアニメーションパスなしで制御できます。エンドポイントの制約は決定的であり、フレーム間は確率的ですが、構成上のガードレールが機能します。

動画編集モードは、他のモデルがAPIレベルで対処していないギャップを埋めるものです。Wan 2.7 Video Editは既存の映像を受け取り、テキストプロンプトに基づいてビジュアルスタイルを書き換えますが、動き、タイミング、構造は維持されます。1つのソース動画から、プラットフォームごとに適したバリエーション(YouTubeのプレロール向けに洗練、TikTok向けにアニメーション化、Instagram向けにイラスト化)を3回のAPIコールで生成できます。

9枚の画像参照グリッドは、以前なら複数の生成パスやControlNetの回避策が必要だった作業を統合します。

Wan 2.7の制限:

Wan 2.7は、Seedance 2.0よりもプロンプトを「クリエイティブに解釈」する傾向があります。正確な出力(キャラクターの挙動、特定のカメラワーク)が必要なチームには、Seedance 2.0の参照システムの方が決定論的で使いやすいでしょう。Wan 2.7は「方向性を示す」のに適しており、Seedance 2.0は「正確に指示を出したい」場合に適しています。

Atlas Cloudの価格: 画像から動画生成で0.10ドル/秒〜。GPUインフラを持っており、生成ごとのコストを削減したいチーム向けにオープンウェイト版も利用可能です。

Seedance 2.0 — ByteDanceのディレクターズコンソール

2026年2月から利用可能なByteDance開発のSeedance 2.0は、異なるアーキテクチャを採用しています。デュアルブランチ拡散トランスフォーマー(DB-DiT)が動画と音声のストリームを並列処理し、生成後に調整するのではなく、生成中にオーディオビジュアルの整合性を強制します。

このモデルの最大の特徴は「ユニバーサル参照(Universal Reference)」システムです。これは、構成、カメラワーク、キャラクターのアクションを参照アセットから再現する驚異的な精度を誇ります。開発者のワークフローは「プロンプトを書く」ことから「指示を出す」ことへと変化しました。言葉で説明する代わりに、モデルに何をしてほしいかを正確に見せるのです。

Seedance 2.0の機能: テキスト、最大9枚の画像、最大3つの動画クリップ、音声を同時に受け入れる「クアッドモーダル」入力に対応しています。物理演算ベースのワールドモデルが、現実的な物体の動きと時空間の一貫性をシミュレートします。8言語以上で音素レベルのリップシンクを実現しており、音声の生成と口の動きが極めて正確に一致します。

主な仕様:

- 解像度:最大1080p(Ultra HD)。画像から動画生成時の解像度は入力画像のアスペクト比に準拠

- 長さ:4〜60秒(自動最適長の設定あり)

- オーディオ:ネイティブ対応、8言語以上での音素レベルリップシンク

- 参照入力:最大12ファイル(画像、動画クリップ、音声)を同時入力

- 実用的な出力率:

90%(業界平均は20%) - 速度:従来システムより30%高速化

Seedance 2.0の強み:

実用的な出力率90%は、単なるマーケティング数値ではありません。生成の失敗がコンピューティングコストの無駄や人手による確認コストに直結する現場では、これは極めて重要です。月1,000クリップ生成する場合、成功率20%なら1,000クリップを得るために5,000回の生成が必要ですが、成功率90%なら1,111回で済みます。これは実質的なAPIコストに4.5倍の差をもたらします。

顔の再現性は、他の2モデルに対するSeedance 2.0の明確な技術的優位点です。当社のSeedance 2.0は、ByteDanceのJimengプラットフォームで適用されるようなコンテンツ制限なしで、リアルな人間の顔をサポートしています。実際の人物が動画に登場する必要があるマーケティングやEコマースの現場では、これが決定的な要因となります。

ユニバーサル参照システムにより、詳細な指示が必要な場合にSeedance 2.0は正しい選択肢となります。「この参照動画と全く同じようにキャラクターを動かしてほしい」といった要望に対し、Seedance 2.0は最も信頼できる回答を提示します。

Seedance 2.0の制限:

画像から動画生成時のアスペクト比は入力画像に追従するため、個別に指定することはできません。固定された出力寸法が必要な場合は、入力準備の段階で調整する必要があります。

Atlas Cloud版Seedance 2.0: 公式料金の1.8倍の価格でフルパワー版を提供。市場で初めてリアルな人間の顔生成に対応し、制限を解除しています。無制限のRPM、待ち時間ゼロ、エンタープライズグレードのインフラを提供します。

Kling 3.0 — Kuaishouのシネマティックディレクター

2026年2月5日にリリースされたKling 3.0は、2026年4月時点でAI動画モデル全体の中で最高のELOベンチマークスコア(1243)を保持しており、Google Veo 3.1やRunway Gen-4.5を上回っています。

モデルには2つのバリエーションがあります:インテリジェントなシネマティックストーリーテリングのためのKling 3.0(Kling 2.6からのアップグレード)、およびカスタム被写体や音声クローンを備えたプログレードの整合性を実現するKling 3.0 Omniです。

Kling 3.0の機能: テキスト、画像、音声、動画を統一システムで処理するマルチモーダル・ビジュアル・ランゲージ(MVL)アーキテクチャを採用しています。カメラアングル、ショットタイプ、キャラクターのステージングを自動計画する「AIディレクター」が搭載されています。4Kネイティブ出力と、中国語、英語、日本語、韓国語、スペイン語での多言語オーディオ、複数キャラクターの対話をサポートしています。

主な仕様:

- 解像度:最大4Kネイティブ(Ultra HD)

- 長さ:3〜15秒

- オーディオ:ネイティブ、多言語リップシンク、複数キャラクター対話サポート

- シーン計画:AIディレクターによる自動ショットシーケンス

- モーション転送:参照動画から動きパターンを抽出し、異なる被写体に適用

- 被写体の整合性:最大4枚の参照画像によるキャラクター固定

- テキストレンダリング:動画内の標識、ロゴ、価格表示などの読みやすさがクラス最高

Kling 3.0の強み:

参照動画から動きを抽出し、全く異なる被写体に適用するモーション転送機能は、2026年初頭に話題を呼び、現在も最大の特徴です。この比較対象モデルの中で、この自動化を実現しているのはKling 3.0だけです。

テキストレンダリングは、過小評価されがちですが実用上重要な利点です。Kling 3.0の動画内では、ロゴや価格タグが明瞭に読み取れます。他のモデルでAI生成動画内のテキストを可読な状態に保つ苦労を知る人なら、これがどれほど重要か分かるはずです。価格やSKU情報が表示される必要があるEコマース動画において、Kling 3.0のテキスト忠実度は必須要件となります。

4Kネイティブ出力の天井は、3モデルの中で最高です。大型ディスプレイでの表示や、ポストプロダクションでのアップスケーリングを前提とするコンテンツには、より広い解像度のヘッドルームがあるKling 3.0が有利です。

Kling 3.0の制限:

コンシューマー向けプラットフォームのサブスクリプション料金体系が不透明な場合があります。ネイティブプラットフォームは生成失敗時にもクレジットを消費し、混雑時には30分を超える待ち時間が発生し、APIアクセスもエンタープライズ層に制限されています。サブスクリプションの摩擦なしでプログラムアクセスが必要な場合は、当社のプラットフォーム経由の利用をおすすめします。

また、Kling 3.0はSeedance 2.0よりもプロンプトを「クリエイティブに解釈」するため、事前の正確な動作指定が不可欠なブリーフには不向きな場合があります。

当社のプラットフォームでの価格: Kling 3.0 APIアクセスは競争力のある秒単位の料金で提供しています。料金は変更される可能性があるため、リアルタイムの料金ページをご確認ください。

並行比較表

| 項目 | Wan 2.7 | Seedance 2.0 | Kling 3.0 |

|---|---|---|---|

| 最大解像度 | 1080p (Ultra HD) | 1080p (Ultra HD) | 4K (Ultra HD) |

| 最大時間 | 15秒 | 60秒 | 15秒 |

| ネイティブオーディオ | あり | あり (音素レベル) | あり (多言語) |

| 入力モダリティ | テキスト, 画像, 音声, 動画 | テキスト, 画像, 音声, 動画 | テキスト, 画像, 音声, 動画 |

| 参照画像 | 最大9枚 (3×3グリッド) | 最大9画像 + 3動画 | 最大4画像 |

| 動画編集モード | あり | なし | あり (Omni) |

| 顔の忠実度 | 良好 | クラス最高 | 良好 |

| 動画内テキスト | 中程度 | 中程度 | クラス最高 |

| オープンウェイト | あり | なし | なし |

| Atlas Cloud価格 | 0.10ドル/秒〜 | 0.081〜0.10ドル/秒 | 料金ページを参照 |

| 推奨用途 | 編集, オープンウェイト | 顔出しコンテンツ, 精密制御 | シネマティック, 4K |

2026年4月時点の価格。最新の料金はatlascloud.ai/pricingをご確認ください。

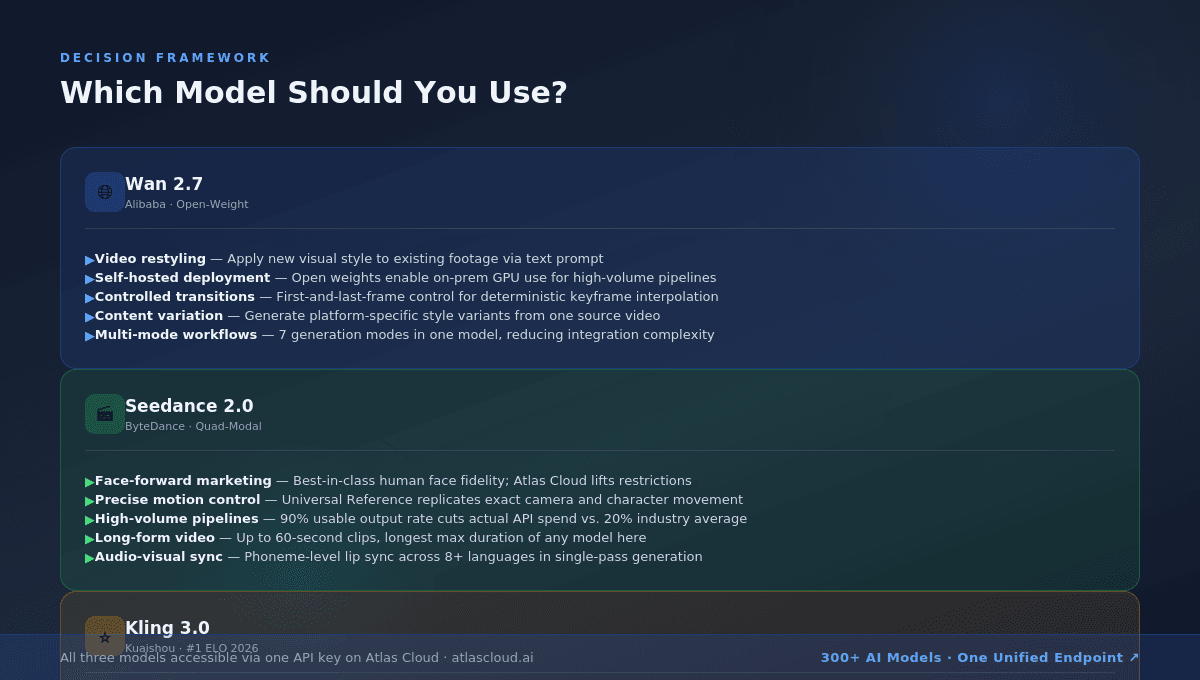

意思決定フレームワーク:ユースケース別モデル選択

Seedance 2.0を選ぶべき場面:

顔が主役のコンテンツ制作時: マーケティングキャンペーン、製品スポークスパーソン動画、対談、顔の一貫性が求められるEコマースコンテンツなど。Seedance 2.0の顔の再現性と、制限のないリアルな顔生成アクセスの組み合わせは、明らかに最適解です。

クリエイティブな要件が明確な場合。 キャラクターの動きを正確に示す参照動画や、シーンの外観を示す参照画像がある場合、Seedance 2.0のユニバーサル参照システムが最も忠実な再現を提供します。

大量のパイプラインを運用している場合。 実用的な出力率90%と0.081ドル/秒のFast階層価格により、競合他社と比較して実質的なクリップ単価を大幅に削減できます。月間数千件を生成する場合、この差は非常に大きくなります。

長いクリップが必要な場合。 Seedance 2.0の最大60秒という長さは他にありません。Kling 3.0とWan 2.7はいずれも最大15秒です。

Kling 3.0を選ぶべき場面:

ストーリー主導のコンテンツ制作時。 AIディレクターによる自動シーン計画が手作業を大幅に削減する、予告編、短編映画、連載ソーシャルコンテンツ、ブランドストーリーなどに適しています。

動画内のテキスト可読性が必須な場合。 Eコマースの商品リスト、価格カード、生成されたシーン内のブランドロゴなど、Kling 3.0のテキストレンダリングはクラス最高です。

モーション転送が必要な場合。 参照映像から動きを抽出し、異なる被写体に適用する機能はKling 3.0独自のものです。

解像度が重視される場合。 大画面表示やポストプロダクションでアップスケーリングの余地が必要な場合の4K出力。

Wan 2.7を選ぶべき場面:

既存映像のスタイル変更が必要な場合。 動画編集モードによるテキストプロンプトでのスタイル転換は、他のモデルではこれほどきれいにカバーされていません。

自社ホスティングが経済的に合理的な場合。 オープンウェイトモデルのため、自身のGPUインフラに展開可能です。月間数千本生成するチームにとって、秒単位のAPIコストを排除できる経済的メリットは非常に大きいです。

単一モデルで多様な生成モードが必要な場合。 7つのモード(テキスト/画像/開始終了フレーム/継続/編集/音声/参照からの生成)が単一モデルに集約されており、統合が容易です。

大量のコンテンツバリエーション制作時。 動画編集モードは、再撮影なしで同じソース素材から複数のビジュアルバリエーションが必要なエージェンシー向けに設計されています。

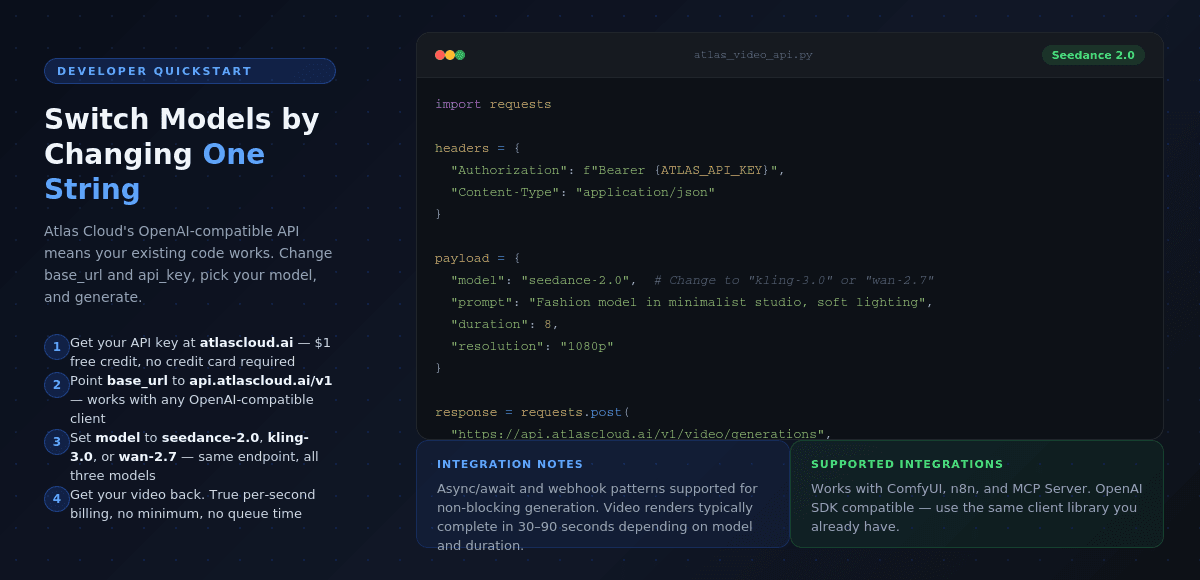

なぜこれら3つにAtlas Cloudを選ぶべきか

これらのモデルは各開発者のプラットフォームで直接利用可能ですが、なぜAtlas Cloudを使うべきなのでしょうか?

請求の統合: Alibaba Cloud、BytePlus、Klingプラットフォームなど、3つの異なるAPIキー、請求アカウント、ドキュメントを管理するのは運用上の大きな負荷となります。当社は単一のAPIキー、単一のエンドポイント(

1https://api.atlascloud.ai/v1スマートルーティングによるコスト削減。 BytePlusはSeedance 2.0に対して1分単位の課金を行うため、5秒のクリップも60秒として請求されます。Atlas Cloudは真の秒単位課金です。短尺コンテンツのパイプラインでは、この差だけで乗り換える価値があります。

待ち時間なし: Klingのネイティブプラットフォームはピーク時に30分を超える待ち時間が発生することがありますが、当社のインフラは全モデルの待ち時間を排除します。

Seedance 2.0でのリアルな顔生成のサポート: ByteDanceのJimengプラットフォームはリアルな顔の生成を制限していますが、当社のバージョンではこの制限を解除しており、マーケティングや商用コンテンツで活用可能です。

OpenAI互換のAPI形式: コードベースがすでにGPTやOpenAI互換のエンドポイントを呼び出している場合、

1base_url1api_keyエンタープライズの信頼性: SOC 2 Type II認定、HIPAA準拠、稼働率99.99%のSLA、RBACアクセス制御、米国データ主権など、コンプライアンス要件を満たす環境を提供します。

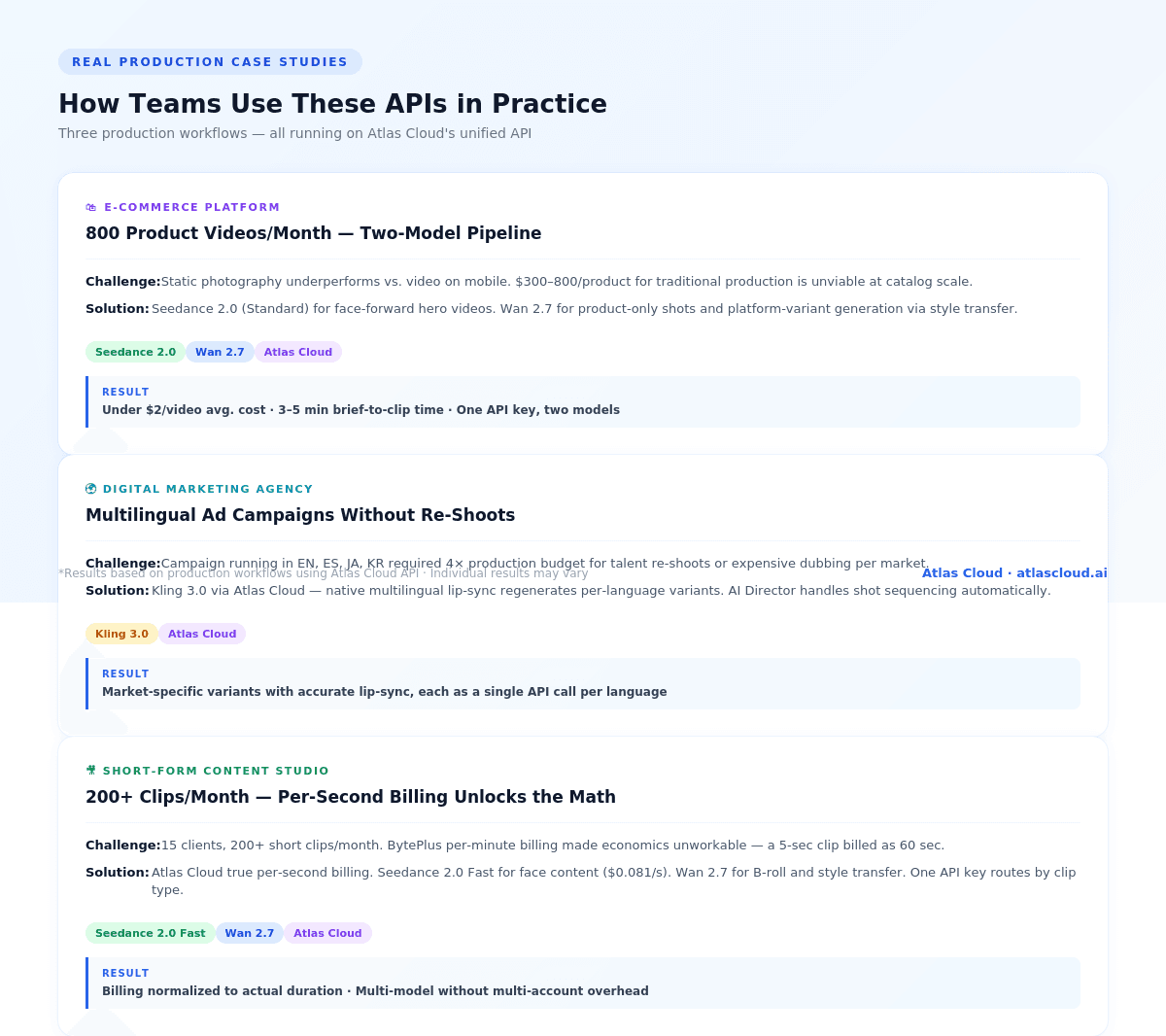

実例ケーススタディ

ケーススタディ1:Eコマースプラットフォーム — 大規模な製品動画生成

チーム: 月間800以上のSKU向けにライフスタイル動画を生成しているファッションEコマース企業。

問題: 静止画よりも動画の方がモバイルプラットフォームでのパフォーマンスが良いが、従来の方法では製品1つあたり300〜800ドルかかり、大規模展開が不可能。

ソリューション: 当社の2モデル・パイプラインを構築。Seedance 2.0(標準階層)がヒーロー動画を担当し、顔の整合性を確保。Wan 2.7が顔の出ないボリューム作業を担当し、低コストと動画編集モードで各プラットフォーム向けのバリエーションを迅速に作成。

結果: 月間800本の動画を生成。動画あたりの平均コストは2ドル以下。最終クリップまでの時間は3〜5分。単一のAPIキーで両方のモデルにアクセス可能です。

ケーススタディ2:デジタルマーケティングエージェンシー — 多言語広告キャンペーン

チーム: 北米、欧州、東南アジアでグローバルブランドを展開する中堅エージェンシー。

問題: 各市場向けにタレントを再起用したり、吹き替えを行う費用が高額。

ソリューション: Kling 3.0のネイティブ多言語リップシンクを採用。1つの動画シーンを生成した後、音声プロンプトを変えて各国語版を再生成。AIディレクターがシーンのショットシーケンスを自動化し、指示の手間を削減。

結果: ローカライゼーションコストを大幅削減。同じクリエイティブブリーフから、市場ごとに正確なリップシンクを備えた動画バリエーションを迅速に生成可能に。

ケーススタディ3:ショートコンテンツスタジオ — 高頻度ソーシャルコンテンツ

チーム: 15クライアントのSNSを運用し、月間200本以上のショートクリップを生成。

問題: BytePlusの1分単位課金では、5秒のクリップが60秒分請求されるため採算が取れない。

ソリューション: 秒単位課金と統一APIにより解決。Seedance 2.0(Fast)が顔出しクリップを、Wan 2.7がBロールを担当。単一のAPIキーで、クリップタイプに応じて自動的にモデルを振り分け。

結果: 実質的な動画の長さに合わせた請求を実現し、マルチアカウント管理も不要に。

開発者の統合パス

3つすべてのモデルは、OpenAI互換の統合APIからアクセス可能です。以下はSeedance 2.0のテキストから動画生成の最小Python例です:

python1import os 2import requests 3 4headers = { 5 "Authorization": f"Bearer {os.environ['ATLAS_API_KEY']}", 6 "Content-Type": "application/json" 7} 8 9payload = { 10 "model": "seedance-2.0", 11 "prompt": "A fashion model walks through a minimalist studio, soft directional lighting, 9:16 vertical", 12 "duration": 8, 13 "resolution": "1080p" 14} 15 16response = requests.post( 17 "https://api.atlascloud.ai/v1/video/generations", 18 headers=headers, 19 json=payload 20) 21 22video_url = response.json()["data"]["url"]

Kling 3.0に切り替えるには

1model1"kling-3.0"1"wan-2.7"よくある質問

Q: 総合的に最も品質が高いモデルは?

Kling 3.0が2026年4月時点で最高ELOスコアを保持していますが、用途によって異なります。顔の再現性と正確なモーション制御ならSeedance 2.0が優れています。動画編集やオープンウェイトの経済性ならWan 2.7が優れています。

Q: Seedance 2.0のコンテンツ制限は解除されていますか?

はい。当社のSeedance 2.0は、Jimeng(ByteDanceのプラットフォーム)で適用される制限なしに、リアルな人間の顔を生成できます。

Q: 単一のAPIキーで3モデル全てにアクセスできますか?

はい。Wan 2.7、Seedance 2.0、Kling 3.0を含むプラットフォーム上の300以上のモデルすべてに1つのAPIキーでアクセス可能です。

Q: Atlas Cloudの料金はネイティブプラットフォームと比べてどうですか?

Seedance 2.0の場合、短尺コンテンツでは秒単位課金によりBytePlusの分単位課金より6〜12倍安くなります。Kling 3.0では待ち時間とサブスクリプションの摩擦を排除しています。

Q: 生成に失敗した場合も課金されますか?

はい。Klingのネイティブプラットフォームとは異なり、生成失敗に対しては課金されません。

Q: Wan 2.7を自己ホストしたいのですが?

オープンウェイトモデルのため、自身のGPUインフラに展開可能です。Alibaba Cloudに依存しないマネージドホスティングが必要な場合は、GPUクラウドアクセスも提供しています。

意思決定まとめ

| 必要とするもの | 使用するモデル |

|---|---|

| 最高の顔の再現性 | Seedance 2.0 |

| 参照映像からの正確なモーション制御 | Seedance 2.0 |

| 最長のクリップ時間(最大60秒) | Seedance 2.0 |

| 大量生成、実用クリップあたりの低コスト | Seedance 2.0 Fast |

| シネマティックなストーリーテリングとシーン計画 | Kling 3.0 |

| 参照映像からのモーション転送 | Kling 3.0 |

| 動画内テキストの可読性 | Kling 3.0 |

| 4Kネイティブ出力 | Kling 3.0 |

| 動画編集 / スタイル転換 | Wan 2.7 |

| オープンウェイトの自社ホスティング | Wan 2.7 |

| 単一モデルでの多様な生成モード | Wan 2.7 |

| 3モデル共通の単一APIキー | Atlas Cloud |

Wan 2.7、Seedance 2.0、Kling 3.0をatlascloud.aiの単一APIで利用しましょう。初回デポジットで20%ボーナス(最大100ドル)。さらに友人紹介で報酬を獲得できます。待ち時間なし、即時アクセス可能です。

この記事の価格情報は2026年4月時点のものであり、変更される可能性があります。プロダクションパイプライン構築の際は、必ずatlascloud.ai/pricingで現在の料金を確認してください。