요약: Zhipu AI(Z.ai)에서 개발한 GLM-5-Turbo는 OpenClaw 사용 사례를 위해 설계된 대규모 언어 모델이자, 당사의 첫 폐쇄형 소스 모델(이전 코드명 Pony-Alpha-2로 테스트됨)로 곧 Atlas Cloud에서 출시될 예정입니다.

이 모델은 도구 사용, 지침 실행, 다단계 워크플로우 및 장기 작업 처리 측면에서 크게 향상된 성능을 제공하며, 최대 200K 토큰의 컨텍스트 윈도우를 지원합니다. 데이터 분석 능력은 Claude Opus 4.6과 대등하며, 자동화 및 정보 처리 작업에서는 GLM-5를 능가합니다. Atlas Cloud의 통합 API와 멀티 모델 생태계를 활용하는 GLM-5-Turbo는 복잡한 비즈니스 자동화, 긴 문서 분석 및 소프트웨어 개발 전반에 걸쳐 효율적인 배포를 가능하게 하며, 개발자와 기업에게 비용 효율적이고 통합이 쉬운 AI 솔루션을 제공합니다.

GLM-5-Turbo가 Atlas Cloud에 출시된다는 소식을 전하게 되어 매우 기쁩니다!

- GLM-5-Turbo란 무엇인가: Zhipu AI(Z.ai)가 개발한 GLM-5-Turbo는 OpenClaw 사용 사례에 최적화된 대규모 언어 모델입니다. 이는 당사의 첫 폐쇄형 소스 출시 모델로, GLM-5보다 호출당 비용은 낮으면서 실행 효율은 더 높습니다. 이전에 Zhipu AI는 차세대 모델을 _Pony-Alpha-2_라는 코드명으로 비공개 테스트한 바 있습니다.

- 핵심 기능: GLM-5-Turbo는 도구 사용, 지침 수행, 다단계 워크플로우 및 지속적인 작업 실행에서 실질적인 향상을 제공합니다. 또한 시나리오 전반의 동적 추론 모드, 실시간 스트리밍 출력, 강화된 도구 연동 및 최대 200K 토큰의 긴 컨텍스트 처리를 지원합니다.

- 출시일: 2026.3.24.

GLM-5는 이전 Artificial Analysis Intelligence Index에서 Gemini 3 Pro를 제치고 최고의 성능을 보이는 오픈 소스 모델로 주목받았습니다. 그 후속작인 GLM-5-Turbo는 아래와 같은 일련의 반복적인 업그레이드를 선보입니다.

핵심 포지셔닝: ClawBench 최적화 모델

강력한 벤치마크 성능

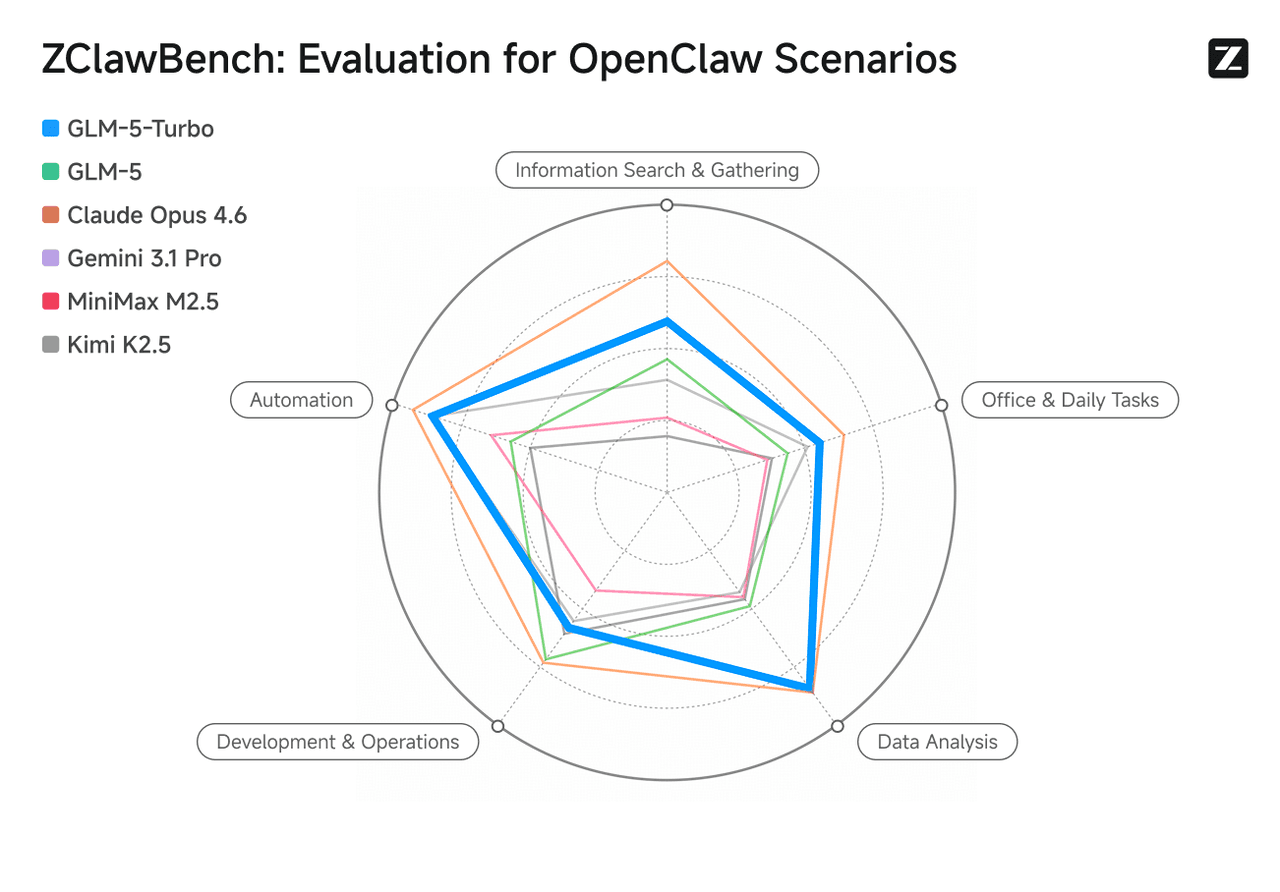

OpenClaw 시나리오에 최적화된 GLM-5-Turbo는 도구 호출, 지침 실행 및 복잡한 작업 조정 기능을 크게 강화했습니다. 데이터 분석 성능은 Claude Opus 4.6과 대등한 수준이며, 자동화, 정보 검색, 사무 생산성 및 분석 작업에서는 GLM-5를 능가합니다.

이미지 출처: Zhipu AI(Z.ai) 공식 웹사이트.

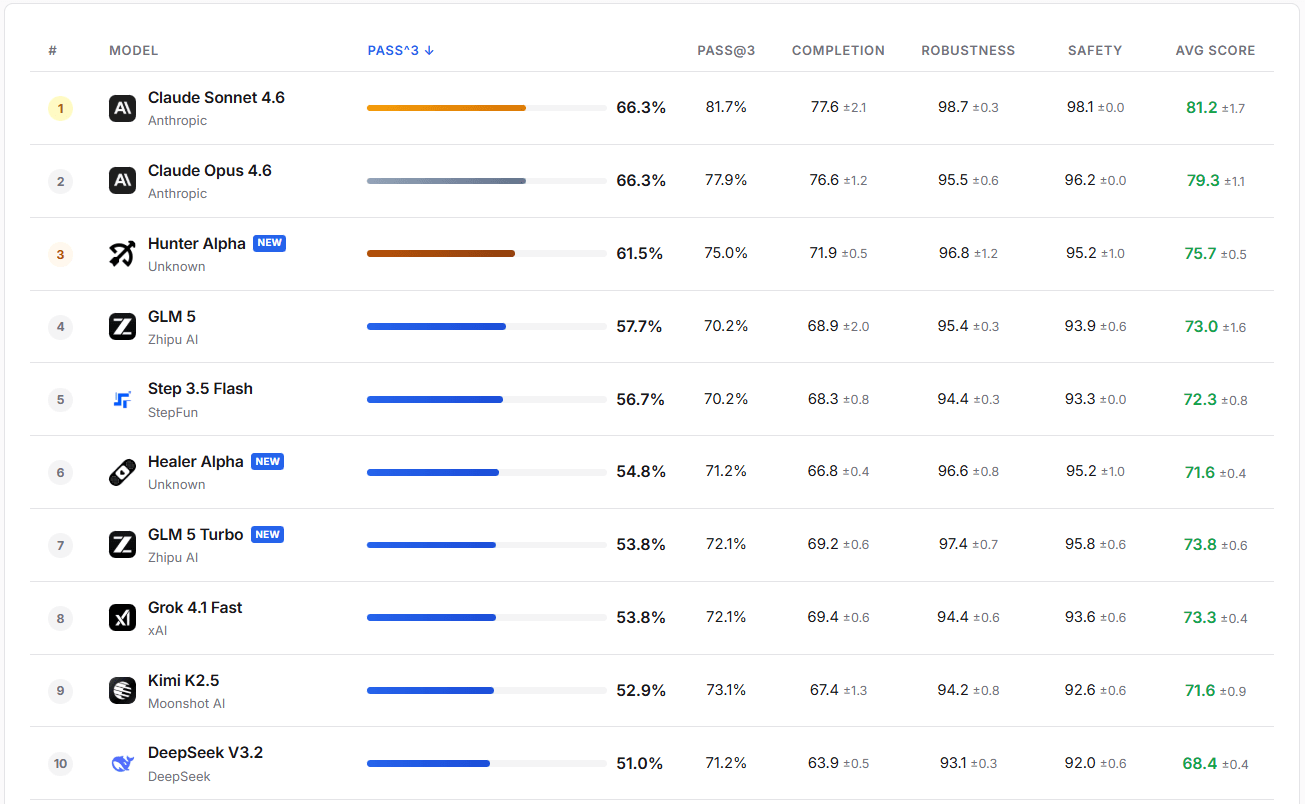

실제 평가에서 GLM-5-Turbo는 높은 안정성과 안전성을 입증했습니다. PASS@3 성공률은 GLM-5, Step 3.5 Flash 및 Kimi K2.5보다 높습니다.

이미지 출처: https://claw-eval.github.io/

강화된 도구 사용 및 외부 연동

Z.ai는 학습 과정에서 GLM-5-Turbo의 에이전트 역량을 강화하여 외부 도구와의 원활한 상호작용을 가능하게 했습니다. 이러한 실행 우선 지향적 특성에는 상충 관계가 있는데, 일부 사용자는 역할극 시나리오에서 GLM-5보다 다소 기계적인 어조를 보인다고 평가합니다.

모델별 강점을 고려하여, Atlas Cloud는 통합 인터페이스를 제공하며 사용자가 여러 모델을 동시에 쿼리하여 나란히 비교하고 선택할 수 있도록 지원합니다.

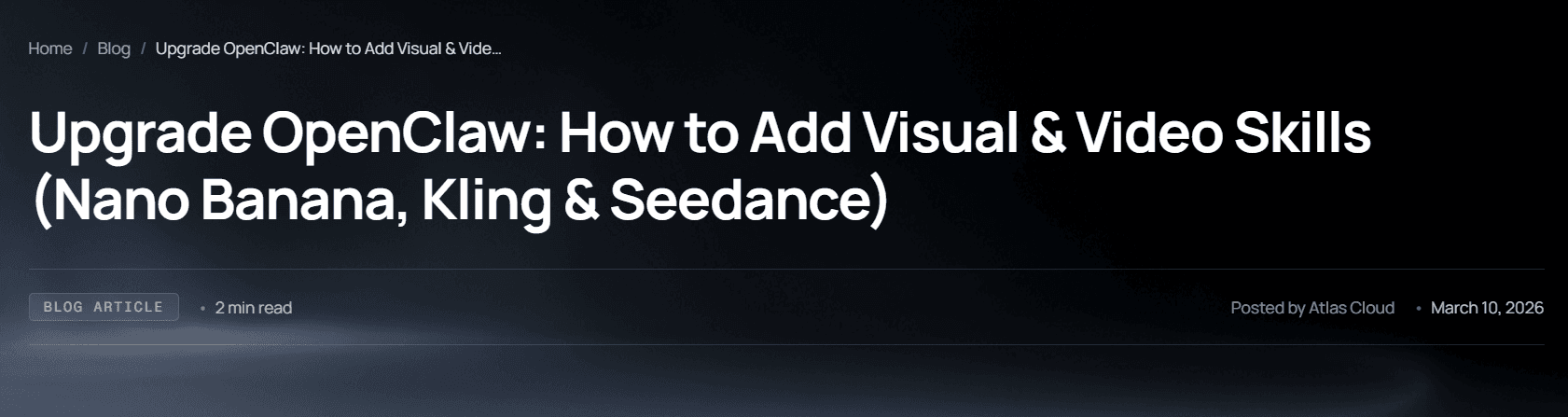

또한, 사용자는 사용자 정의 스킬을 정의하거나 GLM-5-Turbo가 스스로 스킬을 발견하고 설치하도록 허용할 수합니다.

이미지 출처: Atlas Cloud

장기적 자율 실행

GLM-5-Turbo는 예약된 트리거 또는 장기 실행이 필요한 작업에 최적화되어 있습니다. 이 모델은 지속적이고 다단계이며 시간이 걸리는 워크플로우를 강력한 작업 연속성으로 처리합니다.

또한 작업 복잡성에 따라 실행 전략을 사전에 제안합니다. 코드 최적화에 대한 비교 테스트에서 GLM-5-Turbo는 약 10%의 사례에서 경쟁 모델보다 우수한 권장 사항을 생성했습니다.

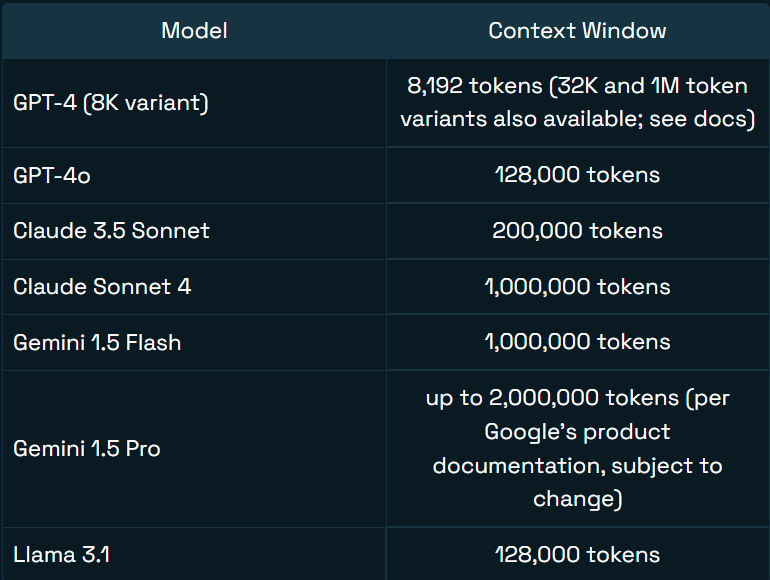

200K 토큰 컨텍스트 윈도우

최대 200K 토큰(약 133,000개의 영어 단어)을 지원하는 GLM-5-Turbo는 단일 세션 내에서 방대한 컨텍스트를 유지하고 활용할 수 있습니다. 이를 통해 대화의 마지막 단계에서도 이전 정보를 정확하게 검색할 수 있습니다.

이미지 출처: Jim Allen Wallace (Redis)

사용 사례

복잡한 워크플로우 자동화

강화된 OpenClaw 기능을 갖춘 GLM-5-Turbo는 복잡한 비즈니스 프로세스를 분해하고, 기본 논리를 식별하며, 작업을 실행하는 데 필요한 기술을 자율적으로 찾거나 생성할 수 있습니다.

예를 들어, 숏폼 비디오 제작 시 모델이 글쓰기, 이미지 생성 및 비디오 제작 도구를 검색, 설치 및 조정하여 전체 워크플로우를 기획하고 실행할 수 있습니다.

긴 문서 질의응답 및 심층 분석

이 모델은 단일 세션 내에서 긴 문서 전체의 컨텍스트를 유지하여 정확한 다중 턴 질의응답을 가능하게 합니다. 높은 토큰 효율성 덕분에 낮은 계산 비용으로 빠른 응답을 보장합니다.

대규모 코드베이스에서 GLM-5-Turbo는 아키텍처 설계를 분석하고 구성 요소 간의 종속성을 매핑하며, 저수준 코드 변경으로 인한 잠재적인 연쇄 효과를 경고할 수 있습니다.

"바이브 코딩(Vibe Coding)"

소프트웨어 개발 수명 주기 내에서 GLM-5-Turbo는 복잡한 워크플로우에 내장된 풀스택 엔지니어처럼 작동합니다. 개발자가 상위 수준의 논리를 개략적으로 설명하면 모델이 실시간으로 애플리케이션 아키텍처를 점진적으로 구축합니다.

멀티모달 기술과 결합하여 사용자는 UI 이미지, 화면 녹화본 또는 스케치를 업로드할 수 있으며, 모델이 이를 직접 기능적인 프론트엔드 구성 요소로 변환할 수 있습니다.

왜 Atlas Cloud에서 GLM-5-Turbo를 사용해야 할까요?

올 모달(All-modal) AI 인프라 플랫폼인 Atlas Cloud는 사용자에게 통합 API 인터페이스를 제공합니다. 한 번 연결하면 텍스트, 이미지, 비디오 생성 또는 멀티모달 모델을 포함하여 300개 이상의 고급 AI 모델을 쉽게 잠금 해제할 수 있습니다.

대상 사용자

- 개별 개발자: 다양한 AI 모델을 호출하기 위한 저비용의 간소화된 솔루션을 찾는 분.

- 기업: 핵심 비즈니스를 지원하기 위해 안정적이고 안전하며 확장 가능한 인프라가 필요한 곳.

- 개발팀: 프로젝트에 여러 교차 모달 모델을 효율적으로 통합해야 하는 팀.

- 워크플로우 사용자: 도구 체인 호환성을 중요하게 생각하며 ComfyUI나 n8n을 사용하는 사용자.

제품 특징

- 통합 간소화: 플랫폼은 OpenAI와 호환되는 API를 제공하여 개발자의 작업량을 즉시 간소화합니다. 여러 공급업체의 키를 관리하거나 플랫폼 전반의 유지 관리 비용을 걱정할 필요가 없습니다.

- 비용 이점: 경쟁사 대비 Atlas Cloud의 배포 비용이 더 저렴합니다. Nano Banana 2는 이미지당 $0.056(경쟁사: 이미지당 $0.07), Veo 3.1은 초당 $0.09(경쟁사: 초당 $0.1)입니다. 또한 플레이그라운드 인터페이스는 전체 가격 투명성을 제공하며, "실행" 버튼이 이미지 또는 비디오 초당 공제액을 직접 표시합니다.

- 엔터프라이즈급 안정성 및 지원: Atlas Cloud는 데이터 보호가 엄격한 개인정보 보호 표준을 충족하도록 보장하며 민감한 정보를 처리할 수 있습니다.

- 플러그 앤 플레이 지원: ComfyUI 및 n8n과 같은 도구와 원활하게 작동하도록 구축되어 기업의 전환 비용을 절감하고 즉시 시작할 수 있도록 돕습니다.

유사 제품 비교

- Fal.ai: 일부 모델을 제공하지만 Atlas Cloud는 더 넓은 선택지(300개 이상), 더 경쟁력 있는 가격을 제공하며 신규 등록 사용자는 $1 체험 크레딧을 받습니다.

- Wavespeed: 가격이 상당히 높습니다. Atlas Cloud는 Wavespeed가 강조하지 않는 추가적인 기업 규정 준수 지원과 전문가의 기술 지도를 제공합니다.

- Kie.ai: 불투명한 크레딧 시스템을 사용합니다. Atlas Cloud는 모든 실행에 대한 정확한 비용을 인터페이스에 직접 표시합니다. 모델 수 또한 Kie.ai보다 많습니다.

- Replicate: 모델 호스팅에 중점을 둡니다. Atlas Cloud의 장점은 API 통합, 모델 배포 속도 및 개발자 친화적인 지원 정책에 있습니다.

- OpenAI 또는 Google: 자체 모델만 제공합니다. 교차 모달이 필요한 사용자는 일반적으로 여러 서비스를 통합해야 합니다. Atlas Cloud는 독점 및 오픈 소스 모델을 하나의 API 아래 통합하여 시스템 복잡성을 줄입니다.

Atlas Cloud에서 GLM-5-Turbo를 사용하는 방법은 무엇인가요?

방법 1: 플랫폼에서 직접 사용

방법 2: API 연동을 통한 사용

1단계: API 키를 받으세요. 콘솔에서 API 키를 생성하고 붙여넣으세요:

2단계: API 문서를 참조하세요. 요청 매개변수, 인증 방법 등을 확인하세요.

3단계: 첫 번째 요청을 실행하세요 (Python 예시)

GLM-5 예시입니다.

plaintext1{ 2 "model": "zai-org/glm-5", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

FAQ

GLM-5-Turbo와 GLM-5의 차이점은 무엇인가요? GLM-5-Turbo는 더 빠르고 비용 효율적이며, 토큰 효율성이 GLM-5보다 최대 3배까지 향상된 것으로 보고되었습니다. 또한 OpenClaw 시나리오에 특별히 최적화되어 있습니다.

GLM-5-Turbo는 MiniMax M2.7과 어떻게 비교되나요? 두 모델 모두 에이전트 도구 사용에 최적화되어 있으며 GLM-5보다 높은 토큰 효율성을 제공합니다. 각 모델은 약 200K 토큰의 컨텍스트 윈도우를 지원합니다(MiniMax M2.7은 196,608 토큰 지원). 심층적인 비교 평가를 위한 블로그 게시물을 준비 중입니다. 기대해 주세요!

OpenClaw 배포에는 어떤 GLM 모델이 권장되나요? GLM-5-Turbo입니다. OpenClaw 시나리오에 특별히 최적화되어 있으며 Claude Opus 4.6과 대등한 데이터 분석 성능을 달성하기 때문입니다.