O que é o GLM-5.1? O modelo de codificação autônoma da Zhipu AI

O modelo GLM 5.1 chegará ao Atlas Cloud em breve!

- O que é o GLM-5.1: O GLM 5.1 é o modelo de código aberto mais avançado da Zhipu AI, ostentando as capacidades de programação mais fortes entre os modelos abertos, rivalizando com o Opus 4.6!

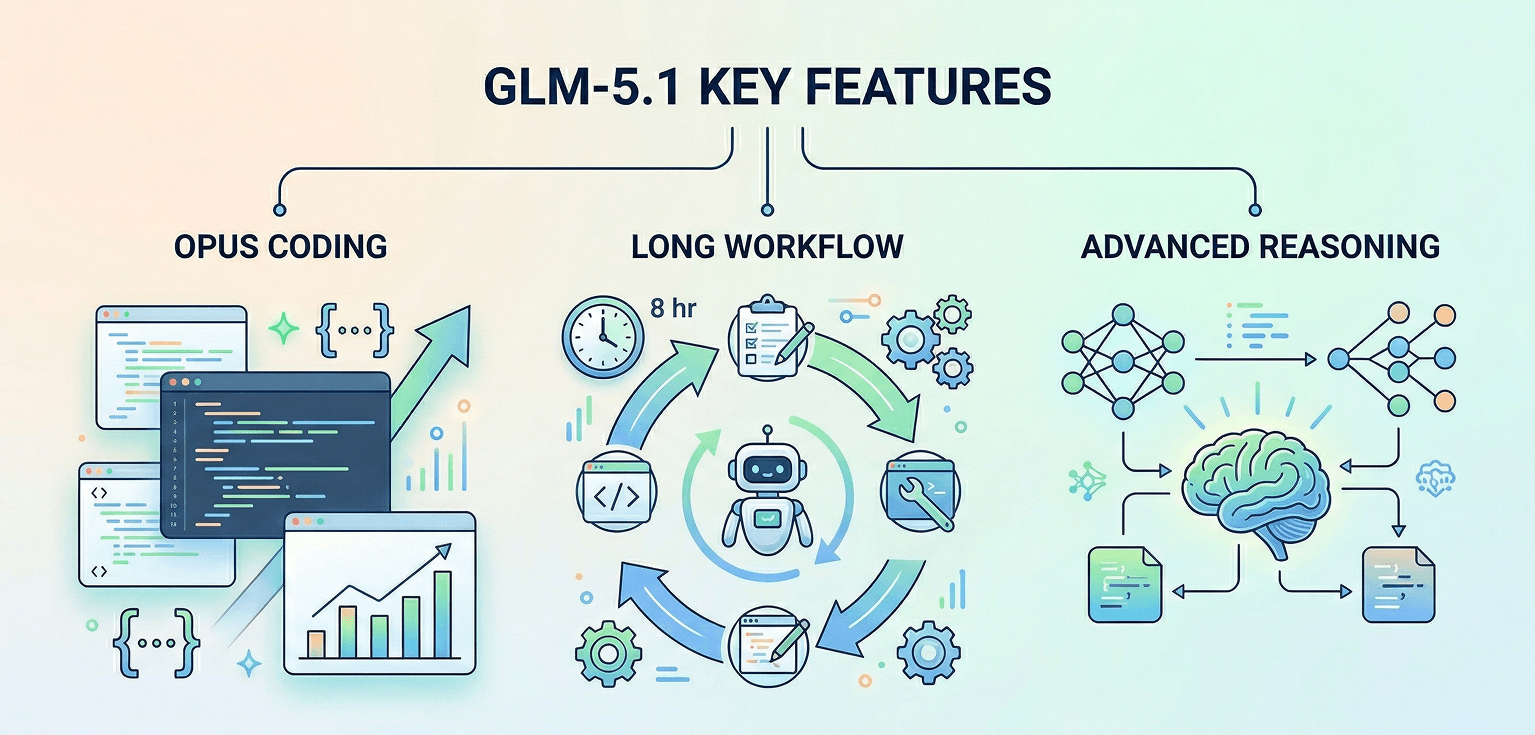

- Principais Recursos: O GLM 5.1 possui habilidades de codificação de alto nível. Ele automatiza tarefas por até oito horas, com resolução de problemas adaptativa para garantir fluxos de trabalho fluidos e resultados totalmente funcionais.

- Data de Lançamento: Este mês.

Principais Recursos do GLM-5.1

Desempenho de Codificação: Nível Opus 4.6

O GLM-5.1 alcança os resultados de referência mais fortes em tarefas de codificação, igualando o desempenho do Claude Opus 4.6. Ele ocupa o topo entre os modelos de código aberto nos principais benchmarks públicos.

Comparação com o Claude 3.5 Sonnet:

- Claude 3.5 Sonnet: Fortes capacidades de codificação, amplamente adotado para desenvolvimento

- GLM-5.1: Igual ao desempenho nível Opus 4.6, preços competitivos

Comparação com o DeepSeek V3.2:

- DeepSeek V3.2: Excelente modelo de codificação de código aberto com capacidades amplas

- GLM-5.1: Superior em benchmarks de codificação especializados, execução única de longo prazo

Execução de Tarefas de Longo Prazo: 8 Horas de Autonomia

O GLM-5.1 vai muito além do diálogo normal. Entregue a ele um projeto de engenharia real e ele planejará o fluxo de trabalho, escreverá código, executará testes, alterará estratégias se ficar preso, corrigirá problemas quando algo quebrar — e continuará trabalhando por até 8 horas para entregar um resultado completo. Poucos modelos têm essa capacidade.

Comparação com o GPT-4o:

- GPT-4o: Excelente para conversas de vários turnos e tarefas curtas

- GLM-5.1: Projetado para execução autônoma estendida com gerenciamento de estado

Comparação com o Qwen2.5:

- Qwen2.5: Desempenho forte em tarefas diversas

- GLM-5.1: Especializado para fluxos de trabalho de engenharia complexos e de longa duração

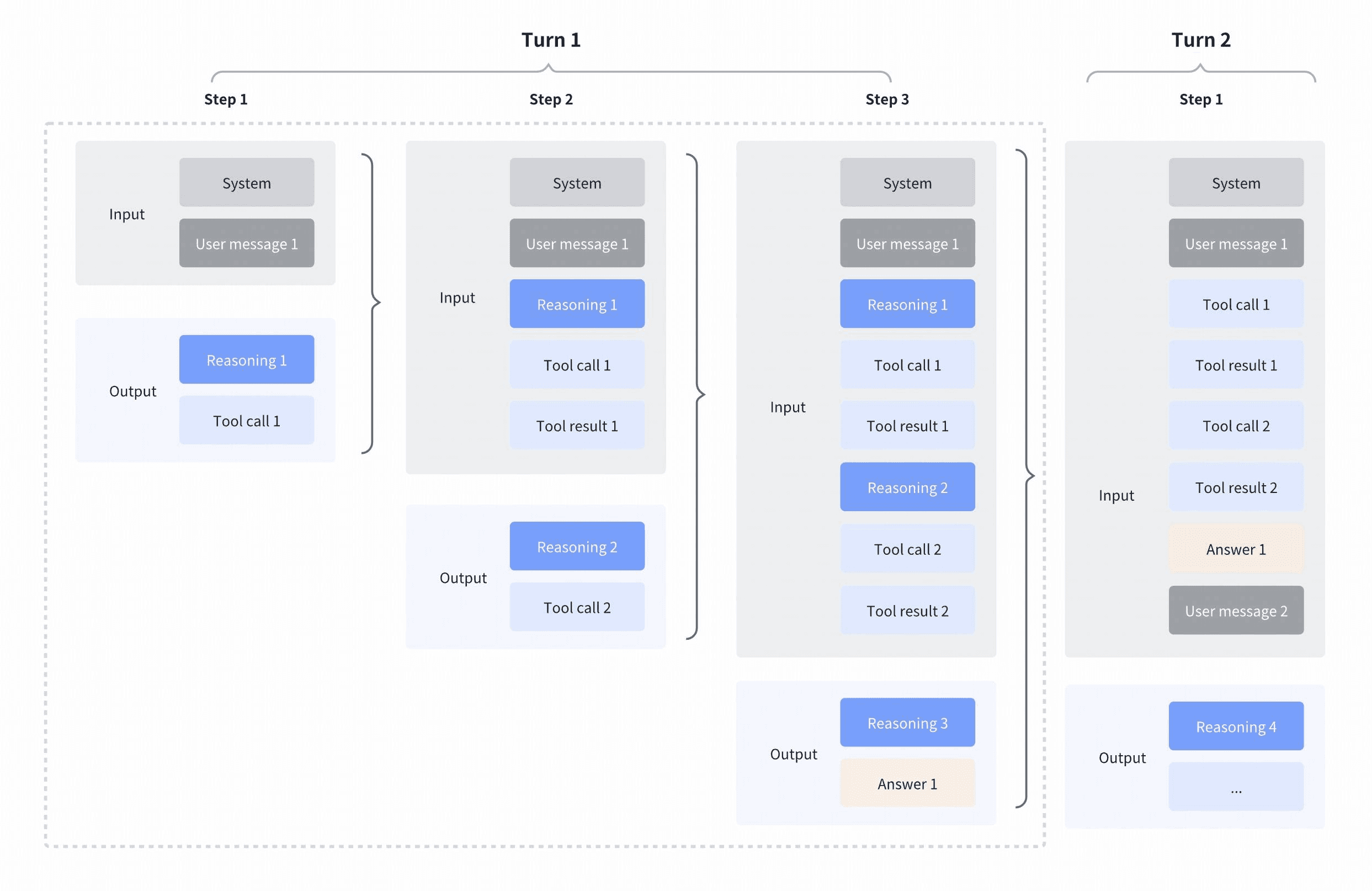

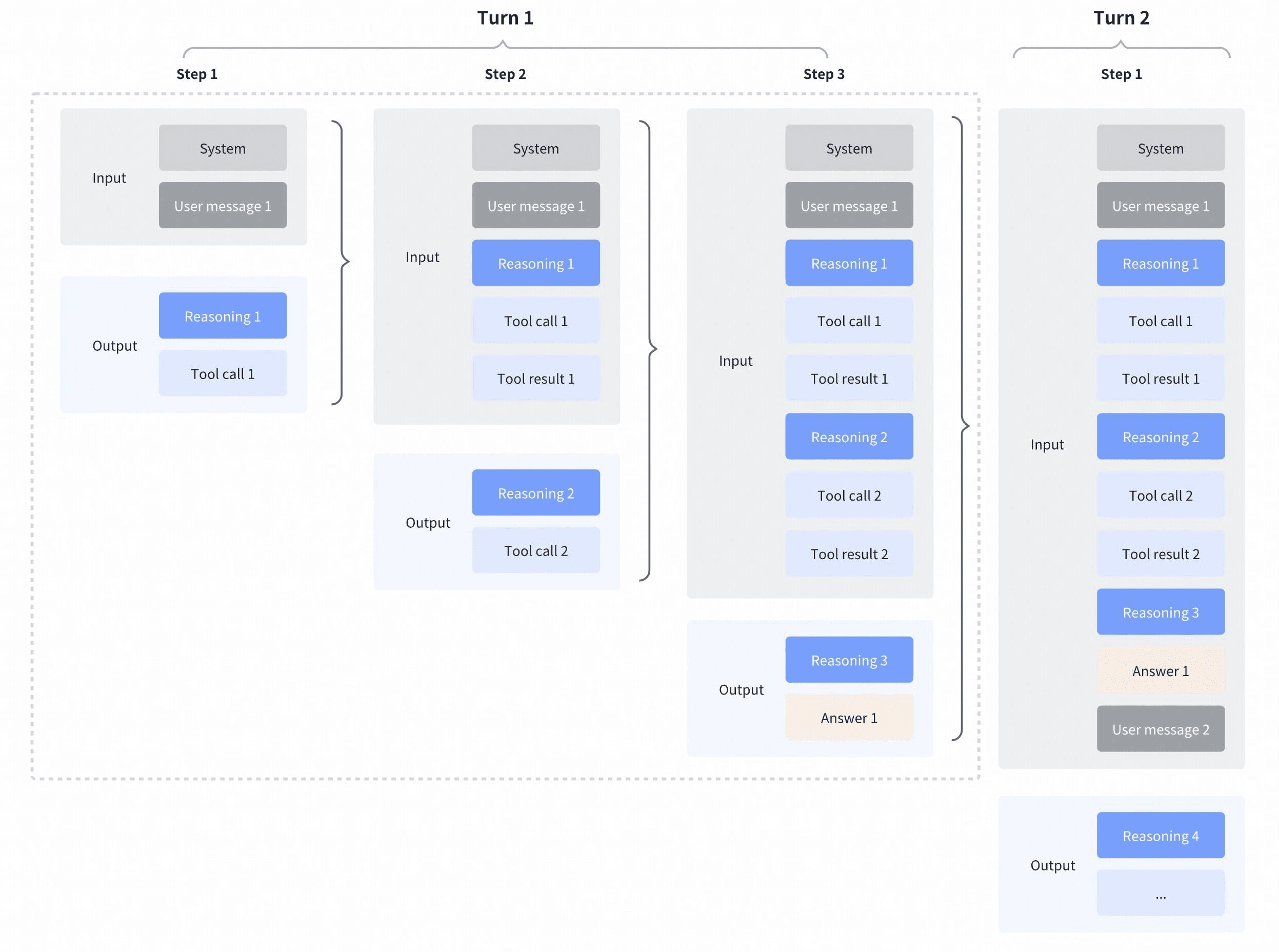

Pensamento Intercalado e Preservado

- Pensamento Intercalado

Permitir que o GLM raciocine entre e após chamadas de ferramentas permite um pensamento passo a passo: interpretando resultados, encadeando chamadas e tomando decisões precisas com base em resultados intermediários.

- Pensamento Preservado

O GLM-5.1 retém o raciocínio de turnos anteriores, garantindo continuidade, melhorando o desempenho, aumentando os acertos de cache e economizando tokens em tarefas reais.

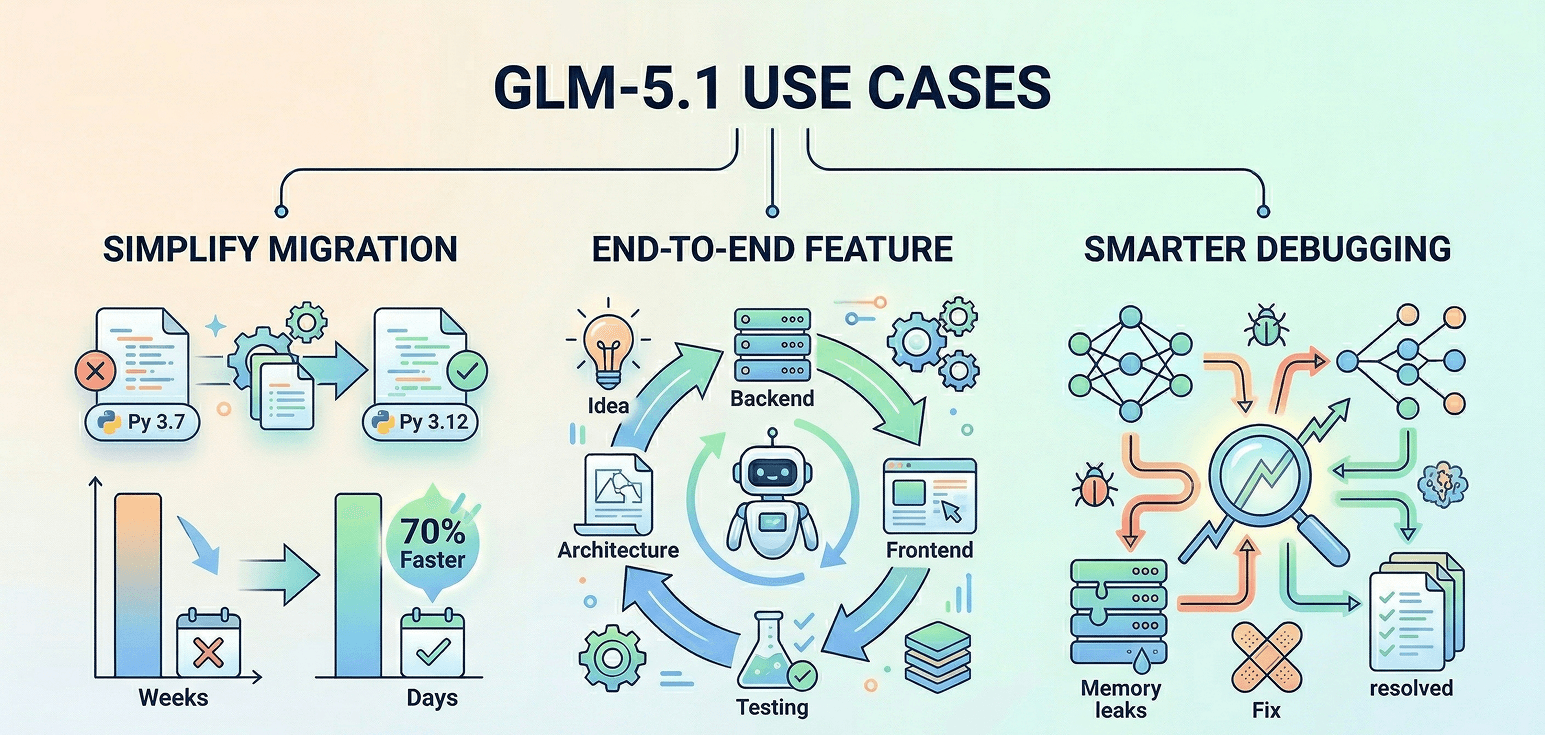

Casos de Uso do GLM-5.1: Migração de Código, Desenvolvimento de Recursos, Depuração

Simplificando a Migração de Código

O GLM-5.1 assume tarefas demoradas de migração de código, transformando semanas de esforço em questão de dias. Ele revisa a base de código, cria uma estratégia, edita arquivos em escala e realiza testes completos. Isso tornou projetos comuns, como atualizar versões do Python ou modernizar frameworks, até 70% mais rápidos e fáceis.

Desenvolvimento de Recursos de Ponta a Ponta

Desde ideias iniciais até aplicações totalmente construídas, o GLM-5.1 executa todo o processo. Ele planeja a arquitetura, constrói sistemas de backend e frontend, escreve testes e até cuida da documentação. Sem precisar de supervisão constante, ele entrega soluções completas prontas para implantação, incluindo segurança, bancos de dados e configurações de produção.

Depuração Mais Inteligente

Quando bugs complexos aparecem em grandes sistemas, o GLM-5.1 faz o trabalho pesado. Ele rastreia problemas persistentemente, sejam condições de corrida ou vazamentos de memória, e aplica correções com base em testes cuidadosos. Cada etapa é documentada, deixando os desenvolvedores com soluções sobre as quais eles podem construir.

Por que usar o GLM-5.1 no Atlas Cloud?

O que é o Atlas Cloud?

É uma plataforma que simplifica a IA, dando acesso a mais de 300 modelos de ponta em um só lugar — texto, imagens, vídeo e muito mais.

Para quem é?

• Desenvolvedores que desejam acesso fácil e acessível à IA. • Equipes que lidam com projetos que precisam de IA em várias áreas. • Empresas que precisam de IA confiável para trabalhos importantes. • Pessoas que usam ferramentas como ComfyUI e n8n.

Por que escolher?

• Uma API permite que você use tudo — apenas uma chave. • Preços claros, sem surpresas e custos baixos. • Criado para empresas: estável, seguro e suportado por especialistas. • Funciona com as ferramentas que você já possui. • Seus dados permanecem seguros e atendem aos requisitos de conformidade.

Como ele se compara?

• Fal.ai: O Atlas tem mais modelos e melhores preços. • Wavespeed: O Atlas custa menos e inclui suporte empresarial. • Kie.ai: O Atlas é mais claro nos preços e oferece uma seleção maior. • Replicate: Biblioteca menor e custos mais altos. • Outros provedores (como OpenAI): O Atlas combina tudo em uma plataforma simples.

Como usar o GLM-5.1 no Atlas Cloud

O Atlas Cloud permite que você use modelos lado a lado — primeiro em um playground, depois via uma única API.

Método 1: Usar diretamente no playground do Atlas Cloud

Método 2: Acesso via API

Passo 1: Obtenha sua chave de API

Crie uma chave de API no seu console e copie-a para uso posterior.

Passo 2: Verifique a documentação da API

Revise o endpoint, parâmetros de solicitação e método de autenticação em nossa documentação da API.

Passo 3: Faça sua primeira solicitação (exemplo em Python)

Exemplo: gerar um vídeo com GLM-5-Turbo

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

FAQ: Perguntas Frequentes sobre o GLM-5.1

P: Como o GLM-5.1 se compara ao Claude 3.5 Sonnet para codificação?

R: O GLM-5.1 iguala o Claude Opus 4.6 nos benchmarks de codificação, superando o Claude 3.5 Sonnet. Sua capacidade de lidar com tarefas estendidas o torna notável.

P: O que há de diferente na "execução de tarefas de longo prazo"?

R: Modelos de chat comuns respondem a prompts individuais. O GLM-5.1, no entanto, pode permanecer na tarefa por até 8 horas, adaptando-se e autocorrigindo-se durante todo o processo.

P: O GLM-5.1 é código aberto?

R: Sim, é totalmente de código aberto. Desenvolvido pela Zhipu AI, você pode encontrar detalhes de licenciamento na documentação oficial.

P: Está pronto para uso em produção?

R: Definitivamente! O GLM-5.1 oferece uma janela de contexto de 128K e é executado na infraestrutura confiável do Atlas Cloud, tornando-o pronto para produção.

P: Como integro sua capacidade de execução de 8 horas?

R: Para tarefas longas, use um webhook ou configuração de polling. O Atlas Cloud lida com o backend e seu aplicativo recebe o resultado final após a conclusão.

P: Para quais tarefas o GLM-5.1 é mais adequado?

R: É ideal para projetos desafiadores como migração de código, depuração de sistemas complexos e desenvolvimento de software full-stack.