O seu prompt atingiu uma barreira de recusa. Não por ser prejudicial, mas porque uma palavra-chave acionou um filtro.

Desenvolvedores na comunidade Ollama descrevem isso como "vetores de recusa": bloqueios acionados por palavras-chave que não têm nada a ver com danos reais. Engenharia reversa de malware para pesquisa de segurança, documentação de estudos de caso médico, criação de conteúdo adulto, escrita de ficção sombria. As IAs convencionais bloqueiam tudo isso. Esta lista classifica os melhores modelos de IA sem censura em 2026 com base em dados reais da comunidade, e não em textos de marketing. Ela abrange três categorias: modelos LLM sem censura para texto e código, os melhores modelos de IA locais sem censura em 2026 para implementação em hardware privado, e modelos de IA sem censura em 2026 para geração de imagem e vídeo via API. Todos os números são fontes e datados de maio de 2026.

Para uma introdução ao cenário mais amplo de ferramentas, leitores novos nesta área encontrarão no guia de gerador de imagens de IA sem censura um ponto de partida útil antes de selecionar um modelo específico.

Como Classificamos os Melhores Modelos de IA Sem Censura de 2026

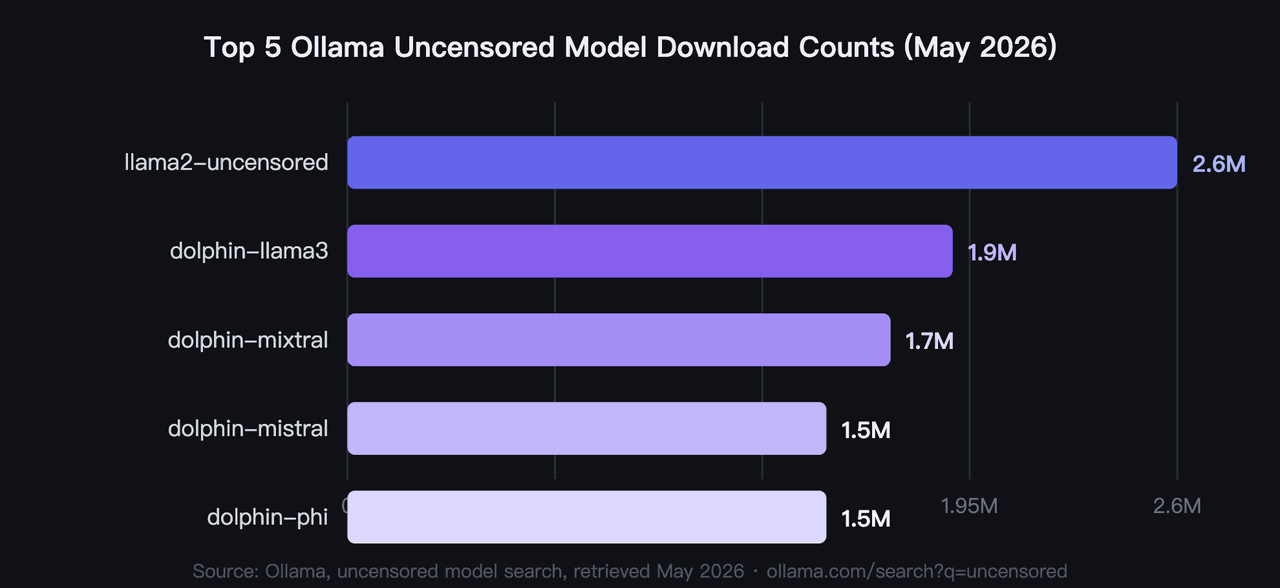

Em 2026, as contagens de download da comunidade no Ollama fornecem um sinal de classificação mais confiável do que as pontuações de benchmarks, que podem ser selecionadas para comunicados de imprensa em vez de desempenho no mundo real (Ollama, busca de modelos sem censura, 2026). Milhões de pulls representam milhares de configurações de hardware e tipos de prompts. Isso é mais difícil de manipular do que um conjunto de avaliação curado.

Três sinais de classificação são usados ao longo deste artigo. Para modelos sem censura do Ollama, o sinal principal é a contagem de pulls de ollama.com, recuperada em maio de 2026. Para modelos no OpenRouter, a classificação é baseada na contagem de parâmetros e na janela de contexto, já que as contagens de pulls não estão disponíveis publicamente nessa plataforma. Para modelos de imagem e vídeo, a classificação é baseada no preço por saída, com os custos mais baixos listados primeiro dentro de cada grupo.

A maioria dos modelos de IA sem censura de 2026 enquadra-se em duas categorias técnicas: ajustados (fine-tuned) e obliterados. Modelos ajustados como a série Dolphin são treinados em conjuntos de dados que não reforçam o comportamento de recusa. Modelos obliterados tiveram seus pesos de recusa removidos cirurgicamente. A comunidade considera consistentemente os modelos ajustados mais estáveis em diversos tipos de prompts.

Na prática, as contagens de downloads também se correlacionam com a estabilidade do modelo. Um modelo que atinge mais de 1 milhão de pulls foi testado em uma ampla gama de configurações de hardware, revelando bugs e instabilidades que grupos de teste menores ignoram completamente.

Quais São os 5 Modelos Sem Censura do Ollama Mais Baixados?

Em 2026, os cinco modelos sem censura do Ollama mais baixados somam mais de 9,2 milhões de pulls, com o llama2-uncensored liderando com 2,6 milhões (Ollama, busca de modelos sem censura, 2026). Estes são os melhores modelos sem censura do Ollama de 2026 por validação da comunidade, não por qualquer benchmark. O hardware é o filtro principal que a maioria dos usuários aplica primeiro: os requisitos de VRAM variam de menos de 4GB a 40GB neste grupo.

1. llama2-uncensored: Modelo de IA Sem Censura Mais Baixado no Ollama

O benchmark original da comunidade para IA local sem censura. George Sung e Jarrad Hope lançaram este ajuste fino para remover o comportamento de recusa do Llama 2 sem degradar a capacidade geral. É o modelo com o qual a maioria dos desenvolvedores começa, e sua contagem de 2,6 milhões de pulls reflete mais de dois anos de uso no mundo real. Nenhum outro LLM sem censura igualou esse volume de downloads.

- Parâmetros: 7B ou 70B

- VRAM: ~6GB (7B); ~40GB (70B)

- Ideal para: Chat irrestrito de uso geral e geração de conteúdo

- Plataforma: Ollama

2. dolphin-llama3: Melhor LLM Llama 3 Sem Censura para Fluxos de Trabalho Agênticos

O Dolphin de Eric Hartford em uma base Llama 3 é o modelo sem censura mais baixado construído em uma arquitetura moderna, com 1,9 milhão de pulls (Ollama, página do modelo dolphin-llama3, 2026). Ele suporta chamada de funções e uma janela de contexto que se estende de 8K a 256K tokens, dependendo da configuração. A versão 8B pesa 4,7GB, cabendo na maioria das GPUs de consumo intermediárias.

- Parâmetros: 8B ou 70B

- VRAM: ~5GB (8B); ~40GB (70B)

- Ideal para: Programação, fluxos de trabalho agênticos e chamada de funções

- Plataforma: Ollama

3. dolphin-mixtral 8x7B: Modelo de IA MoE Sem Censura para Raciocínio Complexo

Uma arquitetura de mistura de especialistas (MoE) roteia cada token através de um subconjunto de suas 8 camadas especialistas. Isso produz qualidade de raciocínio próxima a 70B com menor custo de inferência do que um modelo denso com a mesma contagem total de parâmetros. O ajuste fino sem censura de Eric Hartford mantém uma forte ênfase em programação.

- Parâmetros: 8x7B (parâmetros ativos por passagem de inferência são muito menores que o total)

- VRAM: ~12-16GB com quantização

- Ideal para: Tarefas complexas de programação, raciocínio técnico e cadeias de instruções longas

- Plataforma: Ollama

4. dolphin-mistral: Modelo de IA Local Sem Censura 7B para Respostas Rápidas

Mais leve e rápido que o dolphin-mixtral em hardware com limitação de CPU. Ele acumula 1,5 milhão de pulls de desenvolvedores que desejam um modelo local responsivo para conclusão de código sem precisar de uma GPU de última geração. A arquitetura base Mistral oferece uma forte relação desempenho-tamanho para um modelo 7B.

- Parâmetros: 7B

- VRAM: ~5-6GB

- Ideal para: Assistência de programação leve e respostas de chat rápidas

- Plataforma: Ollama

5. dolphin-phi 2.7B: Modelo de IA Local Sem Censura Mais Leve

A arquitetura base Phi da Microsoft traz um raciocínio capaz em uma contagem de 2,7 bilhões de parâmetros. O ajuste fino sem censura de Eric Hartford preserva essa eficiência. Com menos de 4GB de VRAM, ele roda na maioria dos laptops modernos com GPU dedicada, tornando-o o ponto de entrada acessível para os melhores modelos de IA locais sem censura de 2026.

- Parâmetros: 2,7B

- VRAM: Menos de 4GB

- Ideal para: Implementação em laptop, testes rápidos e ambientes com restrição de hardware

- Plataforma: Ollama

Melhores Modelos LLM Sem Censura de 6 a 10: Programação, Roleplay e Longo Contexto

Em 2026, a série Dolphin ocupa 5 das 10 primeiras posições no catálogo sem censura do Ollama por contagem de downloads, uma concentração que reflete a metodologia de ajuste fino consistente de Eric Hartford aplicada a diferentes arquiteturas base (Ollama, página do modelo hermes3, 2026). Os modelos de 6 a 10 cobrem roleplay, conversação geral, ferramentas de desenvolvedor, seguimento de instruções e contexto estendido: os casos de uso onde as recusas da IA convencional são mais disruptivas.

6. hermes3: Modelo de IA Sem Censura para Roleplay e Tarefas Agênticas

A Nous Research construiu o hermes3 para profundidade de roleplay e uso de ferramentas estruturadas. Ele está disponível em quatro tamanhos, de 3B a 405B, a maior variedade de tamanhos de qualquer modelo nesta lista. Com 1,3 milhão de pulls, a variante 8B situa-se em um ponto prático para escrita criativa e fluxos de trabalho de planejamento agêntico (Ollama, página do modelo hermes3, 2026).

- Parâmetros: 3B, 8B, 70B ou 405B

- VRAM: ~2GB (3B); ~5GB (8B); ~40GB (70B)

- Ideal para: Roleplay, ficção criativa e planejamento de tarefas agênticas

- Plataforma: Ollama

7. wizard-vicuna-uncensored: Modelo de IA Sem Censura Multi-Tamanho para Uso Geral

Um modelo mais antigo, porém comprovado, construído sobre o Llama 2, disponível em três tamanhos até 30B. Seus 1,2 milhão de pulls vêm de usuários que desejam uma opção sem censura confiável com uma gama maior de parâmetros. Ele não iguala as capacidades de janela de contexto do dolphin-llama3, mas lida com conversação geral e conteúdo criativo de forma consistente.

- Parâmetros: 7B, 13B ou 30B

- VRAM: ~5GB (7B); ~9GB (13B); ~20GB (30B)

- Ideal para: Conversação de uso geral e conteúdo criativo com múltiplas opções de tamanho

- Plataforma: Ollama

8. dolphincoder: Modelo de IA de Programação Sem Censura na Base StarCoder2

O StarCoder2 como base torna o dolphincoder um especialista genuíno. Onde outros modelos Dolphin são generalistas com ajustes sem censura, este foca especificamente no desenvolvimento de software. Seus 943 mil pulls vêm quase inteiramente de desenvolvedores, não de usuários criativos. A variante 15B lida com bases de código maiores do que a 7B consegue gerenciar.

- Parâmetros: 7B ou 15B

- VRAM: ~5GB (7B); ~10GB (15B)

- Ideal para: Geração de código, depuração e documentação técnica

- Plataforma: Ollama

9. wizardlm-uncensored: LLM Sem Censura de Seguimento de Instruções para Fluxos de Pesquisa

Um modelo de seguimento de instruções 13B com 610 mil pulls. Sua força é seguir instruções complexas de várias etapas sem hesitar ou recusar subtarefas. Em fluxos de trabalho de pesquisa onde uma recusa quebra uma longa cadeia, essa confiabilidade tem valor de produtividade direto. Ele não possui a arquitetura base moderna do dolphin-llama3, mas faz o trabalho de instrução de forma consistente.

- Parâmetros: 13B

- VRAM: ~9GB

- Ideal para: Cadeias de instruções complexas de várias etapas e fluxos de pesquisa

- Plataforma: Ollama

10. everythinglm: LLM Sem Censura com Janela de Contexto de 16K

O destaque aqui é a janela de contexto de 16K em uma base Llama 2. A maioria dos modelos 7B chega a 4K ou 8K tokens. Esse contexto extra permite que o everythinglm processe bases de código completas, documentos longos ou históricos de conversas estendidos sem truncamento. Seus 536 mil pulls são modestos para os padrões desta lista, mas ele preenche uma lacuna que nenhum outro modelo aqui cobre nesse tamanho.

- Parâmetros: 13B

- VRAM: ~9GB

- Ideal para: Análise de documentos longos, chat com contexto estendido e revisão de base de código completa

- Plataforma: Ollama

A predominância da série Dolphin nas contagens de download do Ollama reflete um padrão que a comunidade documentou: modelos sem censura ajustados de um único autor com uma metodologia consistente superam tentativas de obliteração isoladas. A obliteração remove pesos de recusa de um único modelo. O ajuste fino constrói um comportamento sem censura estável em diversos tipos de prompts. Essa consistência é a razão pela qual 5 das 10 primeiras posições pertencem ao trabalho de Eric Hartford, e não a qualquer arquitetura base única.

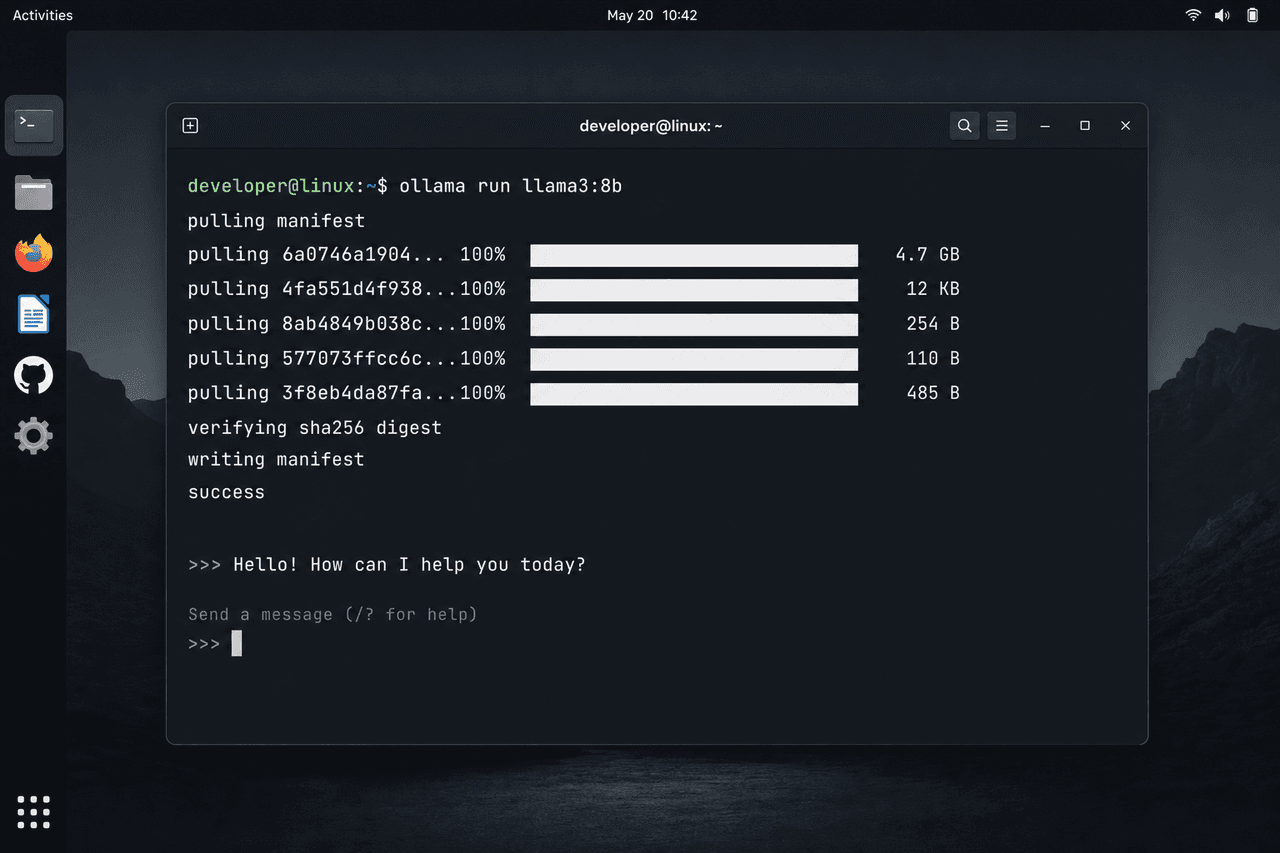

Como Instalar Modelos Sem Censura do Ollama Localmente?

Em 2026, três comandos instalam qualquer modelo Ollama no Mac, Linux ou Windows: instale o Ollama em ollama.com, execute

1ollama pull [nome-do-modelo]1ollama run [nome-do-modelo]Para o dolphin-llama3 como um exemplo concreto:

1ollama pull dolphin-llama31ollama run dolphin-llama3O LM Studio fornece uma interface gráfica para usuários que preferem não trabalhar no terminal. Ele usa os mesmos arquivos de modelo GGUF que o Ollama, com uma interface visual para seleção de modelo e ajuste de parâmetros. O llama.cpp é o mecanismo de inferência subjacente por trás de ambas as ferramentas, e suporta uso direto via linha de comando quando você precisa de mais controle sobre níveis de quantização e configurações de tamanho de contexto.

Desenvolvedores que desejam requisitos de hardware específicos e configurações de quantização para rodar os melhores modelos de IA locais sem censura de 2026 em GPUs de consumo encontrarão no guia completo de configuração local detalhes sobre configurações mínimas de VRAM e erros comuns de instalação.

Quais Modelos Sem Censura do OpenRouter Estão Disponíveis Sem uma GPU Local?

Em 2026, o OpenRouter hospeda LLMs sem censura via API, eliminando totalmente o requisito de GPU. O modelo venice/uncensored está disponível como um modelo de nível gratuito a USD0 por milhão de tokens de entrada e saída (OpenRouter, página do modelo venice/uncensored, 2026). Isso torna os modelos sem censura do OpenRouter o ponto de entrada prático para usuários sem hardware dedicado.

A compensação é direta: o OpenRouter roteia seu prompt através da infraestrutura deles, então a conversa não é privada da mesma forma que um modelo local. Modelos Ollama locais mantêm tudo no seu dispositivo. Nenhuma abordagem é universalmente melhor. A escolha certa depende do seu modelo de ameaça e da disponibilidade de hardware.

11. venice/uncensored: Modelo OpenRouter Sem Censura Gratuito

O modelo Venice Uncensored no nível gratuito do OpenRouter. Uma base Mistral-Small 24B, ajustada para saída sem censura pela Cognitive Computations em colaboração com a Venice.ai. Janela de contexto de 32K, USD0 por milhão de tokens. O nível gratuito do OpenRouter aplica um limite de plataforma de 200 solicitações por dia em modelos gratuitos.

- Parâmetros: 24B

- VRAM: Nenhuma necessária (hospedado na nuvem)

- Ideal para: Testar LLMs sem censura sem hardware local; gratuito dentro dos limites de taxa da plataforma

- Plataforma: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B: Modelo Sem Censura Grande via OpenRouter

Modelo de roleplay criativo e seguimento de instruções 70B da Sao10k, ajustado para saída sem censura. Baseado no Llama 3.3 70B com contexto de 131K. Mantido ativamente com uso real no OpenRouter e pesquisável por nome na busca global da plataforma.

- Parâmetros: 70B

- VRAM: Nenhuma necessária (hospedado na nuvem)

- Ideal para: Escrita criativa complexa, roleplay e longas cadeias de instruções sem hardware local

- Plataforma: OpenRouter

13. Sao10K: Llama 3 8B Lunaris: Modelo Sem Censura Leve via OpenRouter

O Lunaris 8B é um modelo generalista versátil e de roleplay da Sao10k, baseado no Llama 3 8B. É uma fusão estratégica de múltiplos modelos projetada para equilibrar criatividade com lógica aprimorada e conhecimento geral, oferecendo uma experiência superior ao Stheno v3.2 com criatividade e raciocínio aprimorados. A opção sem censura de menor custo no OpenRouter, a USD0.04/USD0.05 por milhão de tokens, com mais de 6 bilhões de tokens de uso real na plataforma.

- Parâmetros: 8B

- VRAM: Nenhuma necessária (hospedado na nuvem)

- Ideal para: Conversação leve sem censura e escrita criativa com custo mínimo

- Plataforma: OpenRouter

14. TheDrummer: Cydonia 24B V4.1: Modelo de Escrita Criativa Sem Censura via OpenRouter

Cydonia 24B V4.1 é um modelo de escrita criativa sem censura da TheDrummer, baseado no Mistral Small 3.2 24B, com bom recall, aderência ao prompt e inteligência. Janela de contexto de 131K. Mantido ativamente e pesquisável diretamente por nome na busca global do OpenRouter.

- Parâmetros: 24B

- VRAM: Nenhuma necessária (hospedado na nuvem)

- Ideal para: Escrita criativa e roleplay sem censura sem hardware local

- Plataforma: OpenRouter

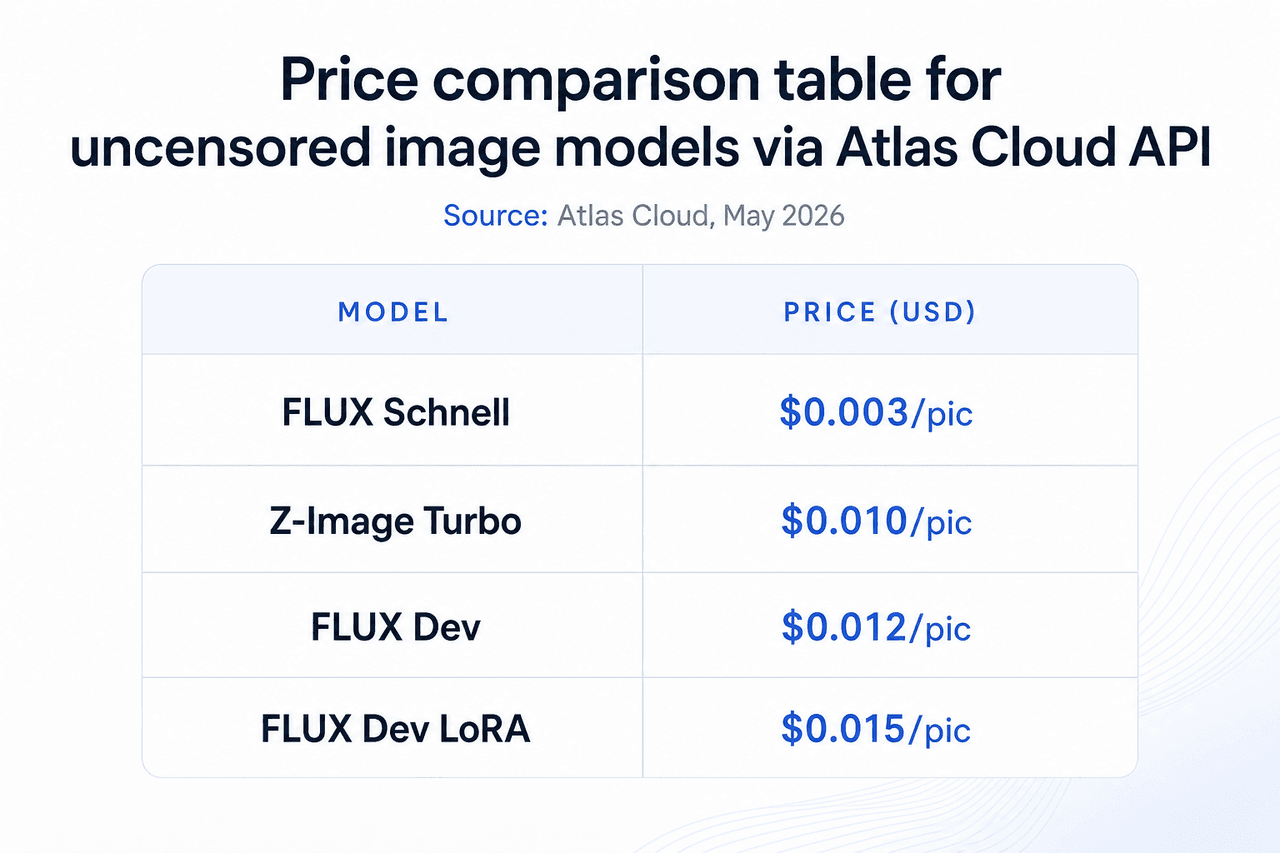

Como Acessar Modelos de Imagem e Vídeo Sem Censura via Atlas Cloud

Em 2026, a maioria dos modelos de imagem e vídeo sem censura requer hardware de GPU local ou uma plataforma de API dedicada, porque provedores de nuvem convencionais aplicam filtros de conteúdo que bloqueiam saídas NSFW no nível da inferência. Atlas Cloud é uma plataforma de API de modelos construída especificamente para remover essa restrição, cobrindo mais de 300 modelos curados em texto, imagem, vídeo e áudio.

Começar leva três passos:

- Crie uma conta em atlascloud.ai

- Gere uma chave de API no painel

- Chame o endpoint do modelo usando a chave — modelos de imagem e vídeo usam seu próprio formato REST; endpoints de LLM seguem o formato OpenAI Chat Completions

O que torna o Atlas Cloud relevante especificamente para casos de uso sem censura:

- A política de privacidade da plataforma afirma: "Seu conteúdo gerado nunca é usado para treinamento e nunca é revisado por ninguém." Este é um compromisso publicado e explícito, não uma suposição padrão.

- Nenhum limite diário de geração se aplica a qualquer modelo no catálogo.

- O catálogo de imagens sem censura cobre 33 modelos de texto para imagem a partir de USD0.003 por imagem.

- O catálogo de vídeos sem censura cobre mais de 10 modelos de vídeo NSFW a partir de USD0.01/seg.

O catálogo completo de modelos sem censura pode ser navegado em atlascloud.ai/models/explore/uncensored. Os modelos #15 a #20 nesta lista são todos acessíveis através de uma única chave de API do Atlas Cloud.

Quais São os Melhores Modelos de Imagem de IA Sem Censura para NSFW e Geração de Conteúdo Adulto?

Em 2026, a arquitetura FLUX impulsiona a maioria da geração de imagens sem censura de alta qualidade, disponível via API do Atlas Cloud em vários níveis de preço e qualidade (Atlas Cloud, lista de modelos de texto para imagem, 2026). O catálogo do Atlas Cloud cobre 33 modelos de texto para imagem no total. Os casos de uso incluem arte, design de personagens, modelos de lingerie sem censura e geração de retratos adultos, criação de ativos de jogos e ilustrações em lote em volume.

A página inicial do Atlas Cloud afirma "mais de 300 modelos curados em texto, imagem, vídeo e áudio", e a política de privacidade da plataforma para seu catálogo sem censura diz: "Seu conteúdo gerado nunca é usado para treinamento e nunca é revisado por ninguém."

Para uma análise completa de ferramentas de imagem sem censura baseadas em navegador e API, o guia de melhores geradores de imagens de IA sem censura cobre ambas as categorias com comparações de capacidade. Desenvolvedores focados especificamente na arquitetura FLUX podem ler o guia de gerador de imagens sem censura FLUX para detalhes de ajuste fino e fluxo de trabalho.

15. FLUX Schnell: Modelo de Imagem de IA Sem Censura Mais Rápido para Geração em Lote

A opção de menor custo no catálogo de imagens do Atlas Cloud. A USD0.003 por imagem, é a ferramenta certa para fluxos de trabalho de geração em lote onde a velocidade e o volume importam mais do que os detalhes finos. Nenhum limite diário se aplica, e nenhum conteúdo é armazenado para treinamento.

- Preço: USD0.003/imagem

- VRAM: Nenhuma necessária (acesso via API)

- Ideal para: Geração de imagens em lote, prototipagem rápida e saída sem censura de alto volume

- Plataforma: Atlas Cloud API

A USD0.003 por imagem, um orçamento de USD3.00 produz 1.000 imagens. Esse custo por saída é menor do que as taxas de armazenamento em nuvem para os arquivos resultantes na maioria dos provedores. Isso muda a economia para estúdios que antes rodavam plataformas de GPU locais caras durante a noite para geração em lote: a abordagem via API agora é mais barata e mais rápida para trabalho de volume.

16. FLUX Dev: Modelo de Imagem de IA Sem Censura de Maior Qualidade para Produção Final

Quatro vezes o custo do FLUX Schnell, com detalhes de anatomia, iluminação e textura visivelmente melhores. Para resultados de qualidade final onde imagens individuais importam, o preço de USD0.012 é um salto prático. Ele se adequa a peças de portfólio, conteúdo adulto comercial e ativos de produção onde a qualidade é a restrição primária.

- Preço: USD0.012/imagem

- VRAM: Nenhuma necessária (acesso via API)

- Ideal para: Imagens únicas de alta qualidade, peças de portfólio e ativos de produção final

- Plataforma: Atlas Cloud API

17. FLUX Dev LoRA: Modelo de Imagem Sem Censura com Treinamento de Estilo Personalizado

O ajuste fino LoRA injeta um estilo personalizado, aparência de personagem ou assunto na base FLUX Dev. Este é o modelo a usar quando você precisa de aparência de personagem consistente em um lote ou deseja que um estilo específico seja aplicado a cada imagem em um conjunto. O Atlas Cloud lida com o carregamento do LoRA no lado do servidor.

- Preço: USD0.015/imagem

- VRAM: Nenhuma necessária (acesso via API)

- Ideal para: Consistência de personagem, treinamento de estilo personalizado e séries de imagens de marca

- Plataforma: Atlas Cloud API

18. Z-Image Turbo: Modelo de Imagem de IA Sem Censura Econômico com Qualidade de Nível Médio

Posicionado entre o FLUX Schnell e o FLUX Dev na curva preço-qualidade. A USD0.01 por imagem, o Z-Image Turbo oferece uma arquitetura diferente otimizada para velocidade sem a simplificação de imagem que o Schnell faz em seu nível de preço mais baixo. A escolha prática quando a qualidade do Schnell não é suficiente e o custo do FLUX Dev é muito alto para o volume necessário.

- Preço: USD0.01/imagem

- VRAM: Nenhuma necessária (acesso via API)

- Ideal para: Geração de volume moderado onde qualidade e custo precisam se equilibrar

- Plataforma: Atlas Cloud API

Quais São os Melhores Modelos de Vídeo de IA Sem Censura para Animação NSFW em 2026?

Em 2026, a geração de vídeo sem censura requer um pipeline separado da geração de imagens porque as plataformas de vídeo convencionais aplicam filtros de conteúdo idênticos e recusam animar conteúdo NSFW mesmo quando a imagem de origem foi gerada em outro lugar (Atlas Cloud, catálogo de modelos sem censura, 2026). A página de vídeos sem censura do Atlas Cloud traz o título "Liberdade Criativa Irrestrita. Sem Filtros. Sem Limites." e cobre mais de 10 modelos de vídeo NSFW, com o catálogo completo também incluindo variantes das séries Wan 2.6, Wan 2.5 e Van.

19. Wan 2.2 Turbo Spicy Infinite I2V: Modelo de Vídeo Sem Censura de Menor Custo

A opção de nível de entrada para animação NSFW a partir de uma imagem estática. A USD0.01/seg, é a maneira mais econômica de animar uma imagem estática em conteúdo de vídeo NSFW. A resolução chega a 1080p com duração de clipe variável, tornando-o o ponto de partida certo para pipelines de produção preocupados com o orçamento.

- Preço: USD0.01/seg

- Resolução: 1080p

- Duração: Variável

- Ideal para: Animação NSFW econômica e visualização de conceitos de movimento

- Plataforma: Atlas Cloud API

20. Seedance v1.5 Spicy: Modelo de Vídeo Sem Censura de Maior Qualidade para Saída Final

A opção de qualidade cinematográfica no catálogo. A USD0.049/seg, custa cerca de 2,5 vezes mais que o Wan 2.2 Turbo Spicy Infinite, mas produz movimento mais suave, melhor coerência do assunto entre os quadros e transições mais naturais. Para resultados de vídeo NSFW de qualidade final onde a fidelidade visual é a preocupação primária, esta é a opção de topo na linha de vídeos sem censura do Atlas Cloud.

- Preço: USD0.049/seg

- Resolução: 720p

- Duração: 5s

- Ideal para: Vídeo NSFW de qualidade final, conteúdo adulto profissional e resultados prontos para entrega

- Plataforma: Atlas Cloud API

O guia de melhores geradores de vídeo de IA sem censura cobre o catálogo completo de variantes das séries Wan 2.7 e Wan 2.2 Spicy com todas as opções de duração e resolução.

Guia de Seleção Rápida de Modelos de IA Sem Censura

| Necessidade | Recomendado |

|---|---|

| Melhor LLM sem censura geral | llama2-uncensored ou dolphin-llama3 |

| Tarefas de programação | dolphin-mixtral 8x7B ou dolphincoder |

| Roleplay e escrita criativa | hermes3 |

| Abaixo de 4GB VRAM | dolphin-phi 2.7B |

| Geração de imagem sem censura | FLUX Schnell via Atlas Cloud (USD0.003/imagem) |

| Vídeo NSFW a partir de imagem | Wan 2.2 Turbo Spicy Infinite via Atlas Cloud (USD0.01/seg) |

FAQ de Modelos de IA Sem Censura

Qual é o modelo de IA mais sem censura em 2026?

Por contagem de downloads no Ollama, o llama2-uncensored lidera com 2,6 milhões de pulls, tornando-o a opção mais validada pela comunidade entre os modelos de IA sem censura de 2026 (Ollama, busca de modelos sem censura, 2026). Em capacidade bruta, o dolphin-llama3 oferece mais: chamada de função, até 256K de contexto e uma arquitetura base Llama 3. A resposta depende se estabilidade comprovada ou capacidade moderna importa mais para o seu caso de uso.

Quais modelos sem censura rodam no Ollama?

Dez modelos desta lista rodam como modelos sem censura no Ollama: llama2-uncensored, dolphin-llama3, dolphin-mixtral, dolphin-mistral, dolphin-phi, hermes3, wizard-vicuna-uncensored, dolphincoder, wizardlm-uncensored e everythinglm. O modelo da comunidade jaahas/qwen3.5-uncensored também roda no Ollama para uso multilíngue. Todos são instalados com

1ollama pull [nome-do-modelo]Quais modelos sem censura estão disponíveis no OpenRouter?

Em 2026, o OpenRouter hospeda LLMs sem censura via API, eliminando totalmente o requisito de GPU. As opções incluem o modelo venice/uncensored de nível gratuito a USD0 por milhão de tokens (200 solicitações por dia), além de modelos pagos, incluindo Sao10K Euryale 70B, Lunaris 8B e TheDrummer Cydonia 24B (OpenRouter, página do modelo venice/uncensored, 2026). Esses modelos sem censura do OpenRouter não requerem GPU local nem investimento em hardware para começar.

Qual é a diferença entre um modelo sem censura obliterado e um ajustado?

A obliteração remove pesos de recusa de um modelo cirurgicamente no nível do peso. Modelos sem censura ajustados (fine-tuned) como a série Dolphin são treinados em conjuntos de dados que não reforçam o comportamento de recusa em primeiro lugar. A comunidade considera consistentemente os modelos ajustados mais estáveis: a obliteração pode introduzir resultados inconsistentes em diversos tipos de prompts, enquanto o ajuste fino produz resultados confiáveis, o que explica por que os modelos Dolphin dominam as contagens de download sem censura do Ollama.

Posso rodar modelos de IA sem censura localmente em um laptop?

Sim. O dolphin-phi 2.7B roda com menos de 4GB de VRAM, tornando-o o ponto de entrada para implementação em laptop com GPU dedicada. Com 6-8GB de VRAM, você pode rodar qualquer modelo 7B desta lista. Placas de vídeo integradas não funcionarão. O guia de configuração local para modelos de IA sem censura cobre configurações mínimas de hardware e configurações de quantização em detalhes.

Conclusão

O melhor modelo de IA sem censura em 2026 depende inteiramente do seu caso de uso. Para trabalho geral com LLM, o dolphin-llama3 é a opção mais capaz no Ollama. Para laptops, o dolphin-phi cobre o requisito de VRAM abaixo de 4GB. Para acesso a LLM em nuvem sem hardware, o venice/uncensored no nível gratuito do OpenRouter é o ponto de partida prático a USD0 por milhão de tokens. Para geração de imagens sem censura em escala, o FLUX Schnell via Atlas Cloud API produz resultados a USD0.003 por imagem, sem limite diário. Para vídeos NSFW, o catálogo do Atlas Cloud começa em USD0.01/seg com uma política verificada de não treinamento e não revisão.

Leitores que procuram uma visão geral completa das ferramentas de IA sem censura em imagens, vídeo e editores encontrarão no guia de gerador de imagens de IA sem censura toda a paisagem.