Não faz muito tempo, criar um vídeo de qualidade para redes sociais exigia uma equipe inteira: roteiro, filmagem, edição, design de som. Até 2026, todo esse processo foi comprimido em um prompt de texto e uma chamada de API. A infraestrutura que transforma uma descrição de produto, uma linha de roteiro ou um briefing de conteúdo diretamente em um clipe de vídeo publicável já existe.

Este artigo explica como é essa infraestrutura, como construir sobre ela e o que é necessário para fazê-la funcionar de forma confiável em escala.

Por que a automação de vídeos para redes sociais é importante agora

Vídeos curtos deixaram de ser apenas entretenimento. TikTok, Instagram Reels e YouTube Shorts tornaram-se motores fundamentais de distribuição para cultura, marketing e e-commerce. Mas existe uma restrição simples: a produção de conteúdo não escala na mesma velocidade da demanda.

Mesmo para criadores experientes, produzir um vídeo de alta qualidade exige um tempo considerável – roteirização, storyboard, filmagem ou busca de imagens, edição, correção de cor, mixagem de som e legendas. O gargalo raramente são as ideias. É a velocidade de execução. Quando uma tendência dura apenas algumas horas, quem publica primeiro ganha. A geração de vídeo por IA muda o jogo ao transformar a produção em lote de um projeto de capital em um custo operacional de rotina.

Por que as APIs são mais importantes do que as interfaces de usuário

Muitas ferramentas de vídeo por IA oferecem interfaces web bonitas: digite um prompt, clique em um botão, veja o resultado. Isso é conveniente para criadores individuais. Mas, se você está construindo um sistema de conteúdo automatizado, uma interface (UI) não o ajudará. O que permite uma escala real é a API.

As APIs trazem programabilidade. Você pode enviar trabalhos em lote. Pode ajustar automaticamente as proporções de tela para diferentes plataformas. Você pode incorporar a geração de vídeo em sua plataforma SaaS como um recurso nativo. Você pode executar testes A/B programáticos — gerar dez variações estilísticas da mesma descrição de produto, publicá-las para diferentes segmentos de público e, em seguida, usar os dados de engajamento para refinar o próximo lote de prompts.

Considere uma plataforma de e-commerce que lista duzentos novos produtos todos os dias. Fazer um vídeo de demonstração para cada um manualmente exigiria dezenas de profissionais de vídeo. Com uma API, você escreve um script que lê o banco de dados do produto, monta automaticamente um template de prompt, chama a API e envia os resultados para uma ferramenta de agendamento de redes sociais. Nenhum humano abre um software de edição. UIs são para pessoas. APIs são para sistemas. O verdadeiro avanço vem deste último.

A vida de uma chamada de API

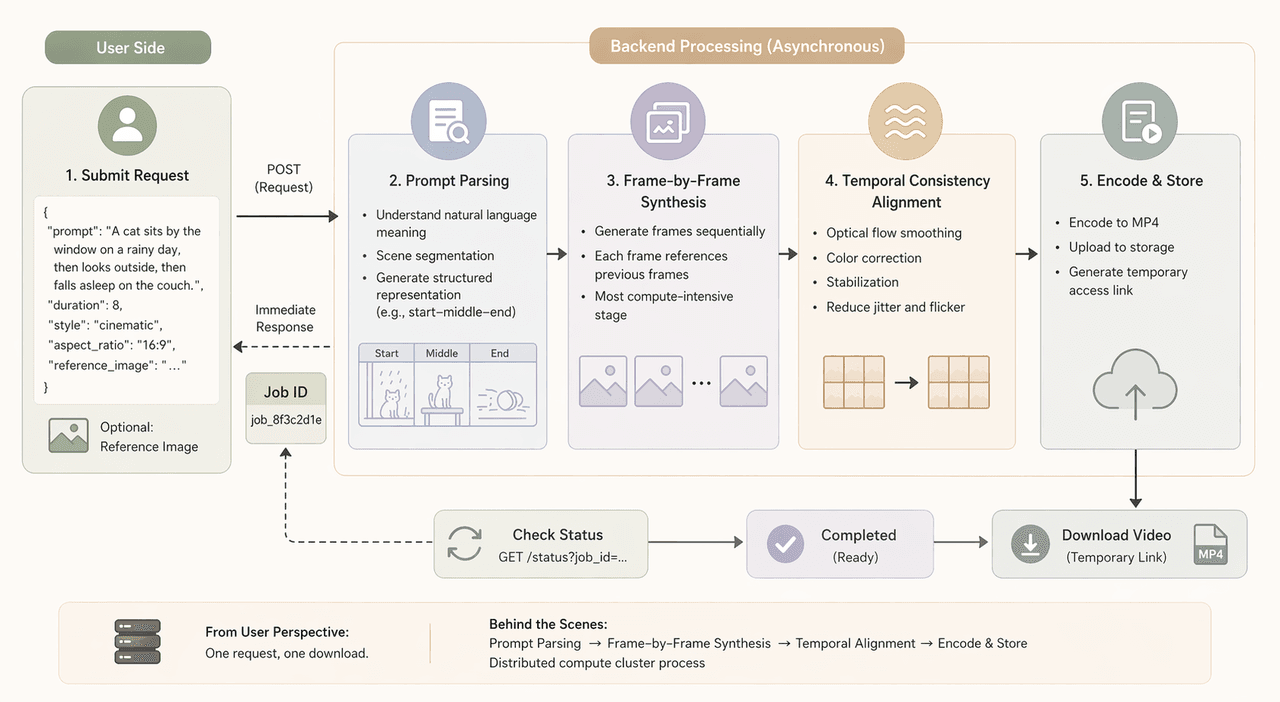

Vamos rastrear uma chamada de API real, desde o envio até o download.

Primeiro, você empacota seu prompt e parâmetros em JSON. A solicitação normalmente inclui prompt, duração (digamos, oito segundos), uma predefinição de estilo, proporção de tela (

1aspect_ratioApós o envio, o backend começa a trabalhar.

O primeiro passo é a análise do prompt (parsing) – transformando sua linguagem natural em uma representação estruturada. Isso inclui segmentação de cena: se sua descrição implica três ações sequenciais, o modelo define o início, o meio e o fim.

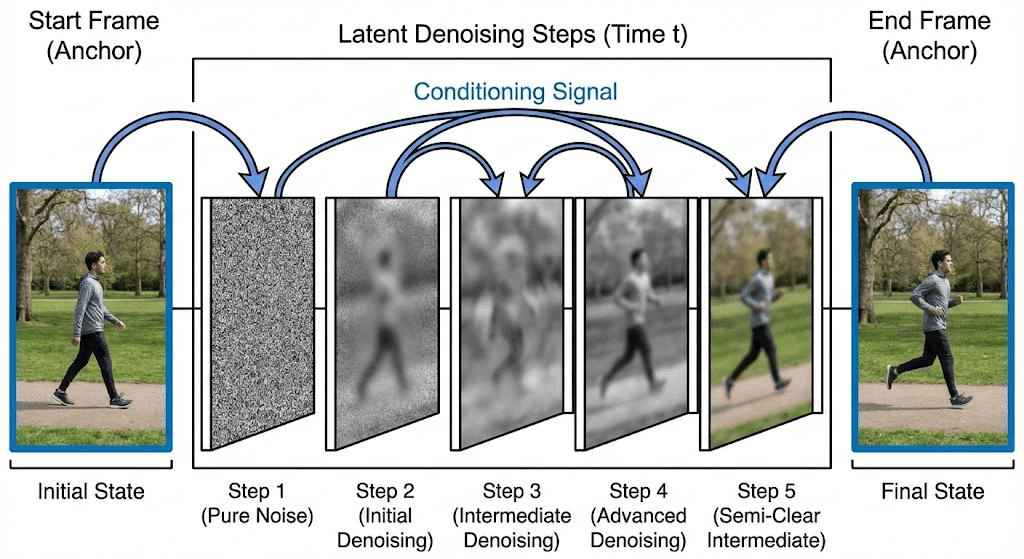

O segundo passo é a síntese quadro a quadro. O modelo gera quadros sequencialmente, cada um referenciando os anteriores para manter a coerência. Este é o estágio que mais consome processamento.

O terceiro passo é o alinhamento da consistência temporal. Mesmo com os melhores esforços do modelo, os quadros brutos podem apresentar pequenos tremores. Um estágio de pós-processamento aplica suavização de fluxo óptico, correção de cor e estabilização.

Finalmente, o sistema codifica o vídeo em MP4, faz o upload para o armazenamento e gera um link de acesso temporário. Do ponto de vista do usuário, é apenas uma solicitação e um download. Nos bastidores, um cluster de computação distribuída realizou muito trabalho.

Como diferentes perfis utilizam isso

Criadores independentes usam a API para multiplicar sua produção. Você pode pegar uma ideia central e gerar uma dúzia de variações – mudar o tom da cor, trocar o estilo da narração, ajustar o movimento da câmera. Em vez de três vídeos por semana, você pode fazer dez por dia. O gargalo muda da velocidade de produção para o seu julgamento sobre o que manter.

Demonstração rápida: Uma ideia, muitas variações

plaintext1import requests 2 3API_KEY = "YOUR_API_KEY" 4url = "https://api.atlascloud.ai/api/v1" 5 6styles = ["cinematic", "anime", "documentary", "vlog"] 7 8for style in styles: 9 payload = { 10 "prompt": "A cat sitting by the window, wind blowing curtain", 11 "duration": 6, 12 "style": style, 13 "aspect_ratio": "1:1" 14 } 15 16 res = requests.post(url, json=payload, headers={ 17 "Authorization": f"Bearer {API_KEY}" 18 }).json() 19 20 print(f"{style} → job_id:", res["job_id"])

Equipes de marketing usam abordagens mais sistemáticas. Um caso de uso comum é a localização multirregional. Uma marca global lançando um produto em vinte países pode gerar um vídeo mestre e, em seguida, executar um script que substitui automaticamente o texto na tela, a narração e os detalhes visuais para cada idioma. Um mês de trabalho vira poucos dias.

O e-commerce é outra área em rápido crescimento. Uma imagem estática de produto mais uma breve descrição torna-se uma demonstração dinâmica. Para um smartwatch, você insere uma descrição de close-up com iluminação e movimento de câmera, e o sistema gera um loop de seis segundos. Em uma página de produto, clipes assim superam imagens estáticas. E você pode processar todo o catálogo em lote.

Desenvolvedores e plataformas SaaS empacotam a geração de vídeo como serviço. Uma ferramenta de agendamento para redes sociais pode integrar uma API para que os usuários insiram um tweet e a ferramenta o transforme automaticamente em um roteiro de vídeo curto, gere o vídeo e o agende. Essas plataformas estão transformando a geração de vídeo em uma capacidade fundamental.

Tornando a saída da IA pronta para produção

Uma verdade dura: a saída bruta da API raramente está pronta para publicação. Sistemas de produção bem-sucedidos envolvem a API com várias camadas.

Primeiro, engenharia de prompt. Equipes maduras mantêm bibliotecas de templates de prompt para diferentes categorias, estilos e plataformas. Um prompt para Instagram Reels enfatiza alta saturação e cortes rápidos. Um prompt para YouTube Shorts foca no fluxo narrativo. Os templates possuem variáveis que os scripts preenchem dinamicamente.

Segundo, gestão de qualidade de geração. O mesmo prompt executado cinco vezes pode produzir três clipes utilizáveis e dois com falhas – um dedo deformado, um objeto de fundo ilógico. Você escreve verificações automatizadas que detectam modos de falha comuns e sinalizam clipes para regeneração.

Terceiro, pipelines de pós-processamento. Após a geração, você pode precisar adicionar um logotipo, introdução/encerramento ou legendas embutidas. Faça isso com scripts, não reimportando em um software de edição.

Quarto, cache e reutilização. Se sua biblioteca usa repetidamente o mesmo produto ou personagem, armazene os resultados em cache. Isso reduz custos e mantém a consistência visual.

Todas essas camadas juntas formam um verdadeiro motor de conteúdo. A API é apenas um componente. O valor está em como você monta o sistema.

O que ainda não funciona

A geração de vídeo por IA está longe de ser perfeita. Se você tentar gerar algo com mais de quinze segundos, provavelmente terá problemas – objetos se deformam, a lógica da cena falha, personagens tornam-se inconsistentes. A janela narrativa efetiva dos modelos atuais é curta.

O custo computacional é outra restrição. Gerar um segundo de vídeo de alta qualidade exige muito mais tempo de GPU do que gerar uma imagem. Os preços estão caindo, mas para equipes que precisam de centenas de vídeos por dia, a matemática ainda importa. Uma abordagem pragmática reserva a geração de alto custo para conteúdo crítico e usa opções mais baratas para testes.

A imprevisibilidade do prompt é um incômodo persistente. O mesmo prompt pode dar resultados diferentes hoje em comparação com ontem. Os resultados entre provedores variam muito. Sistemas automatizados precisam de robustez extra – presuma que nem toda geração atenderá às expectativas e crie retentativas (retries).

A coerência narrativa de múltiplas cenas ainda é muito fraca. Você pode gerar "uma pessoa bebendo café em um café" e também "a mesma pessoa saindo para a rua", mas o modelo não entenderá automaticamente a transição. Para obter um vídeo com várias cenas, atualmente você precisa descrever cada corte em detalhes.

Para onde as coisas estão indo

Apesar dessas limitações, a direção é clara. A geração de vídeo não permanecerá como uma ferramenta isolada. Nos próximos anos, espere pipelines de conteúdo totalmente automatizados: um sistema verifica as tendências a cada manhã, gera conceitos de vídeo automaticamente, realiza pequenos testes, escolhe os melhores desempenhos e os amplifica. Nenhum humano toma decisões criativas – apenas a revisão final de segurança da marca.

Espere também sistemas criativos baseados em agentes. Você dá a um agente de IA um objetivo – "aumentar o reconhecimento de novos produtos esta semana" – e ele propõe direções de roteiro, gera candidatos, publica para públicos de teste, analisa o feedback, ajusta a estratégia e gera o próximo lote.

Fluxos de vídeo personalizados em tempo real aparecerão. Um aplicativo de fitness poderia produzir um resumo semanal personalizado com os dados do próprio usuário, visuais de progresso e narração encorajadora.

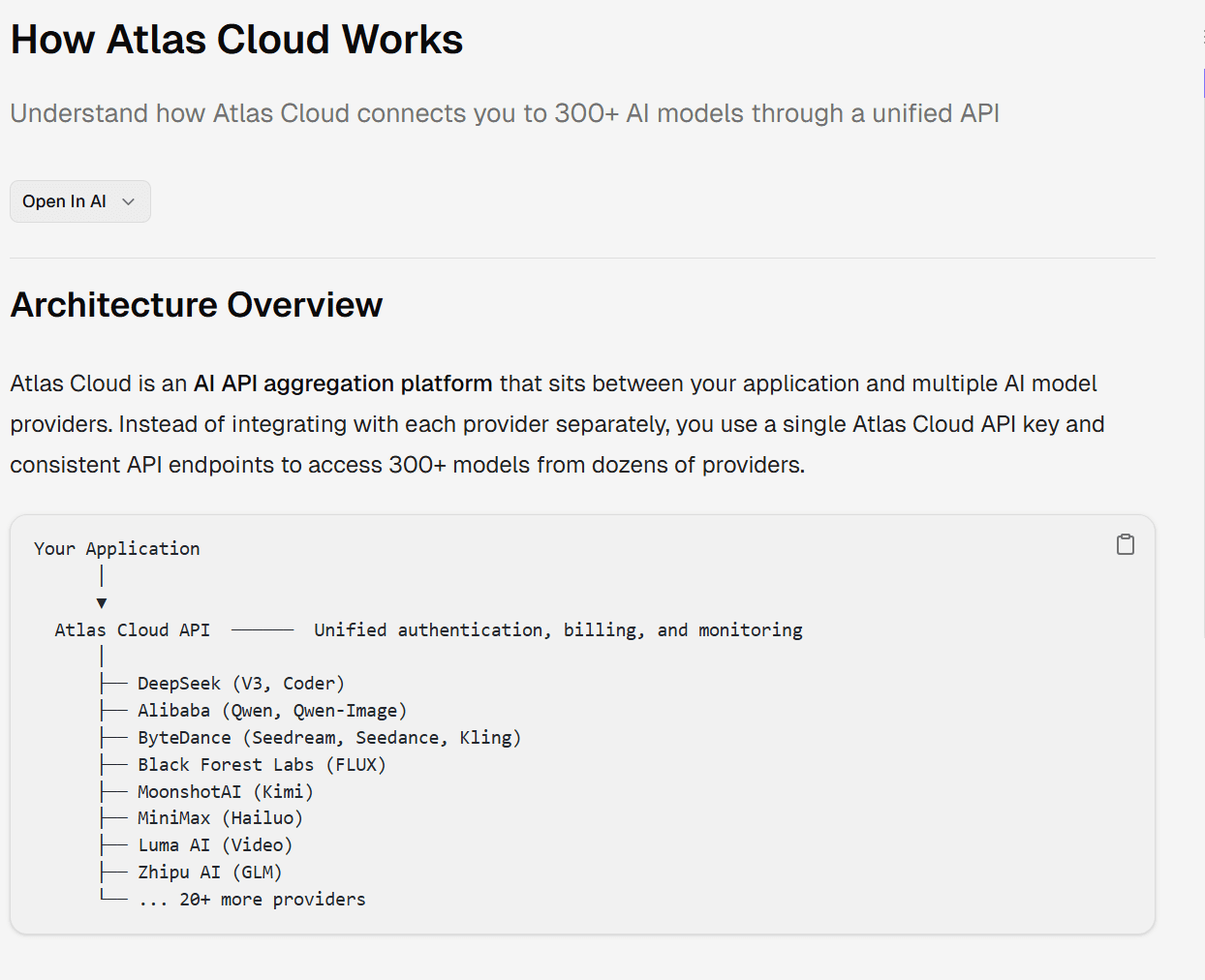

Finalmente, espere uma integração profunda com pilhas de automação de marketing. Plataformas como AtlasCloud suportam a agregação de vários modelos para geração de imagem e vídeo, facilitando para os usuários integrá-los em seus próprios projetos criativos ou comerciais.

Reflexão final

A transição da edição manual para a geração baseada em API não é apenas uma atualização de ferramenta. É uma mudança estrutural em como o conteúdo é feito e consumido. As APIs de geração de vídeo estão se tornando a camada de infraestrutura do storytelling digital moderno. Para os criadores, isso significa escala. Para os desenvolvedores, oportunidade. Para as plataformas, automação. E para a internet, uma transição da produção estática em lote para sistemas de mídia generativa contínuos. Essa transição já está acontecendo. Qualquer pessoa com uma chave de API e uma ideia pode começar a construir seu próprio pipeline de vídeo – sem necessidade de um orçamento milionário.