DeepSeek v4: Alles, was wir bisher wissen – Funktionen, Veröffentlichungsdatum und Zugriff über Atlas Cloud

Einleitung: Was ist DeepSeek v4?

AtlasCloud erweitert sein Portfolio an generativer KI um die kommende Ergänzung DeepSeek v4.

- Was es ist: Das neueste Flaggschiff des DeepSeek-Teams. Wenn DeepSeek v3.2 den Standard für kosteneffiziente Open-Source-Codierungsmodelle setzt, verschiebt v4 die Grenzen von Logik und Gedächtnis durch proprietäre Manifold-Constrained Hyper-Connections (mHC)- und Engram Memory-Technologien.

- Hauptvorteil: v4 generiert nicht nur Code-Snippets, sondern agiert wie ein leitender Architekt, der ganze Repository-Strukturen versteht, um dateiübergreifende Schlussfolgerungen zu ziehen und komplexe Fehler zu beheben.

- Status: Demnächst verfügbar (erwartet Mitte Februar 2026).

Warum sind wir sicher, dass DeepSeek v4 das nächste große Ding ist? Weil es das größte Problem der Branche löst: KI muss die Logik eines Projekts speichern und verstehen.

📣 Update — 24. April 2026: DeepSeek-V4 wurde offiziell veröffentlicht. Lesen Sie unseren vollständigen Bericht über das tatsächliche Release, einschließlich der neuen Sparse-Attention-Architektur, 1 Mio. Token-Kontext und Agent-Benchmark-Ergebnissen – im DeepSeek-V4 Preview Launch.

Technischer Deep Dive: Hauptfunktionen

Um Claude Opus 4.5 herauszufordern, hat DeepSeek das Modell von Grund auf neu aufgebaut. Durchgesickerte Unterlagen deuten auf eine grundlegende Änderung im Umgang des Modells mit Gedächtnis und logischer Stabilität hin. Werfen wir einen Blick auf die vier Säulen dieses Updates.

Architektur: Überlegene logische Schlussfolgerung

-

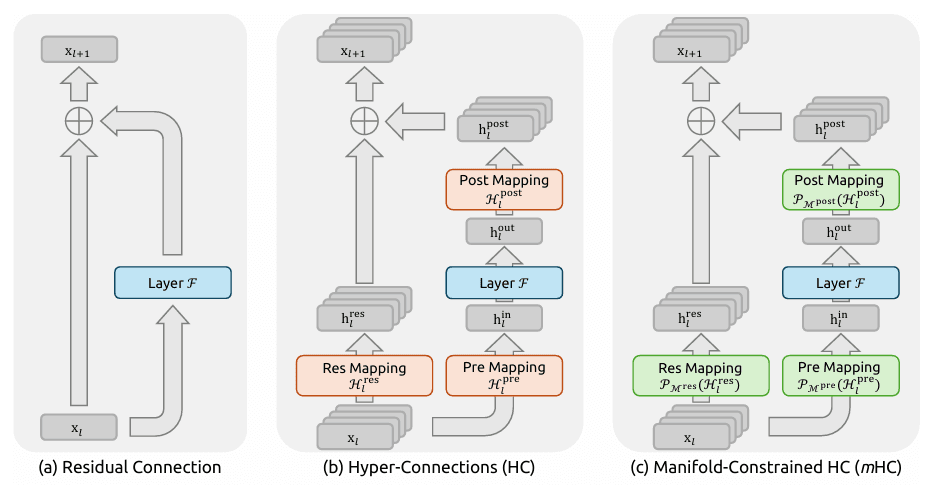

Manifold-Constrained Hyper-Connections (mHC)

- Das Konzept: DeepSeek v4 erfindet eine neue Methode der "neuronalen Verdrahtung". Herkömmliche Verbindungen verlieren in tiefen Netzwerken oft Informationen, aber mHC fungiert wie eine "logische Superautobahn" für das Gehirn der KI.

- Das Ergebnis: Bei der Verarbeitung massiver, komplexer Logik (wie dem Refactoring tausender Zeilen Code) lernt das Modell schneller und behält Logik besser bei. Dies eliminiert "logische Halluzinationen" und Inkonsistenzen, die bei der Generierung langer Kontexte üblich sind.

Effizienz: Niedrigere Inferenzkosten

-

Mixture-of-Experts (MoE) 2.0

- Das Konzept: Obwohl v4 ein Parameter-Gigant ist (hunderte Milliarden), nutzt es eine optimierte MoE-Architektur, um für jedes Token nur die relevantesten "Experten" zu aktivieren.

- Das Ergebnis: Es bietet die perfekte Balance zwischen hoher Leistungsfähigkeit (massive Wissensbasis) und effizienter Skalierung (so leicht wie ein kleineres Modell).

-

Sparse Attention

- Das Konzept: Statt Texte mit roher Gewalt zu durchsuchen, konzentriert sich das Modell nun intelligent nur noch auf die wichtigsten Informationen. Dies senkt die Rechenkosten drastisch und beschleunigt die Verarbeitung langer Kontexte.

Gedächtnis: Intelligentes Kontext-Management

-

Engram Memory (Selektive Speicherung & Abruf)

- Das Konzept: Die KI hört auf, auswendig zu lernen und fängt an zu "verstehen". Sie erkennt Projektstrukturen, folgt Namenskonventionen (snake_case vs. camelCase) und identifiziert Codierungsmuster (und ahmt die spezifischen Factory-Muster Ihres Teams nach).

- Das Ergebnis: Es codiert wie ein erfahrener Mitarbeiter.

-

Multi-Head Latent Attention (MLA)

- Das Konzept: Betrachten Sie dies als "Super-Kurzschrift". Wo andere Modelle 100 Token benötigen, um Informationen zu speichern, komprimiert MLA sie in 10 Schlüsselsymbole.

- Das Ergebnis: Wenn ein Abruf erforderlich ist, rekonstruiert das Modell mathematisch die ursprüngliche Bedeutung ohne Verlust. Dies bewahrt eine unglaubliche Detailgenauigkeit bei deutlich geringerer VRAM-Auslastung.

Anwendung: Engineering in der Praxis

- Repo-Level-Verständnis & Fehlerbehebung

- Das Ziel ist nicht nur das Schreiben einer Funktion, sondern die Kontrolle über die Codebasis. In SWE-bench-Tests strebt DeepSeek v4 an, über 80,9 % komplexer, realer Probleme durch das Verständnis dateiübergreifender Abhängigkeiten zu lösen.

Anwendungsfälle: Kosten senken & Effizienz steigern

DeepSeek v4 ist für Hardcore-Engineering gebaut. So schlägt es sich im Vergleich zum Wettbewerb:

Refactoring von Legacy-Code

Für undokumentierte, chaotische Legacy-Systeme ist die mHC-Architektur ein Lebensretter. Sie verfolgt logische Abhängigkeiten über lange Distanzen für ein sicheres Refactoring.

- VS GPT-4o: GPT-4o leidet oft unter "logischen Halluzinationen" (erfindet nicht existierende Funktionsaufrufe), wenn der Kontext 10k Token überschreitet. DeepSeek v4 behält die logische Konsistenz über lange Kontexte hinweg bei 100 % bei.

- VS Claude 3.5 Sonnet: Während Sonnet eine hohe Qualität liefert, ist es langsam und teuer für massive Refactoring-Aufgaben. Die MoE-Architektur von DeepSeek v4 bietet ca. 40 % schnellere Inferenzgeschwindigkeiten zu niedrigeren Kosten auf Atlas Cloud.

Feature-Entwicklung auf Repository-Ebene

Beim Hinzufügen einer neuen API zu einem ausgereiften Projekt nutzt v4 "Engram Memory", um den Kontext sofort zu erfassen.

- VS Traditionelle Autocomplete: Standard-Tools ignorieren oft projektspezifische Normen und führen Stilinkonsistenzen ein. DeepSeek v4 ahmt Ihre vorhandene Codebasis so gut nach, dass es sich anfühlt wie ein Copy-Paste von Ihrem besten Entwickler.

Full-Link Bug Tracking

Das Ziel einer Erfolgsquote von 80,9 % bei SWE-bench bedeutet, Bugs zu bewältigen, die Frontend, Backend und Datenbanken umspannen.

- VS Claude Opus 4.5 (Erwartet): Opus 4.5 wird wahrscheinlich leistungsstark, aber teuer sein. DeepSeek v4 bietet eine Leistung nahe am SOTA zu einem Preis, der iterative "Reflexions- und Korrekturschleifen" ohne Budgetüberschreitung ermöglicht.

📉 Das Fazit: ROI für Teams

Für Startups und Entwickler-Teams liefert die Kombination aus DeepSeek v4 und AtlasCloud einen greifbaren ROI:

- Produktivität: Reduzieren Sie die Codierungszeit für erfahrene Entwickler um 30–50 %.

- Kosten: Im Vergleich zum Mieten von Dual-RTX-4090-Servern oder der Zahlung für Closed-Source-APIs kann die integrierte API von AtlasCloud Teams über 60 % der gesamten Rechenkosten einsparen.

Die Hardware-Grenze: Lokal hosten? Überlegen Sie es sich gut.

Vielleicht sind Sie versucht, diesen "Coding-Gott" auf Ihrer lokalen Maschine auszuführen. Aber wir müssen Ihnen die Realität vor Augen führen: Leistung hat ihren Preis.

- Mindestanforderung: Dual RTX 4090s

- Übersetzung: Sie kaufen zwei der teuersten Consumer-GPUs auf dem Markt und koppeln sie. Die Kosten für die GPUs allein entsprechen in etwa 3x iPhone 17 Pro Max-Geräten (oder einem ordentlichen Gebrauchtwagen).

- Empfohlen: Einzelne RTX 5090 (2026-Flaggschiff)

- Übersetzung: Dies ist der "Ferrari" unter den GPUs. Der Preis wird durch Reseller in die Höhe getrieben und die Verfügbarkeit knapp sein.

Da die GPU-Preise hoch bleiben, fragen Sie sich: Ist es das wert, tausende Dollar auszugeben und sich mit Lüfterlärm, Hitze und Umgebungskonfiguration herumzuschlagen, nur um ein Modell auszuführen?

Die smarte Lösung: Tag 0-Zugriff mit Atlas Cloud

Sie müssen nicht reich sein, um DeepSeek v4 zu nutzen; Sie müssen nur schlau sein. Statt "elektronische Ziegelsteine" zu kaufen, die an Wert verlieren, wählen Sie die Cloud.

AtlasCloud ist bereit für den Start:

-

Unser Versprechen: Genießen Sie Ihren Feierabend. Überlassen Sie uns die Drecksarbeit der Bereitstellung. Wir überwachen die offiziellen Release-Kanäle rund um die Uhr.

-

Kernvorteile:

- Sofortiger Zugriff: Sobald die Open-Source-Gewichte veröffentlicht werden, geht unsere API-Integration live.

- Null Barrieren: Keine teure Hardware, kein CUDA-Abhängigkeits-Chaos. Bringen Sie einfach Ihren Prompt mit.

- Kompromisslose Erfahrung: Wir bieten vollständige Kontextunterstützung und stellen sicher, dass der "Engram"-Speichermechanismus bei 100 % Kapazität ohne Quantisierungsverlust arbeitet.

Nutzung auf Atlas Cloud

Atlas Cloud ermöglicht es Ihnen, Modelle nebeneinander zu nutzen – zuerst im Playground, dann über eine einzige API.

Methode 1: Direkte Nutzung im Atlas Cloud Playground

Methode 2: Zugriff via API

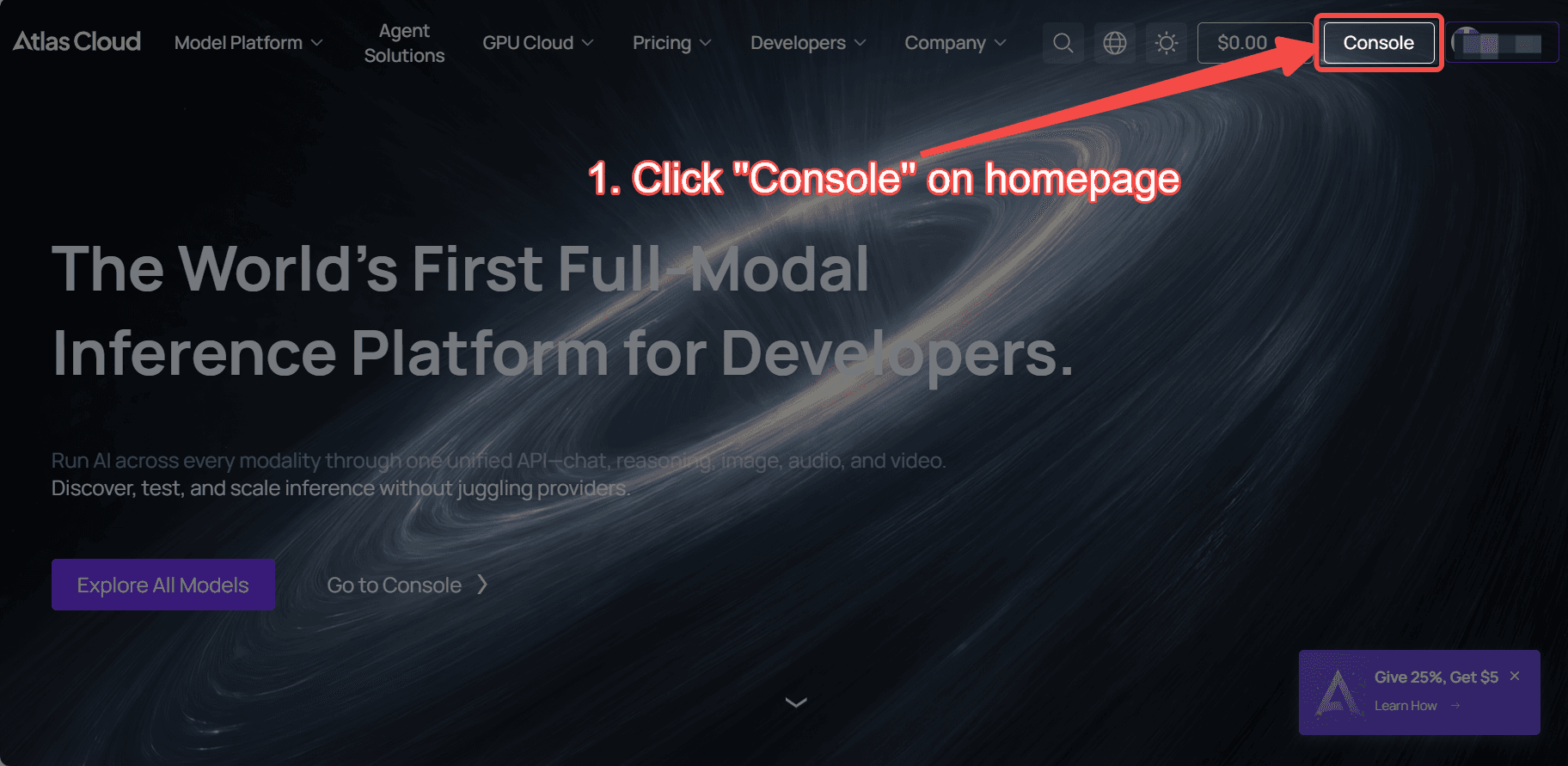

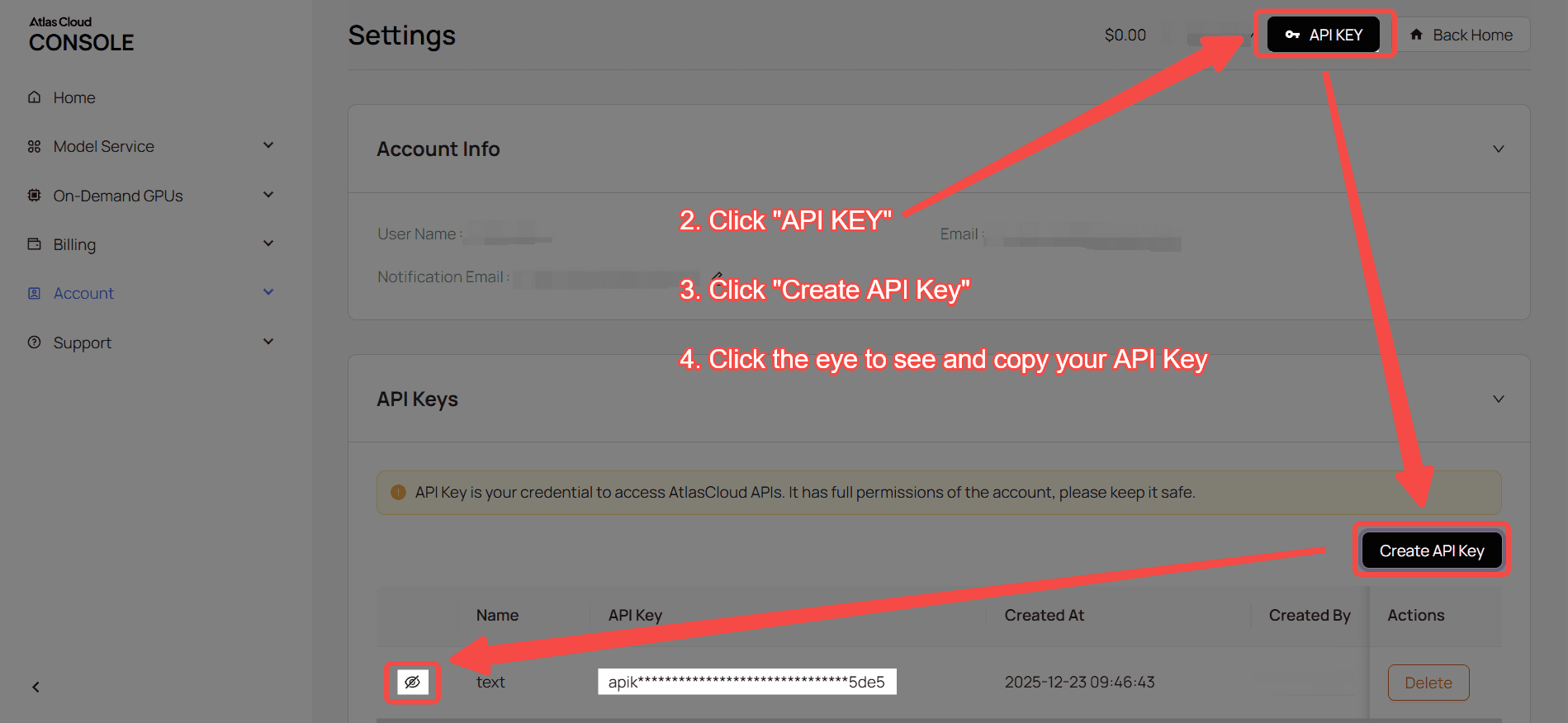

Schritt 1: API-Key abrufen

Erstellen Sie einen API-Key in Ihrer Konsole und kopieren Sie ihn für die spätere Verwendung.

Schritt 2: API-Dokumentation prüfen

Überprüfen Sie den Endpoint, die Anfrageparameter und die Authentifizierungsmethode in unserer API-Dokumentation.

Schritt 3: Erste Anfrage stellen (Python-Beispiel)

Beispiel: Generieren Sie einen Text mit DeepSeek v3.2:

python1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "deepseek-ai/deepseek-v3.2", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "what is difference between http and https" 14 } 15 ], 16 "max_tokens": 32768, 17 "temperature": 1, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())