Die meisten Menschen glauben immer noch, dass bessere Wörter zu besseren Bildern führen. Das war vor zwei Jahren wahr. Heute nicht mehr.

Im Jahr 2026 liegt der wahre Unterschied nicht zwischen den Modellen. Er liegt zwischen Benutzern, die beschreiben, und Benutzern, die konstruieren. Die eine Gruppe tippt „filmische Beleuchtung, 4k, ultra-detailliert". Die andere Gruppe baut Szenen auf – Lichtrichtung, Tiefenebenen, Kamerawinkel.

Wenn Ihre Bilder immer noch flach aussehen, liegt das Problem wahrscheinlich nicht am Modell. Es liegt daran, was Sie ihm nicht sagen.

Warum Ihre Prompts nicht ausreichen (Perspektive 2026)

Generische Prompts funktionieren nicht mehr. Modelle haben Ausdrücke wie „beste Qualität" und „hohe Details" millionenfach gesehen. Diese Wörter bewirken heutzutage kaum noch etwas.

Was zählt wirklich? Strukturierte Eingaben. Woher kommt das Licht? Was befindet sich im Vordergrund und was im Hintergrund? Welches Objektiv verwenden Sie? Moderne Modelle reagieren auf diese Variablen. Sie ignorieren das Füllmaterial.

Hier ist ein häufiges Muster. Jemand schreibt: „ein schönes Porträt mit weicher Beleuchtung." Das Modell liefert etwas Flaches. Warum? Keine Lichtrichtung. Keine Tiefentrennung. Kein Kamerawinkel. Das Modell muss raten. Und Raten führt zu durchschnittlichen Ergebnissen.

Die Veränderung, die Sie vornehmen müssen, ist einfach. Hören Sie auf, das Ergebnis zu beschreiben. Fangen Sie an, die Szene zu konstruieren.

Die 7 fortgeschrittenen Tipps

-

Sagen Sie dem Licht, wohin es gehen soll

„Weiche Beleuchtung" ist vage. Seitenlicht, Gegenlicht, Licht von oben – das gibt dem Modell etwas Konkretes. Richtung erzeugt Schatten. Schatten erzeugen Tiefe. Tiefe lässt ein Bild echt aussehen.

Versuchen Sie dies statt „weiche Porträtbeleuchtung":

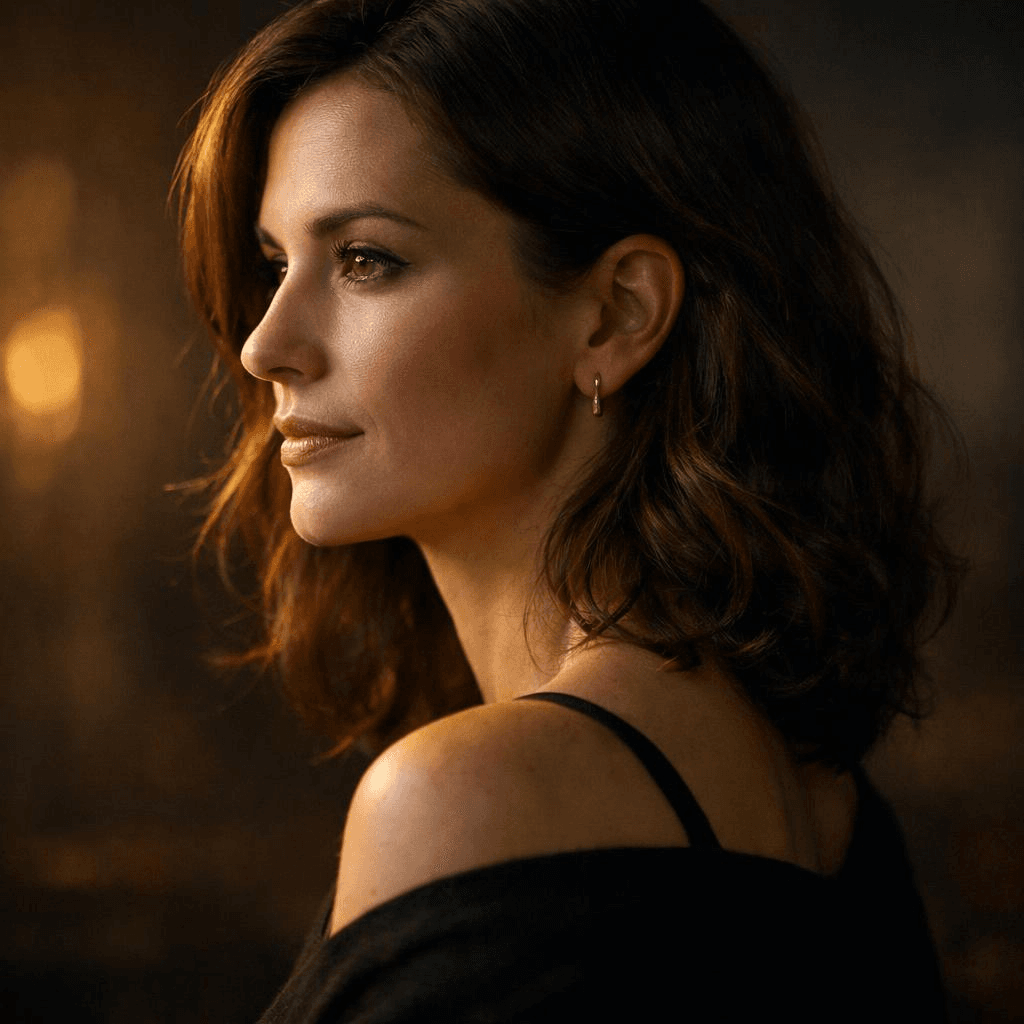

Ein Porträt einer Frau, Seitenlicht von links, weiche Schatten auf der rechten Seite des Gesichts, dezentes Umgebungslicht aus dem Hintergrund

Sie sehen den Unterschied sofort. Das Modell weiß genau, wo das Licht sitzt.

-

Verwenden Sie echte Fotografie-Setups

Drei-Punkt-Beleuchtung. Konturlicht (Rim Lighting). Rembrandt-Beleuchtung. Das sind nicht nur schicke Begriffe. Es sind Muster, die das Modell während des Trainings tausende Male gesehen hat. Verwenden Sie sie, und Ihre Ergebnisse werden stabiler.

Beispiel:

Produktaufnahme eines Sneakers, Drei-Punkt-Beleuchtungssetup, starkes Hauptlicht, weiches Aufhelllicht, dezentes Konturlicht, das das Produkt von einem dunklen Hintergrund trennt

Das funktioniert jedes Mal besser als „dramatische Beleuchtung".

-

Bauen Sie Tiefe Schicht für Schicht auf

Flache Bilder bedeuten meist, dass alles auf derselben Ebene liegt. Beheben Sie dies, indem Sie Vordergrund, Mittelgrund und Hintergrund explizit benennen.

Beispiel:

Eine Kaffeetasse auf einem Holztisch (Vordergrund), eine Person, die an einem Laptop arbeitet (Mittelgrund), ein weich gezeichnetes Café-Interieur mit warmen Lichtern (Hintergrund)

Jetzt hat das Modell räumliche Beziehungen, mit denen es arbeiten kann.

-

Verwenden Sie Kamerasprache, keine Stil-Labels

„Cyberpunk-Stil" ist schwammig. „35mm-Objektiv, niedriger Winkel, Weitwinkelaufnahme" ist präzise. Kameraeinstellungen bilden direkt ab, wie Bilder aufgebaut werden.

Behalten Sie diese im Hinterkopf:

- 35mm für einen natürlichen Alltags-Look

- 85mm für Porträts mit Kompression

- Weitwinkel für Drama und Maßstab

- Niedriger Winkel, Augenhöhe, von oben für die Perspektive

Beispiel:

Ein Nahaufnahme-Porträt, 85mm-Objektiv, geringe Schärfentiefe, Augenhöhe, weiche Hintergrundunschärfe

Das gibt dem Modell viel klarere Anweisungen als „ästhetisches Porträt".

-

Lenken Sie die Aufmerksamkeit durch Kontrast

Hohe Detaildichte überall ist nicht das Ziel. Kontrast ist es. Licht gegen Schatten. Warm gegen Kühl. Scharfes Motiv gegen unscharfen Hintergrund.

Drei Arten von Kontrast funktionieren gut:

- Lichtkontrast: helles Motiv vor dunklem Hintergrund

- Farbkontrast: warmes Spotlight auf einem kühl getönten Hintergrund

- Detailkontrast: scharfes Motiv, unscharfe Umgebung

Beispiel:

Ein Motiv, das von einem warmen Scheinwerfer vor einem dunklen, kühl getönten Hintergrund beleuchtet wird, kontrastreiche Beleuchtung, starker Fokus auf das Motiv

Der Blick des Betrachters geht genau dorthin, wo Sie ihn haben möchten.

-

Fügen Sie Einschränkungen hinzu, um Chaos zu beseitigen

Lange Prompts werden unübersichtlich. Anstatt mehr Details hinzuzufügen, setzen Sie Grenzen. Sagen Sie dem Modell, was Sie nicht wollen. Kein Durcheinander. Keine Verzerrung. Keine zusätzlichen Objekte.

Beispiel:

Minimalistische Produktaufnahme, zentrierte Komposition, sauberer weißer Hintergrund, kein Durcheinander, kein Text, keine Verzerrung

Einschränkungen bewirken oft mehr als zusätzliche Beschreibungen.

-

Iterieren Sie wie ein Regisseur, nicht wie ein Glücksspieler

Niemand bekommt das endgültige Bild beim ersten Versuch. Profis generieren, optimieren, generieren erneut.

Ein einfacher Workflow:

- Schritt eins: grundlegende Komposition, Motiv und Umgebung

- Schritt zwei: gerichtete Beleuchtung und Kontrast hinzufügen

- Schritt drei: Details verfeinern, Durcheinander entfernen

Jeder Durchgang verbessert das Ergebnis. So gelangen Sie von Glück zu Konsistenz.

Alles zusammenführen — Ein professionelles Prompt-Framework

Schreiben Sie Prompts nicht als lange Sätze. Schreiben Sie sie als modulare Systeme.

Hier ist eine Struktur, die funktioniert:

plaintext1[Motiv] + [Umgebung] + [Beleuchtung] + [Kamera] + [Komposition] + [Farbe] + [Einschränkungen]

Sehen Sie sich den Unterschied zwischen einem einfachen Prompt und einem strukturierten an.

Beispiel: Vom einfachen Prompt zum professionellen Prompt

Einfacher Prompt (typischer Benutzer):

Ein weibliches Model in einem weißen Sommerkleid, sauberer Hintergrund, Studiobeleuchtung, hohe Details, E-Commerce-Stil

Professioneller Prompt (strukturiert):

Ein weibliches Model in einem weißen Sommerkleid (Motiv), stehend in einem minimalistischen Studio mit einem weichen, beigen, texturierten Hintergrund (Umgebung), Seitenlicht von rechts, das weiche Schatten auf der linken Körperseite erzeugt, dezentes Konturlicht, das die Silhouette vom Hintergrund trennt (Beleuchtung), aufgenommen mit einem 85mm-Objektiv, Augenhöhe (Kamera), Motiv leicht außermittig mit geringer Schärfentiefe, weiche Unschärfe im Vordergrund zur Erzeugung von Tiefe (Komposition), warme natürliche Töne, weicher Kontrast (Farbe), saubere Komposition, kein Durcheinander, keine Verzerrung, keine zusätzlichen Objekte (Einschränkungen)

Fazit — Vom Prompten zum Regieführen

Ein einzelnes großartiges Bild zu bekommen ist schön. Aber echte Projekte benötigen Hunderte konsistente, hochwertige Visuals. Manuelles Prompten ist nicht skalierbar.

Sie stoßen auf praktische Probleme. Latenz. Kosten pro Bild. Beibehaltung des gleichen visuellen Stils über Batches hinweg. Das Prompt-Design allein kann diese nicht lösen. Sie brauchen ein System.

Daher wird API-basierte Bildgenerierung essenziell. Anstatt jedes Mal Prompts in ein Playground-Tool einzugeben, integrieren Sie die Generierung in Ihren Workflow. Strukturierte Prompts werden wiederverwendet. Automatisiert. Im Laufe der Zeit optimiert.

Plattformen wie Atlas Cloud bieten hierfür eine vereinheitlichte API-Schicht.

Und falls Sie:

• Entwickler sind, die einfachen, erschwinglichen KI-Zugang wünschen. • Teams sind, die Projekte handhaben, die KI in mehreren Bereichen benötigen. • Unternehmen sind, die zuverlässige KI für wichtige Arbeiten benötigen. • Personen sind, die Tools wie ComfyUI und n8n verwenden.

Probieren Sie AtlasCloud aus, und Sie werden feststellen, dass Sie vom Experimentieren zur Produktion übergehen. Sie müssen die Infrastruktur nicht von Grund auf neu aufbauen.

Bei der Zukunft geht es nicht darum, bessere Prompts isoliert zu schreiben. Es geht darum, kontrollierbare, wiederholbare, produktionsreife visuelle Systeme zu bauen.

FAQ

Warum sehen meine KI-Bilder immer noch flach aus?

Flache Bilder bedeuten normalerweise, dass Sie Tiefenhinweise weggelassen haben. Denken Sie daran, wie Fotografie funktioniert. Tiefe entsteht durch Schatten, sich überlappende Dinge und Unterschiede in der Schärfe. Ihr Prompt muss diese ausbuchstabieren.

Nehmen wir einen einfachen Prompt: „eine Person, die an einem Schreibtisch sitzt." Das sagt dem Modell fast nichts über Tiefe. Versuchen Sie stattdessen etwas wie: „eine Person, die an einem Schreibtisch sitzt (Mittelgrund), ein unscharfes Fenster mit Stadtlichtern (Hintergrund), eine Kaffeetasse im scharfen Fokus (Vordergrund)." Jetzt hat das Modell Ebenen, mit denen es arbeiten kann.

Beleuchtung ist ein weiterer Bereich, in dem Menschen Fehler machen. Viele Prompts erwähnen nur Umgebungslicht. Das ergibt eine flache, gleichmäßige Ausleuchtung über das gesamte Bild hinweg. Fügen Sie eine gerichtete Quelle hinzu. Seitenlicht. Gegenlicht. Konturlicht. Wählen Sie eine aus. Das Modell beginnt, Schatten zu werfen, und plötzlich hat Ihr Bild Volumen.

Noch etwas: Versuchen Sie nicht, jede Ecke des Rahmens mit Details zu füllen. Leerer Raum und Unschärfe sind nützlich. Sie sagen dem Betrachter, wo er hinschauen soll. Manchmal verleihen weniger Details mehr Tiefe.

Kann KI die Produktfotografie ersetzen?

Ja, für viele Fälle. Aber seien wir ehrlich, wo es funktioniert und wo nicht.

Wenn Sie eine Hero-Aufnahme für eine Luxusuhr benötigen – die Art, bei der jede Spiegelung auf dem Metall zählt und die Textur des Lederarmbands exakt sein muss –, gewinnt die traditionelle Fotografie immer noch. Dafür können Sie kein echtes Studio schlagen.

Für fast alles andere ist KI schneller und billiger. Katalogbilder. Lifestyle-Szenen. Saisonale Variationen. A/B-Test-Creatives. Sie können in Sekunden eine saubere Produktaufnahme vor weißem Hintergrund generieren. Nehmen Sie dann dieses Bild und setzen Sie es mit einem KI-Produktfotografie-Generator in eine Strandszene, eine Winterhütte oder eine moderne Küche ein.

Keine Studiovermietung. Kein Beleuchtungs-Rig. Keine Retusche. Jedes Bild kostet Pfennige.

Für kleine Marken und Direct-to-Consumer-Startups verändert dies das Spiel. Sie können jetzt Visuals produzieren, die mit Unternehmen konkurrieren, die große Budgets haben. Das war vor zwei Jahren noch nicht möglich.

Wie unterscheidet sich das OpenAI-Modell zur visuellen Generierung von früheren Versionen?

Das neue Modell, GPT‑image‑1.5, hat unter der Haube einige architektonische Änderungen. Es verwendet einen Diffusions-Transformer. Das ist eine schicke Art zu sagen, dass es räumliche Beziehungen besser handhabt.

Ältere Versionen zerlegten komplexe Szenen oft in Teile, die nicht ganz zusammenpassten. Eine Hand schwebte vielleicht in der Nähe einer Tasse, anstatt sie zu halten. Schatten zeigten in die falsche Richtung. Die neue Version hält die Dinge verbunden. Eine Hand hält die Tasse. Der Schatten fällt dort hin, wo er sollte.

Die Textwiedergabe ist ein weiterer großer Sprung. Frühere Modelle produzierten verstümmelte Zeichen, die wie zufällige Symbole aussahen. GPT‑image‑1.5 generiert lesbare Wörter in mehreren Sprachen. Sie können Englisch und Chinesisch im selben Bild mischen. Das funktioniert jetzt tatsächlich.

Das Modell unterstützt auch nativ höhere Auflösungen – bis zu 2K ohne Upscaling. Weniger Artefakte. Schärfere Details.

Es gibt eine Kehrseite. Das Modell verzeiht vage Prompts weniger. Sie können nicht einfach „ein schönes Porträt" sagen und Magie erwarten. Sie müssen sorgfältiger sein. Aber wenn Sie ihm strukturierte Anweisungen geben – Lichtrichtung, Tiefenebenen, Kameraeinstellungen –, ist die Ausgabequalität besser als alles aus früheren Generationen.