Resumen: GLM-5-Turbo, desarrollado por Zhipu AI (Z.ai), es un modelo de lenguaje extenso diseñado para casos de uso de OpenClaw y el primer lanzamiento de código cerrado de la compañía (previamente probado bajo el nombre en clave Pony-Alpha-2), y está programado para lanzarse pronto en Atlas Cloud.

El modelo ofrece mejoras significativas en el uso de herramientas, la ejecución de instrucciones, los flujos de trabajo de múltiples pasos y el manejo de tareas a largo plazo, a la vez que admite una ventana de contexto de hasta 200 000 tokens. Sus capacidades de análisis de datos son comparables a las de Claude Opus 4.6, y supera a GLM-5 en tareas de automatización y procesamiento de información. Al aprovechar la API unificada y el ecosistema multimodelo de Atlas Cloud, GLM-5-Turbo permite una implementación eficiente en automatización empresarial compleja, análisis de documentos extensos y desarrollo de software, ofreciendo una solución de IA rentable y fácil de integrar para desarrolladores y empresas.

¡Nos complace anunciar que GLM-5-Turbo llegará a Atlas Cloud!

- ¿Qué es GLM-5-Turbo?: Desarrollado por Zhipu AI (Z.ai), GLM-5-Turbo es un modelo de lenguaje extenso adaptado para casos de uso de OpenClaw. Marca el primer lanzamiento de código cerrado del equipo, ofreciendo una mayor eficiencia en tiempo de ejecución que GLM-5 a un menor coste por llamada. Antes de esto, Zhipu AI había probado informalmente su modelo de próxima generación bajo el nombre en clave Pony-Alpha-2.

- Características principales: GLM-5-Turbo ofrece mejoras sustanciales en el uso de herramientas, seguimiento de instrucciones, flujos de trabajo de múltiples pasos y ejecución persistente de tareas. Admite modos de razonamiento dinámico en distintos escenarios, salida de streaming en tiempo real, integración mejorada de herramientas y gestión de contexto extenso de hasta 200 000 tokens.

- Fecha de lanzamiento: 24.03.2026.

GLM-5 llamó la atención anteriormente como el modelo de código abierto con mejor rendimiento en el Artificial Analysis Intelligence Index, superando a Gemini 3 Pro. Como su sucesor, GLM-5-Turbo introduce una serie de actualizaciones iterativas que se detallan a continuación.

Posicionamiento central: un modelo optimizado para ClawBench

Sólido rendimiento en pruebas comparativas

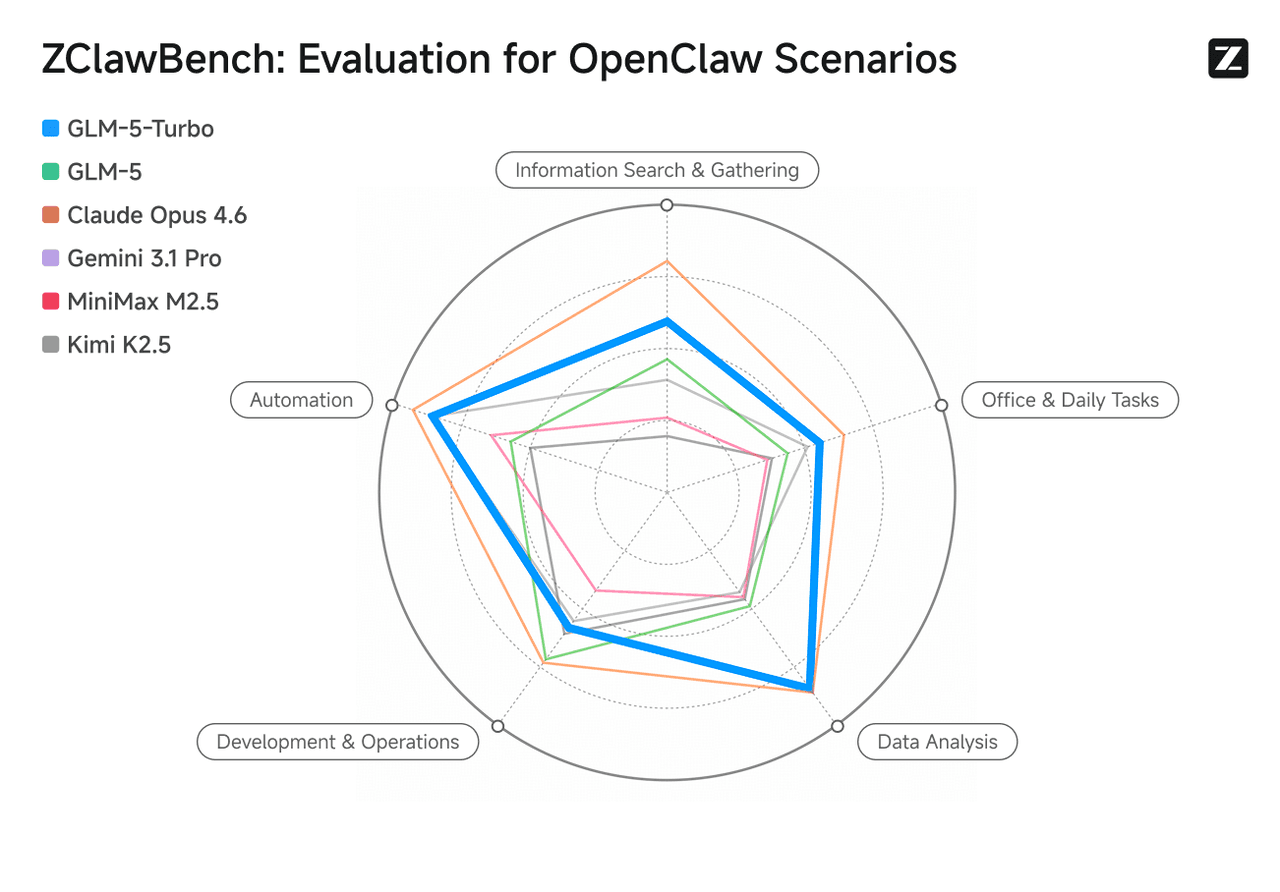

Optimizado para escenarios OpenClaw, GLM-5-Turbo mejora significativamente las capacidades en la invocación de herramientas, la ejecución de instrucciones y la orquestación de tareas complejas. Su rendimiento en el análisis de datos está a la par con Claude Opus 4.6, al tiempo que supera a GLM-5 en automatización, recuperación de información, productividad de oficina y tareas analíticas.

Fuente de la imagen: sitio web oficial de Zhipu AI (Z.ai).

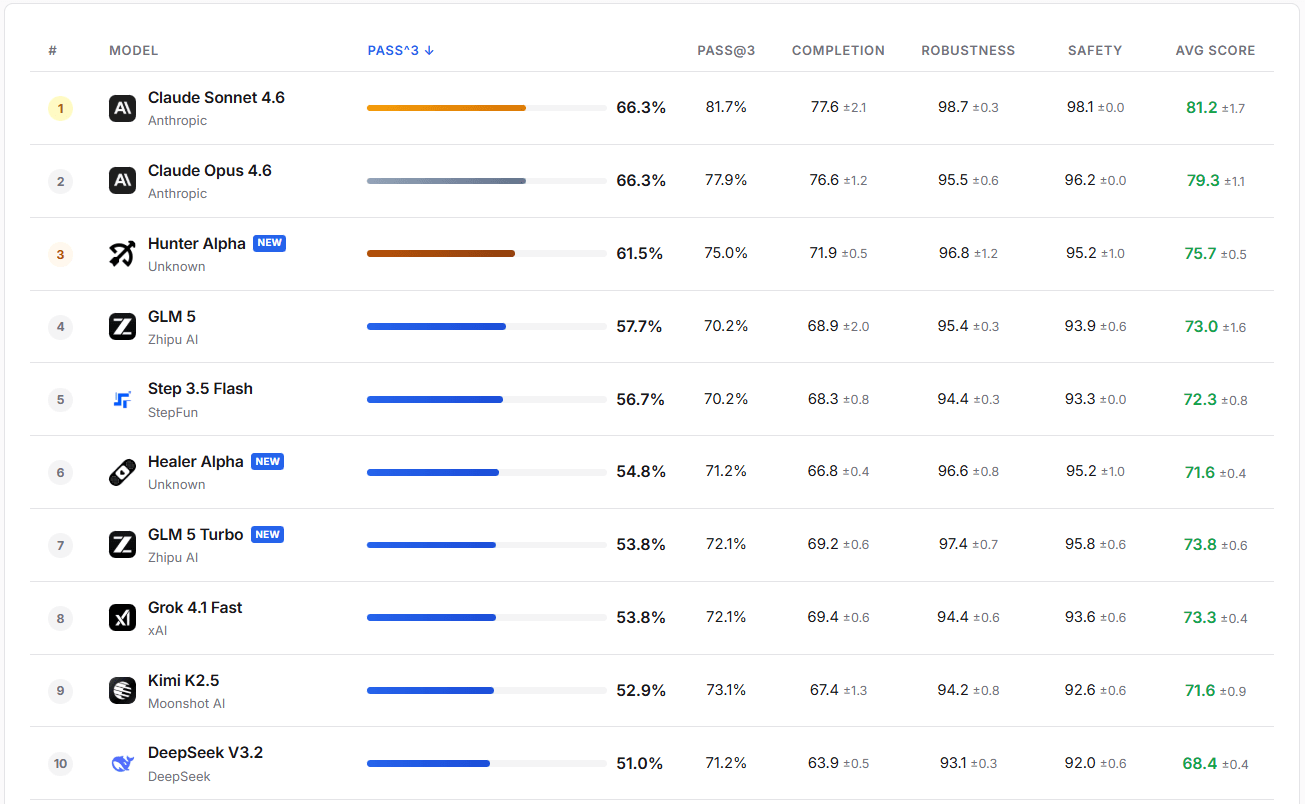

En evaluaciones prácticas, GLM-5-Turbo demuestra una alta robustez y seguridad. Su tasa de éxito PASS@3 supera a la de GLM-5, Step 3.5 Flash y Kimi K2.5.

Fuente de la imagen: https://claw-eval.github.io/

Uso mejorado de herramientas e integración externa

Z.ai ha reforzado las capacidades agentes de GLM-5-Turbo durante el entrenamiento, permitiendo una interacción fluida con herramientas externas. Esta orientación hacia la ejecución conlleva compensaciones: algunos usuarios informan de un tono ligeramente más mecánico en comparación con GLM-5 en escenarios de juego de roles (role-playing).

Para adaptarse a las diferentes fortalezas de los modelos, Atlas Cloud proporciona una interfaz unificada que permite a los usuarios consultar varios modelos simultáneamente, lo que permite la comparación y selección lado a lado.

Además, los usuarios pueden definir habilidades personalizadas o permitir que GLM-5-Turbo las descubra e instale de forma autónoma.

Fuente de la imagen: Atlas Cloud

Ejecución autónoma a largo plazo

GLM-5-Turbo está optimizado para tareas que requieren activadores programados o tiempos de ejecución prolongados. Maneja flujos de trabajo persistentes, de múltiples etapas y cronológicamente diversos con una gran continuidad de tareas.

El modelo sugiere de forma proactiva estrategias de ejecución basadas en la complejidad de la tarea. En pruebas comparativas de optimización de código, GLM-5-Turbo produjo recomendaciones que superaron a los modelos de la competencia en aproximadamente el 10% de los casos.

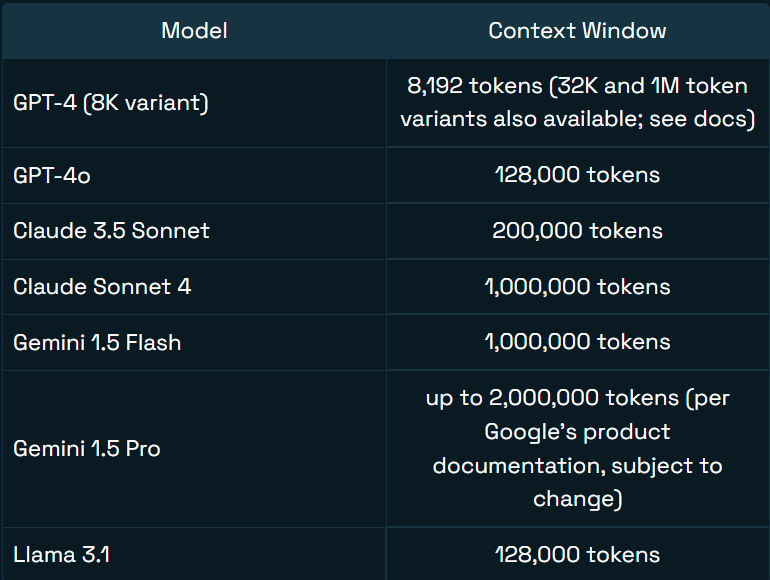

Ventana de contexto de 200 000 tokens

Con soporte para hasta 200 000 tokens (aproximadamente 133 000 palabras en inglés), GLM-5-Turbo puede retener y utilizar un contexto extenso dentro de una sola sesión. Esto permite una recuperación precisa de información previa incluso en las etapas finales de una conversación.

Fuente de la imagen: Jim Allen Wallace (Redis)

Casos de uso

Automatización de flujos de trabajo complejos

Con sus capacidades mejoradas de OpenClaw, GLM-5-Turbo puede descomponer procesos empresariales complejos, identificar la lógica subyacente y localizar o generar de forma autónoma las habilidades necesarias para ejecutar tareas.

Por ejemplo, en la producción de vídeos de formato corto, el modelo puede buscar, instalar y orquestar herramientas de escritura, generación de imágenes y producción de vídeo, planificando y ejecutando todo el flujo de trabajo de principio a fin.

Análisis profundo y preguntas y respuestas de documentos extensos

El modelo mantiene un contexto completo en documentos largos dentro de una sola sesión, lo que permite responder preguntas de múltiples turnos con precisión. Su alta eficiencia de tokens garantiza respuestas rápidas con un menor coste computacional.

En bases de código a gran escala, GLM-5-Turbo puede analizar el diseño arquitectónico, mapear dependencias entre componentes y señalar posibles efectos en cascada a partir de cambios de código de bajo nivel.

"Vibe Coding"

Dentro del ciclo de vida del desarrollo de software, GLM-5-Turbo funciona más como un ingeniero de pila completa (full-stack) integrado en flujos de trabajo complejos. Los desarrolladores pueden delinear la lógica de alto nivel mientras el modelo construye incrementalmente la arquitectura de la aplicación en tiempo real.

Combinado con habilidades multimodales, los usuarios pueden subir imágenes de la interfaz de usuario, grabaciones de pantalla o bocetos, que el modelo puede convertir directamente en componentes de frontend funcionales.

¿Por qué usar GLM-5-Turbo en Atlas Cloud?

Como plataforma de infraestructura de IA multimodal, Atlas Cloud proporciona a los usuarios una interfaz de API unificada. Una vez conectados, los usuarios pueden desbloquear fácilmente más de 300 modelos avanzados de IA, incluyendo modelos de generación de texto, imágenes, vídeo o modelos multimodales.

Público objetivo

- Desarrolladores independientes que buscan soluciones de bajo coste y simplificadas para llamar a varios modelos de IA.

- Empresas que requieren una infraestructura estable, segura y escalable para apoyar su negocio principal.

- Equipos de desarrollo que necesitan integrar de manera eficiente múltiples modelos intermodales en sus proyectos.

- Usuarios de flujo de trabajo que priorizan la compatibilidad de la cadena de herramientas y utilizan ComfyUI o n8n.

Características del producto

- Integración muy simplificada: La plataforma proporciona una API compatible con OpenAI, simplificando instantáneamente la carga de trabajo del desarrollador. No más malabarismos con claves de múltiples proveedores ni preocupaciones por los costes de mantenimiento entre plataformas.

- Ventaja de costes: En comparación con la competencia, Atlas Cloud tiene costes de implementación más bajos. Nano Banana 2 cuesta $0,056 por imagen (competidor: $0,07 por imagen); Veo 3.1 tiene un precio de $0,09 por segundo (competidor: $0,1 por segundo). Además, la interfaz Playground ofrece una transparencia total de precios, con el botón "Ejecutar" indicando directamente el importe de la deducción por imagen o segundo de vídeo.

- Estabilidad y soporte de nivel empresarial: Atlas Cloud garantiza que la protección de datos cumpla con estrictos estándares de privacidad y puede manejar información confidencial.

- Fácil de usar (Plug-and-Play): Creado para funcionar sin esfuerzo con herramientas como ComfyUI y n8n, ayudando a las empresas a reducir los costes de cambio y comenzar rápidamente.

Comparación con productos similares

- Fal.ai: Aunque ofrecen algunos modelos, Atlas Cloud proporciona una selección más amplia (más de 300), precios más competitivos y los nuevos usuarios registrados reciben un crédito de prueba de $1.

- Wavespeed: El precio es significativamente más alto. Atlas Cloud ofrece soporte de cumplimiento empresarial adicional y orientación técnica experta que Wavespeed no enfatiza.

- Kie.ai: Utiliza un sistema de créditos opaco. Atlas Cloud muestra el coste exacto de cada ejecución directamente en la interfaz. El número de modelos también es mayor que el de Kie.ai.

- Replicate: Se centra en el alojamiento de modelos. Las ventajas de Atlas Cloud residen en la unificación de la API, la velocidad de implementación del modelo y políticas de soporte más amigables para los desarrolladores.

- OpenAI o Google: Estos proveedores solo proporcionan sus propios modelos. Los usuarios con necesidades intermodales generalmente necesitan integrar múltiples servicios. Atlas Cloud integra modelos propietarios y de código abierto bajo una única API, reduciendo la complejidad del sistema.

¿Cómo usar GLM-5-Turbo en Atlas Cloud?

Método 1: Usar directamente en la plataforma

Método 2: Usar mediante integración API

Paso 1: Obtenga su clave API. Cree y pegue su clave API en la consola:

Paso 2: Consulte la documentación de la API. Verifique los parámetros de solicitud, métodos de autenticación, etc.

Paso 3: Realice su primera solicitud (Ejemplo en Python)

GLM-5 como ejemplo.

plaintext1{ 2 "model": "zai-org/glm-5", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

Preguntas frecuentes

¿Cuál es la diferencia entre GLM-5-Turbo y GLM-5? GLM-5-Turbo es más rápido y rentable, con una eficiencia de tokens significativamente mejorada, reportada como hasta tres veces mayor que la de GLM-5. También está específicamente optimizado para escenarios de OpenClaw.

¿Cómo se compara GLM-5-Turbo con MiniMax M2.7? Ambos modelos están optimizados para el uso de herramientas de agentes y cuentan con una mayor eficiencia de tokens que GLM-5. Cada uno admite ventanas de contexto de alrededor de 200 000 tokens (MiniMax M2.7 admite 196 608 tokens). Estamos preparando una publicación de blog para una evaluación comparativa más detallada. ¡Manténgase al tanto!

¿Qué modelo GLM se recomienda para la implementación de OpenClaw? GLM-5-Turbo, ya que está específicamente optimizado para escenarios de OpenClaw y logra un rendimiento de análisis de datos comparable a Claude Opus 4.6.